Command Palette

Search for a command to run...

异构科学基础模型协作

异构科学基础模型协作

Zihao Li Jiaru Zou Feihao Fang Xuying Ning Mengting Ai Tianxin Wei Sirui Chen Xiyuan Yang Jingrui He

摘要

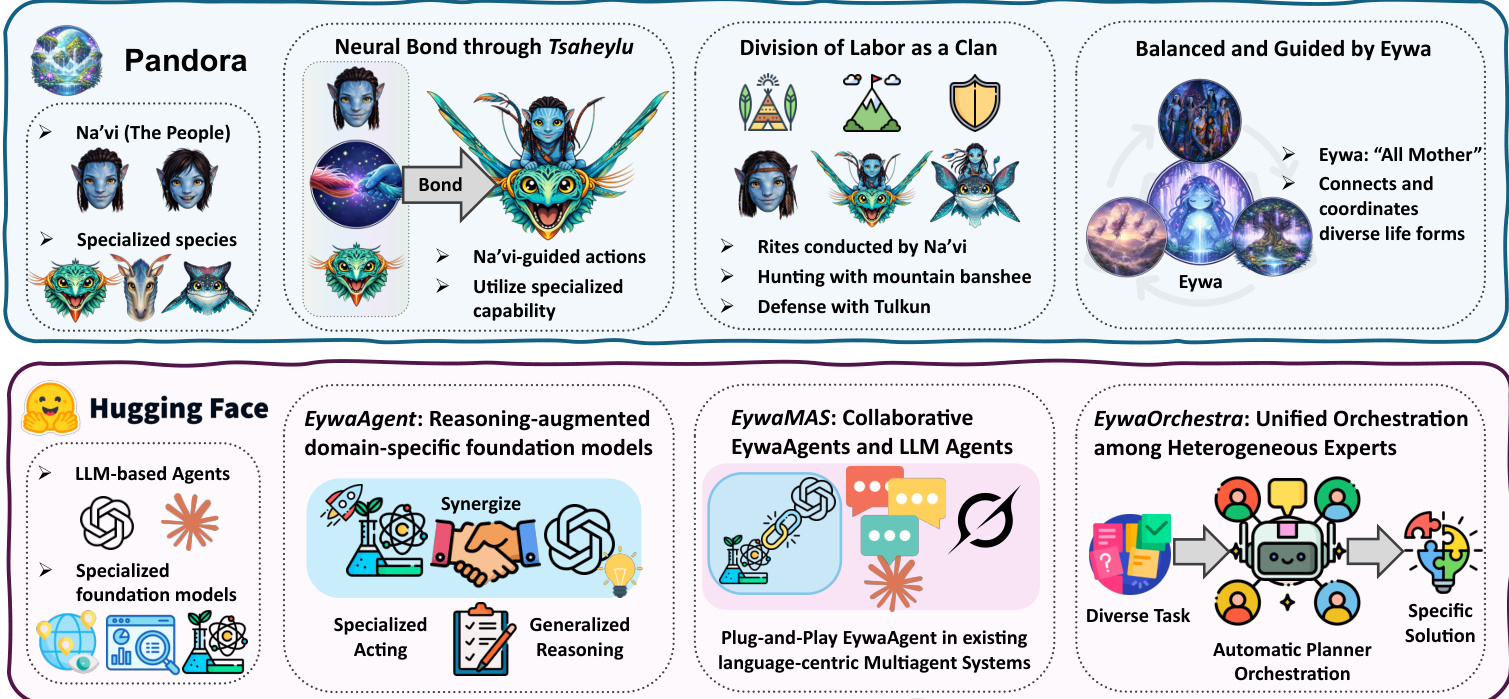

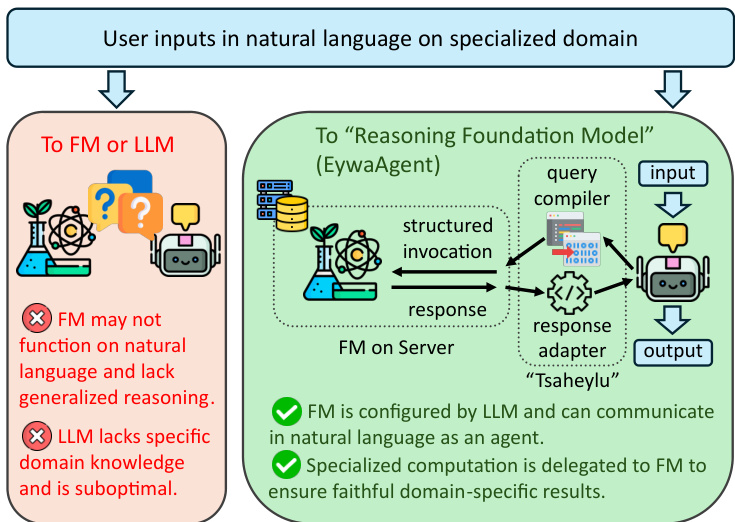

智能体大型语言模型系统已展现出强大的能力。然而,其将语言作为通用接口的特性,从根本上限制了其在许多现实问题中的应用,尤其是在科学领域,该领域已开发出针对超越自然语言处理的专门任务而优化的特定领域基础模型。在本工作中,我们推出了 Eywa,这是一个异构智能体框架,旨在将以语言为中心的系统扩展至更广泛的科学基础模型类别。Eywa 的核心思想是利用基于语言模型的推理接口来增强特定领域的基础模型,使语言模型能够引导对非语言数据模态的推理。这种设计使得通常针对特定数据和任务进行优化的预测性基础模型,能够参与到智能体系统中的高层推理和决策过程中。Eywa 既可以作为单智能体管道的即插即用替代方案(EywaAgent),也可以通过用特定智能体替换传统智能体的方式集成到现有的多智能体系统中(EywaMAS)。我们进一步研究了一种基于规划的编排框架,在该框架中,规划器动态协调传统智能体和 Eywa 智能体,以跨异构数据模态解决复杂任务(EywaOrchestra)。我们在涵盖物理、生命和社会科学的广泛科学领域中对 Eywa 进行了评估。实验结果表明,Eywa 提高了涉及结构化数据和特定领域数据的任务性能,同时通过与特定领域基础模型的有效协作,降低了对基于语言推理的依赖。

一句话总结

作者提出了 Eywa,一种异构 Agent 框架。该框架通过基于语言模型的推理接口增强特定领域的科学基础模型,以指导对非语言数据的推理。它支持单 Agent、多 Agent 以及基于规划的编排配置,能够在物理、生命及社会科学领域提升结构化科学任务的性能,同时降低对自然语言推理的依赖。

核心贡献

- 本研究提出了 Eywa,一种异构 Agent 框架,将以语言为中心的流水线扩展至科学基础模型。通过在专用模型上增加基于语言的推理接口,该架构使大语言模型能够指导非语言数据模态的推理,同时保留原生结构化数据的归纳偏置。

- 该框架支持灵活部署,提供即插即用的单 Agent 流水线(EywaAgent)、模块化多 Agent 集成模块(EywaMAS),以及能够跨不兼容数据格式动态协调异构专家的基于规划的编排系统(EywaOrchestra)。

- 在物理、生命及社会科学基准上的评估表明,Eywa 在处理涉及结构化及领域特定数据的任务时提升了性能,并通过与专用基础模型的协同推理降低了对纯语言推理的依赖。

引言

由大语言模型驱动的 Agent AI 系统已彻底改变了复杂问题的求解方式,但其对自然语言的严格依赖为依赖时序数据、分子结构和晶体图等专用非语言数据的科学应用带来了显著瓶颈。先前方法通常将结构化信息强制转换为文本格式,或将领域特定基础模型视为被动可调用的工具,这牺牲了结构保真度并阻碍了直接的模态原生协作。为弥补这一差距,作者提出了 Eywa,一种异构 Agent 框架,通过新型推理接口将通用大语言模型与专用科学模型相连接。该框架通过基于语言的协调机制增强领域特定基础模型,使其能够直接参与规划与决策工作流。在单 Agent、多 Agent 及动态编排配置中部署时,Eywa 在物理、生命及社会科学领域持续提升了任务效用,同时降低了 token 消耗与执行时间。

数据集

-

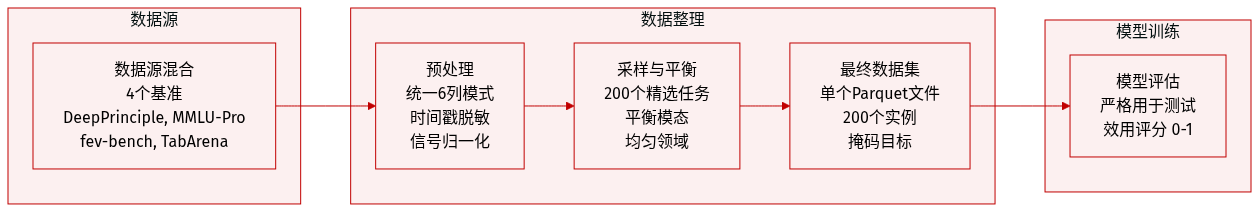

数据集构成与来源

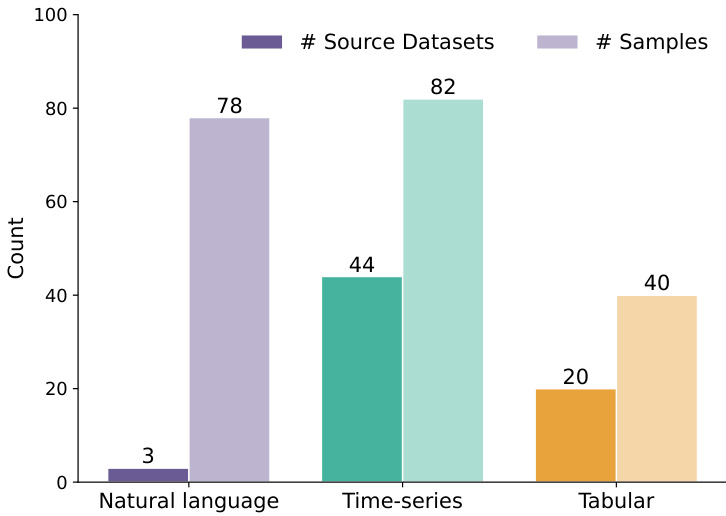

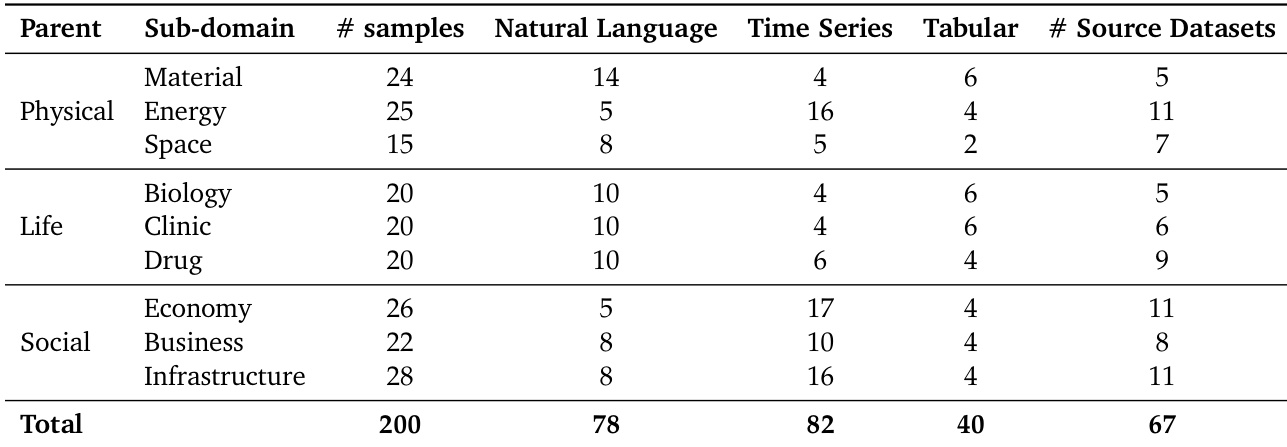

- 作者提出了 EywaBench,这是一个可扩展的基准测试,旨在跨自然语言、时序数据和表格数据三种核心模态评估科学 Agent 系统。

- 该基准测试整合了来自四个主要来源的任务:DeepPrinciple、MMLU-Pro、fev-bench 和 TabArena。这些来源共同涵盖了跨越物理、生命及社会科学的 67 个独立底层科学数据集。

-

子集详情与规模

- 发布的 EywaBench-V1 划分精确包含 200 个经过精心筛选的任务实例,这些实例从更大的源池中采样而来。

- DeepPrinciple 提供科学问答任务(1,125 道原始题目),MMLU-Pro 提供开放式推理题目(6,978 道原始题目),fev-bench 提供时序预测任务(96 个数据集,每个最多包含 30,000 条协变量序列),TabArena 提供表格分类与回归任务(51 个数据集,每个最多包含 150,000 行)。

- 作者强制在三个父领域(32%、30%、38%)、九个子领域(每个 15 至 28 个实例)以及三种模态(41%、39%、20%)上实现近乎均匀的分布,以防止领域坍缩,并确保每个子领域均包含所有模态的混合数据。

-

处理与模式构建

- 每个源数据集均使用自定义解析脚本转换为统一的六列模式,并存储为带有 Snappy 压缩的单个字典编码 Parquet 文件。

- 作者对时间特征应用时间戳匿名化与重新索引,以防止模型依赖记忆的历史趋势,并对数值信号进行归一化,以维持跨任务的一致缩放比例。

- 对于表格任务,目标列会被掩码以模拟现实世界的预测场景,而底层流水线支持对时间窗口、协变量组或行子集的可扩展重采样,且不改变基准测试的模式。

-

使用与评估策略

- 该数据集严格用于评估而非训练,为测试多 Agent 编排、跨模态推理及专家模型集成提供了受控环境。

- 作者采样 200 个实例以保持模态覆盖的平衡,同时确保评估可复现且便于专家验证。

- 性能通过 0 到 1 之间的统一效用分数进行衡量,语言任务采用软匹配评分计算,时序与表格任务采用归一化预测误差计算,从而实现直接的跨模态对比。

方法

Eywa 框架引入了一种模块化架构,旨在将专用领域基础模型(FMs)与通用语言模型(LLMs)相集成,以增强 Agent 系统的推理与执行能力。其核心是 EywaAgent,这是一种统一 Agent,通过名为 FM-LLM “Tsaheylu” 链的双向通信接口,将基于语言的推理与领域特定计算相结合。该链接使语言模型能够正确配置并调用基础模型进行专用计算,同时将输出无缝重新整合至推理流程中。Tsaheylu 接口被形式化为一对函数:查询编译器 ϕk 负责将任务状态翻译为基础模型的结构性调用,响应适配器 ψk 负责将基础模型的输出转换为兼容语言的表示。此通信流水线使 Agent 能够动态决定在内部执行计算还是将其委托给基础模型,从而在通用推理与专用执行之间灵活适应。

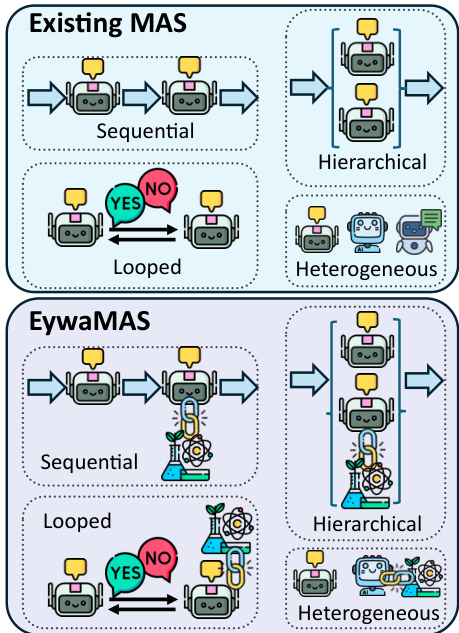

该框架通过 EywaMAS 将此单 Agent 范式扩展至多 Agent 系统,通过允许异构 Agent(包括标准 LLM Agent 与 EywaAgent)在统一框架内交互,对现有系统进行了泛化。这使得领域特定基础模型能够以即插即用方式集成到现有系统中,无需更改通信协议或系统设计。EywaMAS 的通信与状态更新动态遵循标准多 Agent 系统模型,其中 Agent 根据接收到的信息更新状态并生成消息,交互由通信拓扑控制。该方法支持在不同语言模型、基础模型及 Agent 类型之间进行灵活组合。

为应对多样化现实任务对 Agent 与拓扑不同配置的需求,框架引入了 EywaOrchestra,一种动态编排系统。EywaOrchestra 充当指挥器角色,根据输入任务动态实例化异构多 Agent 系统,通过选择适当的语言模型、基础模型及通信拓扑来实现。这种自适应编排使系统突破静态设计限制,利用模型适应性与结构适应性为每项任务选择最优配置。该指挥器实例化为大语言模型,将输入任务映射至候选配置池中的系统配置,随后执行该配置以解决问题。该框架确保系统能够自适应地利用不同组件的优势,在广泛任务中实现最优性能。

对 Eywa 框架的理论分析确立了其相对于纯语言 Agent 与系统的优越性。在基础模型具有领域优势(即在领域特定输入上表现优于纯语言模型)的假设下,EywaAgent 能够实现严格更低的预期最优任务损失。这一提升源于 EywaAgent 通过 Tsaheylu 接口直接访问领域特定输入,从而绕过语言序列化带来的信息瓶颈。分析进一步表明,EywaMAS 可通过通信图传播这一优势,使包含至少一个 EywaAgent 的系统能够解决纯语言系统难以处理的难题,前提是信息能够传递至最终输出节点。最后,EywaOrchestra 的动态编排为任何固定配置提供了额外的严格改进,因为它能够针对每项任务自适应最优设置,从而在性能上超越静态多 Agent 系统。

实验

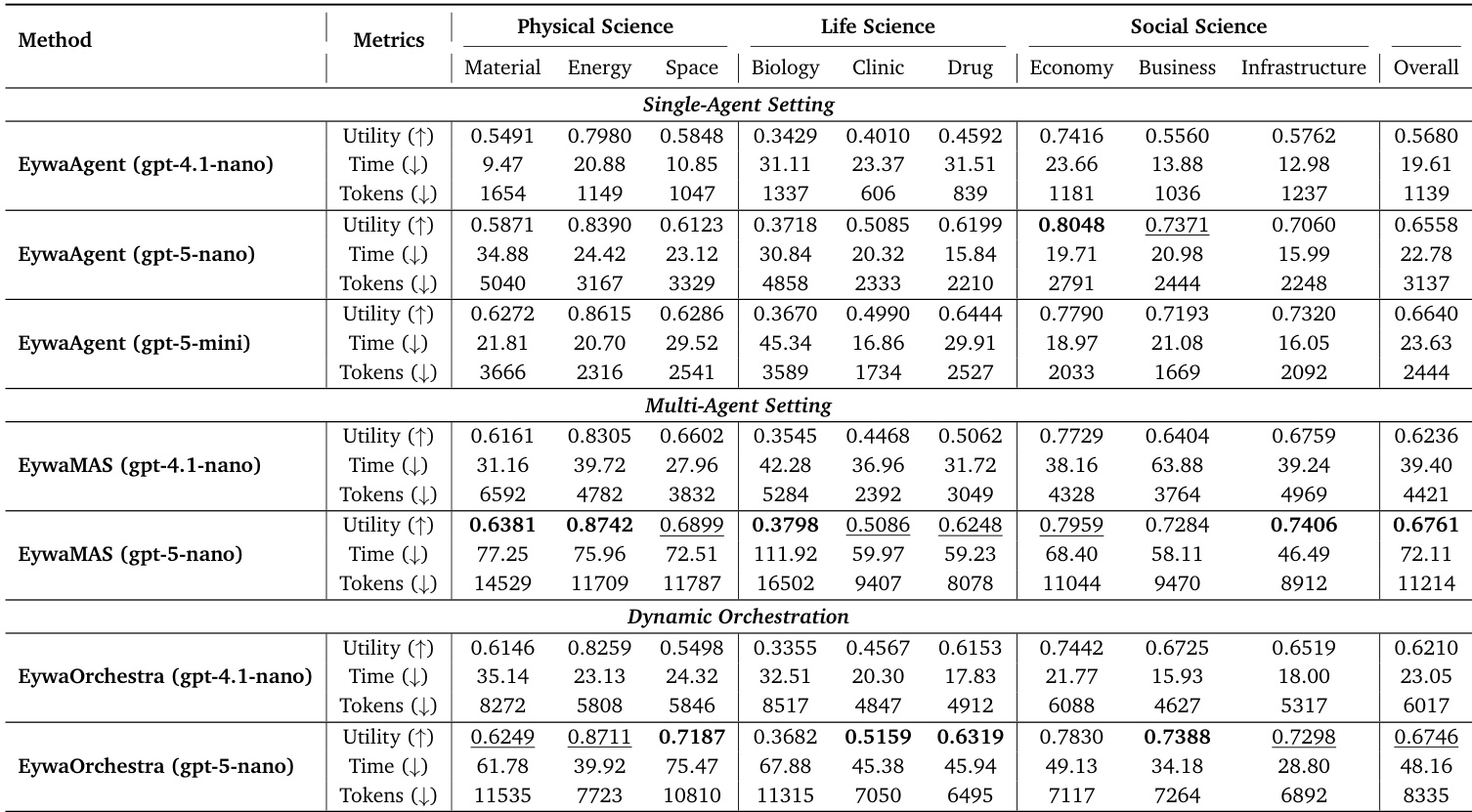

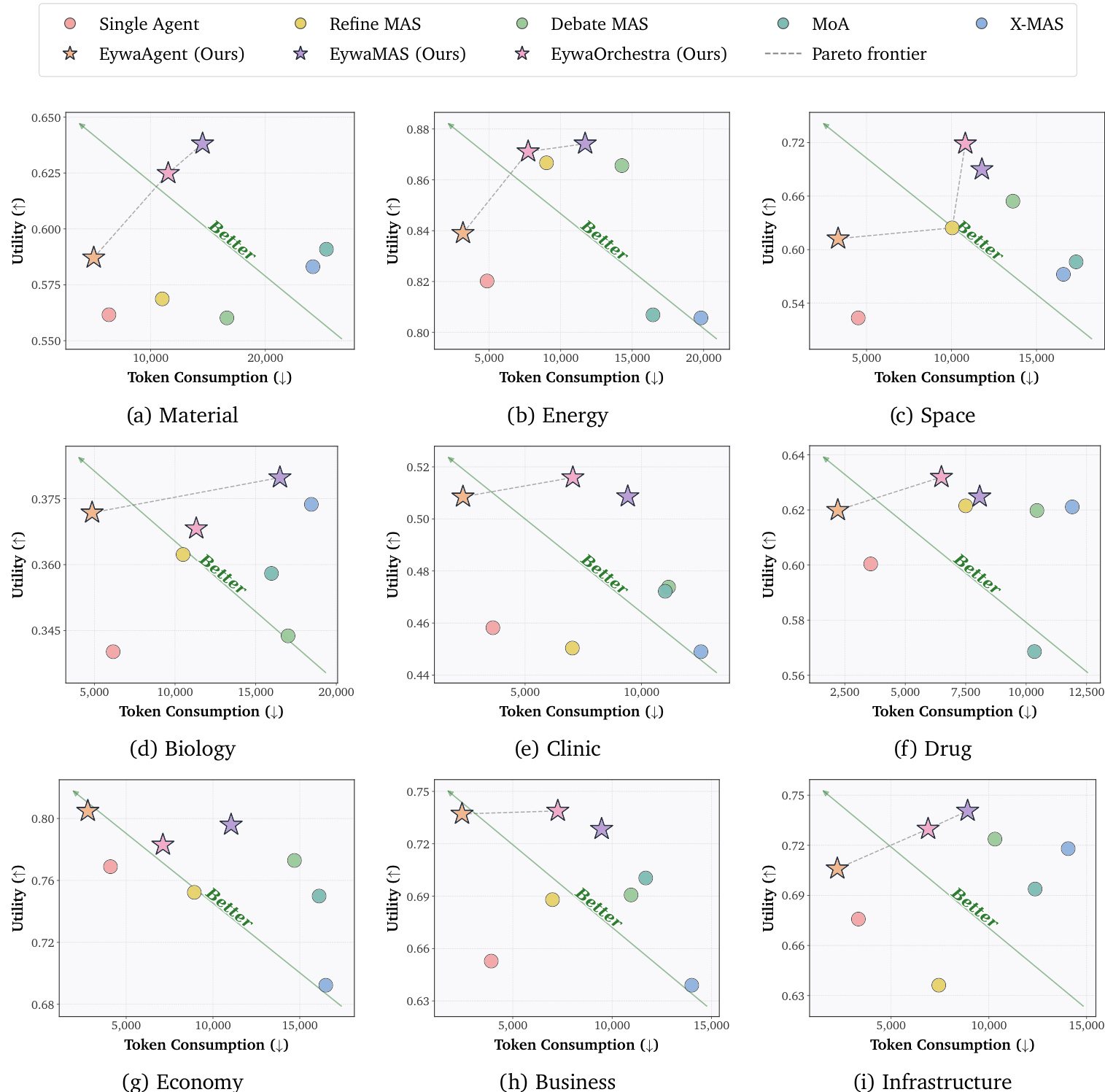

在 EywaBench 上跨多个科学领域的评估表明,本研究将 Eywa 的单 Agent、多 Agent 及动态编排配置与仅基于 LLM 的基线进行对比,以验证将领域特定基础模型集成至 Agent 工作流的必要性。主要性能测试与效率分析证实,通过将结构化数值任务路由至专用预测器而非依赖冗余的语言模型交互,跨模态协作始终优于纯语言多 Agent 系统。超参数与主干消融实验进一步验证了框架的架构鲁棒性,确认其性能提升源于跨模态设计,而非特定的模型检查点或提示模板。最后,定性案例研究证实自适应编排成功将任务复杂度匹配至相应配置,表明动态系统选择在质量与效率上均优于固定多 Agent 拓扑。

作者在对 EywaBench 上 EywaAgent、EywaMAS 与 EywaOrchestra 针对多种基线方法的评估中,聚焦于效用、推理时间与 token 消耗。结果显示,Eywa 方法整体表现强劲,其中 EywaAgent 在保持竞争力效用的同时,在 token 使用方面尤为高效。EywaMAS 在提出方法中实现最高效用,而 EywaOrchestra 通过动态选择最优配置来平衡效用与效率。分析强调,集成领域特定基础模型能够提升性能并减少多 Agent 系统中的冗余。通过利用领域特定基础模型,EywaAgent 相比单 Agent 基线实现了更高的效用并显著降低了推理成本。EywaMAS 在效用上优于同质多 Agent 基线,同时保持较低的 token 消耗。EywaOrchestra 动态选择配置,以较低的推理成本实现接近 EywaMAS 的效用,证明了自适应编排的有效性。

作者在对 EywaBench 上多种 Agent 配置的评估中,跨科学领域对比了单 Agent、多 Agent 及动态编排系统。结果表明,EywaAgent 及其变体在降低推理成本的同时实现了高效用,EywaOrchestra 则通过自适应任务路由提供性能与效率的平衡。所提方法在效用与效率上均优于仅基于 LLM 的基线,特别是在利用专用基础模型的领域特定任务中表现突出。通过将领域特定任务委托给专用基础模型,EywaAgent 相比单 Agent 基线提升了效用并降低了推理成本。EywaMAS 凭借跨模态协调机制,在效用上优于同质多 Agent 基线且效率更高。EywaOrchestra 动态选择最优配置,在显著降低 token 消耗与延迟的同时,达到接近专家设计系统的效用水平。

作者在对 EywaBench 上提出系统针对多种基线的评估中,证明将领域特定基础模型与语言模型集成可提升效用并降低推理成本。与单 Agent 基线相比,EywaAgent 实现了更高的效用与更低的 token 使用量,而 EywaMAS 与 EywaOrchestra 则分别通过多 Agent 协调与自适应编排进一步提升了效用。结果表明,跨模态异构性比仅基于 LLM 的异构性更具优势,且动态编排能够以较低成本实现接近专家设计系统的性能。通过将领域特定任务委托给基础模型,EywaAgent 相比单 Agent 基线提升了效用并降低了 token 使用量。EywaMAS 通过跨模态协调实现了高于同质多 Agent 基线的效用,而 EywaOrchestra 则以更低的推理成本匹配了其性能。EywaOrchestra 中的动态编排实现了任务自适应的系统选择,与固定多 Agent 设置相比,在降低计算成本的同时保持了强劲效用。

作者在对 EywaBench 上多种 Agent 系统的评估中,对比了集成语言模型与领域特定基础模型的单 Agent 及多 Agent 方法。结果表明,所提方法(EywaAgent、EywaMAS 与 EywaOrchestra)相比基线方法在实现高效用的同时降低了 token 消耗,尤其在科学领域表现明显。分析揭示,跨模态异构性与动态编排能够提升性能并降低计算成本。与仅基于 LLM 的基线相比,EywaAgent 实现了高效用且 token 消耗显著更低,证明了对领域特定模型的高效委托机制。EywaMAS 与 EywaOrchestra 在效用上优于同质与异构的仅基于 LLM 的多 Agent 基线,其中 EywaOrchestra 在降低推理成本的同时逼近 EywaMAS 的性能。所有 Eywa 变体在子领域内均一致占据或接近帕累托前沿,表明其在效用与 token 消耗之间的权衡优于其他方法。

实验在多个科学领域评估了 EywaAgent、EywaMAS 与 EywaOrchestra 的性能,并将其与多种基于 LLM 的基线进行对比。结果显示,Eywa 方法在降低推理成本与 token 消耗的同时实现了强劲效用,其中 EywaAgent 效率最高,EywaOrchestra 则提供自适应编排,以较低成本匹配高效用。Eywa 的有效性在不同 LLM 后端中保持一致,且对超参数变化与提示设计保持鲁棒。与单 Agent 基线相比,EywaAgent 显著提升了效用并降低了推理成本与 token 使用量。EywaOrchestra 通过为每项任务动态选择最优配置,以较低成本实现了接近 EywaMAS 的效用。Eywa 方法在不同 LLM 后端中均保持强劲性能,并对超参数变化与提示设计选择具有鲁棒性。

在 EywaBench 跨多个科学领域的评估中,实验将 EywaAgent、EywaMAS 与 EywaOrchestra 与单 Agent、多 Agent 及仅基于 LLM 的基线进行对比。该设置验证了 EywaAgent 能够有效将任务委托给领域特定基础模型,从而在降低计算开销的同时提升效用。研究进一步证实,EywaMAS 与 EywaOrchestra 利用跨模态协调与自适应编排,持续超越固定配置,以显著更低的成本实现专家级结果。总体而言,这些发现表明,将专用模型与动态系统选择相结合,能够在不同条件下实现性能与效率之间稳健且具成本效益的权衡。