Command Palette

Search for a command to run...

ClawGym:构建高效Claw代理的可扩展框架

ClawGym:构建高效Claw代理的可扩展框架

摘要

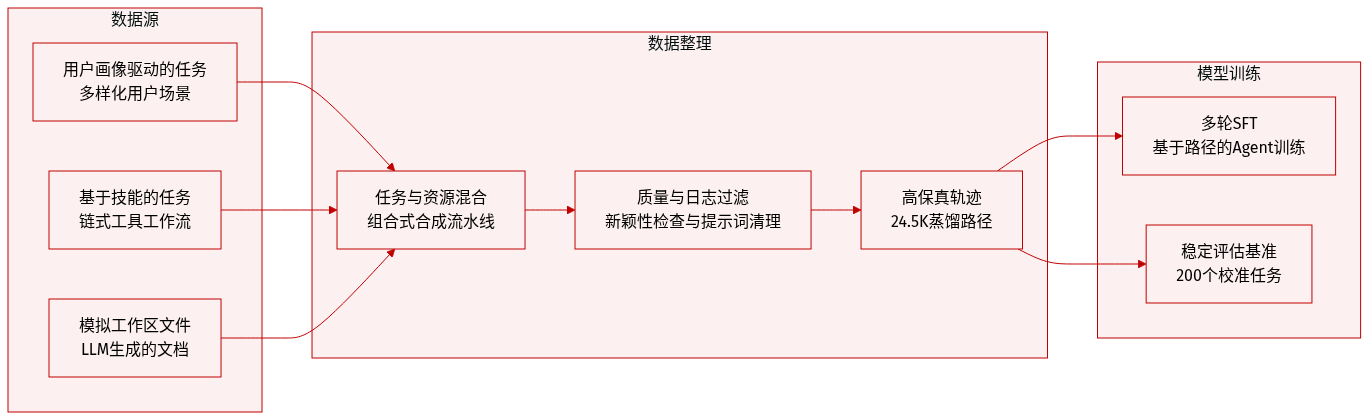

Claw-style 环境支持针对本地文件、工具以及持久化工作区状态的复杂多步工作流。然而,由于缺乏系统化的框架(特别是缺乏合成可验证训练数据并将其与 agent 训练及诊断评估相结合的框架),围绕这些环境的规模化开发仍受到限制。为应对这一挑战,我们提出了 ClawGym,这是一个支持 Claw-style personal agent 开发全生命周期的可扩展框架。具体而言,我们构建了 ClawGym-SynData,这是一个包含 1.35 万个经过筛选任务的多样化数据集。这些任务由基于人设的意图和技能导向的操作合成而来,并配以逼真的模拟工作区及混合验证机制。随后,我们在黑盒 rollout 轨迹上对一系列具备能力的 Claw-style 模型进行监督微调,将其命名为 ClawGym-Agents,并进一步通过一个轻量级流水线探索强化学习,该流水线在任务级沙箱中并行化 rollout 过程。为了支持可靠的评估,我们进一步构建了 ClawGym-Bench,这是一个包含 200 个实例的基准测试集,通过自动化筛选以及人工与大语言模型(LLM)的联合审核进行了校准。相关资源即将在 https://github.com/ClawGym 发布。

一句话总结

ClawGym 是一个面向 Claw 风格个人 Agent 的可扩展框架。该框架整合了 ClawGym-SynData(一个由人格驱动意图和技能基础操作合成的 1.35 万任务数据集),结合监督微调与轻量级强化学习来训练 ClawGym-Agent,并配套了 ClawGym-Bench(一个经过自动过滤与人工-LLM 审核校准的 200 实例基准测试)。

核心贡献

- ClawGym-SynData 提供了一个包含 1.35 万个可执行任务的数据集。该数据集通过自动化流水线合成,融合了人格驱动意图、技能基础操作以及混合验证机制。该数据集支持在本地文件与工具环境中运行的个人 Agent 进行可扩展训练。

- ClawGym-Agent 通过黑盒 rollout 收集高保真交互轨迹,并利用监督微调训练一系列模型,辅以轻量级强化学习流水线,在独立任务沙箱中并行执行。该方法论在不同模型规模下均能带来一致的性能提升。

- ClawGym-Bench 建立了一个包含 200 个精选实例的诊断基准测试,通过自动难度校准与人工-LLM 审核过滤以确保评估的可靠性。实证结果表明,基于该框架训练的 Agent 取得了显著改进,其中 Qwen3-8B 在该基准测试上提升 43.46%,在 PinchBench 上提升 38.90%。

引言

Claw 风格环境赋能自主 Agent 在本地文件、工具与持久化工作区中执行多步工作流,有效弥合了生成式 AI 与实际数字执行之间的差距。尽管具备这一潜力,该生态系统仍缺乏用于可扩展 Agent 开发的系统框架。先前研究难以合成可验证的训练数据,以捕捉个性化意图、处理长周期依赖关系,并将任务锚定于真实的工作区状态。作者引入 ClawGym 这一统一框架,采用双路径合成策略突破上述障碍,简化了 Claw 风格 Agent 开发的全生命周期。该方法提供了包含 1.35 万个精选任务的 ClawGym-SynData,通过监督微调与强化学习训练了一系列高性能 Agent,并建立 ClawGym-Bench 以提供可靠的诊断评估。

数据集

-

数据集构成与来源

- 作者通过 ClawGym-SynData 框架生成训练数据,该框架结合面向多样化用户场景的人格驱动自上而下合成,以及将 OpenClaw 能力串联为真实工作流的技术基础自下而上合成。

- 为建立可复现的工作区状态,流水线使用 LLM 生成轻量级、任务特定的模拟资源,包括文档、表格及带有明确模式的结构化文件,完全规避了真实用户数据带来的隐私风险。

-

各子集关键细节

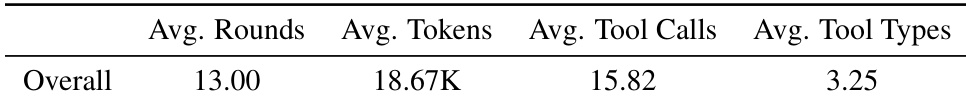

- 训练语料 (ClawGym-Agent): 包含从 MiniMax-M2.5 与 GLM-5.1 教师模型中蒸馏出的 2.45 万条高保真轨迹。数据集保持双模型的混合分布,平均每条轨迹约 13 轮交互、1.87 万 token 及 15.8 次工具调用。

- 评估基准 (ClawGym-Bench): 由 200 个精心筛选的任务组成,分为 156 个代码验证实例与 44 个混合验证实例。涵盖文件操作、数据分析与脚本执行等六大操作类别,并经过严格的难度校准以确保区分度。

-

数据处理与过滤

- 作者应用多阶段质量评估,基于新颖性阈值、LLM 合理性检查与复杂度平衡对任务进行过滤。

- 原始交互日志通过将具有匹配消息前缀的请求分组并拼接回合进行重构。流水线自动裁剪掉心跳消息等非必要系统提示,并移除触发不支持工具轨迹,以防止训练噪声。

- 最终轨迹选择依赖于对混合验证器分数应用连续奖励阈值过滤,仅保留展示高任务完成质量的样本。

-

使用与训练策略

- 过滤后的 2.45 万条轨迹数据集用于多轮监督微调,使 Agent 能够学习真实的工具使用模式与工作区导航。

- 200 任务基准测试作为稳定的评估套件,每个任务均使用其模拟资源初始化,并通过统一验证公式进行评分,确保无需大量重复运行即可实现可靠的模型对比。

方法

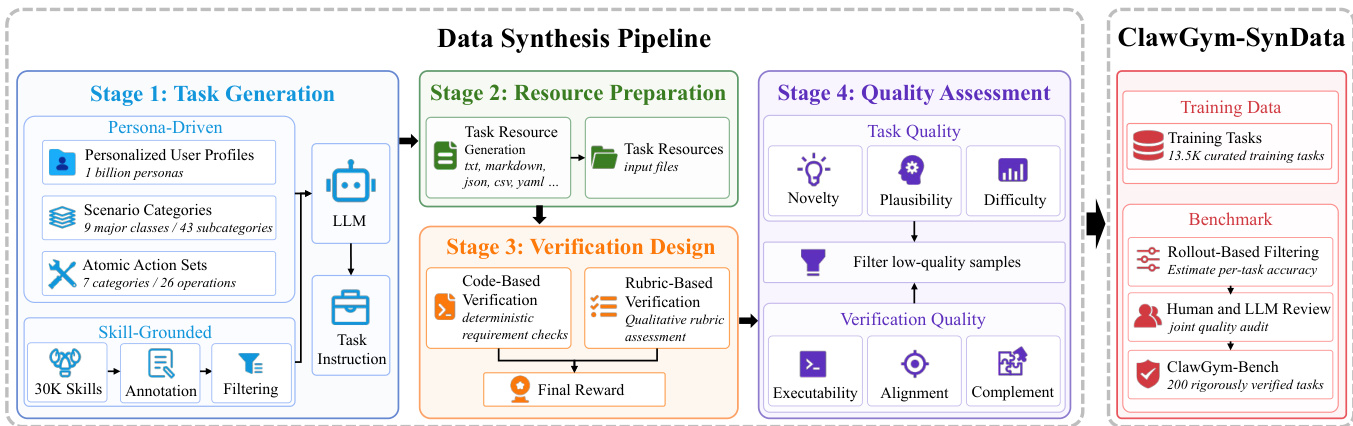

ClawGym 框架旨在支持环境锚定指令执行 Agent 的开发与评估,重点在于合成高质量训练数据并训练鲁棒的 Agent 模型。核心方法论包含一个生成多样化、真实任务的多阶段数据合成流水线,随后通过监督微调与强化学习训练 Agent 模型。整体架构始于任务生成,经过验证设计与质量评估,最终产出用于 Agent 评估的精选数据集与基准测试。

数据合成流水线分为四个明确阶段。第一阶段为任务生成,采用两种互补方法:人格驱动自上而下合成与技术基础自下而上合成。自上而下方法从高层用户上下文出发,结合个性化用户画像、场景类别与一组原子操作生成任务种子。该种子用于引导大语言模型生成具体的面向用户指令,确保任务扎根于真实用户需求与操作约束。相比之下,自下而上方法从开源仓库中现有的能力(即技能)起步。这些技能经过标注与过滤以识别适合合成的项目,随后通过选择主技能与可选辅助技能组合成任务。该方法确保生成任务基于可执行操作,并鼓励跨能力的多步协同。两种合成策略的输出在第二阶段(资源准备)中合并,在此阶段生成输入文件与配置数据等任务特定资源。

第三阶段为验证设计,实施混合验证方案以评估任务完成情况。该方案生成基于代码与基于量规的验证组件。基于代码的验证将任务分解为一组确定性原子检查(例如验证输出文件是否存在或数据转换是否正确),这些检查作为可执行脚本运行。基于量规的验证则使用一组预定义标准,由大语言模型对清晰度、完整性与忠实度等定性方面进行评分。最终任务得分为这两项得分的加权组合,其中基于代码组件的默认权重为 0.7,优先保证客观且可复现的结果。此验证过程对为 Agent 模型生成可靠训练信号至关重要。

第四阶段为质量评估,对合成数据应用自动过滤器以确保高质量。该阶段同时评估任务的合理性与验证工件的可靠性。任务将接受新颖性、合理性与难度评估,验证组件则检查可执行性、与任务的匹配度及互补性。此流程过滤掉模糊或定义不佳的任务以及不匹配的验证器,确保最终训练数据由高质量、可靠的示例组成。

最终数据集 ClawGym-SynData 包含 1.35 万个精选训练任务,用于训练一系列 Agent。训练基于 Qwen3 系列模型(包括 Qwen3-4B、Qwen3-8B 与 Qwen3-30B)进行监督微调。为应对 Agent 交互的长周期特性,使用 YaRN 扩展上下文长度,并采用多轮损失掩码策略,将优化重点集中于模型的推理与动作生成,排除确定性的环境反馈。此外,探索了基于轻量级沙箱并行 rollout 系统的强化学习流水线,其中每个任务在隔离环境中运行,奖励直接由基于代码的验证器提供。该方法支持并发训练,无需依赖辅助奖励模型。

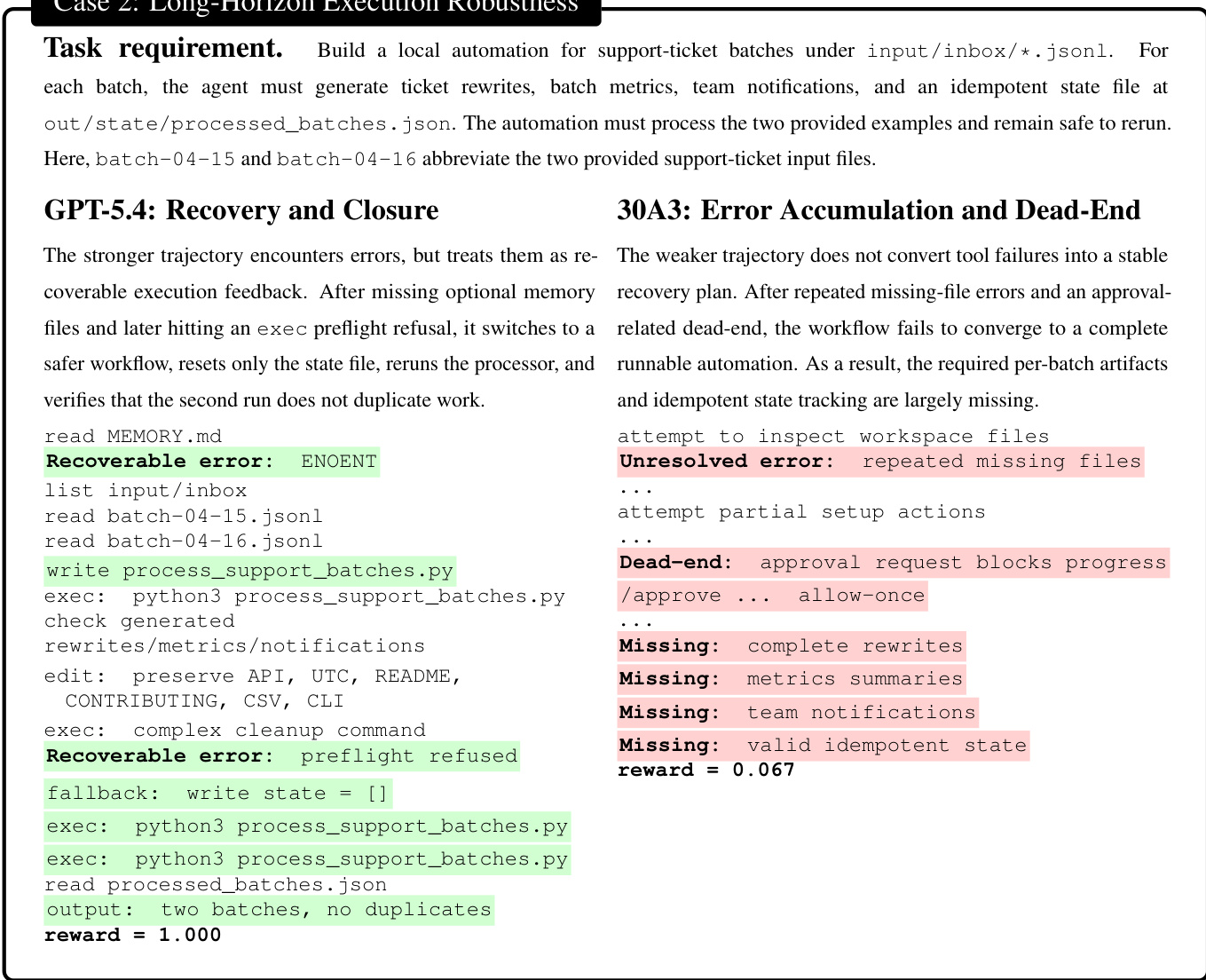

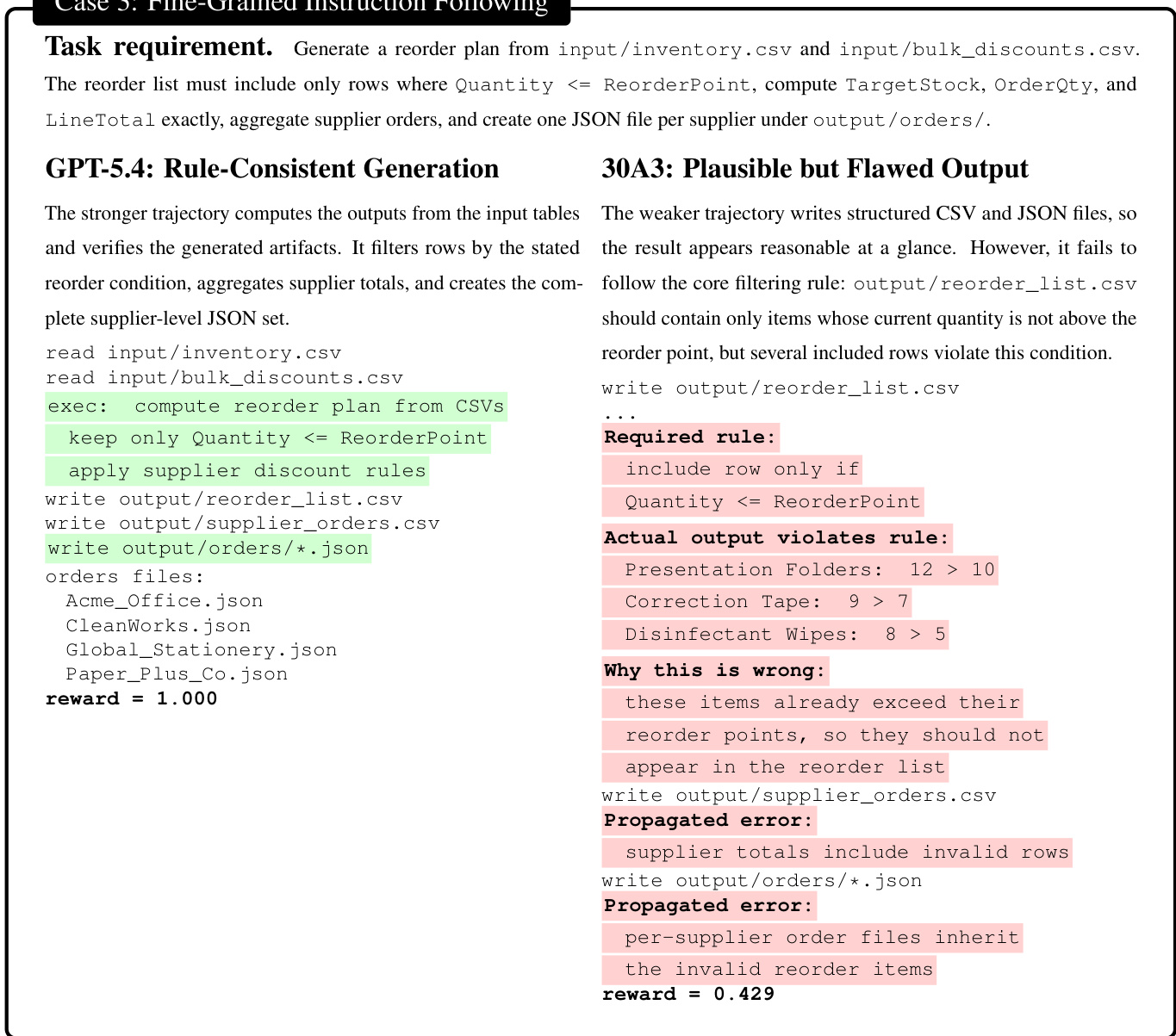

实验

评估使用混合验证协议(将可执行代码检查与定性 LLM 量规配对)在 ClawGym-Bench 与 PinchBench 基准测试上检验专有模型与开放权重模型。实验验证了在合成交互数据上训练能显著提升紧凑模型性能,缩小其与大型系统的差距,并有效迁移至外部基准测试而不过拟合。定性行为分析进一步表明,可靠的 Agent 凭借连贯的工具编排、长周期执行期间稳健的错误恢复能力,以及对生成工件中细粒度约束的严格遵守而表现优异。总体而言,本研究证实合成数据流水线与基准框架成功培养并衡量了用于复杂计算机使用任务的鲁棒、可迁移的 Agent 能力。

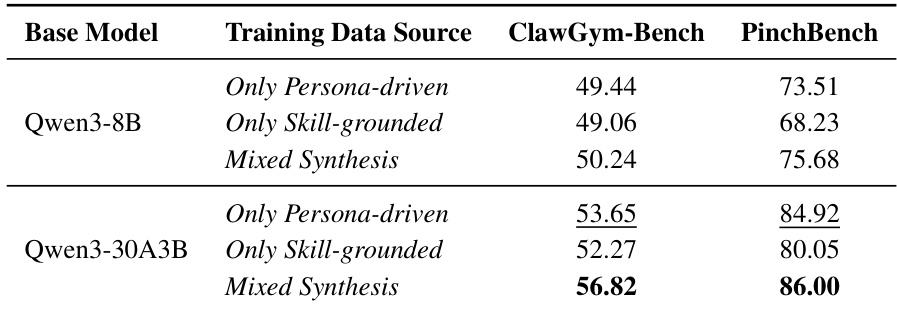

作者使用 ClawGym-Bench 与 PinchBench 两个基准测试评估不同训练数据源对模型性能的影响。结果显示,使用混合合成数据训练的模型得分高于使用人格驱动或技能基础数据训练的模型,且在 PinchBench 上的提升更为明显。混合合成数据训练的模型在两项基准测试上均优于人格驱动或技能基础数据训练的模型。混合合成的性能提升在 PinchBench 上比在 ClawGym-Bench 上更为显著。Qwen3-30B 在两项基准测试的所有训练数据源中均取得最高分。

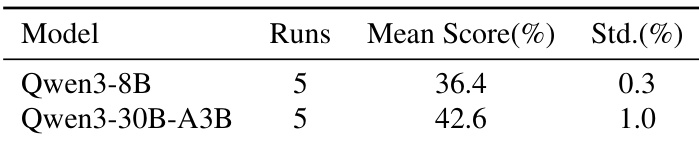

作者比较了两种模型在基准测试上的性能,显示一种模型的平均得分高于另一种。结果表明两种模型的平均性能存在明显差异,第二种模型在结果上表现出更高的一致性。一种模型在基准测试上平均得分高于另一种。第二种模型在不同运行中表现出更高的一致性。结果凸显了所评估任务中两种模型之间的性能差距。

{"summary": "该表格展示了 Agent 轨迹的聚合指标,显示任务中使用的平均轮数、token、工具调用次数及工具类型。这些指标反映了所评估环境中 Agent 行为的复杂性与交互模式。", "highlights": ["Agent 完成平均任务通常需要约 13 轮。", "平均轨迹涉及约 18,670 token 与 15.82 次工具调用。", "Agent 每任务平均使用 3.25 种不同的工具类型。"]}

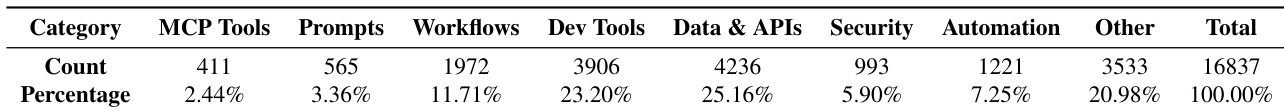

该表格展示了标注技能在不同类别中的分布,突出各类别的数量与比例。数据显示,绝大多数技能属于数据与 API 类别,其次是开发工具与工作流,MCP 工具与安全类别占比较小。数据与 API 类别占标注技能的最大份额,其次是开发工具与工作流。MCP 工具与安全类别在整体技能分布中占比较小。该分布强调了不同功能区域技能的多样性,并着重于数据与开发工具。

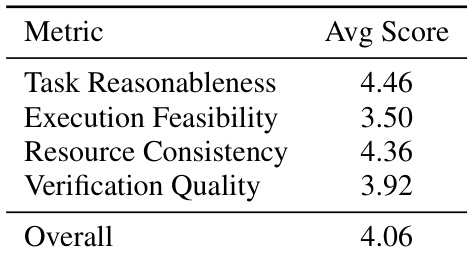

作者通过评估任务合理性、执行可行性、资源一致性与验证质量等指标,检验了框架中验证工件的质量。结果显示整体验证质量处于中等偏上水平,任务合理性与资源一致性得分高于平均水平,而执行可行性得分较低,表明确保稳健且可行的执行工作流仍面临潜在挑战。任务合理性与资源一致性为评分最高的指标,表明与任务要求高度契合且资源处理一致。执行可行性得分低于其他指标,说明确保稳健可靠的执行工作流仍是难点。验证质量处于中等水平,反映了客观评估与定性评估之间的平衡,但在使验证与任务正确性对齐方面仍有改进空间。

评估设置检验了不同训练数据配置与基准任务下的模型性能,验证了混合合成数据始终优于专用替代方案。补充实验分析了 Agent 交互复杂度、跨功能领域的技能分布及验证工件的可靠性。总体发现表明混合训练方法具有明确性能优势,凸显了操作技能的多样性,并将执行可行性确定为提升验证质量的主要方向。