Command Palette

Search for a command to run...

GLM-5V-Turbo:迈向面向多模态 agents 的原生基础模型

GLM-5V-Turbo:迈向面向多模态 agents 的原生基础模型

摘要

我们推出了 GLM-5V-Turbo,这是迈向原生多模态 agent 基础模型的一步。随着基础模型在真实环境中部署得越来越广泛,agent 能力不仅取决于语言推理,还需要具备在图像、视频、网页、文档、图形用户界面(GUIs)等异构上下文中进行感知、解释和行动的能力。GLM-5V-Turbo 正是围绕这一目标构建的:多模态感知被整合为推理、规划、工具使用和执行的组成部分,而不是作为语言模型的辅助接口。本报告总结了 GLM-5V-Turbo 在模型设计、多模态训练、强化学习、工具链扩展以及与 agent 框架集成等方面的主要改进。这些进展使得模型在多模态编程、视觉工具使用和基于框架的 agent 任务中表现出色,同时保持了具有竞争力的纯文本编程能力。更重要的是,我们的开发过程为构建多模态 agent 提供了实践性的见解,突出了多模态感知、层次优化和可靠的端到端验证的核心作用。

一句话总结

GLM-5V-Turbo 通过将多模态感知直接融入推理、规划与工具执行流程,而非将其作为辅助接口,推动多模态 Agent 原生基础模型的发展。结合强化学习与分层优化,该模型在多模态代码生成与视觉工具使用方面表现优异,同时保持了具有竞争力的纯文本代码生成能力。

核心贡献

- 提出 GLM-5V-Turbo,一种原生多模态基础模型,将视觉与视频感知直接嵌入核心推理、规划与执行管线,而非将其视为辅助接口。

- 建立了一套训练框架,利用强化学习、轨迹多样性以催生分层策略,以及可靠的端到端验证,实现模型能力与 Agent Harness 架构的联合优化。

- 在综合评估中展现出多模态代码生成、视觉工具使用及基于框架的 Agent 任务方面的优异性能,同时保留了具有竞争力的纯文本代码生成能力。

引言

随着基础模型从被动语言理解转向主动现实世界交互,使 Agent 能够感知、推理并在图像、视频及图形界面等异构输入上执行操作,已成为软件工程与知识工作的关键。以往系统通常将多模态感知视为文本模型的辅助接口,这导致在长程推理中面临瓶颈,原因包括上下文消耗过快、依赖人工设计的训练轨迹,以及难以忠实压缩视觉信息。本文提出 GLM-5V-Turbo,一种原生多模态基础模型,在预训练、监督微调与强化学习全阶段紧密融合视觉与语言。通过部署专用视觉编码器、实现多模态多 token 预测,并在数十项 Agent 任务中应用分层优化,该系统在视觉工具使用与多模态代码生成方面表现卓越,同时保持了强大的纯文本性能。其开发流程还为管理长程视觉上下文及与 Agent Harness 协同设计模型能力提供了实用指导。

数据集

- 数据集构成与来源: 作者提出了 ImageMining,一个自收集基准测试集,包含 217 个经过精心筛选的测试用例,源自手动收集的轨迹样本。数据涵盖七个不同领域:社交、娱乐、产品、地点、富文本、自然与科学。

- 子集详情与推理类别: 该基准测试将用例划分为五个核心推理类别。通用识别涵盖对动植物及人工制品的细粒度识别。时空推理处理基于视觉线索的地理推导。事件推理聚焦于新闻事件与产品发布。基于文本的推理处理嵌入的富文本内容(如学术论文与报告)。视觉搜索要求交叉引用输入以检索特定艺术作品或图像。

- 训练用途与处理管线: 作者利用该数据集,通过多阶段自动化管线为 GLM-5V-Turbo 模型赋能,该管线负责知识发现、问答重构与质量过滤。核心训练约束为“视觉跳跃(Visual Jump)”要求,规定中间推理步骤必须包含视觉转换,以防止模型依赖文本捷径或参数化知识。

- 裁剪策略与专项处理: 数据集包含一个专门的 OCR Search 子集,针对图表、地图与海报。该子集强制执行严格的处理工作流,要求模型在启动搜索链之前必须先执行实体隔离与局部裁剪或放大。此设计将静态图像转化为交互环境,要求精准使用图像内工具以进行深度视觉探索。

方法

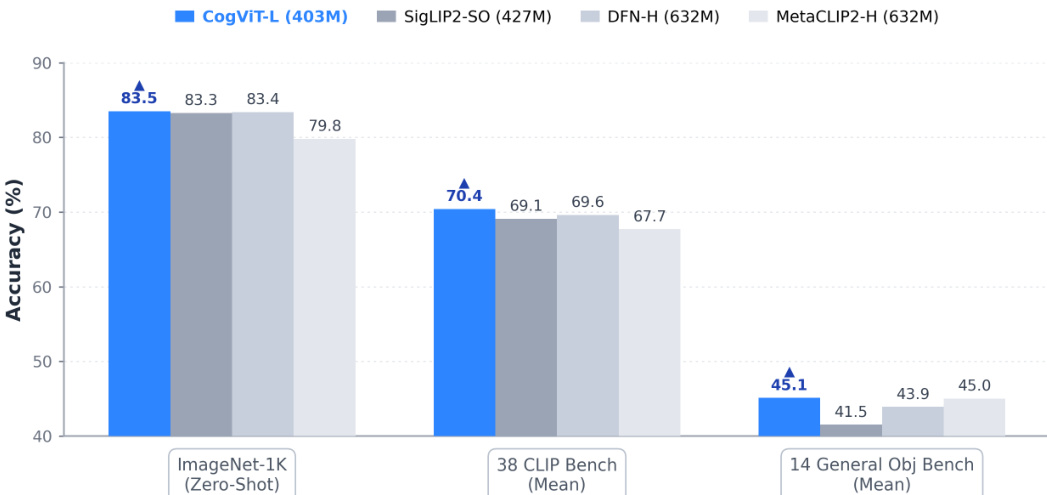

GLM-5V-Turbo 的架构融合了新型视觉编码器、多模态 token 预测以及专为 Agent 导向任务设计的多阶段训练框架。基础层为 CogViT,一种为稳健多模态感知而开发的参数高效视觉编码器。它采用两阶段预训练流程:第一阶段使用基于蒸馏的掩码图像建模,通过质量感知混合数据训练学生端 Vision Transformer (ViT),使其从双教师模型(SigLIP2 负责语义特征,DINOv3 负责纹理细节)中重建掩码区域,从而增强视觉表示。第二阶段转向对比式图文预训练,模型在共享嵌入空间中对齐视觉与文本特征。该阶段引入三项关键增强:通过 NaFlex 方案处理变长输入、采用基于 Sigmoid 的 SigLIP 损失函数与双向分布式实现的 64K 缩放全局批次大小,以及在 80 亿双语(中英)图文语料库上进行训练。视觉编码器与文本编码器及共享投影模块耦合,均使用 Muon 优化器进行优化,并为各模块分配特定学习率。

多模态输入处理通过多模态多 token 预测(MMTP)框架实现,该框架是对纯文本 MTP 设计的扩展。该机制旨在多模态环境下维持训练与推理效率。核心设计决策围绕视觉 token 如何融入 MTP 头展开。研究考虑了三种方案:直接传递视觉嵌入、掩码所有视觉 token,或使用可学习的共享特殊 token <|image|> 替换视觉 token。最终采用第三种方案,它在标准化视觉输入的同时保留了位置信息。该设计通过消除跨阶段传递视觉嵌入的需求,显著降低了管线并行训练中的通信复杂度,提升了可扩展性与工程可维护性。训练损失曲线表明,与直接传递嵌入相比,该方法能实现更低的训练损失与更稳定的收敛。

模型能力通过覆盖感知、推理与 Agent 任务的广泛训练进一步拓展。预训练阶段使用纯文本与多模态数据的混合集以促进均衡发展,涵盖世界知识、OCR、代码生成、GUI 与空间感知等类别,并特别侧重多模态代码数据,以使视觉理解与代码生成对齐。随后是对 30 余个任务类别的联合强化学习(RL)优化。这种多任务 RL 设置使模型在各类领域均取得稳步提升,包括图像定位与视频理解等感知任务、STEM 解题等推理任务,以及 GUI 与代码 Agent 等 Agent 场景。与监督微调相比,RL 过程表现出更低的跨域干扰,允许多项能力同步提升,并促进推理模式在任务间的迁移。训练基础设施为大规模进行了重新设计,具备统一的任务与奖励抽象、端到端异步机制、细粒度内存管理以及拓扑感知分区,以应对大规模多模态 RL 的复杂性。

模型能力通过支持完整感知-规划-执行循环的多模态工具链进一步延伸。这包括带有 zai_ 前缀的专有函数及用户自定义工具的兼容性,使模型能够执行多模态搜索、标注与网页阅读等任务。MMSearch-Plus 与 BrowseComp-VL 等基准测试上的显著性能提升验证了该扩展效果。模型还集成了 Claude Code 与 AutoClaw 等外部 Agent 框架,作为连接高层推理与底层系统执行的核心认知模块。该集成实现了复杂的 Agent 工作流,使模型能够作为视觉-语言控制器处理涉及复杂终端与 GUI 的任务。

最后,模型支持多模态深度研究与内容创作,支持涉及迭代信息收集、证据整合以及跨异构源长文本合成的工作流。通过原生解析视觉丰富的网页与文档,模型可生成图文交错报告、构建结构化幻灯片及产出文档式撰写内容。该能力进一步得到一系列官方技能的支持,这些技能利用模型的原生能力或将其封装为外部工具,便于在 Agent 框架中部署。开发过程还提炼出设计视角,强调感知的基础作用、分层优化的效率,以及清晰任务定义与可靠验证对于端到端长程任务的重要性。

实验

GLM-5V-Turbo 在多模态代码生成、工具使用、GUI Agent 及纯文本推理基准测试中进行了全面评估,以检验其综合 Agent 能力。实验验证了模型将视觉输入转化为可运行代码、在 Agent 框架内执行具身交互,以及完成复杂多模态搜索、文档解析与精确空间定位任务的能力。定性演示一致表明,模型能有效将视觉理解转化为现实世界的端到端执行,同时保持稳健的基于文本的代码生成与推理性能。最终评估确认,GLM-5V-Turbo 成功实现了构建基础多模态 Agent 能力的核心目标,且未削弱底层的纯文本工作流。

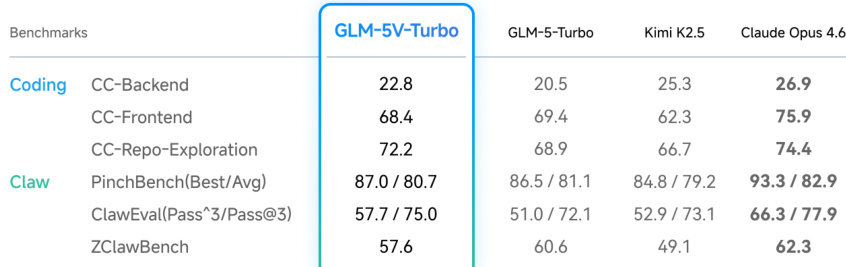

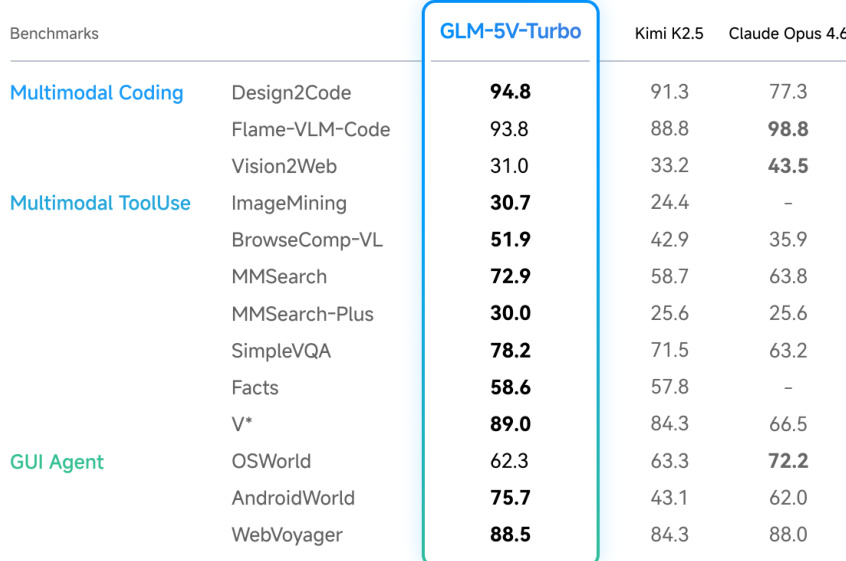

作者通过在代码生成与 Agent 基准测试中评估 GLM-5V-Turbo,并将其性能与多个基线模型进行对比。结果显示,GLM-5V-Turbo 在多模态代码生成与工具使用任务中表现强劲,同时在纯文本代码生成与 Agent 基准测试中保持具有竞争力的性能,表明其在不同模态间能力均衡。GLM-5V-Turbo 在多模态代码生成基准测试中表现优异,在多个类别中超越其他模型。该模型在纯文本代码生成与 Agent 基准测试中保持稳健性能,表明视觉能力未削弱其核心代码生成能力。GLM-5V-Turbo 在执行导向的 Agent 任务中展现竞争力,表明多模态理解能有效迁移至现实 Agent 应用。

作者通过在多模态代码生成、工具使用、GUI Agent 及纯文本代码基准测试中评估 GLM-5V-Turbo,展示了其在 UI 转代码生成与视觉问答等多模态任务中的优异表现,同时保持了纯文本代码生成的稳健能力。模型展现出向现实 Agent 框架的有效迁移能力,支持在视觉赋能环境中的端到端执行。结果表明,视觉理解的整合增强了 Agent 功能,且未损害基础代码生成与推理能力。GLM-5V-Turbo 在多模态代码生成与工具使用任务中表现强劲,涵盖 UI 转代码生成与视觉问答。该模型在纯文本基准测试中保持稳健的代码生成性能,表明引入视觉能力未造成性能下降。GLM-5V-Turbo 展现出向 Agent 框架的有效迁移能力,支持现实场景中的视觉交互与执行。

{"summary": "作者开展了一项实验以探究光的反射中入射角与反射角的关系,观察光线在反射表面的行为。结果表明,测量角度始终符合预期的物理原理,证明在不同条件下反射角与入射角保持一致。", "highlights": ["实验表明,在多次测试中反射角始终与入射角一致。", "该设置允许在不同入射条件下观察反射表面上的光路行为。", "结果证实了在受控环境中反射角等于入射角的基本原理。"]}

作者通过在多模态代码生成、工具使用与 GUI Agent 基准测试中评估 GLM-5V-Turbo,展示了其在代码生成与 Agent 导向交互等多模态任务中的强劲表现,同时保持了纯文本代码生成的扎实能力。模型在模态与非模态基准测试中均展现出竞争力,表明视觉理解能有效迁移至实际 Agent 执行。GLM-5V-Turbo 在多模态代码生成与工具使用基准测试中表现优异,在多个类别中超越其他模型。该模型在 GUI Agent 基准测试中展现竞争力,表明其具备有效的视觉理解能力以支持具身交互与操作。GLM-5V-Turbo 在纯文本代码生成任务中保持稳健性能,表明增加视觉能力未削弱其底层代码生成能力。

该图表对比了 GLM-5V-Turbo 与其他模型在三个基准类别中的性能,显示 GLM-5V-Turbo 在 ImageNet-1K 上达到高精度,并在 CLIP 与通用物体基准测试中表现具有竞争力。该模型在 ImageNet-1K 上超越其他模型,在 38-CLIP 基准测试中保持强劲性能,同时在 14-通用物体基准测试中表现稳定。与其他模型相比,GLM-5V-Turbo 在 ImageNet-1K 上取得最高准确率。GLM-5V-Turbo 在 38-CLIP 基准测试中表现强劲,紧密匹配或超越其他模型。GLM-5V-Turbo 在 14-通用物体基准测试中相对于其他模型保持了具有竞争力的准确率。

评估在多模态代码生成、工具使用、GUI Agent 及纯文本基准测试之外,结合标准视觉识别任务对 GLM-5V-Turbo 进行测试,以验证视觉到代码的转换、自主 Agent 执行以及核心基于文本能力的保留。这些实验表明,模型有效衔接了视觉感知与实际工作流,且未因多模态整合经历性能下降。定性方面,系统展现出强大的适应性,成功利用视觉输入提升现实任务完成度与具身交互能力。最终结论确认,整合视觉能力在保持基础代码生成与推理稳定性的同时,显著扩展了功能多样性。