Command Palette

Search for a command to run...

使用数据进行编程:来自原始语料的自我改进大型语言模型的测试驱动数据工程

使用数据进行编程:来自原始语料的自我改进大型语言模型的测试驱动数据工程

Chenkai Pan Xinglong Xu Yuhang Xu Yujun Wu Siyuan Li Jintao Chen Conghui He Jingxuan Wei Cheng Tan

摘要

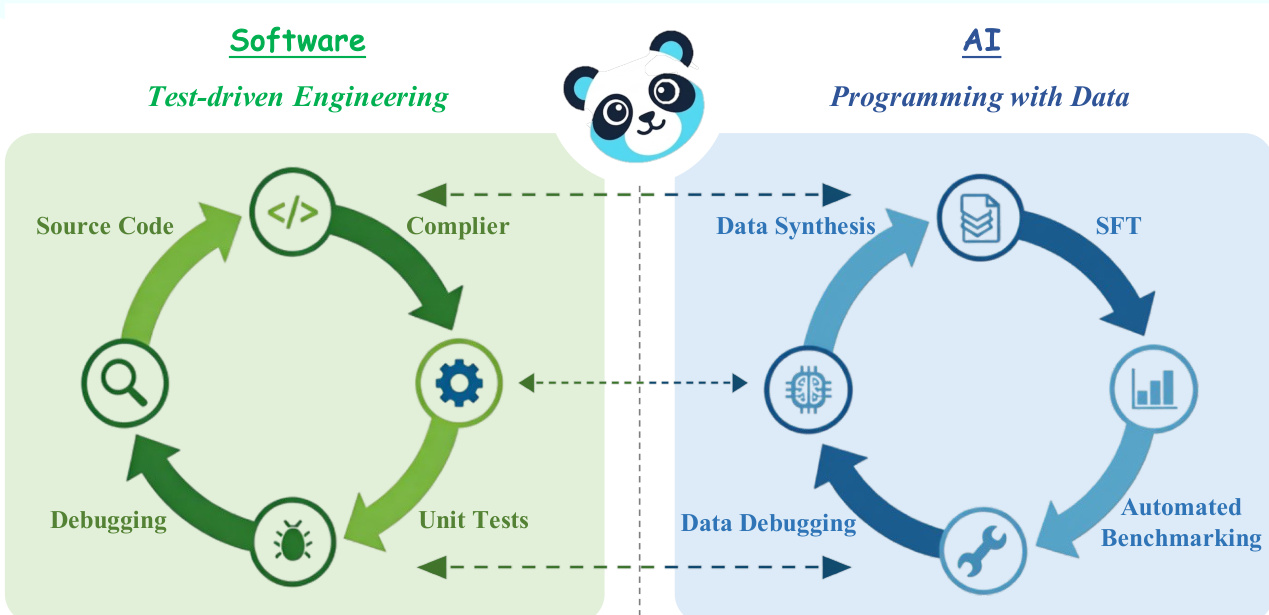

将专业的领域知识从文本中可靠地迁移至大语言模型(LLM),仍是人工智能领域的一项基础性挑战。尽管基于领域语料库的微调显著提升了模型能力,但该过程缺乏反馈机制:当模型在特定领域任务中表现失败时,现有方法无法诊断训练数据中存在的缺陷,唯一的补救措施往往是不加区分地增加更多数据。在此,我们证明,当从源语料库提取的结构化知识表示作为训练数据和评估的共同基础时,完整的数据工程生命周期便能以精确且可操作的方式映射到软件开发生命周期:训练数据成为指定模型应学习内容的“源代码”,模型训练等同于“编译”,基准测试等同于“单元测试”,而由失败驱动的数据修复则等同于“调试”。在这一对应关系下,模型失败可分解为概念层面的缺失和推理链的断裂,这些缺陷可追溯至数据中的具体不足,并通过针对性的补丁进行修复。每个修复周期均在不同规模的模型和不同的架构上带来一致的性能提升,且未损害模型的通用能力。我们将这一原则形式化为“数据编程”(Programming with Data),并在涵盖自然科学、工程、生物医学及社会科学等十六个学科领域中实例化该方法,同时发布了一个结构化知识库、一套基准测试套件以及一个训练语料库作为开源资源。通过证明训练数据与模型行为之间的关系具有结构上的可追溯性和系统上的可修复性,本工作为将人类专业知识可靠地工程化构建至语言模型奠定了原则性基础。

一句话总结

作者提出“数据编程”(Programming with Data),这是一种测试驱动框架,将训练语料映射为源代码,将基准测试映射为单元测试,将故障驱动修复映射为调试。该框架能够在十六个学科中精确诊断概念级缺失和推理链断裂问题并进行针对性修补,同时在不损害通用语言能力的前提下实现持续的性能提升。

核心贡献

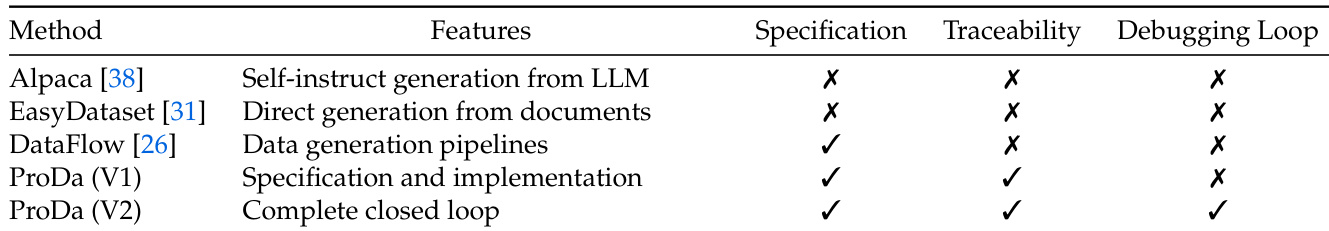

- 该研究提出“数据编程”框架,将领域训练数据视为从结构化知识表示中派生的可执行源代码,将数据工程生命周期映射至软件开发工作流,其中训练过程充当编译环节,基准测试充当单元测试。

- 该闭环方法论将模型故障分解为概念级缺失和推理链断裂,这些故障可直接追溯至特定的数据缺陷,从而实现针对性修补。修补过程可迭代优化训练语料,同时保留通用能力。

- 该框架在自然科学、工程、生物医学和社会科学的十六个学科中完成验证,能够跨不同模型规模与架构持续改善性能,并开源了结构化知识库、基准测试套件及训练语料。

引言

作者解决了将专业领域知识迁移至大语言模型的核心难题。标准微调通常在开环模式下运行,导致模型故障无法追溯至具体的数据缺陷。现有方法存在评估与训练结构脱节的问题,迫使从业者依赖计算成本高且缺乏可解释性的数据增强技术,而非针对性修复。作者提出“数据编程”框架,通过从原始语料中提取共享知识表示来指导训练数据合成与基准测试,将测试驱动开发原则应用于人工智能领域。该系统构建了一个闭环机制:基准测试中的故障被诊断为概念或推理缺失,追溯至数据结构中的精确节点,并通过针对性修补予以解决,从而在提升领域性能的同时不损害通用能力。

数据集

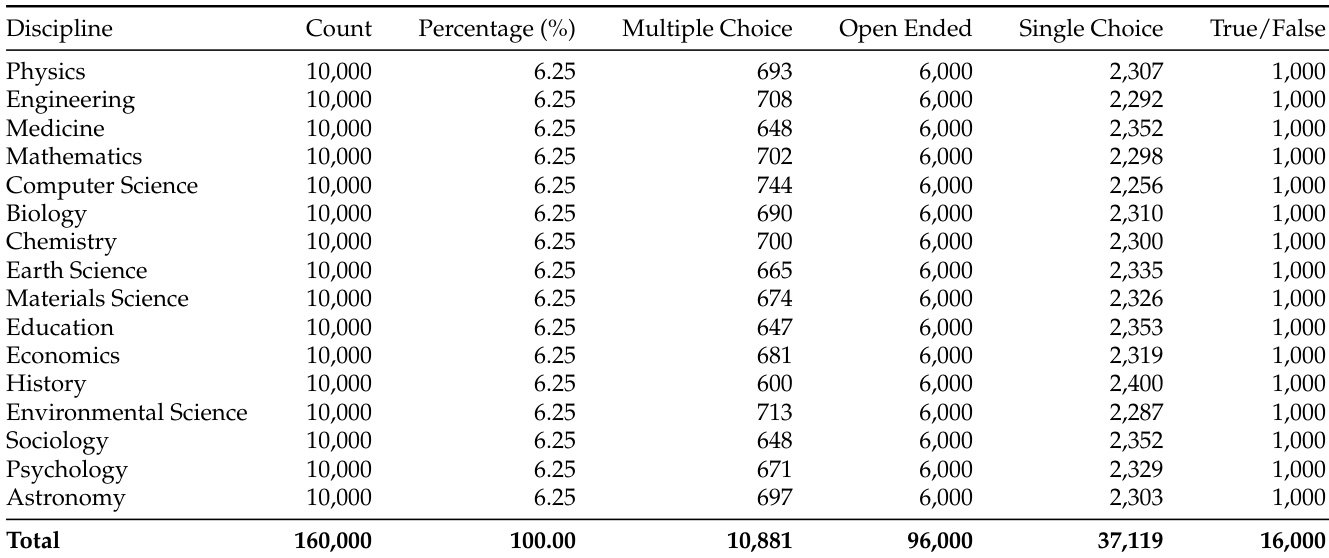

作者提出了 ProDaLib,这是一个从非结构化学术语料中派生的结构化知识数据集,旨在支持富含推理能力的模型训练与评估。

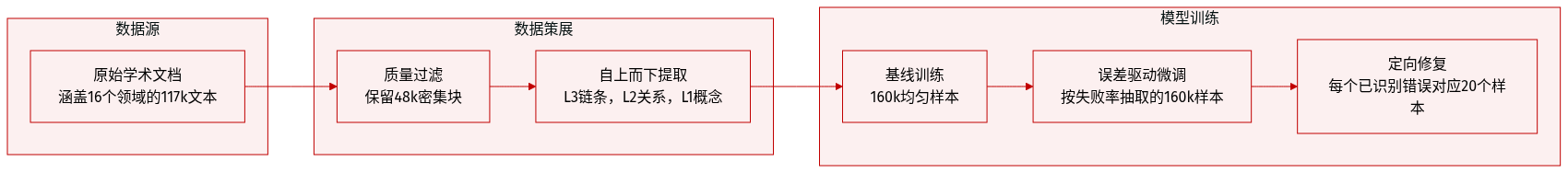

数据集构成与来源

- 语料源自 117,000 份达到教科书标准的文档,涵盖自然科学、工程、生物医学和社会科学共 16 个学科。

- 经过多轮基于质量的过滤,最终保留 48,000 个高质量文本块,包含约 1.5 billion tokens,实现 10:1 的压缩率,使内容高度聚焦于高推理密度部分。

- 收录规则要求文档必须为科学或技术类文献,撰写水平达到本科、研究生或研究级别,归类为非描述性推理,且包含非平凡的概念或程序逻辑。

各子集关键细节

- 提取的知识结构包含 458,622 个节点,孤儿节点率为零,确保完全可追溯。

- L3 推理链:43,953 条多步推理路径,作为子图的锚点。

- L2 关系陈述:186,784 个类型化三元组,编码概念间的因果、定义与前置关系。

- L1 原子概念:227,869 个规范术语,附带类别类型与上下文感知定义。

- 学科分布差异显著,物理学、工程学与医学的节点数超过 45,000,而天文学与心理学约含 7,000 个节点。

- 所有领域的连通性均保持较高水平,最大连通分量涵盖每个学科中超过 99.3% 的节点。

数据使用与处理策略

- 作者采用自上而下的提取流水线:首先生成 L3 链,随后通过滑动窗口遍历链步骤派生 L2 三元组,最后从 L2 的主语和宾语中抽取 L1 概念。

- 训练数据基于 L1 和 L2 条目合成,利用关系陈述的滑动窗口生成开放式、多项选择题与判断题样本,格式比例侧重开放式推理。

- 基准测试由 L3 链构建,采用语义邻近替换、关系反转与链截断等对抗性干扰算子,以检验真实能力而非单纯记忆。

- 基准测试项与训练样本之间强制实施实例级正交性,因为基准测试要求沿特定推理路径组合多个知识条目,而这些路径在单个训练实例中并不存在。

- 训练分为三个阶段:第一阶段为均匀基线,160,000 个样本在 16 个学科中均匀分布;第二阶段为误差比例分配阶段,基于诊断误差率维持 160,000 个样本;第三阶段为针对性修复阶段,针对每个已识别的误差生成 20 个样本,开放式、多项选择题与判断题的比例为 6:3:1。

元数据构建与结构特性

- 自上而下的提取顺序强制执行严格的可达性不变量,确保每个 L1 和 L2 节点均可从至少一条 L3 链到达,从而消除不可测试的孤儿条目。

- 元数据构建为每个节点包含来源链接、父陈述 ID 与类别 ID,实现从基准测试故障到具体知识条目的完全追溯。

- 概念规范化合并词汇变体并分配上下文感知定义,同时在 L2 提取过程中应用代词消解,以确保关系三元组的无歧义性。

- 生成的训练样本包含详细解释,利用领域推理论证答案并驳斥干扰项,同时施加严格约束以避免在自然语言输出中暴露内部元数据标识符。

方法

作者利用结构化知识表示来打通训练数据生成与模型评估之间的闭环,建立了名为“数据编程”的框架。该方法直接类比软件工程,其中共享规范(如需求文档)将代码实现、编译与测试相连接。在大语言模型语境下,原始语料充当需求规范,界定模型应掌握的知识范围。合成训练数据充当源代码,编码模型必须内化的具体概念与关系。模型训练充当编译器,将人类可读的数据转化为机器可执行的权重。微调后的模型即为编译后的二进制文件,基准测试充当测试套件,验证模型是否忠实实现其规范。当基准测试发生故障时,共享知识结构支持精确诊断,将故障追溯至训练数据中的特定缺陷,类似于软件中的漏洞修复。

该框架的核心是作为共享规范的三级知识结构。该结构以自上而下的方式从原始语料中提取:首先从高质量文本块中识别 L3 推理链,随后将其分解为 L2 知识关系(类型化三元组),最后从这些关系的主语和宾语中抽取 L1 核心概念。这种层级组织确保每条知识均可追溯且可测试。该框架具体化为 ProDa 流水线,由三个相互关联的组件构成:构建器(Builder)、测试器(Tester)与调试器(Debugger)。

构建器组件负责知识提取与训练数据合成。它处理原始语料以构建三级知识结构。提取过程遵循 CORE 原则,要求数据必须在文档全局范围内进行上下文关联(Contextualized),组织为分层知识结构(Organized),在强制对抗鲁棒性以及训练与评估的实例级无重叠方面保持严格(Rigorous),并通过迭代优化持续演进(Evolving)。构建器的输出是初始训练语料,以知识结构为基础,随时准备进行模型编译。

测试器组件基于 L3 推理链构建基准测试,这些链代表了语料中最具挑战性的推理模式。该组件在任何训练之前运行,遵循测试驱动开发的先测试原则。通过确保每个基准测试项包含基于相同知识结构构建的对抗性干扰项,并维持基准测试与训练数据的实例级正交性,严格执行严格标准,防止模型记忆答案。

调试器组件诊断基准测试识别出的每项故障。它将底层缺陷分类为两种类型之一:概念缺失(模型缺乏或混淆特定领域知识)或推理缺陷(模型具备所需知识,但未能正确跨多步进行组合)。针对每类缺陷,调试器采用不同的修复策略:概念缺失通过知识强化样本解决,明确对比混淆概念与正确定义;推理缺陷通过思维链样本解决,搭建缺失的推理步骤脚手架。演进标准通过将新生成的修补数据与策略性选出的原始训练数据子集相结合来实现,以防止灾难性遗忘,随后在该增强语料上重新训练模型,完成闭环。

实验

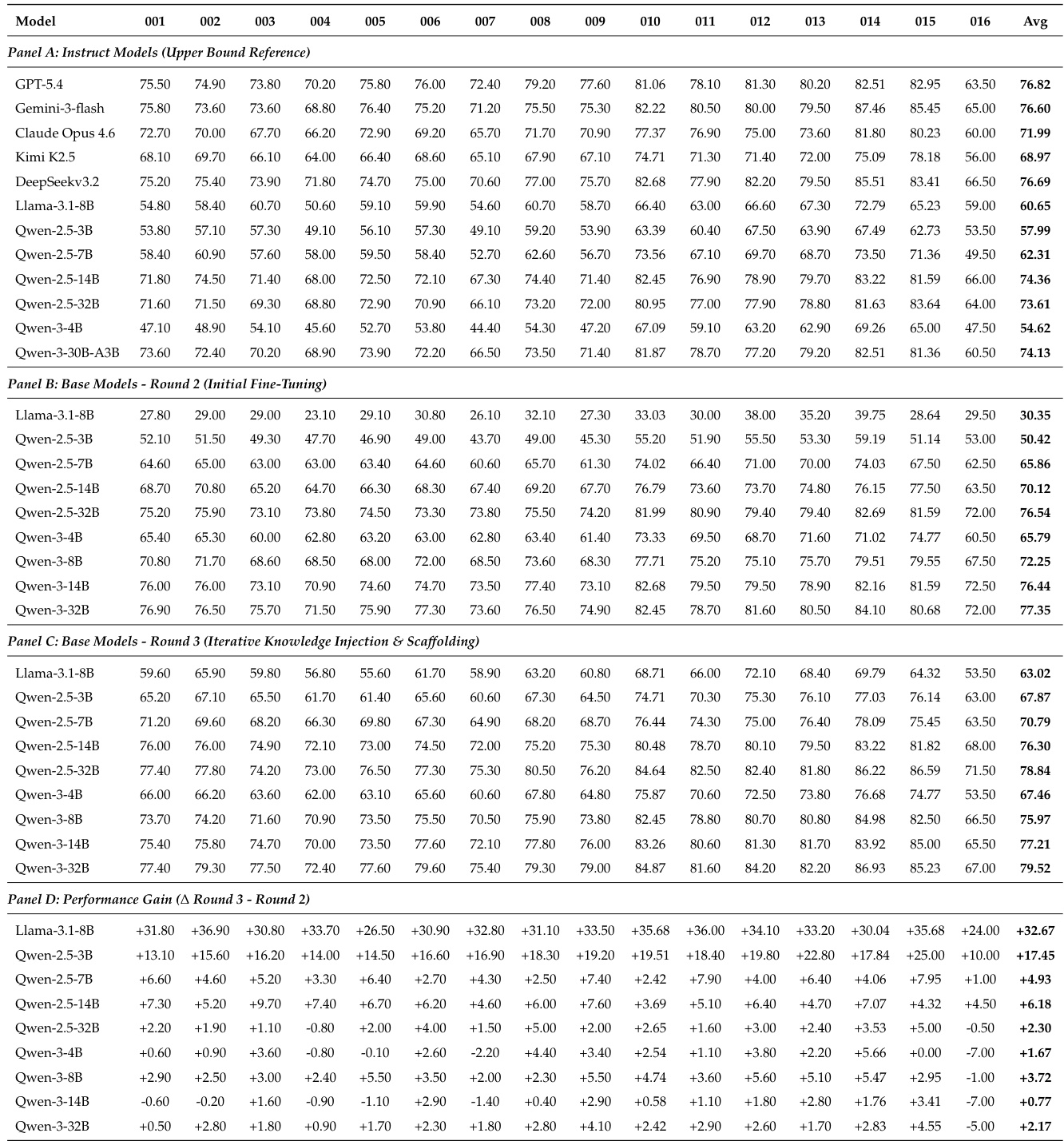

评估设置采用 ProDa-16 基准测试与标准通用知识子集,以评估模型在多种架构与参数规模下的性能。初步实验验证了基准测试的结构效度与区分能力,而在自动合成数据上的首轮微调表明,结构化知识注入可媲美商业对齐流水线,但不可避免地会留下残余能力缺口。后续的诊断迭代利用基准测试的可追溯结构来识别并修补特定知识缺陷,成功恢复通用能力,并持续优于传统数据合成方法。综合而言,这些实验证实,闭环且由诊断驱动的修复框架为提升大语言模型能力提供了比单纯静态数据生成更高效、更具可扩展性的路径。

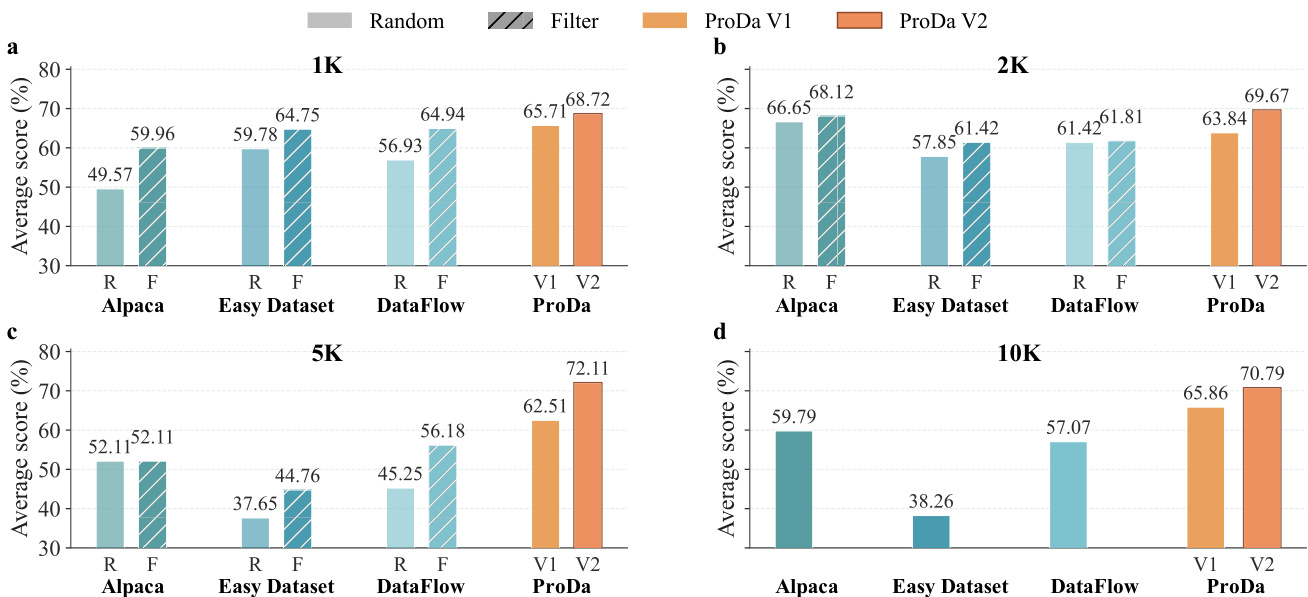

作者在不同数据规模下对比了 ProDa 框架与基线数据合成方法的性能。结果表明,ProDa 持续优于所有基线方法,V2 迭代得分高于 V1,且即使在较小数据量下也显著超越传统方法。随着数据规模扩大,性能差距进一步拉大,证明诊断驱动的针对性修复优于非结构化数据扩展。ProDa V2 在所有数据规模下持续优于基线方法,即使在极小数据量下也取得最高分。ProDa 与基线方法之间的性能差距随数据规模扩大而增加,表明该诊断方法具备更优的可扩展性。ProDa V1 的得分已具备与基线方法竞争的实力,但 V2 展现出显著增益,凸显了针对性修复的有效性。

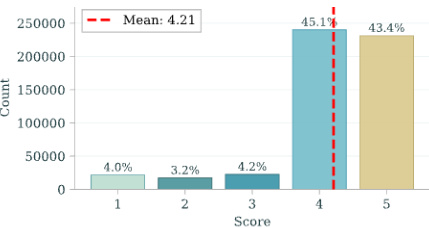

作者分析了模型在基准测试上的性能分布,观察到大多数预测落在较低分数区间,同时在最高分处呈现显著集中。结果表明分布呈现偏态,多数模型取得低分到中等分数,但相当一部分达到最高分,暗示模型间存在性能差距。多数预测集中在较低分数区间,并在最高分处达到峰值。分布显示出明显的不均衡,大量模型取得高分,少数模型得分较低。相当比例的数据聚集在最高分附近,表明存在性能天花板效应。

作者将 ProDa 框架与基线数据合成方法进行对比,强调了可追溯性与闭环调试的重要性。ProDa 在极小数据量下实现更优性能,证明针对性且由诊断驱动的修复比扩展传统数据合成更为有效。该框架能够将错误追溯至特定知识节点,从而实现精确修正,且不会导致通用能力的显著丧失。ProDa 在所有数据规模下均优于基线方法,在极小数据量下取得最先进结果。诊断定位与闭环修复的融合带来显著的性能提升,尤其在小型数据集上表现突出。ProDa 在提升领域特定性能的同时保持通用能力,避免了灾难性遗忘。

作者评估了 ProDa-16 基准测试与多阶段模型优化框架。结果表明,该基准测试与现有评估标准高度契合,并在跨模型规模与学科时展现出强大的区分能力。首轮微调产生的性能可与行业对齐模型相媲美,后续的诊断驱动修复显著提升准确率,尤其对初始得分较低的模型效果明显,同时保留了通用能力。ProDa-16 展现出与现有基准测试的高度一致性,并在跨模型规模与学科时提供有效区分。使用自动合成数据进行首轮微调,其性能可与行业对齐模型竞争,尤其在 Qwen-3 系列中表现突出。诊断驱动的针对性修复带来显著性能增益,改进幅度与初始性能呈反比,并成功恢复首轮微调中损失的通用能力。

作者对跨 16 个学科的基准测试进行了全面评估,证明其与现有基准测试具有统计一致性,并具备跨不同参数规模区分模型性能的能力。该基准测试与主流评估标准高度对齐,并保持区分能力,无天花板或地板效应,确保对模型能力的可靠评估。结果表明,该基准测试支持诊断驱动的修复框架,其中针对性干预在提升模型性能的同时保留通用能力。该基准测试与现有评估范式表现出高度的统计一致性,并在跨模型规模时维持区分能力。该基准测试在所有学科中提供一致的诊断覆盖范围,无天花板或地板效应,支持可靠的性能评估。诊断驱动的修复框架在提升模型性能的同时保留通用能力,证明了针对性干预的有效性。

评估在不同数据规模下将 ProDa 框架与传统数据合成方法进行对比,同时考察 ProDa-16 基准测试与现有标准的对齐程度及其跨学科的区分能力。这些实验验证了诊断驱动的针对性修复显著优于非结构化数据扩展,尤其在处理极小数据集时,并确认该基准测试能够可靠捕捉性能变化,且无天花板或地板效应。结果表明,迭代式闭环调试持续产出优于基线的性能,V2 迭代展现出显著的质量提升。最终,该框架成功提升领域特定准确率,同时保留通用能力,有效缓解模型优化过程中的灾难性遗忘。