Command Palette

Search for a command to run...

Meta-CoT:增强图像编辑的粒度与泛化能力

Meta-CoT:增强图像编辑的粒度与泛化能力

摘要

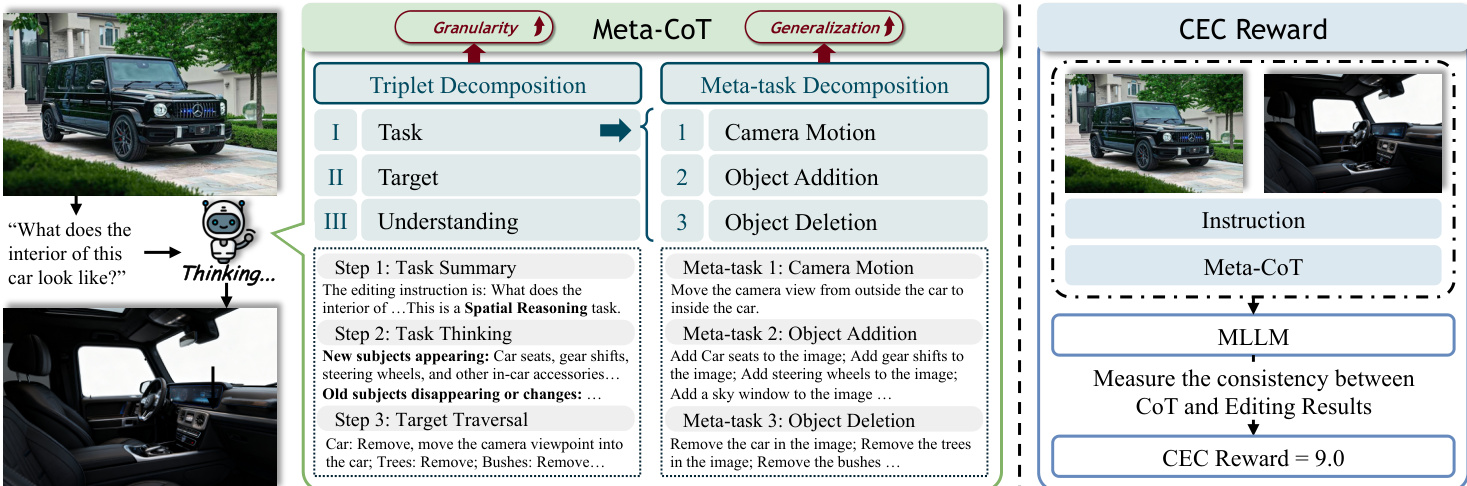

统一的多模态理解/生成模型通过将细粒度理解整合进其思维链(Chain-of-Thoth, CoT)过程,已显著提升了图像编辑性能。然而,一个关键问题仍未得到充分探索:何种形式的思维链(CoT)及训练策略能够协同提升理解的细粒度与模型的泛化能力?为解决这一挑战,我们提出了 Meta-CoT,这是一种对任意单图像编辑操作进行两级分解的范式,具有两大核心特性:(1) 可分解性(Decomposability)。我们观察到,任何编辑意图均可表示为一个三元组——(任务、目标、所需理解能力)。受此启发,Meta-CoT 对编辑任务和目标分别进行分解,生成特定于任务的思维链(CoT),并在所有目标上遍历执行编辑操作。这种分解增强了模型对编辑操作的理解细粒度,并引导模型在训练过程中学习三元组中的各个元素,从而大幅提升编辑能力。(2) 泛化性(Generalizability)。在第二级分解中,我们将编辑任务进一步细分为五种基础元任务(meta-tasks)。我们发现,仅对这三种元任务(原文此处指代前述五种元任务加上三元组中另外两个元素,结合上下文应理解为针对这三种核心要素进行训练,即五种元任务以及三元组中的目标和理解能力元素)以及三元组中的其他两个元素进行训练,就足以使模型在各种未见过的编辑任务中实现强大的泛化能力。为了进一步使模型的编辑行为与其思维链(CoT)推理保持一致,我们引入了“CoT-编辑一致性奖励”(CoT-Editing Consistency Reward),鼓励模型在编辑过程中更准确、有效地利用思维链(CoT)信息。实验表明,我们的方法在 21 项编辑任务上总体提升了 15.8%,并且当仅使用少量元任务进行训练时,仍能有效泛化至未见过的编辑任务。我们的代码、基准数据集和模型已发布于 https://shiyi-zh0408.github.io/projectpages/Meta-CoT/

一句话总结

Meta-CoT 通过将操作分解为“任务-目标-理解”三元组及五项基础元任务,来增强图像编辑能力。这些元任务引导特定任务的思维链推理与训练,从而同步提升细粒度理解能力与跨任务泛化能力。

方法

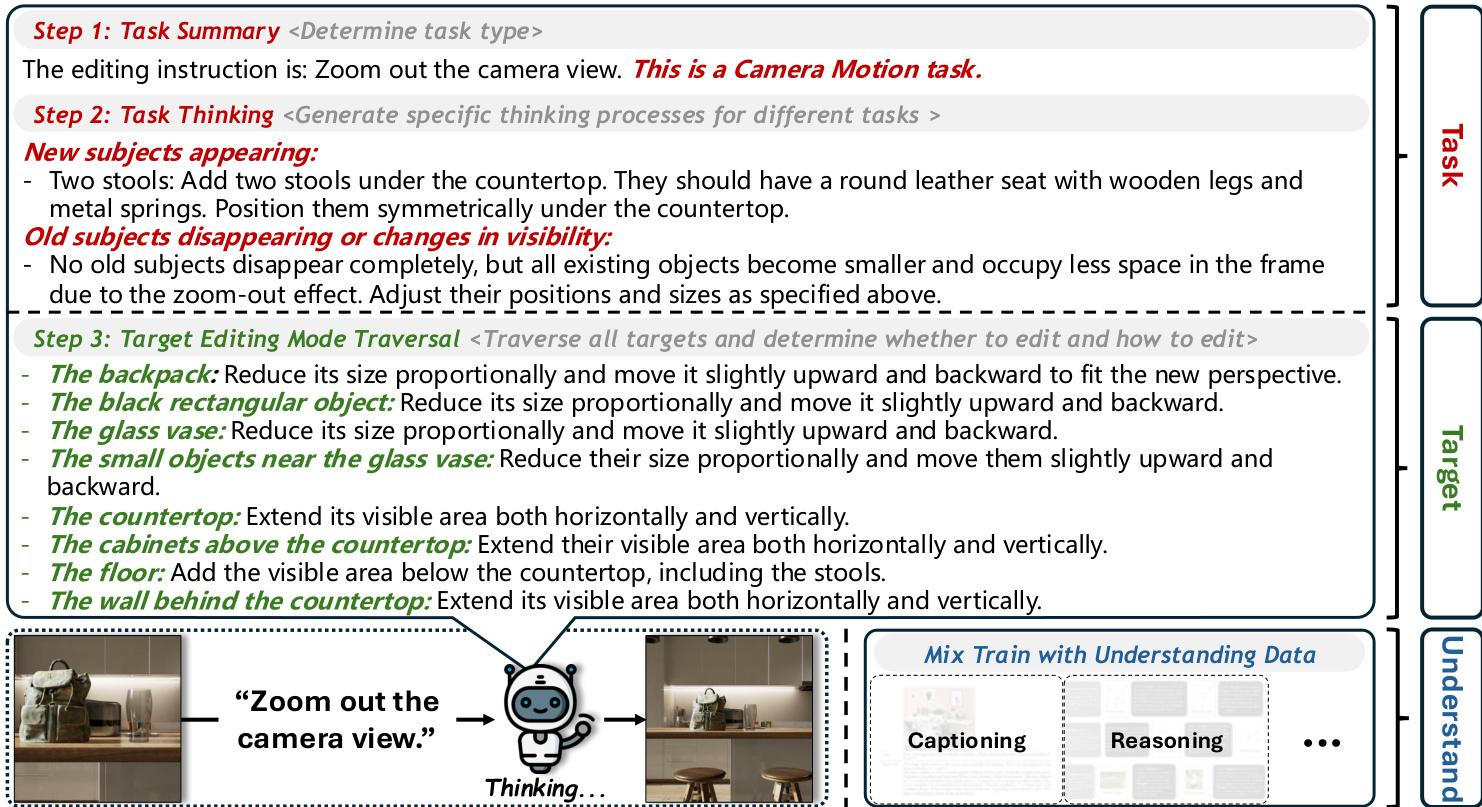

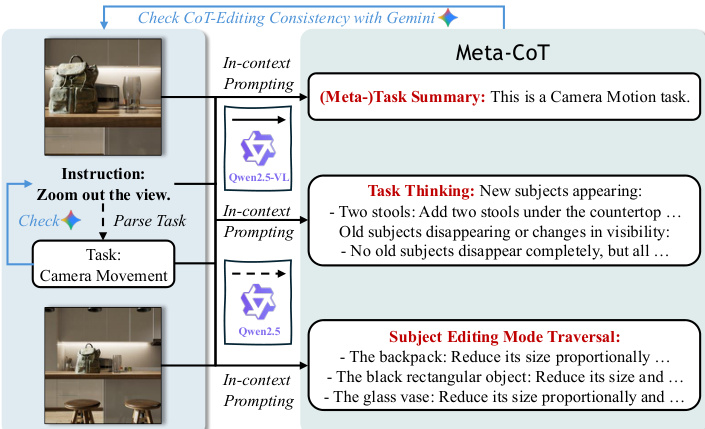

Meta-CoT 采用两级分解框架,以提升思维链(CoT)引导的图像编辑的理解粒度与泛化能力。该方法的核心始于三元组分解,即将任意编辑指令拆解为包含任务、目标及所需理解能力的三元组。在训练过程中显式学习三元组的各个元素,使模型能够在细粒度层面上对编辑操作进行推理。如图所示,该过程分为三个步骤:(1)任务摘要,模型从指令中推断任务类型;(2)任务推理,模型基于推断出的任务类型生成特定任务的推理过程;(3)逐目标编辑遍历,模型遍历图像中的所有目标,以确定每个目标是否需要编辑以及如何编辑,从而确保空间与语义的一致性。

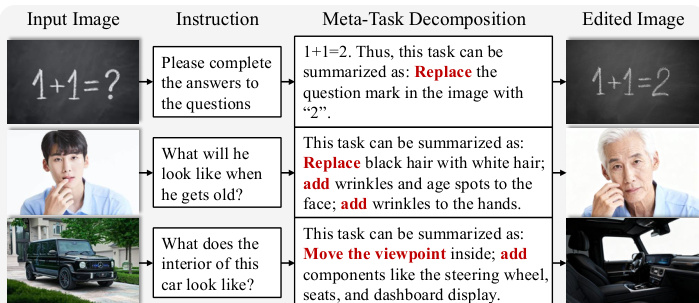

为进一步提升泛化能力,研究引入元任务分解作为第二级分解。该方法识别出一组基础操作,称为元任务,作为编辑任务空间的基础。研究定义了五种不同的元任务,包括相机运动、物体添加和物体删除,这些任务可组合以生成更复杂的编辑操作。随后,三元组被细化为(元任务、目标、所需理解能力),初始的任务摘要步骤被替换为元任务摘要,将指令分解为基本元任务的组合。这使得模型在仅使用少量元任务进行训练时,仍能有效泛化至未见过的编辑任务。

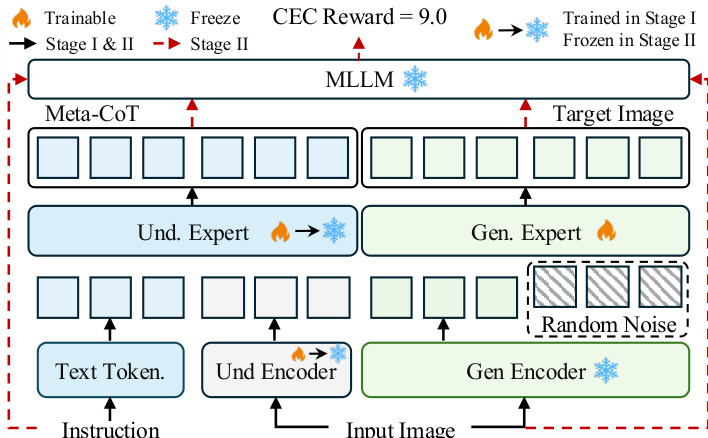

训练流程包含两个阶段。在第一与第二阶段中,理解专家与生成专家均进行微调,以训练 CoT 推理与图像编辑能力,同时更新图像理解编码器。在后续的强化学习阶段,图像理解编码器被冻结,仅训练生成专家。该设计基于以下观察:模型在初始微调阶段结束后已能生成高度准确的 CoT,若在强化学习阶段同时训练两个模块,可能导致优化不稳定,并削弱第一阶段习得的推理能力。

为使 CoT 推理与实际编辑行为保持一致,研究引入思维链-编辑一致性(CEC)奖励。该奖励从任务与目标两个维度,衡量生成的 CoT 与编辑结果之间的语义对齐程度。视觉语言模型(VLM)用于评估生成的编辑内容是否与 CoT 推理一致,并输出 0 到 10 的分数。CEC 奖励通过 Flow-GRPO 进行优化,优化过程聚焦于语义保真度最为关键的早期去噪时间步,并省略对后期时间步的更新以降低噪声伪影。

图 5 展示了 Meta-CoT 的数据构建流程,该流程处理源图像、目标图像与指令,以生成所需的训练数据。流程首先使用 Qwen2.5 确定编辑任务类型,随后通过 Gemini-2.5-Flash 进行一致性校验。随后,将源图像、目标图像、指令与任务类型输入 Qwen2.5-VL。在精心设计的提示词引导下,该模型生成(元)任务摘要、任务推理与目标编辑模式遍历。该流程还包含一个评估步骤,用于验证生成的 Meta-CoT 与实际编辑过程的一致性。

实验

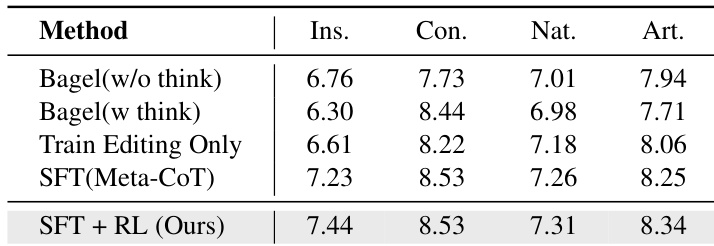

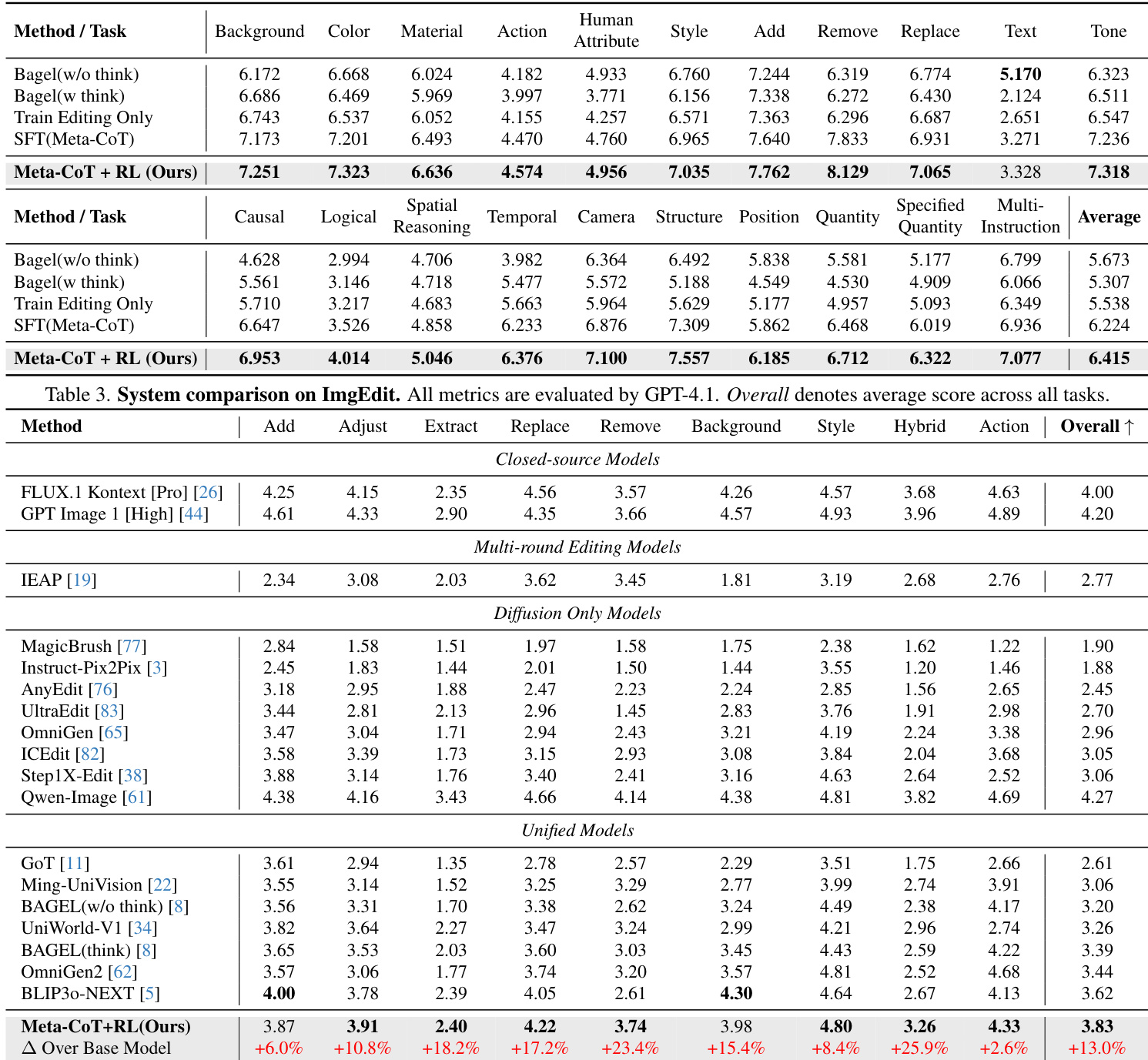

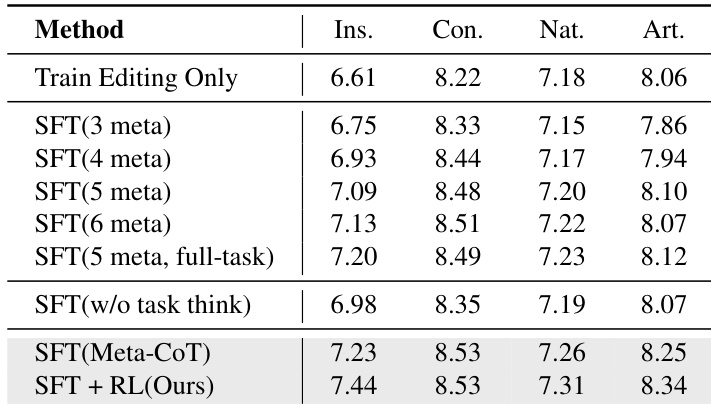

如表格所示,研究将 CoT 的第一步(“任务摘要”)替换为元任务摘要,并在五种不同的设置下进行训练,每种设置对应不同的元任务定义与训练任务类型数量。从基础的 3 元任务设置(添加、删除、替换)开始,研究逐步增加元任务的数量。结果显示,首先,仅在五项元任务上训练的模型,在 21 任务基准测试中已达到与全量数据模型相当的性能,并显著优于基线模型。

表格展示了针对(1)定义的元任务数量与训练任务,以及(2)Meta-CoT 中的任务推理的消融研究。(n meta)表示定义 n 个元任务并仅在其上进行训练。(5 meta, full-task)表示定义 5 个元任务,在全量任务上训练,并将每个任务的数据分解为元任务。

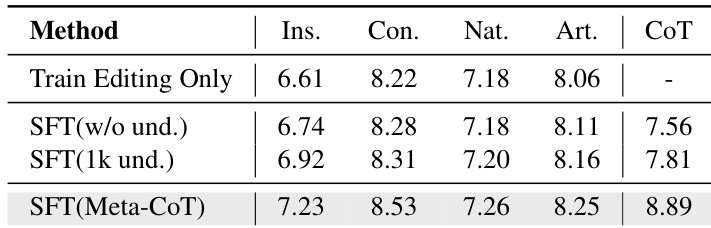

表格展示了训练过程中混合视觉理解数据量的消融研究。w/o und. 表示未混合视觉理解数据的训练。CoT 指标用于衡量任务推理与目标编辑遍历的完整性与准确性。

构成仅训练编辑的版本。这证明了元任务训练策略的强大泛化能力:在少量元任务上训练并学习任务分解,足以泛化至未见过的任务。换言之,掌握通用元任务与任务分解推理能够提升模型的泛化能力。其次,结果表明,定义的五个元任务在泛化能力与性能之间取得了良好平衡:定义更少的元任务会导致指令遵循能力显著下降,而定义更多的元任务则无法在所有任务上带来额外的明显提升。

Meta-CoT 中的任务推理是否有助于编辑过程?如表格所示,研究将该方法与移除任务推理(Meta-CoT 的第二步)的变体进行了对比。结果表明指令遵循性能显著下降,证实了基于任务特征的推理对编辑过程至关重要。

与理解数据联合训练如何影响编辑性能?表格中,研究对比了两种缩减设置:(a)移除所有理解数据,以及(b)仅使用 1K 样本,并与默认的 100K 进行对比。除四个 VIEScore 组件外,GPT-4.1 还从 Meta-CoT 中任务推理与目标编辑遍历的完整性与准确性角度评估 CoT 质量。结果表明,两种缩减设置均导致编辑性能显著下降,尤其是在指令遵循方面。图像中展示了涵盖常规编辑、基于推理的编辑及多指令编辑(放大查看)的跨不同编辑任务的定性结果。研究展示了 Meta-CoT 推理过程的部分可视化内容。Meta-CoT 能够分解指令,将其归类为具体任务,基于任务特征生成推理,并准确判断每个目标是否需要进行编辑,最终实现更优的编辑效果。更多任务示例请参阅补充材料。

遵循能力下降,因为有限的理解数据会削弱模型对编辑指令的理解。CoT 质量的显著下降进一步证实了这一点,强调了在训练过程中平衡三元组所有三个元素的必要性,并表明更高质量的 Meta-CoT 推理能够带来更优的编辑结果。

- 4.4. 定性评估

如图所示,研究展示了涵盖常规编辑、基于推理的编辑及多指令编辑的跨不同编辑任务的对比结果。与基线方法相比,该方法在指令遵循、逻辑推理及多指令理解方面均实现显著提升。这表明该方法在编辑过程中能更有效地激活并利用模型固有的理解能力。

研究在多项编辑基准测试中将该方法与多种基线方法进行对比,证明了其在各类编辑任务上整体性能的全面提升。结果表明,引入 Meta-CoT 推理能显著增强指令遵循能力与整体编辑质量,尤其在复杂及多指令场景中表现突出,同时凸显了与视觉理解数据联合训练的重要性。与基线方法相比,Meta-CoT 推理在指令遵循与整体编辑性能方面带来显著改进。该方法在各类编辑任务上均优于现有模型,尤其在多指令与复杂编辑场景中优势明显。与视觉理解数据的联合训练对于维持高质量的 Meta-CoT 推理与整体编辑结果至关重要。

研究开展消融实验,以评估不同训练配置对编辑性能的影响,重点关注元任务数量、任务推理的引入以及视觉理解数据的整合。结果表明,增加元任务数量可在一定范围内提升性能,而引入任务推理与充足的理解数据则是实现高质量编辑结果的关键。采用完整 Meta-CoT 与强化学习的提出方法在所有评估维度上均取得最佳的整体性能。增加元任务数量最多可提升至五个,超出此数量后额外增加元任务的收益逐渐递减。在 Meta-CoT 中纳入任务推理能显著增强指令遵循能力与整体编辑质量。整合视觉理解数据对于维持高质量推理与实现最优编辑结果至关重要。

{"summary": "研究对比了不同的训练配置,以评估元任务学习与视觉理解对编辑性能的影响。结果表明,引入元任务推理与充足的视觉理解数据能够在多个编辑质量维度上带来持续改进。该方法在所有评估方面均取得最高分,尤其在指令遵循与推理质量方面表现突出。", "highlights": ["与不引入此类推理的训练相比,引入元任务推理显著提升了指令遵循与整体编辑性能。", "在训练过程中添加视觉理解数据增强了模型遵循指令并生成高质量编辑结果的能力。", "该方法在所有评估维度上均稳定优于基线配置,其中在指令遵循与推理质量方面的提升最为显著。"]}

研究在编辑任务基准测试上评估了该方法,并将其与包括 Bagel 及未使用 Meta-CoT 训练的变体在内的多种基线方法进行对比。结果表明,该方法在所有评估维度上均取得更高分数,其中指令遵循方面的提升最为显著。消融研究进一步验证了 Meta-CoT 框架的有效性,强调了任务推理与理解数据联合训练的重要性。提出方法在所有评估维度上均优于基线方法,尤其在指令遵循方面表现突出。消融研究证实,Meta-CoT 推理过程与理解数据联合训练对取得优异性能至关重要。定性结果表明,与基线方法相比,该方法在指令遵循与逻辑推理方面均有改善。

研究在多项编辑基准测试上将该方法与多种基线进行对比,同时开展消融实验以评估元任务数量、任务推理及视觉理解数据整合等训练配置的影响。这些实验验证了引入 Meta-CoT 推理与视觉理解数据联合训练能大幅提升指令遵循与逻辑推理能力,尤其在复杂及多指令场景中效果显著。总体而言,提出方法在所有评估维度上均稳定优于现有方法,证明了结构化推理与多模态数据对齐对于实现高质量图像编辑结果的关键作用。