Command Palette

Search for a command to run...

ClawMark:面向多轮、多日、多模态协作智能体的真实世界基准测试

ClawMark:面向多轮、多日、多模态协作智能体的真实世界基准测试

摘要

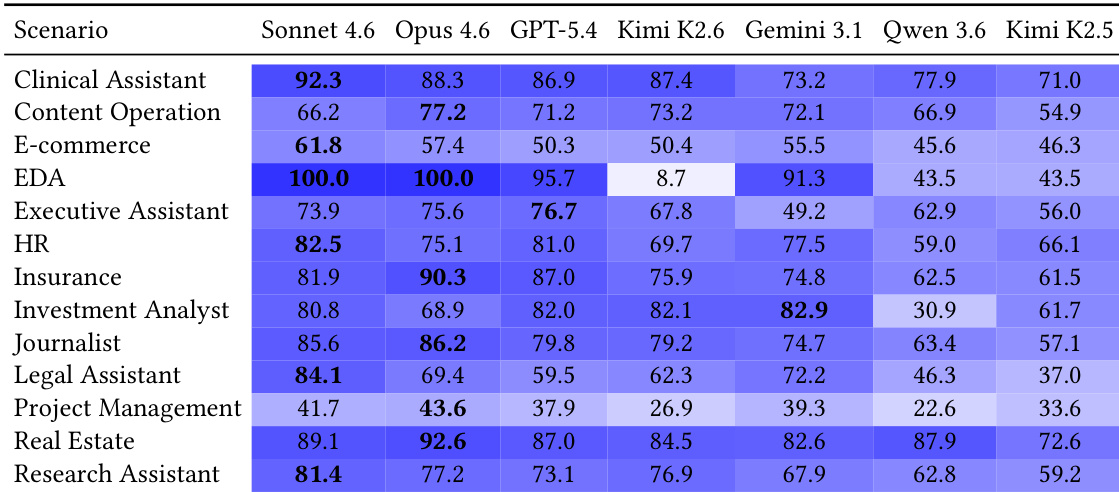

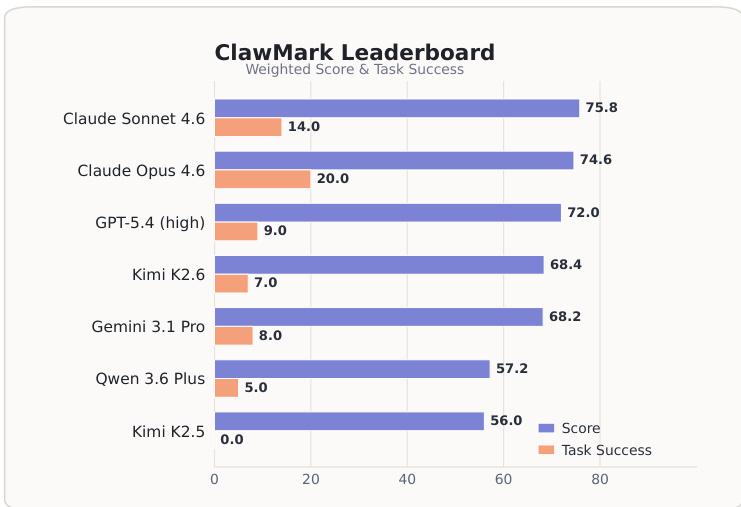

语言模型代理(language-model agents)正日益被用作持久化的同事,在多个工作日内协助用户。在此类工作流中,周围环境可能会独立于代理发生变化:新邮件抵达、日历条目调整、知识库记录更新,以及证据分散出现在图像、扫描版 PDF、音频、视频和电子表格中。现有的基准测试未能充分评估这一场景,因为它们通常在单一的静态回合(episode)中运行,且主要局限于文本中心。我们引入了 [名称缺失],这是一个面向同事型代理的基准测试,其核心特征包括:围绕多轮次、跨天任务设计;一个状态感知的沙盒化服务环境,其状态会在回合之间演变;以及基于规则的验证机制。当前版本包含 13 个专业场景下的 100 个任务,这些任务在五个状态感知的沙盒化服务(文件系统、电子邮件、日历、知识库、电子表格)上执行,并通过 1537 个确定性的 Python 检查器对执行后的服务状态进行评分,评分过程中未调用任何基于大语言模型的评估(LLM-as-judge)。我们测试了七个前沿的代理系统。表现最强的模型获得了 75.8 的加权得分,但最高的严格任务成功率(Task Success)仅为 20.0%,这表明部分进展很常见,而完整的端到端工作流完成则较为罕见。回合层面的分析显示,性能在首次外部(exogenous)环境更新后出现下降,凸显出适应状态变化是一个关键的开放挑战。我们发布了该基准测试、评估工具包以及构建流程,以支持可复现的同事型代理评估。

一句话总结

ClawMark 团队推出了 CLAWMARK,这是一个包含 13 个专业场景中 100 项任务的基准测试。该基准测试在具有状态管理功能的沙盒环境中,评估了七款前沿 coworker agent 在多轮、多日工作流中的表现。研究团队利用 1,537 个确定性 Python 检查器对结果进行评分,结果显示,即便性能最强的模型其严格任务成功率也仅为 20.0%,且在适应外部状态更新方面面临显著挑战。

核心贡献

- 推出 CLAWMARK 作为 coworker agent 的基准测试,将多轮多日工作流与具有状态管理功能的沙盒环境相结合,在该环境中,外部状态更新会在 agent 每次交互轮次之间独立发生。

- 评估框架采用确定性评分协议,利用 1,537 个 Python 检查器验证执行后的服务状态,从而消除对 LLM-as-judge 评估的依赖。

- 对七款前沿 agent 系统的基准测试表明,尽管最高加权得分达到 75.8,但严格任务成功率仍停留在 20.0%。在经历初始环境更新后,模型性能出现下滑,进一步凸显了适应能力是当前的主要挑战。

引言

随着语言模型从单会话工具演变为持久化的数字同事,在动态的真实办公环境中对其进行评估已成为必要。现有基准测试难以反映这一现实,因为它们将交互视为静态快照,忽略了独立于 agent 发生的外部状态变化,且几乎完全依赖基于文本的输入。为弥补这些不足,研究团队推出了 CLAWMARK。该基准测试模拟了跨邮件、日历和共享驱动器等具有状态管理功能的沙盒服务的多日 coworker 工作流。该框架使 agent 暴露于外部状态更新与未转录的多模态证据中,同时采用确定性的规则评分协议取代主观的 LLM 裁判。通过提供可复现的评估框架并测试七款前沿模型,研究团队确立了衡量持久化 agent 适应能力、外部状态追踪及多模态集成的严格标准。

数据集

1. 数据集构成与来源

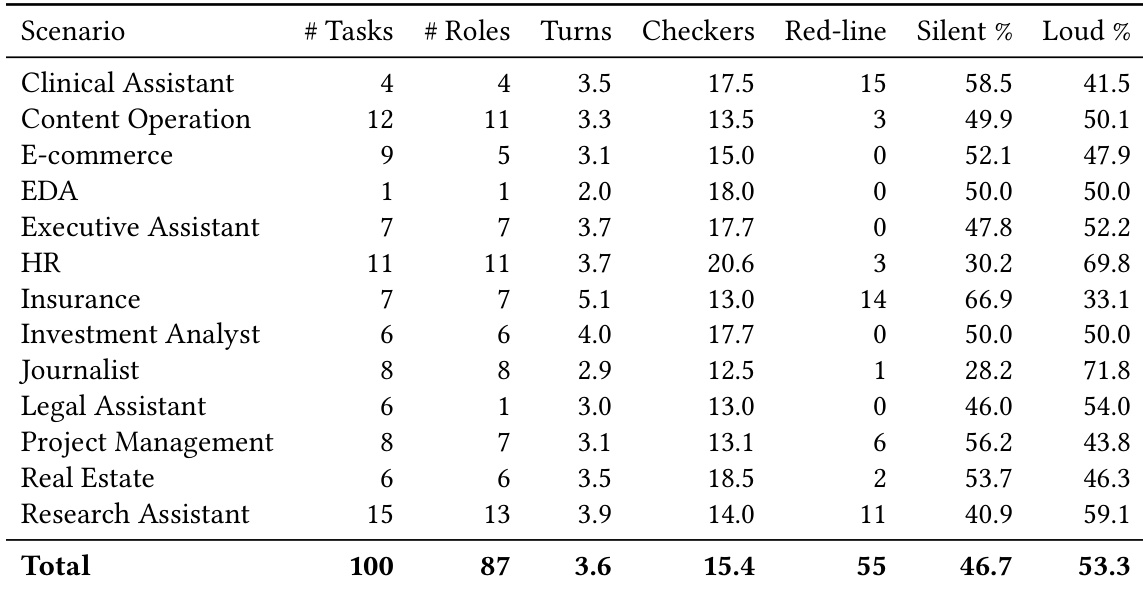

- 研究团队推出 CLAWMARK,该基准测试包含 100 项任务,分布于 13 个专业场景及 87 个独立的任务内角色中。

- 语料库依赖 1,072 份原始多模态素材,涵盖照片、音频、扫描版 PDF、视频及电子表格。

- 证据来源包含三条渠道:公开领域文档的网络采集、原始录音以及定向 AI 合成,所有素材均标注了来源信息。

2. 各子集关键细节

- 该数据集未采用传统的训练集或测试集划分。任务按专业领域组织,范围涵盖通用办公角色至临床辅助和电子设计自动化等垂直领域。

- 每项任务涵盖两到六个交互轮次,每个轮次代表模拟世界中的一个工作日。

- 任务包含六至二十九个加权评估检查器,其中包括五十项严格红线约束,用于强制执行硬性规则。

- 描述性元数据追踪轮次间静默突变与显性突变的平均占比,该分类仅用于语料库特征描述,不影响评分。

3. 数据在本文中的使用方式

- 研究团队仅将数据集用于评估而非模型训练,因此未应用训练集划分或混合比例。

- 使用单一且与框架无关的评估框架对七款前沿 agent 系统进行基准测试,以隔离模型性能差异。

- 评分完全基于规则。研究团队采用 1,537 个确定性 Python 检查器,用于检查五个沙盒服务(包括文件系统、邮件、日历、知识库和电子表格)的执行后状态。

- 评估管道通过要求独立重跑时检查器判定结果完全一致来保证确定性,明确避免使用 LLM-as-judge 方法。

4. 处理与元数据构建

- 多模态证据未经裁剪或预处理;原始文件直接交付给 agent 进行独立解析。

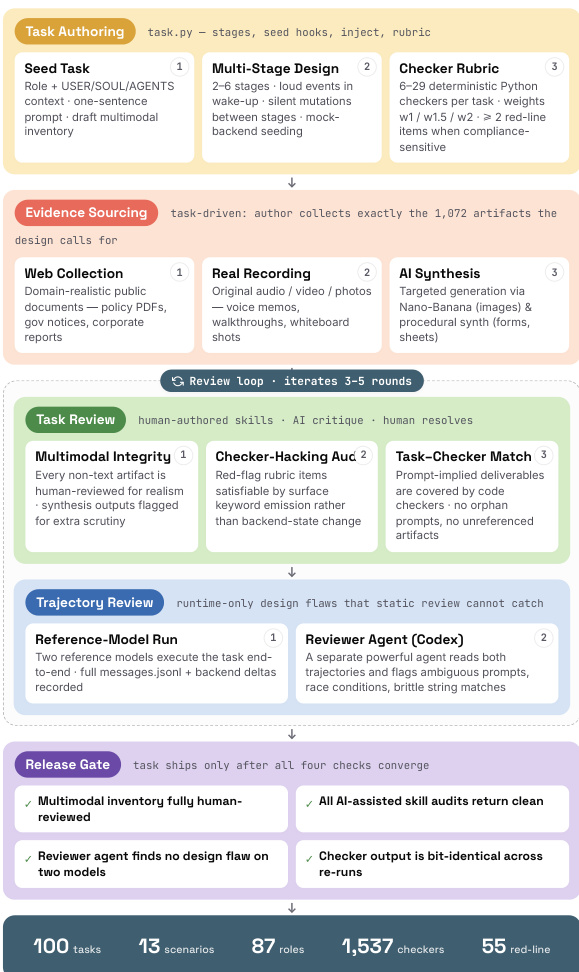

- 任务规范通过每个场景一个

task.py文件构建,该文件定义了轮次结构、服务种子钩子、轮次间注入脚本及加权检查器评分标准。 - 环境在轮次间独立演化,包含两种突变类型:在唤醒提示中声明的显性事件,以及直接注入服务且无需通知的静默突变。

- 严格的发布门控在构建过程中过滤语料库,要求人工审核、AI 审计通过及重跑结果一致。未能通过确定性验证超过两次的任务将被重新设计或移除。

方法

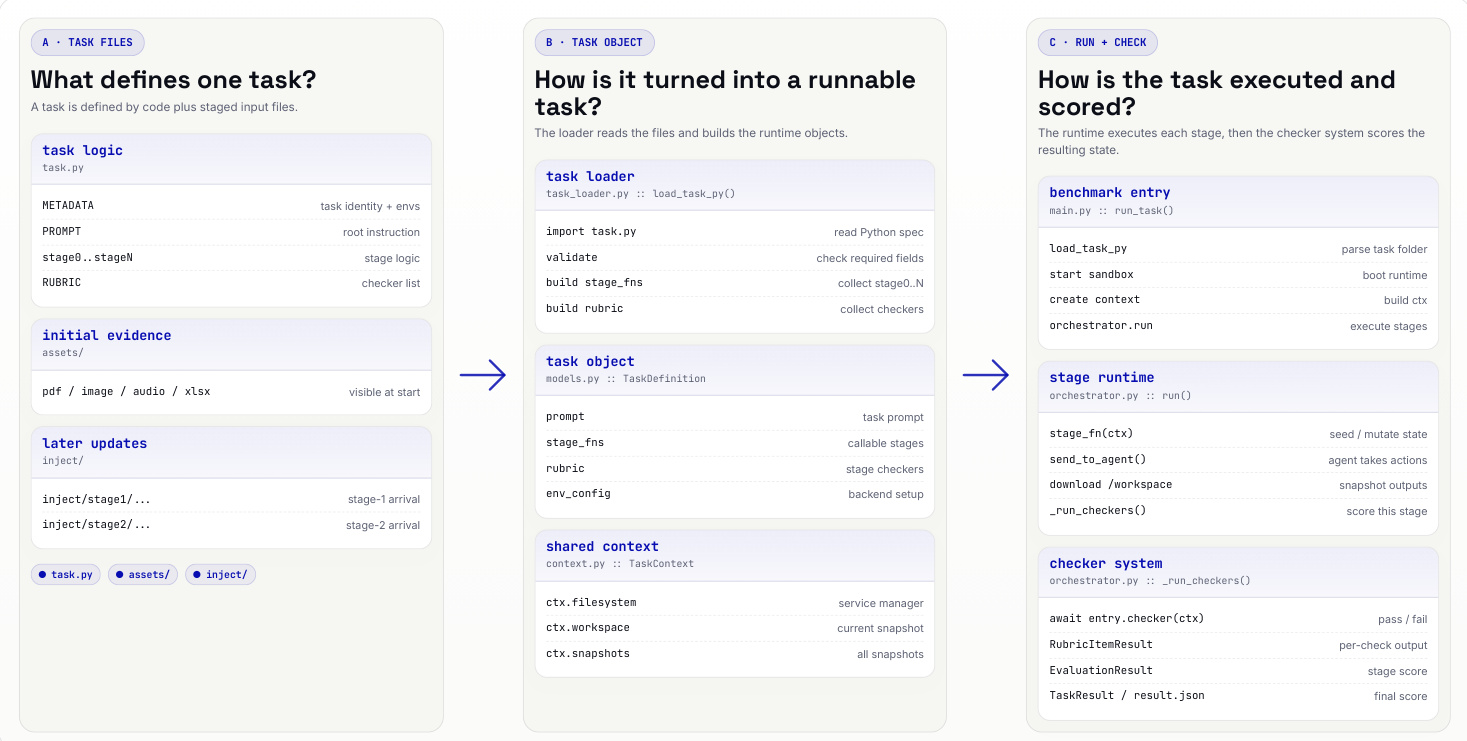

研究团队采用模块化框架,旨在将自然语言任务规范与可执行的多轮、多服务 agent 评估相连接。系统核心围绕任务定义文件 task.py 展开,该文件封装了单次评估所需的全部组件。该文件定义了四个关键元素:轮次入口(每个均为异步函数,指定唤醒提示、允许使用的工具及服务端突变钩子);注入层(提供每轮开始时引入的证据文件);检查器函数(确定性 Python 例程,用于对照评分标准项评估轮次后的服务状态);以及评分标准映射(为每个检查器分配权重与轮次分配,红线检查器通过 ID 约定和固定高权重进行区分)。

框架以加载器启动,负责将任务定义文件及相关分阶段输入文件解析为运行时对象。task_loader.py 模块读取 task.py,验证必要字段,从 assets/ 和 inject/ 目录收集特定阶段的证据,并构建任务对象。该任务对象在 models.py 中定义,包含提示词、阶段函数、评分标准及环境配置。由 context.py 管理的共享上下文保存着服务管理器及后端服务的当前快照。这种结构化表示使编排器能够在隔离的 docker-compose 栈中执行每个轮次,该栈包含 agent 容器及五项服务:Docker 挂载文件系统、GreenMail SMTP/IMAP、Notion API、Google Sheets API 以及 Radicale CalDAV 服务器。

执行过程按阶段推进。基准测试入口文件 main.py 解析任务文件夹,启动运行时环境并构建上下文。随后编排器执行各个阶段,从 seed 或 mutate 状态开始,接着由 agent 执行操作、下载输出并捕获快照。每轮结束后,实现在 orchestrator.py 中的检查器系统会针对当前服务状态运行所有相关检查器。checker 模块评估每个评分标准项,返回通过或失败的判定结果。结果被汇总为最终的 TaskResult 记录,包含各检查器的判定结果与最终得分,从而确保对 agent 在所有轮次中表现的综合且确定性评估。

实验

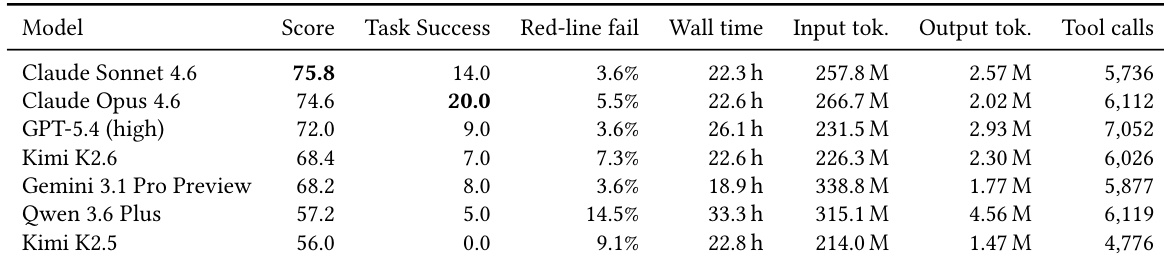

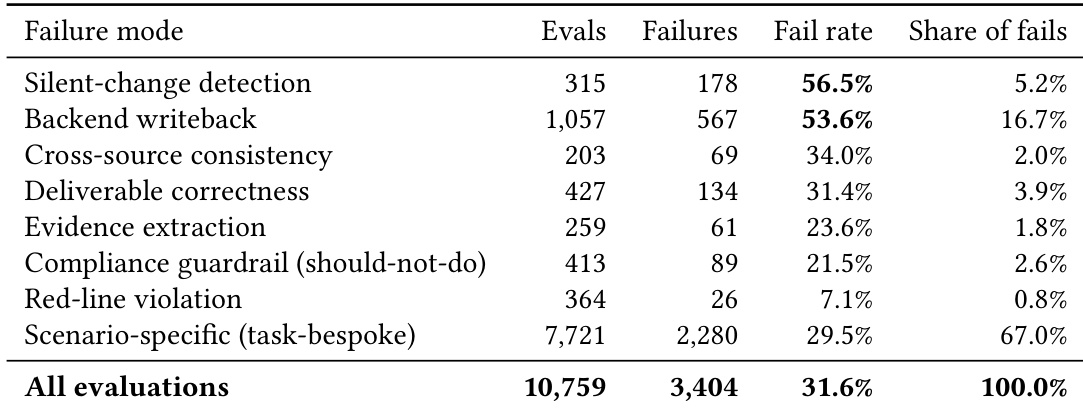

评估采用确定性沙盒框架,在 13 个专业场景的 100 项任务上测试七款前沿模型,以衡量端到端的 agent 性能。主基准测试验证了通用能力与领域专业化,结果显示顶尖系统表现紧密聚集,没有单一模型在所有任务中占据绝对优势。逐轮轨迹分析考察了动态环境变化下的自适应推理能力,表明大多数 agent 在外部状态突变后难以恢复。同时,故障模式分类法揭示了结构性弱点,指出静默变化检测失败与后端写入错误构成了整体失误的主要部分。综合来看,这些实验表明,可靠的职业化部署需要强大的状态同步与严格的合规遵循,因为综合得分往往会掩盖关键的轨迹偏差与约束违规。

实验在多样化的专业场景中评估了多款模型,结果显示不同领域间的性能存在显著差异。基准测试强调,没有单一模型能主导所有场景,模型在处理涉及外部状态变更与合规约束的复杂多轮任务时表现出明显的优劣分野。模型在环境变化后的恢复能力,以及避免关键故障模式(如遗漏静默更新或未提交后端操作)的能力,进一步影响整体表现。性能因场景而异,模型呈现出专业化特征,而非统一的顶尖排名。多数失败集中在静默变化检测与后端操作提交环节,指明了关键的改进方向。模型在首次外部状态变更后难以恢复,至最后一轮时,多数模型性能仍低于初始水平。

研究团队在衡量多轮多日工作流中 coworker-agent 行为的基准测试上评估了七款前沿模型,重点关注其对状态外部变更的响应及合规遵循情况。结果显示,没有模型在所有指标上均取得高分。模型在首次外部突变后性能显著下滑,且在静默变化检测与后端操作提交方面失败率较高。顶尖模型在不同场景中的优势各异,且性能与资源消耗或工具效率之间并无稳定相关性。没有模型实现高任务成功率或完全合规,最高得分未达 76 分,最佳任务成功率仅为 20%。模型在首次外部状态变更后出现显著性能下滑,多数未能恢复至初始水平。静默变化检测与后端操作提交的失败率最高,暴露出状态管理与操作执行方面的关键短板。

研究团队在涵盖专业场景的基准测试上评估了七款前沿模型,结果显示没有模型能在所有任务中取得高综合表现。顶尖模型的综合得分紧密聚集,但具体表现因场景而异,没有单一模型能在所有领域表现卓越。评估表明,即便性能最优的模型也难以独立完成端到端任务,且在外部状态变更后性能急剧下滑,反映出恢复能力有限。没有单一模型主导所有场景,顶尖表现者随任务类型变化,未在不同领域展现持续领先地位。性能在首次环境变更后显著下降,多数模型在跨轮次评估的最后一天仍无法完全恢复。得分最高的两款模型在操作成本方面同样最为高效,表明综合性能与计算效率之间存在正相关关系。

研究团队在 ClawMark 基准测试上评估了七款前沿模型,该测试衡量多轮多日工作流中 coworker-agent 的行为,涵盖外部状态变更与多模态证据。结果显示,没有模型取得高任务成功率,表现最优的模型仅完全解决约 20% 的任务。性能因场景差异显著,表明模型具有专业化特征,且在处理静默变化检测与后端写入等结构性故障方面仍有提升空间。没有模型实现高任务成功率,表现最优者仅完成极小部分任务。性能因场景而异,不同模型在不同领域表现突出,印证了专业化趋势。失败案例集中于静默变化检测与后端写入等结构性挑战,这些环节对现实世界的可靠性至关重要。

研究团队分析了评估 coworker-agent 行为的基准测试中的故障模式,重点关注模型处理外部状态变更与合规约束的方式。结果显示,失败案例高度集中于两类主要场景:静默变化检测与后端写入,其失败率显著高于其他评估类型。特定场景检查构成了多数失败案例,这主要归因于其数量庞大而非脆弱性增加;红线违规虽属罕见,但集中在少量任务与模型中。静默变化检测与后端写入是主导性故障模式,失败率接近基准测试整体平均水平的两倍。特定场景检查贡献了最大比例的失败案例,主要由其数量庞大驱动,而非单次评估的脆弱性更高。红线违规总体罕见,但集中在特定任务与模型中,表明在原本表现优异的轨迹中可能存在安全隐患。

评估在旨在验证多轮多日职业工作流中 coworker-agent 能力的基准测试上,测试了多款前沿模型。该工作流融合了外部状态变更与合规约束。结果表明,没有单一模型能在所有领域展现持续优势,呈现出明显的性能专业化特征而非统一能力。模型在初始环境变更后经历显著的性能衰退,且在长期交互中通常无法恢复至基线水平。主要弱点集中于静默状态更新检测与后端操作执行,凸显了状态管理与长期可靠性方面的关键短板,从而限制了整体任务成功率。