Command Palette

Search for a command to run...

从生成式视角探索空间智能

从生成式视角探索空间智能

摘要

空间智能对于多模态大语言模型至关重要,然而目前的基准测试(benchmarks)很大程度上仅从理解的角度对其进行评估。我们探讨了现代生成式或统一多模态模型是否也具备生成式空间智能(Generative Spatial Intelligence, GSI)——即在图像生成过程中遵循并操控 3D 空间约束的能力,以及这种能力是否可以被衡量或提升。我们推出了 GSI-Bench,这是首个旨在通过空间定位图像编辑来量化 GSI 的基准测试。它由两个互补的部分组成:GSI-Real,这是一个通过 3D 先验引导的生成与过滤流水线构建的高质量真实世界数据集;以及 GSI-Syn,这是一个具有可控空间操作和全自动标注的大规模合成基准测试。结合统一的评估协议,GSI-Bench 能够对空间合规性(spatial compliance)和编辑保真度进行可扩展且与模型无关(model-agnostic)的评估。实验表明,在 GSI-Syn 上对统一多模态模型进行微调,不仅在合成任务和真实任务上均取得了显著提升,而且令人惊讶的是,它还增强了下游的空间理解能力。这提供了首个明确的证据,证明生成式训练可以切实增强空间推理能力,为推进多模态模型的空间智能开辟了新的路径。

一句话总结

为了通过空间定位的图像编辑来量化生成式空间智能,作者引入了 GSI-Bench。该基准测试由真实世界的 GSI-Real 数据集和合成的 GSI-Syn 数据集组成,能够实现对空间合规性的可扩展评估,并证明了生成式训练能显著增强图像操作的保真度以及下游的空间推理能力。

核心贡献

- 本文引入了 GSI-Bench,这是一个旨在通过空间定位的图像编辑来量化生成式空间智能 (GSI) 的新型基准测试。该框架由 GSI-Real(通过 3D 先验引导流水线创建的高质量真实世界数据集)和 GSI-Syn(具有可控空间操作和自动标注的大规模合成数据集)组成。

- 研究建立了一套统一的评估协议,能够对空间合规性和编辑保真度进行可扩展且与模型无关的评估。通过要求模型根据特定指令操纵空间结构,该方法将空间推理的生成方面与理解方面联系起来。

- 实验表明,在 GSI-Syn 数据集上对统一的多模态模型进行微调,可以显著提高合成任务和真实世界任务中的空间合规性。结果进一步表明,这种生成式训练过程提供了迁移效应,增强了下游的空间理解能力。

引言

空间智能是多模态大语言模型与物理世界交互的基础要求,涵盖了从机器人操纵到 3D 场景理解的任务。虽然现有研究主要集中在通过识别和问答来进行空间理解,但模型在图像生成过程中主动操纵空间约束的能力在很大程度上仍未得到探索。作者通过引入 GSI-Bench 填补了这一空白,这是一个旨在通过空间定位的图像编辑来量化生成式空间智能 (GSI) 的新型基准测试。该框架包括高质量的真实世界数据集 GSI-Real 和具有可控空间操作的大规模合成数据集 GSI-Syn。通过这项工作,作者证明了在生成式空间任务上微调统一模型不仅能提高图像编辑的保真度,还能增强下游的空间推理和理解能力。

数据集

作者引入了两个互补的基准测试 GSI-Syn 和 GSI-Real,旨在通过合成数据和真实世界数据评估生成式空间智能。

-

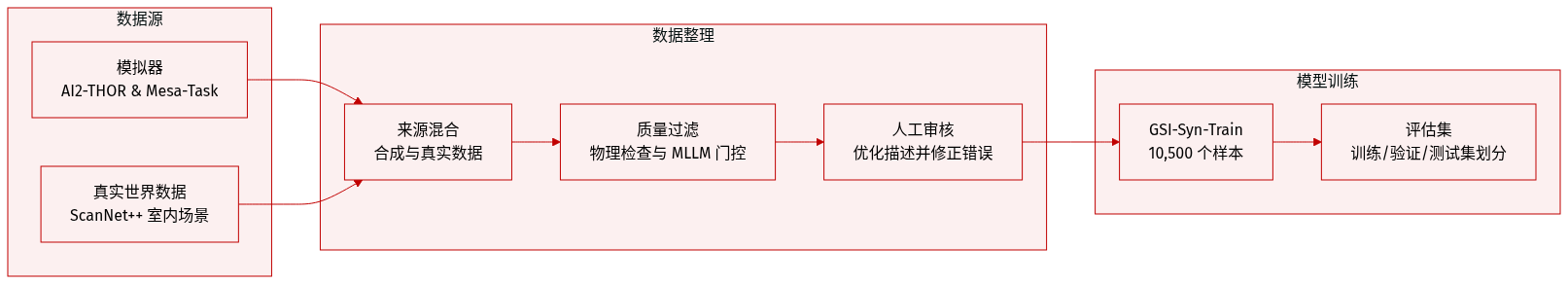

数据集组成与来源

- GSI-Syn (合成): 使用开源模拟器 AI2-THOR 和 Mesa-Task 构建,以提供完美的 ground-truth 数据,包括 3D 场景表示、几何变换和渲染的目标图像。

- GSI-Real (真实世界): 选自大规模室内 RGB-D 数据集 ScanNet++,用于在无法获得完美 3D ground truth 的自然图像上评估模型。

-

子集详情

- GSI-Syn-Room: 包含 593 个样本,涵盖六种操作类型,来源于 AI2-THOR。

- GSI-Syn-Tabletop: 包含 600 个样本,涵盖三种操作类型,来源于 Mesa-Task。

- GSI-Syn-Bathroom: 一个包含 200 个样本的专门子集,具有随机视角,用于测试跨视角泛化能力。

- GSI-Real: 包含来自 211 个不同室内场景的 441 个样本,跨越三种操作类型。

- GSI-Syn-Train: 一个大规模微调集,总计 10,500 个样本,每个环境每种操作类型包含 1,500 个样本。

-

数据处理与质量控制

- 合成流水线: 作者在平面图上使用 DBSCAN 聚类进行视角筛选,并优先选择具有可操纵对象的可用视角。操作通过 3D 几何检查和具备物理特性的模拟进行验证。应用了两阶段过滤器:首先移除像素变化微乎其微的样本,其次使用 MLLM (Qwen3-VL-235B) 剔除模拟伪影或物理上不合理的输出。

- 真实世界流水线: 从 ScanNet++ 中每 20 帧采样一次图像,并进行清晰度和物体密度的过滤。作者使用 DetAny3D 重建 3D 场景结构和边界框。为确保质量,采用了基于可视化的验证方法,即使用 MLLM 识别碰撞或遮挡、纠正标注错误,并将模板说明改写为自然语言。最后进行人工审核以完善所有指令。

-

使用与评估

- 训练: GSI-Syn-Train 子集用于模型微调,训练集与测试集之间保持严格的场景隔离,以防止数据泄露。

- 评估: GSI-Syn 通过 ground-truth 三元组提供明确的自动验证。对于 GSI-Real,作者使用另一种协议,通过分析模型预测的编辑与指定的 3D 变换之间的空间一致性来评估成功率。

方法

作者利用了一个用于空间定位图像编辑 (GSI) 的统一框架,该框架通过一个集成了 3D 场景理解、空间推理和多模态生成的结构化流水线运行。核心方法始于 3D 场景表示,其中每个场景 S 被建模为物体集合 Oi=(ci,si,Ri) 和相机 C=(Rc,tc,K),从而实现精确的几何变换。这种表示支撑了七种定量空间操作的分类法,包括物体旋转、移动、缩放、移除和透视控制,如下图所示。这些操作基于显式的 3D 变换,从而实现了物理一致且可控的图像编辑。

参考框架图以了解 GSI-Bench 的整体架构,它由三个主要部分组成:GSI-Real、GSI-Syn 和 GSI-Bench。GSI-Real 提供来自 211 个场景的真实世界数据,包括相对于相机的移动、物体旋转和空间移除。GSI-Syn 生成合成数据,包含浴室(200 个样本)、桌面(600 个样本)和房间(593 个样本)环境的子集,以及一个包含 10,500 个样本的训练集。GSI-Bench 集成了这些数据源,以评估模型在各种空间任务中的表现。该框架支持多个训练和评估模块,包括 GSI-Syn-Train、GSI-Syn-Tabletop 和 GSI-Syn-Room,每个模块都针对特定的空间操纵场景进行了定制。

如下图所示,GSI-Syn 流水线旨在自动合成高质量的训练数据。它始于场景初始化和视角筛选,通过采样最大分散的视角来确保多样化的覆盖。随后,3D 几何检查模块在生成指令前验证非遮挡、稳定性及避障等约束。操作在模拟器中执行,并将结果状态与理想状态进行比对。如果实际状态符合预期结果,则保留输出;否则,过程回滚。生成后的过滤通过应用实例分割和多模态语言模型来确保质量,以剔除严重的遮挡或物体裁剪等异常情况。

在第二阶段,流水线转向 3D 场景重建和操作生成。根据频域分析选择候选帧,以确保清晰度并最大限度减少运动模糊。DetAny3D 重建 3D 场景,提取物体的边界框、姿态和语义标签。随后生成空间操作,并通过前后对比验证结果。最后一步涉及人工审核和完善,标注者负责纠正模糊的指令并识别残留错误。这一迭代过程确保了生成数据的准确性和语义一致性。

针对 GSI 的统一多模态大语言模型 (MLLM) 微调是以 BAGEL 作为基础模型进行的,该模型通过自注意力机制支持图像编辑,从而实现感知与生成模块之间的深度交互。训练集构建自 GSI-Syn,纳入了移动、旋转、调整大小、移除、缩放和视角变化等多样化操作。这种方法允许模型直接从生成数据中学习空间关系,增强其理解和执行复杂空间指令的能力。评估协议从指令合规性、空间准确性、编辑局部性和外观一致性四个维度评估性能,为空间智能提供了一个全面的基准。

实验

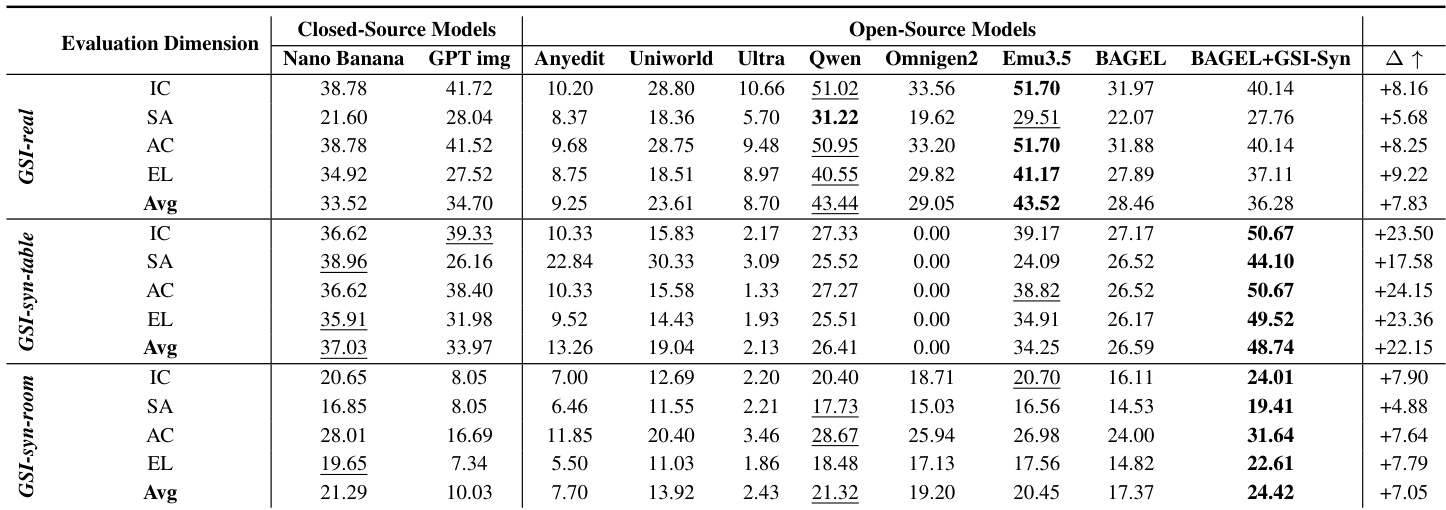

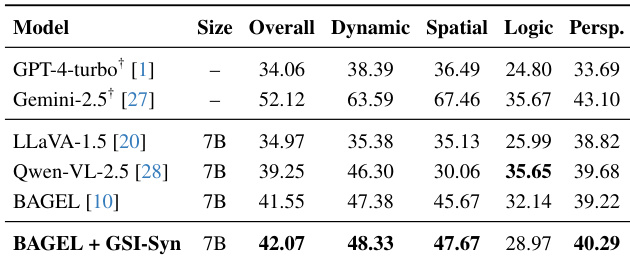

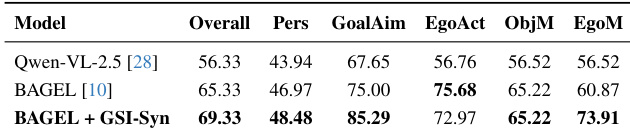

评估协议通过指令合规性、空间准确性、编辑局部性和外观一致性,在合成和真实世界数据集上评估生成式空间智能。基准测试表明,虽然闭源模型在通用视觉生成方面表现出色,但与 Emu3.5 等专门的开源模型相比,它们在进行细粒度空间推理所需的精确几何操纵时往往表现不佳。此外,在几何定位的合成数据上进行微调展示了有效的 sim-to-real 迁移能力,在无需真实世界标注的情况下,显著增强了空间编辑能力和基础空间理解能力。

作者在多个模型和数据集上评估了生成式空间智能,重点关注指令合规性、空间准确性、外观一致性和编辑局部性。结果显示,开源模型,特别是 Emu3.5 和经过微调的 BAGEL,在真实世界和合成基准测试中取得了强劲的表现,在合成数据上微调后,局部编辑和空间保真度有了显著提升。闭源模型在指令合规性和外观一致性方面表现良好,但在细粒度空间准确性方面存在困难。Emu3.5 在开源模型中始终保持领先,而微调显著增强了空间推理能力,特别是在编辑局部性和空间准确性方面。像 Emu3.5 和经过微调的 BAGEL 这样的开源模型在空间推理任务上表现强劲,尤其是在编辑局部性和空间准确性方面。在合成数据上进行微调提高了空间理解能力以及向真实世界场景的迁移能力,在编辑局部性和外观一致性方面取得了显著收益。闭源模型在指令合规性和外观一致性方面表现出色,但在空间准确性方面落后,这表明其在几何推理方面存在局限性。

作者使用包含指令合规性、空间准确性、编辑局部性和外观一致性指标的多维度协议评估生成式空间智能。结果表明,在合成数据上进行微调可以提高空间理解能力和向真实世界任务的迁移能力,在编辑局部性和外观一致性方面有显著提升,同时也增强了在衡量空间交互和视角获取基准上的表现。在合成数据上微调显著提高了真实世界场景中的编辑局部性和外观一致性。在空间定位的生成数据上训练的模型在衡量交互和视角的基准测试中表现出增强的空间理解能力。性能提升在局部编辑和物体身份保持方面最为明显,并在多个指标上表现出持续的改进。

作者使用包含指令合规性、空间准确性、编辑局部性和外观一致性的多维度协议评估生成式空间智能。结果显示,在合成数据上进行微调可以提高空间推理和编辑性能,特别是在局部编辑和物体保持方面,表现最好的模型在多个维度上都展示了显著的收益。在合成数据上进行微调可以从多个维度提高空间推理和编辑性能。与基线模型相比,表现最好的模型在指令合规性和空间准确性方面获得了更高的分数。结果证明了空间理解从合成场景到真实世界场景的稳健迁移,且无需真实世界标注。

作者在各种模型和数据集上评估生成式空间智能,以评估指令合规性、空间准确性、外观一致性和编辑局部性。实验表明,虽然闭源模型在指令遵循方面表现出色,但在合成数据上微调开源模型可以显著增强其空间推理和局部编辑能力。最终,结果表明合成训练能够实现空间理解向真实世界场景的稳健迁移,在不需要真实世界标注的情况下提高物体保持度和几何准确性。