Command Palette

Search for a command to run...

图像生成器是通用视觉学习者

图像生成器是通用视觉学习者

摘要

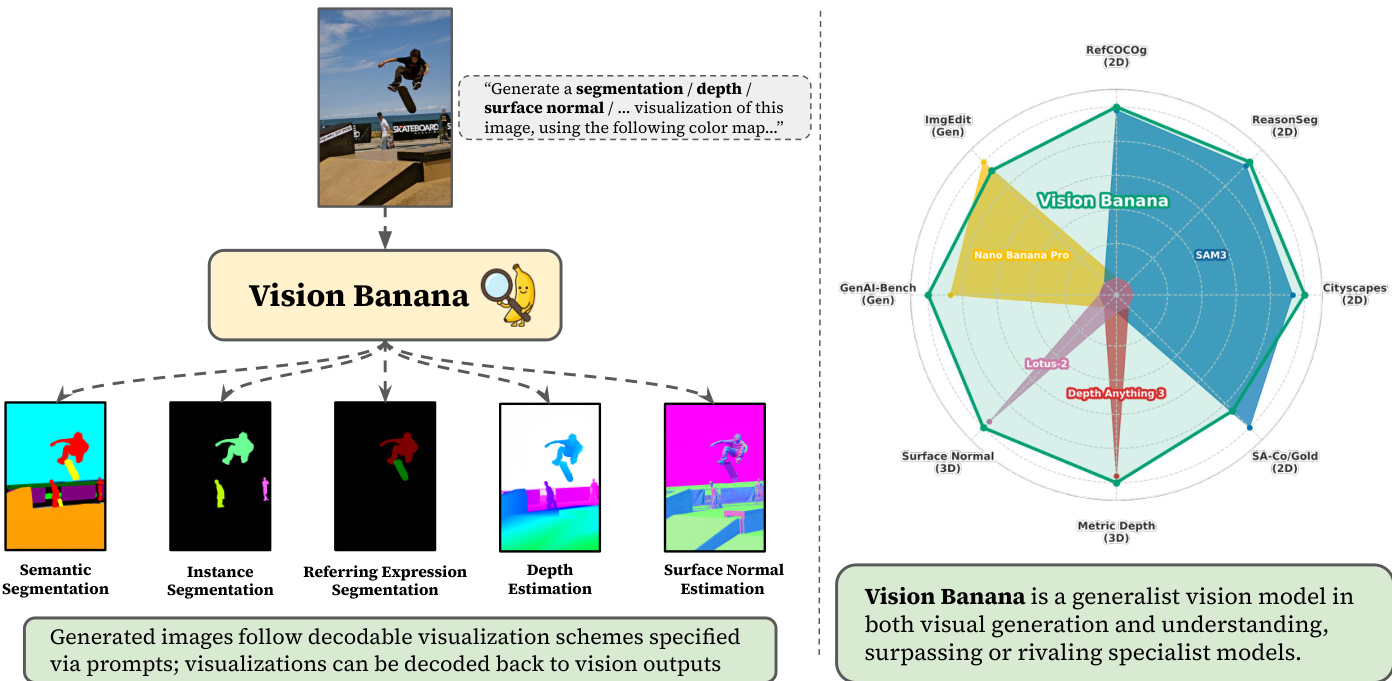

最近的研究表明,图像和视频生成器展现出了零样本(zero-shot)视觉理解行为,其方式类似于 Large Language Models (LLMs) 通过生成式预训练开发出语言理解与推理的涌现能力(emergent capabilities)。虽然长期以来人们一直推测,创造视觉内容的能力意味着具备理解该内容的能力,但目前仍缺乏充足证据表明生成式视觉模型已发展出强大的理解能力。在本文中,我们证明了图像生成训练发挥着类似于 LLM 预训练的作用,它使模型能够学习到强大且通用的视觉表示,从而在各种视觉任务中实现最先进(state-of-the-art)的性能。我们推出了 Vision Banana,这是一个通过对 Nano Banana Pro (NBP) 进行指令微调(instruction-tuning)而构建的通用模型,微调过程中使用了其原始训练数据的混合集以及少量的视觉任务数据。通过将视觉任务的输出空间参数化为 RGB 图像,我们实现了将感知任务无缝重构为图像生成任务。我们的通用模型 Vision Banana 在涉及 2D 和 3D 理解的多种视觉任务中均取得了最先进的结果,超越或媲美了多个零样本领域的专家模型,包括在分割任务上优于 Segment Anything Model 3,以及在度量深度估计(metric depth estimation)任务上媲美 Depth Anything 系列。我们展示了通过轻量级的 instruction-tuning 即可实现这些结果,且不会牺牲基础模型的图像生成能力。这些卓越的结果表明,图像生成预训练是一种通用的视觉学习方式。它还表明,图像生成可以作为视觉任务的一个统一且通用的接口,其作用类似于文本生成在语言理解与推理中的地位。我们可能正在见证计算机视觉领域的一次重大范式转移:生成式视觉预训练将在构建兼具生成与理解能力的视觉基础模型(Foundational Vision Models)中发挥核心作用。

一句话总结

本研究介绍了 Vision Banana,这是一个通过轻量级指令微调 Nano Banana Pro 构建的通用模型,它将视觉任务输出参数化为 RGB 图像,并将感知重构为图像生成,在 2D 和 3D 任务上实现了最先进的结果,媲美零样本领域专家,例如 Segment Anything Model 3 和 Depth Anything 系列,且不牺牲生成能力,证明了生成式预训练可作为基础视觉模型的统一接口。

核心贡献

- 本文介绍了 Vision Banana,这是一个通过在原始训练数据和视觉任务数据的混合集上对 Nano Banana Pro 进行指令微调构建的通用模型。这种方法将视觉任务的输出空间参数化为 RGB 图像,以无缝地将感知重构为图像生成。

- 实验表明 Vision Banana 在涉及 2D 和 3D 理解的各类视觉任务上实现了最先进的结果。该模型击败或媲美零样本领域专家,包括分割任务上的 Segment Anything Model 3 和度量深度估计上的 Depth Anything 系列。

- 该研究表明图像生成训练的作用类似于 LLM 预训练,使模型能够学习强大且通用的视觉表示。这些结果表明图像生成充当视觉任务的统一接口,同时通过轻量级指令微调保留基础模型的图像生成能力。

引言

近期的图像和视频生成器展现出令人联想到大语言模型的涌现视觉理解行为,但以往的生成式视觉模型在历史上落后于专门的判别式方法。先前将这些生成器适配特定任务的尝试往往未能实现最先进的结果,或者需要损害模型通用性的架构修改。为解决这一问题,作者引入了 Vision Banana,这是一个通过指令微调预训练图像生成器,将视觉任务输出参数化为 RGB 图像的通用模型。这种轻量级微调实现了最先进的性能,涵盖多样化的 2D 和 3D 理解任务,且不牺牲基础模型的图像生成能力,将生成式预训练定位为视觉智能的统一基础。

方法

作者通过对基础模型 Nano Banana Pro 进行指令微调构建了 Vision Banana,以严格调查并基准测试为视觉理解任务生成可视化结果的零样本能力。核心目标是使模型对齐,生成可解码回视觉任务输出的可视化结果,用于定量评估。例如,生成的深度热力图必须可逆回物理深度值。为此,作者将视觉任务数据以极低的比例混合到 Nano Banana Pro 的训练混合集中。这种轻量级指令微调策略将模型的涌现生成表示对齐到可测量的物理几何和语义标签,同时保留原始生成先验。

该框架涵盖两个基本类别的视觉理解:2D 场景理解和 3D 结构推断。2D 套件包括指代表达、语义和实例分割,测试将自然语言接地和分割对象的能力。对于 3D 理解,模型专注于单目度量深度和表面法线估计,这需要几何推理和关于物体尺度的内部知识。

如上图框架图所示,Vision Banana 接受图像和指定所需可视化结果(例如分割、深度、表面法线)的提示,并生成相应的输出。该模型在多个基准测试中与专家模型进行评估,包括 RefCOCog、ReasonSeg、Cityscapes 和 Metric Depth,证明其有能力媲美或超越特定任务专家。

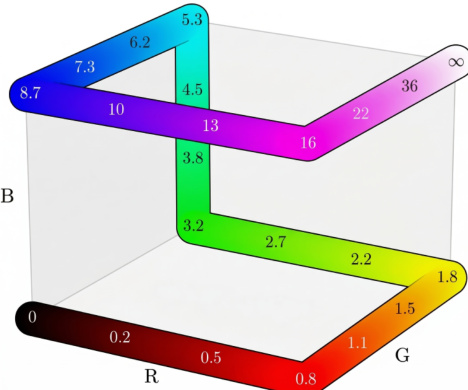

为确保定量评估,生成的图像遵循通过提示指定的可解码可视化方案。这些可视化结果旨在使用特定颜色图解码回视觉输出。

上图描绘了用于解码的示例颜色图,其中特定颜色对应从 0 到无穷大的数值,促进视觉输出逆转为物理测量值。指令微调的数据收集利用内部模型标注用于网络抓取的 2D 图像和渲染引擎生成的 3D 任务合成数据。至关重要的是,评估基准的训练数据未包含在指令微调混合集中,确保结果反映真正的通用能力。作者进一步验证了图像生成能力的保留,通过基准测试 Vision Banana 与基础 Nano Banana Pro 在文本到图像生成和图像编辑任务上,获得有竞争力的胜率,验证模型未遗忘其生成特性。

实验

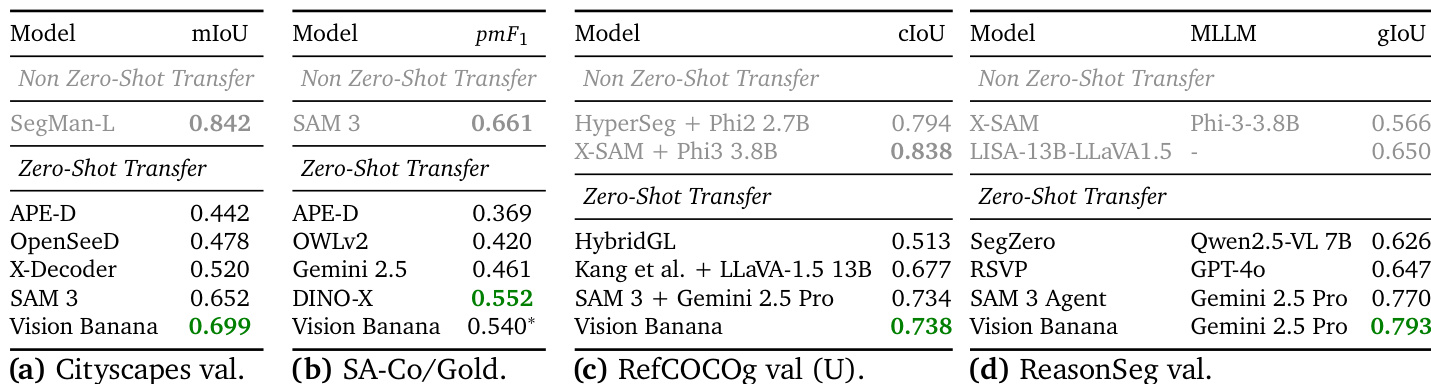

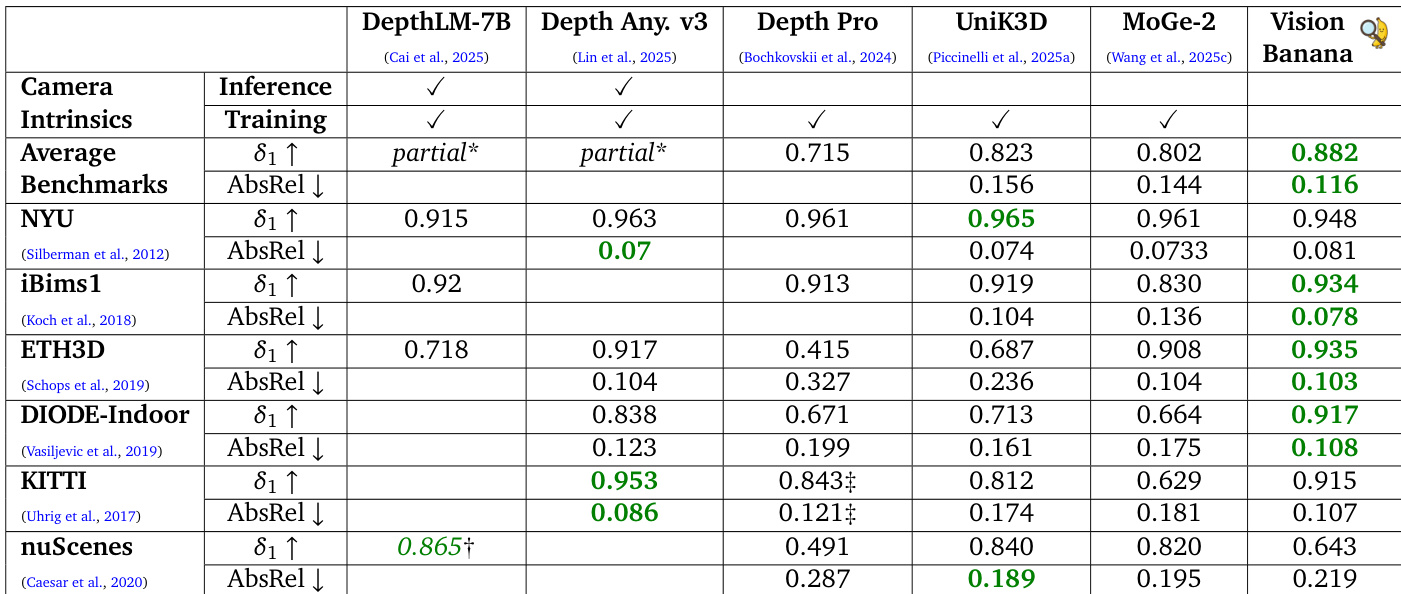

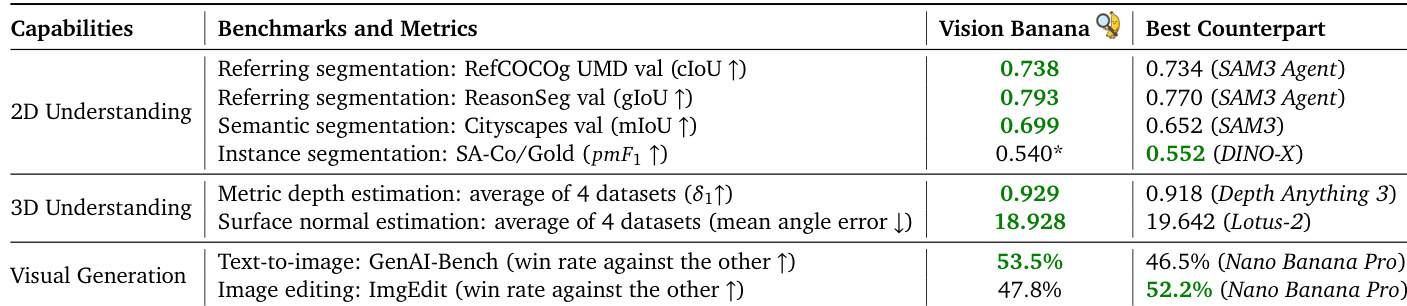

评估将 Vision Banana 与特定任务专家模型进行比较,涵盖 2D 语义理解和 3D 单目理解任务,在零样本迁移设置下,无需专门架构或自定义训练损失。结果表明该模型实现了最先进的性能,在语义和指代表达分割方面,通过利用生成式预训练推理自然语言查询。此外,该方法成功从单张图像推断度量深度和表面法线,无需相机内参,产生几何一致的重建和优越的视觉保真度,在多个基准测试上超越了现有的专家方法。

作者介绍了 Vision Banana,这是一个基于图像生成器构建的通用视觉模型,实现了最先进的零样本性能,涵盖广泛的视觉理解任务。该模型在推理和指代表达分割方面优于专门方法,并在语义和实例分割方面展示出有竞争力的结果。此外,它在 3D 理解任务中取得了优越性能,如度量深度和表面法线估计,且无需相机内参。Vision Banana 在推理和指代表达分割中取得了顶级零样本性能,超越了专门的 agents 和模型。该模型展示了稳健的度量深度估计,优于专用深度模型,且在训练或推理期间不依赖相机内参。在表面法线估计中,该模型在室内数据集上实现了最低误差率,并产生比领先专家方法更高的视觉保真度。

作者在单目度量深度估计上评估 Vision Banana,将其与通常依赖相机内参的专门模型进行比较。结果表明 Vision Banana 实现了优越的平均性能,并在多个特定数据集上领先,无需依赖相机内参,在训练或推理期间。这表明了源于合成训练数据的强大零样本泛化能力。Vision Banana 在基准测试中实现了最高平均准确率和最低误差率,与专门模型相比。该模型平均优于 Depth Anything V3 等竞争对手,跨多个数据集,尽管未使用相机内参。完全在合成数据上训练,该模型展示了对现实场景的稳健零样本泛化能力。

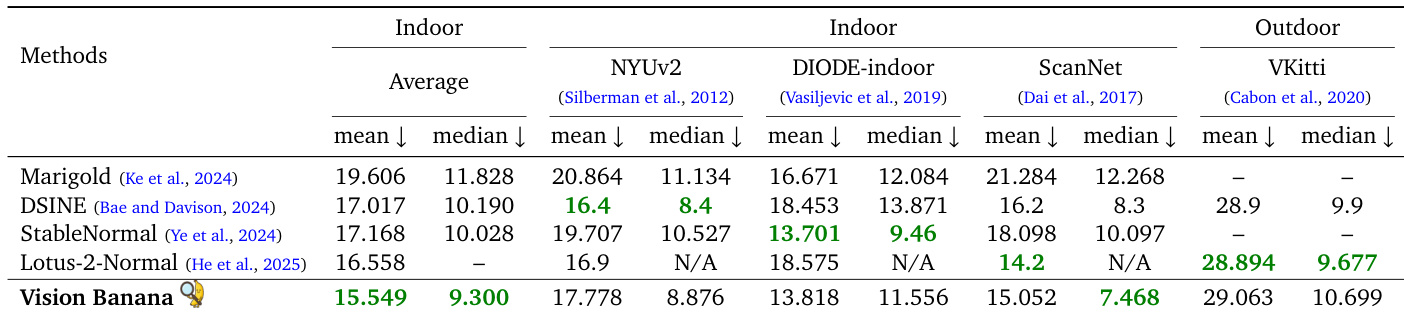

作者在多个基准测试上评估表面法线估计,证明其零样本模型在室内数据集上实现了优越的平均性能。虽然专门模型在特定户外或个别室内数据集上领先,Vision Banana 在 ScanNet 基准测试上优于它们,并在没有域内训练的情况下在户外场景保持有竞争力的结果。Vision Banana 在室内数据集平均上实现了最低的平均和中值误差。该模型在 ScanNet 基准测试上优于最先进的专家。户外 VKitti 数据集的结果具有竞争力,尽管模型未在此特定数据上训练。

作者证明 Vision Banana 实现了最先进的结果,在广泛的视觉理解任务上,无需专门架构。数据显示该模型优于领先的专家对应模型,在语义分割、度量深度估计和表面法线估计方面。虽然它在文本到图像生成方面表现出色,但在图像编辑和实例分割方面表现略低于特定竞争对手。Vision Banana 在语义分割和指代表达任务上超越了专家模型。该模型在 3D 理解任务中实现了优越的准确性,如深度和表面法线估计。视觉生成结果显示文本到图像生成的胜率更高,但在图像编辑方面性能较低。

Vision Banana 作为在合成数据上训练的通用视觉模型进行评估,以评估其在分割、推理和 3D 理解任务上的零样本性能,与专门方法相比。实验验证了该模型实现了优越的准确性,在度量深度和表面法线估计方面,无需依赖相机内参,同时在推理和指代表达分割方面超越了专家。尽管该模型在文本到图像生成和语义分割方面表现出色,但在图像编辑和实例分割方面表现略低于特定竞争对手。