Command Palette

Search for a command to run...

EasyVideoR1:面向视频理解的更简便强化学习方法

EasyVideoR1:面向视频理解的更简便强化学习方法

Chuanyu Qin Chenxu Yang Qingyi Si Naibin Gu Dingyu Yao Zheng Lin Peng Fu Nan Duan Jiaqi Wang

摘要

基于可验证奖励的强化学习(Reinforcement Learning from Verifiable Rewards, RLVR)在提升大语言模型的推理能力方面已展现出显著成效。随着模型逐渐演进为原生多模态架构,将 RLVR 扩展至视频理解领域变得愈发重要,但由于视频任务类型的多样性、重复解码与预处理高维视觉输入带来的计算开销,以及在众多敏感超参数下实现可复现评估的难度,这一领域目前在很大程度上仍处于未开发状态。现有的开源 RL 训练框架虽然为文本和图像场景提供了坚实的基础设施,但仍缺乏针对视频模态定制的系统性优化。在本研究中,我们提出了 EasyVideoR1,这是一个完整且高效的强化学习框架,专门设计用于在视频理解任务上训练大型视觉语言模型。EasyVideoR1 的主要贡献如下:(1) 完整的视频 RL 训练流水线:通过离线预处理和张量缓存(tensor caching)技术,消除了冗余的视频解码操作,使吞吐量提升了 1.47 倍;(2) 全面的任务感知奖励系统:涵盖了 11 种不同的视频和图像问题类型,并具备统一的路由机制和模块化扩展能力;(3) 离线-在线混合数据训练范式:将精选的高质量轨迹(trajectories)与同策略(on-policy)探索相结合,有助于模型学习更具挑战性的任务;(4) 图像-视频联合训练:通过独立配置的像素预算(pixel budgets),实现了两种模态之间的相互增强;(5) 异步多基准评估框架:涵盖了 22 个主流视频理解基准测试,其复现的准确率与官方报告的分数高度一致。

一句话总结

来自 Microsoft 及其他机构的研究人员提出了 EasyVideoR1,这是一个专门的强化学习框架,通过利用离线预处理和 tensor 缓存来消除冗余解码并降低计算开销,从而增强了大型视觉语言模型在视频理解方面的能力。

核心贡献

- 本研究引入了 EasyVideoR1,这是一个专门为视频理解任务中训练大型视觉语言模型而优化的高效强化学习框架。

- 该框架实现了一个专门的训练流水线,其特点是具有元数据一致的 tensor 缓存的离线预处理,以及针对混合模态训练的流水线级适配,旨在消除冗余解码和受 CPU 限制的 I/O 瓶颈。

- 论文提供了一个基于 vLLM AsyncLLMEngine 构建的高吞吐量评估框架,利用异步处理来消除 CPU-GPU 串行化,并在多基准测试期间保持高 GPU 利用率。

引言

随着大型语言模型演变为原生多模态架构,将来自可验证奖励的强化学习 (RLVR) 应用于视频理解,对于自动驾驶和具身智能等应用变得至关重要。然而,现有的 RL 框架主要针对文本或图像模态,难以应对视频的独特需求,例如冗余解码带来的高计算开销、复杂的多任务奖励设计以及缓慢的评估过程。研究人员利用这些挑战引入了 EasyVideoR1,这是一个专门为视频优化的完整且高效的强化学习框架。其贡献包括:具有离线预处理和 tensor 缓存的高吞吐量流水线、针对多样化视频任务的任务感知奖励系统、一种混合离线-在线训练范式,以及一个确保可复现准确性的异步多基准评估框架。

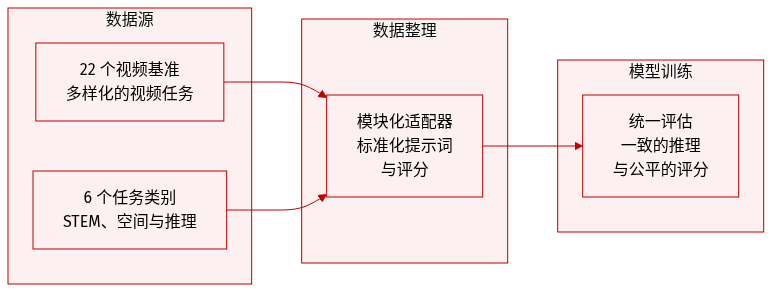

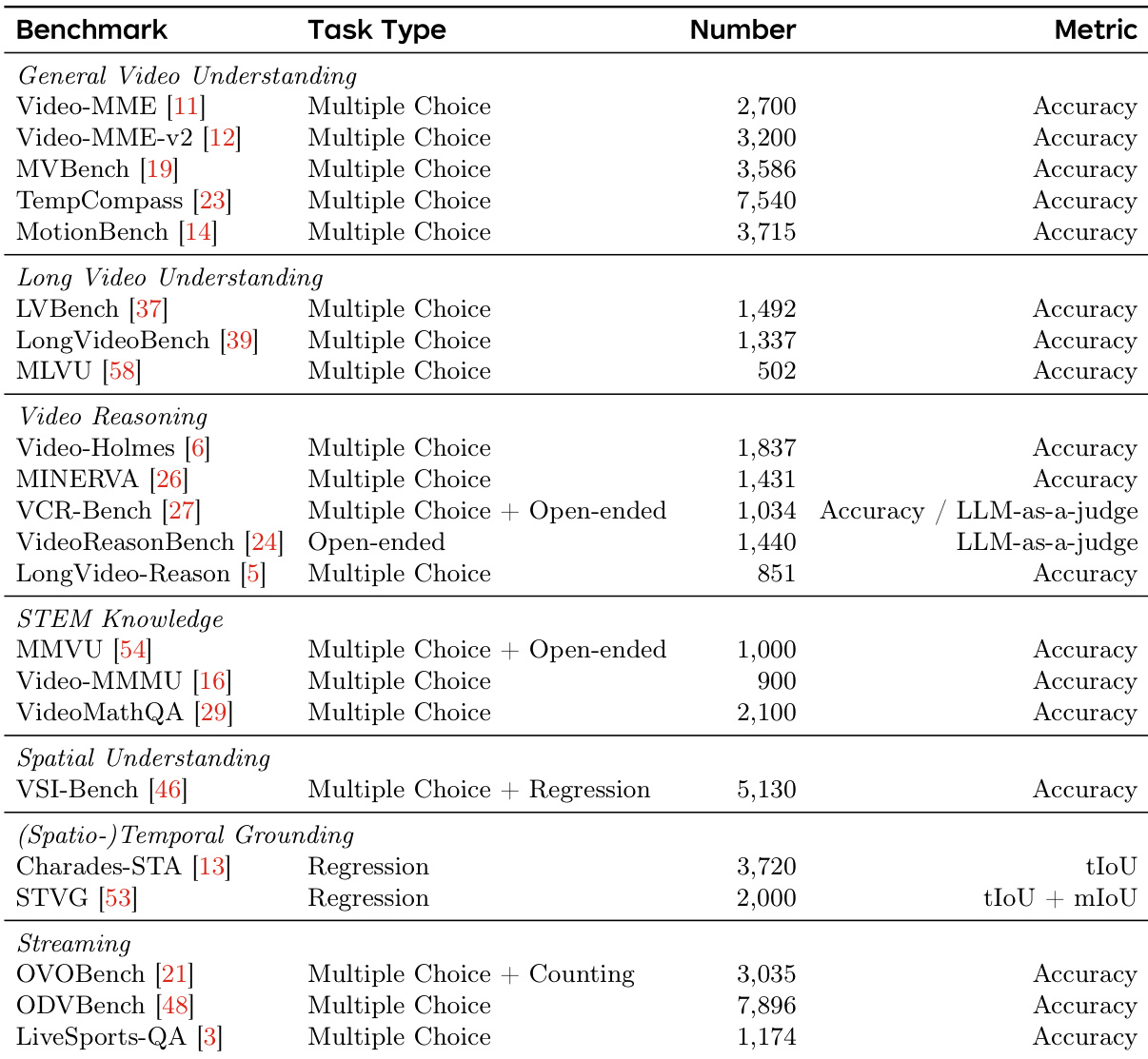

数据集

研究人员使用由 22 个视频理解基准测试组成的综合评估套件,从多个维度评估模型性能。数据集的组成和使用详情如下:

- 基准测试组成与类别: 基准测试分为六个不同的类别:通用视频理解、长视频理解、视频推理、STEM 知识、空间理解,以及(时空)定位与流媒体视频。

- 能力范围: 该集合涵盖了广泛的任务,从细粒度的运动感知和时间推理,到专家级知识问答和时空定位。

- 模块化框架集成: 每个基准测试通过轻量级配置进行集成,定义了特定的数据加载逻辑、prompt 格式化、答案提取和评分函数。

- 处理与可复现性: 研究人员采用了模块化适配器设计,允许在整个套件中使用一致的推理配置。这确保了框架生成的准确性与官方报告的分数密切匹配,从而促进了公平且可复现的比较。

方法

研究人员将 EasyVideoR1 设计为一个全面的视频理解强化学习框架,围绕三个核心维度构建:适配视频模态的 RL 流水线、为算法开发提供研究友好型接口,以及实现高吞吐量评估。整体架构将这些组件集成到一个统一的训练流水线中,如下方的框架图所示。

该框架始于离线预处理阶段,将计算昂贵的视频解码与训练循环解耦。视频被处理成包含时间采样和空间缩放帧的 .pt 缓存文件,每个缓存条目通过 (video_path, fps, max_frames, max_pixels) 进行键值化,以确保在参数更改时自动失效。这种预处理在多个工作进程中并行进行,并结合基于哈希的去重,最大限度地减少了冗余计算。在训练期间,数据集阶段仅引用轻量级的缓存文件路径,避免了节点间的大规模 tensor 传输。当不存在缓存时,系统会透明地回退到即时解码。为了防止重复处理,VideoMetadata(包括帧率、采样索引和空间维度)会随缓存帧一起在整个流水线中传播,确保各阶段行为一致。

训练流水线由三个连续阶段组成:数据集加载、使用 vLLM 进行 rollout 生成,以及使用 FSDP 进行 actor 训练。每个阶段都经过适配以处理混合图像-视频输入。对于混合模态的前向传播,框架会为非活动模态生成零值的 dummy tensor,并通过零权加法将它们连接起来,确保所有参数都参与每一次前向传播而不引入错误的梯度。分辨率预算被解耦为独立的参数——image_max_pixels、video_max_pixels 和 video_max_frames——允许对每种模态的计算资源进行独立调整。这使得在多样化数据类型上进行高效训练成为可能,同时保持了计算平衡。

任务感知奖励系统通过一个统一的分发器为各种视频理解任务提供模块化支持,该分发器根据 problem_type 将每个样本路由到相应的奖励模块。每个任务都实现为一个独立的模块,允许增量扩展。Prompt 格式化通过 Jinja2 模板进行管理,这些模板根据每个任务进行动态渲染,从而实现灵活且一致的评估。

为了解决 on-policy 训练中的冷启动问题,EasyVideoR1 实现了一种混合在线-离线训练范式。每个训练样本可能包含一个预先收集的离线轨迹,在 rollout 过程中,该轨迹会替换一组 n 个响应中的最终响应。这使得框架能够在保持标准 GRPO 更新的同时,整合来自更强模型或先前 checkpoint 的高质量轨迹。该机制由单个标志位控制,并完全在 rollout 层运行,从而保持了算法的完整性。

图像-视频联合训练利用丰富的图像数据来强化基础视觉推理,同时学习视频特有的时间理解。每个样本包含一个 data_type 字段,用于将其路由到相应的预处理器,解耦的分辨率预算确保了独立调整。跨图像和视频样本的统一多模态字段架构消除了模态条件分支,简化了混合 batch 的组装。框架通过在 token 数量不匹配时抛出异常,强制执行文本占位符与视觉特征之间的严格语义一致性,防止静默的数据损坏。

评估框架引入了两项关键优化以实现高吞吐量。预计算帧缓存通过将视频帧存储为缓存文件来消除冗余的 CPU 密集型预处理,将单视频延迟从数十秒降低到毫秒级。这种缓存机制在工作进程中并行执行,以实现高效的初始构建。异步推理设计用三阶段流水线(IO、Prefill 和 Decode)取代了同步的 vLLM 接口:IO 阶段持续加载缓存帧并提交输入而不产生阻塞;Prefill 阶段立即处理传入的序列并构建 key-value caches;Decode 阶段以交错方式生成 tokens,并与预取操作重叠。分块预取 (Chunked prefetch) 将长输入划分为固定大小的块,确保无论序列长度如何,GPU 占用率都能保持一致。这些优化共同作用,维持了持续的 GPU 利用率,实现了比原生推理框架约 6–7 倍的加速。

实验

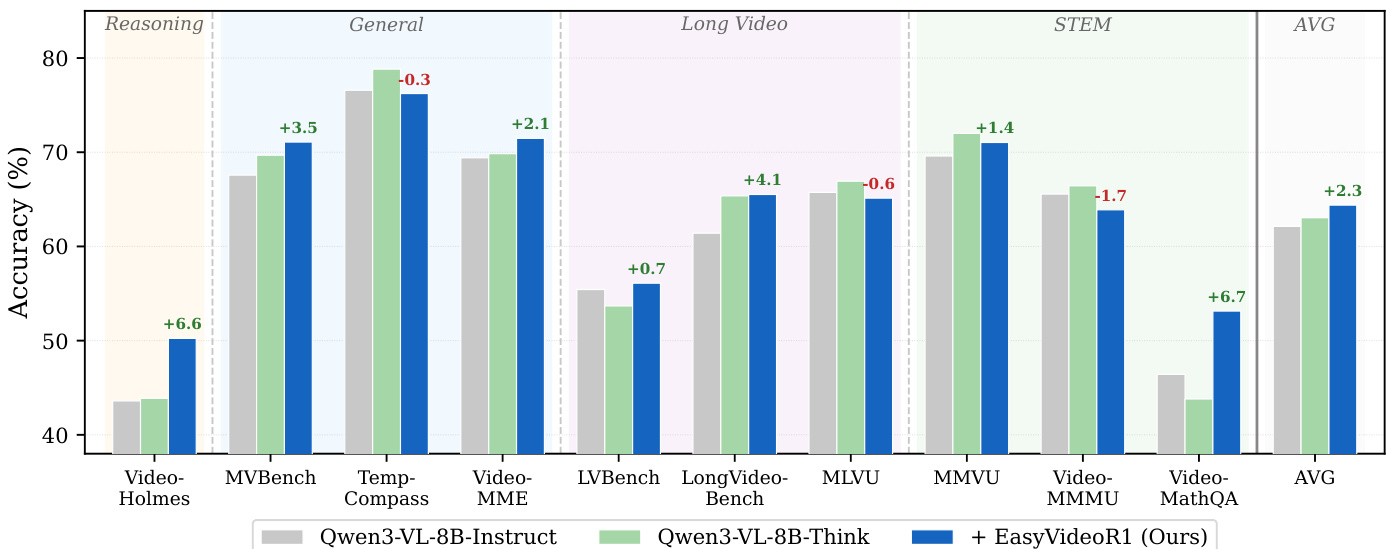

实验评估了 EasyVideoR1 在 Qwen3-VL-8B-Instruct 模型上的训练效果,以及离线预处理和缓存机制带来的效率提升。结果表明,强化学习显著增强了模型的审慎推理和数学能力,使其能够在不增加额外推理开销的情况下,达到与专门的 thinking 变体相当的性能。此外,基于缓存的加载实现显著提高了训练吞吐量,因为它在 rollout 和参考模型阶段消除了冗余的视频解码。

研究人员通过实验评估了使用 EasyVideoR1 进行 RL 训练对基础视频语言模型的影响,将其性能与 thinking 变体进行比较,并分析了离线预处理带来的效率提升。结果显示,RL 训练提高了平均准确率,在推理和数学任务上取得了显著增益,同时在不增加额外推理开销的情况下,实现了与 thinking 变体相当的性能。离线缓存机制通过消除冗余的视频解码,大幅减少了训练步长时间并增加了 token 吞吐量。EasyVideoR1 的 RL 训练提高了平均准确率,并在推理和数学任务上取得进展,匹配或超越了 thinking 变体的性能。离线缓存通过在推理过程中消除冗余视频解码,减少了训练步长时间并增加了 token 吞吐量。训练框架在保持一致训练语义的同时,通过优化的数据加载实现了更快的端到端流水线执行。

研究人员在多个基准测试中比较了三种模型变体,结果显示使用 EasyVideoR1 进行训练提高了平均准确率,并在各种任务类别中取得了进展,特别是在推理和数学任务中。经过 RL 训练的模型表现与 thinking 变体相当或更好,且不需要额外的推理开销。结果证明,离线预处理和缓存通过减少视频解码时间和消除冗余计算,显著提高了训练效率。EasyVideoR1 训练提高了所有基准测试类别的准确率,其中在推理和数学任务中观察到的增益最大。经过 RL 训练的模型在大多数基准测试中实现了与 thinking 变体相当或更优的结果,同时运行在标准推理模式下。离线预处理和缓存通过在训练期间消除冗余视频解码,缩短了步长时间并增加了 token 吞吐量。

研究人员通过将基础视频语言模型与 thinking 变体进行比较,并测试离线预处理机制的效率,评估了使用 EasyVideoR1 进行 RL 训练的影响。结果表明,RL 训练增强了整体准确率,特别是在推理和数学任务中,同时在不增加推理开销的情况下匹配了 thinking 变体的性能。此外,离线缓存的实现通过消除冗余视频解码并增加 token 吞吐量,显著提高了训练效率。