Command Palette

Search for a command to run...

HY-World 2.0:一种用于重建、生成与模拟 3D 世界的多模态 World Model

HY-World 2.0:一种用于重建、生成与模拟 3D 世界的多模态 World Model

摘要

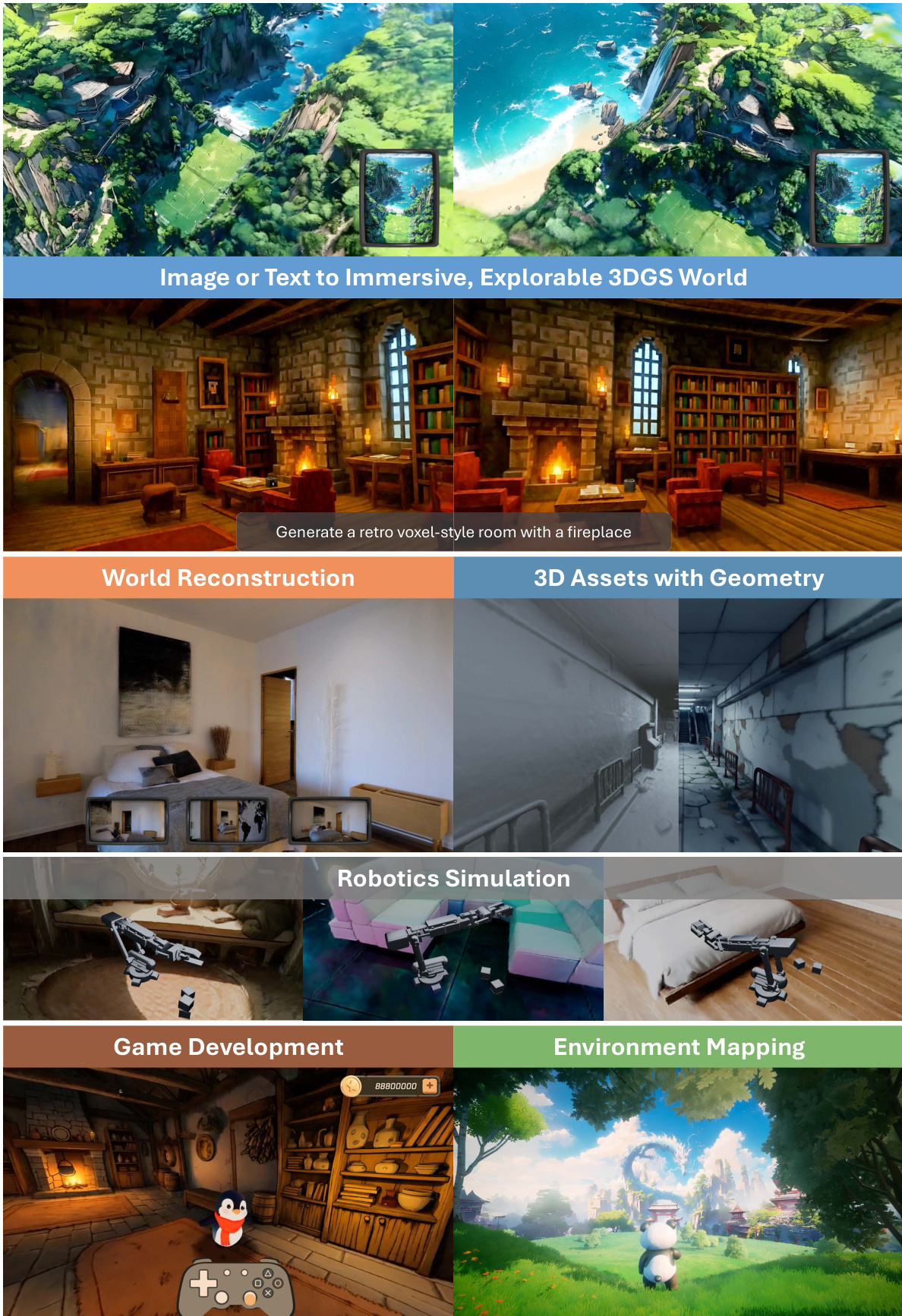

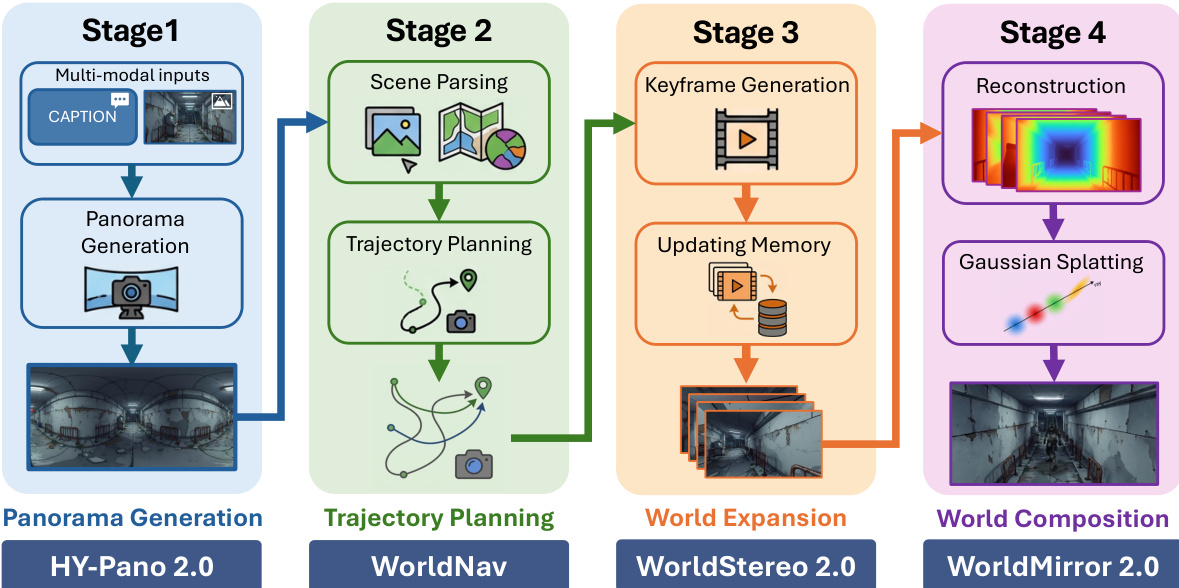

我们推出了 HY-World 2.0,这是一个多模态世界模型(world model)框架,旨在对其前作 HY-World 1.0 进行升级。HY-World 2.0 能够兼容多种输入模态,包括 text prompt、单视图图像、多视图图像以及视频,并能生成 3D 世界表示。通过输入文本或单视图图像,该模型可以执行世界生成任务,合成高保真且可导航的 3D Gaussian Splatting (3DGS) 场景。这一过程通过四个阶段的方法实现:a) 利用 HY-Pano 2.0 进行全景图生成(Panorama Generation);b) 利用 WorldNav 进行轨迹规划(Trajectory Planning);c) 利用 WorldStereo 2.0 进行世界扩展(World Expansion);d) 利用 WorldMirror 2.0 进行世界合成(World Composition)。具体而言,我们引入了多项关键创新,以增强全景图的保真度,实现 3D 场景理解与规划,并升级了 WorldStereo——这是一个具有一致性记忆(consistent memory)的基于关键帧的视图生成模型。同时,我们通过优化模型架构和学习策略,升级了 WorldMirror(一种用于通用 3D 预测的前馈模型),使其能够通过多视图图像或视频实现世界重建。此外,我们还推出了 WorldLens,这是一个高性能的 3DGS 渲染平台,具有灵活的引擎无关(engine-agnostic)架构、自动 IBL 光照、高效的碰撞检测以及训练-渲染协同设计(training-rendering co-design),能够支持带有角色交互的 3D 世界探索。广泛的实验表明,HY-World 2.0 在多个 benchmark 上均达到了开源方法中的 state-of-the-art 水平,其表现可与闭源模型 Marble 相媲美。为了促进研究的可复现性并支持对 3D 世界模型的进一步研究,我们发布了所有的模型权重、代码及技术细节。

一句话总结

腾讯混元推出了 HY-World 2.0,这是一个多模态世界模型框架。它通过包含 HY-Pano 2.0、WorldNav、WorldStereo 2.0 和 WorldMirror 2.0 的四阶段方法,能够从文本、单视图图像、多视图图像或视频中重建并生成可导航的 3D Gaussian Splatting 场景,同时利用 WorldLens 渲染平台进行交互式 3D 模拟。

核心贡献

- 本文介绍了 HY-World 2.0,这是一个多模态框架,通过全景生成、轨迹规划、世界扩展和世界组合的四阶段流水线,将文本、单视图图像和视频等多样化输入转化为可导航的 3D Gaussian Splatting 场景。

- 该框架整合了多个专业组件,包括用于高保真全景合成的 HY-Pano 2.0、用于语义感知轨迹规划的 WorldNav、用于记忆驱动视图生成的 WorldStereo 2.0,以及用于通用 3D 重建的 WorldMirror 2.0。

- 研究人员开发了 WorldLens,这是一个高性能的 3DGS 渲染平台,具有引擎无关的架构和自动光照功能,能够实现支持角色交互的 3D 世界探索。

引言

3D 世界模型对于推进机器人、虚拟现实和游戏开发中的空间智能至关重要,因为它们使 Agent 能够模拟并与复杂环境进行交互。然而,目前的研究通常分为两类:一类是生成式模型,它们可以从稀疏输入创建沉浸式场景,但缺乏几何准确性;另一类是重建方法,它们可以从密集数据中恢复精确结构,但无法幻化出未见区域。作者利用名为 HY-World 2.0 的统一多模态框架来弥补这一差距,提供了一个既能从文本或单张图像进行高保真世界生成,又能从多视图视频进行精确世界重建的单一系统。其贡献包括一个创新的四阶段流水线,由全景生成、轨迹规划、记忆驱动的世界扩展和世界组合组成,用以产生可导航的 3D Gaussian Splatting 场景。

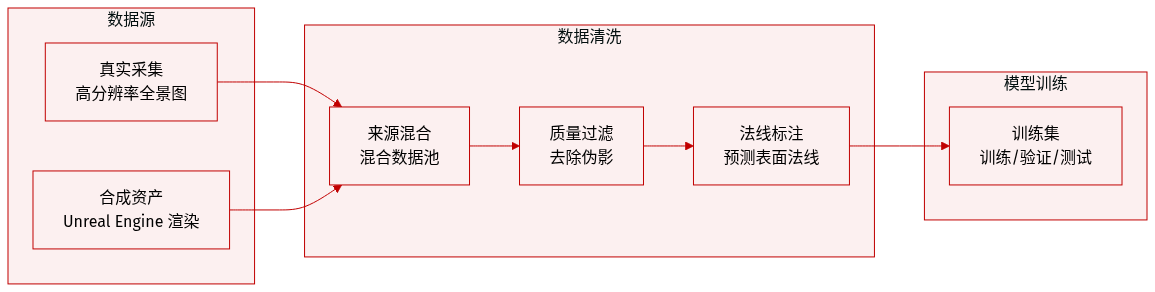

数据集

作者通过扩展原始的 HY-World 1.0 框架,为 HY-World 2.0 构建了一个大规模混合数据集。数据集的构成和处理细节如下:

- 数据集构成与来源:数据集整合了两个主要来源,以增强语义多样性并弥合真实环境与合成环境之间的领域差距。

- 真实世界采集:大规模的高分辨率全景图集合,用于提供真实的照明、复杂的纹理和自然的结构先验。

- 合成资产:通过 Unreal Engine (UE) 等高端引擎渲染的大规模环境,用于提供多样化的场景配置和像素级准确的地面真值(ground-truth)几何结构。

- 数据过滤与质量控制:作者实施了严格的过滤阶段以移除低质量样本,特别针对具有明显拼接伪影或暴露了采集设备(如全景相机)的图像。

- 伪标签增强策略:为了改进真实世界数据,作者采用了仅法线(normal-only)的伪标签方法,而不是单目深度估计。由于独立的深度预测往往会导致多视图几何不一致,作者使用单目法线估计教师模型来预测密集的表面法线。

- 训练与监督:这些预测的法线以两种方式作为伪监督目标。它们直接通过角度损失(angular loss)用于法线头(normal head),并通过专门的深度转法线损失(depth-to-normal loss)间接用于深度头(depth head)。

方法

HY-World 2.0 框架作为一个四阶段流水线运行,将多模态输入整合到沉浸式、可导航的 3D 世界中。该过程始于全景生成(Panorama Generation),其中任意文本或图像输入被转化为高保真的 360° 世界初始化。这一阶段利用多模态扩散 Transformer (MMDiT) 实现从透视图输入到等距柱状投影 (ERP) 空间的隐式自适应映射。MMDiT 在统一的潜在空间内同时处理条件输入和目标全景输出,并拼接它们各自的潜在序列。这种自注意力机制使网络能够自主学习潜在的透视图到 ERP 的转换,而无需显式的相机先验,从而使其能够幻化缺失的细节并保持全局结构的一致性。为了解决 ERP 左右边缘的不连续问题,采用了组合优化策略。在潜在空间层面,循环填充(circular padding)在去噪过程中强制执行周期性边界条件;而在像素空间层面,线性混合策略平滑了 360^\\circ 的环绕过渡,确保了完美无缝且结构连贯的全景输出。

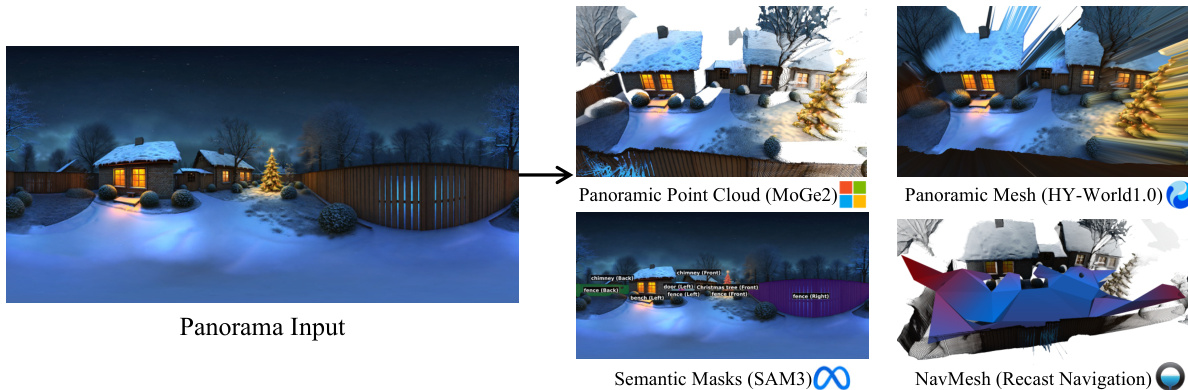

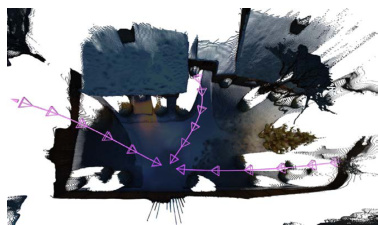

在高保真全景生成之后,系统进入轨迹规划(Trajectory Planning)阶段。这一阶段由 WorldNav 策略实现,旨在推导出能够最大化可导航空间覆盖率的探索轨迹。该过程始于对全景图进行全面的几何和语义场景解析。这包括通过使用优化的 LSMR 解算器对细分透视图的单目深度图进行对齐,从而构建全局全景点云 mathbfPpan。应用了一种结合了视觉语言接地(vision-language grounding)和深度不连续性移除的混合过滤策略,以增强几何质量。同时,语义解析会识别关键地标和障碍物,并定位它们的 3D 中心以创建 3D 掩码。此外,还使用 Recast Navigation 构建导航网格 (NavMesh) 来定义可通行区域。该 NavMesh 通过几何修正(如将顶点吸附到地面和侵蚀边界)进行优化,以确保物理上合理的相机移动。基于解析后的场景,WorldNav 设计了五种启发式轨迹模式:常规 (Regular)、环绕 (Surrounding)、重建感知 (Reconstruct-Aware)、漫游 (Wandering) 和航空 (Aerial)。常规轨迹提供从原点出发的通用轨道扩展。环绕轨迹以自适应半径环绕重要物体,以确保前景质量。重建感知轨迹旨在针对由退化网格面识别出的观测不足区域,以缓解后续 3D 重建中的空隙。漫游轨迹模拟自主 Agent 的探索以到达环境边界,而航空轨迹是一种辅助模式,通过对其他轨迹应用向上俯仰来消除盲点。

第三阶段是世界扩展(World Expansion),由 WorldStereo 2.0 处理,它为世界扩展合成大量的全新视图。该阶段分为三个渐进的训练阶段,以实现相机控制、基于记忆的一致性和快速推理。WorldStereo 2.0 的核心是其关键帧潜在空间,它重新思考了标准 Video-VAE 的局限性。它没有采用时空压缩,而是使用 Keyframe-VAE 对每个关键帧独立进行仅空间维度的压缩。这种方法保留了高频细节,并减少了在标准 VAE 中常见的运动模糊和几何畸变引起的伪影。通过将轻量级的基于 Transformer 的相机适配器与预训练的视频 DiT 集成,实现了显式的相机控制。该适配器同时使用相机 Plücker 射线和点云作为互补引导。来自参考视图的点云 mathbfPref 被变形到每个目标视图中得到 mathbfPitar,然后进行渲染并编码为潜在特征以引导生成。

![Keyframe-VAE in WorldStereo 2.0 versus a standard Video-VAE [64]. Unlike (a) Video-VAE, which performs spatio-temporal compression, (b) Keyframe-VAE applies spatial-only compression to better preserve high-frequency details and reduce artifacts essentially caused by Video-VAE encoding (e.g., motion blur and geometric distortion).](https://api-rsrc.hyper.ai/paper2blog/991ed478-56a8-4c73-ae44-be1bc7697765/2604.14268/cache/tex_resource/monkeyocr/images/0205ffa4833062126c52ee183f527f4db88fec7397bd0289dd6a19e1a22f3c9c.jpg)

为了确保不同轨迹间的帧一致性,WorldStereo 2.0 引入了两个互补的记忆模块。全局几何记忆 (GGM) 维持全局一致的粗糙场景结构。它使用由扩展的全局点云 mathbfPglo 渲染的视频进行微调,这些点云不仅包括参考点,还包括从新视图中采样的额外点,从而迫使模型更严格地遵循 3D 表示。空间立体记忆 (SSM++) 强化了局部对应关系和细粒度细节。其先进之处在于直接将检索到的关键帧集成到主 DiT 分支中,修改旋转位置编码 (RoPE) 以适应这种集成,并采用选择性检索策略以减少计算开销。在训练中期,模型使用全自注意力进行训练,使其能够学习全局上下文。在推理时,来自输入全景图的透视图作为初始记忆库,并随着生成的关键帧逐步更新。

最后一个阶段是世界组合(World Composition),它将生成的数据整合到一个统一的 3D 表示中。该过程始于使用升级后的 WorldMirror 2.0 模型重建全局对齐的点云和深度图。WorldMirror 2.0 是一个统一的前馈模型,它以多视图图像和可选的几何先验作为输入,并在单次前馈传递中预测各种 3D 属性。相比其前身,它引入了几项关键改进:用于灵活分辨率推理的归一化位置编码、通过深度转法线损失实现的显式基于法线的深度监督,以及用于稳健处理无效像素的专用深度掩码预测头。随后,将 WorldMirror 2.0 估计的深度图与初始全景点云 mathbfPpan 对齐,以解决尺度歧义问题。这种对齐通过基于 RANSAC 的线性变换实现,并使用基于对齐系数全局分布的离群点检测和修正策略进行优化。

最后,扩展后的点云被用于初始化 3D Gaussian Splatting (3DGS) 模型。优化过程采用双重策略来解决渲染效率与细节保留之间的权衡。它仅对点云的非天空部分应用标准的生长策略以加密纹理丰富的区域,同时集成 MaskGaussian 机制,在天空等过度密集的区域动态修剪冗余的 Gaussians。这种由平方损失正则化的概率掩码允许隐式稀疏性,并有效抑制了漂浮伪影。训练目标结合了光度损失和几何损失,其中深度监督稀疏地应用于对齐后的深度图,而密集的法线监督则应用于所有帧。优化后的 3DGS 模型可以进一步处理以提取网格,用于需要碰撞检测或物理模拟的应用。

实验

评估通过对全景生成、轨迹规划、场景重建和 3DGS 组合进行组件级分析,以及对 WorldMirror 2.0 重建基础的独立评估,来衡量 HY-World 2.0 流水线的性能。结果表明,该系统能够生成高度连贯、美观且几何一致的 3D 世界,严格遵循文本或图像输入,同时优于商业模型和最先进的模型。此外,该框架通过优化的推理技术展示了强大的多分辨率泛化能力和高效的扩展性,能够创建高保真、交互式的 3D 环境。

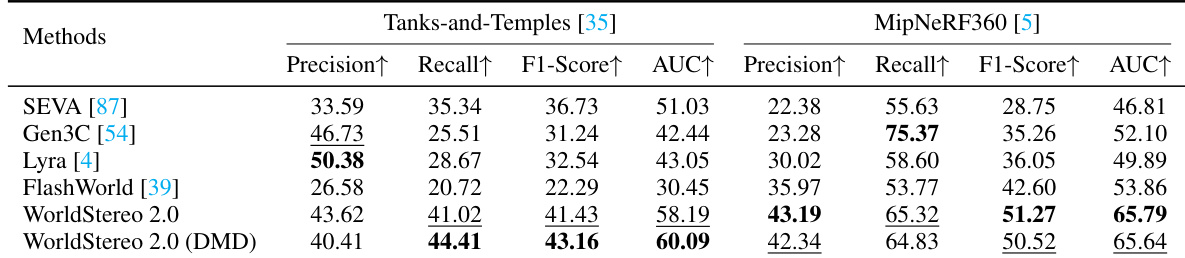

该表展示了单视图 3D 重建方法在 Tanks-and-Temples 和 MipNeRF360 两个基准测试上的比较。结果显示,所提出的 WorldStereo 2.0 方法在两个数据集的大多数指标上均实现了最高性能,特别是在精度和 F1 分数方面有显著提升。与现有方法相比,该方法还展示了卓越的几何一致性和物理合理的 3D 结构。WorldStereo 2.0 在大多数单视图 3D 重建指标上获得了最佳分数,在精度和 F1 分数方面较之前的方法有显著改进,结果证实了其合成高度一致且合理的 3D 结构的能力。

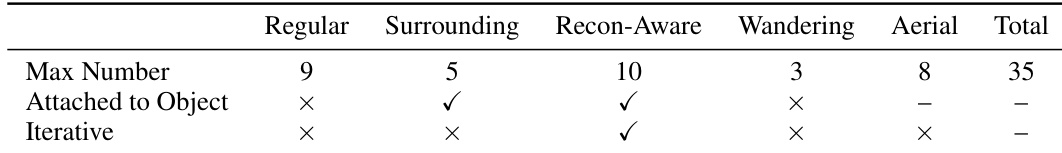

该表是对轨迹规划组件的消融研究,显示了每种轨迹类型生成的最大视图数量,以及它们是否附着于物体或是否为迭代式。常规和环绕轨迹生成的视图数量最多,其中环绕视图是附着于物体且为迭代式的。航空和漫游轨迹生成的视图较少,且均未附着于物体或采用迭代式。常规和环绕轨迹生成了最多的视图,其中环绕视图附着于物体。航空和漫游轨迹生成的视图较少,且未附着于物体或采用迭代式。环绕和重建感知轨迹是迭代式的,而常规和漫游轨迹不是。

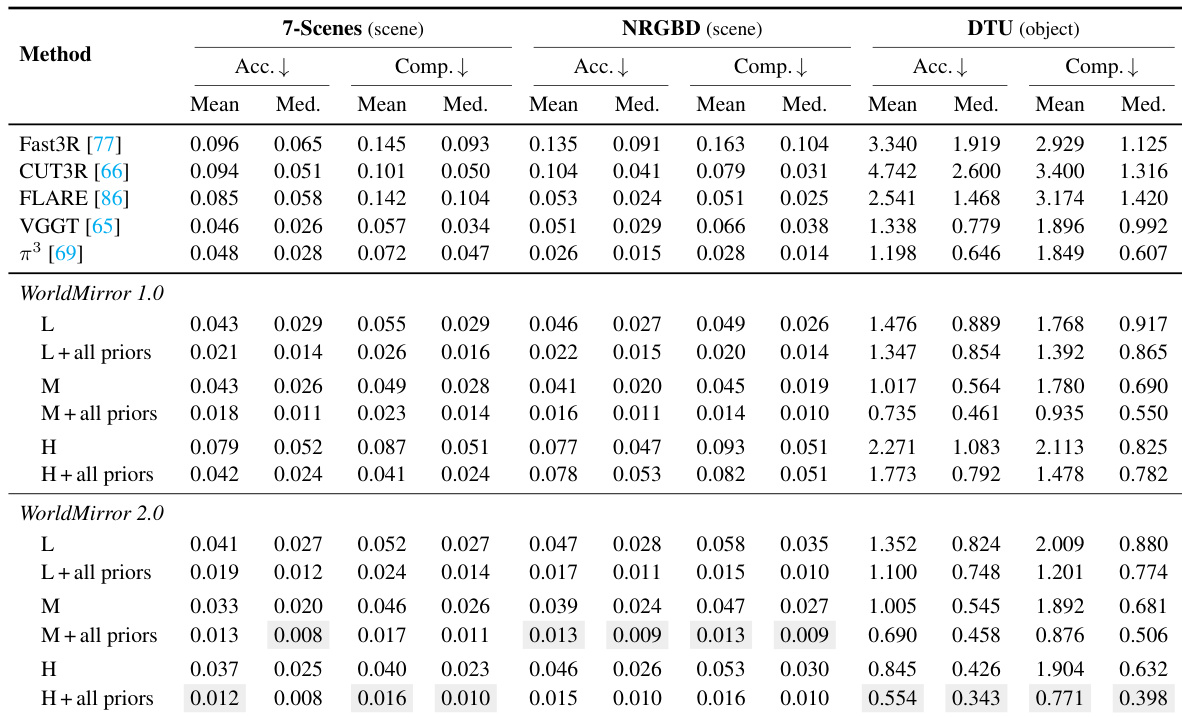

该表比较了 WorldMirror 1.0 和 WorldMirror 2.0 在不同数据集和分辨率下的性能。结果表明,WorldMirror 2.0 一致优于 WorldMirror 1.0,尤其是在更高分辨率下,并受益于几何先验的集成。改进在 7-Scenes 数据集中最为显著。WorldMirror 2.0 在所有数据集和分辨率上均取得了比 WorldMirror 1.0 更好的性能。几何先验的集成显著提升了两个版本的表现,其中 WorldMirror 2.0 的提升最大。WorldMirror 2.0 在高分辨率下保持了稳定的性能,而 WorldMirror 1.0 则出现了显著下降。

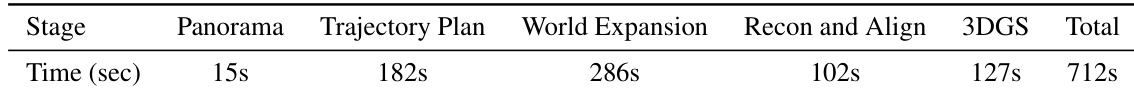

该表对 HY-World 2.0 流水线进行了详细的运行时间分析,显示了每个主要阶段所花费的时间。结果表明,世界扩展是最耗时的组件,其次是轨迹规划,而全景生成是最快的步骤。总结了完整流水线的总运行时间,提供了对系统计算效率的见解。世界扩展是流水线中最耗时的阶段。轨迹规划比全景生成耗时显著增加。整个世界生成过程的总运行时间为 712 秒。

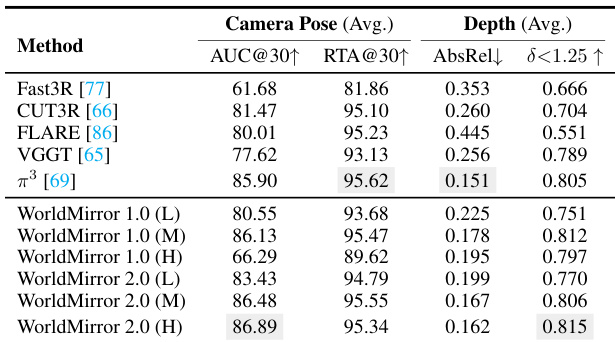

该表比较了不同方法和分辨率下的相机位姿估计性能。WorldMirror 2.0 在高分辨率下实现了最高的 AUC@30 分数,展示了比之前版本和其他方法更高的准确性。它还在不同分辨率下表现出 RTA@30 和深度指标的持续改进。WorldMirror 2.0 在高分辨率下实现了最高的 AUC@30 分数,与 WorldMirror 1.0 相比,在所有指标上均保持了卓越的性能,并在不同分辨率下显示出 RTA@30 和深度指标的持续提升。

评估通过 3D 重建、轨迹规划、点图重建、相机位姿估计和流水线运行时间的基准测试,将 WorldStereo 2.0 和 WorldMirror 2.0 与现有方法及之前版本进行了对比。结果表明,WorldStereo 2.0 能够产生更具几何一致性和物理合理性的 3D 结构,而 WorldMirror 2.0 则显著受益于几何先验,从而在高分辨率下保持稳定的性能。此外,消融研究确定了用于视图生成最有效的轨迹类型,而运行时间分析强调了世界扩展是流水线中的主要计算瓶颈。