Command Palette

Search for a command to run...

SpatialEvo:通过确定性几何环境实现自我演化的空间智能

SpatialEvo:通过确定性几何环境实现自我演化的空间智能

摘要

对三维场景的空间推理(Spatial reasoning)是具身智能(Embodied Intelligence)的核心能力,然而,由于几何标注成本高昂,模型的持续改进一直面临瓶颈。虽然自我演进(Self-evolving)范式提供了一条极具前景的路径,但该范式依赖模型共识(Model consensus)来构建伪标签(Pseudo-labels),这导致训练过程往往会强化而非纠正模型自身的几何错误。我们发现了一种三维空间推理所特有的属性,可以规避这一局限性:即真值(Ground truth)是底层几何结构的确定性结果,无需任何模型参与,仅通过点云(Point clouds)和相机位姿(Camera poses)即可进行精确计算。基于这一见解,我们提出了 SpatialEvo,这是一个以确定性几何环境(Deterministic Geometric Environment, DGE)为核心的三维空间推理自我演进框架。DGE 在显式的几何验证规则下,将 16 类空间推理任务进行了形式化定义,并将未经标注的三维场景转化为“零噪声”的交互式智能体(Oracles),从而用客观的物理反馈取代了模型共识。在 DGE 约束下,一个采用共享参数的策略(Policy)在“提问者(Questioner)”与“求解者(Solver)”角色之间进行协同演进:提问者根据场景观测生成符合物理规律的空间问题,而求解者则针对经 DGE 验证的真值推导精确答案。此外,一个任务自适应调度器(Task-adaptive scheduler)能够内生性地将训练重点集中在模型表现最薄弱的任务类别上,从而在无需人工设计的情况下生成动态课程(Curriculum)。在九个 benchmark 上的实验表明,SpatialEvo 在 3B 和 7B 参数规模下均取得了最高的平均分,在空间推理 benchmark 上实现了持续增长,且在通用视觉理解能力上没有出现退化。

一句话总结

作者提出了 SpatialEvo,这是一个用于 3D 空间推理的自我演进框架。它利用确定性几何环境(Deterministic Geometric Environment)来取代易出错的模型共识,转而使用客观的物理反馈,从而使一个共享参数的 policy 能够在无标注 3D 场景中,通过零噪声的交互式 oracle 在提问者(questioner)和求解者(solver)角色之间协同演进。

核心贡献

- 本文引入了 SpatialEvo,这是一个用于 3D 空间推理的自我演进框架,它用确定性的物理反馈取代了易出错的模型共识。

- 这项工作开发了确定性几何环境(DGE),该环境将 16 类空间推理任务类别形式化,并利用点云和相机位姿将无标注场景转换为零噪声的交互式 oracle。

- 该方法采用单一的共享参数 policy,在作为提问者和求解者的过程中进行协同演进,这一过程在多个空间推理基准测试中展示了显著的性能提升。

引言

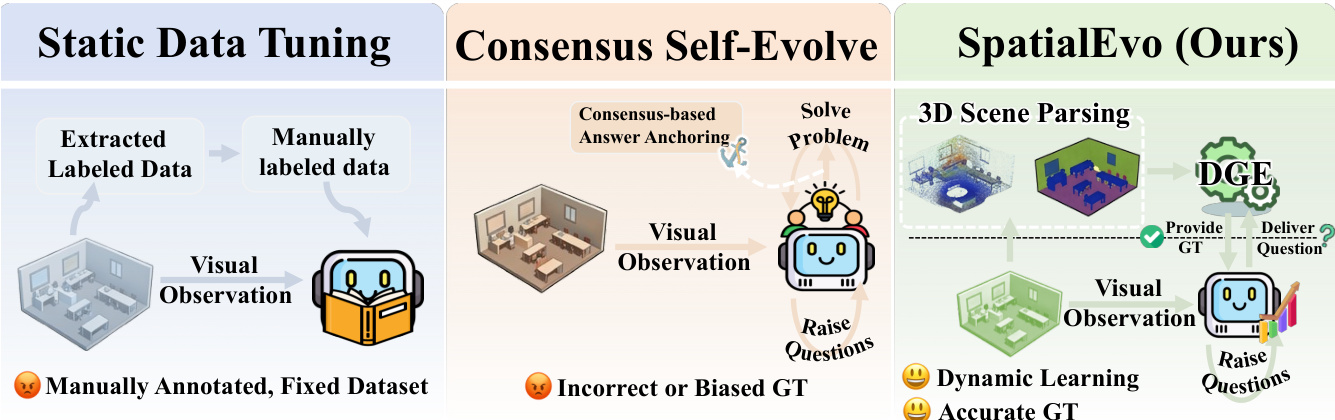

有效的 3D 空间推理对于具身智能至关重要,但由于几何标注成本高昂以及静态数据集的局限性,研究进展往往受到阻碍。现有的自我演进方法通常依赖模型共识来生成伪标签,这可能会强化模型自身的几何错误而非纠正它们。作者利用 3D 几何的确定性特征来克服这一问题,引入了 SpatialEvo。该框架利用确定性几何环境(DGE)从点云和相机位姿中计算精确的 ground truth,用客观的物理反馈取代了不可靠的模型投票。通过使用一个既作为提问者又作为求解者的单一 policy 进行协同演进,SpatialEvo 创建了一个动态的、任务自适应的课程,在无需人工干预的情况下提升了空间推理能力。

数据集

数据集概览

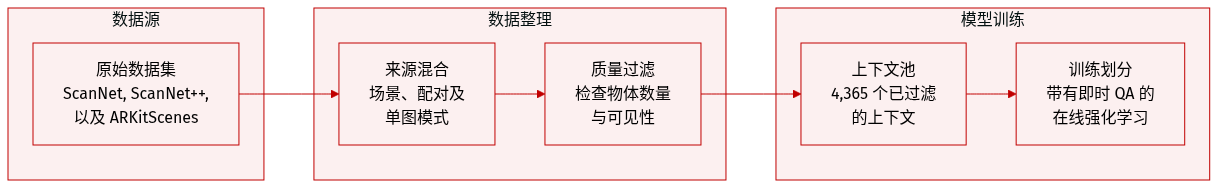

作者利用了一个经过预过滤的多源视觉上下文池,专为在线强化学习(RL)设计。数据集结构如下:

-

组成与来源

- 该上下文池由来自 ScanNet、ScanNet++ 和 ARKitScenes 训练集的共计 4,365 个上下文组成。

- 数据分为三种不同的模态:场景级多帧上下文、图像对上下文和单图像上下文。

-

过滤与质量控制

- 场景级上下文: 经过过滤以确保高 grounded 可见物体计数和低零可见率。

- 图像对上下文: 要求跨帧至少包含三个共享的可见物体,且每帧至少包含五个可见物体。

- 单图像上下文: 要求至少包含六个可见物体。

-

数据使用与训练策略

- 混合比例: 上下文池根据支持的任务类型数量按模态进行平衡,使得场景级、图像对和单图像输入的比例约为 6:7:3。

- 采样逻辑: 为防止数据冗余,作者对每个视频采样有限数量的上下文,具体为每种模态不超过三个。

- 在线生成: 在训练期间,policy 模型接收原始图像上下文作为输入,而问题和答案的生成均在线完成。

方法

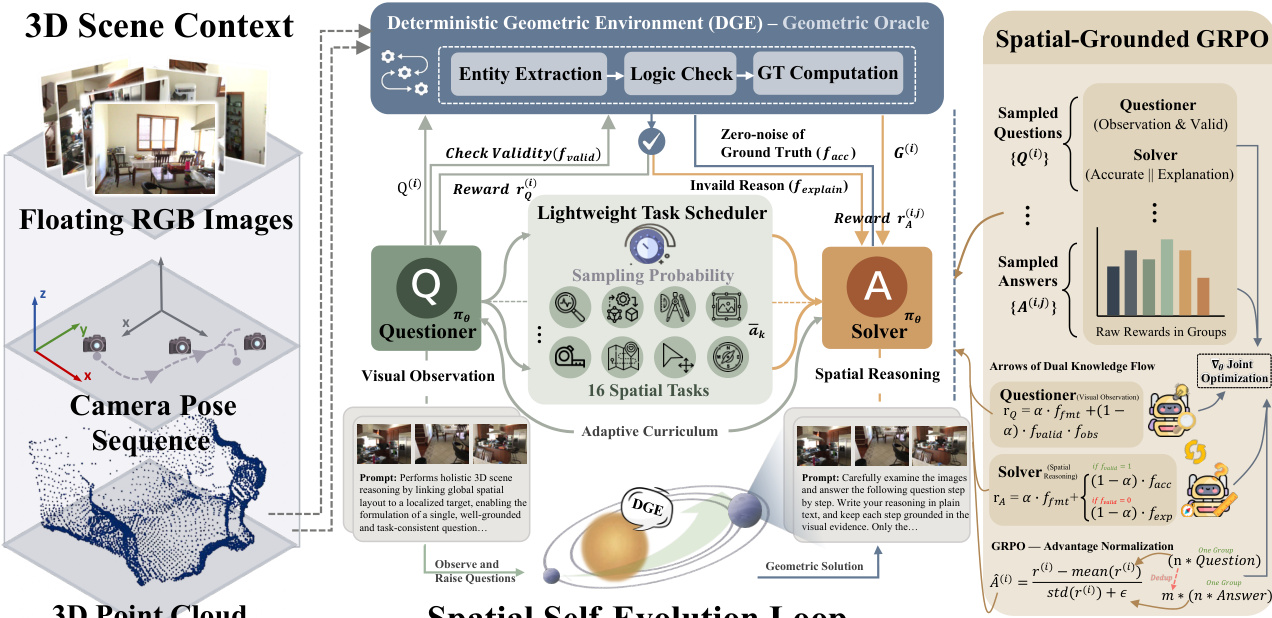

SpatialEvo 框架(如下图所示)通过一种协同演进范式引入了一种新颖的空间推理架构,该范式将确定性几何环境与共享的视觉语言 policy 模型相结合。该框架作为一个闭环系统运行,由参数化为 πθ 的单一 policy 模型动态承担两个互补角色:提问者(Questioner)和求解者(Solver)。提问者从视觉观察中生成具有空间依据的推理问题,而求解者预测这些问题的答案,两个角色都在由确定性几何环境(DGE)提供的几何 ground truth 的硬约束下运行。这种设计建立了一个持续的自我强化循环,其中提问者对空间边界的探索通过求解者与 DGE 绝对 ground truth 的交互得到纠正,从而实现了知识的相互强化和稳健空间智能的涌现。

该框架的核心是确定性几何环境(DGE),它充当几何 oracle 以提供无噪声的反馈。DGE 接收来自 policy 模型的自然语言问题,并将其映射到底层的 3D 场景资产(包括密集点云和相机位姿序列),以执行客观验证并计算精确的 ground-truth 答案。这一过程通过一个由两个主要组件紧密耦合的流水线实现:特定任务的几何验证规则集和自动化验证流水线。验证规则集将 16 个空间推理任务中的每一个分解为可执行的原子标准,确保问题在前提一致性、推理可解性和几何退化过滤等维度上是有效的。例如,一个关于相对方向的问题要求引用的帧是有效的,并且存在足够的视角差异。随后,自动化验证流水线分三个阶段执行此逻辑:首先,使用轻量级 LLM 解析自由形式的问题以提取结构化实体;其次,根据特定任务的规则集验证提取的实体;第三,对于有效的问题,执行精确的几何计算以合成 ground truth。这种范式用程序化的物理计算取代了不可靠的基于模型的判断,确保 policy 模型的每一次梯度更新都锚定在客观物理定律上。

提问者和求解者的协同演进由基于 GRPO 算法的空间锚定 policy 协同演进机制驱动。该机制采用单一的 policy 模型,通过角色条件提示(role-conditioned prompting)在两个角色之间交替。任务调度器是一个轻量级组件,通过基于求解者历史表现进行任务采样来动态调整训练课程。它首先推断当前场景的可行任务集,然后分配与每个任务类别历史有效准确率成反比的采样权重,确保模型专注于当前的认知弱点。这创建了一个完全自适应、内生驱动的课程。训练过程包括提问者生成一批候选问题,然后由 DGE 进行验证。有效问题被传递给求解者,求解者独立生成答案并根据准确率获得奖励。无效问题也对学习有所贡献,因为求解者需要为拒绝原因生成解释,该解释由轻量级 LLM 评判器进行评分。奖励函数经过精心设计,以促进高质量、有效的推理。对于提问者,奖励结合了格式合规性与几何有效性和视觉观察质量的耦合项,这起到了关键的门控机制作用。对于求解者,奖励结构旨在为有效和无效问题都提供有意义的信号,确保模型不仅学会正确回答,还学会理解定义有效空间查询的规则和约束。

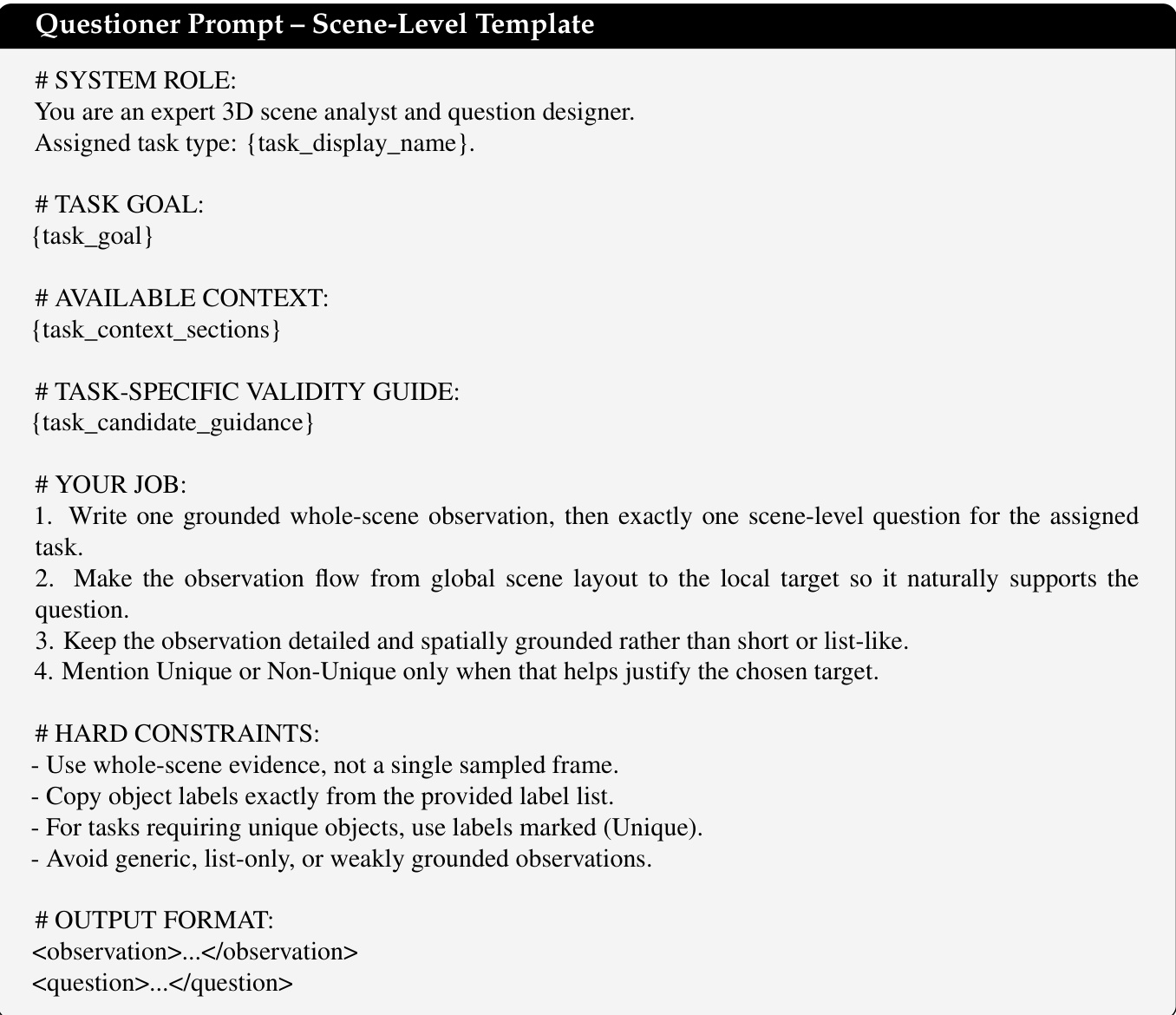

该框架的设计包含几个关键组件,以确保稳健性和可解释性。DGE 的自动化验证流水线包括一个去重感知统计系统,该系统维护唯一语义问题签名的加权计数,以保持课程的一致性。提问者提示模板是任务条件的,包含场景级、单图像和图像对模板,引导模型以“从全局到局部”的流向生成观察。用于为求解者对被拒绝问题的解释评分的“无效问题解释评判器”提示,旨在优先选择模拟器的权威失败原因,而非流利但缺乏依据的解释。这确保了无效问题的学习信号锚定在 DGE 的结构化拒绝证据上,教会模型哪些问题不应该被提出以及原因。所有辅助语言模型调用(包括实体提取和解释评判)都统一到单个 GPT-OSS-120B 后端,以控制系统复杂性并确保一致性。这种全面的设计使模型能够通过与物理一致环境的持续交互,培养出对空间关系的深刻且有据可依的理解。

实验

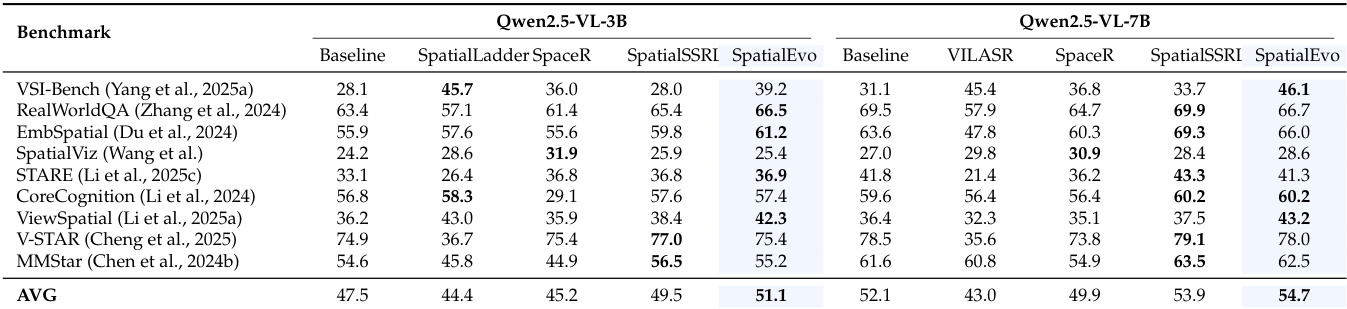

SpatialEvo 在九个基准测试中进行了评估,以验证其通过自我演进强化学习框架提升 3D 空间推理的能力。实验将所提方法与静态数据微调和现有的自监督方法进行了对比,同时通过消融研究分离了确定性几何环境和自适应任务调度器的益处。结果表明,通过程序化验证提供精确的物理反馈,能够在不降低通用视觉能力的情况下,实现卓越的空间智能和涌现式的课程学习。

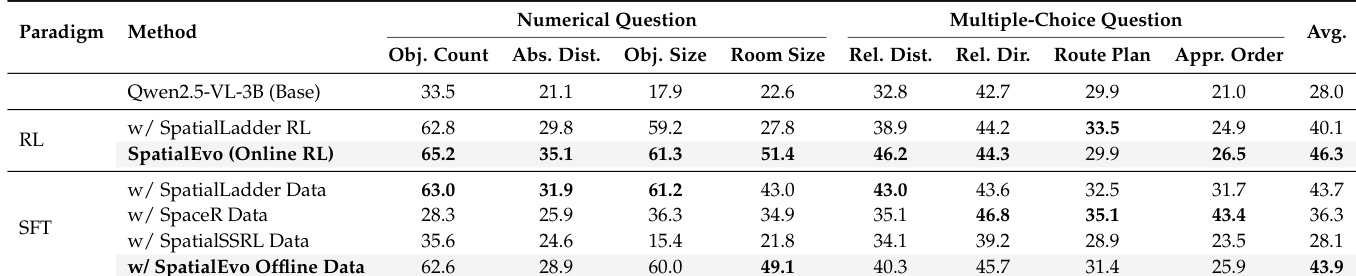

该表比较了空间推理的不同训练范式,显示在线强化学习方法在多个任务类别中实现了最高的平均分。结果突显了与静态数据微调方法相比,所提方法在提高数值题和选择题性能方面的有效性。在线强化学习方法在所有任务类别中均优于静态数据微调方法。所提方法实现了最高的平均分,表明在空间推理任务中具有卓越的性能。静态数据微调方法表现较低,特别是在数值题和选择题类别中。

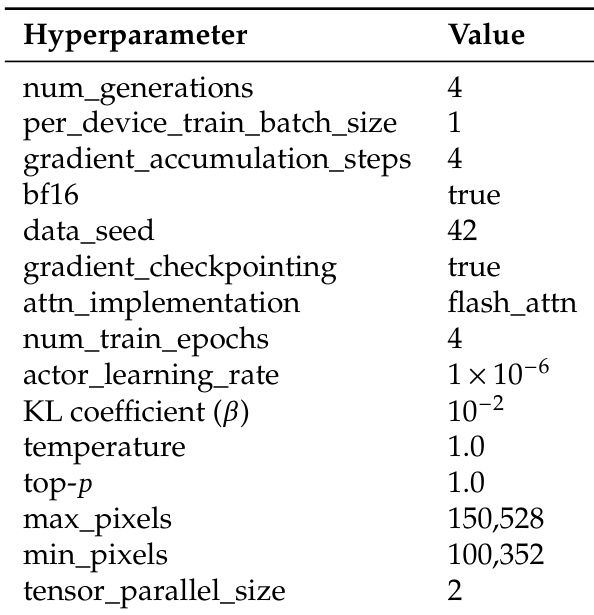

该表列出了训练过程中使用的关键超参数,包括梯度累积、学习率和数据处理的设置。这些参数是模型训练流水线强化学习配置的一部分。训练使用步数为 4 的梯度累积和 1e-6 的学习率。模型采用 flash attention 进行高效计算,并处理最大像素大小为 150,528 的图像。训练涉及 4 个 epoch,并使用大小为 2 的张量并行。

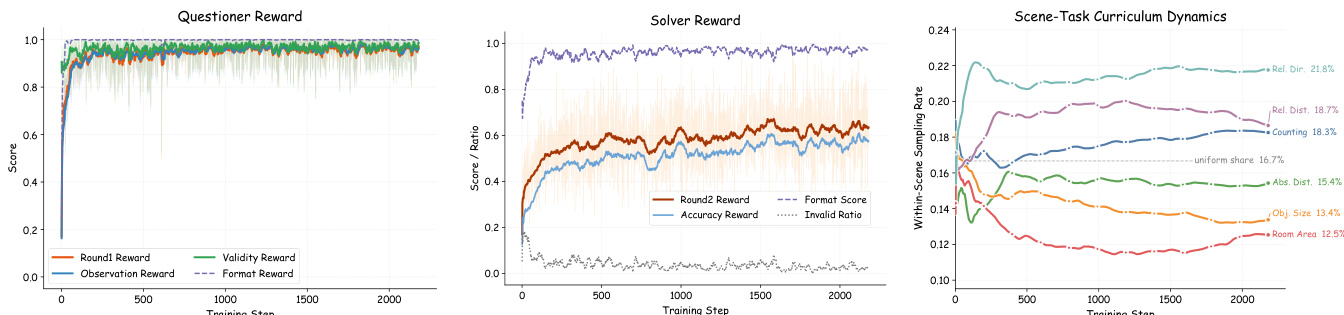

图示展示了 SpatialEvo 的训练动态,显示了提问者和求解者奖励的演进以及自适应课程的发展。结果显示,提问者很快学会了生成有效问题,而求解者的准确率有所提高,无效响应减少。自适应调度器动态调整任务采样率,随着训练的进行,重点转向更难的类别。提问者奖励稳定在 1.0 附近,表明有效问题生成的快速学习。求解者准确率提高且无效比例下降,反映了几何推理的内化。自适应调度器增加了较难任务的权重并降低了较易任务的权重,从而创建了一个内生课程。

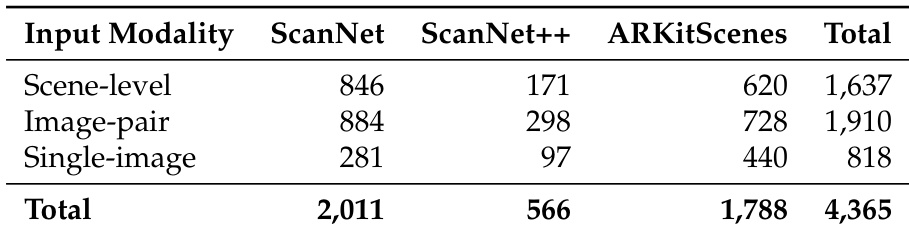

该表展示了三个 3D 场景数据集(ScanNet、ScanNet++ 和 ARKitScenes)中输入模态的细分情况。它显示了每个数据集的场景级、图像对和单图像输入的数量及其总量,表明了实验中所用数据源的规模和分布。数据集在场景级和图像对输入的数量上有所不同,ScanNet 在这两个类别中计数最高。与其它数据集相比,ARKitScenes 贡献了更多的单图像输入。所有模态和数据集的总输入数量为 4,365,其中 ScanNet 的整体贡献最大。

结果显示,SpatialEvo 在两种模型规模下,在多个基准测试中均实现了最高的平均分,优于所有基线模型。该框架在空间推理任务中表现出持续的增益,同时在通用视觉理解基准测试中保持了竞争力的性能。SpatialEvo 在所有评估的基准测试中,两种模型规模均实现了最高的平均分。SpatialEvo 在空间推理基准测试上优于所有基线,在 VSI-Bench 和 EmbSpatial 上有显著提升。SpatialEvo 在通用视觉理解任务上保持了竞争力的性能,与基线模型相比没有退化。

评估通过比较各种训练范式和基准测试,验证了 SpatialEvo 框架在增强空间推理方面的有效性。结果表明,在线强化学习方法在多个任务类别中显著优于静态数据微调,特别是在数值和选择推理方面。此外,自适应课程的发展成功促进了几何推理的内化,同时在通用视觉理解任务上保持了竞争力的性能。