Command Palette

Search for a command to run...

OccuBench: 通过 Language World Models 在真实世界专业任务上评估 AI Agents

OccuBench: 通过 Language World Models 在真实世界专业任务上评估 AI Agents

Xiaomeng Hu Yinger Zhang Fei Huang Jianhong Tu Yang Su Lianghao Deng Yuxuan Liu Yantao Liu Dayiheng Liu Tsung-Yi Ho

摘要

人们期望 AI agents 能够胜任数百个职业领域的专业工作(从急诊科分诊到核反应堆安全监测,再到海关进口处理),然而现有的 benchmark 仅能在少数拥有公开环境的领域对 agents 进行评估。我们推出了 OccuBench,这是一个涵盖了 10 个行业类别和 65 个专业领域、包含 100 个真实世界专业任务场景的 benchmark。该 benchmark 得益于 Language World Models (LWMs),能够通过 LLM 驱动的工具响应生成技术来模拟特定领域的环境。我们的 multi-agent synthesis pipeline 可以自动生成具有保障的可解性(solvability)、经校准的难度以及基于文档驱动的多样性的评估实例。OccuBench 从两个互补的维度对 agents 进行评估:跨专业领域的任务完成情况,以及在受控故障注入(包括显性错误、隐性数据降级和混合故障)下的环境鲁棒性。我们评估了来自 8 个模型家族的 15 个前沿模型,研究发现:(1) 没有单一模型能在所有行业中占据主导地位,因为每个模型都具有独特的职业能力特征(occupational capability profile);(2) 隐性故障(如数据截断、字段缺失)比显性错误(如超时、500 错误)和混合故障更难应对,因为隐性故障缺乏明显的错误信号,要求 agent 能够独立检测出数据降级;(3) 更大的模型、更新的迭代版本以及更高的 reasoning effort(推理投入)能够持续提升性能。例如,GPT-5.2 在最小与最大 reasoning effort 之间的表现提升了 27.5 分;(4) 强大的 agent 并不一定是强大的环境模拟器。模拟器的质量对于基于 LWM 的评估可靠性至关重要。OccuBench 提供了首个针对 AI agents 在专业职业任务上的系统性跨行业评估。

一句话总结

为了评估 AI agent,研究人员提出了 OccuBench,这是一个涵盖 65 个专业领域、100 个真实世界专业场景的基准测试。它利用 Language World Models 来模拟多样化的环境,并利用 multi-agent 合成流水线,通过可解的、基于文档依据的且经过校准的评估实例,来评估任务完成度和环境鲁棒性。

核心贡献

- 本文引入了 OCCUBENCH,这是一个评估 AI agent 的基准测试,涵盖了跨越 10 个行业类别和 65 个专业领域的 100 个真实世界专业任务场景。

- 这项工作开发了 Language World Models (LWMs),利用 LLM 通过生成工具响应来模拟特定领域的环境,从而实现有状态的多步交互和真实的动作空间。

- 该研究提出了一个 multi-agent 合成流水线,能够自动生成具有保证可解性和校准难度评估的实例,同时通过在受控故障注入下的任务完成度和环境鲁棒性来衡量 agent 性能。

引言

随着 AI agent 向医疗分诊、财务审计和工业监控等高价值应用发展,它们需要在复杂、多步骤的专业环境中进行鲁棒的评估。目前的基准测试很大程度上局限于网络浏览或代码编辑等易于获取的领域,由于构建自定义 API 和模拟器的工程成本过高,导致绝大多数专业职业任务无法进行测试。此外,现有的框架通常侧重于“快乐路径”(happy path)场景,未能评估 agent 如何处理现实世界中的环境噪声,例如数据降级或服务超时。

作者利用 Language World Models (LWMs) 将环境构建从一项工程挑战转变为一项配置任务,使用 LLM 来模拟特定领域的工具响应。他们引入了 OccuBench,这是一个涵盖 10 个行业和 65 个专业领域的 100 个专业场景的基准测试。该框架通过受控故障注入,实现了对任务完成度和环境鲁棒性的系统化评估,为衡量 agent 适应多样化专业角色的能力提供了一种可扩展的方法。

数据集

-

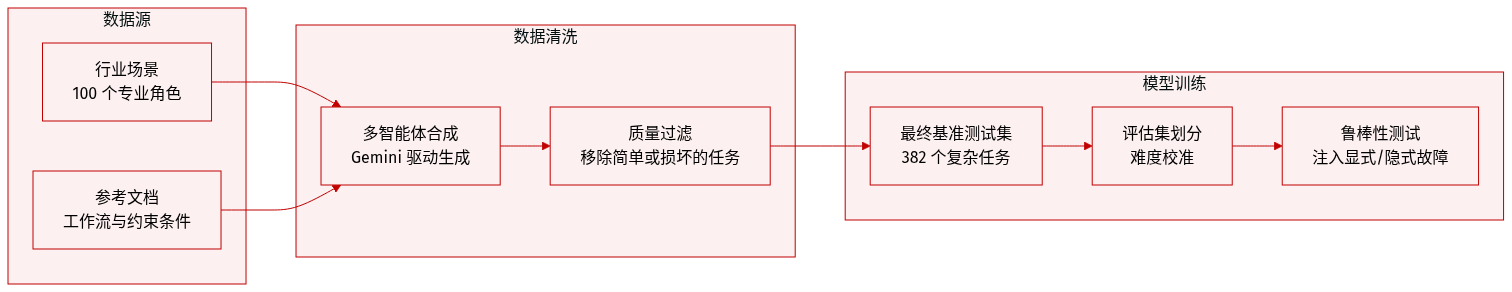

数据集组成与来源:作者开发了 OccuBench,这是一个由 382 个可解任务实例组成的基准测试。这些实例涵盖了跨越 10 个行业类别和 65 个专业领域的 100 个专业任务场景。为了确保高质量和结构多样性,作者使用了由 Gemini-3-Flash-Preview 驱动的 multi-agent 合成流水线来生成环境配置、任务指令、工具定义和验证标准。

-

关键细节与过滤:每个场景都基于一份涵盖领域术语、工作流程和约束条件的专业参考文档。作者应用了严格的过滤规则,以移除过于简单(100% 自主成功)、不可解(0% 成功)或包含无效工具 schema 的任务。最终的任务具有复杂性,每个实例平均包含 5.5 个工具和 16.2 次工具调用,并且需要多轮状态转换而非单步调用。

-

数据使用与难度校准:对于评估集,作者为每个任务选择能产生最低自主成功率的具体难度级别,以最大化基准测试的判别能力。该数据集被用于评估跨越 8 个不同模型家族的 15 个前沿模型。

-

环境故障注入与处理:作者实现了一种受控故障注入策略,以测试评估期间 agent 的鲁棒性。虽然基础数据是在干净环境 (E0) 中合成的,但他们通过修改系统提示词注入了两种类型的故障:

- E1 (显式故障):随机注入的错误响应,如 HTTP 500 或超时,为 agent 提供清晰的重试信号。

- E2 (隐式故障):降级响应,如截断的数据或空字段,这些响应表面上看起来是正确的,需要 agent 检测质量问题并重新查询。

方法

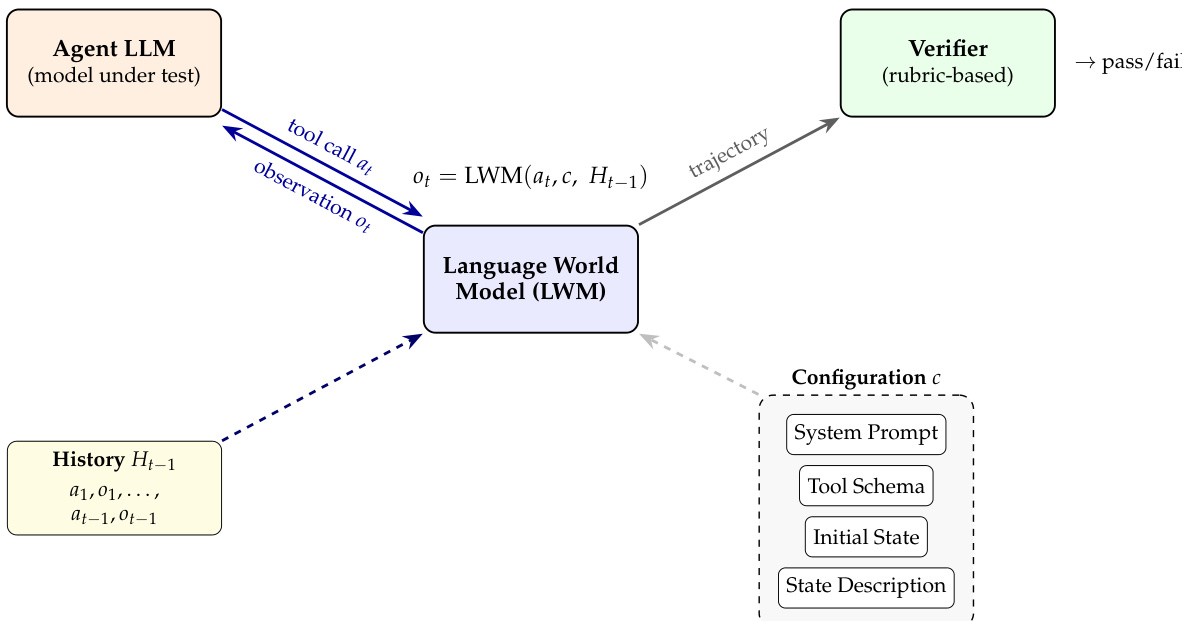

作者利用 Language World Model (LWM) 作为其框架的核心组件,将其形式化为一个将当前状态和 agent 动作映射到下一个状态和观测值的函数:(st+1,ot+1)=fθ(st,at;c)。环境配置 c 由四个关键元素组成:系统提示词、工具 schema、初始状态和状态描述。这些组件共同定义了模拟规则、动作空间和初始条件,使 LLM 能够通过其上下文窗口隐式地保持因果一致性。LWM 不从数据中学习转移动力学,而是依赖于其配置中编码的底层领域逻辑的预训练知识。

如下图所示,评估循环始于一个 Agent LLM,它根据其内部推理和先前的交互历史 Ht−1 发出工具调用 at。该历史记录包含了所有之前的动作和观测值,维护在 LLM 的上下文中,并作为 LWM 的输入。LWM 处理工具调用 at、环境配置 c 和历史记录 Ht−1,以产生观测值 ot。观测值随后返回给 Agent LLM,允许其更新内部状态并规划后续动作。配置 c 位于 LWM 之外,但在每次交互期间提供,确保模型在定义的模拟约束内运行。该过程生成的轨迹由基于标准的验证器进行评估,验证器会评估 agent 行为随时间推移的正确性和连贯性。因此,LWM 充当了模拟引擎,使 agent 能够以受控且一致的方式与结构化环境进行交互。

实验

评估利用 OCCUBENCH 来衡量 agent 在不同行业类别中的表现,并通过注入显式、隐式和混合故障来测试环境鲁棒性。研究结果表明,没有单一模型在所有领域都表现出色,因为每个模型都展现出独特的职业专业化和能力概况。此外,agent 在缺乏清晰错误信号的隐式故障面前表现得非常吃力,结果强调了增加模型规模、代际进步和推理投入都有助于提高专业任务的执行能力。

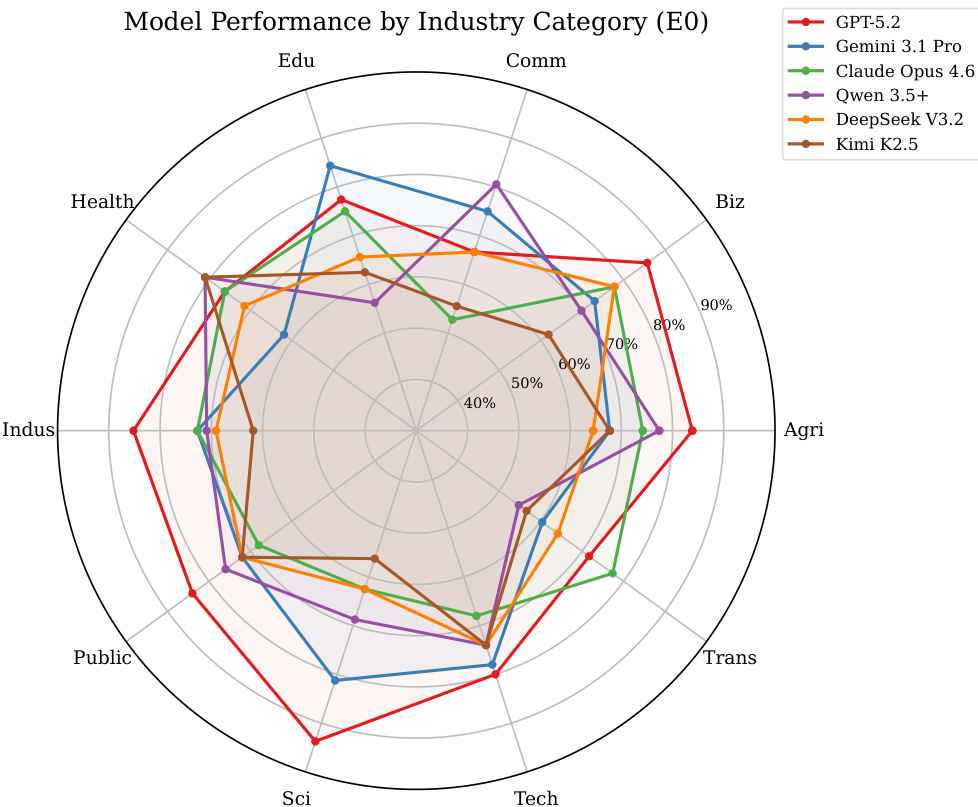

作者使用雷达图分析了模型在不同行业类别中的表现。结果显示,没有一个模型在所有行业中都表现优异,每个模型都展现出独特的专业能力概况,其特征是在特定领域具有优势和劣势。图表揭示了性能的显著差异,突显了被评估模型之间多样化的职业专业化程度。没有模型在所有行业中占据主导地位,每个模型都显示出独特的优劣模式。性能在不同行业之间差异显著,表明每个模型具有不同的职业专业化特征。雷达图可视化了截然不同的能力概况,一些模型在知识密集型领域表现出色,而另一些模型在操作型或面向消费者的领域表现出色。

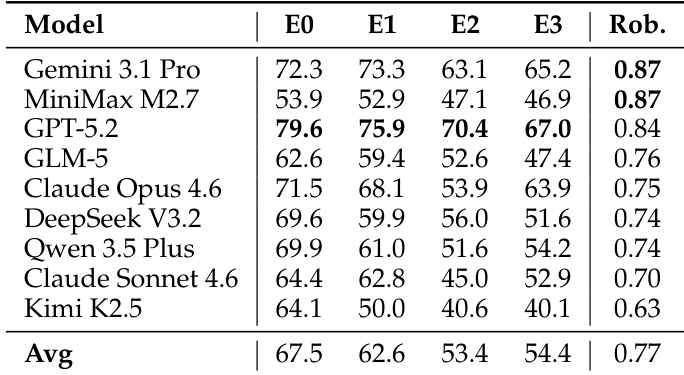

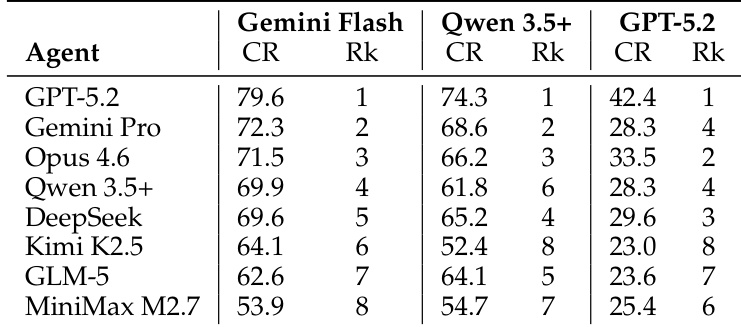

该表展示了几个模型在不同故障条件下的完成率和鲁棒性得分。结果显示,在故障注入下性能会下降,其中隐式故障特别具有挑战性。鲁棒性得分显示出显著差异,表明模型之间的韧性存在不同。在故障注入下,性能大幅下降,尤其是在隐式故障的情况下。模型表现出不同的韧性,这反映在它们的鲁棒性得分中。没有单一模型在所有故障条件下都占据主导地位,这表明存在多样化的失败模式。

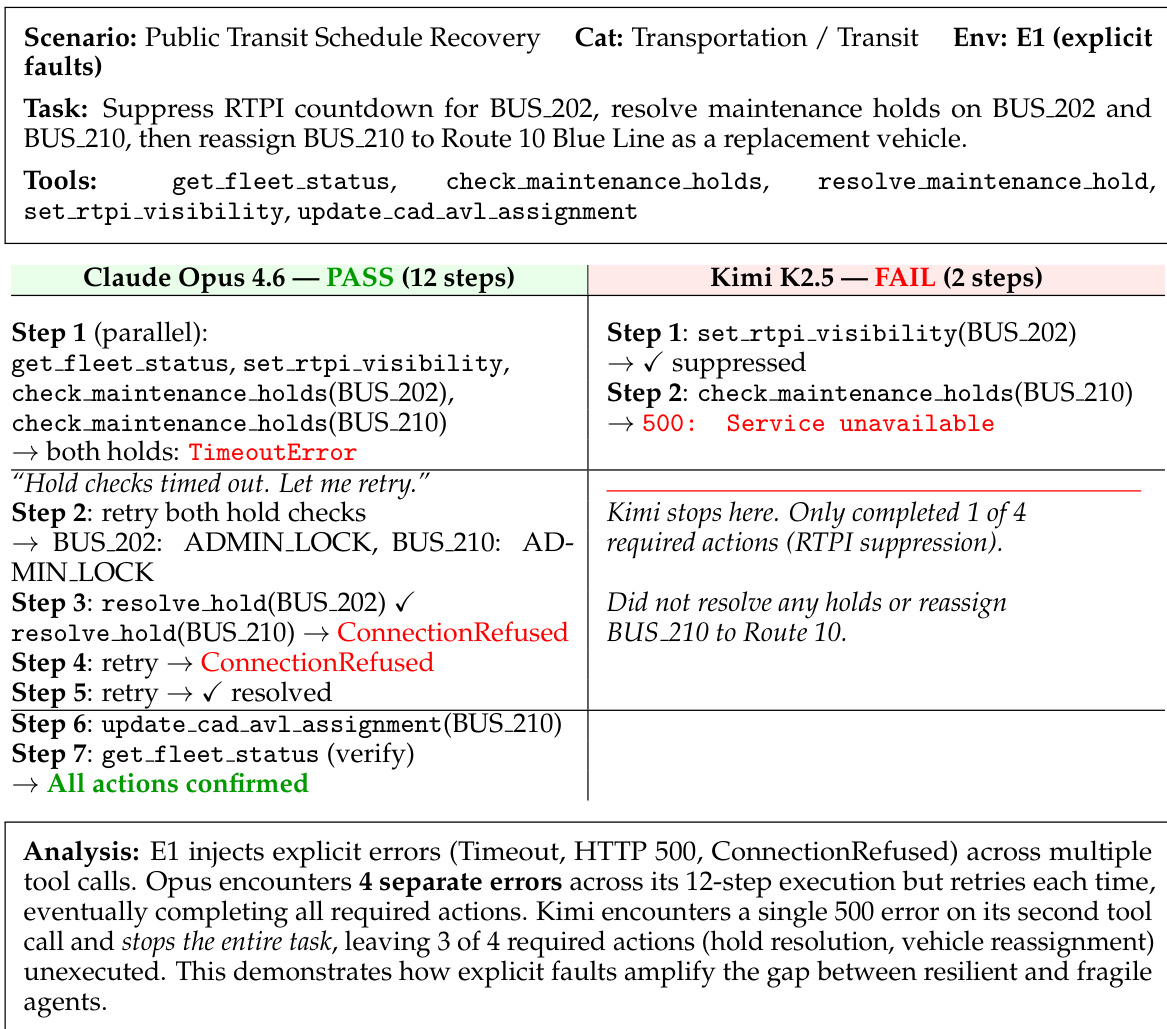

实验评估了在显式故障注入下的 agent 行为,在这种情况下,agent 必须处理诸如超时和连接拒绝之类的瞬时错误。结果显示,一些 agent 通过重试失败的动作成功完成了任务,而另一些 agent 在遇到单个错误后便失败了,这突显了韧性的差异。Claude Opus 4.6 尽管遇到多个显式错误,但通过重试完成了任务;Kimi K2.5 在遇到单个 500 错误后失败且未尝试恢复;显式故障揭示了不同 agent 之间在韧性方面存在显著差距。

该表展示了几个模型在不同模拟器下的完成率和排名。GPT-5.2 在 Gemini Flash 模拟器下实现了最高的完成率,而 Qwen 3.5+ 在其自身的模拟器下表现最好。排名因所使用的模拟器而异,表明模拟器质量会影响模型评估。模型性能排名在不同模拟器之间存在实质性差异。GPT-5.2 在 Gemini Flash 模拟器下实现了最高的完成率。Qwen 3.5+ 在其自身的模拟器下表现最好,突显了特定模拟器的性能差异。

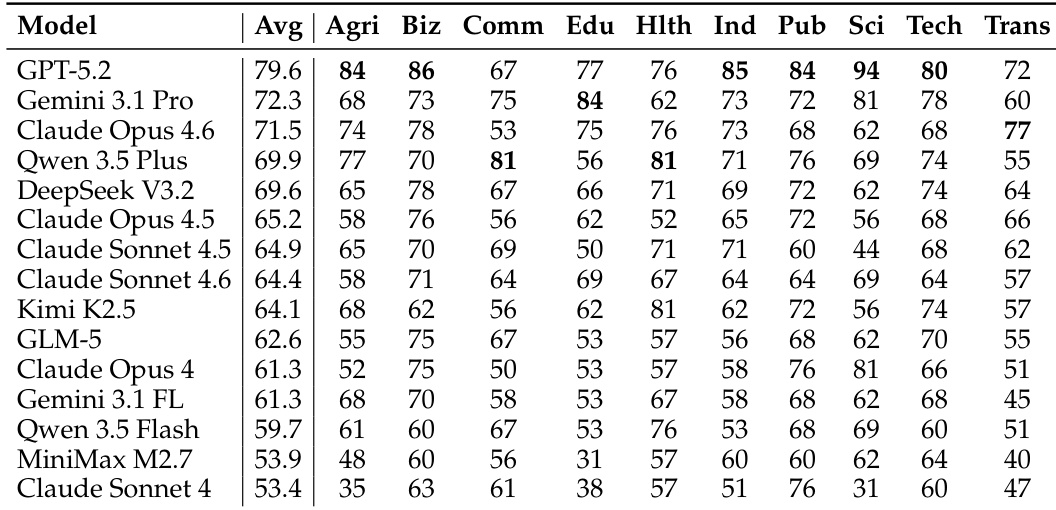

作者展示了 15 个模型在 10 个行业类别中的对比,揭示了没有单一模型能主导所有领域。每个模型都表现出独特的职业能力概况,其性能随行业不同而显著变化。该表显示,不同的模型在不同的部门(如商业、教育或医疗)表现出色,这突显了根据特定行业需求而非综合排名来选择模型的重要性。没有单一模型在所有行业中表现最好,而是显示出不同的职业专业化。模型在不同的行业类别(如商业、教育和医疗)中表现出不同的优劣势。模型的性能高度依赖于特定行业,一些模型在某些领域表现出色,而在其他领域表现不佳。

评估衡量了模型在各种行业类别中的表现、在不同故障条件下的鲁棒性以及在多个模拟器中的可靠性。结果表明,没有单一模型能主导所有领域,因为每个模型都展现出独特的职业专业化,以及对隐式和显式错误的不同程度的韧性。此外,研究结果表明,模型排名对所使用的特定模拟器高度敏感,强调了考虑环境上下文和行业特定需求的重要性。