Command Palette

Search for a command to run...

ActiveGlasses: 通过主动视觉从自我中心视角人类演示中学习操纵技能

ActiveGlasses: 通过主动视觉从自我中心视角人类演示中学习操纵技能

Yanwen Zou Chenyang Shi Wenyu Yu Han Xue Jun Lv Ye Pan Chuan Wen Cewu Lu

摘要

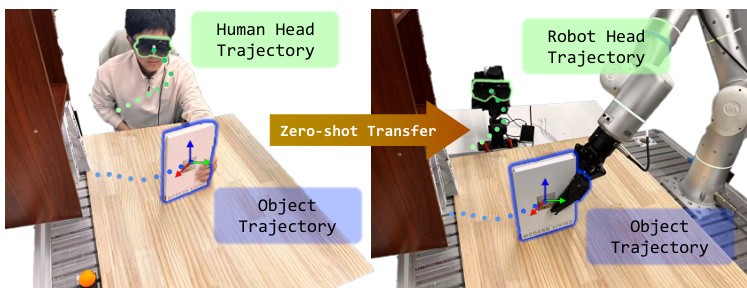

大规模真实世界机器人数据的采集,是实现机器人日常部署的前提条件。然而,现有的 pipeline 通常依赖专门的手持设备来弥合具身差距(embodiment gap),这不仅增加了操作者的负担并限制了可扩展性,还难以捕捉人类日常交互中自然协调的“感知-操控”(perception-manipulation)行为。这一挑战要求开发一种更自然的系统,能够在实现向机器人平台零样本迁移(zero-shot transfer)的同时,忠实地捕捉人类的操控与感知行为。在此,我们介绍了 ActiveGlasses,这是一个通过具有主动视觉(active vision)的第一视角(ego-centric)人类演示来学习机器人操控任务的系统。安装在智能眼镜上的立体相机作为数据采集和 policy 推理的唯一感知设备:操作者在进行徒手演示时佩戴该眼镜,而在部署阶段,同一台相机被安装在 6-DoF 感知机械臂上,以重现人类的主动视觉行为。为了实现零样本迁移,我们从演示中提取物体轨迹,并利用一种以物体为中心的点云 policy 来共同预测操控动作与头部运动。在涉及遮挡和精确交互的多个挑战性任务中,ActiveGlasses 实现了具备主动视觉的零样本迁移,在相同硬件配置下持续优于强有力的基准模型(baselines),并在两种机器人平台上展现出了良好的泛化能力。

一句话总结

ActiveGlasses 是一个通过智能眼镜学习人类第一视角演示来获取机器人操控能力的系统,它利用以物体为中心的点云策略(object-centric point-cloud policy)来共同预测操控动作和头部运动,从而实现协调的感知-操控行为在多个机器人平台上的 zero-shot 迁移。

核心贡献

- 本文介绍了 ActiveGlasses,这是一个利用安装了立体摄像头的智能眼镜,通过自然的第一视角演示来捕捉人类操控和感知行为的系统。

- 该方法采用以物体为中心的点云策略,通过提取物体轨迹来共同预测操控动作和头部运动,使机器人能够重现类人的主动视觉(active vision)。

- 实验结果表明,该系统在两个不同的机器人平台之间实现了 zero-shot 迁移,并在涉及遮挡和精确交互的挑战性任务中持续优于强基准模型。

引言

扩展机器人部署需要大规模的现实世界数据采集,然而目前的模仿学习流程往往依赖沉重的便携式设备或 VR 头显,这给操作者带来了身体负担,且无法捕捉自然的人类感知。虽然现有方法使用了腕部摄像头,但它们缺乏进行类人主动感知的能力,而以往使用智能眼镜的尝试通常将头部运动视为噪声,而不是完成任务的有用信号。作者利用了一个名为 ActiveGlasses 的基于智能眼镜的系统,来采集结合了操控和主动视觉的第一视角人类演示。通过提取物体轨迹并利用以物体为中心的点云策略,作者使机器人能够共同预测操控动作和 6-DoF 头部运动,实现了在不同机器人平台上的 zero-shot 迁移。

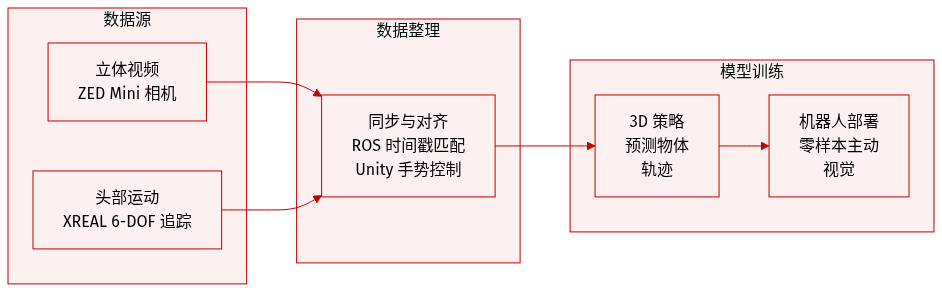

数据集

作者使用了一个定制采集的数据集,旨在捕捉第一视角立体视频和 6-DOF 头部运动数据。数据集详情如下:

- 数据源与硬件:采集系统集成了 XREAL Air 2 Ultra 眼镜和 ZED Mini 立体摄像头。XREAL 眼镜为头部运动提供高频 6-DOF 位姿跟踪,而 ZED Mini 作为立体视频流的主要来源。

- 数据组成:每个记录的 episode 由同步的立体摄像头帧和 6-DOF 头部位姿组成。由于 XREAL 系统具有更优的采样频率和稳定性,作者使用它进行运动跟踪,而非 ZED Mini 的 IMU。

- 处理与同步:数据时间戳使用机器人操作系统(ROS)进行对齐。为了便于数据采集,作者开发了一个基于 Unity 的用户界面,通过检测用户手势来发出每个 episode 开始和结束的信号,并向操作者提供音频反馈。

- 在模型训练中的使用:数据用于训练一个以物体为中心的 3D 策略。该策略旨在预测任务空间中未来的 6-DOF 物体轨迹。在推理过程中,训练好的策略被 zero-shot 地部署在 6-DOF 机械臂上,机械臂同步执行记录的头部运动以重现主动视觉。

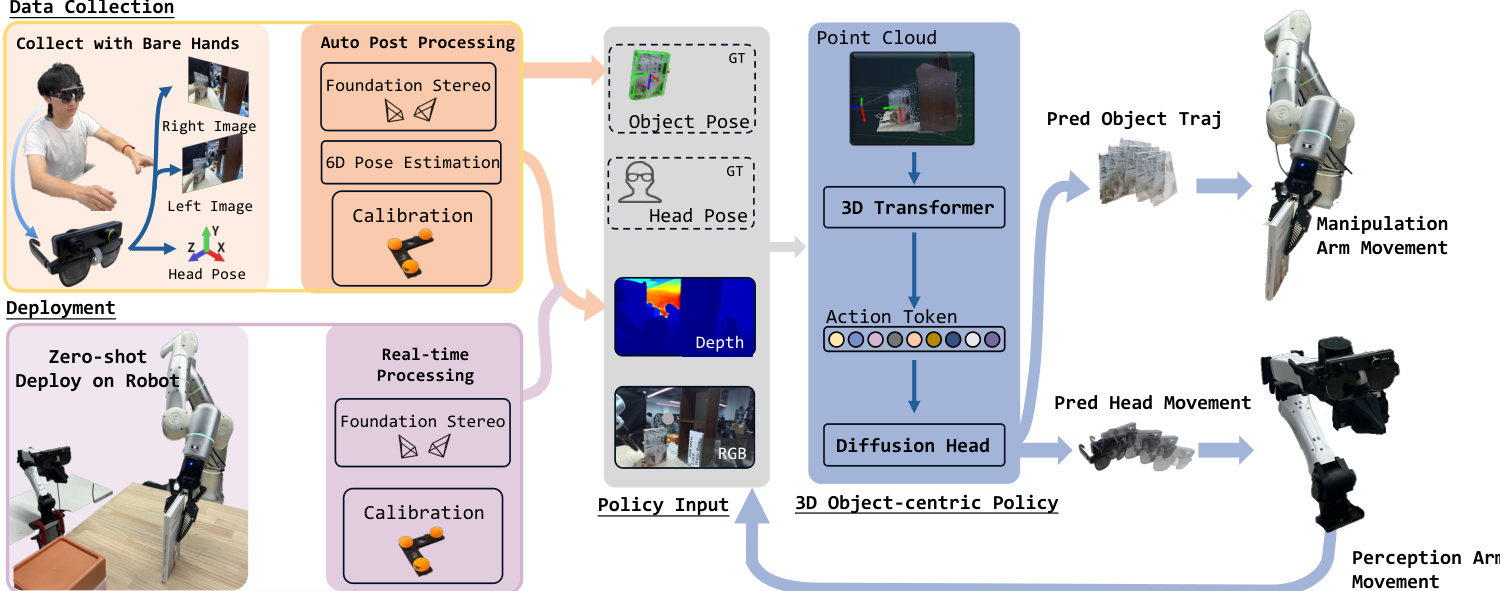

方法

作者利用多阶段流水线将立体视频和头部轨迹数据处理成适合策略学习的统一表示,从而实现从人类演示到机器人执行的 zero-shot 迁移。整体框架始于使用安装在智能眼镜上的 ZED Mini 立体摄像头进行数据采集,如下图所示。系统处理左眼和右眼视频流以及头部轨迹,以生成逐帧深度图、物体和手部掩码(mask),以及相机坐标系下的真值物体轨迹。这些数据随后用于校准系统,并将重建的点云转换到一致的世界坐标系中。

使用 FoundationStereo 对每对立体图像进行深度估计以生成深度图,然后将其反投影为相机坐标系下的点云。为了消除人类特有的伪影,使用 Grounded-SAM 对操作者的手部进行分割,并从点云中移除相应的点。使用 SAM2 对被操控的物体进行分割以获取掩码,然后结合深度图和左视图图像,通过 FoundationPose 估计物体的 6-DoF 位姿。这产生了相机坐标系下的物体轨迹,并通过物体网格(mesh)提供的几何先验进行了增强。

通过在桌面放置三个橙色球体来定义平面坐标系,从而实现校准。利用第一帧,根据球心的像素位置和深度值计算其 3D 位置,从而构建一个轴向由球体相对位置衍生的世界坐标系。计算初始的相机到世界的变换,并利用头部位姿的相对运动传播后续变换,确保在整个 episode 中点云始终保持在统一的世界坐标系中。

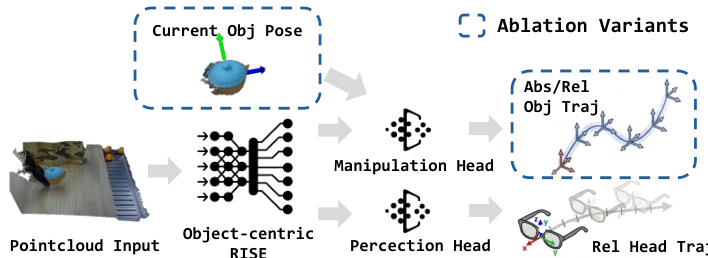

策略设计分为三个阶段:抓取前(pre-grasp)、运动规划(motion planning)和终止(termination)。对于运动规划,作者采用了一种以物体为中心的策略,该策略以世界坐标系点云作为输入,并同时预测目标物体轨迹和机器人的头部运动。如框架图所示,该策略采用 3D Transformer 来处理点云并生成 action tokens,然后将其输入到两个 diffusion heads 中。一个 head 预测绝对物体轨迹以保持任务专注度,另一个 head 预测相对头部运动轨迹,以防止因初始状态不同而导致的逆运动学失败。策略输出还包括一个终止信号,每个 episode 的最后五帧被标记为任务完成。

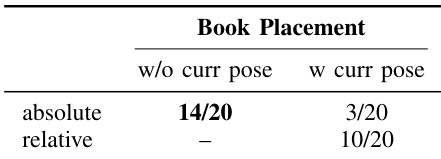

最终动作通过使用相机校准将预测的物体位姿转换到末端执行器坐标系中得到。消融实验强调了对物体轨迹使用绝对表示以及对头部运动使用相对表示的重要性,如下图所示。这种设计确保了在不同初始配置和视角下的鲁棒性和泛化能力。

实验

实验通过涉及遮挡和精度的现实任务(如书籍放置和面包插入)来评估 ActiveGlasses 系统,以验证其可扩展性、主动视觉能力、策略设计和跨具身(cross-embodiment)潜力。结果表明,使用头戴式眼镜进行徒手数据采集比传统的遥操作更高效且用户友好,同时与固定摄像头设置相比,主动视觉显著提高了遮挡场景下的成功率。此外,通过预测物体轨迹而非特定的关节运动,以物体为中心的 3D 策略实现了在不同机器人平台上的成功 zero-shot 迁移。

实验评估了不同的物体轨迹预测策略设计,比较了在有无当前物体位姿条件约束下的绝对表示和相对表示。结果显示,绝对轨迹预测的表现优于相对预测,且添加当前位姿作为条件会降低性能。在策略性能方面,绝对轨迹预测优于相对预测。将当前物体位姿作为条件信号会降低策略的有效性。相对轨迹预测会导致性能下降并增加系统复杂度。

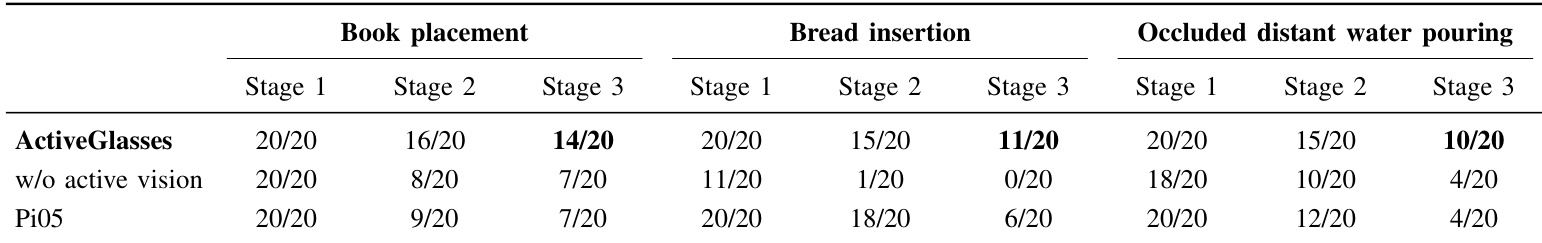

作者在三个涉及遮挡和精确操控的现实任务中评估了 ActiveGlasses。结果显示,与基准模型相比,ActiveGlasses 在所有任务和阶段都实现了更高的成功率,特别是在需要主动视觉的场景中。该系统在处理遮挡和远距离视觉输入方面表现出鲁棒的性能。ActiveGlasses 在所有任务和阶段都优于基准模型,尤其是在遮挡场景下。与固定摄像头设置相比,该方法在需要主动视觉的任务中实现了更高的成功率。ActiveGlasses 在不同机器人平台之间表现出一致的性能,展示了跨具身能力。

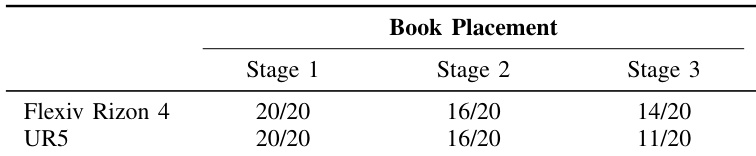

作者比较了两个机器人臂在书籍放置任务中跨三个阶段的表现。结果显示,两个机器人在初始阶段都达到了相似的成功率,但 UR5 在最后阶段出现了更多失败,这可能是由于工作空间限制造成的。两个机器人在书籍放置的前两个阶段表现同样出色。与 Flexiv Rizon 4 相比,UR5 在最后阶段的成功率较低。性能差异归因于 UR5 机器人的工作空间约束。

实验评估了轨迹预测的策略设计选择、ActiveGlasses 在现实操控任务中的有效性,以及不同机器人臂的跨具身性能。研究结果表明,绝对轨迹表示优于相对表示,而 ActiveGlasses 在遮挡场景和各种机器人平台中展示了卓越的鲁棒性。此外,虽然不同的机器人臂在任务初始阶段表现相似,但工作空间约束可能会导致后期阶段的性能差异。