Command Palette

Search for a command to run...

HY-Embodied-0.5:面向真实世界 Agent 的 Embodied Foundation Models

HY-Embodied-0.5:面向真实世界 Agent 的 Embodied Foundation Models

摘要

我们推出了 HY-Embodied-0.5,这是一个专门为现实世界具身智能体(embodied agents)设计的基座模型系列。为了弥合通用视觉语言模型(VLMs)与具身智能体需求之间的鸿沟,我们开发的模型旨在增强具身智能所需的核心能力:空间与时间维度的视觉感知,以及用于预测、交互和规划的高级具身推理能力。HY-Embodied-0.5 系列包含两种主要变体:一种是具有 2B 激活参数的高效模型,专为边缘端部署设计;另一种是具有 32B 激活参数的强大模型,旨在处理复杂的推理任务。为了支持具身任务所必需的细粒度视觉感知,我们采用了 Mixture-of-Transformers (MoT) 架构,以实现模态特定的计算。通过引入 latent tokens,该设计有效地增强了模型的感知表示能力。为了提升推理能力,我们引入了一种迭代式的、自我进化的训练后(post-training)范式。此外,我们采用 on-policy distillation 技术,将大模型的先进能力迁移至较小的变体中,从而最大限度地挖掘紧凑型模型的性能潜力。在涵盖视觉感知、空间推理和具身理解等领域的 22 个 benchmark 上进行的广泛评估证明了我们方法的有效性。我们的 MoT-2B 模型在 16 个 benchmark 上超越了同等规模的最先进(state-of-the-art)模型,而 32B 变体的性能则达到了与 Gemini 3.0 Pro 等前沿模型相当的水平。在下游机器人控制实验中,我们利用强大的 VLM 基座训练了一个高效的 Vision-Language-Action (VLA) 模型,并在现实世界的物理评估中取得了令人瞩目的成果。代码和模型已在 https://github.com/Tencent-Hunyuan/HY-Embodied 开源。

一句话总结

由腾讯 Robotics X 和 HY Vision 团队开发的 HY-Embodied-0.5 是一个面向现实世界 Agent 的基础模型系列。它利用 Mixture-of-Transformers 架构和 latent tokens 来增强空间和时间感知,同时采用迭代式、自我进化的 post-training 范式和 on-policy 蒸馏,来弥合通用视觉语言模型与复杂具身推理之间的差距。

核心贡献

- 本文介绍了 HY-Embodied-0.5,这是一个基础模型系列,具有模态自适应的 Mixture-of-Transformers (MoT) 架构和视觉 latent tokens,旨在增强具身 Agent 的细粒度空间和时间感知。

- 这项工作提出了一种迭代式、自我进化的 post-training 范式和一种从大到小的 on-policy 蒸馏方法,将复杂的推理能力从 32B 参数模型转移到专为边缘部署设计的 2B 参数高效变体中。

- 在 22 个基准测试上的实验结果表明,这些模型达到了最先进的性能,其中 32B 变体超越了 Gemini 3.0 Pro,2B 变体则优于 Qwen3-VL-4B 和 RoboBrain2.5-4B 等更大模型。

引言

虽然视觉语言模型 (VLMs) 在数字智能领域取得了显著进展,但它们往往难以满足物理 Agent 的专业需求。现有模型通常缺乏物理落地所需的细粒度视觉感知,并且在具身环境中所需的动态预测、交互和规划方面优化不足。作者通过引入 HY-Embodied-0.5 来解决这些差距,这是一个专门为现实世界 Agent 设计的基础模型系列。他们利用带有视觉 latent tokens 的 Mixture-of-Transformers 架构来增强空间和时间感知,并结合迭代式、自我进化的 post-training 范式来提升推理能力。此外,作者利用 on-policy 蒸馏将先进的智能从大型 32B 参数模型转移到针对边缘部署优化的 2B 参数高效变体中。

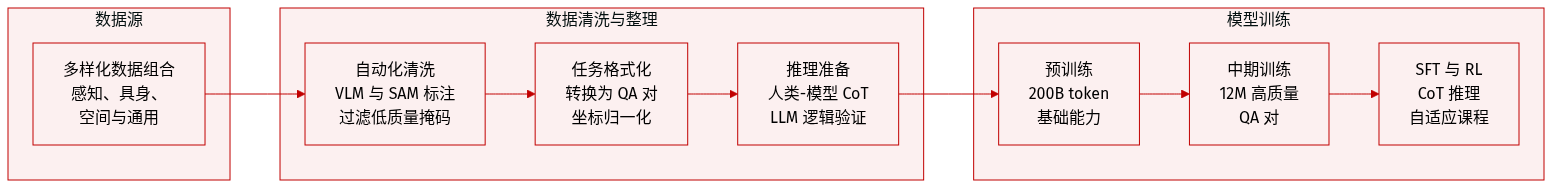

数据集

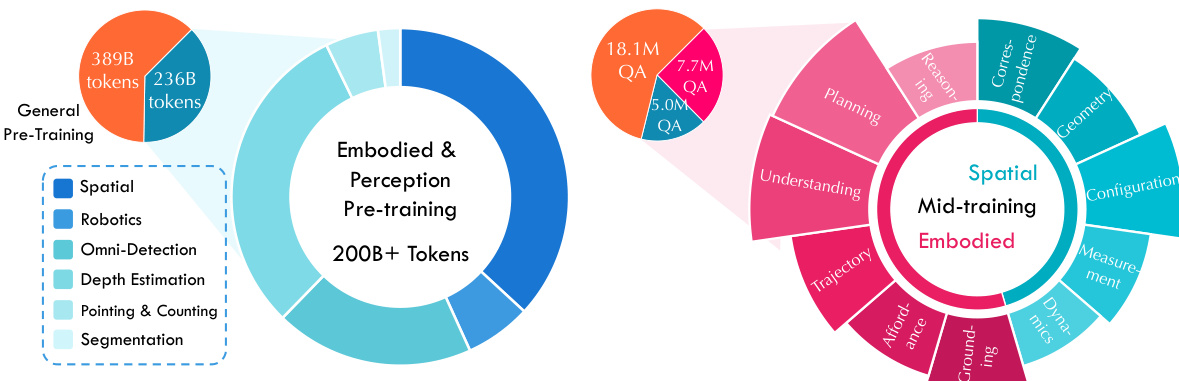

作者开发了一个多阶段训练课程,使用了多样化的视觉语言数据混合物,分为四个主要领域:

-

视觉感知数据:该子集专注于低层级的落地 (grounding) 和识别。

- 全方位检测 (Omni-Detection, 62M 样本):结合了来自 OpenImages、Objects365、RefCOCO 和 SA-1B 等来源的 2D 和 3D 检测数据。作者使用包含 VLM 和 SAM 的自动化流水线对低质量数据进行标注,并使用更强的 VLM teacher 进行验证。坐标被归一化到 0 到 1000 的整数范围。

- 深度估计 (Depth Estimation, 36M 样本):源自 3D 室内/室外和自动驾驶数据集。作者使用点采样策略来排除物体边界和无穷远,并归一化相机焦距以标准化尺度。

- 分割 (Segmentation, 5M 样本):来源于 SA-1B。作者过滤掉了过小、过大或破碎的 mask,并使用扩展的 tokenizer 词表将 mask 转换为问答对。

- 指向与计数 (Pointing and Counting, 11M 样本):使用来自 Pixmo-Points 的 ground-truth 点,并从检测语料库中选择高密度场景以增加任务难度。

-

具身中心数据 (Embodied-Centric Data):组织为三层层次结构(感知、语义理解和规划),以支持物理 Agent 操作。

- 落地 (Grounding):使用 Molmo、RoboPoint 和 RefSpatial 来强化对交互物体和机械臂的空间识别。

- 可利用性 (Affordance):将 RoboAfford 和 ShareRobot 与 VLM 生成的用户指令与现有的落地标注相结合。

- 轨迹 (Trajectory):使用 CoTracker3 模型从开源数据集和操作视频中提取。轨迹被下采样至最多 15 个路标点,绘制在图像上,并由 VLM judge 进行验证。

- 理解与规划 (Understanding and Planning):聚合了来自 Robo2VLM、RoboVQA 等的 QA 对。规划数据通过使用 VLM 将机器人视频在时间上分割成动作序列查询-响应对来创建。

- 推理 (Reasoning):一个针对长程任务(如视觉谜题解决和直觉物理)的内部数据集。

-

空间中心数据 (Spatial-Centric Data):专注于使用 ScanNet、ScanNet++ 和 ARKitScenes 进行 3D 几何推理。

- 对应关系与几何 (Correspondence and Geometry):包括跨帧点匹配和 2D-3D 映射,以及深度估计和比较。几何任务使用深度差异至少为 0.3m 的点对以确保清晰度。

- 配置与测量 (Configuration and Measurement):涵盖物体计数、相对方向和距离排序。测量任务为物体大小、绝对距离和房间面积提供度量输出(例如厘米或米),并设有过滤器以排除过于接近的物体。

- 动力学 (Dynamics):通过 3D 点轨迹捕捉相机自我运动和物体运动。

-

通用理解数据 (General Understanding Data):包括涵盖语义、STEM、细粒度解析和 agentic 操作的内部数据。这些数据被划分为两个子集,分别用于 pre-training 和 mid-training 阶段。

训练与处理策略:

- Pre-training 与 Mid-training:pre-training 混合物由超过 200B tokens 的空间、机器人和感知数据组成。mid-training 阶段利用了超过 12M 高质量的 QA 对。

- 监督微调 (SFT):作者通过人机协作流水线构建了 100k 个冷启动思维链 (CoT) 实例,随后由 LLM 进行逻辑正确性评估。

- 强化学习 (RL):作者没有使用固定数据集,而是采用了能力自适应课程。他们维护一个候选池,并选择位于模型当前能力前沿附近的样本(即那些部分成功的样本),以提供信息量最大的信号。

方法

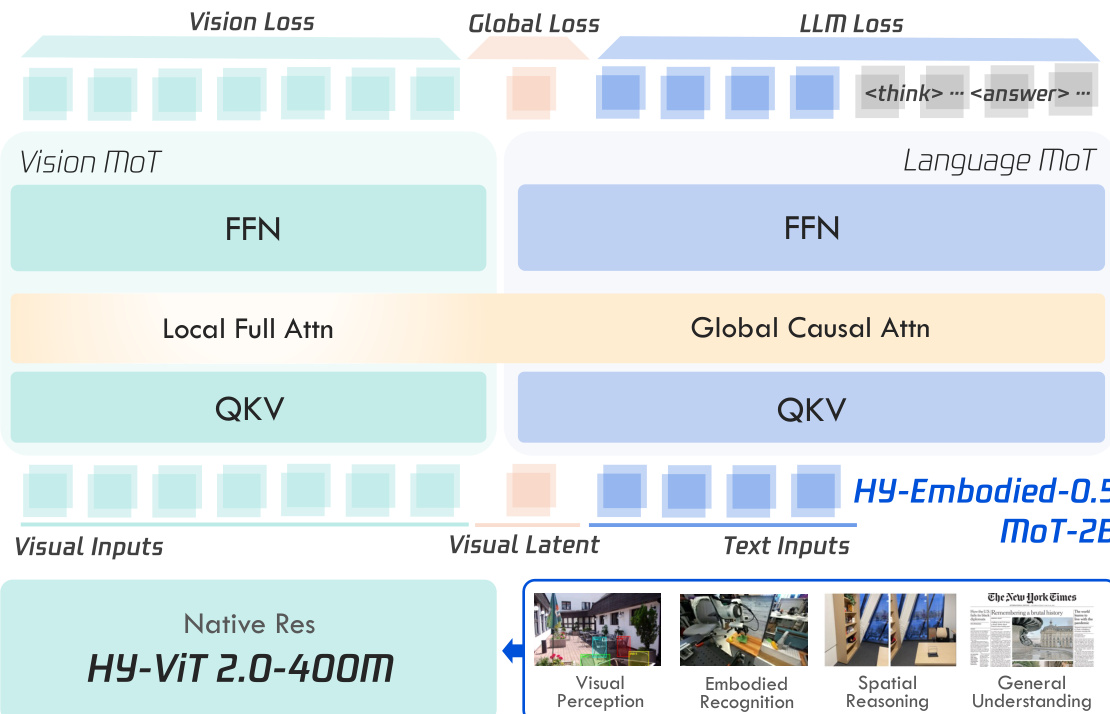

作者利用了一种混合视觉语言模型架构 HY-Embodied-0.5,该架构建立在集成了视觉编码器和大型语言模型 (LLM) 的基础视觉语言模型 (VLM) 范式之上。为了在增强视觉感知的同时保持与语言能力的平衡(特别是针对边缘部署),该模型引入了几项架构创新。核心视觉编码器是一个高效的、原生分辨率的 Vision Transformer (ViT),即 HY-ViT 2.0,它针对边缘设备部署进行了优化。该模型支持任意输入分辨率,并通过从更大的内部模型进行知识蒸馏来实现鲁棒的感知。它旨在将视觉输入投影到语言嵌入空间,使 LLM 能够处理多模态数据。整体框架围绕 Mixture-of-Transformers (MoT) 设计构建,该设计解耦了视觉 tokens 和文本 tokens 的处理。如下方图所示,MoT 架构采用了模态特定的 Query-Key-Value (QKV) 和 Feed-Forward Network (FFN) 参数,从而实现了模态自适应计算。这种设计在显著提升视觉性能的同时,减轻了因重度视觉训练常导致的语言能力退化。

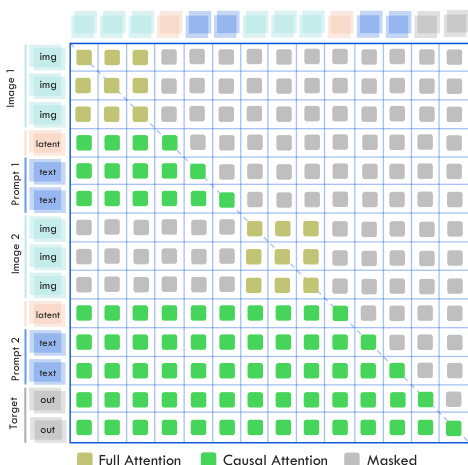

MoT 设计通过模态特定的注意力机制得到了进一步增强。作者为视觉 tokens 引入了一种独特的局部全注意力 (local full-attention) 机制,与用于文本的单向注意力相比,它更适合视觉数据的双向特性。与之互补的是用于文本 tokens 的全局因果注意力机制。MoT 的注意力计算如下图所示,其中视觉和文本 tokens 的不同注意力模式在实际交错的多模态序列下得到了可视化。这种模态特定的注意力对于有效的视觉建模至关重要。

为了进一步改进视觉建模,作者引入了视觉下一代码预测 (visual next-code prediction) 任务。该任务使用由更大的 ViT 生成的离散视觉表示作为监督,其中一个 MLP 模块预测下一个图像 patch 的离散代码。这为视觉分支提供了更强的监督信号。此外,受 latent thinking 和 vision registers 的启发,模型在每个视觉输入序列的末尾附加了专门的、可学习的视觉 latent tokens。这些 tokens 在 pre-training 期间使用来自大型 ViT 的全局特征进行监督,这有助于连接视觉和文本内容,并增强模型的整体感知能力。训练流水线如下图所示,分为两个连续阶段:大规模 pre-training 和有针对性的 mid-training 阶段。pre-training 阶段在海量多模态语料库上建立基础的视觉语言对齐,而 mid-training 阶段则显式增强具身应用的复杂推理能力。

训练策略在 pre-training 期间采用了多目标损失函数,结合了标准的 LLM 损失、用于下一代码预测任务的视觉损失,以及用于将视觉 latent tokens 与整体图像语义对齐的全局损失。视觉损失被公式化为视觉分支预测 logits 的交叉熵损失,而全局损失被定义为 latent token 的映射隐藏状态与来自 teacher ViT 的全局 CLS 特征之间的负余弦相似度。总损失是这三个目标的总和。在随后的 mid-training 和微调阶段,仅优化标准的自回归语言损失。训练方案包括冷启动监督微调 (SFT) 阶段,随后是具身强化学习 (RL) 阶段,以及基于拒绝采样微调 (RFT) 的迭代自我进化训练范式。最后,通过一个从大到小的 on-policy 蒸馏阶段,将精炼的推理行为从大型模型转移到紧凑的部署模型中。

实验

模型在涵盖视觉感知、3D 空间理解和具身智能的 22 个多样化基准测试,以及现实世界机器人控制任务中进行了评估。结果表明,HY-Embodied-0.5 系列实现了最先进的性能,尤其在细粒度空间推理和复杂任务规划方面表现出色。即使是紧凑的 2B 变体也保持了与大得多模型的高竞争力,这表明以具身为中心的架构和专门的训练有效地平衡了效率与先进的推理能力。

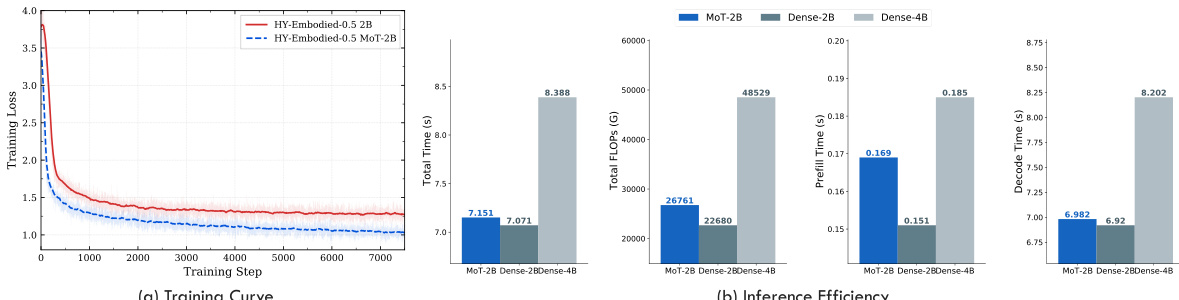

作者评估了 Mixture-of-Tokens (MoT) 架构与标准稠密 transformer 的效率对比。结果显示,MoT 在训练期间实现了更快的收敛,同时保持了相当的推理速度和效率。该模型展示了改进的训练动力学,且没有引入显著的推理时间开销。MoT 架构在训练期间比稠密 transformer 收敛更快;MoT 实现了与稠密模型相当的推理速度,且开销极小;MoT 在保持高效推理时间的同时,更有效地降低了训练损失。

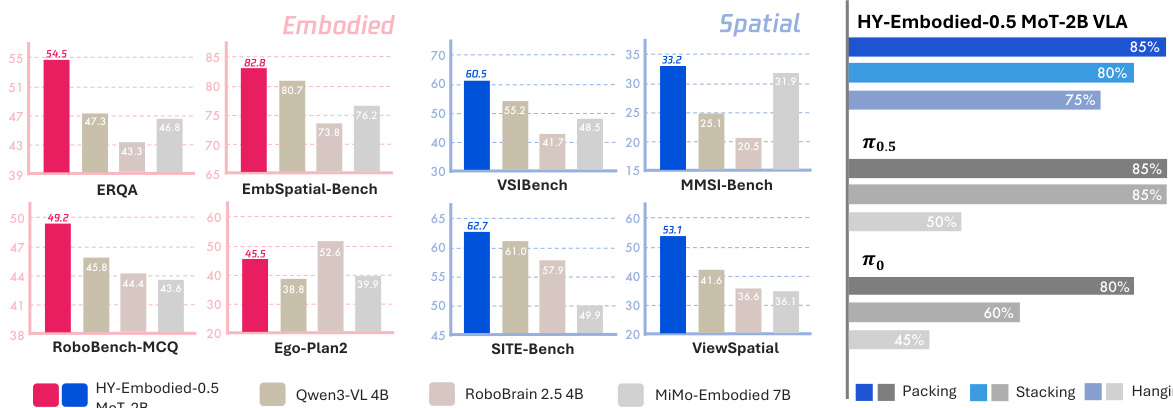

作者在一套涵盖具身和空间理解的基准测试中评估了 HY-Embodied-0.5 MoT-2B。结果显示,该模型在大多数任务中表现强劲,特别是在空间推理方面,尽管体积紧凑,但在面对更大模型时仍保持竞争力。HY-Embodied-0.5 MoT-2B 在大多数具身和空间基准测试中取得了顶尖性能,展示了强大的空间推理能力。该模型在多个任务上优于更大的基准模型,表明其有效性不仅仅源于规模。在真实机器人任务上的结果显示了高成功率,在复杂操作场景中较基准模型有显著提升。

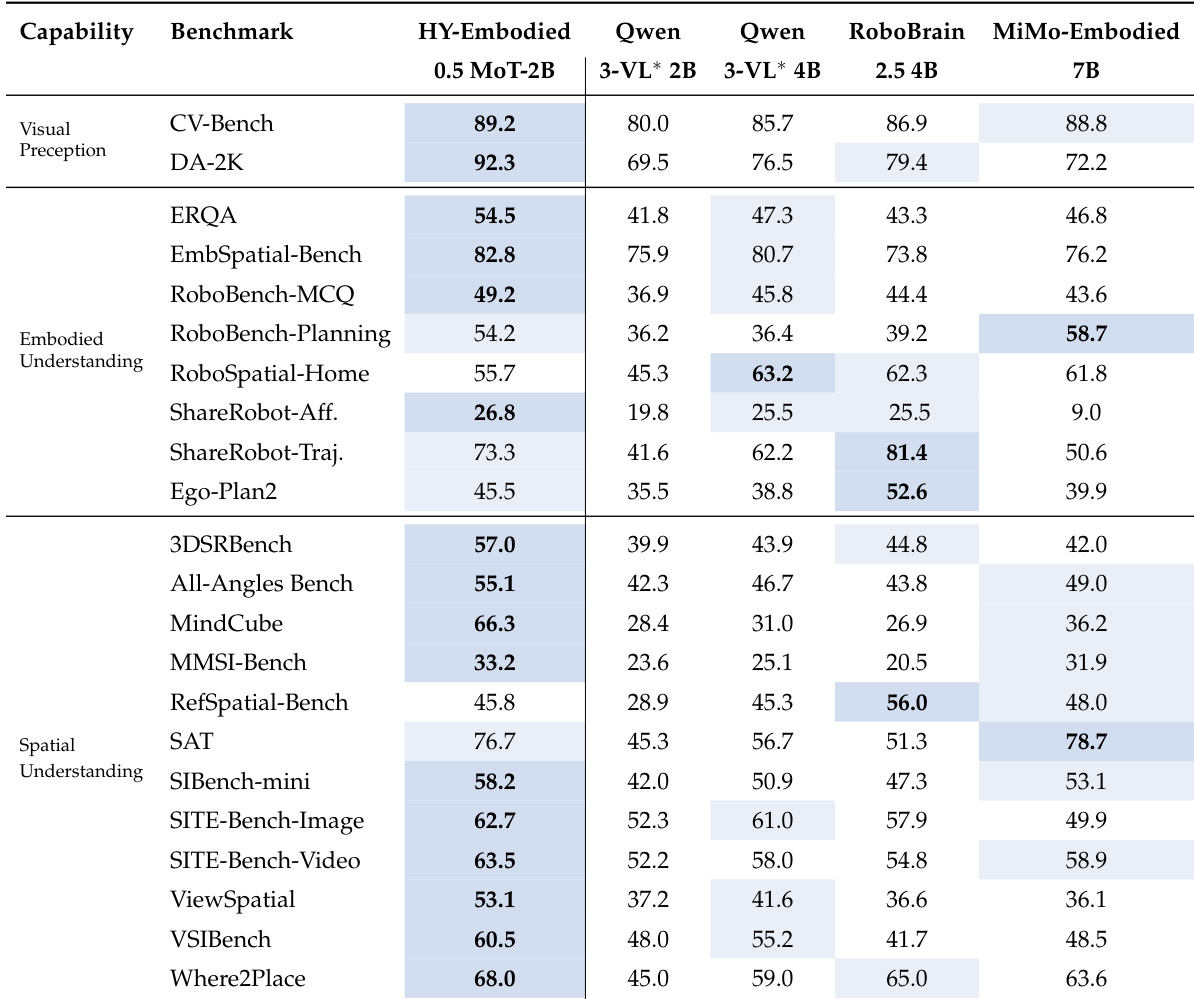

作者在一套包含 22 个基准测试(涵盖视觉感知、具身理解和空间理解)中评估了 HY-Embodied-0.5 MoT-2B。结果显示,该模型在大多数任务上实现了最佳性能,特别是在空间理解方面表现卓越,并尽管体积紧凑,仍展示了强大的具身推理能力。HY-Embodied-0.5 MoT-2B 在大多数基准测试中取得了最佳性能,尤其是在空间理解任务中。该模型在视觉感知、具身理解和空间推理方面表现出强大且一致的性能。HY-Embodied-0.5 MoT-2B 优于更大的基准模型,表明其收益来自于设计选择而非仅仅是规模。

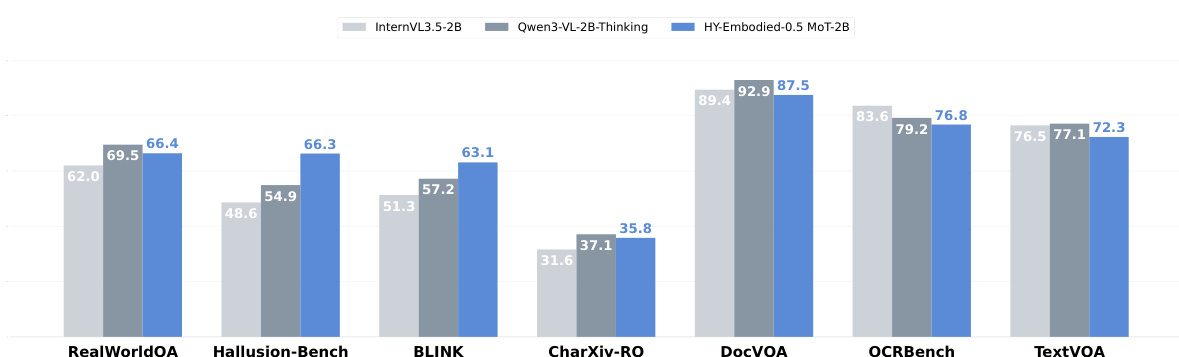

作者在一组通用视觉理解基准测试中,将 HY-Embodied-0.5 MoT-2B 与规模相当的通用 VLMs 进行了比较。结果显示,该模型在各种任务中保持了具有竞争力的性能,证明了其为具身推理进行的专门设计并没有损害其通用视觉能力。与规模相当的通用 VLMs 相比,HY-Embodied-0.5 MoT-2B 在通用视觉理解基准测试中取得了具有竞争力的性能。该模型在需要视觉知识、减轻幻觉和以文本为中心的推理任务上表现良好。尽管针对具身和空间推理进行了优化,该模型在通用视觉任务上仍保持了强劲性能。

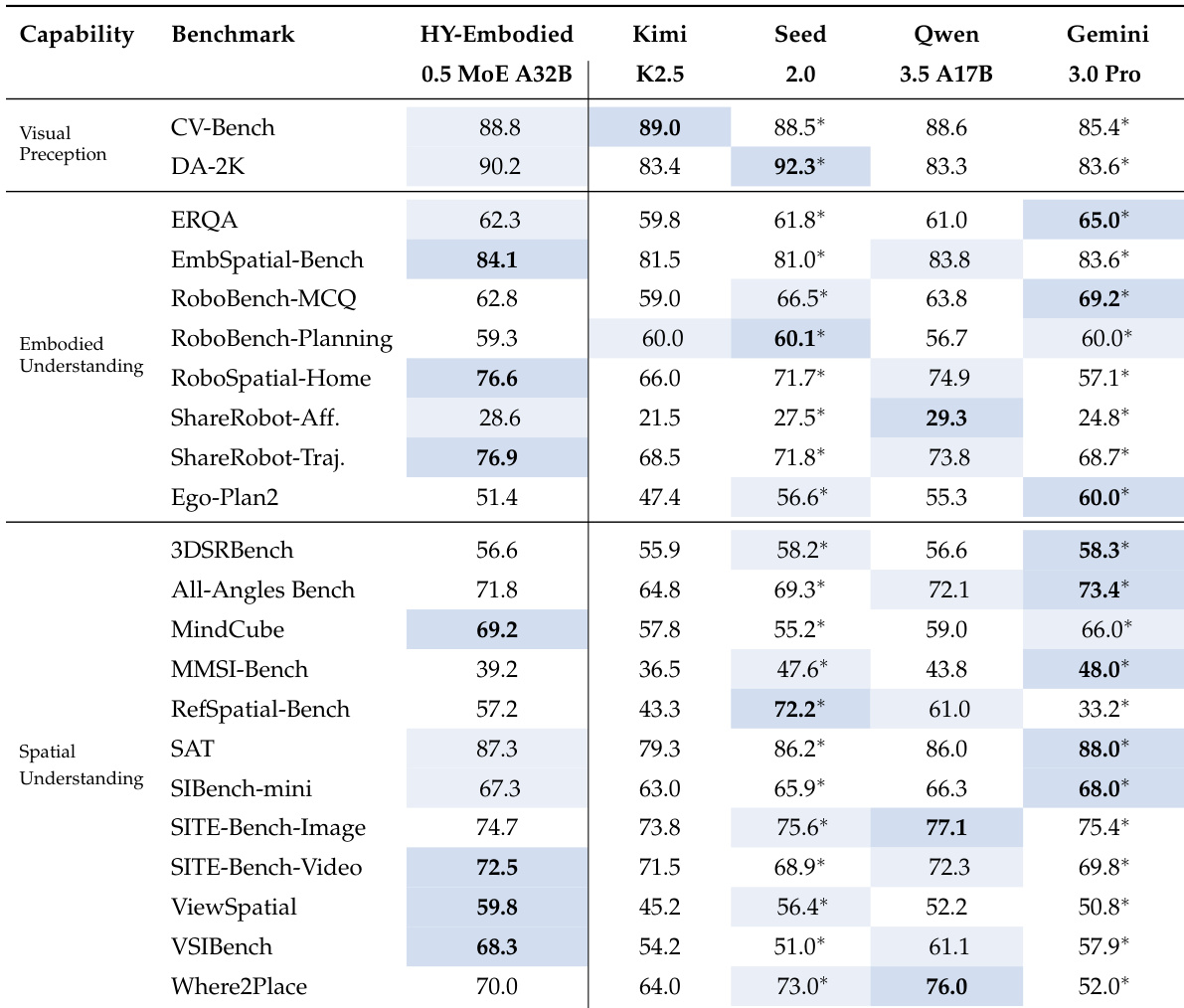

该表将 HY-Embodied-0.5 MoE A32B 的性能与几种最先进的模型在视觉感知、具身理解和空间理解等一系列基准测试中进行了对比。结果显示,HY-Embodied-0.5 MoE A32B 在多个任务中获得了最高分,尤其在空间理解基准测试中表现卓越。该模型在所有类别中都展示了强大的性能,经常超越更大的模型,这表明其优势源于架构和训练设计,而非仅仅是规模。HY-Embodied-0.5 MoE A32B 在多个基准测试中获得了最高分,特别是在空间理解方面,表明其具有强大的空间推理能力。该模型在大多数任务上优于 Gemini 3.0 Pro 和 Kimi K2.5 等更大模型,表明其性能不仅仅取决于模型大小。HY-Embodied-0.5 MoE A32B 在视觉感知和具身理解任务中展现了具有竞争力的结果,展示了平衡且稳健的能力概况。

作者通过效率对比以及在具身、空间和通用视觉理解任务中的广泛基准测试,对 Mixture-of-Tokens (MoT) 架构进行了评估。结果表明,MoT 架构能够在以极小推理开销实现更快训练收敛的同时,提供比更大模型更优越的空间推理和具身能力。此外,这种专门的设计保持了强大的通用视觉性能,证明了模型的有效性源于架构创新,而非仅仅是规模。