Command Palette

Search for a command to run...

重新审视推理 SFT 中的泛化问题:基于优化、数据与模型能力的条件分析

重新审视推理 SFT 中的泛化问题:基于优化、数据与模型能力的条件分析

摘要

在 LLM post-training 领域,一种普遍的观点认为:监督微调(SFT)倾向于记忆,而强化学习(RL)则倾向于泛化。针对使用长 chain-of-thought (CoT) 监督进行推理 SFT 的场景,我们重新审视了这一观点,并发现跨领域泛化并非不存在,而是具有条件的,它受优化动力学(optimization dynamics)、训练数据以及 base model 能力的共同影响。研究发现,一些报道中的泛化失败实际上是欠优化(under-optimization)造成的伪影:跨领域性能在性能下降后,会随着训练时间的延长而恢复并提升(呈现出一种“先下降后恢复”的模式),因此,短时间的训练 checkpoint 可能会低估模型的泛化能力。数据质量与结构同样至关重要:低质量的解决方案会普遍损害泛化性能;而经过验证的长 CoT 轨迹(traces)则能带来持续的跨领域增益。此外,模型能力是核心要素:更强大的模型即使从简单的算术游戏(toy arithmetic game)中,也能内化可迁移的程序化模式(例如回溯机制/backtracking),而较弱的模型则仅仅是在模仿表面的冗长表达。然而,这种泛化具有不对称性:推理能力在提升的同时,安全性(safety)却有所下降。这使得研究问题发生了转向——从“推理 SFT 是否具有泛化性”转变为“在何种条件下以及付出何种代价,推理 SFT 才能实现泛化”。

一句话总结

通过对具有长思维链(long chain-of-thought)监督的推理监督微调(SFT)进行条件分析,本研究挑战了“SFT 缺乏泛化能力”的观点,转而证明跨领域性能是由优化动态、数据质量和 base-model 能力共同塑造的,同时揭示了一种非对称的权衡,即推理能力的提升是以牺牲安全性为代价的。

核心贡献

- 本文识别出了跨领域泛化中的“下降后恢复”(dip-and-recovery)模式,证明了短训练 checkpoint 可能会导致对通过延长优化所能达到的泛化能力的低估。

- 本研究确立了泛化是由数据质量与模型能力相互作用驱动的,表明经过验证的长思维链轨迹和更强的 base models 有助于促进可迁移程序模式的内化。

- 研究揭示了推理与安全性之间的非对称关系,发现通过 supervised fine-tuning 实现的推理性能提升,往往伴随着模型安全性的下降。

引言

在大语言模型(LLM)后训练领域,一个普遍的共识认为 supervised fine-tuning (SFT) 主要导致记忆,而真正的泛化则需要强化学习(RL)。这一区别对于开发能够在不同领域进行复杂推理的模型至关重要。然而,先前的研究往往依赖于较短的训练时长、低质量的数据集或较小的 base models,这可能导致一种错误的结论,即 SFT 本质上无法进行跨领域迁移。

作者通过证明推理 SFT 中的泛化是一种条件属性而非缺失属性,挑战了这一叙事。通过系统分析,他们表明泛化能力的表面失效通常是优化不足(under-optimization)造成的伪影,即性能在训练过程中遵循“下降后恢复”的模式。作者利用受控实验设置揭示了成功的泛化取决于三个关键因素:充分的优化、高质量的长思维链数据以及强大的 base-model 能力。此外,他们还发现了一种非对称的权衡,即通过 SFT 提升的推理能力可能会导致模型安全性的下降。

数据集

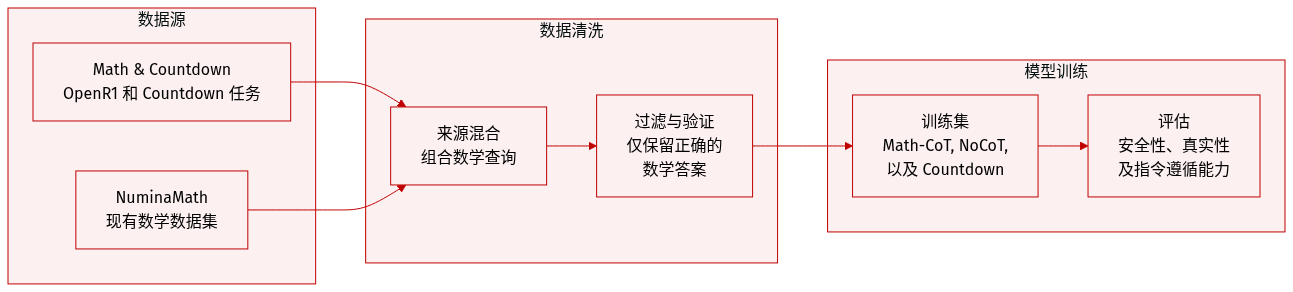

作者利用多个专门的数据集来训练和评估其模型,主要侧重于数学推理和安全对齐。

-

数据集组成与子集

- Math-CoT-20k: 主要训练集,包含 20,480 个数学推理示例。查询(queries)采样自 OpenR1-Math-220k 子集,响应由开启了 thinking 功能的 Qwen3-32B 生成。

- Math-NoCoT-20k: Math-CoT-20k 数据集的衍生版本,通过从响应中移除 thinking 过程创建。

- Countdown-CoT-20k: 包含 20,000 个采样自 Countdown-Tasks-3to4-Unique 的查询,响应由 Qwen3-32B 生成。

- NuminaMath-20k: 一个包含与数学集相同查询的子集,但使用了源自 NuminaMath-1.5 数据集的响应。

-

数据处理与过滤

- 响应生成: 对于 CoT 数据集,作者使用 Qwen3-32B,最大响应长度为 16,384 tokens。生成参数设置为 temperature 0.6, top-p 0.95, top-k 20, 以及 min-p 0。

- 验证与选择: 作者为每个查询生成多个响应,并应用 math-verify 以确保准确性。仅保留答案正确的响应。如果单个查询有多个正确响应,则随机选择其中一个。

-

评估与元数据构建

- 奖励建模: 作者针对不同的评估任务使用特定的 prompt 格式,例如用于指令遵循的 IFEval 格式,以及用于判断 TruthfulQA 真实性和帮助性的专门 prompt。

- 安全对齐: 为了评估策略遵循情况,作者根据 Meta 的使用指南使用结构化评分系统(1 到 5 分)。该过程涉及对用户意图、模型响应对齐情况以及是否存在违禁内容的逐步分析。

方法

作者利用一个旨在评估和提高大语言模型在多样化任务中推理能力和事实一致性的框架。整体架构由三个主要部分组成:优化动态、训练数据策划和模型能力评估,每个部分分别解决模型行为和性能的不同方面。

参考框架图

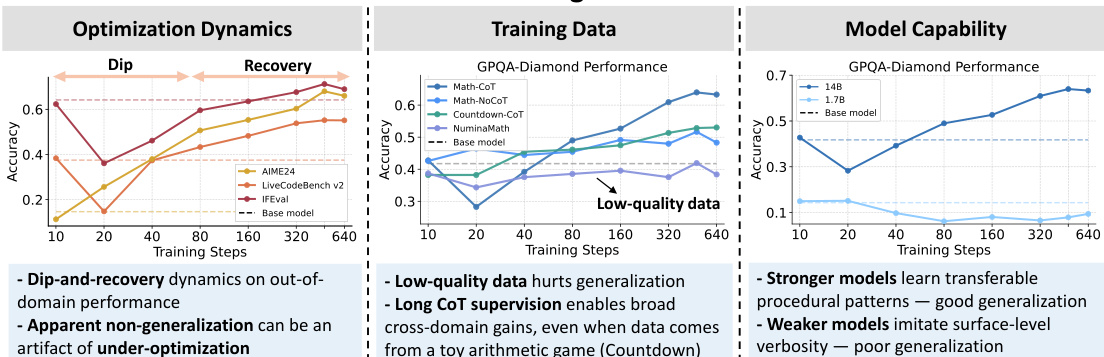

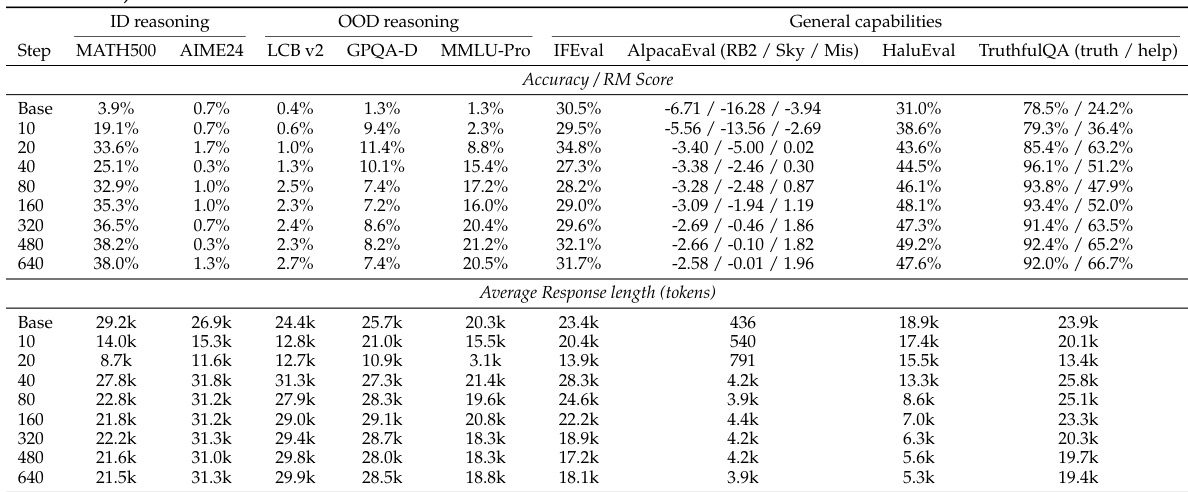

训练数据面板评估了数据质量对模型性能的影响。它表明低质量数据会显著损害泛化能力,特别是对于在这些数据集上训练的模型。相比之下,长思维链(CoT)监督能够实现广泛的跨领域泛化,即使数据源自像 Countdown 这样的简单算术游戏。这证明了训练信号的质量和结构对于在不同领域实现稳健性能至关重要。

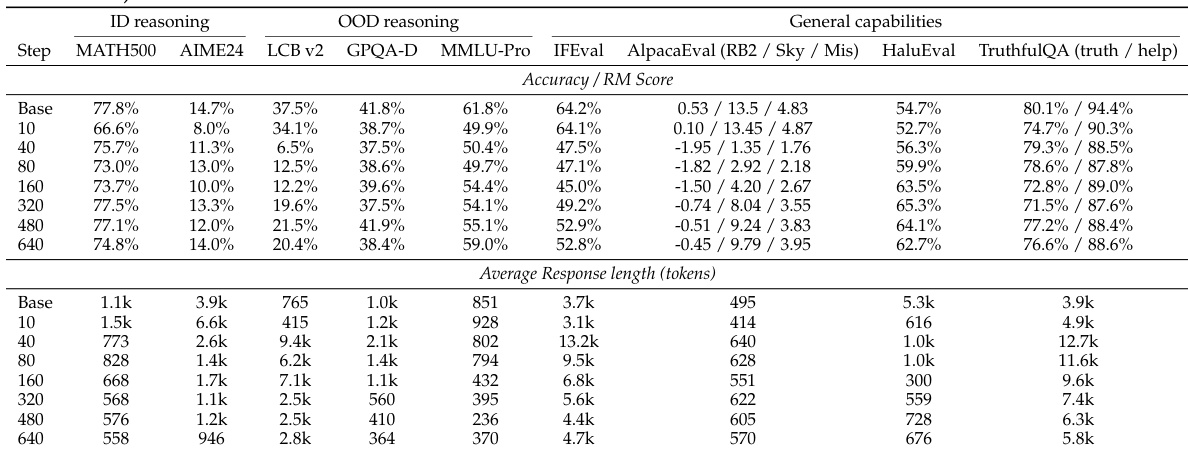

模型能力面板评估了不同模型规模如何影响在 GPQA-Diamond 基准测试上的性能。较大的模型表现出对可迁移程序模式更强的学习能力,从而实现良好的泛化;而较弱的模型则倾向于模仿表层的冗长性(verbosity),导致泛化效果较差。这表明模型容量在从训练数据中提取并应用有意义的推理模式的能力方面起着至关重要的作用。

该框架还结合了特定任务的模板来生成评估数据。例如,使用 GPQA Diamond 生成模板来创建需要逐步解释的多选题推理问题。类似地,HaluEval 模板旨在通过将模型输出与已知事实进行比较,来检测问答、对话和摘要场景中的幻觉。这些模板确保了评估的标准化,并专注于模型行为的特定方面,如事实准确性和推理连贯性。

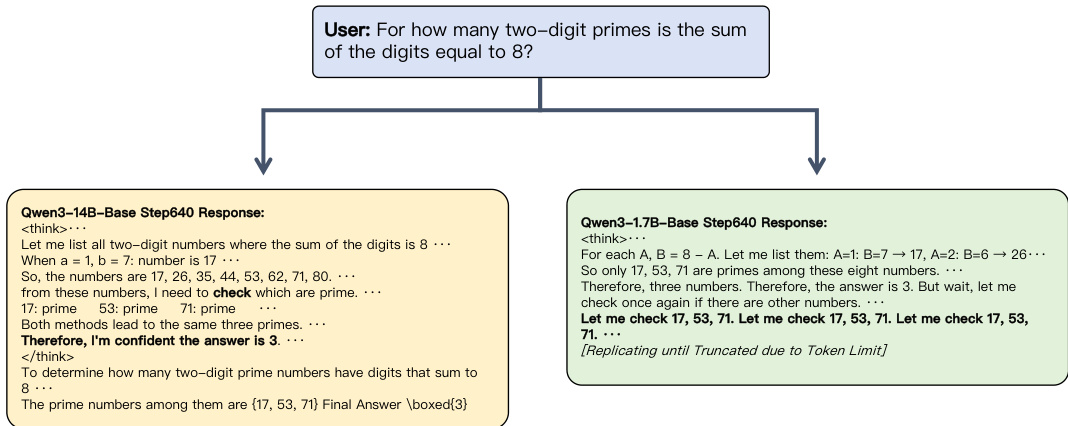

作者通过示例进一步展示了模型的行为。如下图所示:

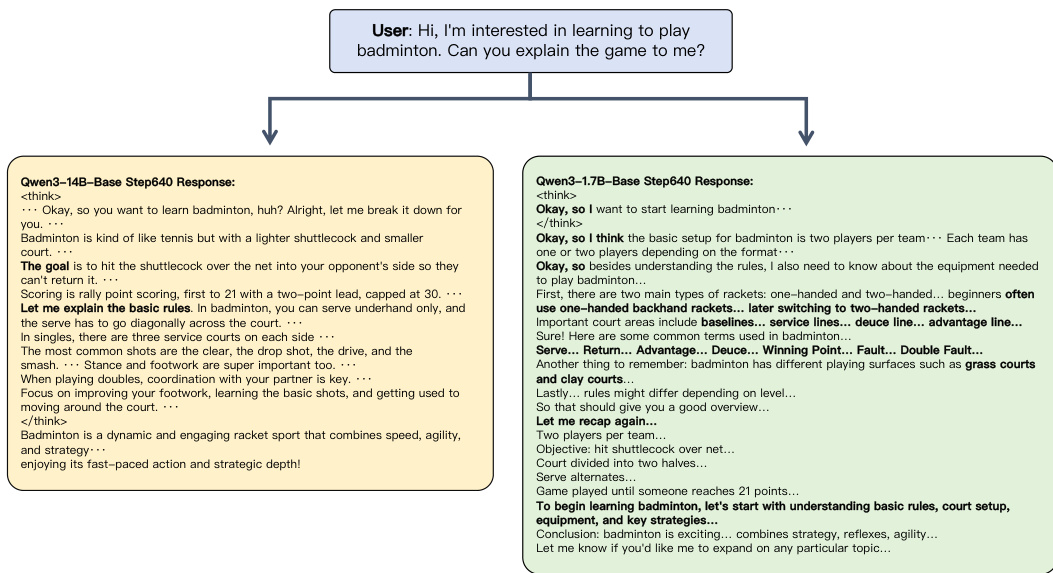

另一个示例展示了模型在对话中处理事实和程序性知识的能力。如下图所示:

这些示例强调了模型规模和训练数据质量在实现准确推理和事实一致性方面的重要性。该框架允许对这些因素进行系统评估,为不同模型架构和训练方法的优缺点提供见解。

实验

实验评估了优化、数据质量和模型规模对长思维链(CoT)推理 SFT 泛化的影响。通过在域内数学和域外推理任务上测试各种 base models 和训练计划,研究揭示了感知的泛化限制通常是优化不足的伪影,而非内在缺陷。研究结果表明,成功的跨领域迁移需要高质量的程序性数据、足够的训练轮数(epochs)以及更高的 base-model 能力,从而从浅层的模式模仿转向内化的推理。

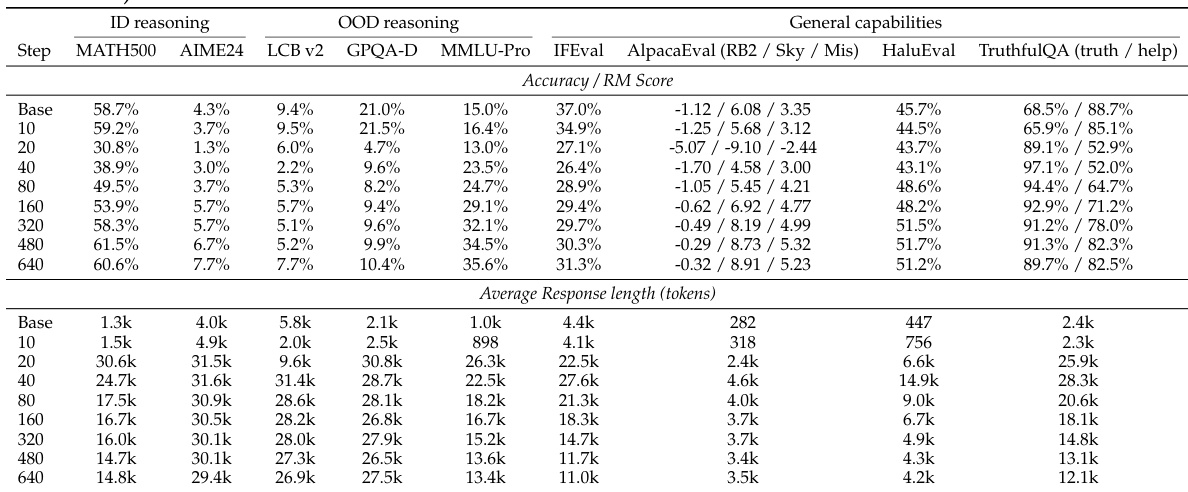

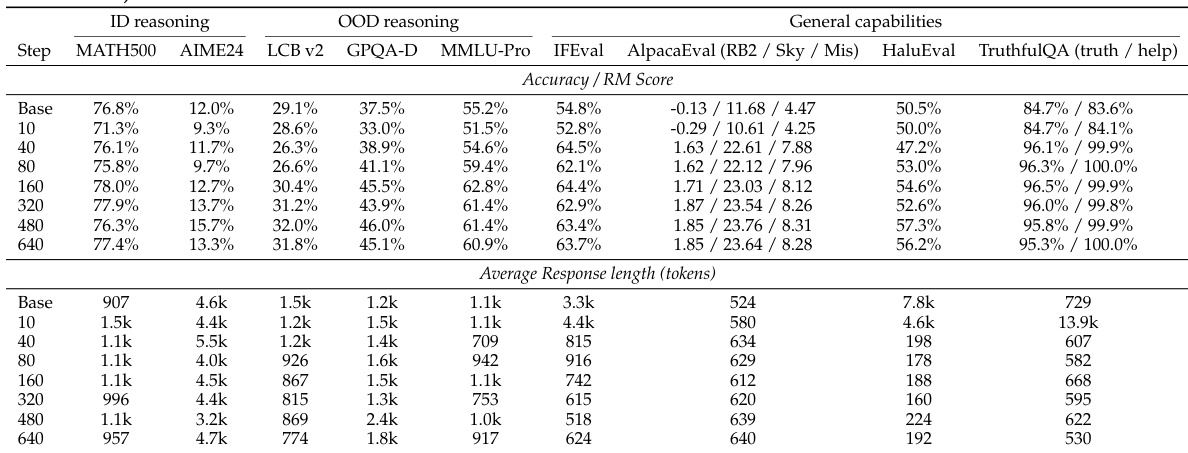

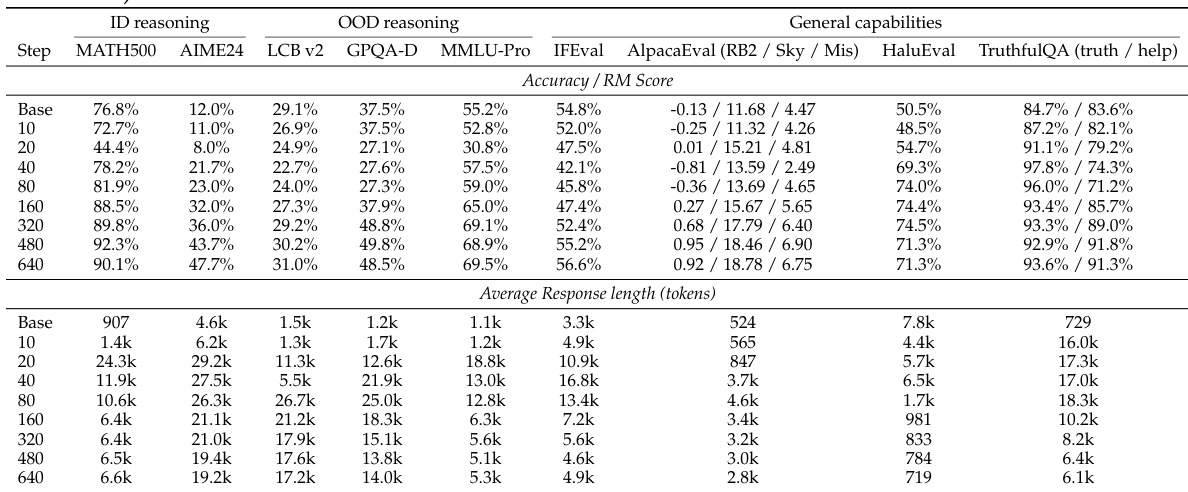

作者检查了推理 SFT 的训练动态,观察到基准测试性能呈现“下降后恢复”的模式,且响应长度也相应地出现上升和下降。这表明,为了让模型超越表层模仿并实现更好的跨领域泛化,延长训练是必要的,且较大的模型表现出更强、更高效的学习能力。性能在各基准测试中呈现“下降后恢复”的模式,域内和域外任务在初始下降后均有所提升。响应长度在训练早期增加,随后减少,可作为优化进度的诊断指标。较大的模型实现了更好的泛化并收敛更快,而较小的模型则处于较长时间的响应阶段。

作者使用长 CoT 推理 SFT 设置在数学推理数据上训练模型,观察到各基准测试性能呈现“下降后恢复”的模式。响应长度最初增加然后减少,作为优化进度的诊断。与较小的模型相比,较大的模型表现出更好的泛化能力和更高效的学习。在经过延长训练后,域内和域外任务的性能在初始下降后均有所恢复。响应长度在训练早期上升,随后下降,表明从表层模仿向深度推理的转变。与较小的模型相比,较大的模型实现了更好的泛化,并在较短的响应长度下趋于稳定。

实验追踪了模型性能和响应长度随训练步数的变化,显示在大多数基准测试上呈现“下降后恢复”的模式。性能在提升前先出现下降,而响应长度在早期增加后减少,表明了优化进程。训练期间,性能在各基准测试中呈现“下降后恢复”的模式。响应长度最初增加然后减少,与性能变化相关。与较小的模型相比,较大的模型实现了更好的泛化和更短的响应长度。

实验研究了长思维链监督微调在不同训练步数下对模型性能和响应长度的影响。结果显示,基准测试性能呈现“下降后恢复”的模式,响应长度先激增后下降,体现了优化动态。这些趋势在各种模型和任务中均有观察到,表明优化不足可能解释了此前关于泛化能力有限的报告。训练期间,域内和域外基准测试的性能均呈现“下降后恢复”的模式。响应长度在训练早期增加随后减少,与性能变化相关。这些趋势在不同模型和训练数据中保持一致,表明这是一种普遍的优化现象。

实验追踪了模型性能和响应长度随训练步数的变化,显示在各基准测试中呈现“下降后恢复”的模式。性能在提升前先下降,而响应长度在早期增加后减少,表明了优化动态。较大的模型表现出更强的泛化能力和更快的收敛速度。训练期间,所有基准测试的性能均呈现“下降后恢复”的模式。响应长度在早期增加随后减少,与性能变化相关。较大的模型表现出更强的跨领域泛化能力和更快的响应长度稳定速度。

作者通过追踪不同模型规模下的基准测试性能和响应长度,研究了长思维链监督微调的训练动态。实验揭示了性能中一致的“下降后恢复”模式以及响应长度相应的升降,表明延长训练对于模型从表层模仿过渡到真实推理至关重要。最终,与较小的模型相比,较大的模型展示了卓越的跨领域泛化能力和更高效的优化。