Command Palette

Search for a command to run...

长上下文视觉文档理解中的内化推理机制

长上下文视觉文档理解中的内化推理机制

Austin Veselka

摘要

视觉长文档理解对于企业、法律及科学应用至关重要,然而目前性能最优的开源方案尚未对推理(reasoning)能力进行探索——而正是推理能力驱动了数学和代码性能的飞跃。我们引入了一种用于长文档理解推理的合成数据 pipeline,该 pipeline 通过对每一页进行问题相关性评分,提取文本证据并按相关性从高到低进行排序,从而生成思维链(thinking traces)。我们对生成的标签内 traces 进行 SFT(监督微调),并使用控制 token 进行门控;随后通过低强度模型合并(low-strength model merging)实现推理能力的内化。我们对 Qwen3 VL 32B 和 Mistral Small 3.1 24B 进行了研究。实验结果显示,在使用 Qwen3 VL 时,我们在 MMLongBenchDoc 上达到了 58.3 分,超越了参数量大 7 倍的 Qwen3 VL 235B A22B(57.0)。在使用 Mistral 时,我们证明了合成推理在 MMLBD-C 上的表现比从 Thinking 版本 traces 中进行蒸馏(distillation)高出 3.8 分,且与显式推理(explicit reasoning)相比,内化推理的平均输出 tokens 减少了 12.4 倍。为了便于复现和进一步探索,我们开源了该 pipeline。

一句话总结

针对关键的企业、法律和科学应用,作者引入了一种用于长上下文视觉文档理解内部化推理的合成数据流水线,该流水线生成有序的思考轨迹以进行监督微调和低强度模型合并,使 Qwen3 VL 32B 在 MMLongBenchDoc 上达到 58.3 分,超越 7 倍大的 Qwen3 VL 235B A22B (57.0),并允许 Mistral Small 3.1 24B 在 MMLBD-C 上比 Thinking 版本的轨迹蒸馏高出 3.8 分,同时比显式推理少 12.4 倍的平均输出 token。

核心贡献

- 论文介绍了一种用于长文档推理的合成数据流水线,通过评分页面相关性和排序文本证据生成思考轨迹。这种方法将递归答案生成扩展到专门针对长文档视觉问答任务训练推理模型。

- 通过在门控轨迹上进行监督微调以及低强度模型合并,实现了推理能力的内部化,允许通过 token 进行因果开关控制。该方法在不修改架构的情况下实现了内部化,同时在 24B 到 32B 参数规模下运行。

- 实验表明,该模型在 Qwen3 VL 上在 MMLongBenchDoc 上达到 58.3 分,超越 7 倍大的变体,而内部化推理将平均输出 token 减少 12.4 倍。该流水线已发布以供复现和进一步探索合成推理。

引言

长上下文视觉语言模型能够在法律和金融等关键领域对文档执行复杂操作,但当前系统由于问答任务中缺乏高信号奖励,未能有效利用推理能力。虽然前沿模型显示无论思考模式如何性能相当,但之前的隐式推理工作仍局限于较小规模或更简单的任务,且未确认主动推理的优势。作者通过引入一种合成数据流水线来解决这一差距,该流水线通过页面级证据提取和相关性评分生成结构化推理轨迹。他们训练大型视觉语言模型并利用低强度模型合并来内部化这些能力,证明隐式推理是一种主动的推理时技能,而非训练产物。

数据集

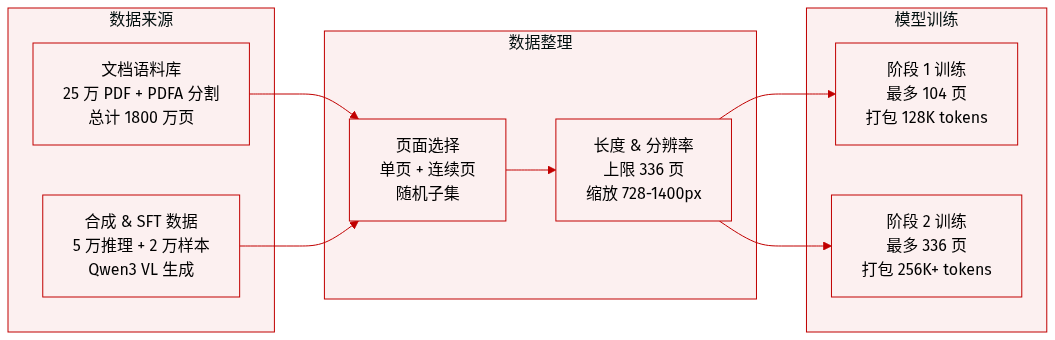

数据集构成与来源

- 作者从 25 万 PDFs 和 PDFA 英文分割集构建文档语料库,涵盖 200 万 PDFs 和 1800 万页。

- 他们增加了 5 万个合成推理示例和来自 Luth 和 Smoltalk2 数据集的 2 万个外部 SFT 样本。

子集细节与统计

- 主语料库文档平均 34 页,而 PDFA 文档平均 8.6 页,所有文档上限为 336 页。

- 组合数据集平均每示例 57.9 页,中位数为 16.0 页。

- 合成 QA 对使用 Qwen3 VL 32B Instruct 进行提取,使用 Qwen3 VL 235B A22B 进行答案生成。

- 内容包括单页、连续页面子集和随机页面子集。

训练用途与混合

- 训练分两个阶段进行,分别针对最多 104 页和 336 页的示例。

- 团队采用无截断的序列打包,并按 assistant token 数量归一化损失。

- 在长阶段,Mistral 的上下文限制达到 336K token,Qwen3 VL 为 256K token。

处理与分辨率策略

- 当完整文档不适合上下文时,文档分辨率从 728 到 1400 像素动态缩放。

- CPT 向量与 instruct 模型合并,Qwen3 VL 强度为 0.25,Mistral 为 0.5。

- 外部 SFT 样本遵循参考表中的归一化分布混合。

方法

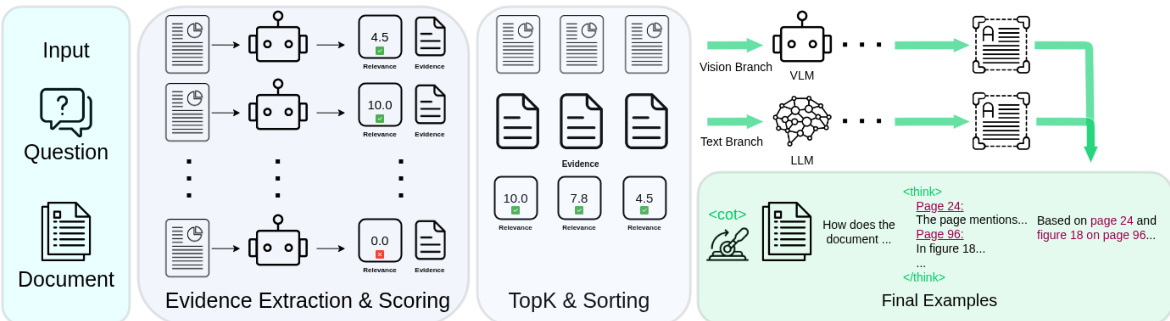

作者利用一种设计用于生成长文档理解结构化推理轨迹的合成数据流水线。完整过程如下图所示。

该流水线处理由 N 张页面图像和一个问题 Q 组成的文档,分为两个不同阶段。在第一阶段,证据提取与评分,提取器 VLM 独立处理每一页以及问题。对于每一页,模型提取包含相关内容或视觉描述的自然语言证据片段,并在 [0, 10] 尺度上分配相关度分数。为了引导提取,属于问题源集的页面被明确标识,确保它们获得 [6.0, 10.0] 之间的分数。处理完所有页面后,低于相关度阈值的配对被丢弃,剩余配对按相关性排名以保留 top-K 条目。

第二阶段涉及通过两个并行分支进行答案生成,以确保信息的全面覆盖。视觉分支利用教师 VLM,接收排名靠前的页面图像和问题,直接从视觉内容生成答案。相反,文本分支采用教师 LLM,仅接收提取的证据片段和问题,在不访问页面图像的情况下生成答案。这种双分支方法在文本分支中强制执行推理轨迹与答案之间的依赖关系,同时在视觉分支中将答案基于完整视觉内容。

训练示例以统一格式构建,无论生成分支如何。每一页和证据片段都带有其 1 索引位置前缀,以促进来源关联。<cot> 控制 token 在系统提示中门控推理轨迹。在 95% 的训练示例中,提供 <cot> token,助手响应以包含有序证据片段的 <think> 块开始,随后是最终答案。其余 5% 的示例排除控制 token 和推理轨迹,以允许在推理时进行模式切换。

为了内部化这种推理能力,作者采用模型合并,定义为 θmerged=θbase+α⋅(θSFT−θbase)。通过使用低合并强度(α=0.25),生成的模型保留了推理轨迹的性能优势,而无需在推理期间生成显式思考 token,有效地将合成推理过程压缩到模型权重中。

实验

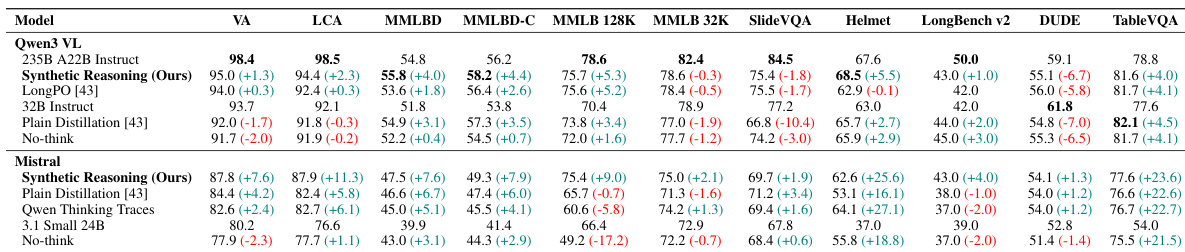

该研究评估了跨 MMLBD 和 MMLongBenchDoc 等长文档基准的合成推理流水线,以验证其在视觉问答任务中的有效性。实验表明,这种方法允许较小的模型通过内部化推理能力来实现最先进的性能,这些能力作为可控的推理时特性运行,而不是依赖显式思考 token。此外,消融分析证实,特定的轨迹设计改进和控制 token 门控对于优于标准思考轨迹和非推理基线至关重要。

作者提出了一种合成推理流水线,在长文档 VQA 基准上实现了最先进的结果,允许较小的模型超越显著更大的对应模型。该方法在模型家族之间表现出强大的泛化能力,始终优于普通蒸馏和 LongPO 等基线。所提出的方法在 Qwen 和 Mistral 模型家族中均实现了最高的 VA 和 LCA 分数。利用该流水线的较小模型在主要长文档基准上超越较大模型。该方法优于在较大模型思考轨迹上训练的基线。

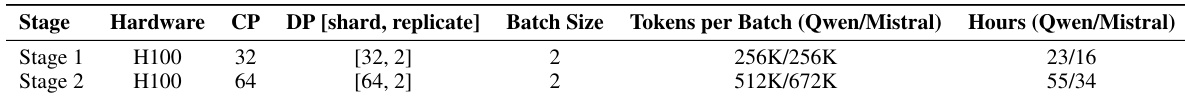

作者详细说明了其合成推理流水线在两个阶段的训练配置,利用 H100 硬件并增加并行度和批量大小。该设置比较了 Qwen 和 Mistral 模型家族的计算需求和吞吐量,显示了训练时长和 token 处理能力的显著差异。结果表明,Mistral 配置实现了更高的每批次 token 吞吐量,同时比 Qwen 配置所需的训练时间显著更少。训练分两个阶段进行,第二阶段增加了并行度和 token 容量。Mistral 模型家族所需的总训练时间比 Qwen 家族少。Mistral 配置在第二个训练阶段每批次处理了更大体积的 token。

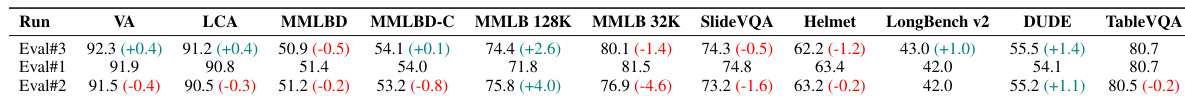

该表比较了不同实验运行的评估结果,揭示了相对于基线的显著性能变化。一个运行始终优于基线,在视觉问答和长上下文理解方面获得正向增益,而另一个运行显示大多数任务分数普遍下降。一个实验运行在视觉问答和长上下文基准方面相比基线实现了正向改进。一个单独的运行显示出性能显著下降,特别是在涉及更长上下文长度的任务中。结果强调模型性能对特定运行配置高度敏感,视觉和文档理解分数存在显著差异。

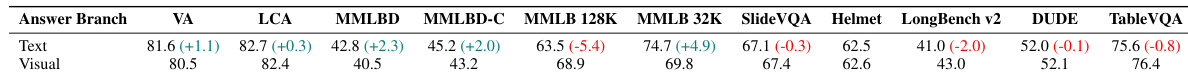

作者比较了文本和视觉答案分支在一系列基准上的性能,以确定合成推理的最佳来源。结果表明,文本分支在文档理解任务上通常优于视觉分支,而视觉分支在特定长上下文基准上显示出优势。文本分支在 VA、LCA、MMLBD 和 MMLBD-C 指标上获得比视觉分支更高的分数。视觉分支在 MMLB 128K 基准上显著优于文本分支。在 SlideVQA、Helmet 和 TableVQA 等基准上,两个分支之间的性能差距可以忽略不计。

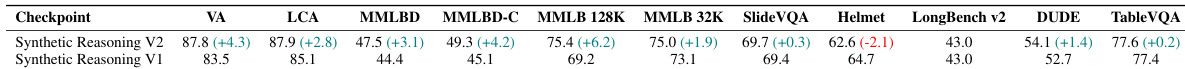

作者评估了合成推理流水线的两个版本,证明 V2 检查点在广泛的基准上显著优于 V1 基线。这一改进由轨迹重新设计驱动,解决了推理循环问题并更好地强调页面相关性。虽然 V2 模型在包括视觉问答和长上下文理解在内的大多数任务上获得更高分数,但在 Helmet 等特定数据集上性能略有变化。V2 检查点在视觉问答和长文档基准上显示出对 V1 的一致改进。V2 中推理轨迹的重新设计解决了之前的失败模式,如无限循环。在大多数类别中观察到性能增益,尽管在 Helmet 基准上看到轻微下降。

作者评估了一种合成推理流水线,该流水线使较小模型能够在多样化的模型家族中在长文档 VQA 基准上超越较大对应模型。对比实验显示,训练效率因配置而异,但文本分支通常在文档理解任务上优于视觉分支。此外,V2 流水线迭代通过解决推理问题显示出对 V1 的显著改进,证实了该方法的强大泛化能力和优于现有基线的优越性。