Command Palette

Search for a command to run...

潜空间:基础、演进、机制、能力与展望

潜空间:基础、演进、机制、能力与展望

摘要

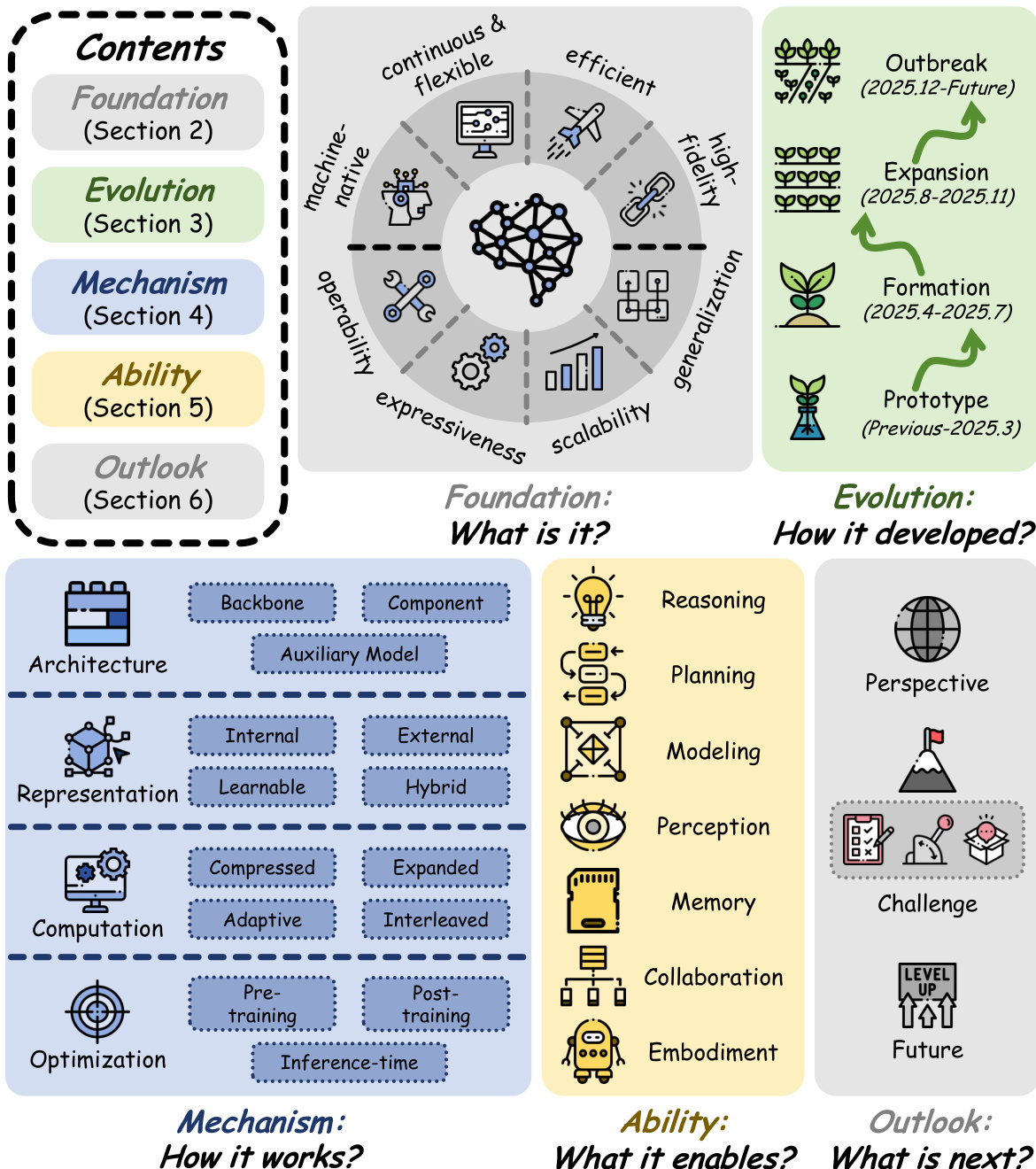

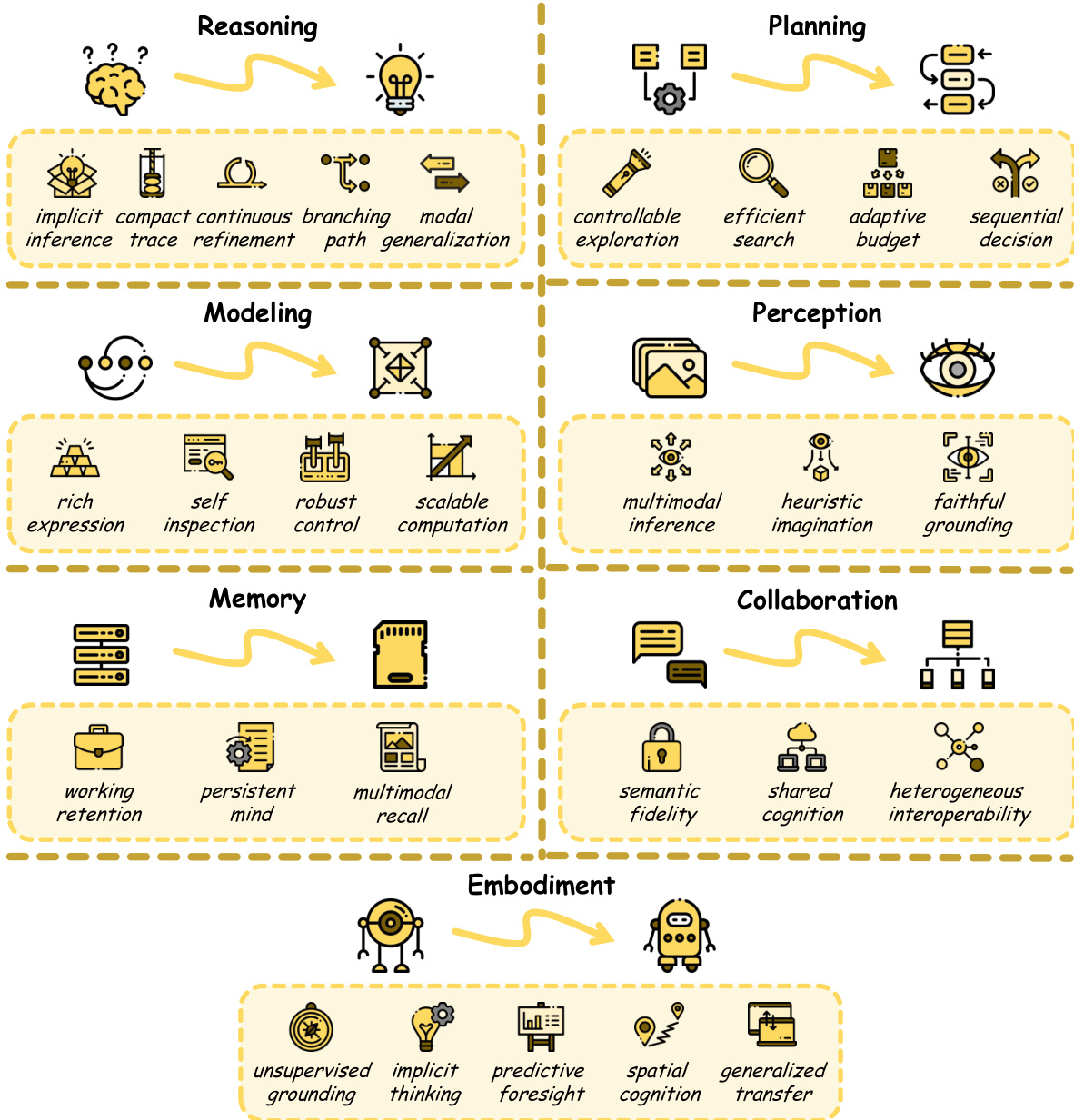

潜空间正迅速成为基于语言模型的天然基础。尽管现代系统通常仍被理解为在显式词元(token)层面进行生成,但越来越多的研究表明,许多关键内部过程在连续潜空间中执行,比在人类可读的语言痕迹中更为自然。这一转变由显式空间计算的结构性局限所驱动,包括语言冗余、离散化瓶颈、序列低效性以及语义丢失。本文旨在提供关于语言模型中潜空间的统一且最新的综述图景。我们将综述组织为五个递进的视角:基础(Foundation)、演进(Evolution)、机制(Mechanism)、能力(Ability)与展望(Outlook)。首先,我们界定潜空间的范畴,将其与显式或语言空间区分开来,并区别于生成式视觉模型中常见的潜空间。随后,我们追溯该领域从早期探索性研究到当前大规模扩展的演进历程。为梳理技术格局,我们分别从机制与能力两个互补视角审视现有工作。从机制视角出发,我们识别出四条主要发展脉络:架构(Architecture)、表示(Representation)、计算(Computation)与优化(Optimization)。从能力视角出发,我们展示了潜空间如何支撑涵盖推理(Reasoning)、规划(Planning)、建模(Modeling)、感知(Perception)、记忆(Memory)、协作(Collaboration)与具身(Embodiment)的广泛能力谱系。除整合现有成果外,本文还探讨了关键开放挑战,并勾勒出未来研究的前瞻方向。我们期望本综述不仅可作为现有工作的参考,更能成为理解潜空间作为下一代智能通用计算与系统范式的基石。

一句话总结

来自新加坡国立大学、复旦大学、清华大学及其他顶尖机构的研究人员提出了一项关于语言模型中潜在空间的统一综述,引入了机制与能力的二维分类法,以整合碎片化的文献,并指导推理、感知和具身智能领域的未来研究。

主要贡献

- 本文提出了一个统一的综述框架,围绕五个连续视角——基础、演进、机制、能力和展望——组织,以整合关于语言模型中潜在空间的碎片化文献。

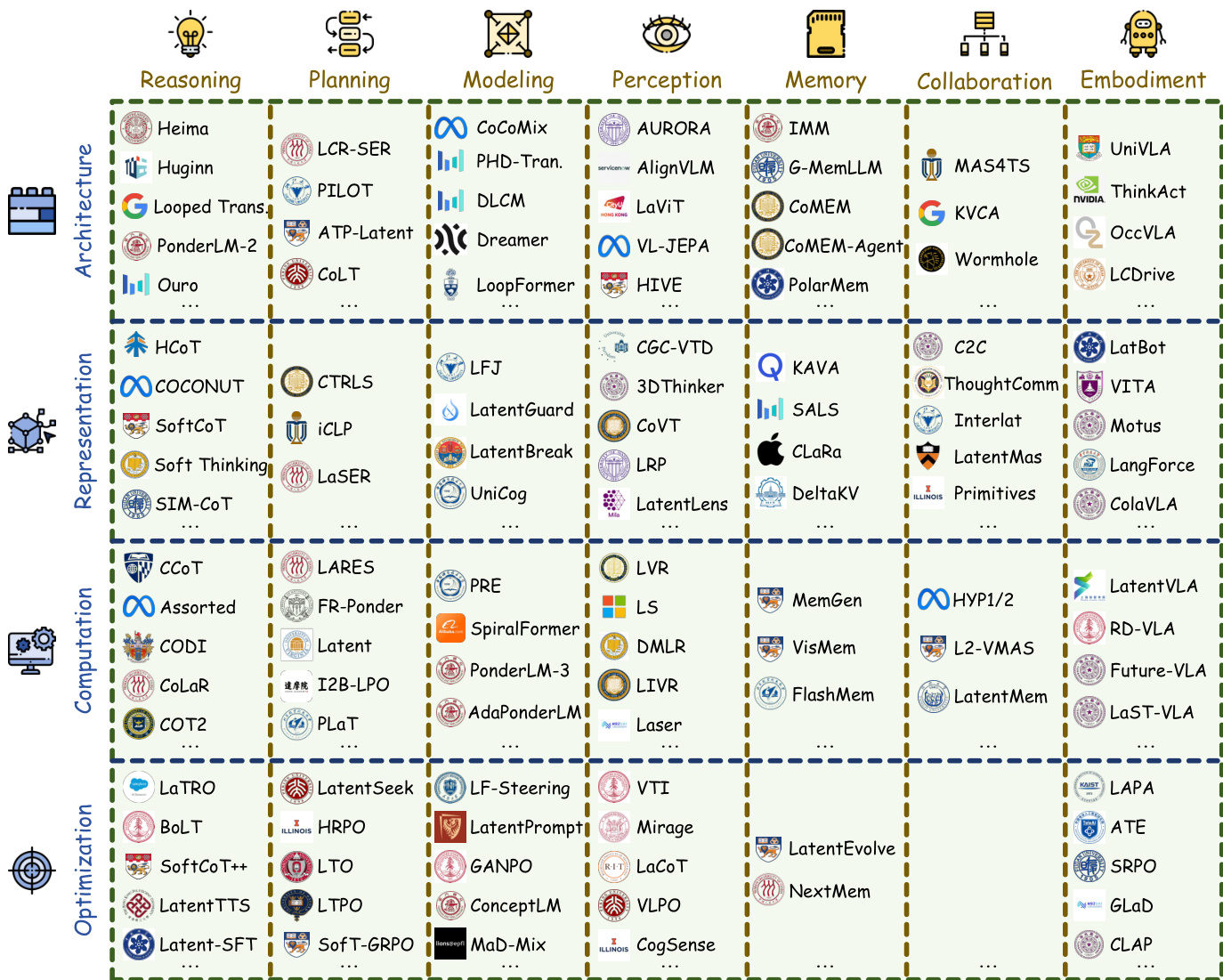

- 该工作提出了一个全面的技术分类法,将现有方法分为四类机制(架构、表示、计算、优化)和七个能力领域(推理、规划、建模、感知、记忆、协作、具身)。

- 该研究通过区分潜在空间与显式词元级生成及视觉生成模型,界定了潜在空间的概念范围,同时概述了下一代智能面临的开放挑战和未来研究方向。

引言

语言模型正日益从显式的词元级生成转向连续潜在空间作为原生计算基底,这一转变旨在克服语言冗余、离散化瓶颈以及语言痕迹固有的序列低效性。先前的研究大多局限于特定任务(如潜在推理或视觉理解),缺乏一个统一的框架来分类该领域涌现的多样化机制和能力。作者通过提供一份全面的综述填补了这一空白,将研究版图组织为五个连续视角,并引入基于技术机制和功能能力的二维分类法,以指导未来研究。

方法

作者提出了一个统一框架,用于分类潜在空间在现代语言系统中的实例化与操作方式。这一以机制为导向的分类法将多样化的方法沿四个互补轴进行组织:架构、表示、计算和优化。如框架图所示,这些维度共同定义了潜在空间方法的设计空间,阐明了潜在变量是如何构建、处理和优化的。

架构轴描述了潜在空间在模型中的结构角色。根据潜在计算嵌入的位置,方法被分为三类。首先,基于主干(Backbone-based)的方法通过循环、回路或递归结构赋予主模型原生的潜在能力,使潜在操作成为架构本身的基元。其次,基于组件(Component-based)的方法保留原始主干,但通过功能模块对其进行增强,这些模块负责构建、转换、存储或检索潜在表示。第三,基于辅助模型(Auxiliary Model-based)的范式利用额外模型提供监督信号或中间特征,以引导或补充主模型。代表性工作在这些架构选择下的分类详见网格图。

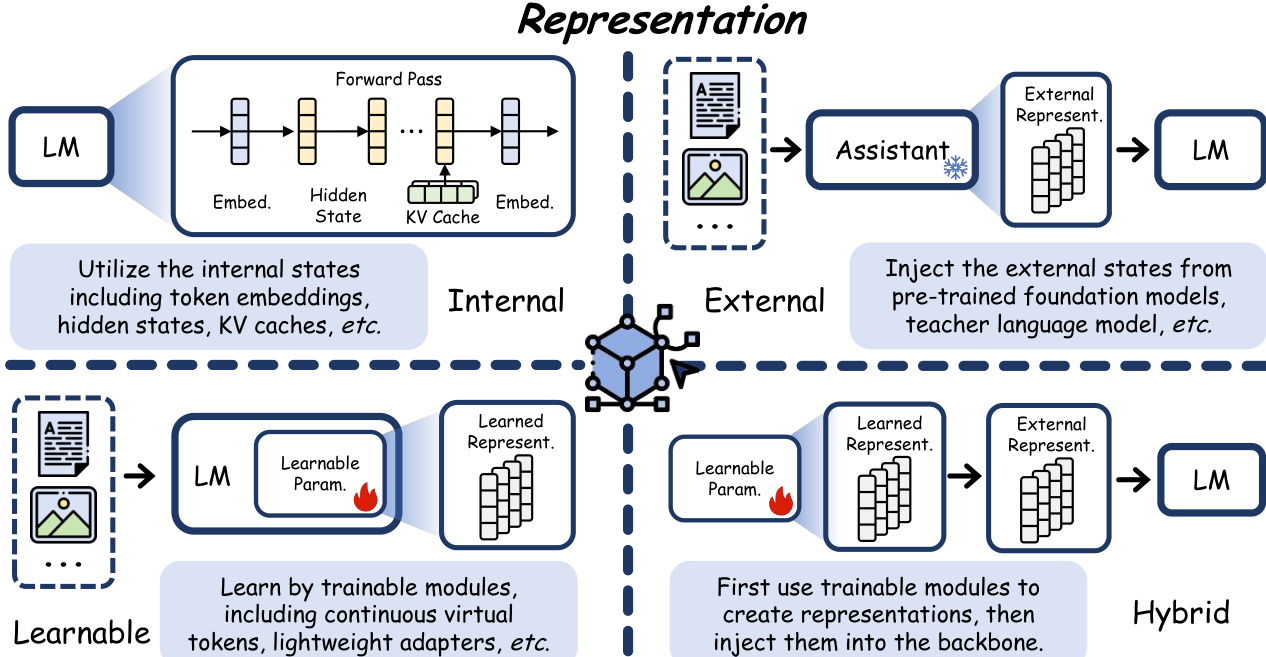

表示轴描述了潜在变量的形式,区分了信息是如何编码和整合的。内部表示直接作用于主干前向传播过程中产生的激活值(如词元嵌入或隐藏状态),不引入额外参数。外部表示源自结构独立的辅助系统,并作为条件输入注入主干。可学习表示由嵌入主干并端到端优化的专用可训练模块构建。混合表示结合了可学习与外部范式,首先使用可训练模块创建专用表示,然后将其作为外源信号注入。示意图展示了这四种子类型及其数据流。

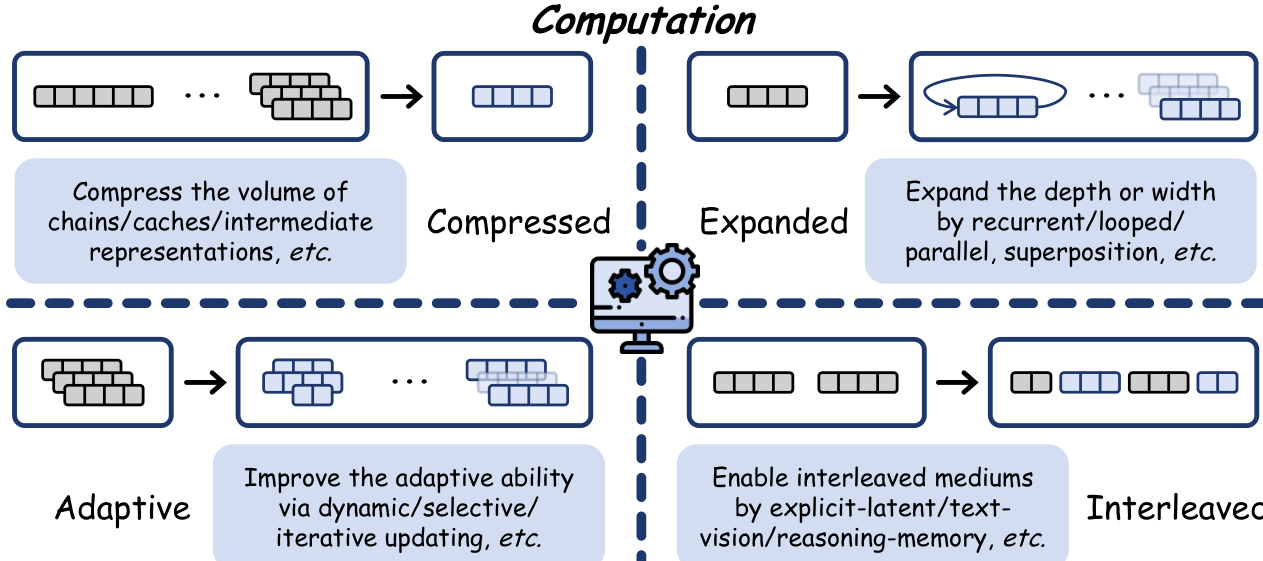

计算轴捕捉了潜在空间如何参与信息处理。压缩计算通过减少显式痕迹或内部状态的体积来提高效率,同时保持表达能力。扩展计算通过在深度或宽度维度扩展潜在过程(如通过循环或并行设计)来增加有效容量。自适应计算根据输入复杂度动态分配资源,灵活地平衡容量与效率。交错计算桥接了异构生成介质,在离散词元和连续潜在变量之间交替,从而结合显式的可解释性与隐式的强大能力。相应的示意图概述了这四种计算策略。

优化轴关注潜在空间何时以及如何被诱导、对齐或优化。预训练方法从随机初始化的模型开始,从头训练以启用原生的潜在级能力。后训练利用多样化的监督信号和目标来增强预训练模型学习潜在空间的能力。推理时方法专注于测试期间对潜在状态的操作,允许在不修改模型权重的情况下进行动态调整。概览表总结了每个优化阶段的监督、目标和场景。

实验

- 对潜在空间与传统显式(语言)空间进行了比较分析,以阐明潜在表示的独特特征。

- 实验验证了当利用潜在空间而非显式空间时,语言模型在表示属性和功能能力方面发生的范式转变。