Command Palette

Search for a command to run...

LIBERO-Para:针对 VLA 模型改写鲁棒性的诊断性 benchmark 与评估指标

LIBERO-Para:针对 VLA 模型改写鲁棒性的诊断性 benchmark 与评估指标

Chanyoung Kim Minwoo Kim Minseok Kang Hyunwoo Kim Dahuin Jung

摘要

Vision-Language-Action (VLA) 模型通过利用预训练的视觉-语言主干网络(vision-language backbones),在机器人操控领域取得了卓越的性能。然而,在下游机器人场景中,这些模型通常使用有限的数据进行 fine-tuning,这导致模型容易对特定的指令表述产生过拟合,且其对改写指令(paraphrased instructions)的鲁棒性尚未得到充分探索。为了研究这一差距,我们推出了 LIBERO-Para,这是一个受控的 benchmark,通过独立改变动作表达(action expressions)和物体引用(object references),从而对语言泛化能力进行细粒度的分析。通过对七种不同规模的 VLA 配置(0.6B-7.5B)进行测试,我们观察到在指令改写的情况下,模型性能一致下降了 22-52 个百分点(pp)。这种性能下降主要由物体层面的词汇变化引起:即使是简单的同义词替换也会导致大幅度性能下滑,这表明模型倾向于依赖表层匹配而非语义理解(semantic grounding)。此外,80-96% 的失败案例源于规划层面的轨迹偏差(trajectory divergence),而非执行错误,这表明指令改写会干扰任务识别。传统的二元成功率(Binary success rate)将所有改写指令同等对待,从而掩盖了模型是在不同难度水平下表现一致,还是仅仅依赖于较简单的案例。为了解决这一问题,我们提出了 PRIDE,一种利用语义和语法因子来量化改写难度的指标。我们的 benchmark 及相应的代码已开源:https://github.com/cau-hai-lab/LIBERO-Para

一句话总结

韩国淑明女子大学和中央大学的研究人员介绍了 LIBERO-Para,这是一个诊断基准,揭示了在 0.6B 到 7.5B 参数的七种视觉 - 语言 - 动作模型配置中,在改写指令下性能下降 22 到 52 个百分点,并提出了 PRIDE,这是一个使用语义和句法因素量化改写难度的指标,以解决二元成功率的局限性,因为 80 到 96 percent 的失败源于规划级轨迹发散。

核心贡献

- 研究团队介绍了 LIBERO-Para,这是一个受控基准,独立变化动作表达和对象引用,以评估视觉 - 语言 - 动作模型中的改写鲁棒性。这种双轴设计支持跨 43 种基于语言的指令类型的细粒度分析。

- 研究团队提出了 PRIDE,这是一个指标,使用特定于机器人指令的语义和句法因素量化改写难度。PRIDE 结合关键词相似度和结构变化与任务成功,以在标准二元成功率之外实现可解释的鲁棒性评估。

- 研究团队评估了七种 VLA 配置,范围从 0.6B 到 7.5B 参数,并观察到在改写下性能一致下降 22 到 52 个百分点。我们的分析确定对象级词汇变化是主要失败来源,80 到 96 percent 的错误源于规划级轨迹发散。

引言

视觉 - 语言 - 动作模型通过利用预训练的视觉 - 语言骨干网络促进机器人操作,但它们通常需要数据稀缺的微调,导致对特定指令形式的过拟合。这种对表面匹配的依赖使模型在部署时使用改写命令时容易受到性能下降的影响,这是先前基准未充分检查的弱点,这些基准侧重于视觉泛化或混淆语言变化与任务变化。为了解决这一差距,作者提出了 LIBERO-Para,这是一个受控基准,独立变化动作表达和对象引用,以进行语言鲁棒性的细粒度分析。他们还提出了 PRIDE,这是一个旨在使用语义和句法因素量化改写难度而非二元成功率的指标。

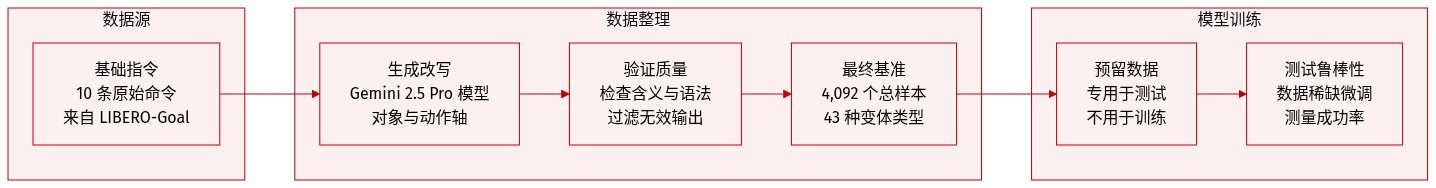

数据集

-

数据集组成与来源

- 作者介绍了 LIBERO-Para,这是一个构建在 LIBERO-Goal 设置之上的基准。

- 基础由从四种任务类型中选择的 10 个原始指令组成,其中语言理解至关重要。

- 所有变化均使用 Gemini 2.5 Pro 生成,并保留用于评估而非训练。

-

每个子集的关键细节

- 数据集包含 4,092 个改写指令,组织成 43 种不同的变化组合。

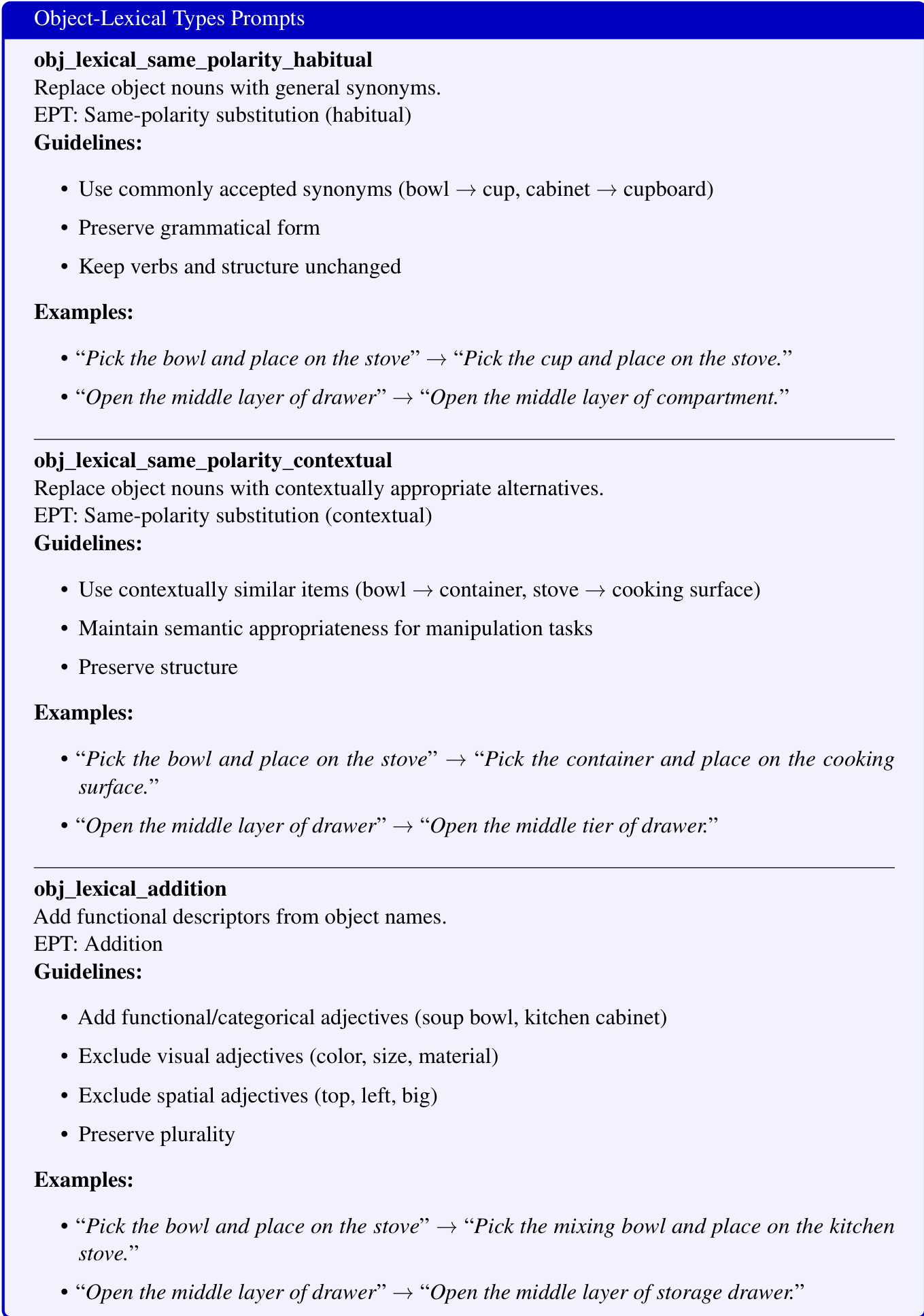

- 对象轴定义了三种词汇类型,例如添加和同极性替换。

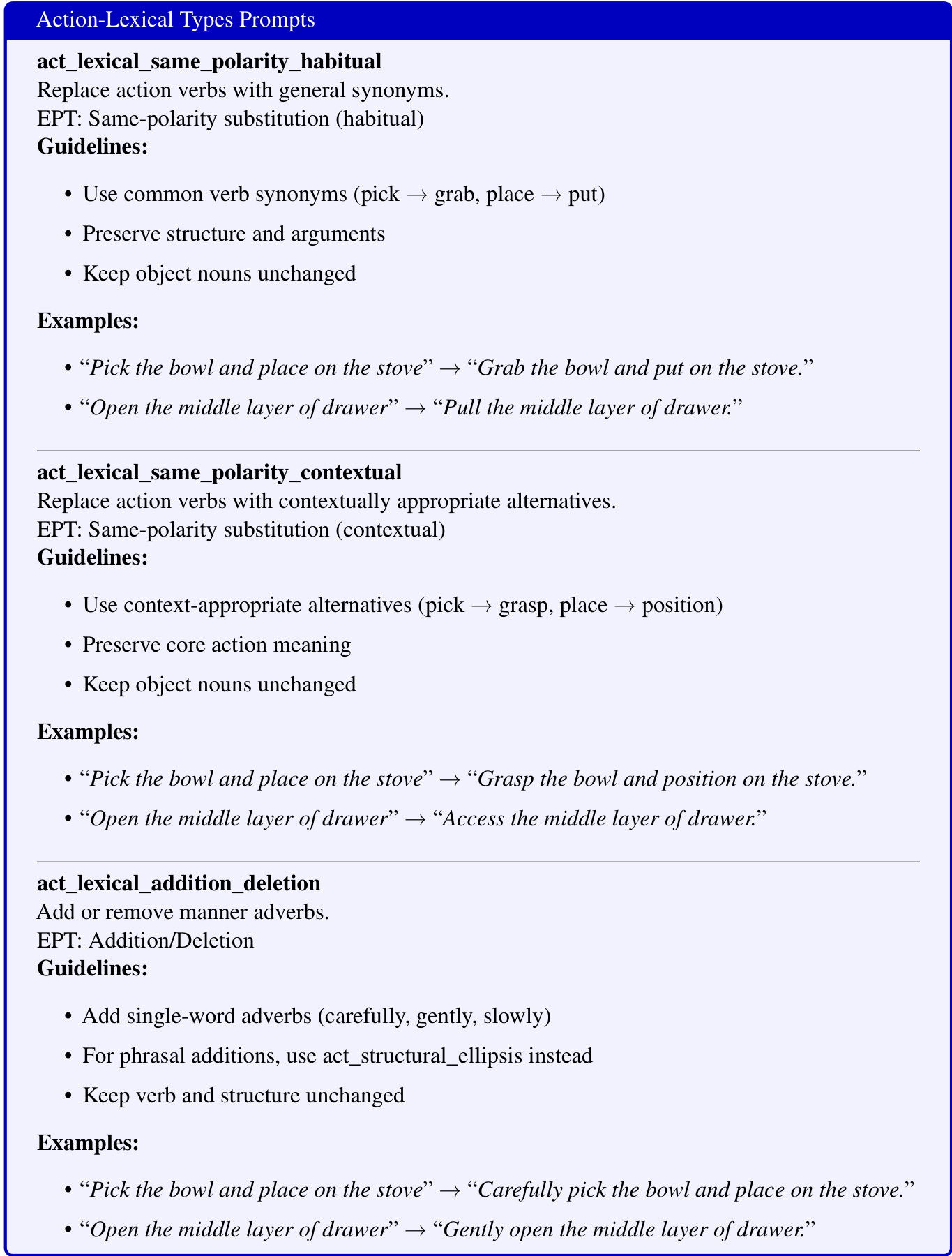

- 动作轴涵盖十种类型,包括词汇、结构和语用实现。

- 样本均匀分布,每种变化类型组合约有 100 个改写。

-

论文如何使用数据

- 该基准仅用于评估,以评估对未见语言变化的泛化。

- 原始指令作为基线条件,与改写变体进行比较。

- 在数据稀缺微调场景下测量性能,以测试改写鲁棒性。

-

处理和元数据构建

- 分类选择源自扩展改写类型学和指令类型,同时排除违反祈使约束的类别。

- 生成遵循四阶段工作流,涉及逐轴创建、验证、合并和最终验证。

- 元数据包括 PRIDE 指数组件,如关键词距离和结构距离,以量化语言发散。

方法

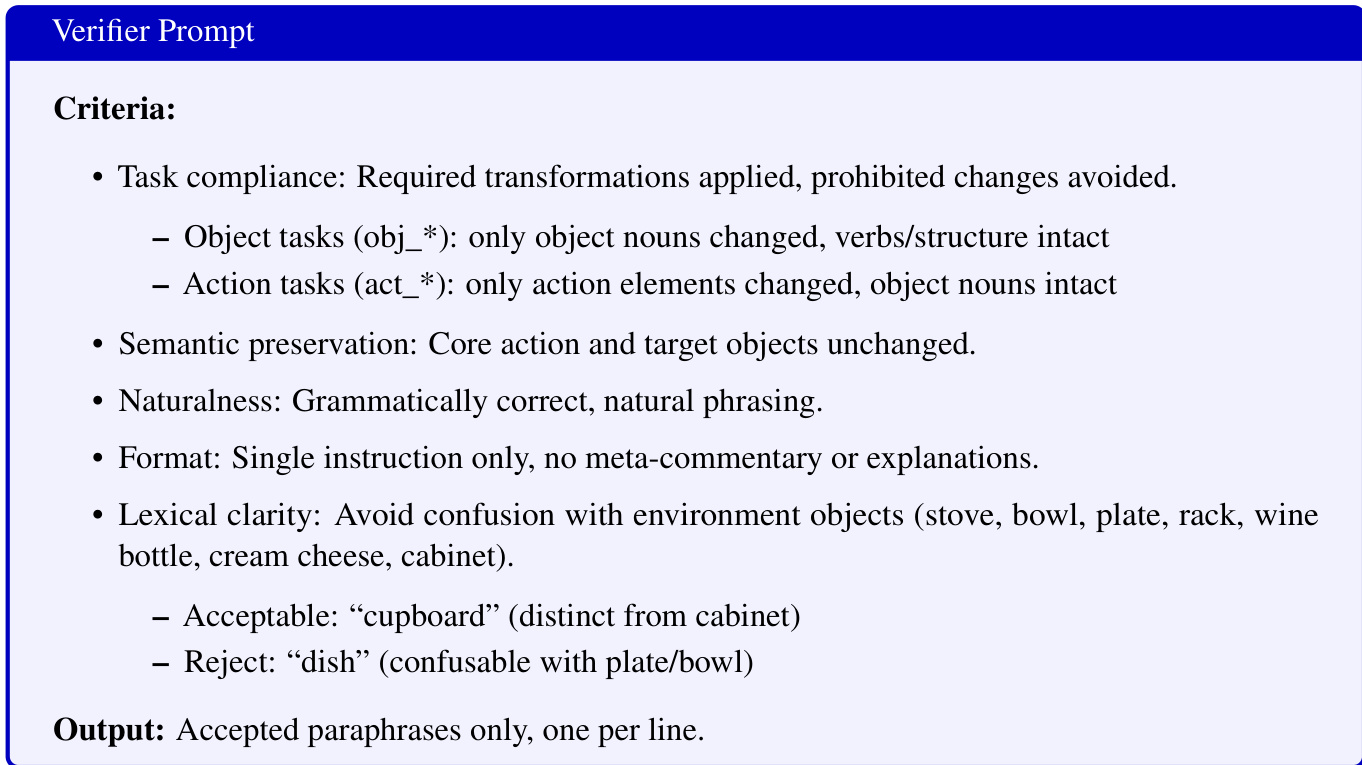

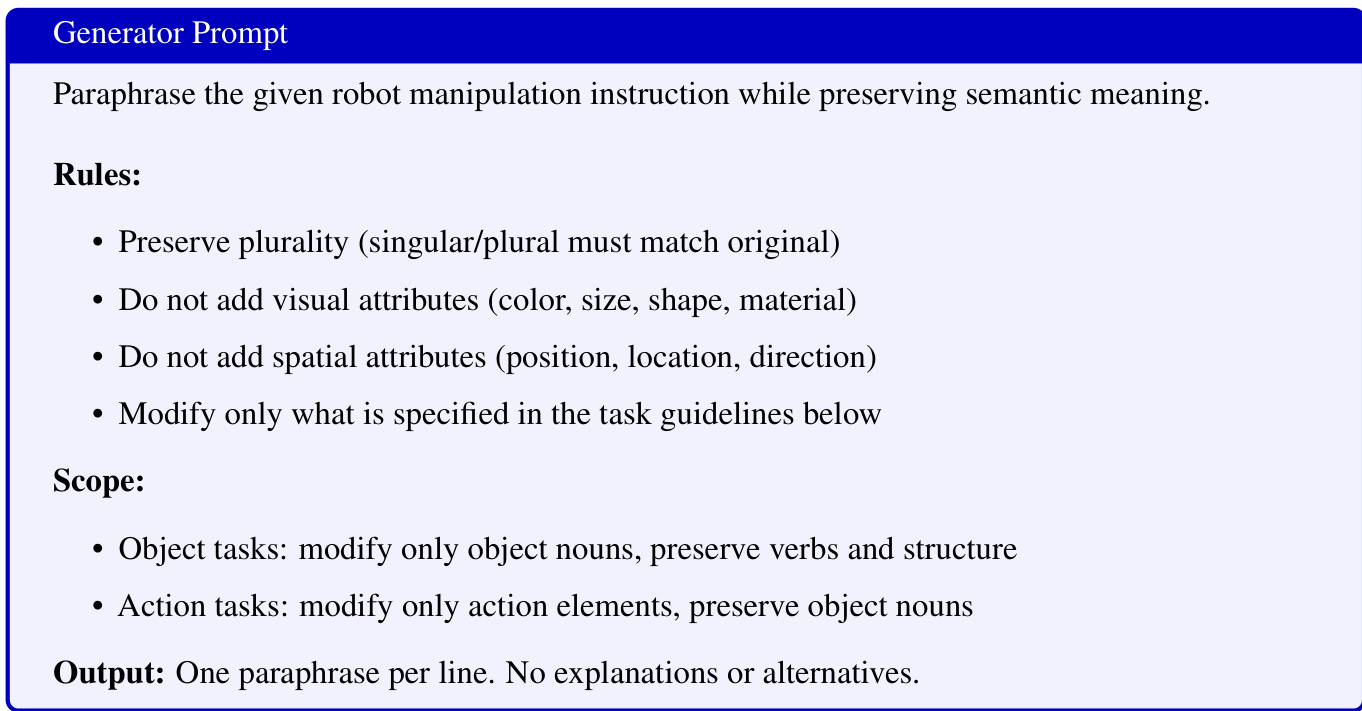

作者利用多阶段框架生成和评估改写的机器人操作指令,中心是基于大语言模型 (LLM) 的管道,该管道考虑了自然语言中的语义和句法变化。整个过程始于指令输入,该输入通过改写生成器处理以生成候选改写。该生成器在旨在保留核心任务语义的一组约束下运行,包括保持复数和避免添加视觉或空间属性等规则。生成的改写随后由第二个 LLM 组件验证,该组件检查是否符合特定任务标准,包括动作和对象实体的语义保留、语法正确性以及遵守单指令格式。该框架采用模块化设计,其中生成器和验证器独立运行但链式连接,以确保输出改写既具有语言多样性又对原始指令语义忠实。

参考框架图

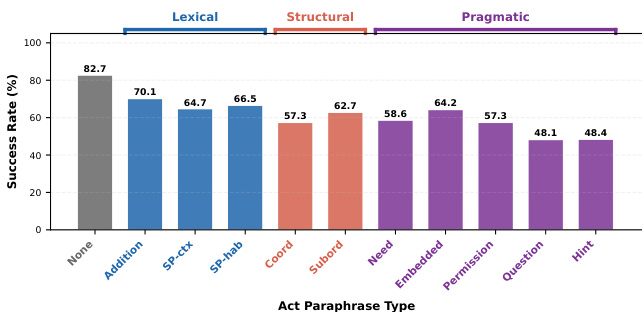

动作变化是框架的关键组件,捕捉动作如何通过三种不同类型在语言上表达:词汇、结构和语用。词汇变化涉及词级同义词替换和副词插入,而结构变化改变句级结构,如并列和从属。语用变化包括间接言语行为,如嵌入的祈使句或问题。这些变化类型基于既定的语言分类,并用于系统生成多样的改写。如下图所示,该框架对这些变化进行分类并评估其对任务成功率的影响,热图说明了不同改写类型如何影响各项任务的性能。

为了量化原始指令与其改写之间的相似度,作者定义了两个互补指标:关键词相似度 SK 和结构相似度 ST。关键词相似度通过计算原始和改写指令中这些词嵌入之间的平均最大余弦相似度,测量任务关键内容词(特别是动作动词和对象名词)的保留情况。这种方法,如下图所示,侧重于语义等价而非表面词汇重叠,使其对替换同义词或重排词序的改写策略更鲁棒。

结构相似度 ST 另一方面,通过测量原始和改写指令的依存树之间的树编辑距离 (TED) 来捕捉句法变化。依存树使用词性标签和依存关系而非表面词构建,降低了对词汇替换的敏感度。TED 通过两个树的组合大小归一化,以减轻句长效应,产生反映结构发散程度的分数。如下图所示,该指标考虑了主动被动交替或子句重排等转换,这些转换可能保留关键词但改变祈使结构。

改写距离 (PD) 分数结合 SK 和 ST 以提供原始指令与其改写之间偏差的统一度量。PD 定义为 1−(αSK+(1−α)ST),其中 α 控制关键词和结构相似度的相对权重。该分数用于计算 PRIDE 指标,该指标反映视觉 - 语言模型在改写指令下的成功,较高值表示较大偏差。该框架支持对机器人操作任务中自然语言变化的模型鲁棒性进行系统评估。

实验

我们使用 fastdtw (Salvador and Chan, 2007) 与欧几里得距离作为局部成本函数,并通过序列长度归一化结果距离,以确保跨片段的可比性。

重采样。为了标准化 DTW 的输入长度,所有轨迹通过线性插值重采样到 K=50 点。该值被选为在 ~143K 总片段(4,092 个改写 × 5 个种子 × 7 个模型)之间空间分辨率和计算成本之间的实际权衡。

仅 EEF 位置。从 7 维本体感觉状态 (x,y,z,rx,ry,rz,g),我们仅使用前三个维度,对应于末端执行器 (EEF) 绝对位置 (x,y,z)。剩余维度(朝向、夹爪状态)被排除,因为空间轨迹发散是模型是否规划向正确目标对象的最直接指标,这是本分析的核心诊断问题。

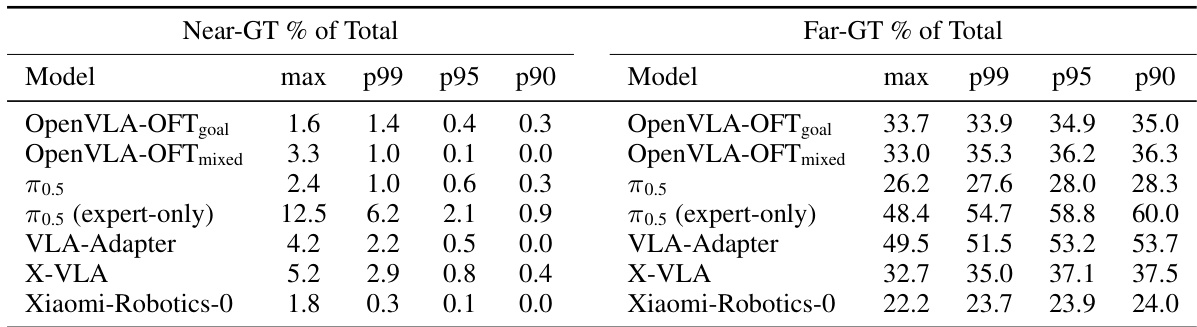

阈值鲁棒性。阈值 τt 按任务设置为成功片段中的最大 DTW 距离(算法 1,第 12 行),代表最宽松的近真值边界。为了验证我们的发现不敏感于此选择,我们使用逐步更严格的阈值(成功 DTW 距离的 p99、p95、p90)重复分类。如表所示,远真值失败在所有阈值下仍占主导,收紧 τ 将一些近真值片段转移到远真值,但不改变总体结论。例如,即使在最严格标准 (p90) 下:π0.5(仅专家)在所有模型中保持最高的近真值比率,与冻结 VLM 一致。

图:每个 VLA 模型在 LIBERO-Para 上的 PRIDE 分数 (PD) 与成功率 (SR) 之间的相关性。每个点代表改写单元的平均 SR,误差条表示标准差。颜色按模型统一以保持视觉清晰度。所有模型均表现出统计显著的负相关 (p<.0001)。Pearson r 值范围从 −0.671 到 −0.877,验证了较高的改写距离持续导致较低的任务成功。表格总结(右下角)报告了所有模型的 r 和 p。

第 6.3 节讨论的解释。

GT 轨迹一致性。图可视化了每个 LIBERO-Goal 任务的成功 EEF 轨迹。在每个任务内,成功轨迹收敛到具有低方差的狭窄空间走廊,验证了使用其均值作为伪 GT。这种一致性源于 LIBERO-Goal 训练数据,其中每个任务包含单个固定演示路径,无路线多样性。

每模型失败分解。图提供了来自表格的失败分类的细粒度视图,针对每个模型沿对象和动作轴分解。所有模型有两个一致的观察。首先,近真值(执行级)失败在每个类别中占一小部分,确认第 6.3 节报告的远真值失败的主导地位不是聚合的伪影,而是在每类型级别成立。其次,近真值失败不集中在任何特定改写轴或类型上,它们大致均匀分布,表明执行级错误未由特定语言属性系统触发。

唯一的例外是 π0.5(仅专家),其在大多数类别中显示升高的近真值比率。如第 6.1 节讨论,该模型在微调期间冻结 VLM,保留预训练语言理解,从而实现部分任务识别。然而,未适应的动作专家缺乏将正确计划转换为成功执行的精度,导致跟踪 GT 路径但最终失败的轨迹。

这些模式加强了结论,即改写鲁棒性改进应针对指令到任务识别阶段,即远真值失败起源处,而非低层运动控制优化。

{"caption": "模型比较表格", "summary": "该表格呈现了七个 VLA 模型在预训练数据、微调方法和适应范围方面的比较。它突出了训练策略的差异,例如全量微调与仅专家适应,以及使用不同的数据源和模型架构。", "highlights": ["模型在预训练数据源方面有所不同,包括专有数据集和开源集合。", "微调策略不同,一些模型使用全量适应,而其他模型将更新限制为仅动作专家。", "该表格包括发布的模型和自定义训练变体,表明公开可用和私有开发的配置混合。"]

作者分析了不同动作改写类型的成功率,表明随着语言复杂性从词汇增加到语用变化,性能下降。结果表明,间接言语行为如问题和提示导致成功率最显著下降,而添加等较简单变化影响较小。成功率从词汇到语用改写类型逐渐下降。性能最显著下降发生在间接言语行为,如问题和提示。词汇变化如添加和替换对成功率有中等影响。

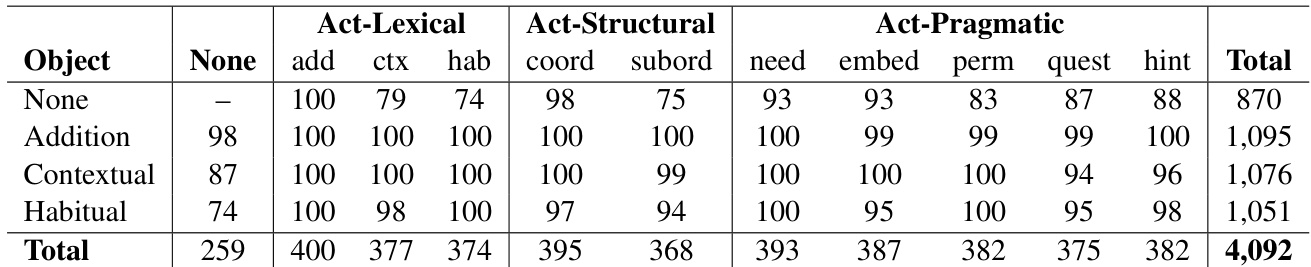

该表格显示了不同对象和动作改写类型的成功率,随着对象和动作变化增加,性能下降。最显著下降发生在对象改写与间接动作类型结合时,表明对象级变化是比动作间接性更强的失败驱动因素。当对象改写与间接动作类型结合时,成功率急剧下降。对象改写行在所有模型中显示比对象保留行低得多的性能。退化沿对象和动作轴加剧,最显著下降发生在最间接动作类别中。

{"caption": "模型评估资源使用", "summary": "该表格总结了评估七个模型配置所需的计算资源,包括 GPU 类型、VRAM 使用量和评估时间。结果显示模型在资源需求方面差异显著,一些需要高 VRAM 和长评估时间,而其他更高效。", "highlights": ["模型在 GPU 和 VRAM 需求方面差异很大,一些需要高端硬件。", "评估时间范围从约 8 到 70 小时,表明计算成本不同。", "所有模型的总评估成本约为 194 GPU 小时。"]

该表格呈现了不同模型中近真值 (Near-GT) 和远真值 (Far-GT) 失败的百分比。结果显示大多数失败是规划级 (Far-GT),仅一小部分是执行级 (Near-GT),表明模型经常无法从一开始正确识别任务,而非在执行期间失败。大多数失败是规划级,Far-GT 失败在所有模型中占主导。Near-GT 失败最小,代表总失败的一小部分。例外是仅专家模型,其显示较高比例的 Near-GT 失败,表明正确任务识别但执行问题。

评估比较了七个视觉 - 语言 - 动作模型,具有不同的训练策略和资源需求,以评估其对语言变化的鲁棒性。结果表明,随着指令复杂性增加,性能下降,间接言语行为和对象改写导致成功率最显著下降。此外,失败分析揭示大多数错误源于关于任务识别的规划级问题,尽管仅专家模型显示朝向执行级失败的明显趋势。