Command Palette

Search for a command to run...

为何自蒸馏(有时)会削弱 LLMs 的推理能力?

为何自蒸馏(有时)会削弱 LLMs 的推理能力?

Jeonghye Kim Xufang Luo Minbeom Kim Sangmook Lee Dohyung Kim Jiwon Jeon Dongsheng Li Yuqing Yang

摘要

自蒸馏(Self-distillation)已成为大语言模型(LLMs)一种有效的后训练范式,通常能在提升性能的同时缩短推理轨迹。然而,在数学推理任务中,我们发现该方法虽然能够缩短回复长度,却会导致性能下降。我们将这种性能退化归因于对“认知性言语化”(epistemic verbalization)的抑制,即模型在推理过程中表达不确定性的能力。通过控制实验,系统性地调节条件信息的丰富度与任务覆盖范围,我们证实:当教师模型基于丰富信息进行条件化时,会抑制不确定性的表达;这种机制虽能在有限任务覆盖下实现快速的域内(in-domain)优化,却会损害域外(OOD)泛化性能,因为未见过的难题恰恰需要模型表达不确定性并据此调整策略。在 Qwen3-8B、DeepSeek-Distill-Qwen-7B 以及 Olmo3-7B-Instruct 等多个模型上的实验表明,性能下降幅度最高可达 40%。我们的研究结果表明,适度暴露不确定性对于实现稳健的推理能力至关重要,并强调在优化推理行为时,不能仅局限于强化正确答案的轨迹,而需超越这一单一维度。

一句话总结

微软研究院、KAIST 和首尔国立大学的研究人员揭示,自蒸馏通过抑制认知性言语表达(epistemic verbalization),损害了大语言模型(LLM)的数学推理能力。他们证明,丰富的教师条件设定会减少不确定性表达,导致在分布外任务上性能显著下降,尽管推理轨迹变得更短。

主要贡献

- 该论文指出,数学推理中的自蒸馏通过抑制认知性言语表达(即模型在推理过程中表达不确定性的方式)导致性能下降。

- 通过控制实验改变条件设定的信息丰富度和任务覆盖范围,结果表明:基于丰富信息对教师模型进行条件设定虽能实现快速的域内优化,但会损害分布外任务的性能,而在这些任务中,不确定性表达是有益的。

- 在 Qwen3-8B、DeepSeek-Distill-Qwen-7B 和 Olmo3-7B-Instruct 上的实证结果显示,性能下降幅度高达 40%,这证明优化推理行为不仅需要强化正确答案的轨迹,还必须保留适当程度的不确定性表达。

引言

自蒸馏是一种流行的 LLM 后训练范式,通常能在缩短推理轨迹的同时提升性能,但在某些场景下却意外地损害了数学推理能力。先前的工作通常假设将推理压缩为简洁、自信的输出是普遍有益的,但这种方法未能考虑到认知性言语表达的缺失,即模型通过表达不确定性来应对复杂问题的过程。作者指出,基于丰富的真实信息对教师模型进行条件设定会抑制这些不确定性信号,导致在分布外任务上出现高达 40% 的性能下降。他们证明,保留适当程度的不确定性表达对于稳健的推理至关重要,并提出未来的训练目标必须在优化推理行为时超越单纯的答案正确性。

数据集

- 作者在实验设置中引入了 DAPO-Math-17k 数据集,以增强任务覆盖范围和模型性能。

- 该子集包含从 25,600 个样本池中提取的 17,000 道数学题,其中 14,000 道为不同题目,占总数的 78%,这是由于在 100 个训练步骤中进行了重复采样。

- 与仅依赖六种问题类型的化学数据集或仅包含 131 道题目的 LiveCodeBench v6 不同,DAPO-Math-17k 让模型接触到了广泛且不重叠的问题类型范围。

- 数据经过特定提示格式处理,指示模型逐步解决问题,并将最终输出格式化为单独一行的"Answer: $Answer"。

- 评估在未见过的问题类型上进行,以确保模型能够泛化到训练分布之外。

方法

作者利用自蒸馏框架来增强语言模型的推理能力。在此设置中,模型 πθ 在不同的条件设定下既充当学生也充当教师。学生仅基于输入 x 生成序列 y,而教师策略则基于更丰富的上下文 c 进行条件设定,该上下文提供解决方案或环境反馈等额外信息。训练目标是最小化学生与教师下一个 token 分布之间的散度:

LSD(θ)=∑tKL(πθ(⋅∣x,y<t)∥stopgrad(πθ(⋅∣x,c,y<t))).

该目标鼓励学生匹配教师在更丰富上下文下的预测,使模型能够通过蒸馏训练时可用的信息来提升性能,而无需外部教师。该方法的一个关键组成部分是在推理过程中处理不确定性。数学推理被视为自贝叶斯推理,其中模型迭代地更新其对中间假设的信念。

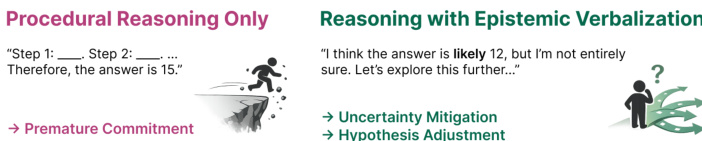

如下图所示,作者区分了程序性推理和带有认知性言语表达的推理。

缺乏认知信号的推理往往导致过早地坚持错误的假设,且几乎没有恢复的机会。相比之下,认知性言语表达允许模型表达不确定性,这作为一种信息信号而非单纯的风格冗余。这种方法有助于维持替代假设并支持逐步的不确定性降低。挑战在于过滤掉非信息性内容,同时保留能够支持迭代信念细化的认知表达,而不是盲目地压缩推理过程。

实验

- 在不同信息丰富度下对 LLM 推理进行的实验表明,提供更丰富的条件设定(例如完整解决方案)显著减少了响应长度和认知 token 的使用,从而产生更简洁、更自信的输出。

- 使用缺乏认知标记的解决方案引导响应进行监督微调,会导致数学基准测试上的性能大幅下降;而在无引导响应上进行训练则能保留推理能力,这表明认知性言语表达对于自主错误修正至关重要。

- 与 GRPO 相比,在线策略自蒸馏(SDPO)持续抑制认知 token 并缩短响应,导致在具有挑战性的数学任务上出现严重的分布外性能下降,特别是当基础模型依赖不确定性表达进行复杂推理时。

- 自蒸馏的负面影响与任务覆盖范围相关;虽然简洁的推理提高了小型、狭窄数据集上的效率,但它阻碍了在更大、更多样化的问题集上的泛化,而在这些集合中,表达不确定性对于适应是必要的。

- 消融研究证实,使用固定的教师策略可以缓解但无法消除由认知抑制引起的性能下降,且这些发现在包括 DeepSeek、Qwen 和 OLMo 在内的多个模型系列中均成立。