Command Palette

Search for a command to run...

具有推理轨迹的长尾驾驶场景:KITScenes 长尾数据集

具有推理轨迹的长尾驾驶场景:KITScenes 长尾数据集

摘要

在自动驾驶等现实应用场景中,泛化至罕见场景仍是一项根本性挑战。为此,我们推出一个专为端到端驾驶设计的新数据集,重点聚焦长尾驾驶事件。该数据集提供多视角视频数据、车辆轨迹、高层指令以及详细的推理轨迹(reasoning traces),以支持上下文学习(in-context learning)和小样本泛化(few-shot generalization)。基于此构建的多模态模型基准测试(benchmark),不仅涵盖安全性与舒适性指标,还进一步评估模型的指令遵循能力(instruction following)以及模型输出与语义的一致性。其中的多语言推理轨迹(涵盖英语、西班牙语和中文)由具备多元文化背景的领域专家标注,因此本数据集成为研究不同推理形式如何影响驾驶能力(driving competence)的独特资源。数据集获取地址:https://hf.co/datasets/kit-mrt/kitscenes-longtail

一句话总结

来自 KIT 和 FZI 的研究人员推出了 KITScenes LongTail 数据集,该数据集包含多语言专家推理轨迹,旨在解决罕见的驾驶场景。与以往的基准测试不同,它评估语义一致性,并提出轻量级的多机动评分(Multi-Maneuver Score),以评估端到端自动驾驶中的指令遵循能力和安全性。

主要贡献

- 本文介绍了 KITScenes LongTail 数据集,该数据集提供了与推理轨迹配对的长尾驾驶场景,使视觉 - 语言模型能够实现任务对齐的推理和泛化。

- 提出了一种新的多机动评分(MMS)指标,通过将规划轨迹与五个参考类别进行排名,并基于加加速度(jerk)和曲折度(tortuosity)计算施加舒适度惩罚,从而评估规划轨迹。

- 提出了一种语义一致性评估方法,利用 Rocchio 分类对句子嵌入进行处理,以验证推理轨迹中描述的驾驶动作是否与实际的规划轨迹一致,该方法对同义词变化具有鲁棒性。

引言

视觉 - 语言模型(VLMs)和视觉 - 语言 - 动作模型(VLAs)扩展了语言能力以解释视觉输入并执行动作,其中思维链(chain-of-thought)等中间推理步骤显著提高了复杂任务的可靠性。虽然先前的工作已成功应用采样、基于树的搜索和特定领域微调来稳定少样本行为,但这些方法往往难以始终将推理建立在可执行策略上,或者在没有高质量数据的情况下难以跨不同领域泛化。作者利用先进的推理机制来弥合视觉理解与动作规划之间的差距,确保 VLAs 能够以更准确的精度和策略对齐执行多步骤任务。

数据集

-

数据集构成与来源 作者推出了 KITScenes LongTail 数据集,这是一个专为端到端驾驶设计的资源,专注于罕见和长尾场景。数据是在城市、郊区和高速公路环境中历时两年收集的,特别筛选了恶劣天气、道路封闭、事故和施工区域。与标准的感知数据集不同,该集合集成了多视角视频、高级指令和人工标注的推理轨迹,以支持决策研究。

-

每个子集的关键细节

- 总规模:数据集包含 1,000 个场景,每个场景持续 9 秒。

- 划分:数据分为训练集(500 个场景)、测试集(400 个场景)和验证集(100 个场景)。

- 场景类型:分布在各划分中保持平衡,包含特意选择的罕见事件(如抗议、撞车)以及基于帕累托原则利用 nuScenes 作为参考识别出的长尾数据(如夜间驾驶、超车、变道)。

- 指令:高级命令由专家手动标注,范围从简单的“直行”到指定物体类型和相对位置的复杂超车指令。

- 推理轨迹:标注由具有不同文化背景的领域专家以英语、中文和西班牙语提供,捕捉了他们母语或流利语言中的直观推理。

-

论文中的数据使用 作者利用该数据集通过上下文学习机制评估视觉 - 语言模型(VLMs)和视觉 - 语言代理(VLAs)。

- 训练与评估:训练集支持少样本提示和少样本思维链(CoT)提示,模型从包含推理轨迹的少量示例中进行适应。

- 指标:本文引入了多机动评分(MMS),用于评估多个可能未来中的安全性、舒适度和指令遵循情况,而不是单一的真实轨迹。

- 分析:该数据使得能够测量模型输出与专家推理之间的语义一致性,并研究不同推理风格和语言如何影响驾驶能力。

-

处理与元数据构建

- 视频处理:数据集提供同步的六视角视频数据,水平视场角为 360°。帧以原始格式和小孔格式提供,其中小孔参数针对 ViT 补丁处理进行了优化。

- 拼接策略:应用逐帧拼接方法生成 360°视图。该方法不使用单一单应性矩阵,而是将图像划分为垂直部分,并将单应性与恒等变换混合,以平滑处理重叠部分。

- 标注流程:专家回答五个结构化问题,涉及情境感知以及 0–3 秒和 3–5 秒间隔的具体加速/转向指令。回答以口头或书面形式记录,并使用 Whisper 进行转录,确保解释的多样性和文化根基。

- 指令粒度:指令细粒度化,以便精确评估情境感知决策,包括因外部因素导致指令机动故意无法实现的情况。

方法

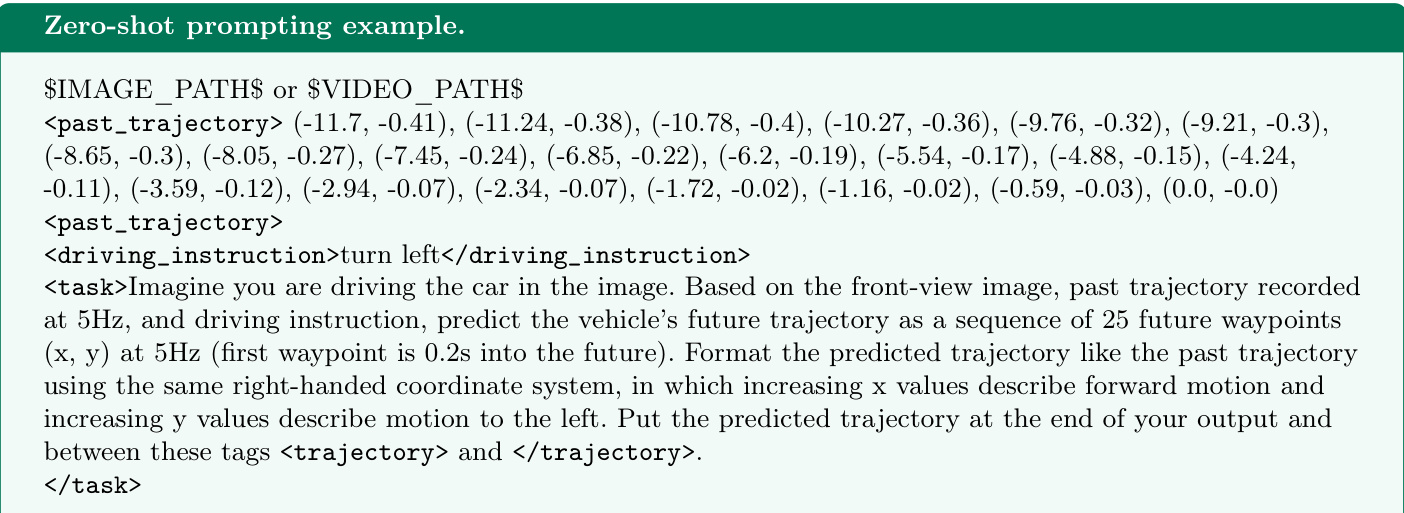

作者利用零样本提示方法来定义驾驶任务。如下图所示,输入包括图像路径、过去轨迹坐标和特定的驾驶指令,指导模型预测未来路点。

为了确保模型的推理与其动作一致,作者测量了语义一致性。他们应用启发式方法从规划轨迹中分类驾驶动作,并使用 EmbeddingGemma 0.3B 为推理轨迹生成嵌入。随后执行 Rocchio 分类,将这些嵌入与代表所有可能驾驶动作的参考嵌入进行比较。分类定义如下:

y^=argc∈Cmaxcos(z,μc)其中 C 是所有类别的集合,z 是嵌入,μc 是类别 c 的参考嵌入,cos(⋅) 计算余弦相似度。

对于轨迹评估,作者提出了一种多机动评分(MMS),根据与参考轨迹的相似度和舒适度对规划轨迹进行排名。有关该指标中使用的参考类别,请参阅下表。

MMS 考虑了五个类别:类专家、速度错误、忽视指令、未撞车但驶离道路以及撞车。舒适度通过减去基于相对于参考轨迹的加加速度和曲折度的惩罚来考虑。作者使用以下公式计算加加速度:

average jerk=T1t∑Δt3Δ3Yt,:其中 Y∈RT×2 是作为路点时间序列的轨迹。此外,他们使用以下公式计算曲折度:

tortuosity=∥YT:−Y1:∥∑t=2T∥Yt:−Yt−1:∥为了计算规划轨迹与参考轨迹之间的相似度,他们利用基于阈值的相似度指标:

sim={1,min(simlat,simlon),if dlat≤λlat and dlon≤λlon,otherwise.最终的 MMS 基于涉及相似度分数 s、参考分数 MMSref 和舒适度惩罚 CP 的四种情况计算:

MMS=⎩⎨⎧0,MMSref,s⋅MMSref,3.5−CP,if ⟨vplan(0),vref(0)⟩≤0.5vref(0),else if MMSref∈{0,1} and s≥0.4,else if s⋅MMSref≥3.5−CP,otherwise,该系统将预测的轨迹叠加在驾驶场景上进行可视化。有关预测路径可视化的示例,请参阅下图。

实验

- 将 MMS 指标与 L2 误差和闭环驾驶分数(DrivingScores)进行比较,验证了 MMS 与整体驾驶质量的相关性显著更好,特别是在检测 L2 误差遗漏的轨迹不一致性方面。

- 零样本评估显示,闭源 VLM 和经典端到端驾驶模型的表现优于开源 VLM,尽管开源模型在少样本和少样本 CoT 提示下显示出显著改进。

- 语义一致性分析表明,模型推理轨迹中描述的驾驶动作与最终预测轨迹之间经常存在不匹配,这表明存在幻觉或领域差距问题。

- 集成运动学模型将模型预测的驾驶动作转换为轨迹,为开源模型带来了最佳性能,证实中间推理轨迹通常包含比直接轨迹生成更准确的驾驶行为。

- 定性结果强调,模型在雪地和交叉路口等复杂场景中最为吃力,经常无法遵循指令或生成不安全的机动。