Command Palette

Search for a command to run...

SpatialBoost:通过语言引导推理增强视觉表征

SpatialBoost:通过语言引导推理增强视觉表征

Byungwoo Jeon Dongyoung Kim Huiwon Jang Insoo Kim Jinwoo Shin

摘要

尽管大规模预训练图像表示模型(即视觉编码器)在各类视觉任务中取得了显著成功,但它们主要基于二维图像数据进行训练,因此往往难以捕捉真实世界中物体与背景之间的三维空间关系,从而限制了其在众多下游应用中的有效性。为解决这一问题,我们提出了 SpatialBoost——一个可扩展的框架,旨在通过将以语言描述形式表达的三维空间知识注入现有预训练视觉编码器,从而增强其空间感知能力。该框架的核心思想是将来自二维图像的稠密三维空间信息转化为语言表达,并借助大语言模型(LLM)将此类空间知识注入视觉编码器。为此,我们采用多轮思维链(Chain-of-Thought, CoT)推理过程,逐步融入稠密空间知识,构建层次化的空间理解能力。为验证其有效性,我们将 SpatialBoost 应用于最先进的视觉编码器(如 DINOv3),并在一系列需要三维感知能力与通用视觉能力的基准测试上评估其性能提升。例如,在 ADE20K 数据集上,SpatialBoost 将 DINOv3 的平均交并比(mIoU)从 55.9 提升至 59.7,实现了 3.8% 的性能增益,达到当前最优水平。

一句话总结

来自 KAIST、RLWRLD 和 NAVER Cloud 的研究人员提出了 SpatialBoost,这是一个利用大语言模型(LLM)引导的多轮思维链(Chain-of-Thought)推理,将 3D 空间知识注入到如 DINOv3 等预训练视觉编码器中的框架。该方法将稠密的几何数据转化为语言描述,在显著提升 3D 感知和机器人控制任务性能的同时,保留了通用的视觉能力。

主要贡献

- 本文介绍了 SpatialBoost,这是一个可扩展的框架,通过将来自 2D 图像的稠密 3D 空间信息转化为语言描述,并利用大语言模型注入这些知识,从而增强预训练视觉编码器的空间感知能力。

- 提出了一种多轮思维链推理过程,通过像素级、物体级和场景级的子问题构建分层空间理解;同时,双通道注意力模块允许仅训练新参数,以保留现有知识。

- 实验表明,将该方法应用于 DINOv3 和 SigLIPv2 等最先进编码器,在多种基准测试中均取得了最先进(SOTA)的性能,包括在 ADE20K 数据集上 mIoU 提升 3.8%,以及在单目深度估计和图像分类任务中准确率的提高。

引言

预训练视觉编码器在语义理解方面表现出色,但由于主要基于 2D 图像训练,难以捕捉 3D 空间关系,这限制了它们在机器人控制和深度估计等任务中的有效性。以往尝试解决这一问题通常需要多视图数据集或从头开始训练,这造成了显著的数据整理瓶颈和计算成本,阻碍了可扩展性。作者提出了 SpatialBoost,这是一个通过大语言模型利用多轮思维链推理,将稠密 3D 空间线索转化为语言描述并注入现有视觉编码器的框架。通过冻结原始编码器并仅训练新的双通道注意力模块,该方法在避免遗忘先验知识的同时高效地构建了分层空间理解,在语义分割和单目深度预测等多种基准测试中取得了最先进结果。

数据集

-

数据集构成与来源 作者构建了两个主要数据集以增强空间推理能力:多视图视觉问答(VQA)数据集和多轮视觉空间推理数据集。多视图 VQA 数据集源自 ScanNet、Mip-NeRF360 和 MVIImgNet 等 3D 数据集,以及 Ego4D 第一人称视频数据集。多轮视觉空间推理数据集利用从 SA1B 数据集中筛选出的 10 万张图像用于单视图任务,并从上述 3D 和视频源中获取 20 万个样本用于多视图任务。

-

各子集的关键细节

- 多视图 VQA 子集: 该子集包含 20 万个样本,使用 LPIPS 指标进行筛选,确保图像对的相似度得分在 0.35 到 0.65 之间,从而剔除过于相似或过于不相似的异常值。GPT-4o 生成了三种类型的问题:通用 VQA、对抗性 VQA 和多项选择 VQA,以探测通用的多视图知识。

- 多轮视觉空间推理子集: 该子集每张图像包含 12 个连续的问答轮次。前 5 轮针对像素级深度,接下来的 4 轮利用 3D 边界框覆盖物体级空间关系,第 10 轮处理场景级距离预测,最后 2 轮提供由 GPT 生成的场景描述。单视图数据通过基于 CLIP 的开放词汇模型进行筛选,以确保存在多个物体。

-

模型训练中的数据使用 作者在视觉指令微调的特定阶段使用这些数据集。多视图 VQA 数据集用于第 2 阶段,以对齐视觉编码器与大语言模型,使其能够处理多视图数据。多轮视觉空间推理数据集用于第 3 阶段,以注入稠密空间信息并启用思维链(CoT)推理。训练流程处理单视图和多视图输入,合成从狭窄的像素查询到广泛的场景理解的问答对。

-

处理与构建策略

- 3D 信息提取: 对于单视图图像,作者使用 Depth-pro 进行度量深度估计,并利用分割模型生成 3D 点云。对于多视图输入,他们应用 VGGT 3D 重建模型来创建点云。

- 分层推理: 数据生成流程在三个层级合成问题:像素级(绝对/相对深度)、物体级(使用边界框的相对位置)和场景级(物体间的距离)。深度值四舍五入到小数点后三位,对于小于 0.5 米的距离使用厘米刻度。

- 视角扩展: 为了超越双视图配置,作者在锚点视图之间采样插值帧。他们使用 GPT-4o 验证现有的 VQA 对在这些新视角下是否仍然有效,最终得到 16 万个双视图、3 万个四视图和 1 万个八视图样本的混合数据。

方法

作者提出了 SpatialBoost,这是一种视觉表示学习框架,旨在通过将自然语言表达的 3D 空间信息注入来增强视觉编码器。整体方法涉及一种多模态架构,通过双通道注意力层将语言化表达的视觉信息融入视觉编码器。这确保了在充分利用 3D 空间信息的同时,保留原始视觉特征。

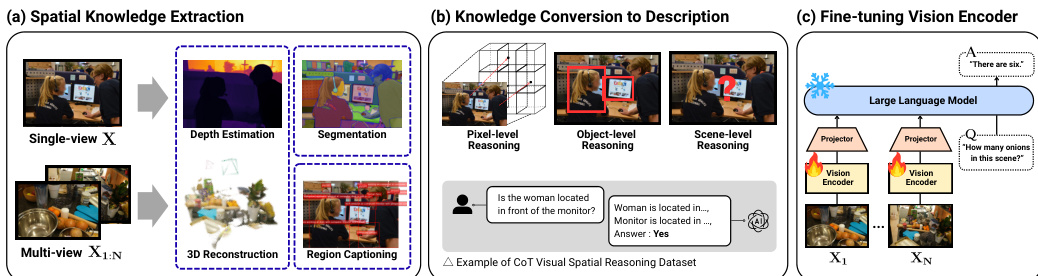

参考框架图以了解空间知识提取、转换和微调过程的概览。该流程始于从单视图和多视图图像中提取空间知识,利用深度估计、分割、3D 重建和区域描述。随后,通过像素级、物体级和场景级推理,将提取的知识转化为自然语言描述。最后,利用大语言模型(LLM)和投影模块对视觉编码器进行微调。

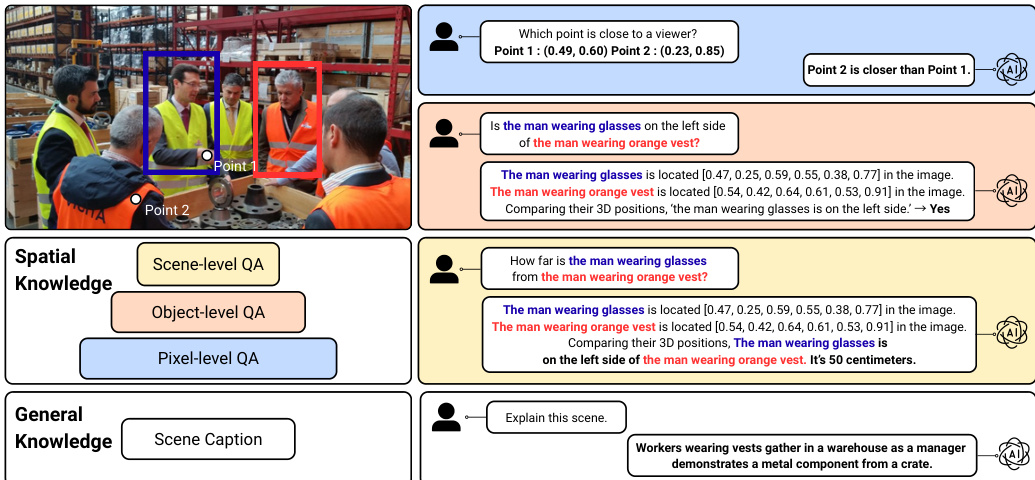

为了支持这一训练,作者设计了一个视觉问答(VQA)数据集,该数据集在层次上解耦了 3D 空间关系。如下图所示,该数据集在不同粒度上展示了多轮视觉空间推理。在像素级,问答任务通过深度估计查询点的 3D 位置。在物体级,它提取边界框或相对位置等空间属性。在场景级,它确定多个物体之间的确切距离,这需要基于前几步的推理。此外,还包含通用的场景描述以提供更广泛的上下文。

训练流程包含三个阶段,均使用监督微调(SFT)损失进行优化。在第 1 阶段(特征对齐),训练投影器 gP 将图像特征映射到 LLM 的文本嵌入空间,同时冻结视觉编码器 fV 和语言模型 fL。在第 2 阶段(视觉指令微调),视觉编码器保持冻结,而投影器和 LLM 使用多视图 VQA 数据结合单视图视觉指令数据进行微调。这使得模型能够有效处理多视图视觉问题。

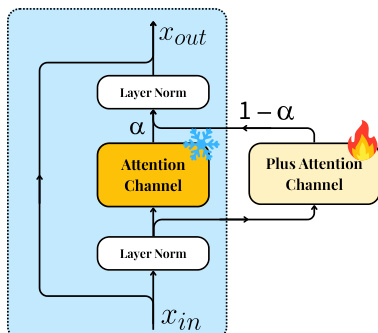

在第 3 阶段,对视觉编码器进行微调以获取空间理解。为了防止在此过程中发生灾难性遗忘预训练知识,作者引入了一种双通道注意力机制。参考双通道注意力层图示以了解具体的模块设计。对于视觉编码器中的每个注意力层,在原始块旁边引入一个额外的注意力层。输出通过可学习的混合因子 α 进行合并。

形式上,给定每个注意力层的输入 x,最终输出计算如下:

Attnfinal(x)=α⋅Attn(x)+(1−α)⋅Attn+(x)其中,α=sigmoid(a) 是一个可训练的混合因子,初始化为零,确保模型最初依赖于预训练的注意力权重。在微调过程中,仅更新额外注意力层 Attn+ 的参数和混合因子 α。这种方法使视觉编码器能够在不丢弃现有知识的情况下平滑地增强空间感知能力。

实验

- SpatialBoost 通过有效转移基于语言的空间知识,显著增强了视觉编码器在密集预测任务(包括单目深度估计和语义分割)中的空间理解能力。

- 该方法在不损害通用语言能力或导致灾难性遗忘的情况下,提高了复杂 3D 中心任务(如视觉 - 语言推理和 3D 语义分割)的性能。

- 基于视觉的机器人学习实验表明,增强的空间表示直接导致了在移动和操作领域更优越的控制性能。

- 图像分类和检索的评估证实,该方法提高了通用视觉能力,且未出现过拟合空间特征的情况,保留了预训练知识。

- 消融研究验证,与像素级替代方案相比,基于 LLM 的微调提供了更优越的监督;分层前向推理顺序以及单视图和多视图数据的结合产生了最佳结果。

- 双通道注意力机制被确定为在微调过程中保留和增强预训练知识的关键,其表现优于标准的全量微调和 LoRA 方法。

- 实验证实,该方法随着数据量的增加具有稳健的可扩展性,并且在应用于已经具备强空间感知能力的编码器时表现出互补性。