Command Palette

Search for a command to run...

PEARL:个性化流式视频理解模型

PEARL:个性化流式视频理解模型

摘要

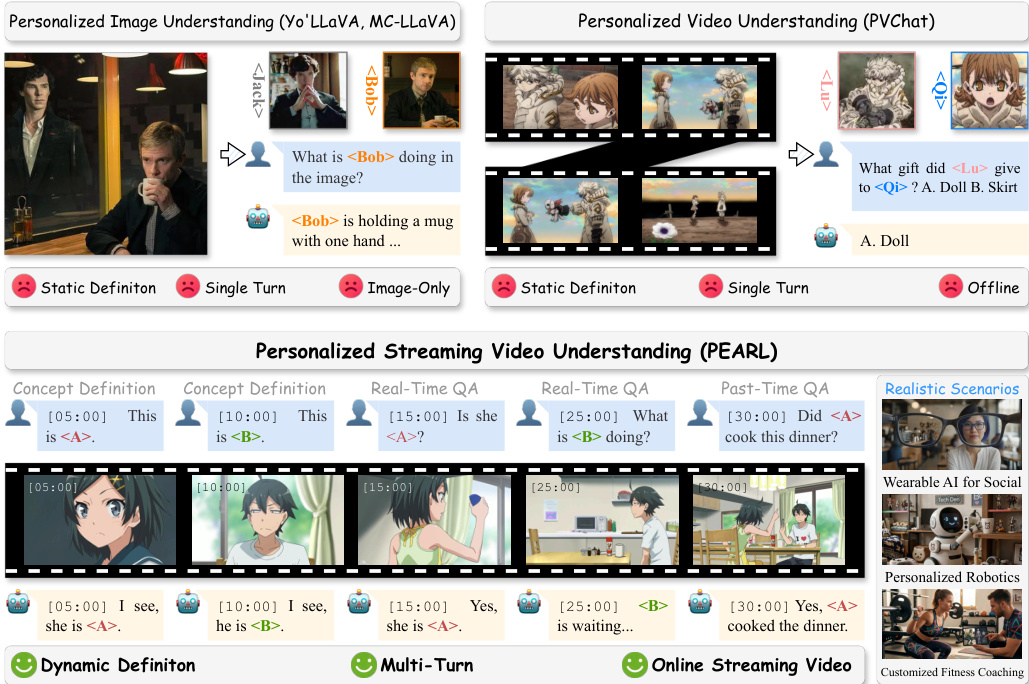

人类对新概念的认知本质上是一个流式过程:我们持续识别新对象或身份,并随时间不断更新记忆。然而,当前的多模态个性化方法主要局限于静态图像或离线视频。这种局限使得连续的视觉输入无法与实时的现实世界反馈有效衔接,从而削弱了其提供未来 AI 助手所必需的实时、交互式个性化响应能力。为弥合这一差距,我们首先提出并形式化定义了一项新任务:个性化流式视频理解(Personalized Streaming Video Understanding, PSVU)。为推动该方向的研究,我们推出了 PEARL-Bench,这是首个专为评估这一挑战性场景而设计的综合性基准。该基准在两种模式下评估模型在精确时间戳处响应个性化概念的能力:(1)帧级模式,聚焦于离散帧中的特定人物或对象;(2)视频级模式(一种新颖设定),聚焦于在连续帧中展开的个性化动作。PEARL-Bench 包含 132 个独特视频及 2,173 条带有精确时间戳的细粒度标注。通过自动化生成与人工验证相结合的 pipeline,我们严格确保了概念的多样性与标注质量。为应对这一极具挑战性的新场景,我们进一步提出了 PEARL——一种即插即用、无需训练的策略,可作为强有力的基线方法。在 8 个离线与在线模型上的广泛评估表明,PEARL 实现了最先进(state-of-the-art)的性能。值得注意的是,当应用于三种不同架构时,PEARL 均能带来一致的 PSVU 性能提升,证明其是一种高效且鲁棒的策略。我们期望本研究能推动视觉 - 语言模型(VLM)的个性化发展,并激发关于流式个性化 AI 助手的后续研究。代码已开源:https://github.com/Yuanhong-Zheng/PEARL。

一句话总结

北京大学及其合作者提出了 PEARL,这是一个无需训练的个性化流式视频理解框架。该框架引入了一种双粒度记忆系统,能够在连续视频流中实现实时、个性化的响应,并在其新推出的 PEARL-Bench 上超越了现有的离线和在线模型。

主要贡献

- 本文提出了个性化流式视频理解任务,并推出了 PEARL-Bench。这是首个综合基准测试,包含 132 个视频和 2,173 个细粒度标注,用于评估具有精确时间定位能力的帧级和视频级个性化。

- 提出了一种名为 PEARL 的无需训练、即插即用的框架。该框架利用双粒度记忆系统将概念知识与流式观测解耦,并通过概念感知检索算法,在不更新参数的情况下实现实时响应。

- 在八个离线和在线模型上的广泛评估表明,所提出的方法达到了最先进水平,在三种不同的架构中,帧级平均提升 13.79%,视频级平均提升 12.80%。

引言

当前的视觉 - 语言模型在个性化方面表现出色,但仍局限于静态图像或离线视频处理,这与人类认知的连续性、实时性以及现实世界 AI 助手应用的需求脱节。现有方法难以处理流式视觉输入、动态即时定义用户概念,或在无需计算昂贵的重新训练的情况下提供即时交互反馈。为了解决这些差距,作者正式定义了个性化流式视频理解这一新任务,并推出了 PEARL-Bench,这是首个用于评估连续流中帧级和视频级个性化的综合基准。此外,作者提出了 PEARL,这是一个无需训练、即插即用的框架,利用双粒度记忆系统和概念感知检索,使现成模型能够在实时个性化视频理解中达到最先进水平。

数据集

-

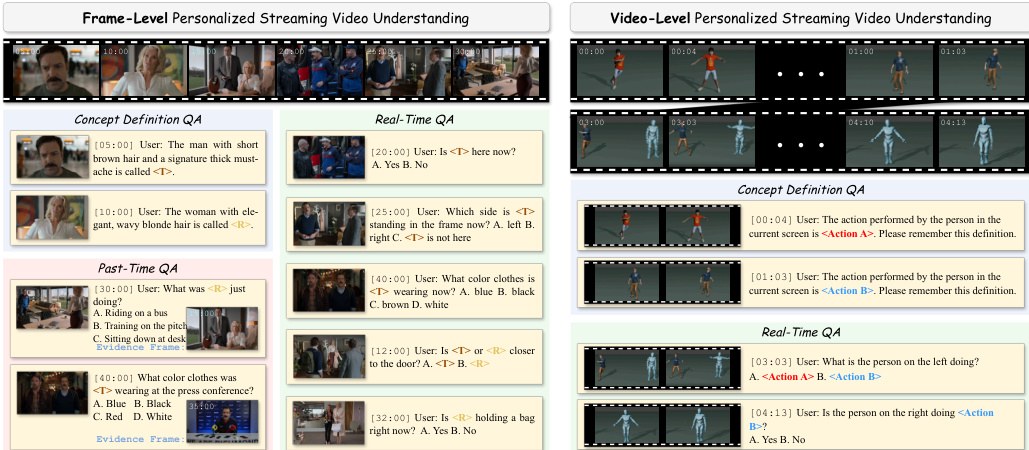

数据集构成与来源:作者推出了 PEARL-Bench,这是一个包含 132 个视频和 2,173 个标注的基准,专为长格式流式视频个性化设计。帧级划分源自多样化的公共互联网资源,包括动漫、电影和真人秀;而视频级划分则利用 Mixamo 资产进行数字人合成,以确保在 8 个角色、20 个动作和 20 个背景下的重复、清晰动作标注。

-

各子集的关键细节:该数据集支持两种不同的概念类型:帧级概念(静态角色)和视频级概念(动态动作)。标注分为三类问答(QA):用于注册新概念的“概念定义”、用于查询当前状态的“实时”以及用于检索历史证据的“过去”。平均视频时长为 1,458 秒,所有标注均链接到精确的时间戳。

-

模型使用与训练策略:作者仅在交互阶段使用“概念定义”QA 进行记忆注册,并将其排除在最终评估指标之外。“实时”和“过去”QA 作为主要评估划分,模型必须将识别出的概念锚定在当前场景中,或检索历史片段来回答问题。该基准包含细粒度的子类别,如存在性、行为、外观、位置、关系和动作,以测试多维感知能力。

-

处理与元数据构建:策展流程包括针对高动态和分辨率(480p+)的人工筛选,随后通过自动化消融测试和人工验证进行严格的质量控制。为了增强鲁棒性,作者用美国社会保障局(SSA)数据库中的 10,000 个常见名字替换了原始名称。此外,他们还采用特定的提示策略来生成紧凑的描述,重点关注帧级概念的稳定特征和视频级概念的运动模式,以确保在不同场景和主体上的泛化能力。

方法

作者提出了 PEARL,这是一个专为个性化流式视频理解(PSVU)设计的即插即用框架。与局限于静态定义或单轮交互的先前方法不同,PEARL 能够在在线流式视频环境中实现动态概念定义和实时响应。请参阅框架图,观察从静态图像/视频理解到所提出的动态多轮流式能力的转变。

形式上,流式视频被定义为无限序列 V=[X1,X2,…],其中 Xi 表示语义场景。用户可以在任意时间戳通过指令动态引入新概念 C。对于在时间 tq 发出的查询 Q,模型 M 构建上下文以生成响应 A: A=M(Csub,Vcontext,Q) 其中 Csub 是与查询相关的概念子集,Vcontext 是必要的视觉上下文。

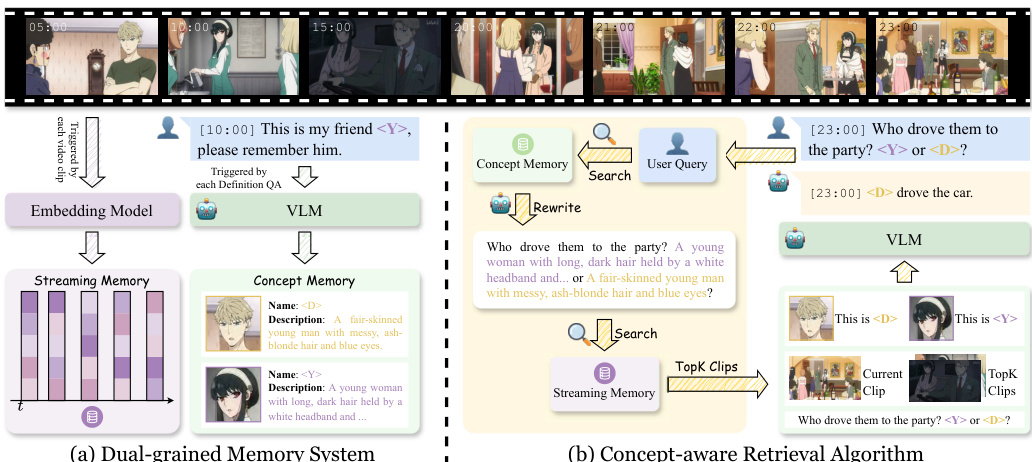

为了管理无界流和不断演变的概念,作者设计了一种双粒度记忆系统,将以概念为中心的知识与以流为中心的观测解耦。该系统包含一个流式记忆,用于增量归档带有紧凑多模态嵌入的分段片段;以及一个概念记忆,用于存储用户定义概念的结构化表示。如下图所示,该架构明确分离了这两条记忆流,以促进高效检索。

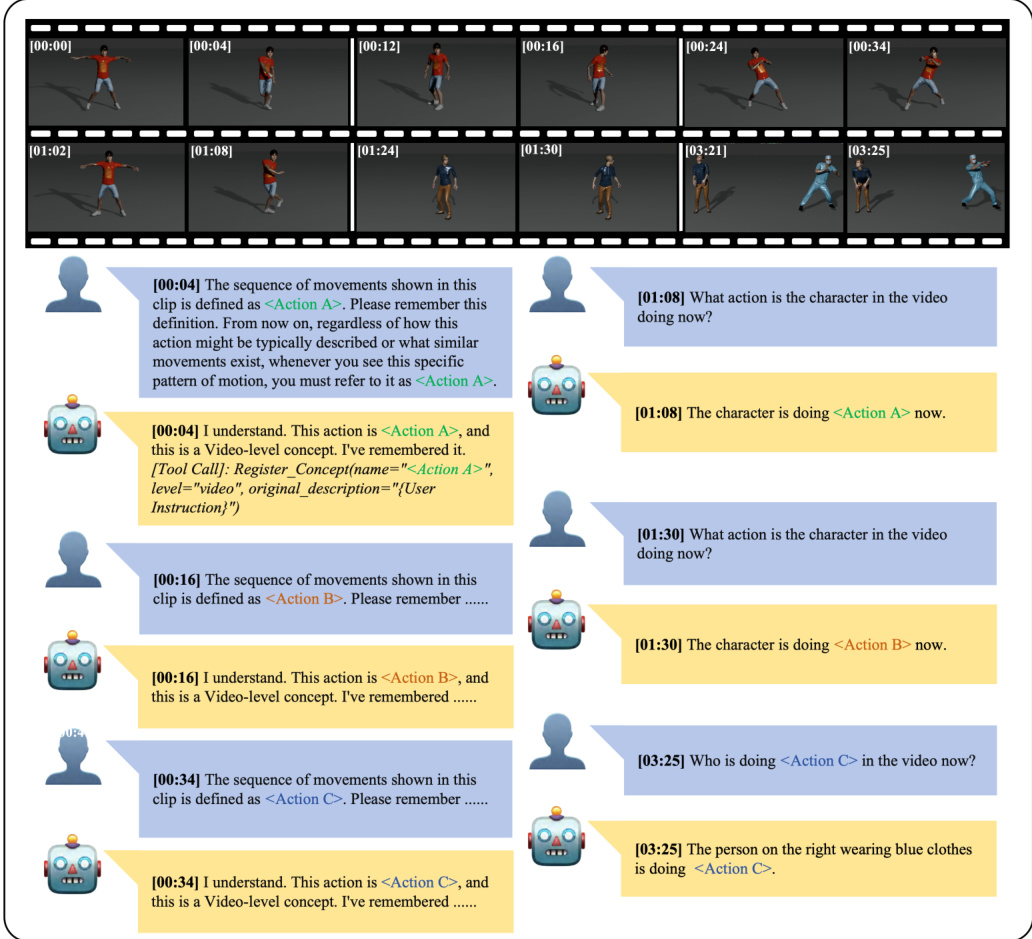

该框架支持帧级和视频级概念。对于帧级概念,系统存储当前片段的最后一帧作为视觉证据。对于视频级概念,整个片段作为证据,重点关注核心运动学和运动模式,而非静态身份特征。下图展示了这些不同概念粒度的示例,说明了如何定义和查询特定动作或角色外观。

收到查询后,将触发概念感知检索算法以检索相关信息。模型首先识别查询中的概念名称,并从概念记忆中检索相应条目。然后,它通过将概念名称替换为其文本描述来重写查询,以提高检索准确性。该重写后的查询被编码并与流式记忆中的片段嵌入进行比较,以选择最相关的 top-K 个历史片段。最后,检索到的概念、历史片段、当前片段和原始查询被输入到 VLM 中以生成响应。交互流程展示了系统如何通过工具调用注册视频级概念,并在随后实时识别这些动作。

实验

- 基线对比验证了离线模型由于上下文有限且缺乏记忆而在流式任务上表现不佳,而 PEARL 通过有效管理连续视觉流,在帧级和视频级设置中显著优于离线和在线基线。

- 人类评分和纯文本实验证实,该基准需要视觉锚定,因为仅靠文本先验会导致性能低下,而人类标注员在拥有完整视觉访问权限时能达到高准确率。

- 消融研究表明,概念记忆对于将用户定义的名称链接到实体不可或缺,流式记忆对于过去时间查询中基于历史证据的推理至关重要,而查询重写通过将个性化名称转换为描述性语义来提高检索准确性。

- 效率分析显示,与基础模型相比,PEARL 引入的延迟开销极小,同时保持了实时能力,推理时间主要由大语言模型(LLM)主导,而非检索模块。

- 超参数和规模分析表明,适度的检索足以获得准确答案,过多的历史数据可能会为实时查询引入噪声,且该框架在各种模型规模下都能持续提升性能,而仅扩展离线模型而不使用流式框架则收效甚微。