Command Palette

Search for a command to run...

生成模型感知空间:释放隐式3D先验以增强场景理解

生成模型感知空间:释放隐式3D先验以增强场景理解

Xianjin Wu Dingkang Liang Tianrui Feng Kui Xia Yumeng Zhang Xiaofan Li Xiao Tan Xiang Bai

摘要

尽管多模态大语言模型(MLLMs)展现出卓越的语义理解能力,但它们往往存在空间感知盲区,难以处理细粒度的几何推理与物理动态。现有方案通常依赖显式的 3D 模态或复杂的几何架构,却受限于数据稀缺与泛化难题。本文提出一种范式转变:利用大规模视频生成模型中内蕴的隐式空间先验。我们主张,为了合成时间连贯的视频,这些模型本质上已习得鲁棒的 3D 结构先验与物理规律。为此,我们提出了 VEGA-3D(Video Extracted Generative Awareness,视频提取生成感知),这是一个即插即用的框架,可将预训练的视频 Diffusion 模型重新构建为隐式世界模拟器(Latent World Simulator)。该框架通过从中间噪声层级提取时空特征,并经由 token 级自适应门控融合机制将其与语义表示进行整合,从而在不依赖显式 3D 监督的情况下,为 MLLMs 注入稠密的几何线索。在 3D 场景理解、空间推理及具身操作等多个基准测试上的广泛实验表明,我们的方法优于现有最先进基线,验证了生成先验为物理世界理解提供了可扩展的基础。代码已开源:https://github.com/H-EmbodVis/VEGA-3D。

一句话总结

华中科技大学与百度公司研究人员提出了 VEGA-3D,这是一个将视频生成模型重新利用为潜在世界模拟器(Latent World Simulators)的框架,旨在向多模态大语言模型(MLLMs)注入隐式 3D 先验。与以往依赖显式 3D 数据的方法不同,该方法采用自适应门控融合机制,在无需几何监督的情况下增强空间推理和具身操作能力。

主要贡献

- 本文提出了 VEGA-3D,这是一个即插即用的框架,它将预训练的视频扩散模型重新利用为潜在世界模拟器,以提取隐式 3D 先验,而无需显式的 3D 监督。

- 设计了一种令牌级(token-level)自适应门控融合机制,将来自中间噪声水平的时空特征与语义表示进行整合,使 MLLM 在保留判别性语义信息的同时,能够获取稠密的几何线索。

- 在 3D 场景理解、空间推理和具身操作基准测试上的广泛实验表明,该方法优于最先进(SOTA)的基线模型,验证了生成先验为物理世界理解提供了可扩展的基础。

引言

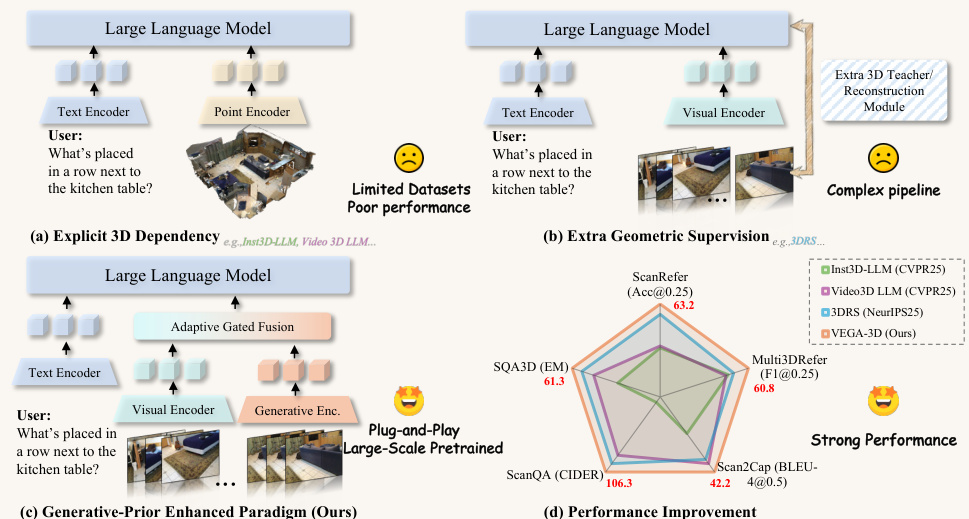

多模态大语言模型在语义任务上表现出色,但往往缺乏细粒度几何推理和物理动力学所需的空间感知能力。先前的解决方案试图通过依赖点云或复杂几何脚手架等显式 3D 输入来解决这一问题,但这些方法受限于数据稀缺以及对专门标注的需求。作者利用大规模视频生成模型已学到的隐式 3D 先验来克服这些局限。他们引入了 VEGA-3D,这是一个即插即用的框架,将预训练的视频扩散模型重新利用为潜在世界模拟器。通过从中间噪声水平提取时空特征,并通过令牌级自适应门控融合机制将其与语义表示融合,该方法在无需显式 3D 监督的情况下,为 MLLM 丰富了稠密的几何线索。

数据集

-

数据集构成与来源 作者将训练数据组织为三个实验设置:3D 场景理解、空间推理和机器人操作。每个设置都依赖既定的公开基准,以确保与 Video-3D LLM、VG-LLM 和 OpenVLA-OFT 等基线模型进行公平比较。

-

各子集的关键细节

- 3D 场景理解:该子集结合了五个公开基准(ScanRefer、Multi3DRefer、Scan2Cap、ScanQA 和 SQA3D),均源自 ScanNet 场景。数据涵盖 3D 视觉定位、稠密描述生成和问答任务。

- 空间推理:作者使用了来自 VG-LLM 的 S1 训练集,该集合混合了 SPAR-7M 的实例和 LLaVA-Video-178K 的 LLaVA-Hound 划分。这种组合提供了空间增强的监督,同时保留了通用的视频 - 语言能力。

- 机器人操作:该设置利用标准的 LIBERO 基准,具体包括四个标准任务套件:LIBERO-Spatial、LIBERO-Object、LIBERO-Goal 和 LIBERO-Long。

-

模型使用与训练策略

- 对于 3D 场景理解,模型在混合基准集上进行多任务训练,将静态 ScanNet 场景转换为视频风格的多视图输入。

- 在空间推理实验中,S1 混合集作为唯一的训练数据,以隔离生成先验带来的增益,而无需额外的合成监督。

- 对于机器人操作,模型在与 OpenVLA-OFT 基线相同的 LIBERO 下游数据上进行训练和评估,以专注于视觉生成先验的影响。

-

处理与过滤细节

- 3D 场景理解流程将静态 3D 场景转换为视频风格的多视图输入,以统一不同任务的训练。

- 作者严格避免引入额外的指令微调语料库或辅助操作数据集,以保持受控的实验条件。

- 除了将场景转换为视频风格输入以及选择特定的基准划分外,文中未提及具体的裁剪策略或元数据构建步骤。

方法

作者提出了 VEGA-3D,这是一个即插即用的框架,旨在缓解标准多模态大语言模型(MLLMs)固有的空间盲区。如框架图所示,该方法引入了一种生成先验增强范式,将冻结的视频生成模型重新利用以提取隐式 3D 结构先验,从而避免了对显式 3D 依赖或复杂几何监督流程的需求。

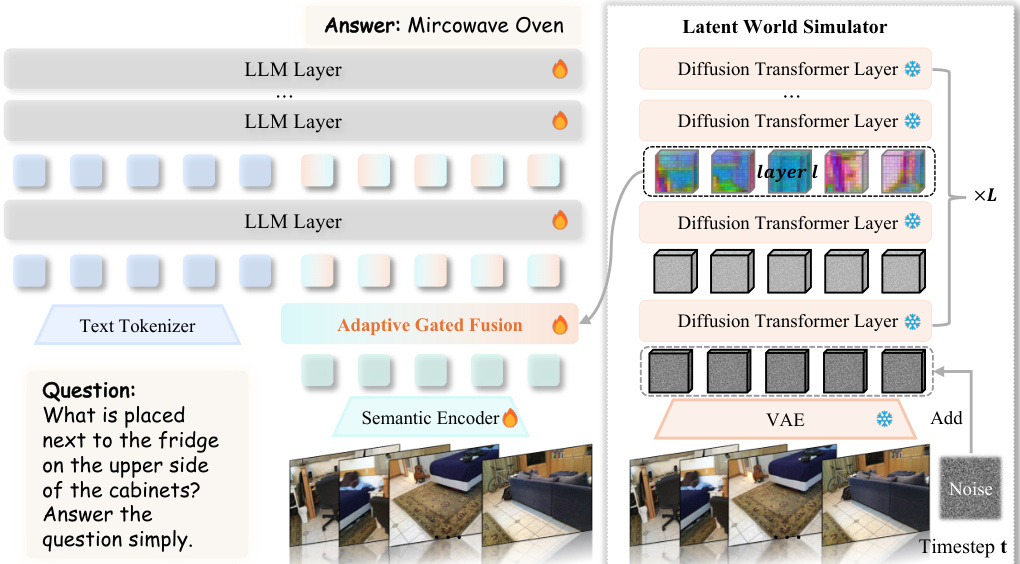

架构的核心是潜在世界模拟器,它将视频生成模型操作化为几何编码器。给定输入视频序列,系统首先通过变分自编码器(VAE)将帧映射到低维潜在空间。为了激活模型对物理结构的理解,通过在高斯噪声路径上添加特定时间步的高斯噪声,对干净的潜在表示进行扰动。该噪声潜在表示被输入到带有空文本提示的扩散 Transformer 骨干网络中,确保激活的特征仅依赖于视觉信号和学到的物理规律。特征从中间 DiT 层提取,以在空间精度和时空上下文之间取得最佳平衡。

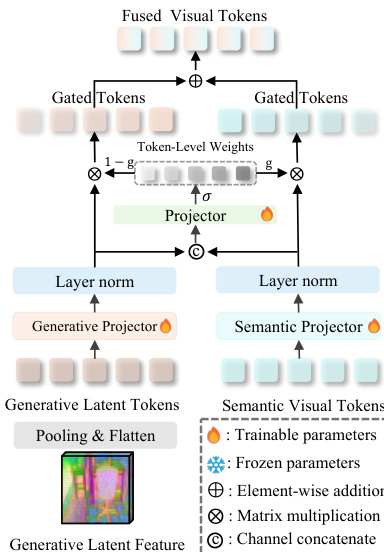

为了弥合生成分支的连续物理特征与标准视觉编码器的离散语义特征之间的差距,作者采用了一种自适应门控融合机制。如详细模块图所示,生成潜在令牌和语义视觉令牌均使用独立的 MLP 投影器投影到 LLM 的隐藏维度。

对于每个空间令牌,使用应用于级联且经过层归一化特征的 Sigmoid 函数计算标量门 gi∈[0,1]。最终的融合表示是由该门决定的凸组合: Fifused=(1−gi)⋅Fgen.,i+gi⋅Fsem.,i. 该机制允许模型在识别任务中动态优先处理语义先验,而在需要空间推理的任务中转向生成世界知识。生成的融合视觉令牌随后被序列化并传递给大语言模型以生成响应。

实验

- 多视图对应分析验证了跨视角的特征一致性与下游 3D 性能之间存在强正相关,揭示了基于 DiT 的生成模型由于其全局注意力机制,在几何对齐方面优于 UNet 架构。

- 在 3D 场景理解基准上的实验表明,利用冻结的视频生成模型作为潜在世界模拟器,显著提高了空间定位和推理能力,且无需显式 3D 标注,有效规避了数据稀缺问题。

- 在空间推理和机器人操作任务上的评估证实,生成先验能够很好地泛化到多种能力,增强了具身代理在相对距离估计、路径规划和复杂物体交互方面的性能。

- 消融研究表明,中间扩散时间步和特定网络层提供了最稳健的几何线索,而自适应门控融合模块对于平衡语义细节与结构先验以实现一致的任务性能至关重要。