Command Palette

Search for a command to run...

互补强化学习

互补强化学习

摘要

强化学习(RL)已成为训练基于 LLM 的智能体(agent)的有力范式,但其样本效率低下问题依然突出。这一局限不仅源于稀疏的结果反馈,还源于智能体无法在多个回合(episodes)之间有效利用先验经验。尽管为智能体引入历史经验被视为一种颇具潜力的解决方案,但现有方法存在一个关键缺陷:从历史中提炼的经验要么被静态存储,要么无法与不断进化的策略执行者(actor)协同演化。这导致经验与执行者不断变化的能力之间出现渐进式失配,从而削弱了经验在训练过程中的效用。受神经科学中互补学习系统(complementary learning systems)的启发,我们提出了互补强化学习(Complementary RL),旨在实现经验提取器与策略执行者在 RL 优化循环中的无缝协同演化。具体而言,策略执行者通过基于稀疏结果奖励的方式进行优化;而经验提取器则根据其提炼的经验是否切实有助于执行者取得成功来进行优化,从而使其经验管理策略能够与执行者能力的增长保持同步演化。实证结果表明,Complementary RL 优于那些无法从经验中学习的基于结果的智能体 RL 基线方法:在单任务场景中,其性能提升了 10%,并在多任务设置中展现出强大的可扩展性。这些结果确立了 Complementary RL 作为一种高效经验驱动智能体学习范式的地位。

一句话总结

阿里巴巴集团与香港科技大学的研究人员提出了互补强化学习(Complementary RL),这是一个使经验提取器与策略执行器能够无缝协同进化的框架,旨在克服强化学习中的静态记忆限制,显著提升了基于大语言模型(LLM)的智能体在单任务和多重任务场景下的样本效率与性能。

主要贡献

- 本文提出了互补强化学习(Complementary RL),该框架在策略执行器与经验提取器之间建立了一个闭环协同进化回路,确保提炼出的知识与智能体不断增强的能力同步演进。

- 该方法基于提炼出的经验在促进执行器成功方面的可验证效用,对经验提取器进行优化,利用结构化添加、细化和合并操作自动解决冲突与冗余。

- 实验结果表明,与不利用经验学习的基于结果的智能体强化学习基线相比,该方法在单任务场景中实现了 10% 的性能提升,并在多重任务设置中展现出强大的可扩展性。

引言

强化学习赋能了大语言模型智能体,但由于结果反馈稀疏以及无法有效复用过往经验,其在样本效率方面面临挑战。现有的融入历史数据的方法往往因将经验视为静态资源,或依赖无法自适应的提取器而失败,导致提供的指导与智能体不断增强的能力之间出现错位。为此,作者受神经科学启发,提出了互补强化学习(Complementary RL),在策略执行器与经验提取器之间建立闭环协同进化回路。执行器通过基于结果的奖励进行优化,而提取器则学习根据经验对执行器成功的实际贡献来提炼高效用经验,确保两个组件同步进化以最大化学习效率。

数据集

-

数据集构成与来源 作者构建了一个多环境数据集,源自五个不同的来源:MiniHack、WebShop、ALFWorld、SWE-Bench 和 Sokoban。这些环境涵盖了基于网格的导航、网页交互、家庭任务模拟、软件工程以及组合谜题求解。

-

各子集的关键细节

- MiniHack:针对 LLM 智能体进行了适配,使用文本符号表示实体,并采用战争迷雾观察模型。作者在四个难度递增的特定变体上进行评估:MiniHack Room(5x5 网格,方向性动作)、MiniHack Maze(9x9 网格,方向性动作)、MiniHack KeyRoom(需要获取钥匙并开门)以及 MiniHack River(需要推动巨石渡水)。

- WebShop:一个模拟购物基准,智能体在此发出搜索查询或点击按钮。作者使用了小型变体配置,将产品目录限制为 1,000 件商品,并根据属性频率对目标进行采样。

- ALFWorld:一个用于家庭任务的基于文本的交互式环境。训练集包含 1,466 个任务实例,另有 134 个实例被保留用于评估。

- SWE-Bench:一个软件工程基准,要求修改代码库以通过单元测试。作者利用了 SWE-Bench-Verified 子集,但应用了过滤策略,仅保留 124 个任务,其中基础模型的 pass@16 成功率介于 0% 到 80% 之间,排除了过于简单或不可能完成的任务实例。

- Sokoban:一个用结构化符号表示的基于文本的谜题游戏。Episode 被配置为包含两个箱子和两个目标的 6x6 房间,以创造具有挑战性的组合搜索空间。

-

模型使用与任务混合 本文根据可用环境定义了两个特定的训练混合集:

- 3 任务混合集:组合了 MiniHack Room、WebShop 和 ALFWorld。

- 6 任务混合集:在原有三个任务的基础上,扩展加入了 MiniHack Maze、MiniHack KeyRoom 和 Sokoban。 在强化学习过程中,所有环境通常采用二元奖励方案(成功为 1,失败为 0),ALFWorld 除外,其对失败情况分配 -1 的奖励。

-

处理与实现细节

- 符号表示:MiniHack 和 Sokoban 环境被转换为基于文本的格式,使用特定符号表示智能体、目标、障碍物和物体,以符合 LLM 的输入要求。

- 动作空间:动作定义因环境而异,从 MiniHack Room 中的简单方向移动,到 SWE-Bench 中的复杂工具使用(Bash, str_replace_editor),再到 ALFWorld 中的自然语言命令。

- 奖励逻辑:作者在大多数任务中实施了标准的二元奖励系统,而 ALFWorld 则利用负奖励来提供更强有力的学习信号。

方法

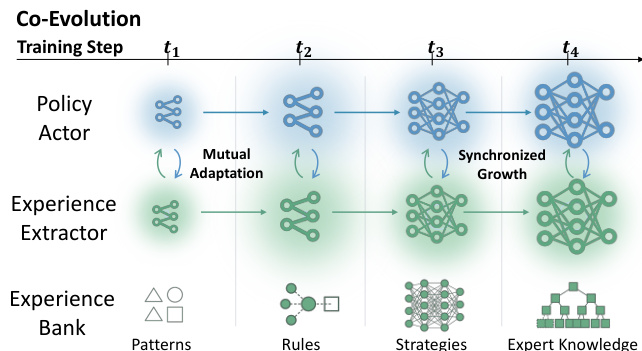

作者提出了互补强化学习(Complementary RL),这是一个统一的框架,在策略执行器与经验提取器之间建立协同进化关系。与传统方法中经验是静态的或由固定提取器收集不同,该方法联合优化两个组件以确保相互适应。如下图所示,系统通过不同的训练步骤演进,策略执行器和经验提取器的复杂度同步增长。

在初始阶段 t1,策略执行器和经验提取器都相对简单。随着训练推进到 t2 和 t3,策略执行器生成更高质量的轨迹,这使得经验提取器能够将更复杂的模式和规则提炼到经验库中。到了 t4,系统实现了同步增长,此时提取器提供专家知识以指导执行器,而执行器性能的提升则进一步精炼了经验库的质量。这种动态机制防止了静态经验系统中常见的分布错位问题,即随着策略的改进,指导变得过时。

算法设计依赖于每个组件特定的优化目标。经验提取器 πϕ 从完成的轨迹 τ 中提炼结构化经验 m,并使用 CISPO 目标进行优化。该目标通过根据其所引导轨迹的结果分配二元奖励,来最大化提炼经验的效用。策略执行器 πθ 则使用改进的组相对策略优化(GRPO)目标进行优化。为了防止过度依赖外部指导,作者将 rollout 划分为经验引导和经验自由两个子组。优势值在每个子组内独立计算以保持信号完整性,确保执行器在受益于检索知识的同时内化自身能力。

为了高效支持这种协同进化,作者实现了一个双循环基础设施,将 rollout 收集与经验提炼解耦。请参阅框架图以了解主训练循环和后台轨道的详细架构。在主训练循环中,策略执行器持续与环境交互以收集轨迹,并根据结果奖励更新其参数。与此同时,后台轨道管理经验管理器 H,后者监督经验库 M。经验管理器通过接收来自已完成 episode 的提炼请求,经由经验提取器处理它们,并使用写锁更新库以确保一致性,从而协调数据的异步流动。在检索方面,它采用查询批处理和并行搜索工作线程,并在读锁下运行,以最小化执行器的延迟。这种异步设计消除了同步障碍,允许执行器和提取器在独立的调度上进行优化,同时保持全局一致的经验库。

实验

- 互补强化学习在四个开放式环境中得到了验证,结果表明,将策略执行器与经验提取器协同进化,其表现始终优于静态基线以及缺乏经验整合的方法。

- 该方法通过提炼的经验引导执行器进行更有效的决策,从而实现了更高的成功率和改进的动作效率。

- 多重任务训练实验证实,协同进化对性能至关重要,因为静态提取器无法适应不断演变的执行器,导致分布错位和检索噪声。

- 增加经验提取器的容量进一步放大了收益,表明更强的模型能够提取更具泛化能力和信息量的经验。

- 随着训练任务数量的增加,该框架展现出稳健的可扩展性,在复杂的多重任务设置中,相比基线保持了显著的性能优势。

- 延迟分析表明,与标准基线相比,异步训练框架并未给 rollout 收集带来明显的开销。