Command Palette

Search for a command to run...

CHIMERA:用于可泛化LLM推理的紧凑型合成数据

CHIMERA:用于可泛化LLM推理的紧凑型合成数据

Xinyu Zhu Yihao Feng Yanchao Sun Xianzhi Du Pingzhi Li Olli Saarikivi Yun Zhu Yu Meng

摘要

大规模语言模型(LLMs)近期展现出卓越的推理能力,这主要得益于在高质量推理数据上采用监督微调(SFT)和强化学习(RL)等后训练方法。然而,在开放且可扩展的环境中复现并拓展这些能力,仍面临三大以数据为中心的根本性挑战:(1)冷启动问题——缺乏包含详细、长链条思维(Chain-of-Thought, CoT)轨迹的初始数据集,难以有效初始化推理策略;(2)领域覆盖有限——现有大多数开源推理数据集集中于数学领域,对更广泛的科学学科覆盖不足;(3)标注瓶颈——前沿级推理任务难度高,导致可靠的人工标注成本过高甚至不可行。为应对上述挑战,我们提出 CHIMERA,一个轻量级的合成推理数据集,包含9,000个样本,旨在支持可泛化的跨领域推理。CHIMERA 具备三个关键特性:(1)由当前最先进的推理模型生成丰富且长周期的 CoT 推理轨迹,确保推理过程的深度与连贯性;(2)具备广泛而结构化的领域覆盖,涵盖8大学科门类,涵盖超过1,000个细粒度主题,并通过模型自动生成的层级化分类体系进行组织;(3)采用完全自动化、可扩展的评估流程,利用强推理模型对问题的有效性与答案的正确性进行交叉验证。我们利用 CHIMERA 对一个40亿参数的 Qwen3 模型进行后训练。尽管数据集规模相对有限,该模型在一系列具有挑战性的推理基准测试中表现优异,包括 GPQA-Diamond、AIME 24/25/26、HMMT 25 以及 Humanity's Last Exam,其推理性能已接近甚至达到远大于其规模的模型(如 DeepSeek-R1 和 Qwen3-235B)的水平。

一句话总结

来自多个机构的研究人员提出了 CHIMERA——一个包含 9K 个样本的紧凑型合成推理数据集,涵盖 8 个科学领域的长链式思维(CoT)轨迹,可实现无需人工标注的可扩展后训练,使 Qwen3-4B 模型在高级推理基准测试中达到与更大模型相当的性能。

主要贡献

- CHIMERA 通过引入完全由前沿模型生成的 9K 样本紧凑合成数据集,解决了大语言模型推理后训练中的三大关键数据瓶颈:长 CoT 轨迹冷启动稀缺、领域覆盖狭窄、人工标注成本高昂。

- 该数据集提供涵盖 8 个科学学科和 1K+ 细粒度主题的丰富多步推理轨迹,这些主题通过模型生成的分类体系组织,实现广泛泛化的同时保持结构连贯性,无需人工标注。

- 使用 CHIMERA 通过 SFT 和 RL 对 4B Qwen3 模型进行后训练,使其在 GPQA-Diamond、AIME、HMMT 和 Humanity’s Last Exam 等前沿基准测试中表现具有竞争力,达到或接近 DeepSeek-R1 和 Qwen3-235B 等更大模型的水平。

引言

作者利用合成数据解决训练大语言模型进行通用推理时的关键瓶颈:缺乏包含长链式思维轨迹的种子数据集、领域覆盖狭窄(主要为数学)以及前沿任务人工标注成本高昂。以往的合成数据集常缺乏结构、多样性或可靠的质量控制,限制了其后训练效果。他们的主要贡献是 CHIMERA——一个基于三大设计支柱构建的 9K 样本紧凑数据集:由强模型生成的长 CoT 轨迹、通过模型生成分类体系覆盖 8 个科学领域和 1K+ 主题、以及使用跨模型验证全自动评估确保正确性——无需人工标注。在 CHIMERA 上对 4B Qwen3 模型进行后训练,使其在多项挑战性基准测试中表现与 DeepSeek-R1 和 Qwen3-235B 等更大模型相当。

数据集

作者使用完全由大语言模型构建的合成推理数据集 CHIMERA,在无需人工标注的情况下训练模型解决复杂的跨学科问题。其结构与使用方式如下:

-

数据集组成与来源

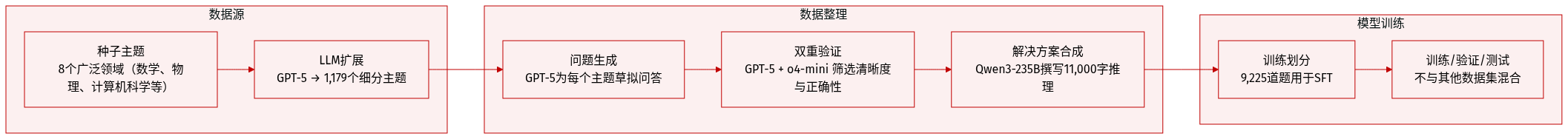

- 基于 8 个广泛学科(数学、物理、计算机科学、化学、生物、文学等)构建,使用 GPT-5 进行主题扩展和问题生成,Qwen3-235B 进行解决方案合成。

- 从粗粒度种子主题出发,通过大语言模型提示扩展为 1,179 个细粒度主题。

- 问题均为自包含、博士级别、需多步推理;每个问题包含学科、主题、问题、答案、详细解法和正确性标签。

-

关键子集细节

- 总计:9,225 道题目,数学占比最高(48.3%),其次为计算机科学、化学和物理。

- 每个主题生成多道题目(每主题 n 道),通过双大语言模型验证器(GPT-5 和 o4-mini)筛选,确保清晰性、可解性和答案正确性。

- 主题经去重并分层组织;数学因领域广度获得额外采样。

- 解法平均字数达 11K,显著长于以往数据集,鼓励深度、长视野推理。

-

训练用途

- 作为监督微调(SFT)的训练集使用,未提及混合比例——似乎以单体方式使用。

- 设计用于补充现有基准(如 GSM8K、MATH、GPQA),强调结构多样性而非规模。

- 论文中题目未与其他数据集混合;重点是通过复杂、跨领域的推理训练高级大语言模型。

-

处理与元数据

- 无裁剪——所有题目均为完整长度且自包含。

- 元数据包括学科-主题层级、题目陈述、答案、解题轨迹和正确性标志(True/False)。

- 过滤自动化:未通过双验证器检查(清晰性、答案正确性)的题目被丢弃。

- 所有阶段(扩展、生成、验证)的提示语见附录 A;完整样本见附录 C。

方法

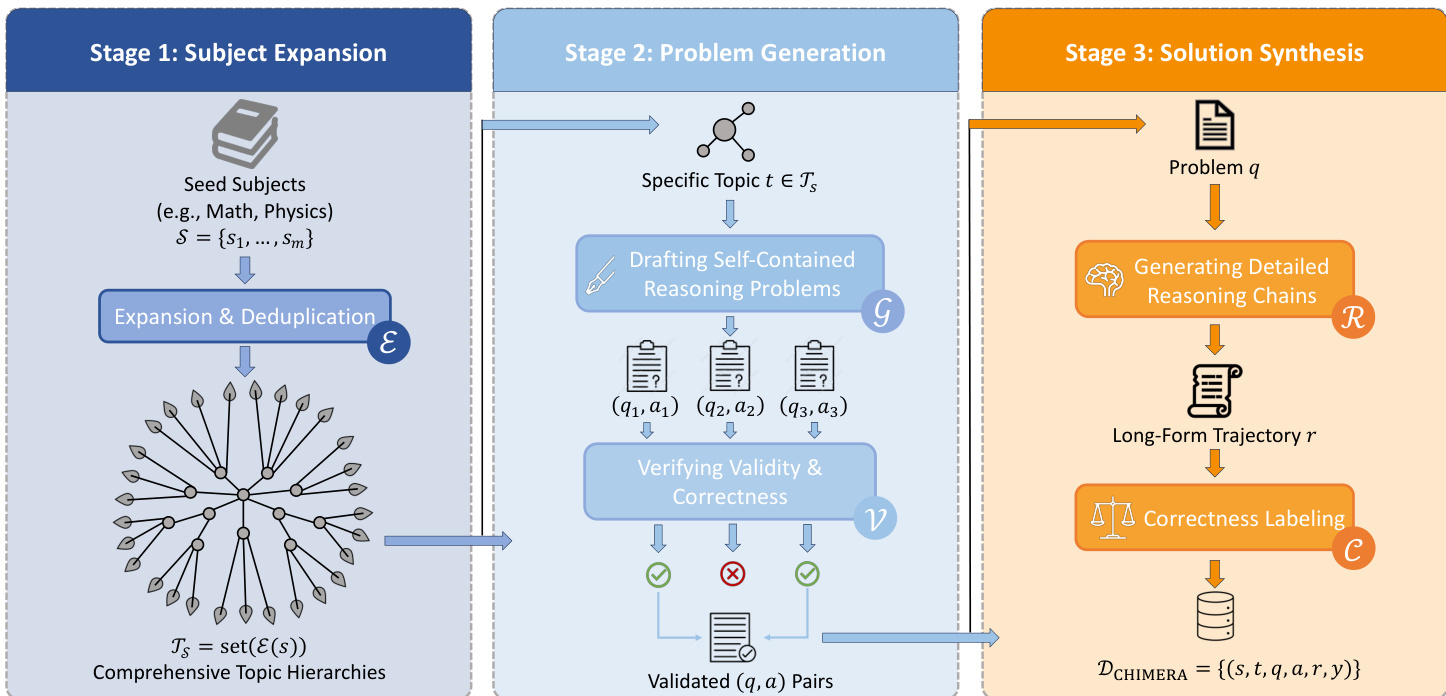

作者采用三阶段流水线构建高质量、推理密集型数据集 CHIMERA。整体框架旨在系统扩展学科领域、生成自包含问题、合成带正确性标签的详细推理轨迹,支持监督微调与强化学习应用。

第一阶段“学科扩展”:从种子学科集合 S={s1,...,sm}(如数学、物理)开始,通过模块 E 扩展并去重,生成完整的主题层级集合 TS=set(E(S))。该阶段确保跨学科与子主题的广泛覆盖,为后续问题生成奠定基础。

第二阶段“问题生成”:对每个特定主题 t∈TS,问题草拟模块 G 生成自包含推理问题 (qi,ai),其中 qi 为题目陈述,ai 为参考答案。候选题目随后传递至验证模块 V,验证其有效性与正确性。仅通过验证的 (q,a) 对进入下一阶段,确保所有题目在进一步处理前满足质量与准确性阈值。

第三阶段“解法合成”:在此阶段实现核心推理增强。对每个已验证的问题 q,使用强开放推理模型 R(此处为 Qwen3-235B-A22B-Thinking-2507)生成详细、分步推理轨迹 r。该轨迹随后与原始答案 a 对比,通过标注模块 C 生成二元正确性标签 y∈{0,1}。最终输出为结构化数据集 DCHIMERA={(s,t,q,a,r,y)},每个条目包含学科、主题、问题、答案、推理链和正确性标签。

请参阅框架图以获取三阶段流水线及其模块组件的可视化概览。

实验

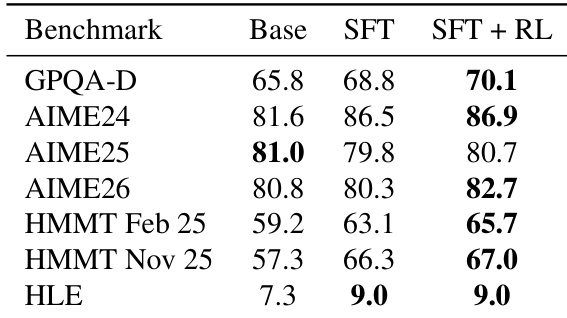

- 在 CHIMERA 上微调 Qwen3-4B 显著提升其在多个基准测试中的推理性能,达到或超越高达 235B 参数的模型,展现出卓越的数据效率。

- CHIMERA 的合成题目显著难于现有数据集,提供更强的训练信号,即使对强基座模型仍有提升空间。

- 仅监督微调即可带来大部分性能提升;强化学习仅提供增量改进,凸显数据集固有质量。

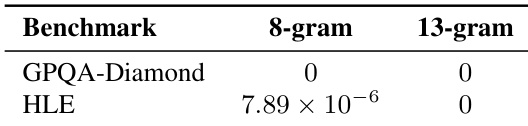

- 独立评估者认为 CHIMERA 中大语言模型生成的题目在清晰度、设定合理性和推理深度上与人工编写题目相当或更优。

- 与评估基准近乎零词法重叠,确认无数据污染,验证性能提升源于真实推理能力增强。

- 推理时扩展显示随样本量增加性能持续提升,表明增强的鲁棒性和更广的解法覆盖,而非仅单次准确率提升。

- 在 OpenScience 上微调性能下降,可能因其多选格式鼓励捷径策略而非深度推理。

- CHIMERA 结构化、多步、自由形式题目与详细解法轨迹是推动现代大语言模型推理能力的关键。

作者使用合成数据集 CHIMERA 微调 4B 参数基座模型,实现与高达两个数量级更大模型相当的性能。结果表明在多个推理基准测试中持续提升,仅监督微调即贡献大部分改进,表明数据集高质量与高难度。推理时扩展进一步揭示推理鲁棒性增强,因采样增加时性能差距扩大,暗示更广的有效解法路径覆盖。

在 CHIMERA 数据集上微调 Qwen3-4B 基座模型,在多个推理基准测试中持续提升性能,仅监督微调即贡献大部分提升,强化学习提供增量改进。最终模型实现与更大模型相当的性能,展现强数据效率。这些改进在推理时扩展下仍持续,表明增强的推理鲁棒性和更广的解法覆盖,而非仅单次准确率提升。

作者使用合成数据集 CHIMERA 微调 4B 参数基座模型,实现与高达两个数量级更大模型相当的性能。结果表明在多个推理基准测试中持续提升,仅监督微调即贡献大部分改进,表明数据集高质量与高难度。推理时扩展进一步揭示推理鲁棒性增强,因采样增加时性能差距扩大,暗示更广的有效解法路径覆盖。

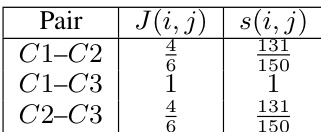

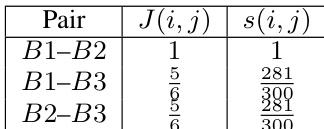

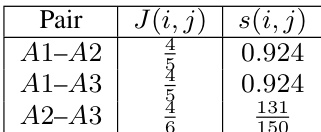

作者使用 n-gram Jaccard 相似度评估其合成训练数据与评估基准间的词法重叠,发现 GPQA-Diamond 和 HLE 均近乎零污染。这表明性能提升并非源于记忆或数据泄露,而是真实推理能力的提升。结果支持模型对未见挑战性问题的泛化能力。

作者使用合成数据集 CHIMERA 微调 4B 参数基座模型,实现与高达两个数量级更大模型相当的性能。结果表明在多个推理基准测试中持续提升,仅监督微调即贡献大部分改进,表明数据集高质量与高难度。推理时扩展进一步揭示推理鲁棒性增强,因采样增加时性能差距扩大,暗示更广的有效解法路径覆盖。