Command Palette

Search for a command to run...

通过 ScaleFormer 实现跨尺度 Pansharpening 以及 PanScale 基准测试

通过 ScaleFormer 实现跨尺度 Pansharpening 以及 PanScale 基准测试

Ke Cao Xuanhua He Xueheng Li Lingting Zhu Yingying Wang Ao Ma Zhanjie Zhang Man Zhou Chengjun Xie Jie Zhang

摘要

全色锐化(Pansharpening)旨在通过融合全色图像(Panchromatic images)的空间细节与低分辨率多光谱(MS)数据的光谱丰富度,来生成高分辨率的多光谱图像。然而,现有的大多数方法都是在有限的低分辨率设置下进行评估的,这限制了它们在真实世界高分辨率场景中的泛化能力。为了弥补这一差距,我们系统地研究了跨尺度全色锐化在数据、算法以及计算方面面临的挑战。首先,我们推出了 PanScale,这是首个大规模跨尺度全色锐化数据集,并配套推出了 PanScale-Bench,这是一个用于评估不同分辨率和尺度下泛化能力的全面 benchmark。为了实现尺度泛化,我们提出了 ScaleFormer,一种专为多尺度全色锐化设计的创新架构。ScaleFormer 将图像分辨率间的泛化问题重新定义为序列长度(sequence lengths)之间的泛化问题:它将图像转化为分辨率相同、但长度随图像尺度按比例变化的 patch 序列。通过引入 Scale-Aware Patchify 模块,模型能够利用固定尺寸的裁剪图(crops)来应对此类尺度变化进行训练。随后,ScaleFormer 将 patch 内部的空间特征学习与 patch 间的序列依赖建模进行解耦,并结合 Rotary Positional Encoding 以增强对未知尺度的外推能力。

一句话总结

作者介绍了 PanScale,这是首个大规模跨尺度全色锐化数据集,以及 PanScale-Bench 和 ScaleFormer。ScaleFormer 是一种新颖的架构,它将图像 token 化为可变长度的 patch 序列,并采用旋转位置编码(Rotary Positional Encoding),将 patch 内的空间特征学习与 patch 间的序列依赖建模解耦,以增强对未见尺度的外推能力。

核心贡献

-

介绍了 PanScale,一个大规模跨尺度全色锐化数据集,以及 PanScale-Bench,一个用于评估不同分辨率下泛化能力的综合基准。该标准化平台使得在现实应用遇到的各种多尺度场景中对方法进行系统测试和评估成为可能。

-

提出了 ScaleFormer,这是一种新颖的架构,通过将图像 token 化为可变长度的 patch 序列,将分辨率泛化重构为序列长度泛化。尺度感知分块(Scale-Aware Patchify)模块支持从固定大小裁剪进行训练,该方法利用旋转位置编码将 patch 内的空间特征学习与 patch 间的序列依赖建模解耦。

-

在 PanScale 基准内的多个数据集上进行了大量实验,表明该方法在多个尺度上实现了准确且高效的融合。结果表明,即使在处理超高分辨率输入时,该方法仍能保持高性能,突显了其强大的泛化能力。

引言

高分辨率多光谱图像对于环境监测和精准农业至关重要,但卫星硬件限制 necessitate 通过全色锐化融合全色和低分辨率光谱数据。由于计算成本高昂、分块推理伪影以及训练和推理尺度之间的分布偏移,当前的方法往往无法泛化到现实世界的高分辨率场景。为了弥合这一差距,作者提出了 PanScale,这是首个大规模跨尺度数据集,以及用于标准化评估的 PanScale-Bench。他们进一步提出了 ScaleFormer,这是一种新颖的架构,将分辨率变化视为序列长度变化,从而将空间特征学习与序列依赖建模解耦。这种设计实现了高效推理和在不同图像尺度下的鲁棒泛化,无需依赖分块。

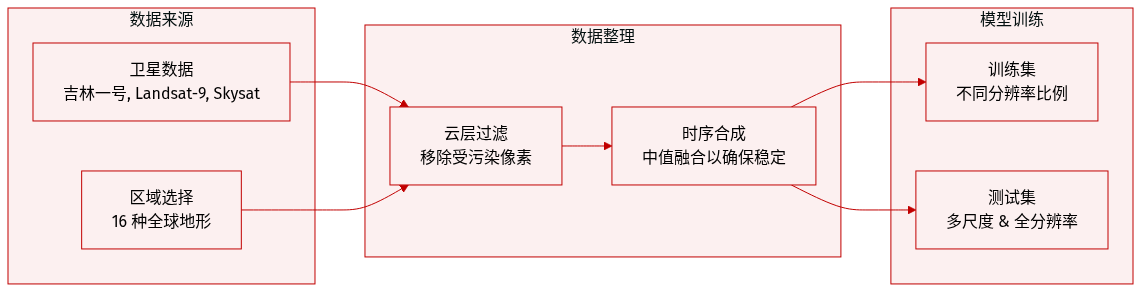

数据集

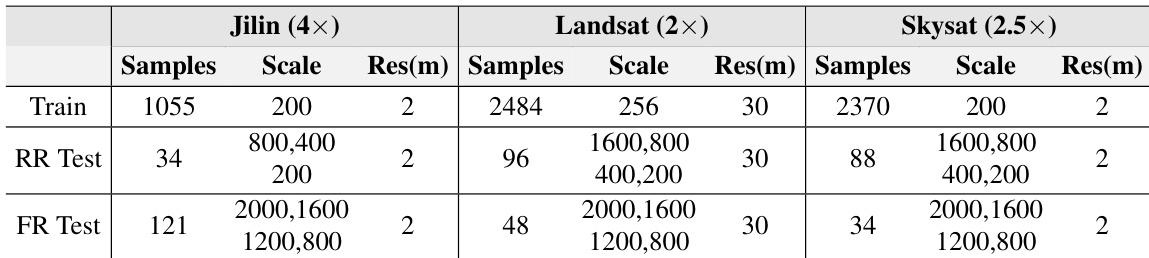

- 组成与来源: 作者利用 Google Earth Engine 获取了来自吉林一号、Landsat-9 和 Skysat 卫星的多源遥感数据。他们选择了全球 16 个地理多样化的区域,涵盖城市、山区、海洋和沙漠等地形。

- 预处理步骤: 使用质量评估波段去除受云污染的像素以生成二值云掩膜。团队在时间间隔内的无云观测上应用像素级中值合成,以创建时间稳定且去噪的合成波段。

- 训练数据: 每个子数据集都包含具有不同上采样比率的训练集,以使模型接触不同的分辨率级别。吉林一号使用 4 倍比率,而 Landsat-9 和 Skysat 分别使用 2 倍和 2.5 倍比率。

- 测试框架: 该基准包括 1600x1600、800x800、400x400 和 200x200 像素的多尺度降分辨率测试集。吉林子集由于最大分辨率限制排除了 1600x1600 变体。还提供了全分辨率测试集以评估跨现实世界空间变化的鲁棒性。

方法

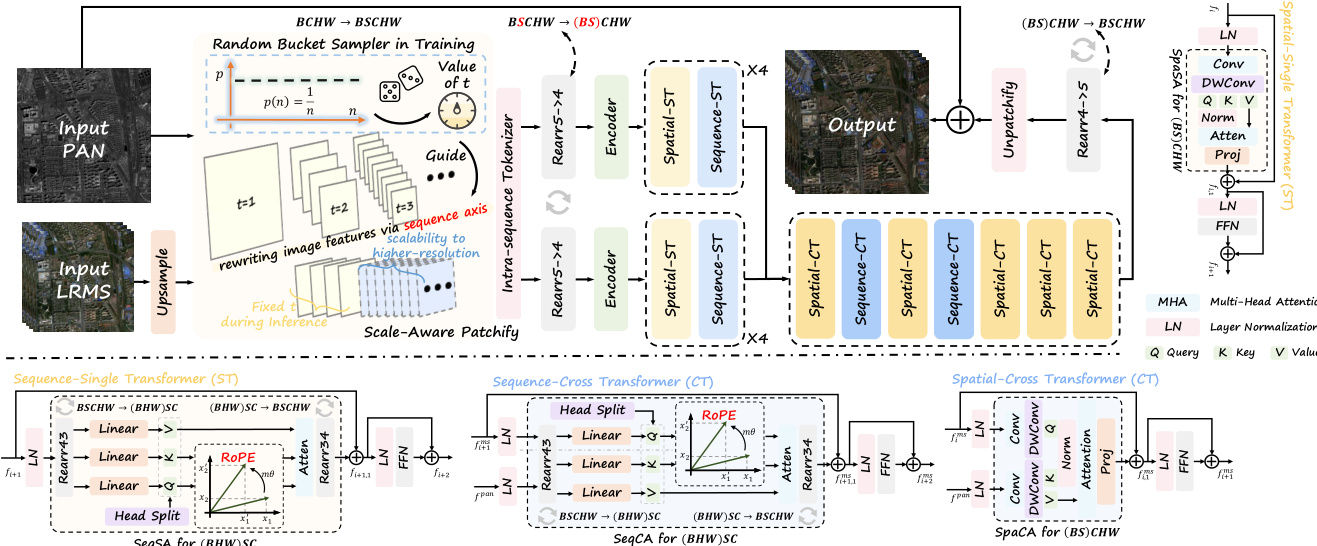

作者提出了 ScaleFormer,这是一个旨在通过解耦空间信息与尺度特定特征来解决跨尺度全色锐化挑战的框架。整体架构如框架图所示,通过一系列专用模块处理全色(PAN)和低分辨率多光谱(LRMS)输入,以生成高分辨率多光谱输出。

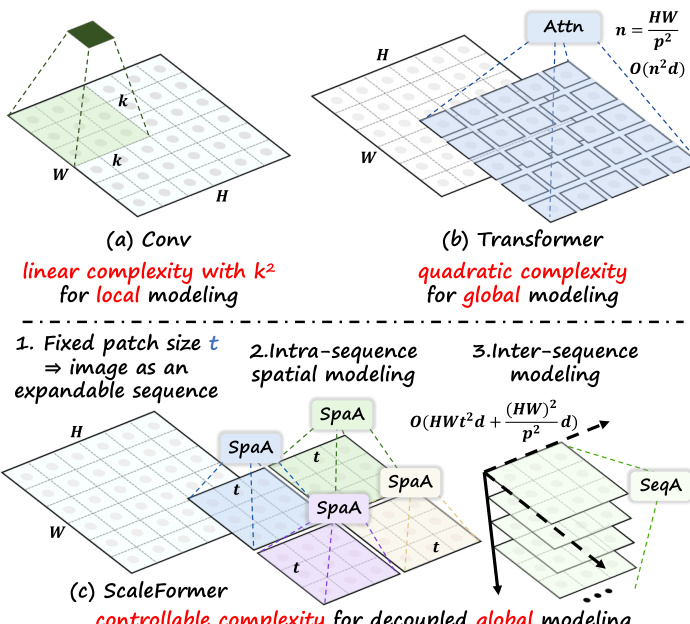

ScaleFormer 的设计哲学源于局部建模和全局建模之间的权衡。如下图所示,标准卷积操作为局部建模提供线性复杂度但缺乏全局感受野,而标准 Transformer 提供全局建模但产生二次复杂度。ScaleFormer 通过将图像视为可扩展序列,实现了用于解耦全局建模的可控复杂度。

尺度感知分块 (Scale-Aware Patchify) 流程始于尺度感知分块(SAP)模块。为了减轻由不同输入分辨率引起的分布偏移,作者在训练期间采用了基于桶的采样策略。给定输入 PAN 图像 P 和上采样的 MS 图像 L,SAP 模块随机采样桶索引 t 以确定窗口大小。这将输入划分为多尺度 tokens 序列,有效地将局部图像证据重写为额外的序列轴。该操作可表示为:

P5d,L5d=SAP(P),SAP(L)其中 P5d∈RB×T×C×h×w。在推理期间,确定性地使用固定窗口大小,确保更高的空间分辨率通过沿尺度轴延长序列来处理,同时保持稳定的每个 token 统计信息。

单 Transformer 模块 分块后,特征通过轻量级编码器进入单 Transformer 模块。这些模块专门用于独立捕获空间和序列域内的依赖关系。架构由空间 Transformer 和序列 Transformer 组成。

空间 Transformer 专注于建模每个 patch 内的局部和全局空间关系。同时,序列 Transformer 沿新引入的序列维度操作,以学习跨 patch 相关性并捕获尺度感知的上下文依赖。这种分离允许模型将空间编码与尺度建模解耦。特征图 fi 的处理流程涉及带有自注意力和前馈网络的残差连接:

fi,1=fi+SAspa(LN(fi)) fi+1=fi,1+FFN(LN(fi,1)) fi+1,1=fi+1+SAseq(LN(fi+1)) fi+2=fi+1,1+FFN(LN(fi+1,1))为了增强尺度外推,旋转位置嵌入(RoPE)被纳入映射的查询和键中,编码连续的相对位置信息。

交叉 Transformer 模块 为了促进全色和多光谱模态之间的有效特征融合,该框架采用交叉 Transformer 模块。这些包括空间交叉 Transformer 和序列交叉 Transformer,它们分别通过沿空间和尺度维度的交叉注意力机制实现双向信息交换。

给定输入特征图 fims 和 fipan,交叉注意力操作定义为:

fi,1ms=fims+CAspa(LN(fims),LN(fpan)) fi+1ms=fi,1ms+FFN(LN(fims)) fi+1,1ms=fi+1ms+CAseq(LN(fi+1ms),LN(fpan)) fi+2,1ms=fi+1,1ms+FFN(LN(fi+1,1ms))与单模态注意力类似,在 CAseq 期间应用重排操作以合并批次和空间维度,并注入 RoPE 以支持跨尺度的泛化。

损失函数 最后,模型被训练以最小化重建的高分辨率多光谱图像 Hout 与真实值 G 之间的像素级差异。作者采用 L1 范数作为损失函数:

L=∥Hout−G∥1实验

评估框架使用 PanScale 数据集和标准化指标将所提出的方法与代表性的传统和深度学习基线进行比较。对比实验验证了该模型实现了卓越的融合质量和可扩展性,在输入分辨率增加时保持稳定的性能,同时比最先进的方法使用更少的参数和更低的计算资源。此外,消融研究证实,在处理多样化的遥感数据时,特定的架构设计对于确保有效的尺度感知和泛化是必要的。

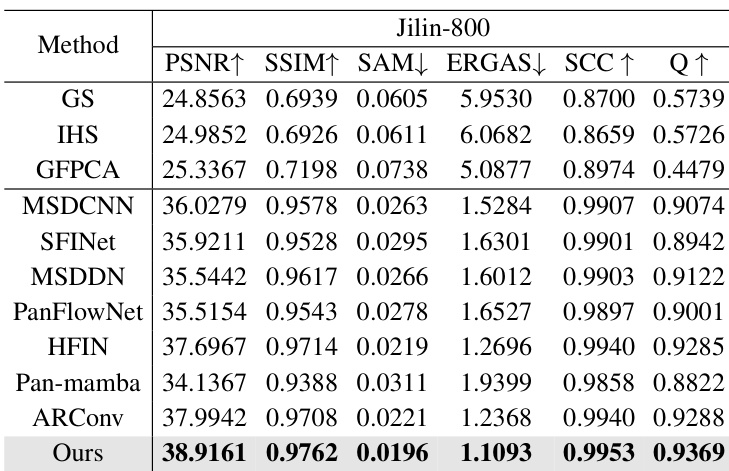

作者在吉林 -800 数据集上将提出的方法与各种传统算法和最先进的深度学习模型进行了比较。实验结果表明,所提出的方法在所有评估指标上始终优于所有竞争方法。这证明了与现有技术相比,在保留空间细节和光谱保真度方面具有卓越的能力。所提出的方法在 PSNR 和 SSIM 等空间保真度指标中取得了最高分数。结果表明,在所有测试方法中光谱失真水平最低。该方法在所有类别上均优于 HFIN 和 ARConv 等最近的深度学习基线。

该表详细说明了 PanScale 数据集的配置,包括吉林、Landsat 和 Skysat,涵盖训练、降分辨率和全分辨率测试阶段。它说明了虽然训练集利用单个固定图像尺度,但测试集包含各种尺度以评估不同分辨率下的性能。此外,数据集的基础空间分辨率不同,Landsat 数据集明显比其他数据集粗糙。训练集由单个尺度的图像组成,而测试集涵盖更广泛的图像尺寸。Landsat 数据集的空间分辨率比吉林和 Skysat 数据集粗糙。全分辨率测试集包括多个尺度,以验证模型在高分辨率图像上的鲁棒性。

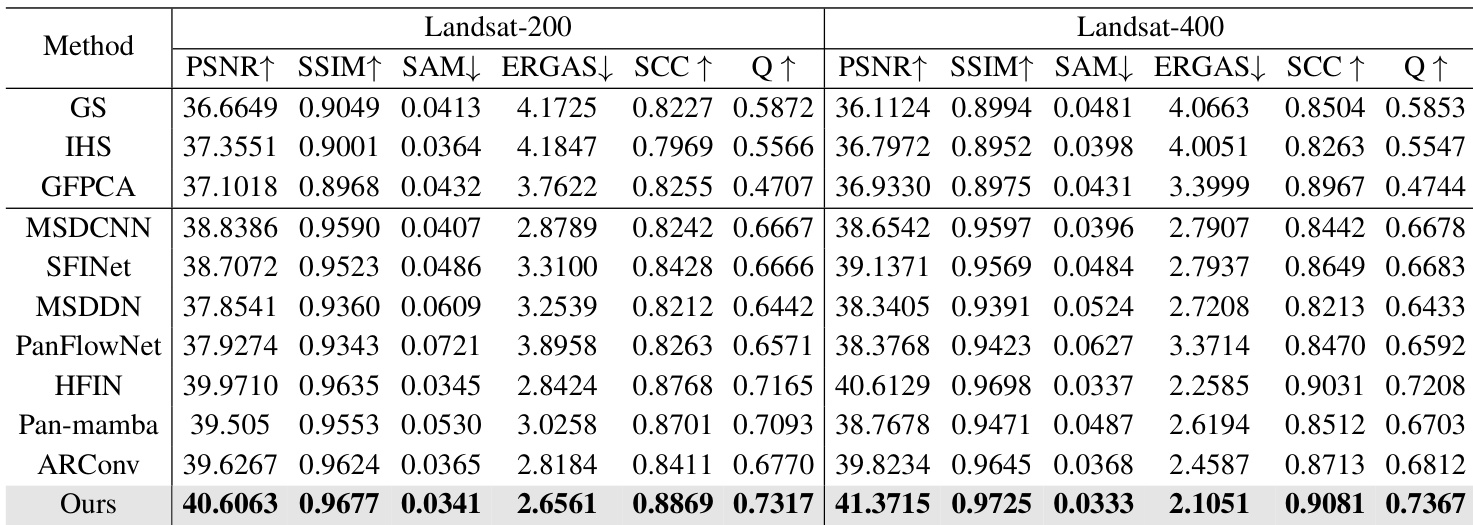

作者在 Landsat 数据集上将提出的方法与各种传统和基于深度学习的 pansharpening 方法进行了比较。结果表明,所提出的方法在所有评估指标上始终优于所有竞争技术,证明了卓越的空间细节保留和光谱保真度。所提出的方法在 PSNR 和 SSIM 等空间保真度指标中取得了最高分数,同时保持最低的光谱失真误差。性能优势在 Landsat-200 和 Landsat-400 数据集上均保持一致,显示出对分辨率变化的鲁棒性。该方法在整体图像质量评估方面超越了最先进的深度学习基线以及经典图像融合技术。

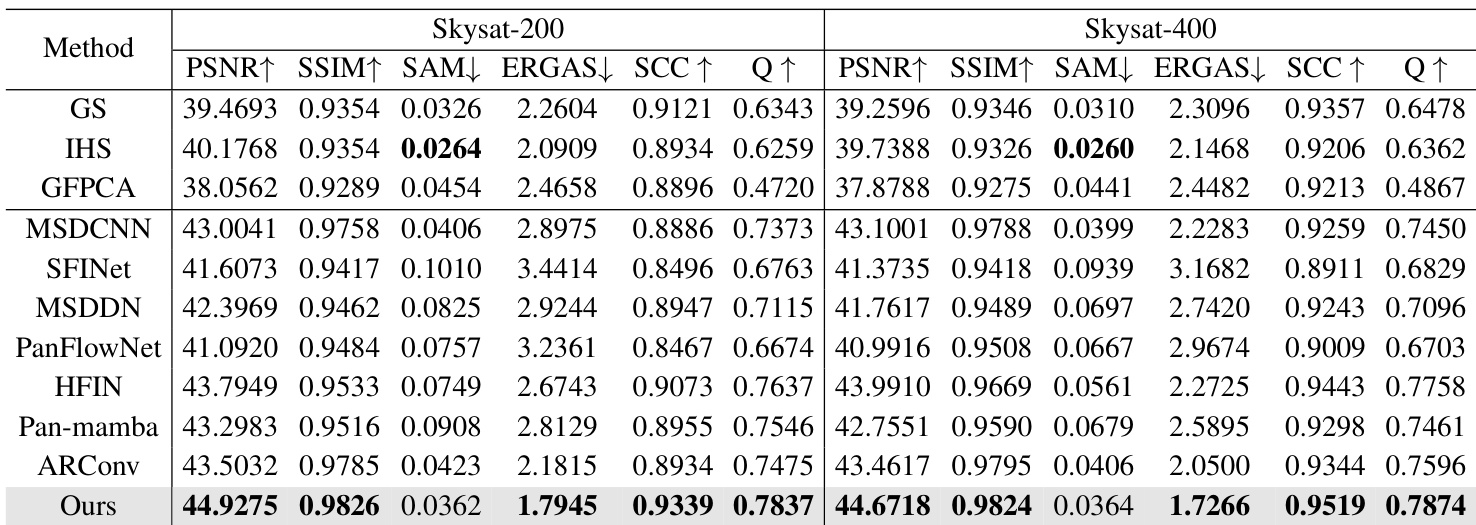

作者在 Skysat 数据集上将提出的方法与传统和深度学习基线进行了比较。结果表明,所提出的方法通常优于竞争方法,在大多数空间和质量指标中取得了领先分数。所提出的方法在 PSNR、SSIM 和 SCC 等空间保真度和质量指数中取得了顶级性能。通过在两个数据集上实现最低的 ERGAS 分数,它展示了卓越的光谱合成质量。该方法在大多数测量标准上优于 ARConv 和 HFIN 等强大的深度学习基线。

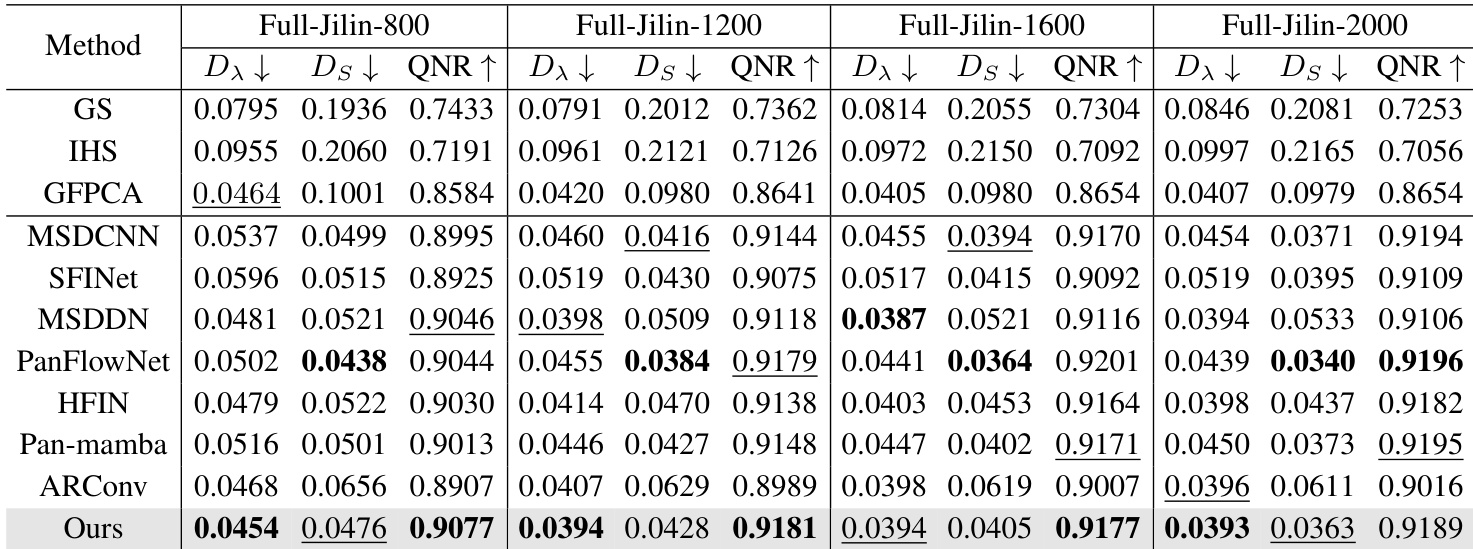

作者在无参考质量指标上使用全分辨率吉林数据集将提出的方法与各种传统和深度学习基线进行了比较。结果表明,所提出的方法在所有测试的空间尺度上始终实现了卓越或极具竞争力的性能。所提出的方法在所有测试的分辨率尺度上实现了最低的光谱失真。空间失真得到有效最小化,该方法始终排名第二。整体图像质量保持高水平,在大多数测试案例中优于大多数竞争方法。

作者在具有不同空间分辨率和尺度的吉林、Landsat 和 Skysat 数据集上评估了所提出的方法与传统算法和最先进的深度学习模型。此设置通过测试降分辨率和全分辨率图像上的性能来验证模型鲁棒性,以确保在不同条件下的可靠性。实验结果表明,所提出的方法在保留空间细节和光谱保真度方面始终优于竞争技术,同时最小化失真以实现卓越的整体图像质量。