Command Palette

Search for a command to run...

从规模到速度:面向图像编辑的自适应测试时缩放

从规模到速度:面向图像编辑的自适应测试时缩放

摘要

图像思维链(Image Chain-of-Thought,Image-CoT)是一种测试时扩展(test-time scaling)范式,通过延长推理时间来提升图像生成质量。目前大多数Image-CoT方法集中于文本到图像(Text-to-Image, T2I)生成任务。然而,与T2I生成不同,图像编辑具有明确的目标导向性:其解空间受到源图像和指令的双重约束。这种本质差异导致在将Image-CoT应用于图像编辑时面临三大挑战:固定采样预算下资源分配效率低下、早期阶段依赖通用多模态大模型(MLLM)评分进行验证的可靠性不足,以及大规模采样带来的冗余编辑结果。为应对上述问题,本文提出一种按需测试时扩展框架——自适应编辑思维链(ADaptive Edit-CoT,ADE-CoT),以显著提升图像编辑的效率与性能。该框架融合三项关键技术策略:(1)基于编辑难度感知的动态资源分配机制,根据预估的编辑难度自动调整采样预算;(2)在早期剪枝阶段引入面向编辑任务的验证机制,结合区域定位与图像描述一致性判断,筛选出更具潜力的候选结果;(3)基于实例特定验证器引导的深度优先机会性终止策略,在检测到符合意图的编辑结果时立即停止采样,避免无效计算。在三个前沿编辑模型(Step1X-Edit、BAGEL、FLUX.1 Kontext)及三个基准数据集上的大量实验表明,ADE-CoT在性能与效率之间实现了显著更优的权衡。在与传统Best-of-N方法相当的采样预算下,ADE-CoT不仅取得了更优的生成质量,且整体推理速度提升超过2倍。

一句话总结

来自中国科学院、中国科学院大学、阿里巴巴和昆士兰大学的研究人员提出了 ADE-CoT,这是一种自适应测试时扩展框架,能够动态分配资源,通过区域感知检查验证编辑,并在目标达成时提前终止——相比先前的 Image-CoT 方法,在图像编辑任务中显著提升效率与性能。

主要贡献

- ADE-CoT 通过引入难度感知资源分配机制,解决 Image-CoT 应用于图像编辑时的低效问题:动态为复杂编辑分配更多采样预算,同时在简单编辑上节省计算资源。

- 它用编辑特定指标——区域定位与描述一致性——取代通用 MLLM 验证,从而在早期精准剪枝低潜力候选,避免误判导致在早期去噪阶段丢弃有前景的结果。

- ADE-CoT 实施由实例特定验证器引导的深度优先机会性终止策略,在找到符合意图的结果后立即停止生成,在三个最先进的编辑模型和基准上实现超过 2 倍的加速,同时性能更优。

引言

作者利用传统用于提升文生图生成效果的测试时扩展技术,改进图像编辑任务,其中输出必须同时精确匹配源图像与编辑指令。先前为开放生成设计的 Image-CoT 方法在编辑任务中存在三大缺陷:固定采样预算在简单编辑上浪费算力;通用 MLLM 验证器在早期阶段误判候选;大规模采样产生冗余的正确结果。为解决这些问题,他们提出 ADE-CoT:根据编辑难度动态分配计算资源,使用区域与描述感知验证实现早期剪枝,并在找到符合意图的结果后应用深度优先机会性终止。在三个最先进模型上的评估表明,ADE-CoT 在相近预算下比 Best-of-N 实现超 2 倍加速,同时性能更优。

方法

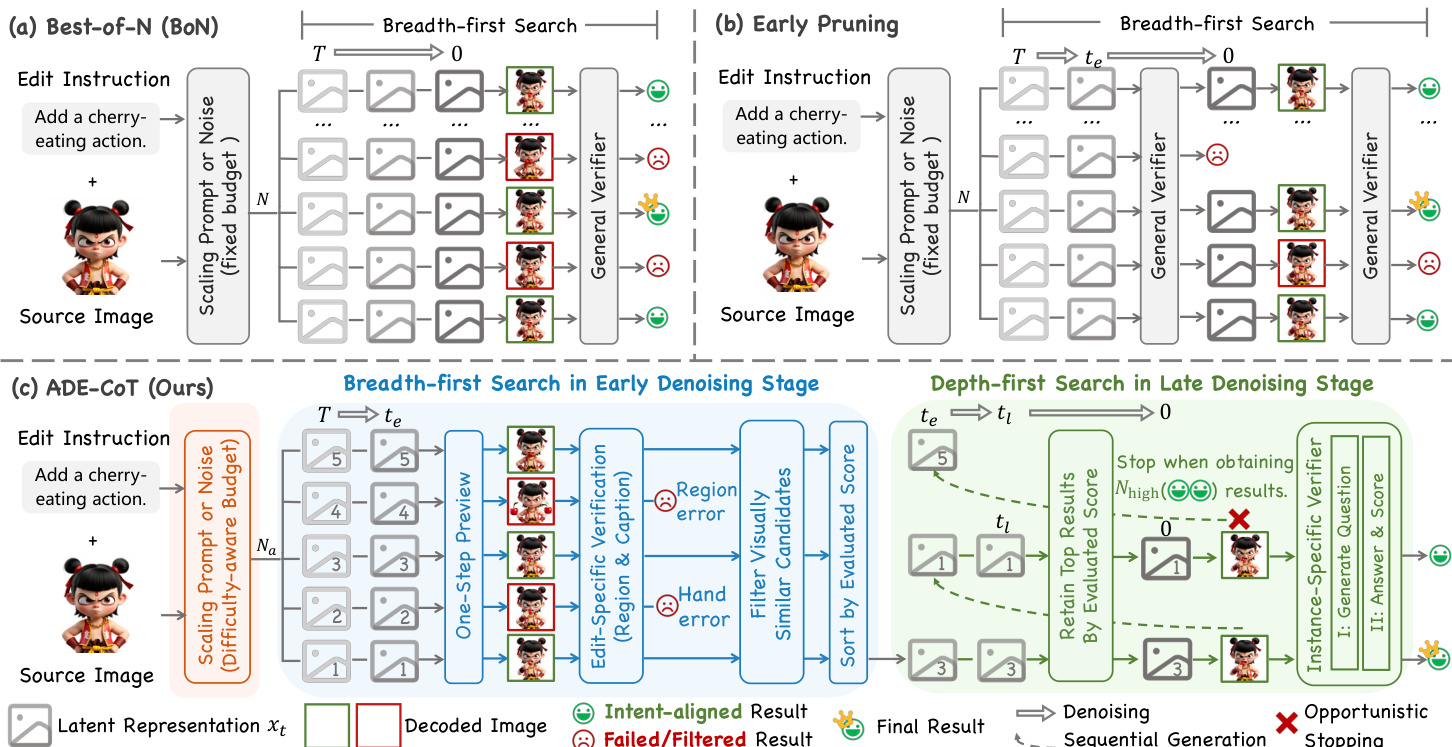

作者采用三阶段自适应框架 ADE-CoT,以解决标准 Image-CoT 方法在图像编辑中的低效与不准确问题。核心创新在于动态分配计算资源、使用编辑特定信号优化早期验证、并在找到足够符合意图的结果后立即终止生成。该方法将固定广度优先搜索转变为引导式深度优先过程,优先保障质量与效率。

框架始于难度感知资源分配策略。系统不采用固定采样预算 N,而是首先从源图像 Isrc 和编辑指令 c 生成一个候选图像。通用 MLLM 验证器为此候选分配初始分数 S,作为编辑难度的代理。随后计算自适应预算 Na:

Na=Nmin+⌈(N−Nmin)×(1−S/Smax)γ⌉,其中 Nmin 为最小预算,Smax 为最大可能分数,γ 控制敏感度。这确保简单编辑(高 S)使用最少样本,而困难编辑(低 S)获得更大预算,优化资源使用。

预算分配后,系统进入早期剪枝阶段,采用由编辑特定验证引导的深度优先搜索。在早期去噪时间步 te,系统生成一组 Na 个中间潜在变量。对每个潜在变量,采用一步预览机制,利用模型预测的噪声 ϵθ 从噪声潜在变量 xte 估计干净潜在变量 x0∣te:

x0∣te=xte−σteϵθ(xte,Tte).随后,预览图像 I0∣te 使用统一分数 S 评估,该分数结合三个部分:通用 MLLM 分数 Sgen、编辑区域正确性分数 Sreg、指令与描述一致性分数 Scap。区域正确性分数通过提示 MLLM 使用 Preg 识别需编辑或保留的对象,再通过 Grounded SAM2 生成二值掩码 M。计算编辑图像与源图像之间的逐像素变化图 Δ 并通过 softmax 归一化,Sreg 为掩码内变化总和:

Sreg=H,W∑M⊙H,Wsoftmax(Δ).描述一致性分数通过提示 MLLM 使用 Pcap 为理想编辑图像生成目标描述 ccap,再评估预览图像与此描述间的 CLIP 相似度:

Scap=CLIPScore(I,ccap).统一分数为加权和:

S=Sgen+λregSreg+λcapScap.得分低于拒绝阈值 Srj 的候选被剪枝。为进一步减少冗余,使用 DINOv2 嵌入过滤视觉相似候选,剩余候选按统一分数降序排序。

最终阶段为深度优先机会性终止。系统按排序顺序逐个处理候选。在稍后时间步 tl,应用自适应过滤器:仅当候选预览分数与当前最佳分数之差在容差 δ 内时,才保留其进行完整生成。对保留候选,系统执行完整去噪至 t=0,并应用实例特定验证器。该验证器使用两阶段 MLLM 提示:首先 Pq 生成关于编辑的五个具体是非问题,然后 Pa 回答这些问题。实例特定分数 Sspec 为“是”答案数量。当 Nhigh 个候选获得满分(全“是”答案)后搜索终止,选择综合分数最高的候选作为最终输出。

请参阅框架图以直观比较三种策略。图中展示了 ADE-CoT 如何整合难度感知预算、编辑特定验证和机会性终止,以克服固定预算与通用分数方法的局限。

实验

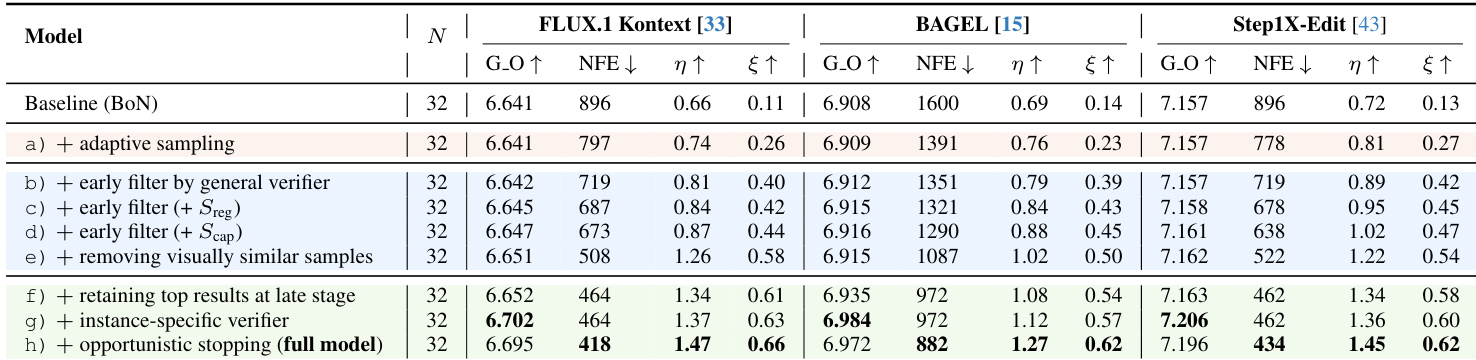

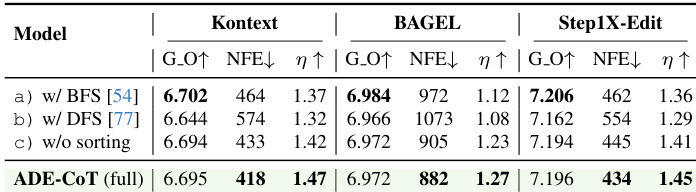

- ADE-CoT 在多个基准(GEdit-Bench、AnyEdit-Test、Reason-Edit)上显著改善性能-效率权衡,通过降低计算成本同时保持或超越基线质量。

- 相比 Best-of-N,其推理效率提升超 2 倍,结果效率提升 2.7–4.9 倍,表明冗余计算大幅减少。

- 难度感知资源分配根据编辑复杂度动态调整采样预算,在不降低质量的前提下最多减少 24% 的 NFE。

- 编辑特定验证器通过针对定位与语义对齐提升早期剪枝准确性,减少 63% 的误判,支持更高拒绝阈值。

- 机会性终止通过在找到足够高质量结果后立即停止生成,最小化后期冗余,在质量损失极小的情况下提升鲁棒性。

- ADE-CoT 在固定预算和可比性能设置下始终优于先前 Image-CoT 方法(PRM、PARM、TTS-EF),验证其混合搜索与剪枝策略的有效性。

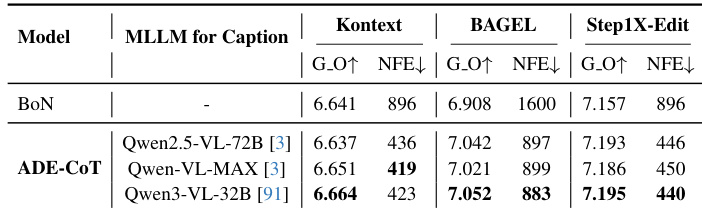

- 该方法在不同 MLLM 上表现稳健,更强验证器带来增量收益,但 MLLM 开销与幻觉仍是实际限制。

- 定性结果表明其在复杂、多轮、细粒度编辑上表现更优,实例特定验证可检测通用分数遗漏的细微错误。

作者使用 ADE-CoT 通过自适应分配计算资源和剪枝冗余候选来提高图像编辑效率。结果表明,该方法在显著减少去噪步骤的同时,实现与 Best-of-N 相当或更优的性能,完整模型在所有测试编辑模型中均提供最高的推理与结果效率。这一改进源于难度感知采样、编辑特定验证与机会性终止的结合,最小化无效计算而不牺牲输出质量。

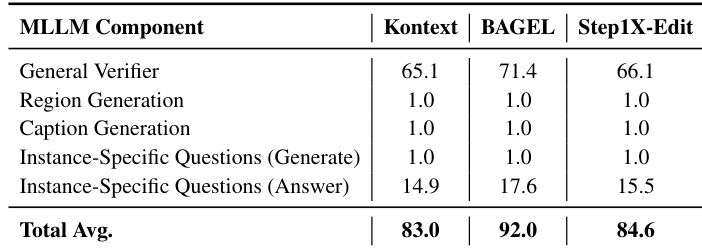

作者使用 MLLM 组件验证图像编辑,通用验证器承担大部分查询,而实例特定问答引入适度开销。在三个模型中,每案例平均 MLLM 调用次数介于 83.0 至 92.0 之间,表明编辑特定验证相对于整体框架引入的额外成本有限。结果证实,针对性验证策略在不显著增加 MLLM 使用的情况下实现显著计算节省。

作者使用 ADE-CoT 通过自适应分配计算与减少冗余采样,改善图像编辑的性能-效率权衡。结果表明,ADE-CoT 在多个模型上始终比基线策略具有更高的推理效率与更低的计算成本,同时不降低输出质量。该方法的收益源于难度感知预算、编辑特定验证与机会性终止,共同最小化无效计算,同时保留高保真输出。

作者使用 ADE-CoT 在图像编辑过程中自适应分配计算资源,在显著减少去噪步骤的同时实现与 Best-of-N 相当或更优的性能。结果表明,ADE-CoT 在各基准上推理效率提升超 2 倍,结果效率最高达 4.9 倍,表明剪枝有效且冗余减少。该方法在固定采样预算下始终优于基线,且在性能匹配时以更低计算成本维持质量。

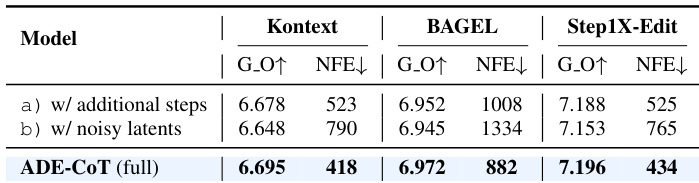

作者使用 ADE-CoT 在多个模型上降低计算成本,同时保持或提升图像编辑质量。结果表明,ADE-CoT 的 NFE 低于额外步骤与噪声潜在预览方法,表明在不牺牲输出质量的前提下更高效地使用资源。这种效率源于由编辑特定验证引导的自适应采样与早期剪枝。