Command Palette

Search for a command to run...

从盲区到收益:基于诊断驱动的大型多模态模型迭代训练

从盲区到收益:基于诊断驱动的大型多模态模型迭代训练

Hongrui Jia Chaoya Jiang Shikun Zhang Wei Ye

摘要

随着大规模多模态模型(LMMs)的不断扩展以及强化学习(RL)方法的日趋成熟,LMMs在复杂推理与决策任务中已取得显著进展。然而,当前训练仍依赖静态数据集和固定训练流程,难以有效识别模型的能力盲区,也难以实现动态、精准的强化机制。受“基于测试的错误暴露”与“反馈驱动的纠错”优于重复练习这一研究发现的启发,我们提出了一种诊断驱动的渐进式进化框架(Diagnostic-driven Progressive Evolution, DPE)。该框架采用螺旋式迭代循环:诊断模块指导数据生成与强化策略,每轮迭代后对更新后的模型重新诊断,从而驱动下一轮针对性的性能提升。DPE包含两个核心组件:其一,多个智能体协同标注并质量控制海量未标注的多模态数据,借助网络搜索、图像编辑等工具生成多样化且真实感强的数据样本;其二,DPE能够将模型失败归因于特定能力短板,动态调整数据构成比例,并引导智能体生成聚焦于薄弱环节的数据,实现精准强化。在Qwen3-VL-8B-Instruct与Qwen2.5-VL-7B-Instruct模型上的实验表明,DPE在11个基准测试中均展现出稳定且持续的性能提升,验证了其作为开放任务分布下可扩展的持续训练范式潜力。相关代码、模型及数据已公开,详见:https://github.com/hongruijia/DPE。

一句话总结

贾鸿瑞、姜超亚等人提出“诊断驱动的渐进式演化”(DPE),这是一种自我改进的闭环机制,通过诊断大型多模态模型(LMM)的弱点并生成针对性的多模态数据进行强化训练,在十一个基准测试中优于静态训练方法,并支持在开放任务下实现可扩展、持续的LMM演化。

主要贡献

- DPE引入了一种诊断驱动的大型多模态模型训练循环,可识别能力盲区,并利用多智能体工具增强标注动态生成针对弱点的数据,克服了静态数据集和基于启发式方法演化的局限性。

- 应用于Qwen3-VL-8B-Instruct和Qwen2.5-VL-7B-Instruct模型时,DPE仅需每轮1000个训练样本,即可在十一个多模态推理基准测试中实现稳定、持续的性能提升,证明其在开放任务分布下的高效性与可扩展性。

- 系统分析证实,DPE的诊断机制增强了训练稳定性并缓解了长尾性能退化,提供了一种无需昂贵人工标注或固定数据配方即可持续改进模型的原理性方法。

引言

作者利用诊断反馈解决大型多模态模型(LMM)训练中的关键缺陷,此前的自演化方法依赖启发式信号和静态视觉数据,导致训练不稳定和长尾性能差。现有框架缺乏可解释的失败归因,难以生成多样且有针对性的多模态样本,导致模型在数学或OCR等复杂任务上性能停滞或退化。其主要贡献是“诊断驱动的渐进式演化”(DPE),这是一种闭环训练范式,通过诊断模型弱点、动态生成定制化多模态数据(借助多智能体工具)并迭代强化改进,最终在多个基准测试中以极少数据实现稳定、广泛的性能提升。

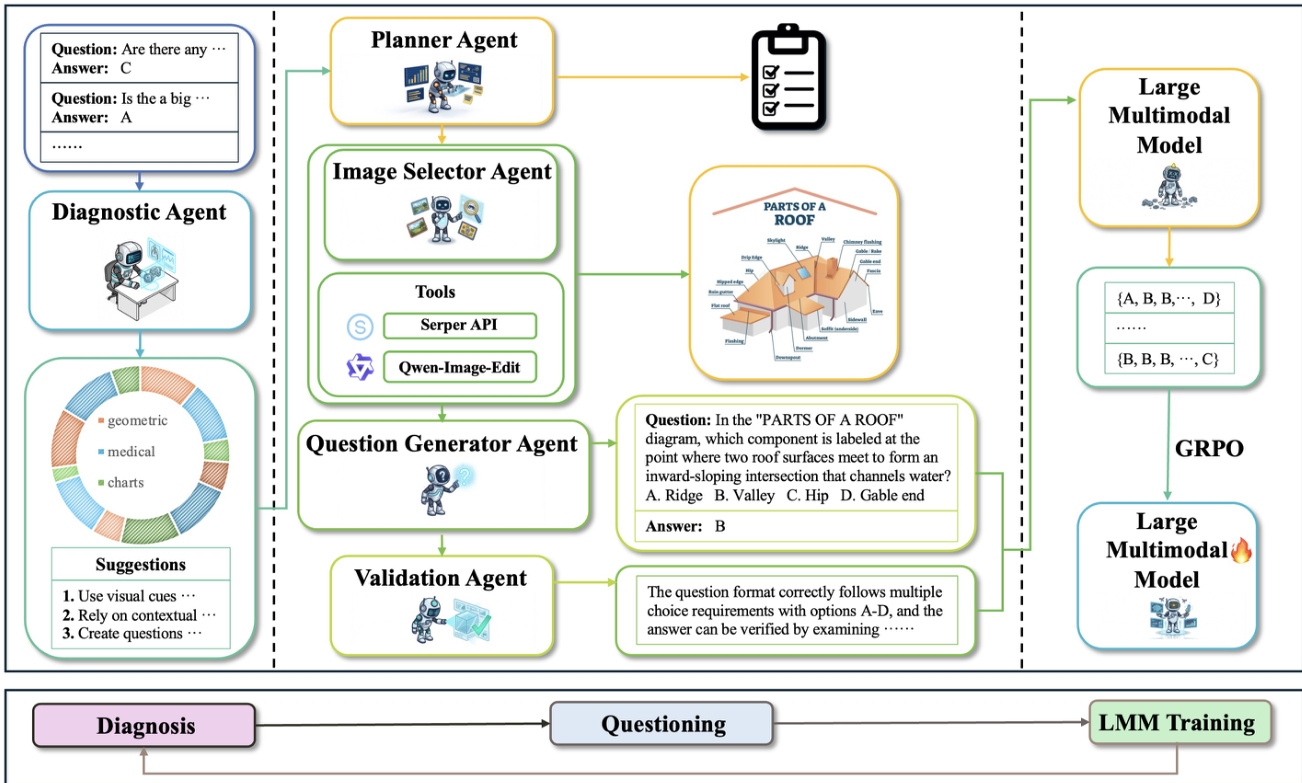

方法

作者采用“诊断驱动的渐进式演化”(DPE),这是一种专为监督稀缺和长尾覆盖不足条件设计的闭环训练框架,用于增强大型多模态模型(LMM)。不同于依赖静态图像集和启发式信号的先前自演化方法,DPE迭代执行诊断、针对性生成与强化学习更新。每轮迭代明确控制训练数据的类别构成和问题重点,将资源对准模型当前的能力盲区,以缓解不稳定性和长尾技能的收益递减。

在第 k 轮迭代中,策略记为 πθ(k)。框架构建训练集 T(k),并通过带有可验证奖励的强化学习更新参数至 θ(k+1):

θ(k+1)=ARL(θ(k);T(k)),T(k)=Agen(R(k)),R(k)=Adiag(πθ(k)),其中 Adiag、Agen 和 ARL 分别代表诊断、生成和RL更新操作符,R(k) 是结构化诊断报告。

诊断机制在每轮开始时执行显式失败归因和能力分解。它将多模态推理映射到一个12维能力空间 C={c1,c2,…,cK},包括几何图像、医学图像、统计图表和自然场景等类别。从诊断池 Ddiag 中采样 N=200 个实例 {(In,qn,an,cn)}n=1N,模型生成响应 y^n∼πθ(k)(⋅∣In,qn)。诊断智能体使用函数 v(⋅) 对每个响应进行评分,该函数评估推理步骤和最终结果,产生标量正确性信号 zn。对每个类别 c,系统计算计数和准确率:

Nc=n=1∑NI[cn=c],Accc=Nc1n=1∑NI[cn=c]⋅zn.除准确率外,智能体分析错误集 Ec={n∣cn=c, zn=0},总结重复失败模式 Fc,例如OCR错位或图表图例不匹配。这些模式被注入生成阶段作为可执行提示。系统随后根据分段准确率范围分配未归一化权重 α~c,并归一化得出类别比例向量 α(k):

αc(k)=∑c′=1Cα~c′α~c.最终诊断报告 R(k) 包含 α(k)、{Fc(k)} 和 {Hc(k)},其中 Hc(k) 提供可执行的生成指令,例如强制更严格的答案格式或更长的推理链。

多智能体提问系统将 R(k) 转换为具有可控分布和可验证答案的训练数据集 T(k)={(Ij,qj,aj,cj)}j=1M。给定目标预算 M,系统强制执行硬性类别配额约束:对每个类别 c,mc=⌊M⋅αc(k)⌋,最终数据集需满足:

(I,q,a,c)∈T(k)∑I[c=c′]=mc′,∀c′∈{1,…,C}.系统包含四个智能体:规划者、图像选择器、问题生成器和验证器。规划者智能体为每个样本 j 输出计划:

planj=(cj, reqjI, reqjQ, dirj),其中 cj 是目标类别,reqjI 指定图像要求,reqjQ 指定问题要求,dirj 针对从 Fcj(k) 和 Hcj(k) 推导出的弱点。图像选择器智能体从外部池 Pext 中检索或合成图像 Ij,使用包含搜索、过滤和编辑功能的管道 ϕ(⋅)。问题生成器智能体根据 Ij 和规划指令生成 (qj,aj):

(qj,aj)=ψ(Ij, reqiQ, Hci(k)).验证智能体通过四个检查门控样本质量:类别一致性、可解性、答案可验证性和格式合规性。最终接受条件为:

g(si)=gcat⋅gsol⋅gver⋅gfmt.若 g(sj)=1,样本加入 T(k) 并更新配额状态;否则丢弃并重新生成。

训练采用GRPO进行。对于每个提示 x,旧策略 πθold 生成 G 条轨迹 yi=(oi,1,…,oi,∣yi∣)∼πθold(⋅∣x)。每条轨迹获得标量奖励 ri=r(x,yi)。GRPO优化剪裁代理目标:

JGRPO(θ)=Ex∼D,{yi}∼πθold[G1∑i=1G∣yi∣1∑t=1∣yi∣min(ρi,tAi,t,clip(ρi,t,1−ε,1+ε)Ai,t)−βKL(πθ∥πinit)]其中 ρi,t=πθold(oi,t∣x,σi,<t)πθ(oi,t∣x,σi,<t),ε 为剪裁阈值,β>0 控制KL正则化,πinit 为参考策略。关键创新是组归一化优势:

A^i=std(r1,…,rG)ri−mean(r1,…,rG).从最大熵视角看,最优策略满足 π∗(y∣x)∝πinit(y∣x)exp(r(x,y)/β),KL散度存在下界:

KL(πinit∥π∗)≥2β2p(x)(1−p(x)),其中 p(x) 是 πinit 下的通过率。该下界在 p=0.5 附近最大化,解释了DPE为何仅保留中等难度样本以提高学习效率。

在第 k 轮迭代中,DPE生成并验证 T(k),应用难度感知过滤获得 Ttrain(k),并通过GRPO更新模型:θ(k+1)=ARL(θ(k);Ttrain(k))。系统随后重复诊断轮次,通过外部图像源逐步强化薄弱能力并扩展视觉覆盖范围。

实验

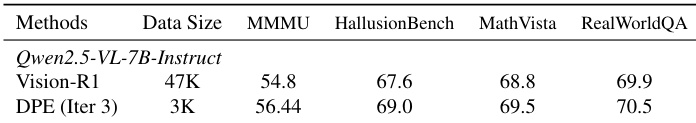

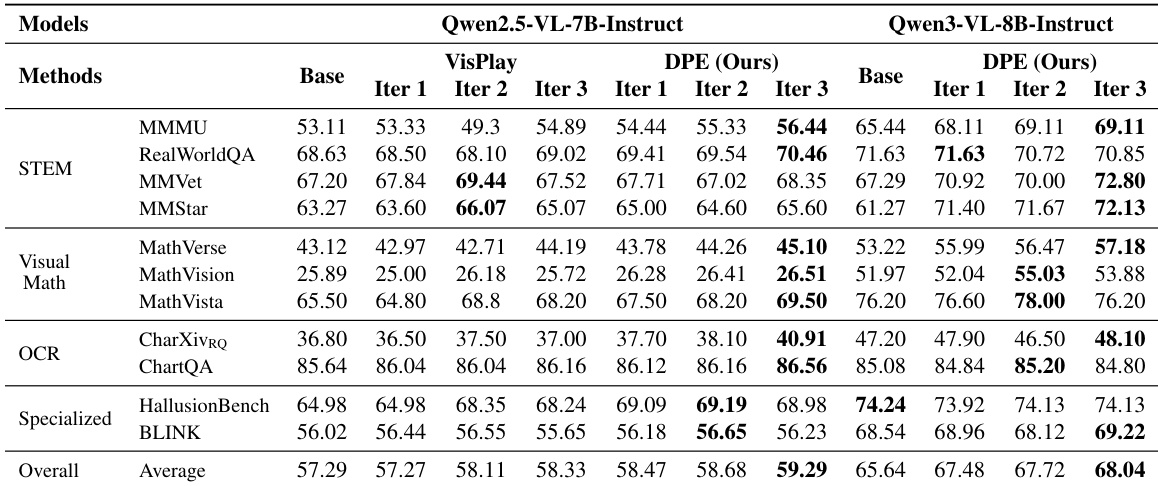

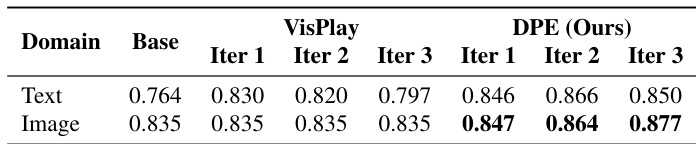

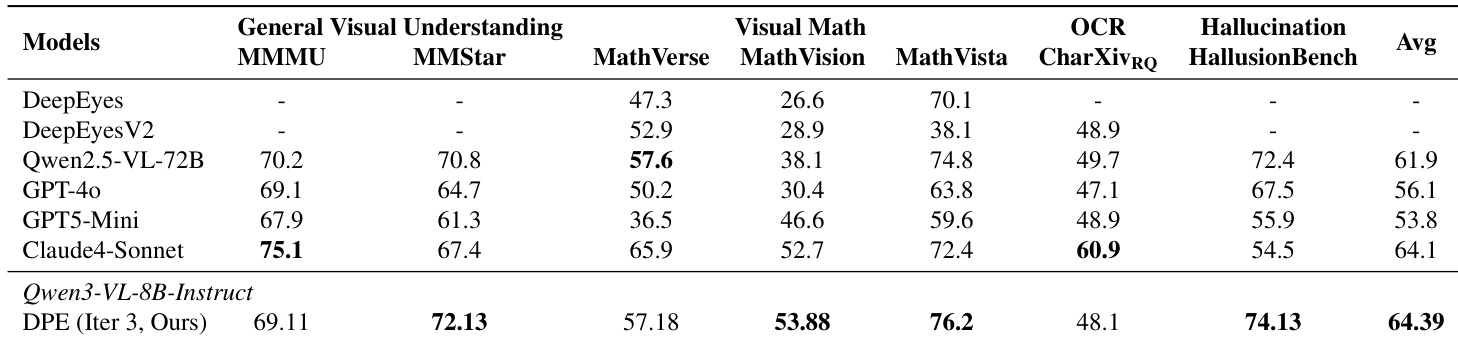

- DPE在能力增强、训练稳定性和跨模型迁移性方面优于VisPlay,尤其在STEM、OCR和幻觉缓解方面,得益于其闭环诊断机制。

- DPE以参数高效性实现最先进结果,在复杂视觉数学和定位任务中超越Qwen2.5-VL-72B和GPT-4o等更大模型,凸显数据质量优于规模的价值。

- 消融研究证实DPE的诊断模块对持续改进至关重要,可防止性能振荡并引导数据生成聚焦真实能力差距。

- DPE的图像检索与编辑工具显著扩展视觉多样性,避免早期停滞,并通过覆盖长尾视觉模式提升OCR和数学推理性能。

- DPE生成的数据在各轮迭代中表现出更高且更稳定的文本与图像多样性,避免模板崩溃并维持广泛的语义和视觉覆盖。

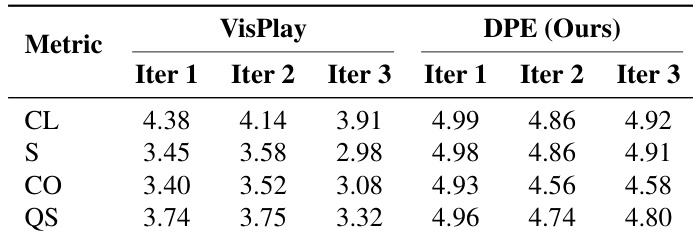

- 质量评估显示DPE持续生成高质量、可解且视觉锚定的问题,而VisPlay的输出随时间退化,尤其在正确性和结构方面。

- 案例研究展示DPE能生成完整、结构良好且语义锚定的问题,而VisPlay常生成不完整或无法回答的示例。

作者使用诊断引导的数据演化框架在低数据条件下迭代改进视觉语言模型,在包括STEM、OCR和幻觉缓解在内的多样化基准测试中实现持续提升。结果表明,该方法在各轮迭代中保持稳定性能增长,优于自演化基线和更大规模的最先进模型,尤其在复杂推理和定位任务中表现突出。该方法在不同模型规模下均有效,依赖针对性数据生成而非数据量,诊断反馈确保持续对准模型弱点。

作者使用多智能体系统迭代生成训练数据,DPE在所有轮次中持续生成比VisPlay更高质量的问题,尤其在可解性和正确性方面表现突出。结果表明,DPE保持稳定、接近天花板的质量评分,而VisPlay的质量随时间退化,表明DPE的诊断引导有效维持了数据可靠性。这一质量优势直接支持比自演化基线更稳定、更有效的模型演化。

作者使用DPE生成比VisPlay更高且更稳定的文本和图像多样性数据,通过各轮迭代的平均成对余弦距离衡量。结果表明,DPE随时间维持多样性增益,而VisPlay表现出退化,尤其在后期迭代中,表明DPE机制更能防止分布崩溃和模板回退。这种增强的多样性支持更广泛的语义和视觉覆盖,有助于更稳健的模型性能。

作者使用DPE在低数据条件下增强Qwen3-VL-8B-Instruct,在包括视觉数学和幻觉缓解在内的多个基准测试中实现最先进性能。结果表明,DPE在关键领域优于Qwen2.5-VL-72B和GPT-4o等更大模型,证明针对性数据生成和诊断反馈比单纯参数规模带来更强增益。该方法通过聚焦模型弱点并维持高数据质量和多样性,在各轮迭代中保持稳定改进。

作者使用DPE从少量种子数据集中迭代生成高质量训练数据,尽管仅使用3K样本,仍优于静态训练。结果表明在MMMU、HallusionBench、MathVista和RealWorldQA等多个基准测试中持续提升,表明基于诊断反馈的针对性数据生成比更大静态数据集更有效地增强模型能力。该方法展现出稳定的训练动态和卓越的数据效率,增益在各轮迭代中持续保持而无性能退化。