Command Palette

Search for a command to run...

PyVision-RL:通过强化学习构建开放的智能体视觉模型

PyVision-RL:通过强化学习构建开放的智能体视觉模型

Shitian Zhao Shaoheng Lin Ming Li Haoquan Zhang Wenshuo Peng Kaipeng Zhang Chen Wei

摘要

基于强化学习的智能体式多模态模型常面临交互崩溃(interaction collapse)问题,即模型逐渐减少工具调用和多轮推理行为,从而削弱了智能体行为的潜在优势。为此,我们提出 PyVision-RL,一个面向开源权重多模态模型的强化学习框架,能够稳定训练过程并维持持续的交互能力。该方法结合了过采样-过滤-排序(oversampling-filtering-ranking)的轨迹生成策略与累积工具奖励机制,有效防止交互崩溃,并鼓励模型进行多轮工具使用。通过统一的训练流程,我们构建了用于图像理解的 PyVision-Image 与用于视频理解的 PyVision-Video。在视频推理任务中,PyVision-Video 采用按需上下文构建机制,在推理过程中仅选择与任务相关的关键帧进行采样,显著降低了视觉 token 的使用量。实验结果表明,该方法在性能与效率方面均表现出色,充分证明了持续交互能力与按需视觉处理机制对于构建可扩展多模态智能体的关键作用。

一句话总结

赵世天、林少恒及来自多个机构的同事提出了 PyVision-RL,这是一种通过过采样-过滤-排序与累积工具奖励机制防止多模态智能体交互崩溃的强化学习框架,支持按需帧采样实现高效视频推理,代码与模型已开源。

主要贡献

- PyVision-RL 提出了一种面向开源权重多模态模型的强化学习框架,通过结合“过采样-过滤-排序”回放策略与累积工具奖励,有效防止训练过程中交互崩溃,确保多轮工具使用得以持续。

- 该框架统一了图像与视频理解的训练流程,其中 PyVision-Video 独创性地采用“按需上下文构建”策略,选择性采样与任务相关的视频帧,相比均匀采样方法可减少高达 90% 的视觉 token 使用量。

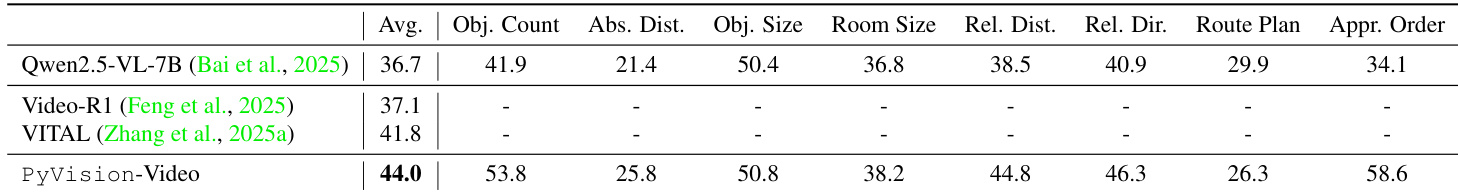

- 实验结果表明,PyVision-Image 与 PyVision-Video 在多模态基准测试中达到最先进水平,例如在 V* 上比 DeepEyes-v2 高 +6.9%,在 VSI-Bench 上比 VITAL 高 +2.2%,同时通过动态工具调用与稀疏视觉 token 消耗保持高效性。

引言

作者利用强化学习构建支持开源权重的多模态智能体,可主动通过 Python 作为动态工具对图像与视频进行推理与交互。以往方法或依赖僵化预定义工具集,或在 RL 训练中遭遇交互崩溃(模型放弃工具使用与多轮推理)。PyVision-RL 通过两项核心创新解决此问题:一是“过采样-过滤-排序”回放策略稳定训练;二是累积工具奖励明确鼓励持续交互。针对视频任务,引入按需上下文构建机制,允许模型通过代码仅提取相关帧——相比均匀采样减少 90% 视觉 token 使用量,同时提升准确率。最终模型 PyVision-Image 与 PyVision-Video 在代理式视觉推理任务中树立新基准,证明在正确训练激励下,可实现可扩展且高效的多模态智能体。

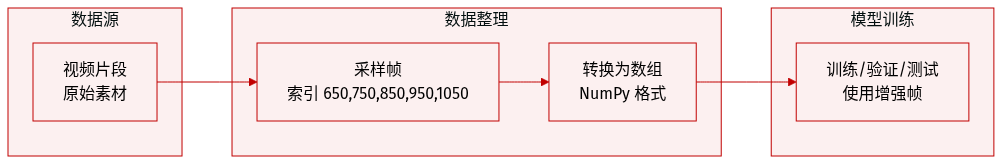

数据集

作者从视频中特定索引(650、750、850、950、1050)额外采样帧,以补充 600 至 1200 帧之间的上下文。这些帧从视频片段中提取为 NumPy 数组,用于增强下游处理的时序上下文。给定文本中未提供数据集构成、来源或模型训练细节。

方法

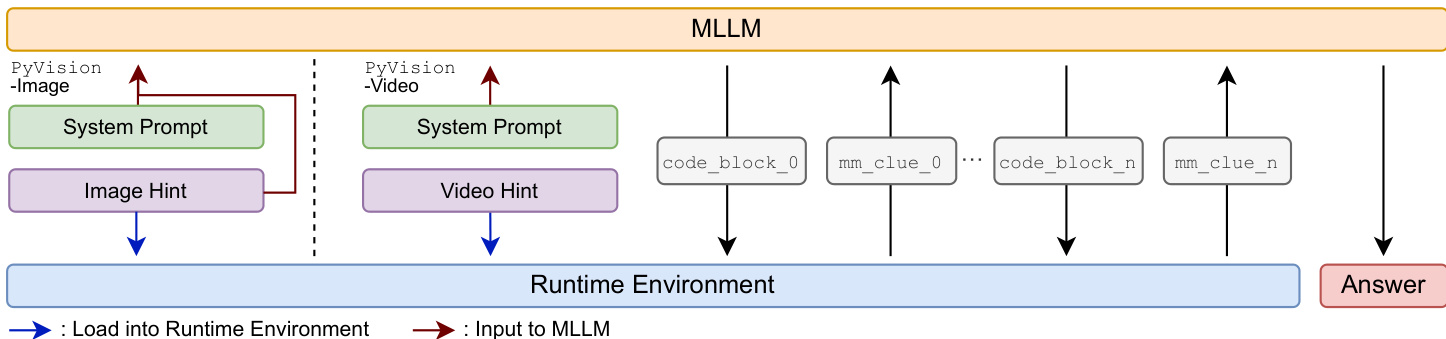

作者采用 PyVision-RL,一种专为训练支持动态工具使用的开源权重多模态大语言模型(MLLM)设计的代理式强化学习框架。核心创新在于将 Python 视为基本工具,使模型可在自然语言推理与可执行代码之间交替。该交互遵循结构化协议:MLLM 生成包含在 <code>...</code> 标签中的推理文本与代码块,在运行时环境中执行。环境返回执行结果,称为多模态线索(mm_clue_i),封装在 <interpreter>...</interpreter> 标签中。该循环持续进行,直至模型生成包含在 <answer>...</answer> 标签中的最终答案,所有中间输出均追加至上下文以保持连贯性。

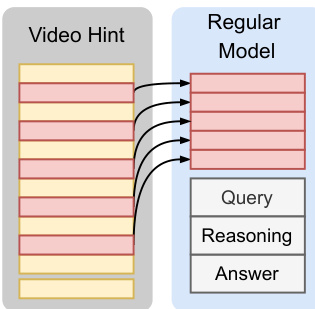

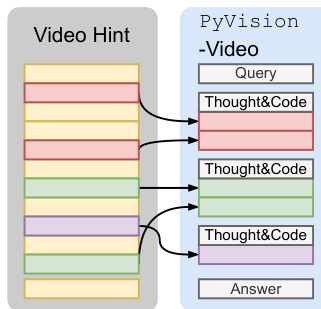

请参阅框架图,图中展示了 MLLM 与运行时环境之间的双向交互。对于图像任务,图像同时注入 MLLM 上下文与 Python 运行时,使代理可在推理过程中引用并操作图像。对于视频任务,PyVision-Video 采用按需上下文构建策略:完整视频仅加载至 Python 运行时,代理根据查询或启发式策略动态采样并绘制帧。这与均匀帧采样形成对比,既减少视觉 token 使用量,又提升性能。

为在 RL 训练中维持多轮工具使用并防止交互崩溃,作者引入累积工具奖励。最终奖励结合答案准确性 Racc∈{0,1} 与与工具调用次数 ntc 成比例的奖励加成 0.1⋅ntc。该加成仅在答案正确时添加,确保激励工具使用而不奖励无效或错误调用。最终 RL 目标为:

R=Racc+accumulative tool reward0.1⋅ntc⋅1{Racc=1}训练稳定性通过“过采样-过滤-排序”框架进一步增强。作者首先过采样回放,然后应用在线过滤以移除奖励方差为零的组及交互中断的回放(如超时或运行时失败)。在剩余候选中,按组级奖励标准差对回放组排序,该值作为样本难度的代理。保留排名靠前的组用于训练,优先选择提供有效学习信号的中等难度回放。此策略称为“标准差排序”,可减少具有负优势的正确样本比例,提升训练效率。

基础 RL 算法为 GRPO,但作者移除了组内优势计算中的标准差归一化项以提升稳定性。每个 token 的优势计算如下:

Ai,t=R(x,yi)−mean({R(x,yi)}i=1G)其中 R(x,yi) 表示回放级奖励。模型使用 GPT-4.1 生成的合成数据进行监督微调(SFT)初始化,涵盖多模态推理、医学推理、图表理解与视觉问答等多样领域。对于 PyVision-Video,专门构建了 44K 样本的 SFT 数据集以教授按需上下文构建。RL 训练随后使用特定任务数据集进一步专业化代理行为,PyVision-Image 与 PyVision-Video 均在 8 块 H100 GPU 上训练 700 步,使用一致超参数。

实验

- PyVision-Image 在视觉搜索、多模态数学推理与代理任务中表现优异,超越静态工具与 Python 解释器基线,证明动态工具调用可增强感知与复杂推理能力。

- PyVision-Video 在 VSI-Bench 上实现强大的空间推理能力,通过按需帧选择大幅减少视觉 token 使用量,在不牺牲准确率的前提下提供更高效率。

- 消融实验确认,增加最大轮次预算与添加累积工具奖励在训练后期带来更大收益,支持持续多轮推理。

- 标准差排序通过优先选择信息丰富、中等难度样本并减少对工具调用较少的正确轨迹的抑制,稳定训练过程。

- 移除优势估计中的标准差归一化通过降低优势信号方差提升训练稳定性。

- 训练动态显示工具使用、响应长度与验证性能持续提升,表明 RL 优化对长视野代理行为有效。

PyVision-Image 在视觉搜索、多模态推理与代理推理基准测试中超越静态工具集与动态工具基线,多个任务达到最先进水平。模型在视觉搜索与多模态数学任务中增益尤为显著,表明其动态工具调用与 RL 驱动训练有效增强感知与复杂推理能力。结果证实,动态工具调用与扩展交互视野对性能的贡献显著超越静态或有限轮次方法所能实现的效果。

作者通过消融实验评估训练组件——累积工具奖励、标准差排序、移除标准差归一化、最大轮次预算——对 PyVision-Image 在视觉搜索与多模态推理任务中性能的影响。结果表明,增加最大轮次预算与引入累积工具奖励在训练后期带来更大性能增益,而移除标准差归一化与应用标准差排序持续改善稳定性与最终性能。总体而言,四个组件组合在 600 训练步时表现最强,超越所有消融变体在多数基准测试中的表现。

PyVision-Video 在 VSI-Bench 多个空间推理类别中超越先前模型,平均得分最高达 44.0,在物体计数、绝对距离估计与近似排序任务中表现强劲。模型的动态帧选择策略在保持竞争性准确率的同时高效使用视觉 token,尤其在关系方向与物体尺寸任务中表现优异。这些增益反映了代理式按需视频处理对复杂空间推理的有效性。