Command Palette

Search for a command to run...

Mobile-O:移动端的统一多模态理解与生成

Mobile-O:移动端的统一多模态理解与生成

摘要

统一的多模态模型能够在单一架构内同时实现视觉内容的理解与生成。然而,现有模型仍存在对数据依赖性强、计算资源消耗大等问题,难以在边缘设备上部署。为此,我们提出 Mobile-O——一种轻量级的视觉-语言-扩散多模态模型,首次将统一的多模态智能能力带入移动设备。其核心模块——移动条件投影器(Mobile Conditioning Projector, MCP),采用深度可分离卷积与分层对齐机制,实现视觉-语言特征与扩散生成器之间的高效融合,从而在极低计算开销下完成跨模态条件建模。Mobile-O 仅在数百万样本上进行训练,并通过一种新颖的四元组格式(生成提示、图像、问题、答案)进行后训练,联合提升模型的视觉理解与生成能力。尽管模型轻量化,Mobile-O 在性能上仍达到或超越其他统一多模态模型:在 GenEval 基准上取得 74% 的得分,分别优于 Show-O 与 JanusFlow 5% 和 11%;推理速度分别提升 6 倍与 11 倍。在视觉理解方面,Mobile-O 在七个基准测试上的平均表现分别领先 Show-O 15.3% 和 JanusFlow 5.1%。在 iPhone 上,每张 512×512 分辨率图像的处理时间仅需约 3 秒,Mobile-O 首次实现了边缘设备上实时统一多模态理解与生成的可行框架。我们期望 Mobile-O 能推动未来在完全本地化(无云依赖)环境下实现实时统一多模态智能的研究发展。相关代码、模型、数据集及移动端应用已公开发布于:https://amshaker.github.io/Mobile-O/

一句话总结

来自 MBZUAI、CMU 和林雪平大学的研究人员提出了 Mobile-O,这是一种紧凑型视觉-语言-扩散模型,配备移动条件投影器(Mobile Conditioning Projector),可在移动设备上实现实时统一的多模态理解和生成,其速度和准确性优于先前模型,且仅需极少数据,无需依赖云端。

主要贡献

- Mobile-O 引入了一种专为边缘设备优化的紧凑型视觉-语言-扩散模型,通过轻量级架构和仅使用数百万样本的训练,解决了现有统一多模态模型效率低下和数据需求大的问题。

- 其核心创新——移动条件投影器(MCP)——利用深度可分离卷积和逐层对齐,高效融合视觉-语言特征与扩散生成;同时引入新颖的四元组训练格式(提示、图像、问题、答案),联合优化理解和生成能力。

- Mobile-O 在 GenEval 上达到 74% 的最先进水平,分别比 Show-O 和 JanusFlow 高出 5% 和 11%,运行速度最高快 11 倍;在七个理解基准上平均分别优于它们 15.3% 和 5.1%,同时在 iPhone 上生成 512x512 图像仅需约 3 秒。

引言

作者利用统一多模态模型,将视觉理解和图像生成整合到单一架构中,旨在将此能力带入智能手机等计算和内存受限的边缘设备。先前模型通常体积过大、数据需求过高,常需数十亿参数和数亿训练样本,难以部署于设备端。Mobile-O 通过引入轻量级移动条件投影器解决此问题,该投影器使用深度可分离卷积融合视觉-语言特征与扩散生成器,实现高效跨模态条件控制。同时引入新颖的四元组训练格式(提示、图像、问题、答案),仅用 10.5 万样本即可联合优化理解和生成。最终,Mobile-O 在两项任务上均达到最先进性能,运行速度比先前统一模型快达 11 倍,并在 iPhone 上 3 秒内完成 512x512 图像生成。

方法

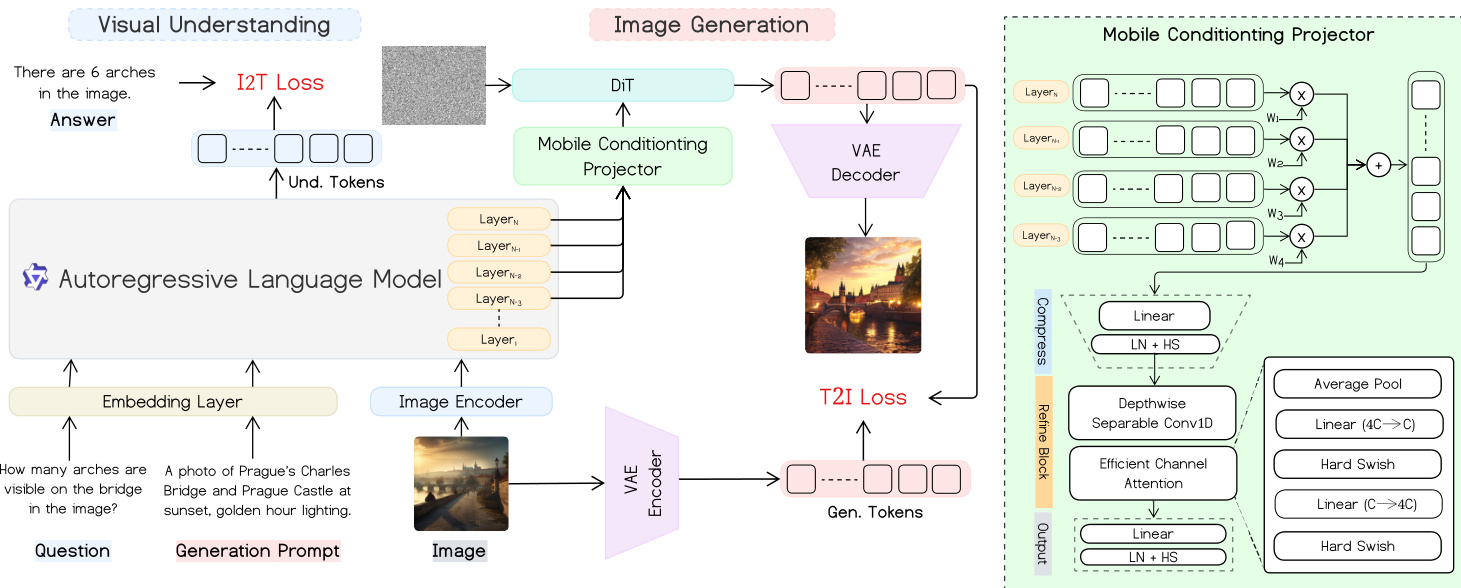

作者采用统一的移动端优化架构,同时支持多模态视觉理解和文本到图像生成。框架整合了用于理解任务的视觉-语言编码器-解码器,以及用于生成的基于扩散的图像解码器,二者通过轻量级移动条件投影器(MCP)连接,实现高效跨模态对齐,且不引入额外的 token 序列。

核心部分,视觉理解路径始于图像编码器和自回归语言模型。给定图像和问题,模型通过在语言模型输出 token 上计算 I2T(图像到文本)损失生成答案。对于生成,文本提示由同一语言模型处理,其隐藏状态经 MCP 投影为 DiT 风格扩散解码器的条件特征。生成的图像随后通过 VAE 解码器重建,训练由基于流匹配的 T2I(文本到图像)损失引导。

请参考框架图,该图展示了双路径及其共享组件。右侧详细展示了移动条件投影器,其使用温度缩放的 softmax 权重融合 VLM 的最后 K 层,通过线性层压缩融合表示,再用深度可分离一维卷积和轻量级通道注意力进行细化。输出投影至匹配扩散解码器的条件维度,实现端到端对齐,无需查询 token。

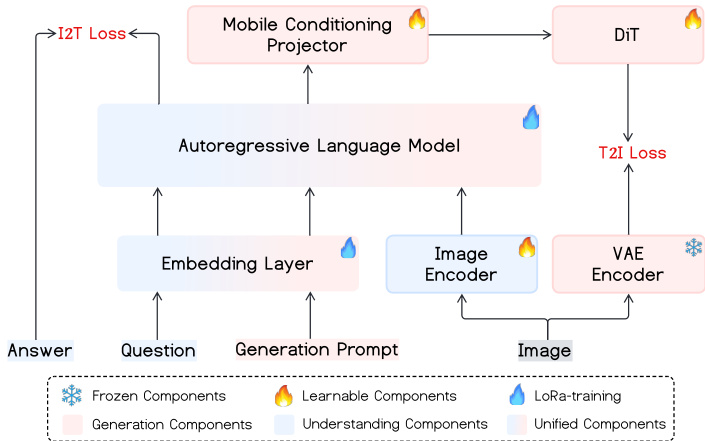

训练分为三个阶段。阶段 1:冻结视觉编码器和语言模型,仅在大规模图像-文本对上训练 DiT 和 MCP,建立跨模态对齐。阶段 2:在精选的提示-图像对上进行监督微调,解决领域特定弱点。阶段 3:引入统一多模态后训练阶段,使用四元组样本(生成提示、图像、问题、答案)联合优化 I2T 和 T2I 目标。该阶段实现双向学习:相同的嵌入层和语言模型支持理解和生成,MCP 作为共享条件接口。

如训练动态图所示,各阶段选择性冻结或更新组件。阶段 1 和 2 中,仅生成组件(DiT 和 MCP)可学习,理解主干保持冻结。阶段 3 中,统一组件(包括 MCP 和部分语言模型)通过 LoRa 微调,实现联合优化而不破坏预训练表示。

统一损失函数结合 I2T 语言建模损失和 T2I 流匹配损失,并赋予可学习权重:

Lunified=λlangLlang+λdiffLdiffI2T 损失是基于图像和问题条件下答案 token 的标准交叉熵。T2I 损失最小化预测速度场与真实流之间的加权均方误差,相比传统噪声预测目标,实现更稳定高效的训练。MCP 的设计确保计算开销极小,每 token 复杂度为 O(kdh+dh2),避免昂贵的二维卷积或新 token 的注意力计算。

实验

- Mobile-O 验证了在移动设备上高效统一多模态理解和生成的能力,在速度和质量上均优于 Show-O 和 Janus 等先前模型,且内存占用低于 2GB。

- 通过共享的移动条件投影器和多任务后训练,实现卓越的文本到图像生成和视觉理解,无需修改架构即可提升两项能力。

- 仅需极少微调数据即可实现图像编辑,在保持场景结构的同时应用局部编辑,展示统一设计带来的涌现能力。

- 消融研究证实 MCP 在跨模态对齐中的有效性,以及联合四元组训练对提升生成和理解能力的价值。

- 扩展至更大主干(Mobile-O-1.5B)表明框架具有泛化性,超越组件基线,增强理解和生成能力。

- 在 iPhone、Jetson 和 MacBook 上的边缘部署证明实时性能,图像生成仅需 3 秒,文本响应低于 0.5 秒,支持离线、隐私保护的移动 AI。

- 定性结果突出其在精细细节渲染、提示保真度和鲁棒 OCR/场景理解方面的优势,即使在具有挑战性的现实条件下亦然。

- 局限性包括由于共享轻量级 LLM 导致的文本表示受限,为在资源受限设备上部署而牺牲部分表达能力。

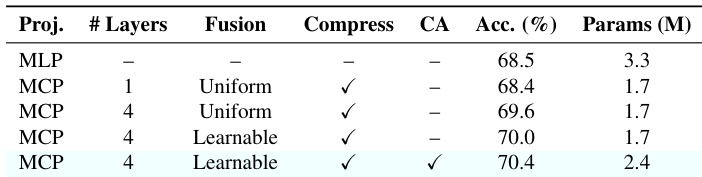

作者评估了移动条件投影器(MCP)的不同配置,发现使用四层、可学习融合和精炼模块可实现最高准确率 70.4%,同时参数保持在 2.4M 以下。结果表明,聚合多个 VLM 层可改善跨模态对齐,添加可学习权重和精炼模块可进一步提升性能,且无需额外计算开销。

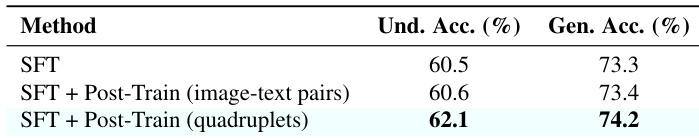

作者采用统一后训练策略,使用四元组样本联合优化理解和生成任务。结果表明,与仅使用图像-文本对或标准监督微调相比,该方法将平均理解准确率提升 1.6 个百分点,生成准确率提升 0.8 个百分点。这表明多目标后训练可在无需大规模预训练的情况下增强跨模态对齐。

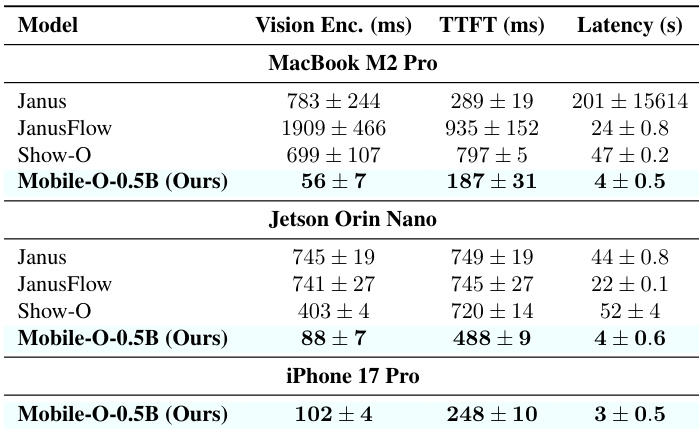

Mobile-O-0.5B 在所有测试边缘设备上均比先前统一模型实现显著更快的推理速度,在 MacBook M2 Pro 上图像生成延迟最高降低 46 倍,在 iPhone 17 Pro 上低于 3 秒。该模型保持低于 2GB 的高效内存使用,同时提供适合设备端部署的实时性能。结果证实架构优化可在不牺牲功能能力的前提下实现高速多模态操作。

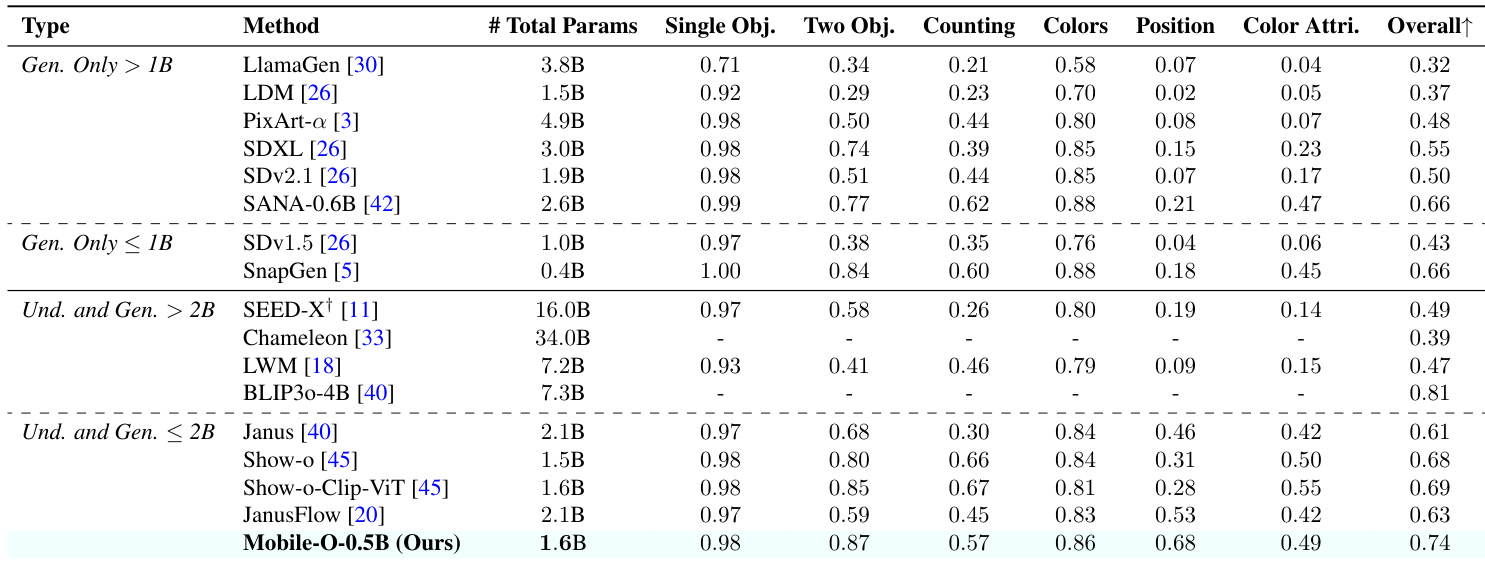

作者在文本到图像生成基准上将 Mobile-O-0.5B 与其他统一和仅生成模型进行比较,显示其在 2B 参数以下模型中获得最高综合得分。结果表明 Mobile-O-0.5B 在生成图像时能准确呈现物体数量、精确颜色属性和正确空间定位,优于 Show-O 和 JanusFlow 等可比统一模型。该性能在保持紧凑参数量和高效推理的同时实现,支持其适用于边缘部署。

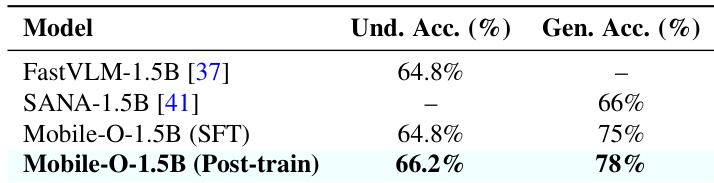

作者使用更大主干配置将 Mobile-O 扩展至 1.5B 参数,并在监督微调和后训练后评估其性能。结果表明,后训练提升了理解和生成质量,最终模型优于其单独组件主干。这证实 Mobile-O 框架即使扩展到更大架构,也能有效增强统一多模态能力。