Command Palette

Search for a command to run...

ManCAR:基于流形约束的潜在推理与自适应测试时计算的序列推荐

ManCAR:基于流形约束的潜在推理与自适应测试时计算的序列推荐

Kun Yang Yuxuan Zhu Yazhe Chen Siyao Zheng Bangyang Hong Kangle Wu Yabo Ni Anxiang Zeng Cong Fu Hui Li

摘要

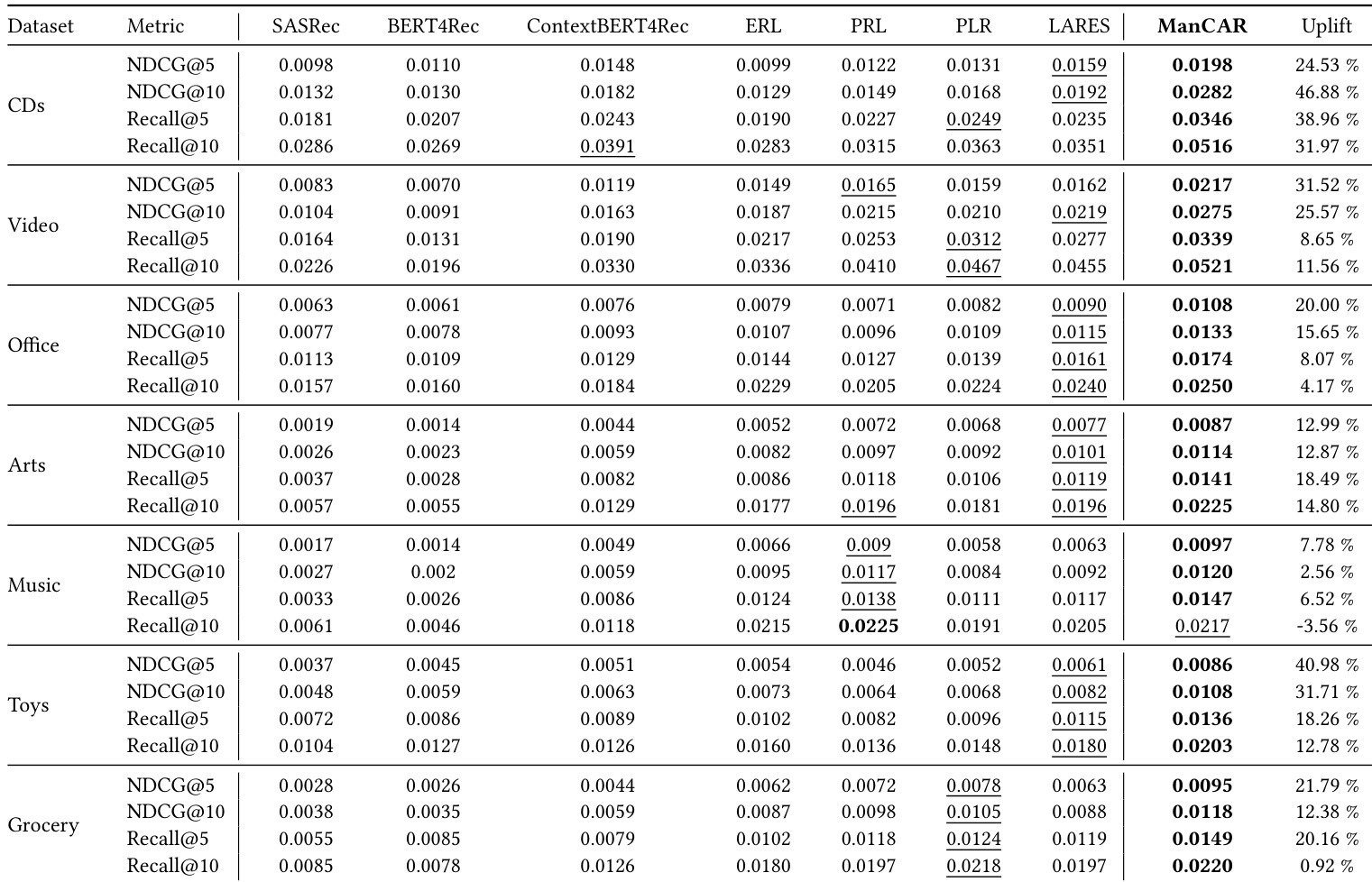

序列推荐正越来越多地采用潜在的多步推理机制,以提升测试阶段的计算能力。尽管现有方法在实证上取得了显著收益,但其大多依赖以目标为导向的优化目标来驱动中间推理状态,而未施加显式的可行性约束,从而导致潜在空间中的“漂移”现象——即推理轨迹偏离至不合理区域。我们认为,有效的推荐推理应被视作在协同流形(collaborative manifold)上的导航过程,而非自由形式的潜在空间优化。为此,我们提出 ManCAR(Manifold-Constrained Adaptive Reasoning)——一种具有理论基础的框架,将推理过程约束于全局交互图的拓扑结构之内。ManCAR 通过用户近期行为的协同邻域构建局部意图先验,该先验以项目单纯形(item simplex)上的概率分布形式表示。在训练阶段,模型逐步将自身的潜在预测分布对齐至该先验,从而强制推理轨迹始终位于合法流形范围内。在测试阶段,推理过程自适应地进行,直至预测分布趋于稳定,避免过度优化。我们进一步为 ManCAR 提供了变分视角的理论分析,以验证其抑制潜在漂移及实现自适应测试阶段终止机制的有效性。在七个基准数据集上的实验结果表明,ManCAR 持续优于当前最先进的基线方法,在 NDCG@10 指标上最高实现 46.88% 的相对提升。相关代码已开源,地址为:https://github.com/FuCongResearchSquad/ManCAR。

一句话总结

来自清华大学和阿里巴巴等机构的研究人员提出了 ManCAR,这是一种基于流形约束的推理框架,将序列推荐建立在协同图拓扑之上,通过自适应测试时细化防止潜在漂移,在 NDCG@10 上最高优于基线模型 46.88%。

主要贡献

- ManCAR 引入了一种用于序列推荐的流形约束推理框架,利用交互图中的协同邻域在项目概率单纯形上定义可行区域,从而在多步潜在细化过程中防止潜在漂移。

- 该方法包含一个变分解释,从理论上验证了其防漂移机制,并通过预测分布的收敛实现自适应测试时停止,避免不必要的过度细化。

- 在七个基准数据集上评估,ManCAR 一致优于最先进的基线模型,在 NDCG@10 上最高实现 46.88% 的相对增益,展示了其在现实推荐场景中的有效性和效率。

引言

作者利用潜在多步推理增强序列推荐,将其视为在由用户-项目交互图定义的协同流形上导航的过程,而非无约束的潜在细化。先前方法因仅优化目标对齐而未施加可行性约束,导致潜在漂移——推理轨迹漂移至不可信区域。ManCAR 通过将推理锚定在源自用户协同邻域的流形中,使用变分框架将潜在状态与图诱导先验对齐,并在预测稳定时自适应停止计算,从而解决此问题。该方法防止漂移、提升泛化能力,并在七个基准数据集上实现高达 46.88% 的 NDCG@10 相对增益。

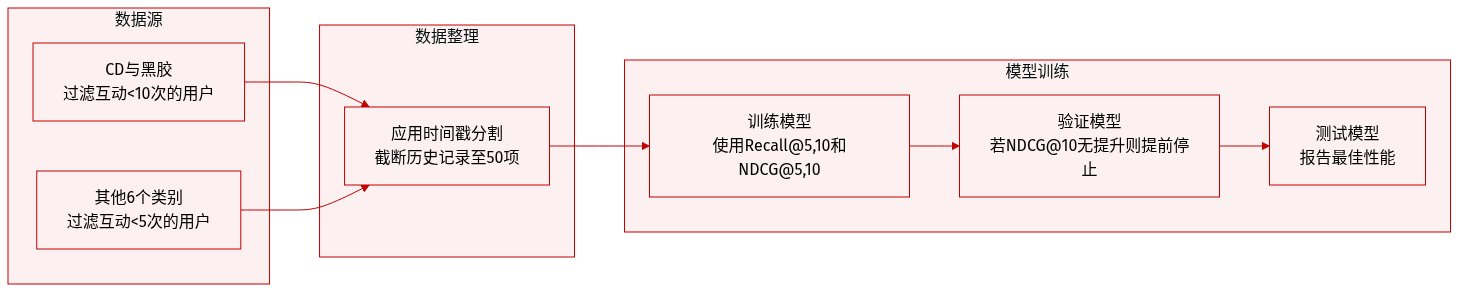

数据集

- 作者使用来自 Amazon 2023 Reviews 语料库的七个子类别数据集:CDs & Vinyl、Video & Games、Office Products、Arts Crafts & Sewing、Grocery & Gourmet Food、Musical Instruments 和 Toys & Games。

- 每个数据集将评分高于 3 的视为正反馈。CDs 数据集中交互少于 10 次的用户被过滤;其余数据集中少于 5 次的用户被过滤。

- 采用官方绝对时间戳划分,每位用户的交互历史被截断为最多 50 个项目。

- 数据集用于训练和评估,使用 Recall@K 和 NDCG@K(K=5,10)衡量检索覆盖范围和排序质量。

- 不应用混合比例;每个子集独立评估。

- 不涉及裁剪或基于图像的处理——所有数据均为文本交互序列。

- 元数据包括用户-项目交互、时间戳和评分;除过滤和截断外未构造额外元数据。

方法

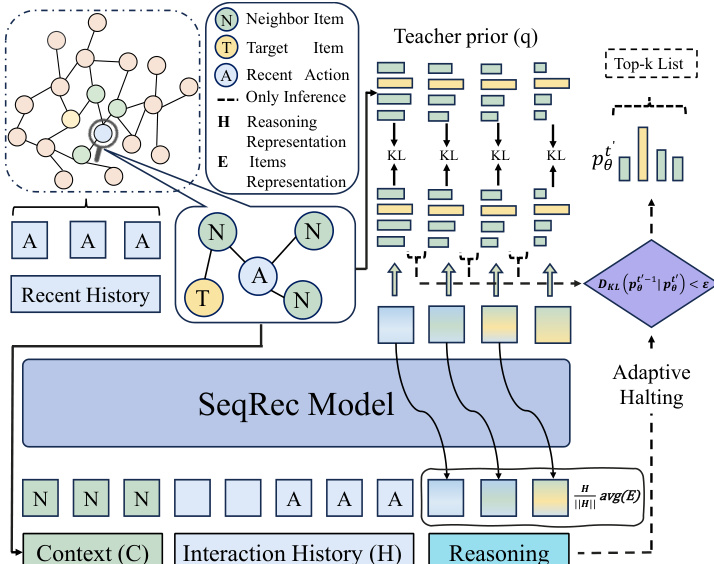

作者利用一种几何基础框架 ManCAR,将潜在推理轨迹约束在由用户近期交互历史和全局项目交互图导出的协同流形内。核心见解是:高维空间中无约束的潜在推理会导致漂移,而用户意图本质上局限于稀疏、图定义的协同可信项目邻域内。ManCAR 通过将潜在推理视为对意图变量的近似推断来实现这一点,该推断由图条件教师先验正则化,强制局部平滑性和可行性。

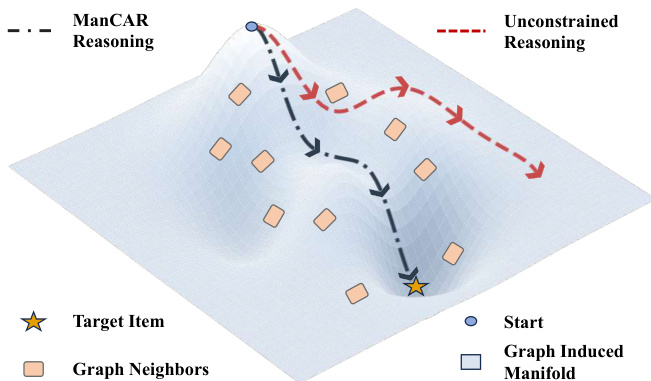

如下图所示,ManCAR 中的推理轨迹(虚线黑路径)被限制在低维区域——由最近项目的 k-hop 邻域定义的图诱导流形。这与无约束推理(虚线红路径)形成鲜明对比,后者在潜在空间中自由漫游,可能偏离可信意图。流形通过有限候选集 C(k)=C(In,G,k) 实例化,包括最近项目 In 及其在全局项目图 G 上的 k-hop 邻居。每个潜在推理状态被投影到项目概率单纯形上,但仅当分布质量集中在 C(k) 上时才被视为有效,从而将推理空间限制在结构化子区域。

训练目标源于变分视角。模型引入离散潜在意图变量 c∈C(k),下一项目 i∗ 的条件似然被分解为 pθ(i∗∣H)=∑c∈C(k)pθ(c∣H)pθ(i∗∣c,H)。图条件教师先验 q(c∣In,G) 独立于模型参数构建,编码从近期交互可达的可信意图的先验知识。作者推导出类似 ELBO 的目标:

logpθ(i∗∣H)≥Eq(c∣In,G)[logpθ(i∗∣c,H)]−DKL(q(c∣In,G)∥pθ(c∣H)).第一项鼓励在图可行意图条件下准确预测,而 KL 项正则化模型推断的意图分布以与教师先验对齐。此正则化明确限制潜在细化的自由度并缓解漂移。

参见框架图获取完整实现。SeqRec 模型通常为基于 Transformer 的编码器,处理用户交互历史 H 以生成初始潜在状态 r1=hT−1。在每个推理步骤 t′,模型通过共享推理模块细化潜在状态,并使用项目嵌入矩阵 E 投影到项目空间以生成 logits zt′=rt′⊤E。所得分布 pθ(t′)(i∣H) 用于目标预测和意图建模。

第 t′ 步的主要预测损失通过注入候选集 C(k) 作为辅助上下文近似,得到 Lmain(t′)=−logpθ(t′)(i∗∣H,C(k))。正则化损失是教师先验与诱导意图分布之间的 KL 散度:Lreg(t′)=DKL(q(c∣In,G)∥pθ(t′)(c∣H))。整体目标对所有推理步骤的损失求和,并加权正则化系数 λ。

为逐步引导推理,教师先验随时间逐渐锐化。使用基于排名的分布质量分配(RDMA)策略,教师分布定义为 qt′(c)∝exp(−rank(c)/γt′),其中 γt′=γbase⋅(T′−t′+1) 线性递减,从扩散先验过渡到以目标为中心的尖锐分布。此调度确保教师漂移有界,并支持自适应测试时终止:当连续学生分布之间的 KL 散度低于阈值 ϵ 时,推理停止,表明已收敛。

此外,为稳定多步推理,作者在每次细化步骤后应用潜在状态范数重缩放:h←ϕ⋅∥h∥h⋅avg(E),其中 avg(E) 是项目嵌入的平均范数,ϕ 是可学习的缩放参数。这使潜在状态范数与嵌入空间对齐,改善 softmax 条件,并支持理论分析中假设的逐步收缩行为。

实验

- ManCAR 在所有数据集和指标上持续优于所有基线模型,尤其在排序质量(NDCG)上表现突出,展示了通过结构化多步推理实现的优越意图细化能力。

- 图条件上下文提升性能,但显式潜在推理(如 ManCAR)相比仅上下文模型提供进一步增益,表明迭代细化更有效地解决不确定性。

- ManCAR 在推理时动态调整推理深度,在复杂数据集上使用更深步骤,在简单数据集上提前停止,实现接近最优性能的同时平衡效率与准确性。

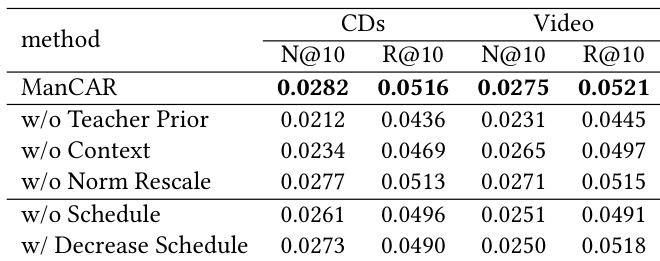

- 消融研究确认图驱动流形约束、上下文注入、潜在状态重缩放和损失调度至关重要;移除任一组件均导致性能下降,其中教师引导的流形控制最为关键。

- 模型对图邻居数量和训练步骤敏感,但对其他超参数鲁棒,可通过简单网格搜索可靠调优。

- KL 散度分析显示推理轨迹随步骤稳定,确认收敛性和一致细化行为。

- 注意力可视化揭示推理状态反复锚定在图条件上下文,后期层整合先前步骤——支持基于近期交互和图信号的受限、数据驱动细化路径。

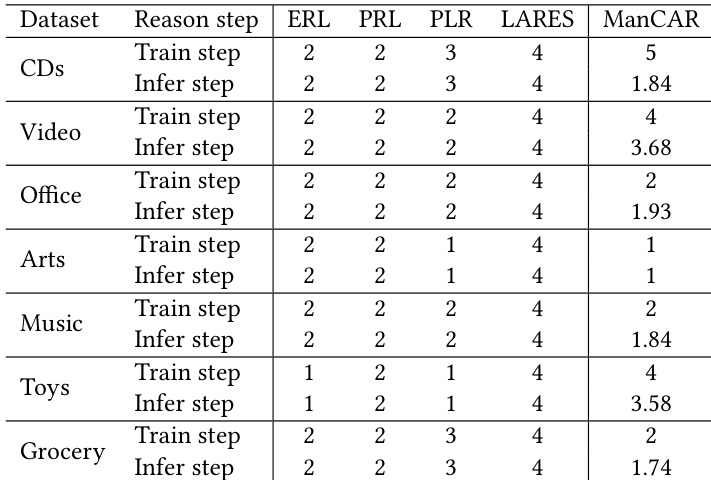

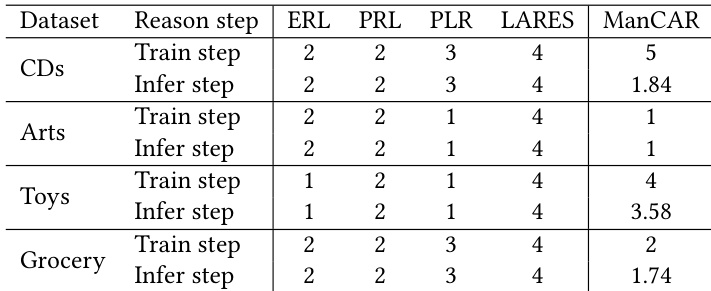

ManCAR 在训练和推理期间动态调整其推理深度,不同于先前方法在所有数据集上使用固定步数。它在 CDs 和 Toys 等复杂数据集上使用更深推理,而在 Arts 和 Grocery 等简单数据集上提前停止,以高效计算实现更优性能。这种数据感知的灵活性使 ManCAR 能够在不同数据特征下平衡表达力与效率。

作者使用消融实验分离 ManCAR 关键组件的贡献,显示移除教师先验导致最大性能下降,表明其在引导稳定潜在推理中的关键作用。结果表明每个组件——上下文注入、范数重缩放和损失调度——均对性能有显著贡献,缺失任一组件均导致所有指标一致下降。这证实 ManCAR 的设计元素协同工作,有效约束和细化推理轨迹。

ManCAR 在训练和推理期间动态调整其推理深度,在 CDs 和 Toys 等复杂数据集上使用更多步骤,而在 Arts 和 Grocery 等简单数据集上提前停止。这种数据感知的计算策略使其优于固定步数基线,同时保持效率。模型根据数据集调整步数的能力反映了其根据数据特征平衡推理表达力与计算成本的能力。

作者使用 ManCAR 在多个数据集和指标上超越所有基线模型,尤其在 NDCG 衡量的排序质量上表现强劲。结果表明,ManCAR 整合图条件上下文、调度教师监督和自适应推理,相比先前方法实现更稳定和有效的多步推理。模型通过数据感知的步数分配实现接近上限的性能,证明其结构化细化过程能适应数据集复杂性,同时保持计算效率。