Command Palette

Search for a command to run...

视觉虫洞:异构多Agent系统中的潜在空间通信

视觉虫洞:异构多Agent系统中的潜在空间通信

Xiaoze Liu Ruowang Zhang Weichen Yu Siheng Xiong Liu He Feijie Wu Hoin Jung Matt Fredrikson Xiaoqian Wang Jing Gao

摘要

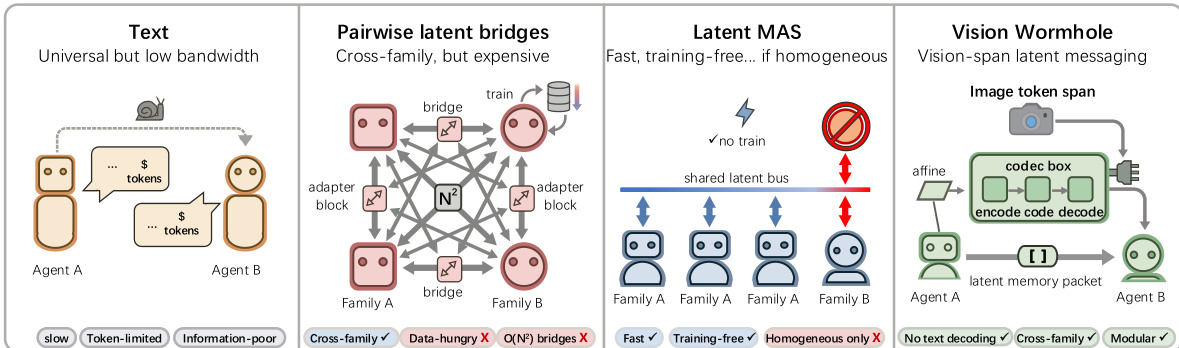

由大型语言模型驱动的多智能体系统(Multi-Agent Systems, MAS)已实现先进的协作推理能力,但仍受限于离散文本通信带来的低效问题,这种通信方式不仅造成显著的运行时开销,还引发信息量化损失。尽管潜在状态传递提供了一种高带宽的替代方案,但现有方法或假设发送方与接收方采用同构架构,或依赖成对特定的可学习翻译器,从而在具有不同流形结构的异构模型家族之间面临可扩展性与模块化不足的瓶颈。本文提出一种名为“视觉虫洞”(Vision Wormhole)的新框架,通过重用视觉-语言模型(Vision-Language Models, VLMs)的视觉接口,实现与模型无关、无需文本的智能体间通信。我们引入一种通用视觉编解码器(Universal Visual Codec),将异构的推理轨迹映射至共享的连续潜在空间,并直接注入接收方的视觉路径中,从而将视觉编码器视作实现跨智能体“心灵感应”通信的通用接口。该框架采用中心辐射式拓扑结构,将成对对齐的复杂度从 O(N2) 降低至 O(N),并设计了一种无标签的师生蒸馏目标,使高速视觉通道与文本路径中稳健的推理模式实现有效对齐。在多个异构模型家族(如 Qwen-VL、Gemma 等)上的大量实验表明,与标准文本驱动的多智能体系统相比,视觉虫洞在控制条件下显著减少了端到端的实时时延,同时保持了相当的推理保真度。相关代码已开源,地址为:https://github.com/xz-liu/heterogeneous-latent-mas

一句话总结

普渡大学、卡内基梅隆大学和佐治亚理工学院的研究人员提出了 Vision Wormhole,这是一种模型无关的框架,通过视觉接口实现多智能体系统中的无文本、高带宽通信,降低运行时间,同时在 Qwen-VL 和 Gemma 等异构大语言模型中保持推理保真度。

主要贡献

- Vision Wormhole 通过重用视觉语言模型的视觉接口,实现模型无关的连续潜在传输,绕过离散标记化开销和量化损失,从而解决多智能体系统中文本通信效率低下的问题。

- 它引入了一个通用视觉编解码器,将异构推理轨迹映射到共享潜在空间,并通过视觉编码器注入,采用中心辐射拓扑结构将对齐复杂度从 O(N²) 降低到 O(N),并使用无标签蒸馏目标对齐视觉和文本推理路径。

- 在包括 Qwen-VL 和 Gemma 在内的多个模型家族中评估,该框架在保持与标准文本多智能体系统相当的推理保真度的同时,减少了端到端的挂钟时间,展示了可扩展、即插即用的通信能力,无需成对适配器。

引言

作者利用视觉语言模型的视觉编码器,实现异构大语言模型在多智能体系统中高带宽、无文本的通信。传统的文本消息传递会带来运行时开销和量化损失,而先前的潜在空间方法要么假设模型同构,要么需要昂贵且不可扩展的成对翻译器。他们的主要贡献是 Vision Wormhole:一个通用视觉编解码器,将不同模型的输出映射到共享潜在空间,然后通过 VLM 的视觉路径注入——完全绕过标记化。这种中心辐射设计将对齐复杂度从 O(N²) 降低到 O(N),并使用师生蒸馏进行无标签训练,使 Qwen-VL 和 Gemma 等模型家族之间实现即插即用集成,同时保持推理保真度并减少挂钟时间。

数据集

-

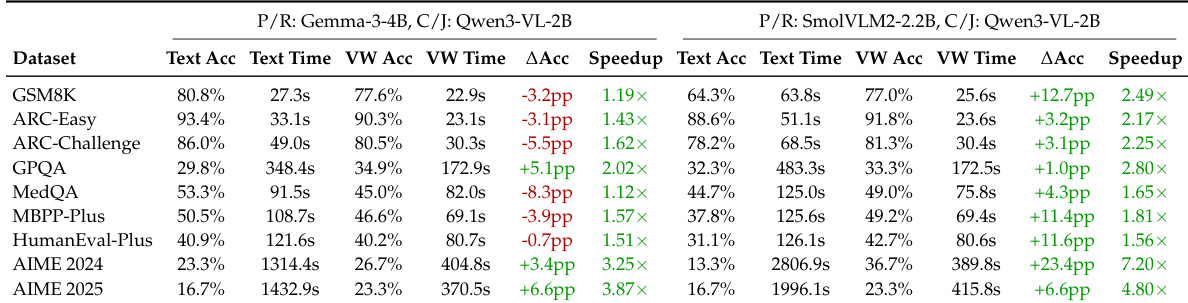

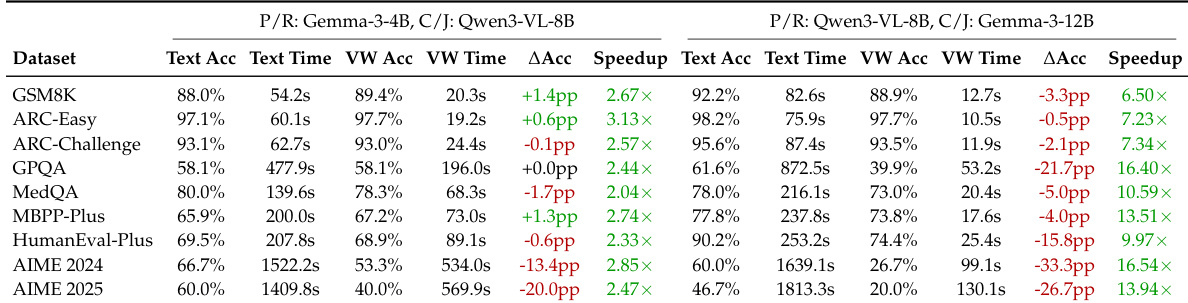

作者使用九个基准数据集,涵盖数学/科学推理(GSM8K、AIME 2024/2025、GPQA、MedQA)、常识推理(ARC-Easy、ARC-Challenge)和代码生成(MBPP-Plus、HumanEval-Plus),根据需要使用准确率或 pass@1 进行评估。

-

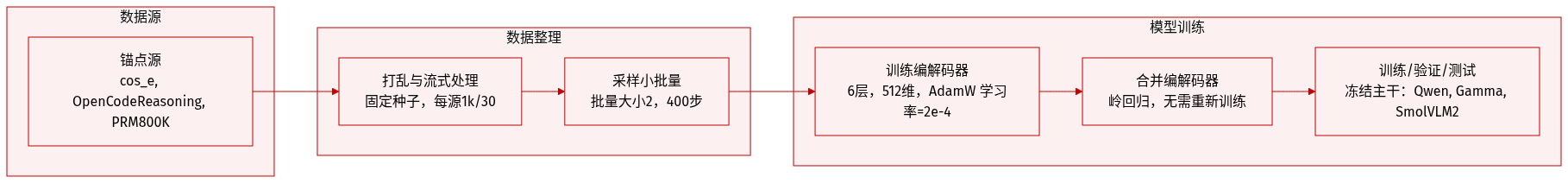

对于编解码器训练,他们从三个来源构建锚点语料库:cos_e、OpenCodeReasoning 和 PRM800K。默认设置每来源使用 1,000 个示例(共 3,000 个);弱监督变体每来源使用 30 个(共 90 个)。锚点以固定种子打乱,并通过流式加载以避免完全实例化。

-

训练时,他们在 400 个优化步骤中均匀随机采样大小为 2 的小批量(共 800 次抽样),默认设置下覆盖率约为 0.27x,弱监督变体约为 8.9x。

-

编解码器架构使用 6 个 Transformer 层、8 个注意力头、dropout 0.10,将潜在状态映射到固定 512 维空间,包含 1024 个通用标记和 256 个图像侧注入标记。训练使用 AdamW(lr=2e-4),损失结合隐藏状态 MSE(权重 1.0)、KL 风格的 logit 对齐(权重 0.25)和注入统计正则化(权重 0.1)。

-

对于多模型推理,他们通过闭式岭回归合并每个模型的编解码器以对齐通用空间——避免端到端重新训练——并在变体中保持架构、优化器和采样策略不变。

-

该模型在异构 MAS 设置中使用冻结的现成主干(Qwen、Google Gamma、SmolVLM2、LFM2.5-VL),在 2 或 4 个模型间交替角色(规划者 → 批评者 → 优化者 → 判断者)。Vision Wormhole 将推理轨迹编码为视觉标记,通过视觉路径注入,强制执行有限带宽和固定潜在步骤预算。

-

基线比较针对 TextMAS(文本中介通信),使用相同角色和提示;其他潜在方法(Cache-to-Cache、LatentMAS)在他们的异构主干下不稳定,未包含在主要结果中。

方法

作者提出了一种新颖的潜在通信框架——Vision Wormhole,使异构视觉语言模型(VLM)能够通过其图像标记跨度交换连续语义消息——无需修改主干参数或依赖文本中介。该架构模块化,包含三个阶段:每个代理的编解码器训练、跨模型仿射对齐和推理时消息传递——所有设计均旨在保持冻结 VLM 的语义保真度,同时实现高带宽、有限成本的代理间通信。

参考框架图,该图对比了 Vision Wormhole 与先前方法,如文本消息传递、成对潜在桥接和同构潜在 MAS。Vision Wormhole 通过重用 VLM 的原生视觉接口作为连续提示通道,独特地结合了跨家族兼容性、无需训练的推理和模块化。

在第一阶段,每个代理的编解码器通过无标签自蒸馏独立训练。给定锚点文本消息 m,冻结的 VLM 主干通过迭代反馈从隐藏状态派生的归一化伪标记嵌入(使用缓存的注意力上下文)生成潜在展开 Hi∈RT×di。此展开作为代理内部推理状态的紧凑、连续摘要。编码器 Ei(实现为 Perceiver 风格的重采样器)将 Hi 压缩为 Ku=K+2 个通用标记 Ui∈RKu×D,其中 K 个标记编码语义,两个特殊标记捕获全局和风格统计。解码器 Di 随后将 Ui 映射到视觉跨度扰动 Δi∈RKimg×di 和标量门控 gi∈(0,1),用于调节注入强度。扰动以残差形式写入代理的图像标记跨度,相对于固定虚拟图像基线 Xˉimg(i):

Ximg(i)=Xˉimg(i)+gi⋅Resample(Δi;Limg(i))训练最小化蒸馏损失,使学生(视觉注入)隐藏状态和下一个标记 logits 与教师(文本注入)输出对齐,同时正则化注入扰动的 RMS 幅度,使其接近视觉嵌入流形。

在第二阶段,作者使用中心辐射仿射映射策略对齐异构代理的编解码器。不是训练 O(N2) 个成对适配器,每个代理学习两个轻量级仿射变换——Aiout 将其通用标记映射到共享参考空间 U,Aiin 映射回。这些映射通过在少量锚点文本上进行岭回归拟合,利用编码器已将消息压缩到结构化、低维标记集的事实,该标记集适合线性对齐。仿射映射定义为:

Uref=Aiout(Ui)=UiWiout+1(biout)⊤,Ui=Aiin(Uref)=UrefWiin+1(biin)⊤,其中 Wiout,Wiin∈RD×D 且 biout,biin∈RD。

如下图所示,推理管道完全在参考通用空间中运行。协作期间,发送代理提取潜在展开,编码为通用标记,并通过 Asout 映射到参考空间。接收代理通过 Aiin 映射回标记,解码为视觉跨度扰动,并注入其图像标记跨度。内存聚合在解码前沿标记维度拼接多个接收消息,确保无论消息长度如何,通信成本有限。最终代理输出自然语言答案,中间角色仅产生潜在展开。

该设计实现了跨模型家族的即插即用推理,避免了成对训练开销,并利用 VLM 的预训练能力将连续视觉嵌入解释为语义上下文——从而将图像标记跨度转化为高保真、模态无关的通信通道。

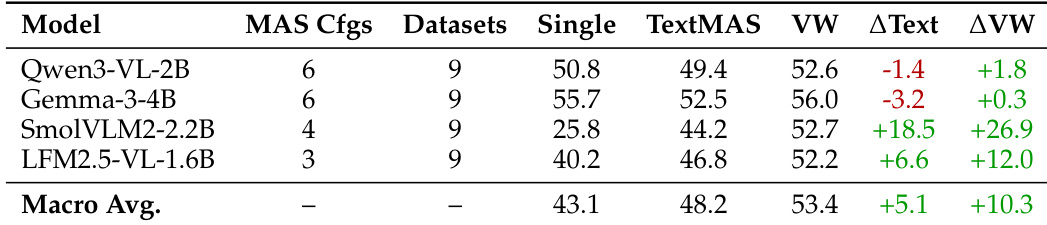

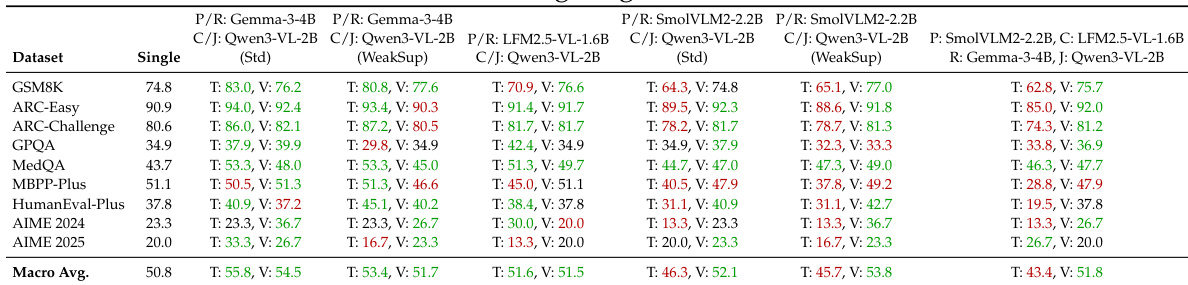

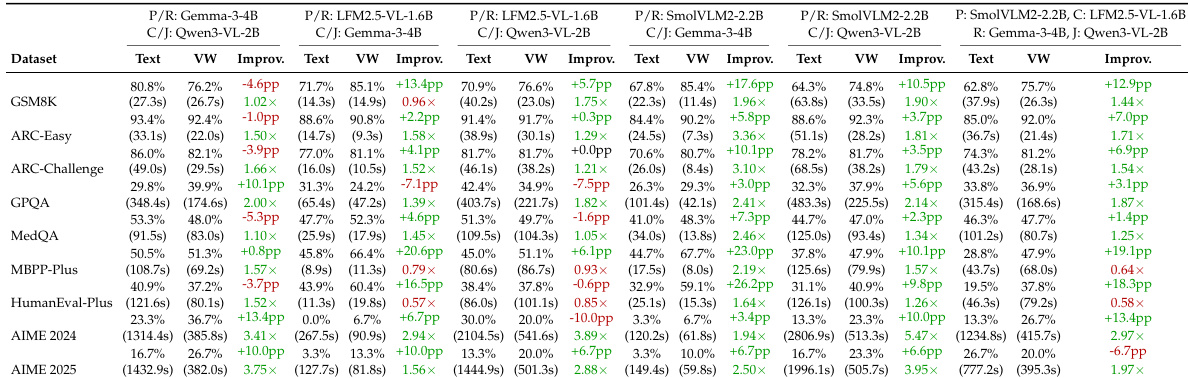

实验

- Vision Wormhole(VW)在异构多智能体设置中始终加速推理,且通常优于 TextMAS,宏观平均准确率提升 +6.3pp,速度提升 1.87 倍。

- 在代码生成任务中表现最佳,VW 实现 +13.2pp 准确率提升和 1.21 倍速度提升,尽管性能因角色分配和主干配对而异。

- 在弱监督下(少于 100 个锚点文本),VW 保持稳健性能,准确率提升 +6.5pp,速度提升 2.67 倍,证实视觉接口作为连续通信端口的有效性。

- 与单智能体基线相比,VW 更好地保留强模型性能,同时增强弱模型,表明有限潜在通信减少了跨角色干扰。

- 在中型模型(4B–12B)中,VW 实现高加速(宏观平均 5.92 倍,某些任务超过 10 倍),但在复杂任务中准确率下降,表明更强主干的默认带宽限制。

- 运行时分析显示,VW 产生更快、更稳定的推理,延迟分布更紧,因为固定视觉标记跨度减少了可变长度文本消息固有的变异性。

- 这些效率和稳定性优势在主要、弱监督和中型设置中持续存在,支持 VW 在不同条件下的适应性和稳健性。

作者使用 Vision Wormhole 替代多智能体系统中的文本通信,观察到在各数据集上始终加速,同时在大多数情况下保持或提高准确率。结果表明,视觉接口减少了运行时变异性,实现了高效协作,尤其在代码生成任务中表现突出,但在使用较大模型且固定通信带宽时,复杂推理基准的准确率可能下降。该方法在弱监督下表现稳健,并在异构团队中相比纯文本协调更好地保持强模型性能。

作者将单智能体基线与使用 TextMAS 和 Vision Wormhole(VW)通信的多智能体系统(MAS)配置进行比较。结果表明,VW 在保持或提升准确率方面始终优于 TextMAS,尤其对弱模型,同时带来显著的系统效率提升。对于强模型,VW 减轻了 TextMAS 中常见的准确率下降,表明在异构代理团队中对编排效应更具鲁棒性。

作者在多个异构多智能体设置中比较 Vision Wormhole 与 TextMAS,发现 Vision Wormhole 始终减少推理时间,同时通常保持或提高准确率,尤其对弱主干。结果表明,Vision Wormhole 在协作设置中更好地保留强单模型性能,且由于其有限通信接口,运行时行为更稳定。在更大模型中,尽管加速仍显著,但若固定通信带宽成为更丰富推理状态的瓶颈,准确率可能下降。

作者使用 Vision Wormhole 替代多智能体系统中的文本通信,发现它始终减少推理时间,同时在不同模型配置中通常提高准确率。结果表明,该方法在代码生成任务中特别有效,即使在弱监督下也保持稳健,加速高达 2.67 倍,平均准确率提升 +6.5pp。然而,在固定通信带宽的较大模型中,复杂任务的准确率可能下降,表明带宽必须随模型容量扩展以维持性能。

作者使用 Vision Wormhole 替代多智能体系统中的文本通信,观察到它在不同模型配对中始终减少推理时间,同时通常提高准确率。结果表明,性能增益因任务和模型强度而异,强主干在固定通信带宽下有时会面临准确率权衡。该方法在弱监督下表现稳健,且相比文本交换保持更稳定的运行时分布。