Command Palette

Search for a command to run...

DRACO:一个面向深度研究准确性、完整性与客观性的跨领域基准

DRACO:一个面向深度研究准确性、完整性与客观性的跨领域基准

Joey Zhong Hao Zhang Clare Southern Jeremy Yang Thomas Wang Kate Jung Shu Zhang Denis Yarats Johnny Ho Jerry Ma

摘要

我们提出了 DRACO(Deep Research Accuracy, Completeness, and Objectivity,即深度研究的准确性、完整性与客观性基准),这是一个针对复杂深度研究任务的评估基准。这些任务涵盖 10 个领域,并整合了来自 40 个国家的信息源,其数据源自某大规模深度研究系统中匿名化的真实使用模式。任务样本选自 Perplexity Deep Research 请求的去标识化数据集,并经过筛选与增强处理,以确保任务具备匿名性、开放性与复杂性,支持客观评估,并能代表现实世界中深度研究应用的广泛场景。输出结果将依据任务特定的评分标准,从四个维度进行评分:事实准确性(accuracy)、分析的广度与深度(含 completeness)、呈现质量(含 objectivity)以及引用质量。DRACO 已公开,访问地址为:https://hf.co/datasets/perplexity-ai/draco。

一句话总结

Perplexity AI 研究人员推出了 DRACO,这是一个跨领域基准,用于评估深度研究的准确性、完整性和客观性。该基准源自匿名的 Perplexity Deep Research 请求,涵盖 10 个领域和 40 个国家,通过特定任务的评分标准评估开放性和复杂任务的输出,评估维度包括事实准确性、分析的广度和深度、呈现质量以及引用质量。

核心贡献

- 我们推出了 DRACO,这是一个源自匿名真实世界使用模式的复杂深度研究任务基准,涵盖 10 个领域和 40 个国家。该数据集源自去标识化的 Perplexity Deep Research 请求,并公开可用於 https://hf.co/datasets/perplexity-ai/draco。

- 输出根据特定任务的评分标准在四个维度上进行分级:事实准确性、分析的广度和深度、呈现质量以及引用质量。该评估框架确保任务可客观评估,并能代表真实世界深度研究用例的广泛范围。

- 该方法论过滤并增强原始查询,以确保任务是开放性的、复杂的且可客观评估的。技术包括添加交付格式、检索指令和时间边界。

引言

深度研究 agents 在处理产生主观或不可验证信息的模糊查询时经常遇到挑战。当前系统通常缺乏标准化协议来跨不同领域执行时间边界和特定指标。作者介绍了 DRACO,这是一个跨领域基准,旨在评估和提高 AI 驱动研究的准确性、完整性和客观性。他们利用多阶段流水线对查询进行预处理以提高清晰度,并添加权威检索指令进行增强。该框架整合了网络搜索和代码执行工具,以根据具体数据而非意见来验证发现。

数据集

数据集组成和来源

- 作者介绍了 DRACO,这是一个由 100 个复杂深度研究任务组成的基准,源自生产的 Perplexity Deep Research 请求。

- 任务涵盖 10 个通用和专业领域,需要从 40 个不同国家获取信息源。

- 数据源自数百万真实世界用户请求的去标识化数据集。

子集细节和处理

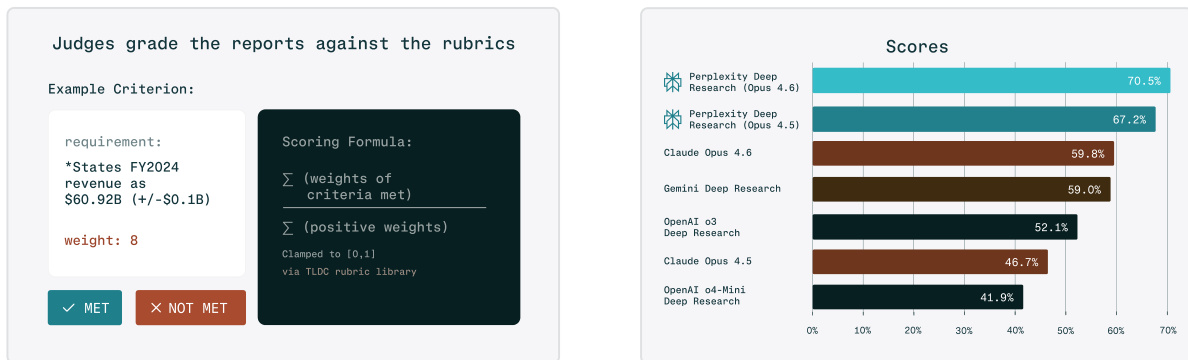

- 初始采样选择 1,000 个高难度英文查询,这些查询由负面用户情绪或踩评分标识。

- 自动化流水线通过用通用占位符替换姓名、地址和 ID 来移除个人身份信息。

- 查询经过增强以增加上下文,例如用户角色和期望的输出格式,同时扩大分析范围。

- 最终过滤仅保留客观、可处理且具有挑战性的任务,随后经人工专家审查确认安全性和质量。

在模型评估中的使用

- 该数据集作为评估深度研究系统的基准,而非用于训练。

- 输出根据特定任务的评分标准在四个维度上进行分级,包括事实准确性和引用质量。

- 评估在英文单轮文本到文本交互上进行,以评估推理和检索能力。

- 作者使用该框架比较了领先的系统,如 OpenAI Deep Research 和 Gemini Deep Research。

元数据和评分标准构建

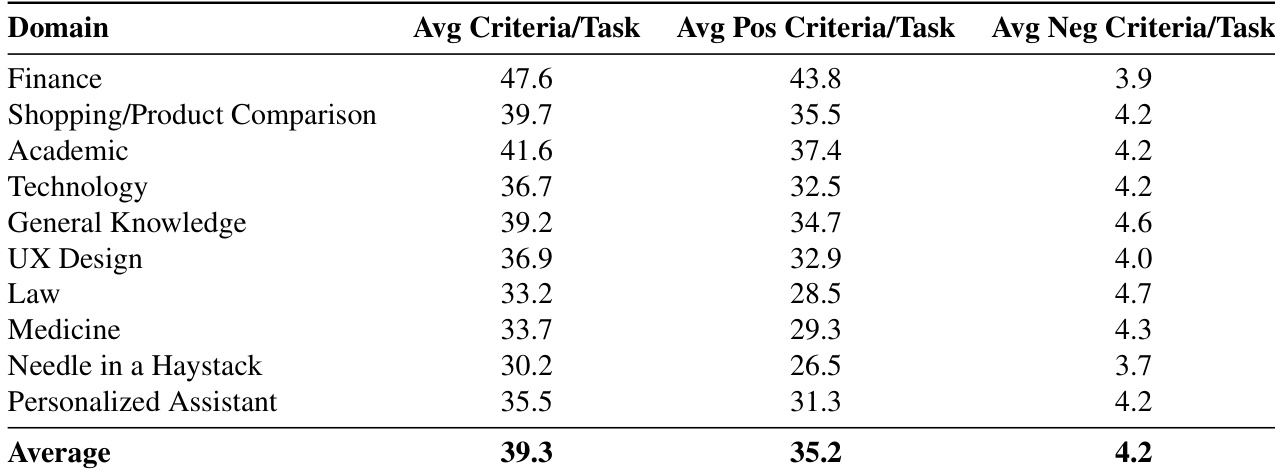

- 领域专家设计评分标准,每个任务平均包含 39.3 个标准,以确保严格评估。

- 标准包括正面要求和负面惩罚,并根据严重程度分配特定权重,例如有害医疗内容。

- 构建过程涉及迭代审查和饱和测试,以防止任务过于简单。

- 流水线设计为可自动化,以便未来更新,同时保持人工安全关卡。

方法

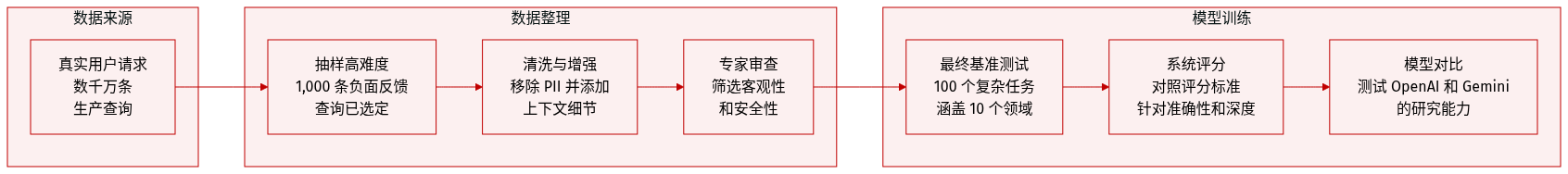

作者利用多阶段流水线构建和评估具有挑战性的深度研究任务,旨在反映真实世界的复杂性并确保高质量输出。该框架始于阶段 1:采样,其中从多样化的来源中抽取数千万潜在深度研究查询的大池,以实现广泛覆盖并反映真实世界使用的分布。此阶段从一个月生产窗口中选择 1,000 个样本子集,专注于固有具有挑战性的任务。

如下图所示,过程进入阶段 2:预处理,这是算法驱动的,不需要人工参与。主要目标是通过基于大型语言模型 (LLM) 的流水线移除个人身份信息 (PII)。此阶段还通过解决歧义和修复语法及拼写错误来解决不完整查询,确保查询清晰且可回答。

在阶段 3:增强中,框架丰富预处理后的查询以增加其难度和特异性。此阶段以结构化、链式的方式运行,专注于任务的不同方面。它首先从查询的领域和复杂性中推断专业角色,确保任务框架适当。然后通过添加同行实体或竞争对手来扩展查询的上下文和范围,并进行地理范围扩展以纳入具有不同信息来源的关键区域。目标是指定上下文并增加任务难度,同时保留原始查询意图。输出是一个精化并增强的查询,无前导或解释。

增强后的查询随后传递至阶段 4:过滤,其中基于三个标准选择高质量任务:客观答案、有限范围和具有挑战性的多跳任务。此阶段旨在选择定义明确、不过于宽泛且需要大量研究工作的任务。过滤后的查询进入阶段 5:策划,通过安全检查、两层专家审查和代表性深度研究使用分布来确保质量。

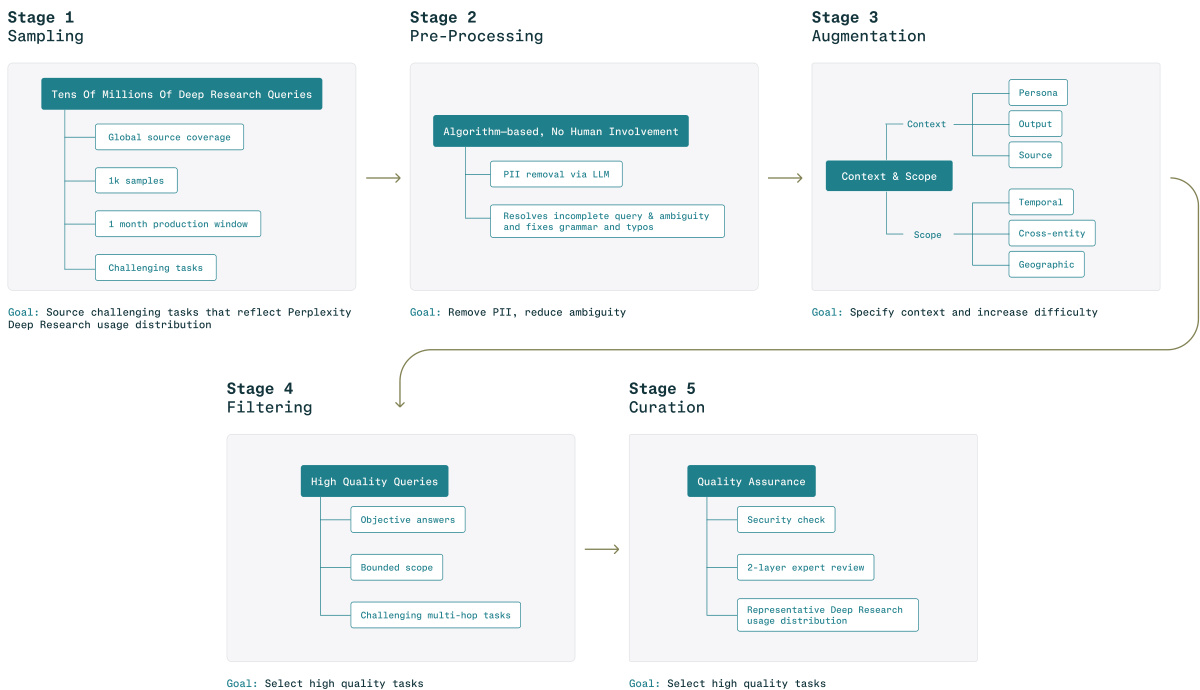

评估协议涉及评分标准创建和任务评估的独立过程。阶段 1:评分标准创建涉及专家与 LLM 工具合作进行多次迭代,每个评分标准大约需要 45 分钟到一小时。随后是阶段 2:迭代审查和修订,第二位专家审查并提供反馈,识别诸如缺少标准或内容不正确等问题。随后在阶段 3:饱和测试中测试评分标准,以确保它们具有足够的挑战性,分析 agent 步骤和工具调用的轨迹,并检查任务在评分标准上的得分是否超过 90%。最后在阶段 4:最终审查中,第三位专家批评评分标准内容,第四位专家检查任务对当前及可预见未来的深度研究系统是否具有足够的挑战性。

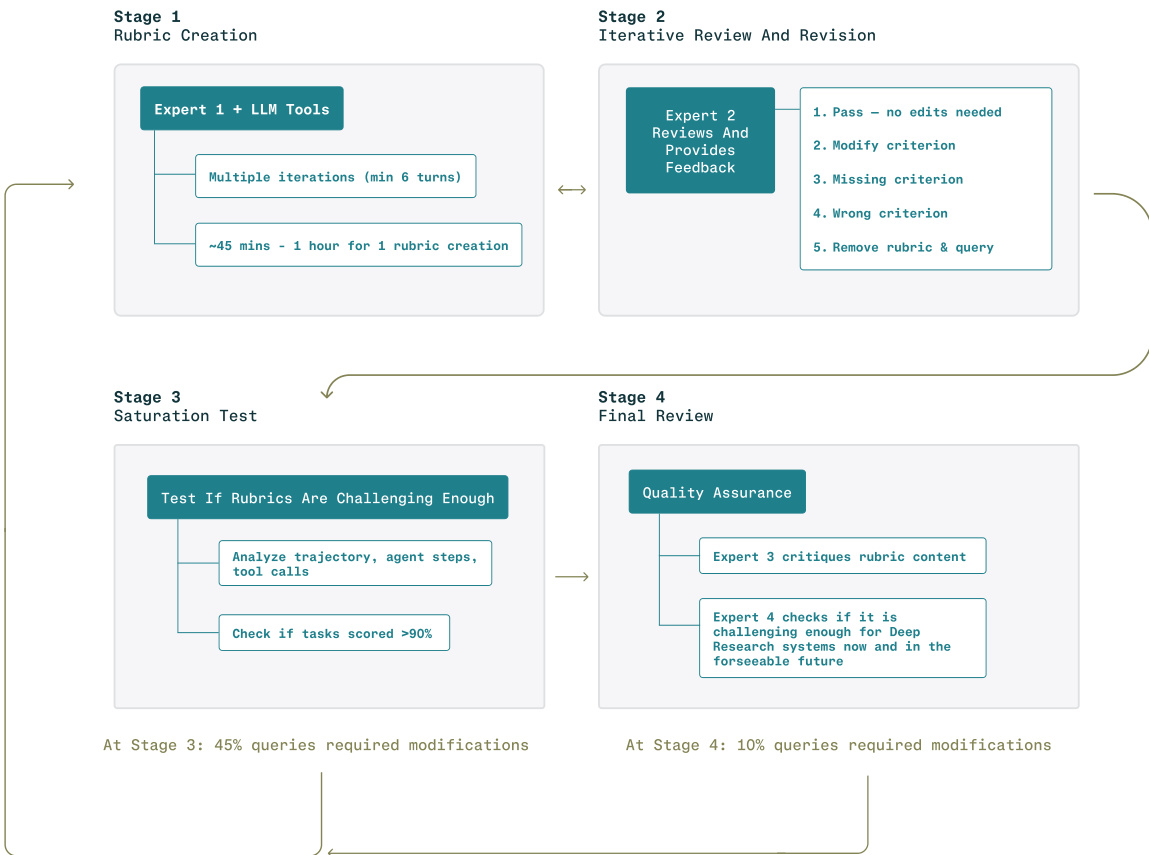

生成报告的评估由评审员使用预定义的评分标准进行。每个标准独立评估,评审员确定响应是否满足或未能满足特定要求。评分公式基于满足标准的权重之和,限制在范围 [0,1] 内。如下图所示,评审员根据评分标准对报告进行分级,示例标准要求响应声明 FY2024 收入为 60.92B(+/−0.1B),权重为 8。各种模型的最终得分显示在柱状图中,展示了不同大型语言模型在 Perplexity Deep Research 基准上的性能。

实验

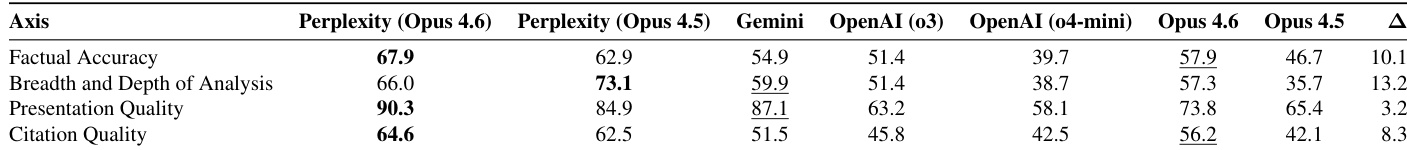

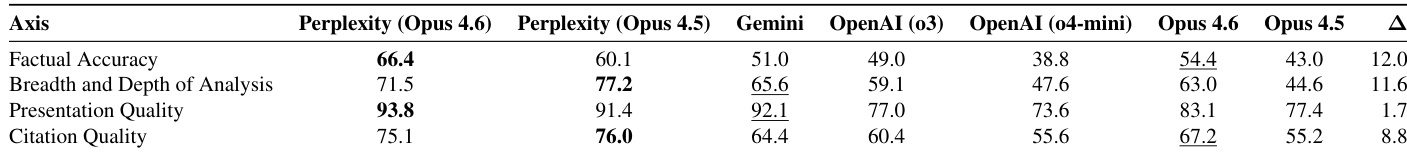

评估利用 LLM-as-a-judge 协议和加权评分标准来评估深度研究系统的归一化得分和通过率。Perplexity Deep Research 在所有领域和评分标准轴上始终优于来自 OpenAI、Gemini 和 Claude 的竞争对手,突显了 agent 编排相对于仅基础模型能力的重要性。系统排名在不同评审员模型之间保持稳定,验证了方法论的稳健性,尽管绝对分数幅度存在差异。此外,表现最佳的系统相比更冗长的替代方案实现了优越的延迟效率,展示了质量与资源使用之间的有利平衡。

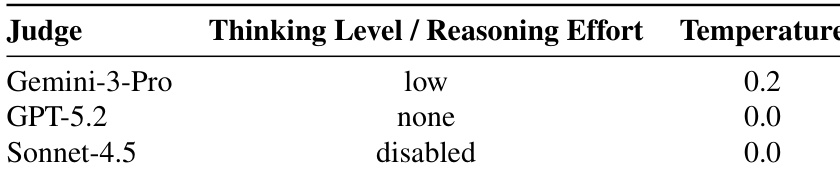

作者使用具有不同配置的多个 LLM 评审员来评估深度研究系统。评审员设置在推理努力和温度上有所不同,以评估评估方法的稳健性。使用具有不同推理和温度设置的不同 LLM 评审员以确保评估稳健性。GPT-5.2 不使用推理努力,温度为 0.0 以获得确定性输出。Gemini-3-Pro 采用低推理努力,温度为 0.2 以限制变异性。

结果显示,Perplexity Deep Research 在所有评分标准轴上实现了最高的归一化得分,在事实准确性、分析的广度和深度、呈现质量以及引用质量上表现始终顶尖。第二好的结果因轴而异,不同模型在特定类别中领先。Perplexity Deep Research 在所有四个评分标准轴上领先,呈现质量在各系统中显示最高得分,Opus 4.6 和 Opus 4.5 在大多数轴上表现相似,略有差异。

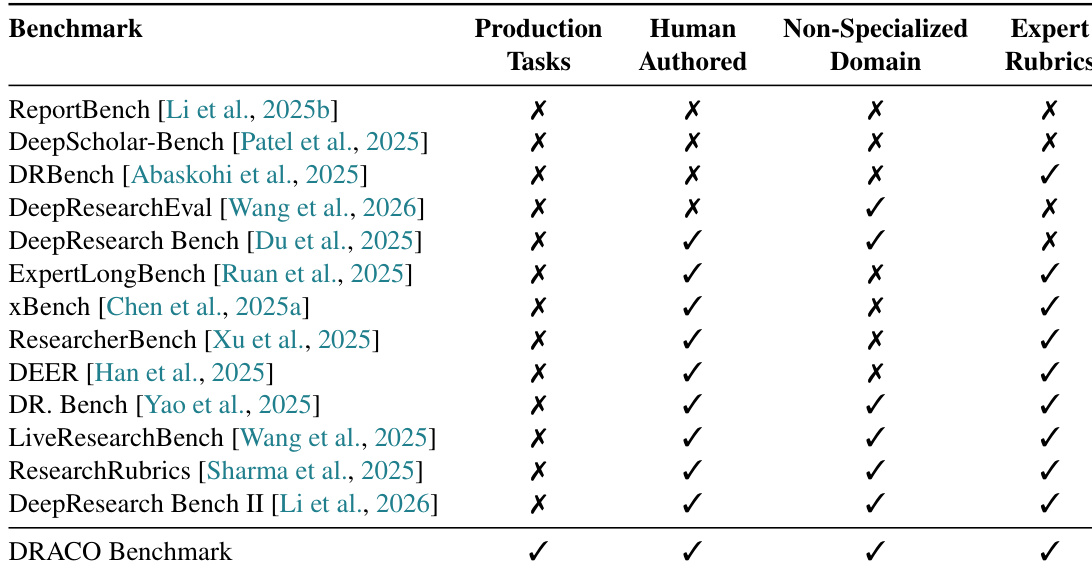

该表根据是否包含生产任务、人工编写内容、非专业领域和专家评分标准来比较各种研究基准。DeepResearch 基准被定位为一个综合评估框架,结合了所有四个标准,使其与其他基准区分开来。DeepResearch 基准包括生产任务、人工编写内容、非专业领域和专家评分标准。其他基准要么缺少一个或多个这些特征,例如生产任务或专家评分标准。DeepResearch 基准旨在以全面的方式评估深度研究系统,涵盖真实场景和专家标准。

结果显示,带有 Opus 4.6 的 Perplexity Deep Research 在所有评分标准轴上始终实现了最高的归一化得分。Perplexity 与其他系统之间的差距在分析的广度和深度以及事实准确性方面最为显著,而在呈现质量方面的性能差异较小。带有 Opus 4.6 的 Perplexity Deep Research 在所有四个评分标准轴上领先。Perplexity 与第二佳模型之间的性能差距在分析的广度和深度以及事实准确性方面最大。呈现质量在表现最佳的系统之间显示最小的差距。

该表展示了不同领域每个任务的正面和负面标准的平均数量,显示了评估指标的整体平衡。平均值表明任务中标准类型的分布一致,正面标准的数量高于负面标准。每个任务的正面标准平均数量在所有领域均超过负面标准的平均数量。金融领域的每个任务平均标准数量最高,表明评估结构更复杂。每个任务的负面标准平均数量在不同领域之间相对一致,略有变化。

作者使用具有不同配置的多个 LLM 评审员来评估深度研究系统,以确保评估稳健性。实验结果表明,Perplexity Deep Research 在所有评分标准轴上始终优于竞争模型,特别是在事实准确性和分析广度方面表现出色。此外,该研究验证了 DeepResearch 基准作为一个综合框架,通过结合生产任务和专家评分标准以及人工编写内容而区别于其他框架。