Command Palette

Search for a command to run...

在线教程丨指令遵循/推理/编码三合一,Mistral Medium 3.5 把 Coding Agent 搬上云端

随着 AI Agent 能力持续进化,大模型正在从「对话助手」逐渐变成真正能够执行任务的智能系统。近期,Mistral AI 发布的 Mistral Medium 3.5 再次将 AI Coding Agent 推向新的阶段。相比传统只能完成简单代码补全的编程助手,其已经能够在云端独立运行、并行处理任务,并持续完成复杂的软件开发流程,包括代码生成、调试、依赖安装、测试执行乃至 Pull Request 提交。

作为 Mistral 最新推出的旗舰级模型,Mistral Medium 3.5 采用 128B 稠密架构,拥有 256k 上下文窗口,并首次将指令遵循、推理与编码能力融合进单一模型之中。

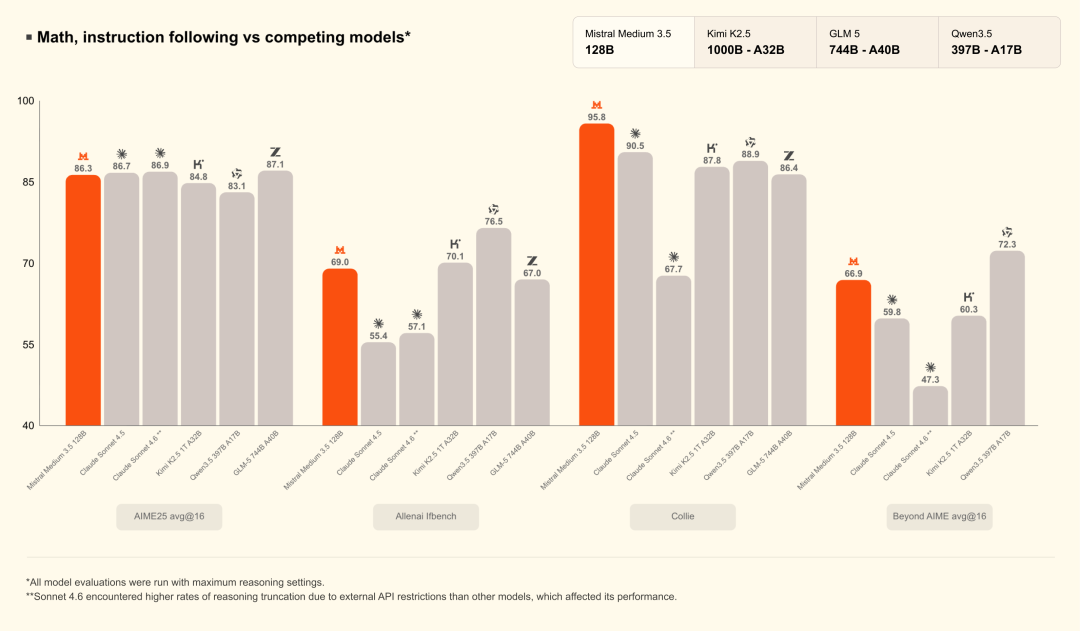

与当前大量依赖 MoE 架构的大模型不同,Mistral 选择继续强化 Dense Model 路线,在保证推理稳定性的同时,进一步提升长时程任务处理能力。官方数据显示,Mistral Medium 3.5 在 SWE-Bench Verified 上取得了 77.6% 的成绩,超过 Devstral 2 以及 Qwen3.5 397B A17B 等模型,同时在 τ³-Telecom 等 Agent 能力测试中也展现出较强表现。

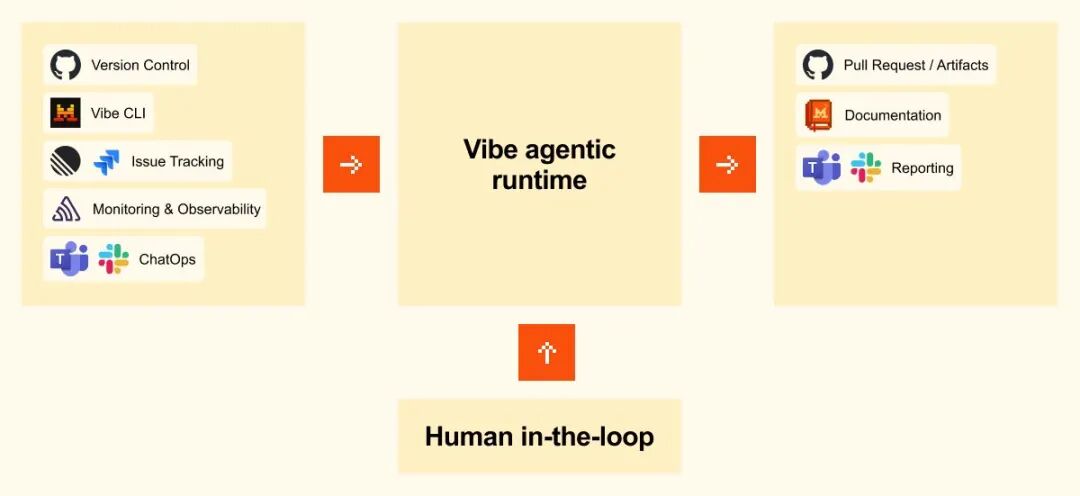

除了模型本身,此次更新更值得关注的是 Mistral 对 AI Agent 工作流的整体重构。通过 Vibe Remote Agents,开发者可以直接在云端运行异步 Coding Session,任务不再依赖本地电脑持续在线。用户既可以通过 CLI 发起任务,也能够直接在 Le Chat 中启动云端 Agent,让模型持续执行多步骤编码工作,包括模块重构、测试生成、 CI 排查与 Bug 修复等。与此同时,新增的 Work Mode 还支持跨工具协同,能够调用邮件、日历、文档与协作平台等外部系统,逐步向真正的「执行型 AI 助手」演化。

某种程度上,Mistral Medium 3.5 所代表的,不只是一次模型升级,而是 AI Coding 从「Copilot」向「Autonomous Agent」转变的重要信号。过去,AI 更多承担辅助生成代码的角色;而现在,模型已经开始具备长时间执行任务、调用工具、管理流程与交付结果的能力。随着上下文长度、推理稳定性与 Agent Framework 的持续提升,未来的软件开发流程也可能因此发生新的变化。

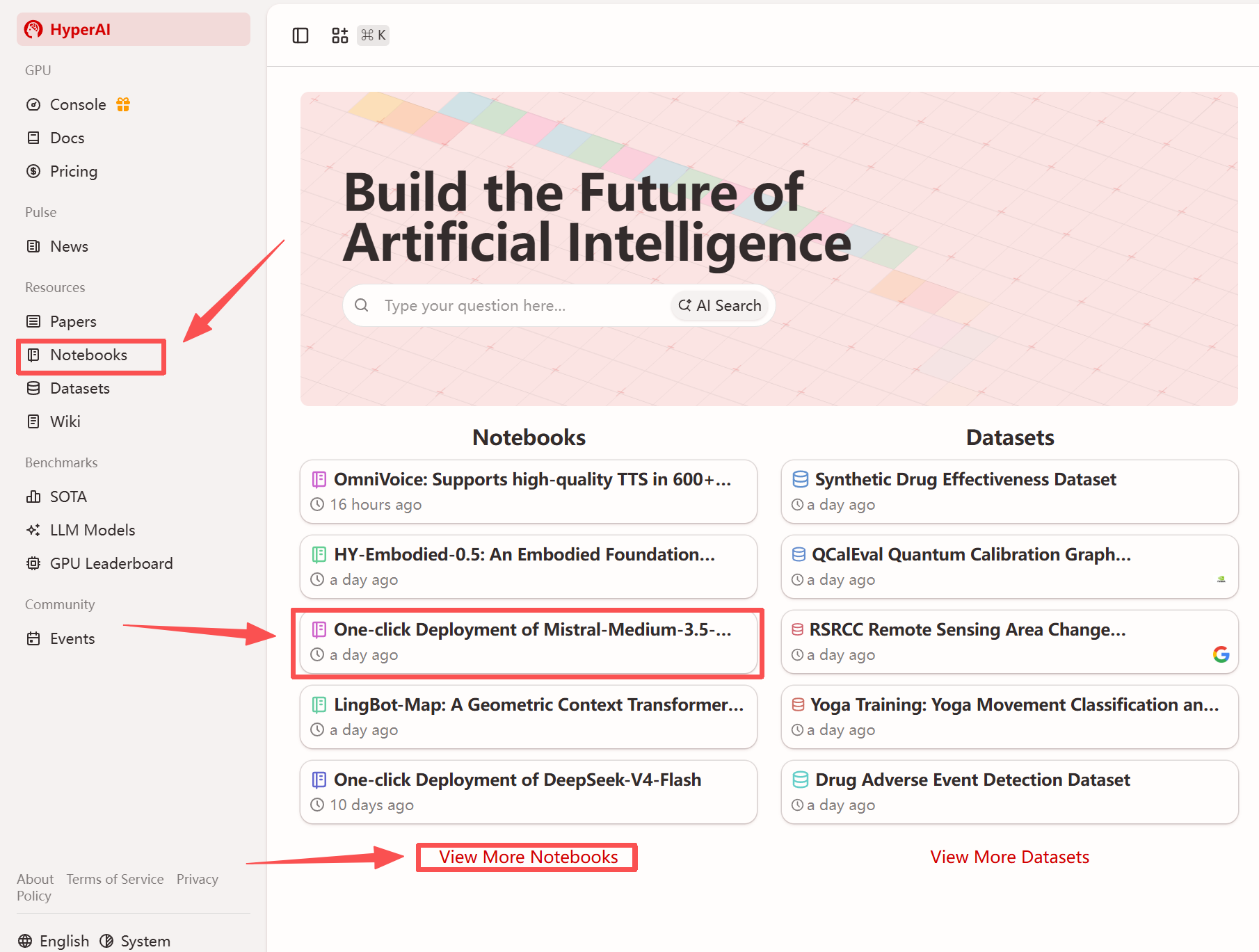

目前,HyperAI 官网(hyper.ai)的教程版块已经上线了「一键部署 Mistral-Medium-3.5-128B」,完成环境配置,进一步降低模型使用门槛。

在线运行:

更多在线教程:

欢迎登录官网查看更多内容:

Demo 运行

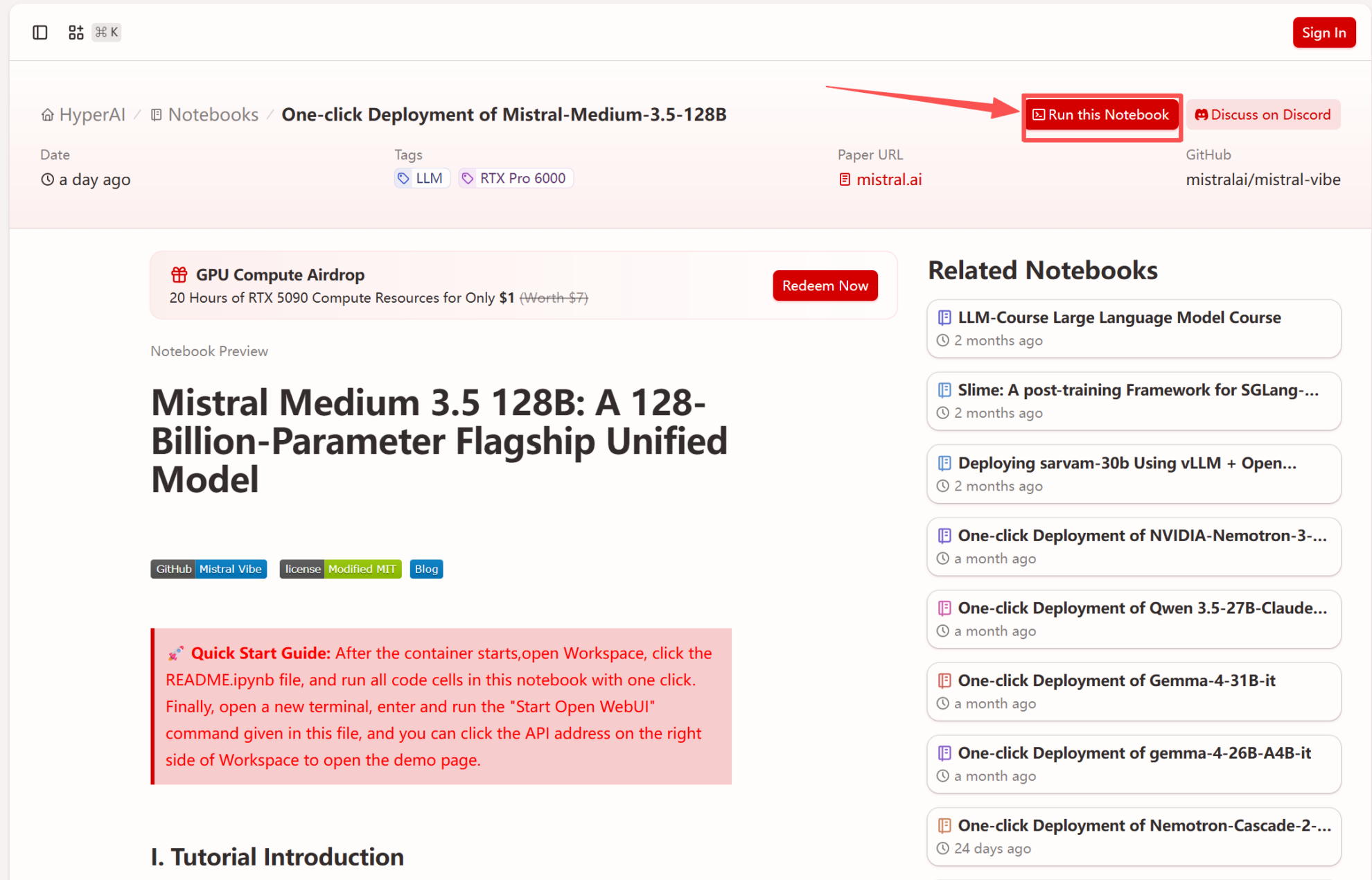

1. 进入 hyper.ai 首页后,选择「教程」页面,或点击「查看更多教程」,选择「一键部署 Mistral-Medium-3.5-128B」,点击「运行此教程」。

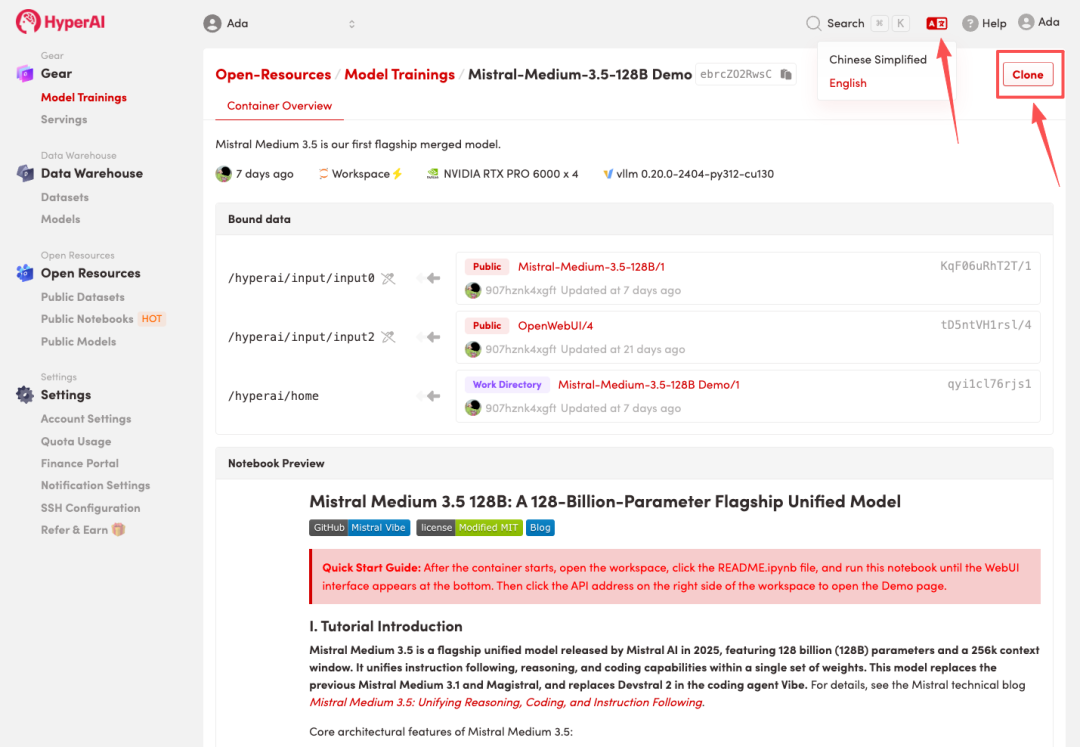

2. 页面跳转后,点击右上角「Clone」,将该教程克隆至自己的容器中。

注:页面右上角支持切换语言,目前提供中文及英文两种语言,本教程文章以英文为例进行步骤展示。

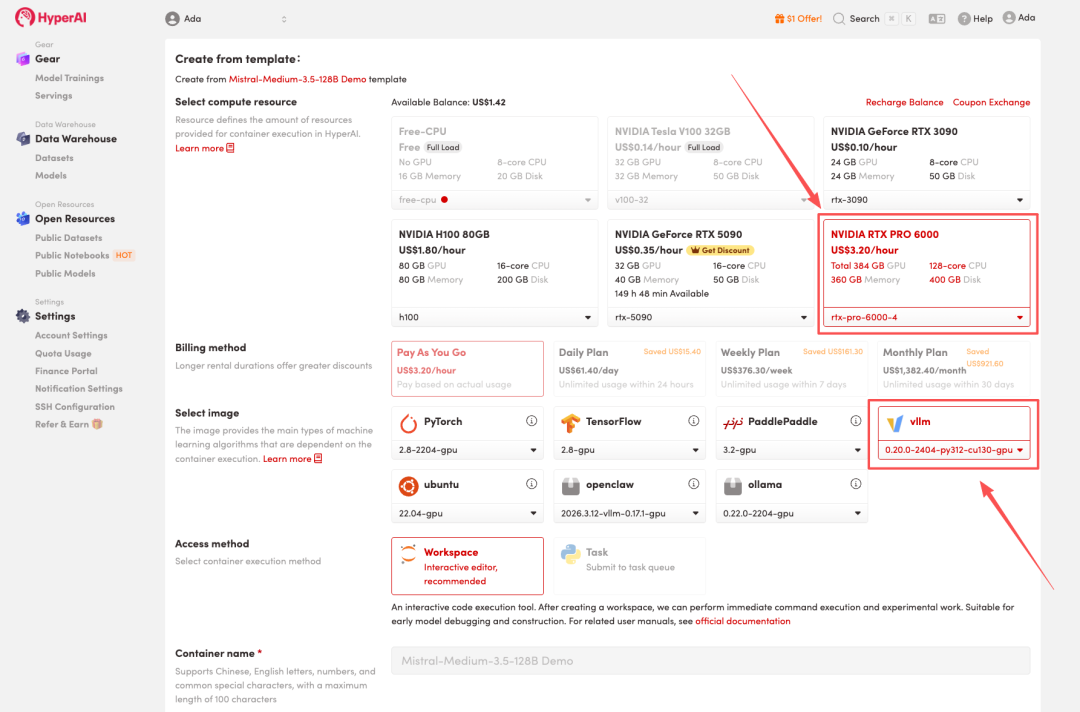

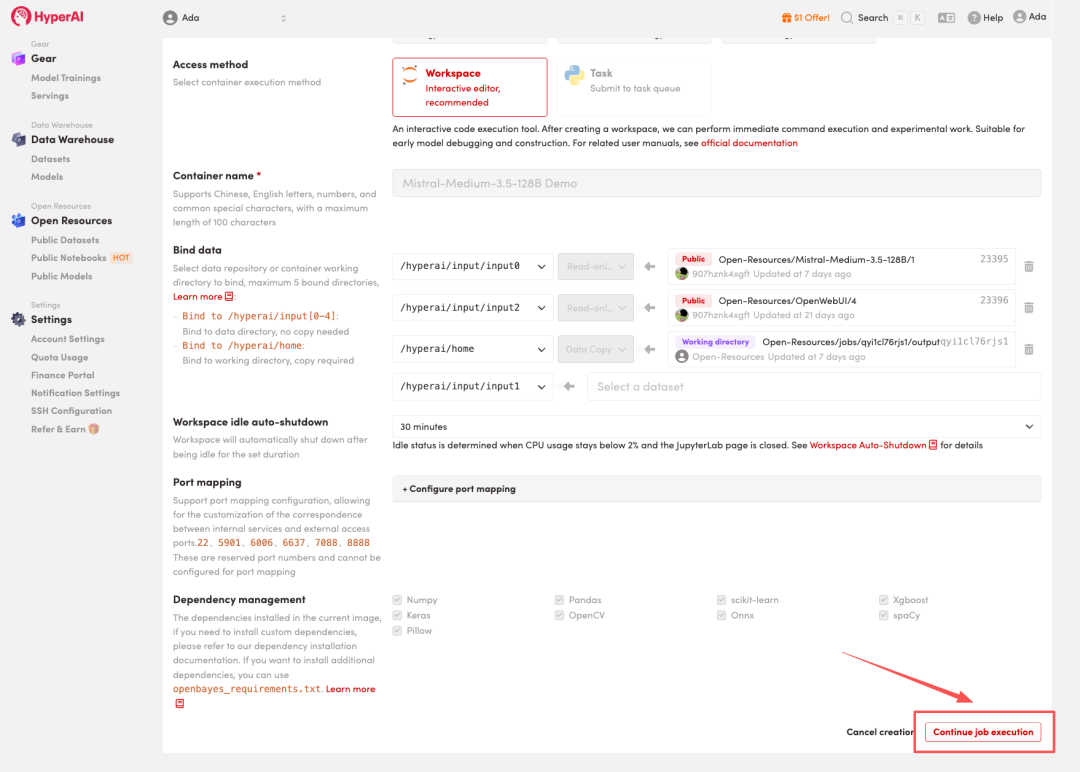

3. 选择「NVIDIA RTX PRO 6000 -4」以及「vLLM」镜像,点击「Continue job execution(继续执行)」。

HyperAI 为新用户准备了注册福利,仅需 $1,即可获得 20 小时 RTX 5090 算力(原价 $7),资源永久有效。

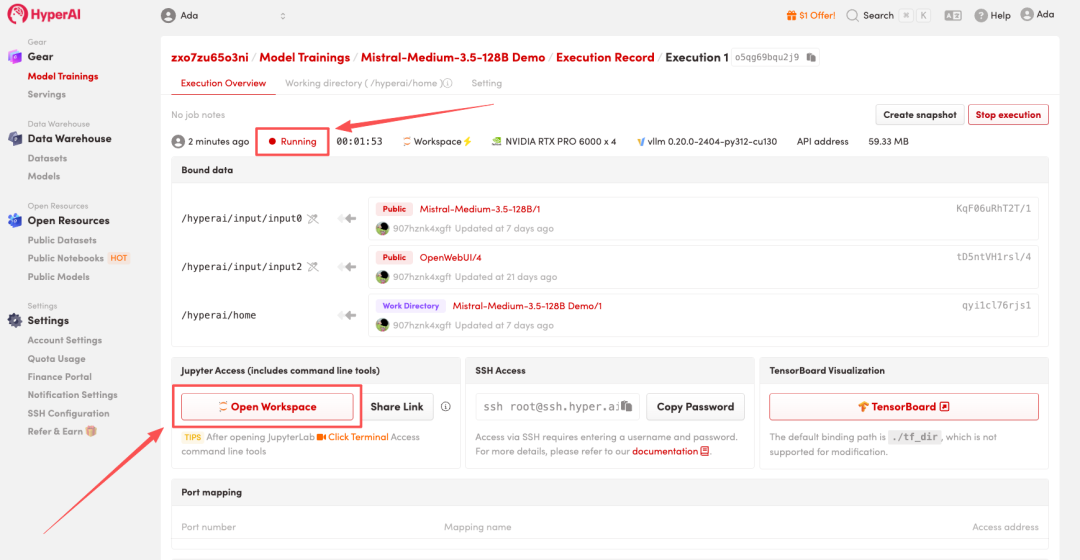

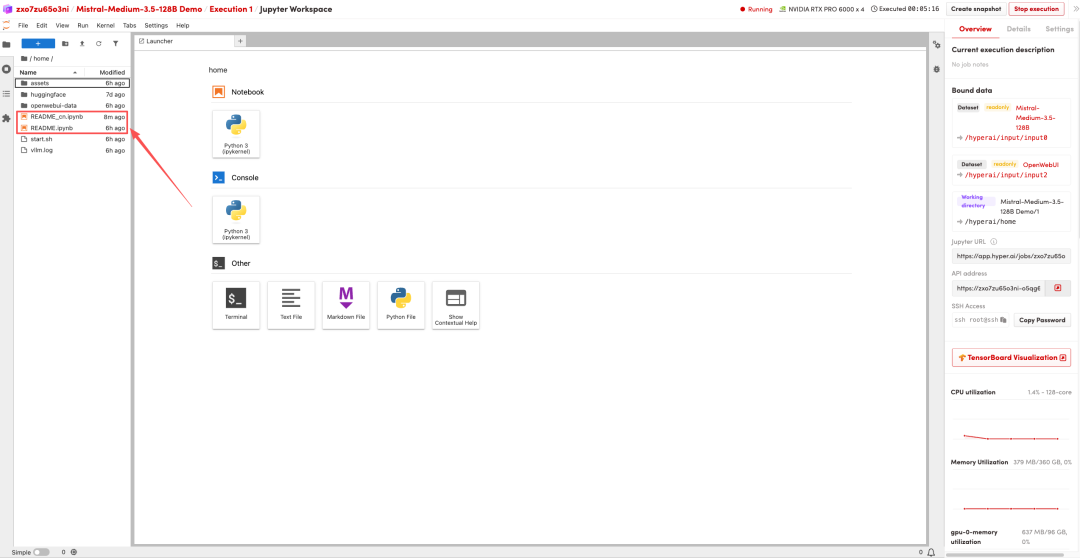

4. 等待分配资源,当状态变为「Running(运行中)」后,点击「Open Workspace」进入 Jupyter Workspace 。

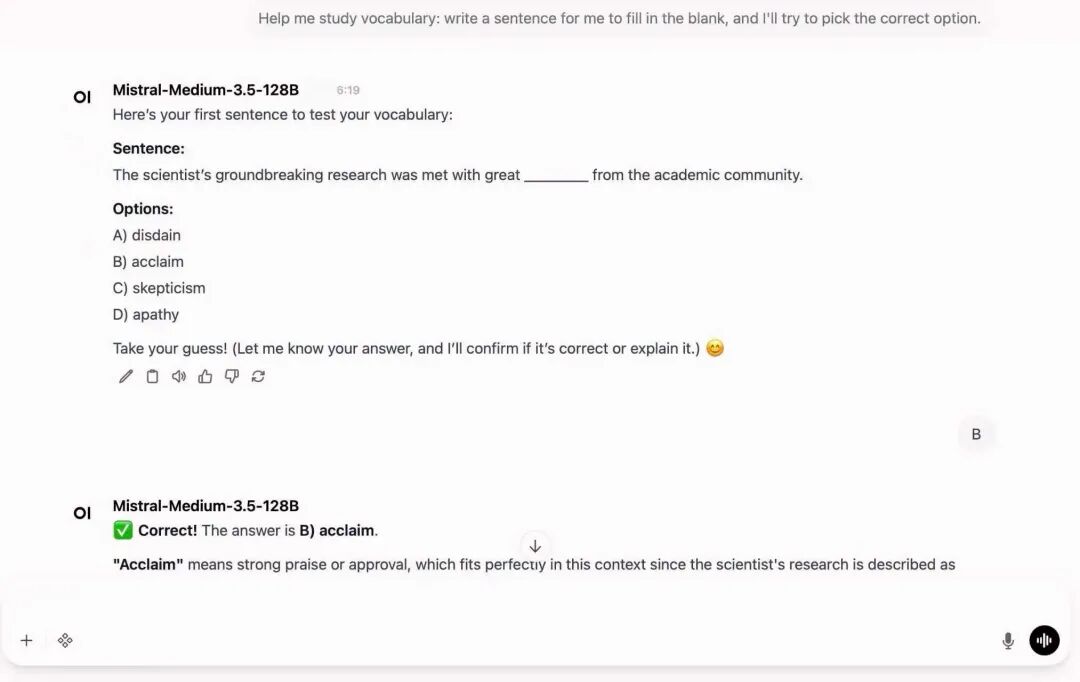

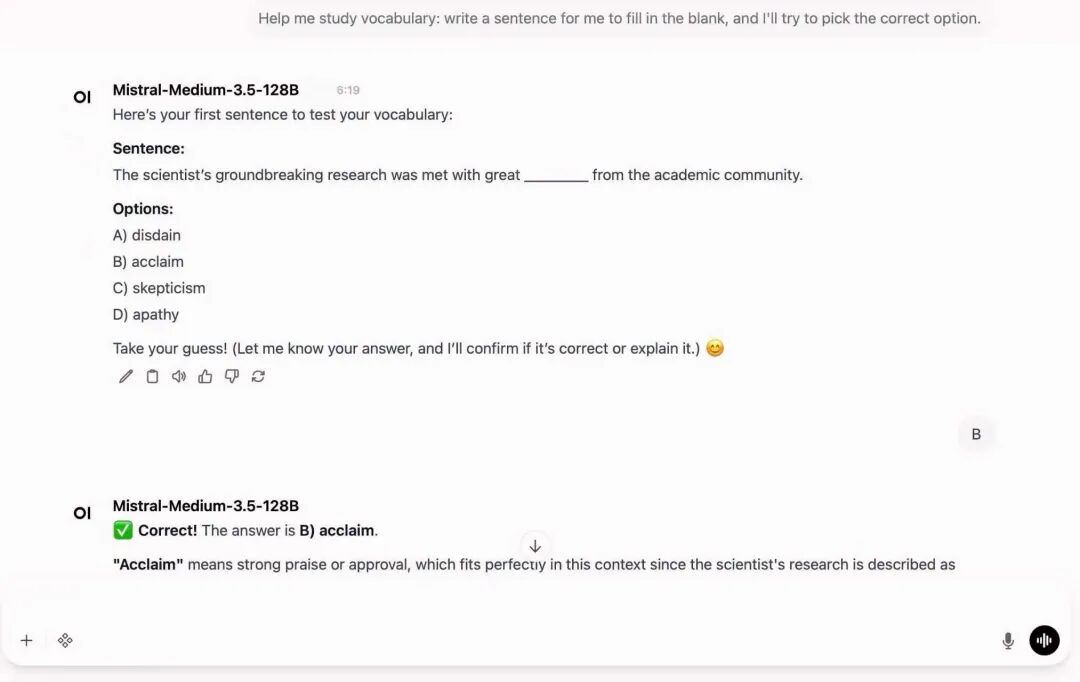

效果展示

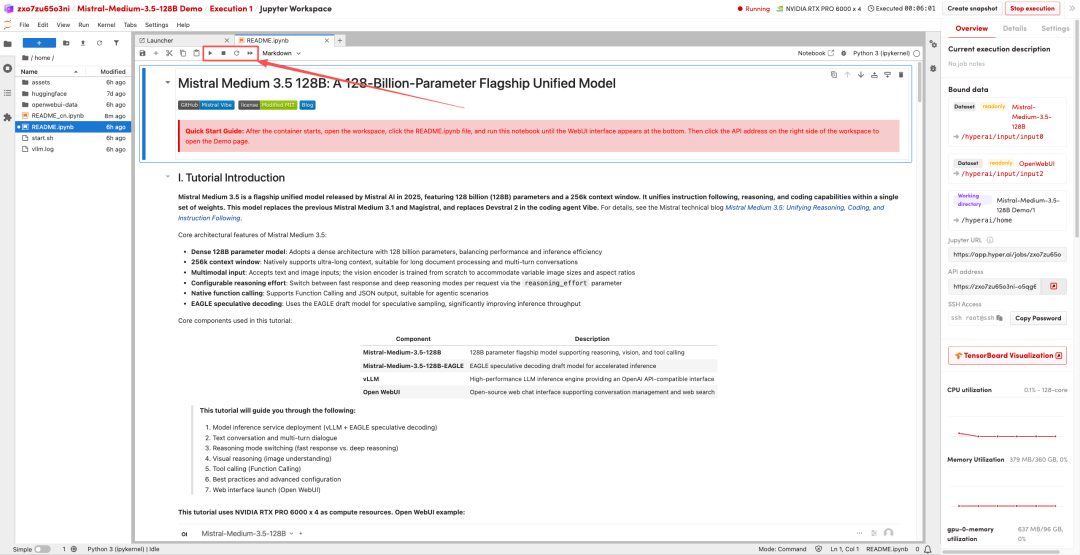

1. 页面跳转后,点击左侧 README 文件,进入后点击上方 Run(运行)。

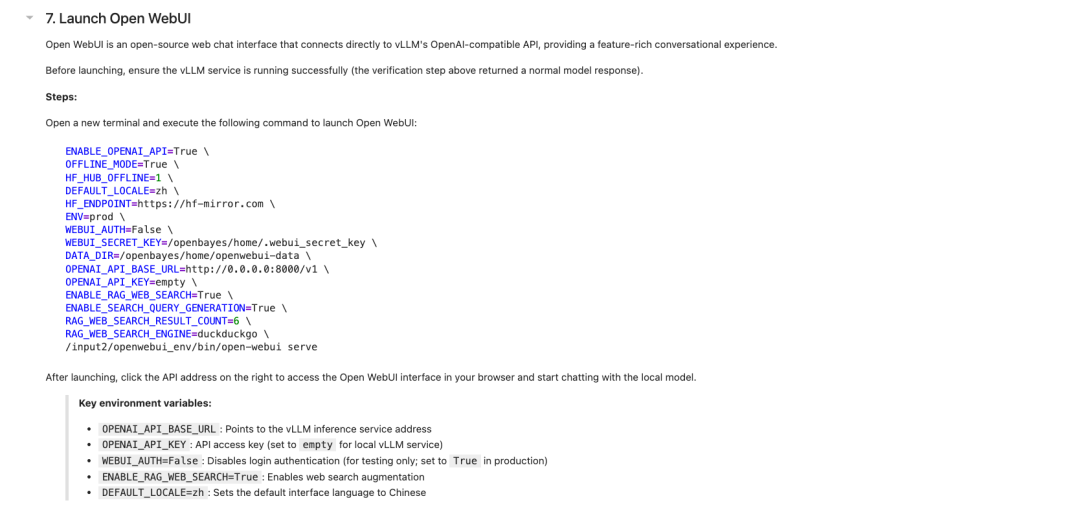

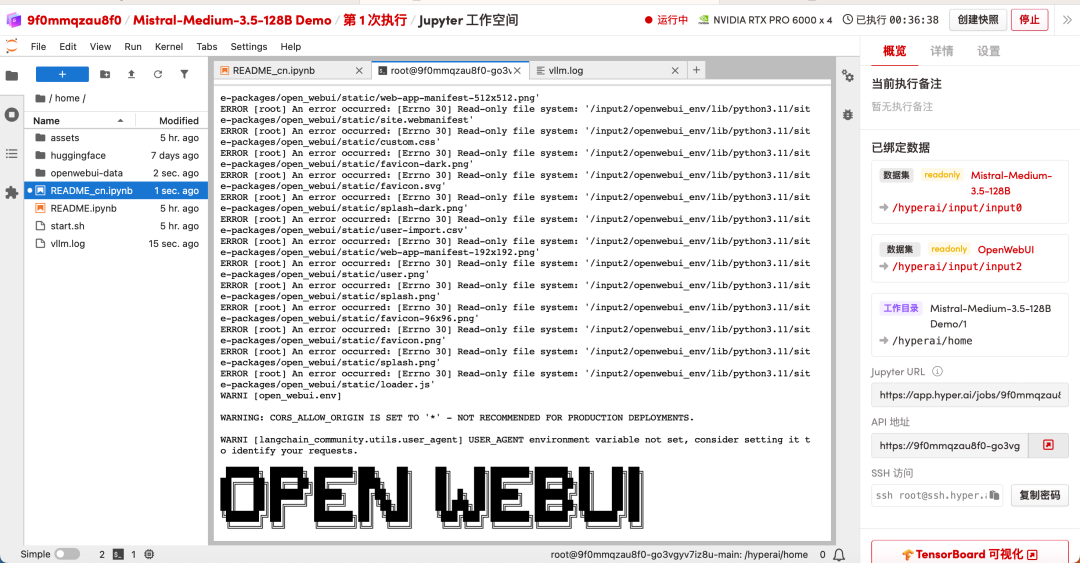

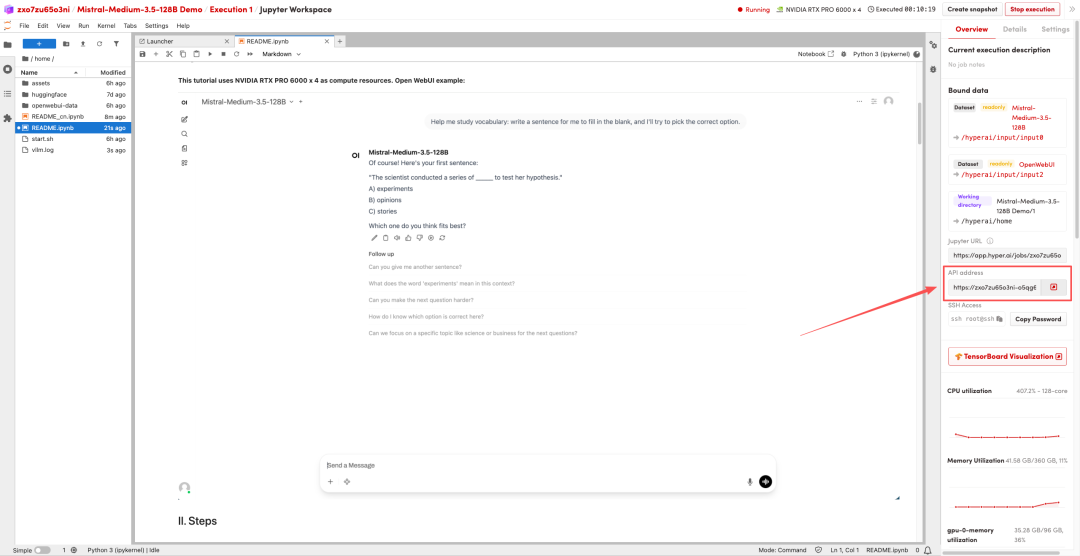

2. 待运行完成,根据 README 提示启动 Open WebUI,待出现实心方块样式的「OPENWEBUI」ASCII 字符即代表启动完成。随后即可点击右侧 API 地址跳转至 demo 页面。