Command Palette

Search for a command to run...

vLLM+Open WebUI の展開 QwenLong-L1-32B

GPUコンピュートの無料配布

1. チュートリアルの概要

QwenLong-L1-32Bは、Tongyi LabとAlibaba Groupによって2025年5月26日にリリースされた長文推論モデルです。このモデルは、強化学習(RL)を用いて訓練された初の長文推論モデルであり、従来の大規模モデルが極めて長いコンテキスト(例:12万トークン)を処理する際に遭遇するメモリ不足や論理矛盾などの問題の解決に重点を置いています。従来の大規模モデルのコンテキスト制限を打破し、金融や法律などの高精度シナリオ向けに低コストで高性能なソリューションを提供します。関連研究論文も入手可能です。 QwenLong-L1: 強化学習を用いた長コンテキスト大規模推論モデルの構築 。

このチュートリアルでは、デュアルカード RTX A6000 リソースを使用します。

2. プロジェクト例

3. 操作手順

1. コンテナを起動した後、API アドレスをクリックして Web インターフェイスに入ります

「モデル」が表示されていない場合は、モデルが初期化中であることを意味します。モデルが大きいため、2〜3分ほど待ってページを更新してください。

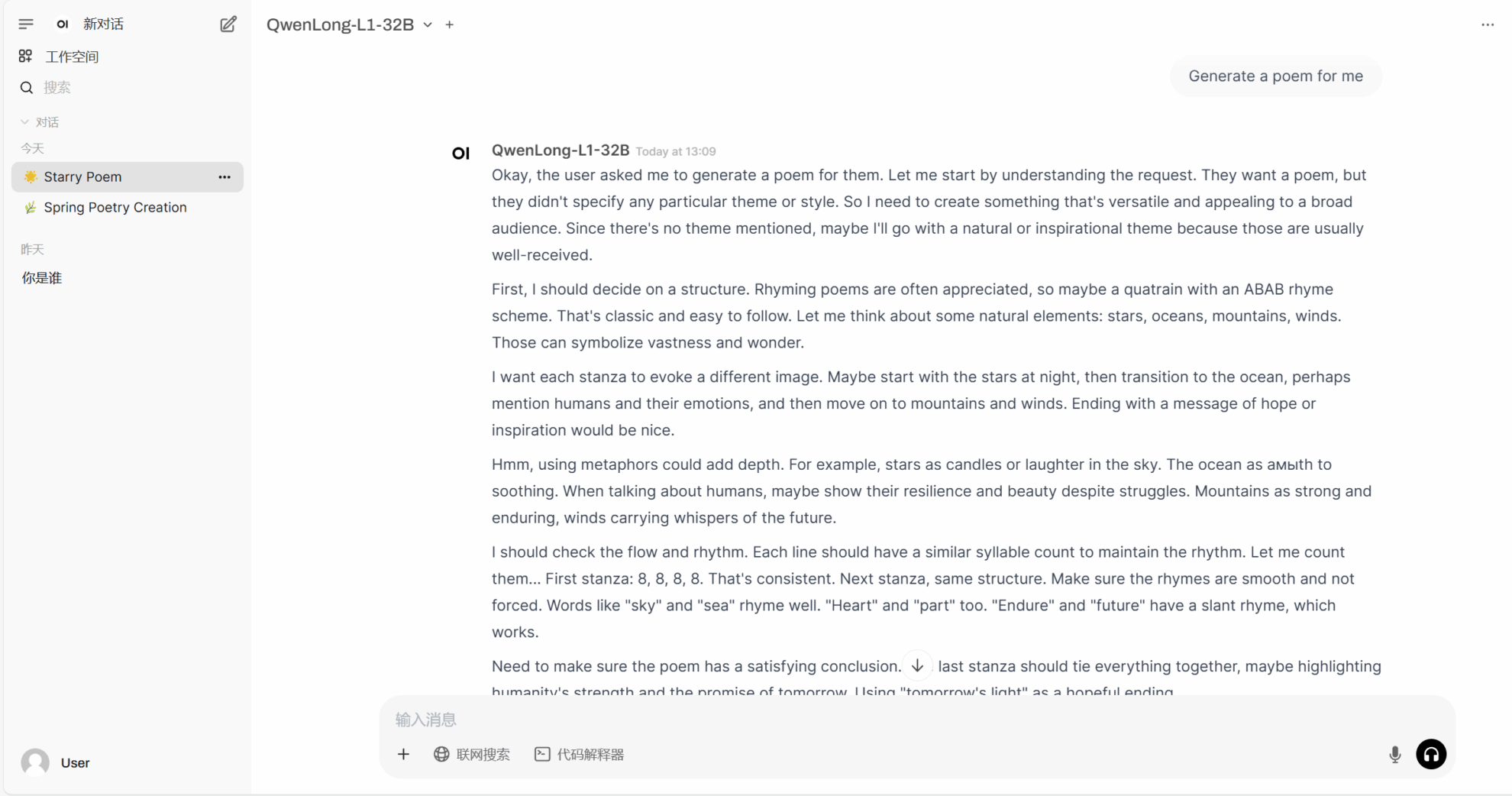

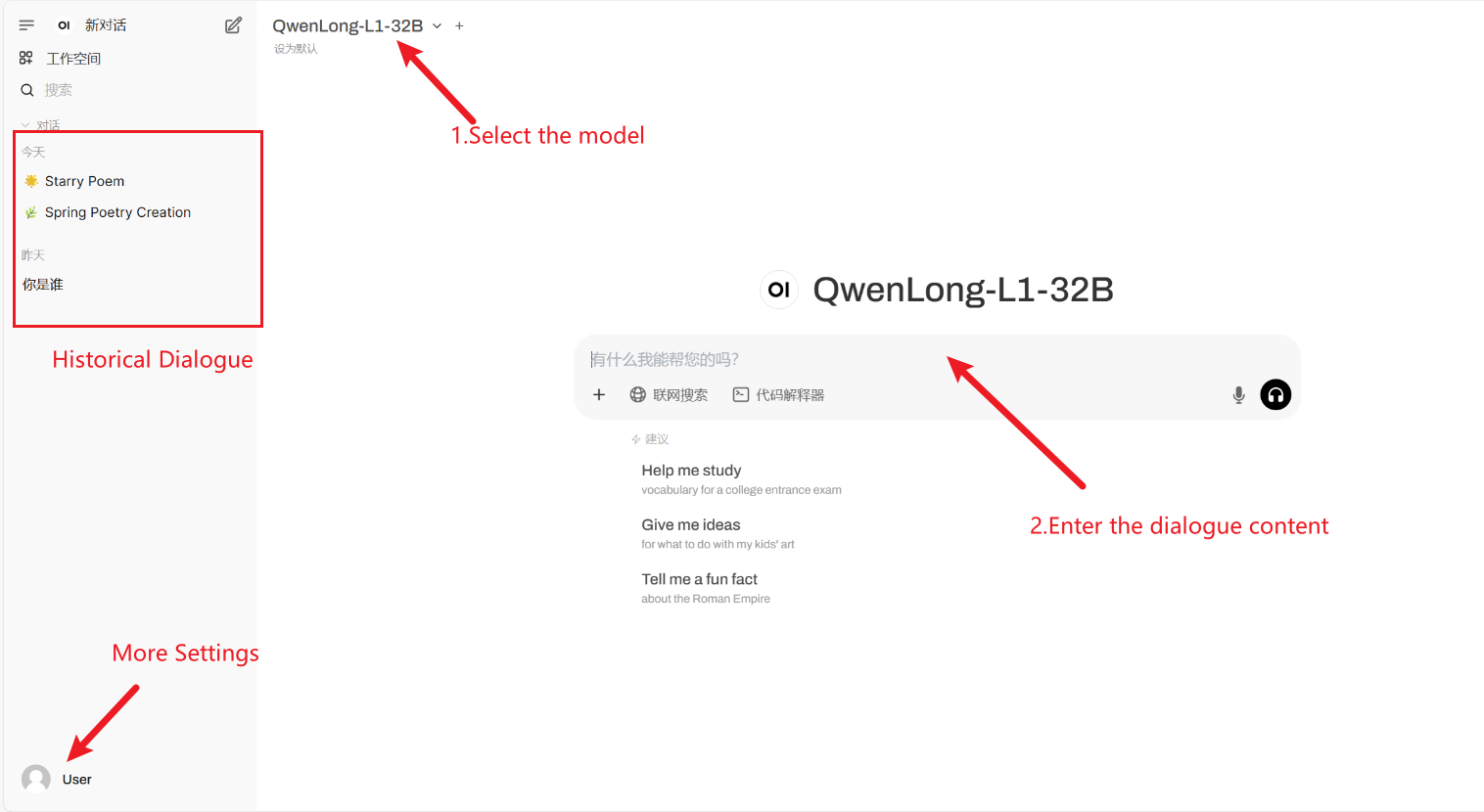

2. Web ページに入ると、モデルと会話を開始できます。

利用手順

4. 議論

🖌️ 高品質のプロジェクトを見つけたら、メッセージを残してバックグラウンドで推奨してください。さらに、チュートリアル交換グループも設立しました。お友達はコードをスキャンして [SD チュートリアル] に参加し、さまざまな技術的な問題について話し合ったり、アプリケーションの効果を共有したりできます。

引用情報

Githubユーザーに感謝 xxxjjjyyy1 このチュートリアルの展開。このプロジェクトの引用情報は次のとおりです。

@article{wan2025qwenlongl1,

title={QwenLong-L1: : Towards Long-Context Large Reasoning Models with Reinforcement Learning},

author={Fanqi Wan, Weizhou Shen, Shengyi Liao, Yingcheng Shi, Chenliang Li, Ziyi Yang, Ji Zhang, Fei Huang, Jingren Zhou, Ming Yan},

journal={arXiv preprint arXiv:2505.17667},

year={2025}

}