Command Palette

Search for a command to run...

ShowUI: Ein Vision-Language-Action-Modell Mit Schwerpunkt Auf GUI-Automatisierung

Datum

Paper-URL

Lizenz

Apache 2.0

GitHub

GPU-Compute-Airdrop

1. Einführung in das Tutorial

ShowUI, ein 2024 vom Show Lab der National University of Singapore und Microsoft gemeinsam entwickeltes visuelles Sprach-Aktions-Modell, ist für intelligente Assistenten mit grafischen Benutzeroberflächen (GUIs) konzipiert, um die Arbeitseffizienz von Nutzern zu steigern. Das Modell versteht die Inhalte der Bildschirmoberfläche und führt interaktive Aktionen wie Klicken, Tippen und Scrollen aus. Es unterstützt sowohl Web- als auch mobile Anwendungen und kann komplexe Aufgaben der Benutzeroberfläche automatisch erledigen. ShowUI analysiert Screenshots und Benutzerbefehle, um interaktive Aktionen auf der Benutzeroberfläche vorherzusagen. Verwandte Forschungsarbeiten sind verfügbar. ShowUI: Ein Vision-Language-Action-Modell für GUI Visual Agent Es wurde in CVPR 2025 aufgenommen.

Dieses Tutorial verwendet standardmäßig eine einzelne RTX 5090 Grafikkarte, aber zum Starten des Programms kann auch eine einzelne RTX 4090 Grafikkarte verwendet werden.

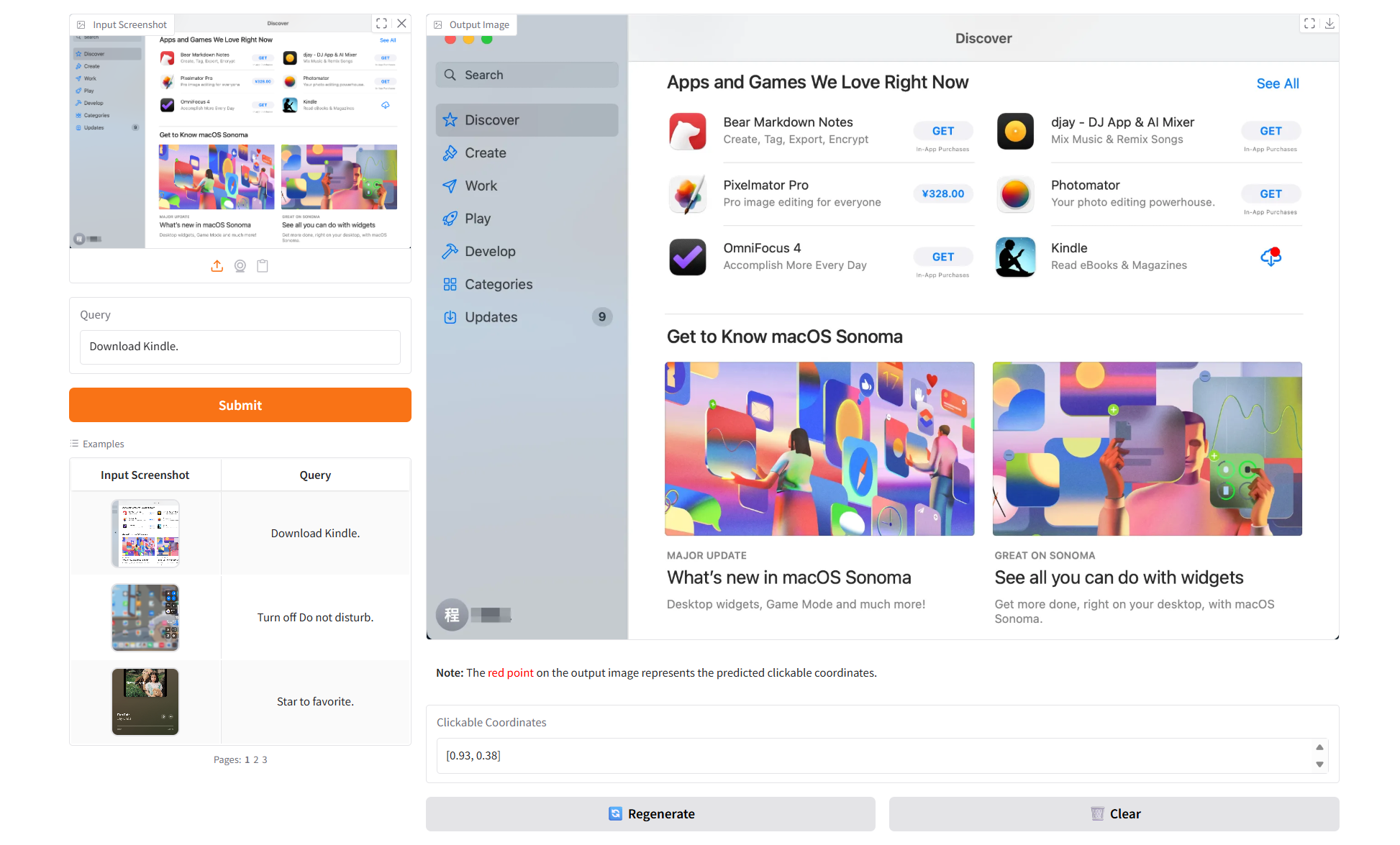

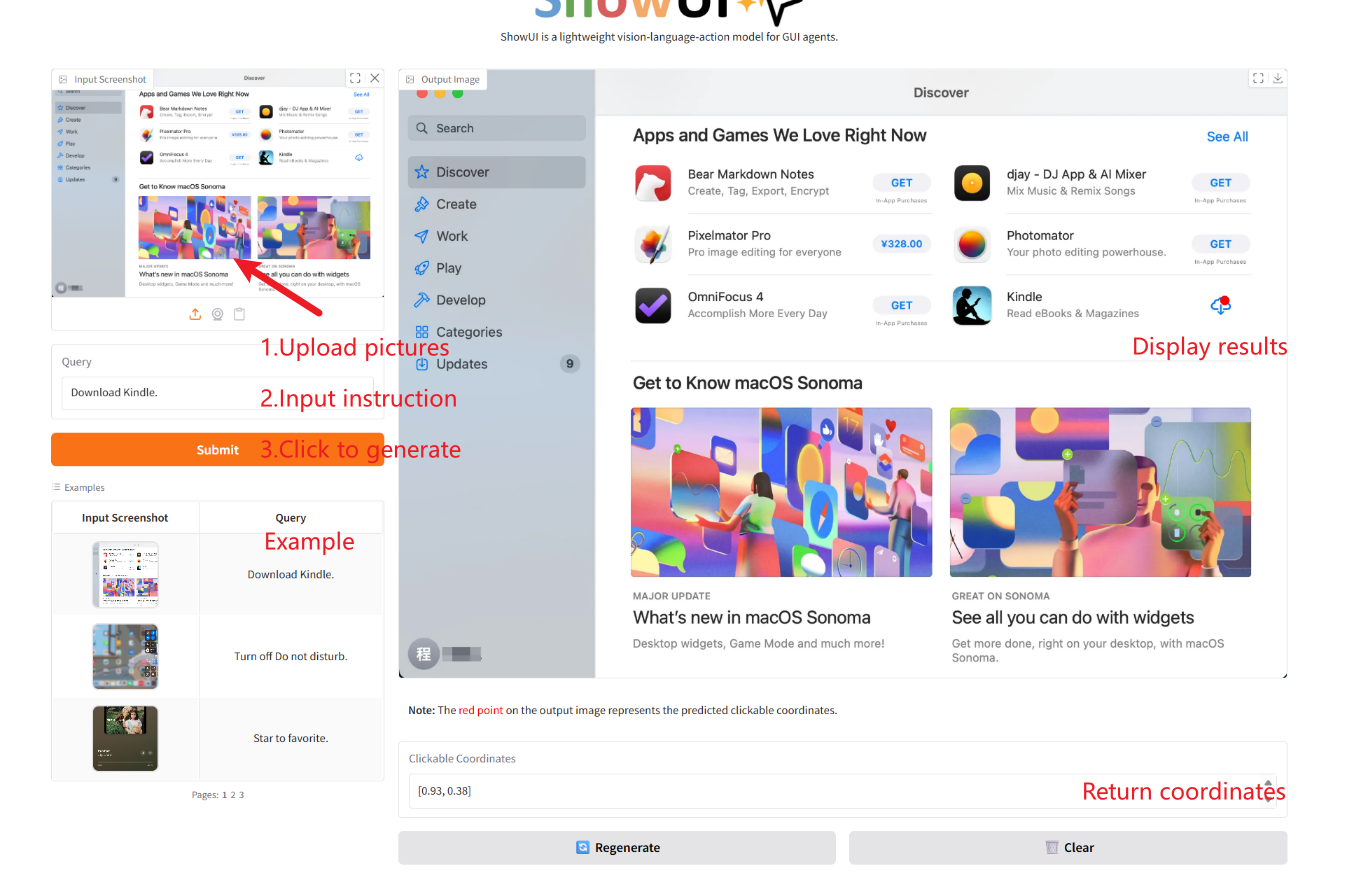

2. Projektbeispiele

3. Bedienungsschritte

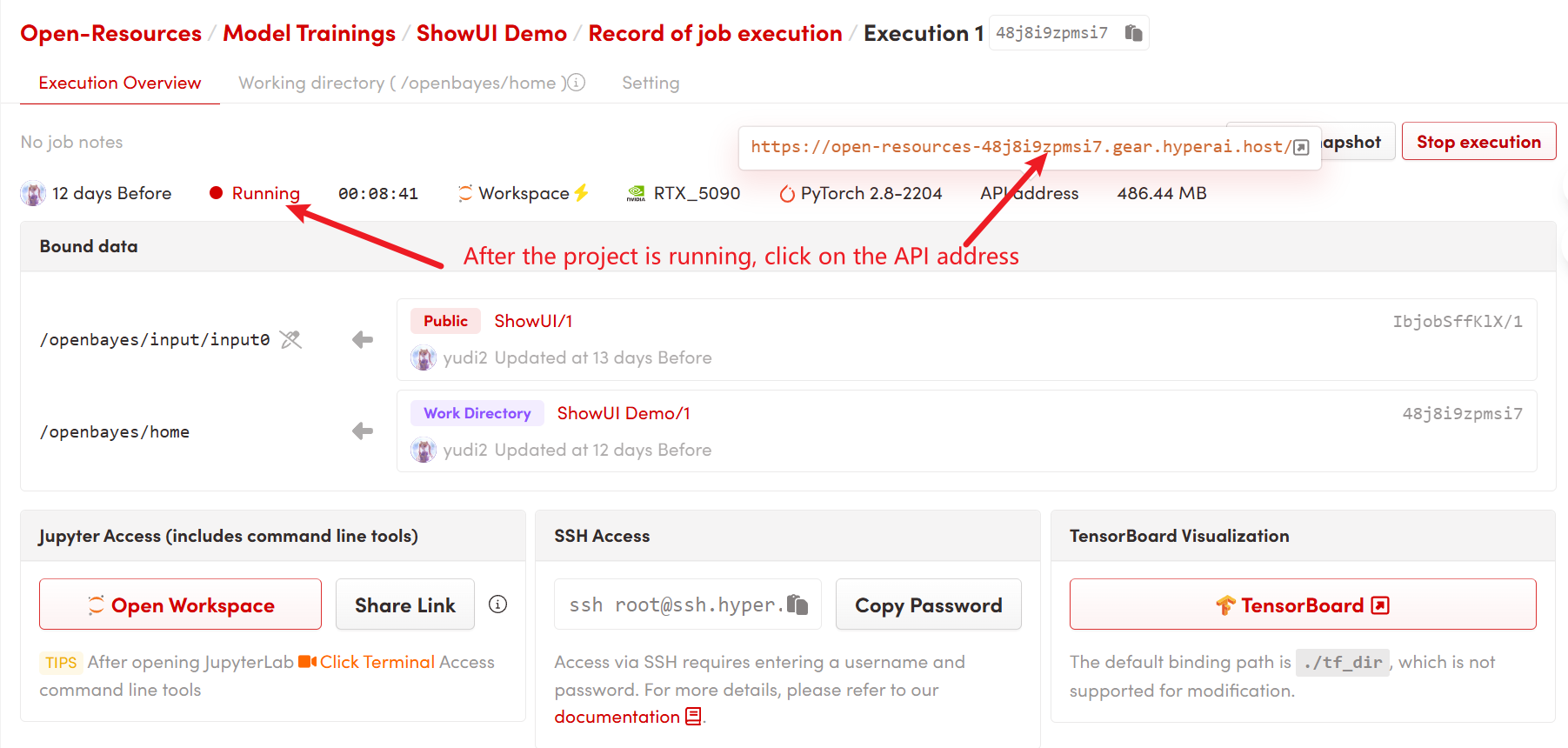

1. Klicken Sie nach dem Starten des Containers auf die API-Adresse, um die Weboberfläche aufzurufen

2. Anwendungsschritte

Wenn „Bad Gateway“ angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 2–3 Minuten und aktualisieren Sie die Seite.

Zitationsinformationen

@misc{lin2024showui,

title={ShowUI: One Vision-Language-Action Model for GUI Visual Agent},

author={Kevin Qinghong Lin and Linjie Li and Difei Gao and Zhengyuan Yang and Shiwei Wu and Zechen Bai and Weixian Lei and Lijuan Wang and Mike Zheng Shou},

year={2024},

eprint={2411.17465},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2411.17465},

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.