Command Palette

Search for a command to run...

Ausgewählt Für CVPR 2025! Das Team Der Universität Shenzhen Und Andere Schlugen EchoONE Vor, Das Mehrteilige Echokardiogramme Präzise Segmentieren Kann

Der Tod durch Herz-Kreislauf-Erkrankungen ist die häufigste Todesursache unter den Chinesen. Aufgrund ihrer Vorteile wie Nichtinvasivität, geringen Kosten und Echtzeit-Bildgebung ist die Echokardiographie zu einer der am häufigsten verwendeten Methoden zur Herzuntersuchung in der klinischen Praxis geworden. Bei der tatsächlichen Durchführung müssen Ultraschallärzte das Herz aus verschiedenen Positionen und Winkeln scannen, um Ultraschallbilder mehrerer Abschnitte zu erhalten. Anschließend müssen sie die Abschnitte kombinieren, um die Struktur und Funktion des Herzens zu analysieren. Dazu gehört auch die Identifizierung der Myokardkontur und die Messung der Größe jeder Kammer.

Aufgrund der erheblichen strukturellen Unterschiede zwischen den einzelnen Segmenten verfügen vorhandene Segmentierungsmodelle jedoch nur über schwache Generalisierungsfähigkeiten für Diagramme mit mehreren Segmenten und müssen normalerweise für jedes spezifische Segment einzeln angepasst werden, was zu hohen Kosten für die wiederholte Entwicklung führt. Darüber hinaus nimmt die Leistung häufig erheblich ab, wenn das Modell eines bestimmten Abschnitts auf andere Abschnitte angewendet wird, was seine Verbreitung und Anwendung in der klinischen Praxis einschränkt.

Als Reaktion darauf schlug ein Forschungsteam des Medical Ultrasound Image Computing Laboratory (MUSIC) der School of Biomedical Engineering der School of Medicine der Universität Shenzhen, des National Engineering Laboratory for Big Data der Universität Shenzhen und der Ultraschallabteilung des Shenzhen People's Hospital das einheitliche Segmentierungsmodell EchoONE für die mehrteilige Echokardiographie vor. Das Modell kombiniert die Feinabstimmungstechnologie des großen SAM-Modells zur natürlichen Bildsegmentierung und Vorkenntnisse zu Herzultraschallabschnitten.Es kann die Herzstruktur von mehrteiligen Echokardiogrammen präzise segmentieren und so die Komplexität des Designmodells effektiv reduzieren.Unterstützen Sie Ärzte bei der effizienteren Beurteilung der Herzfunktion.

Die Forschung mit dem Titel „EchoONE: Segmentierung mehrerer Echokardiographie-Ebenen in einem Modell“ wurde für die IEEE/CVF-Konferenz zu Computer Vision und Mustererkennung (CVPR) 2025 ausgewählt.

Forschungshighlights:

* Erfolgreiche Entwicklung eines einheitlichen Modells, das mehrteilige Echokardiogramme mit signifikanten strukturellen Unterschieden präzise segmentieren kann

* Es wird ein a priori zusammensetzbares Maskenlernmodul (PC-Mask) vorgeschlagen, um semantisch bewusste dichte Hinweise zu generieren, und es wird ein lokales Merkmalsfusions- und -anpassungsmodul (LFFA) eingeführt, um die SAM-Architektur anzupassen. Dadurch eignet sich EchoONE gut für die Verarbeitung unterschiedlicher Abschnitte von Echokardiogrammen mit deutlich unterschiedlicher Datenverteilung und unscharfen Grenzen.

* Die Leistung des Modells EchoONE ist besser als die vieler anderer großer Modelle, die auf Feinabstimmung basieren, und es erzielt auch die beste Leistung im externen Testsatz

Papieradresse:

https://arxiv.org/abs/2412.02993

Das Open-Source-Projekt „awesome-ai4s“ vereint mehr als 200 AI4S-Papierinterpretationen und stellt umfangreiche Datensätze und Tools bereit:

https://github.com/hyperai/awesome-ai4s

Datensatz: 3 große öffentliche Datensätze + 22.044 private, mit Bildern annotierte Paare

In dieser Studie wurden Mehrabschnitts-Echokardiogramme aus mehreren Zentren verwendet.Beinhaltet private und öffentliche Datensätze.

Zu den öffentlichen Datensätzen gehören CAMUS, HMC_QU und EchoNet_Dynamic. CAMUS ist ein in diesem Bereich weit verbreiteter Herzultraschall-Datensatz. Sie stammen aus mehreren Krankenhäusern in Frankreich und umfassen Daten von 500 Fällen zu Zweikammerherzen (2CH) und Vierkammerherzen (4CH). Der HMC_QU-Datensatz wurde in Zusammenarbeit zwischen der Hamad Medical Corporation (HMC), der Universität Tampere und der Universität Katar erstellt. Der EchoNet-Dynamic-Datensatz wurde von der Stanford University erstellt. In dieser Studie wurde der Testsatz nur für externe Testexperimente verwendet, um eine vergleichende Analyse zu ermöglichen.

* Download des CAMUS-Herzultraschall-Bilddatensatzes:

https://hyper.ai/cn/datasets/38453

* Download des HMC-QU-Datensatzes zur medizinischen Herzbildgebung:

https://hyper.ai/cn/datasets/38456

Der private Datensatz wurde aus Ultraschalldaten mehrerer inländischer Kooperationskrankenhäuser gewonnen und umfasst insgesamt 22.044 Bildannotationspaare, darunter drei verschiedene horizontale Abschnitte des Zweikammerherzens (2CH), Dreikammerherzens (3CH), Vierkammerherzens (4CH) und der parasternalen kurzen linksventrikulären Achse (PSAX).

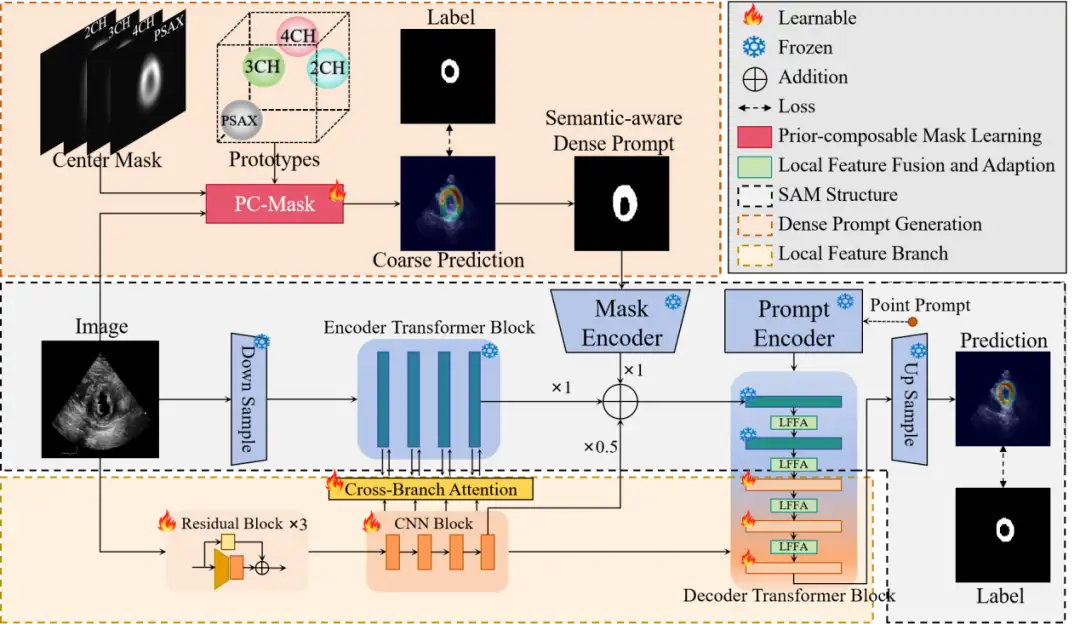

Modellarchitektur: Basierend auf SAM besteht das EchoONE-Modell aus drei Hauptkomponenten

Das Gesamtframework von EchoONE besteht hauptsächlich aus drei Komponenten: einer SAM-basierten Segmentierungsarchitektur; eine Komponente zum Generieren dichter Eingabeaufforderungen; und ein CNN-basierter lokaler Feature-Zweig zum Anpassen und Anpassen von SAM.Die gesamte Netzwerkarchitektur basiert auf dem ursprünglichen SAM.Enthält Transformer-basierte Bildcodierer und Maskendecoder, Sparse-Cue-Encoder und Maskencodierer für Dense Cueing.

Darüber hinaus führten die Forscher das Local Feature Fusion and Adaptation Module (LFFA) im Ladder Side Tuning (LST)-Zweig ein, um die Anpassungsfähigkeit von SAM an bestimmte Aufgaben zu verbessern. Gleichzeitig schlugen sie auch ein clusterbasiertes, vorab zusammensetzbares Maskenlernmodul (PC-Mask) vor, um semantisch bewusste, dichte Hinweise zu generieren. Die Details zu PC-Mask und LFFA sind wie folgt:

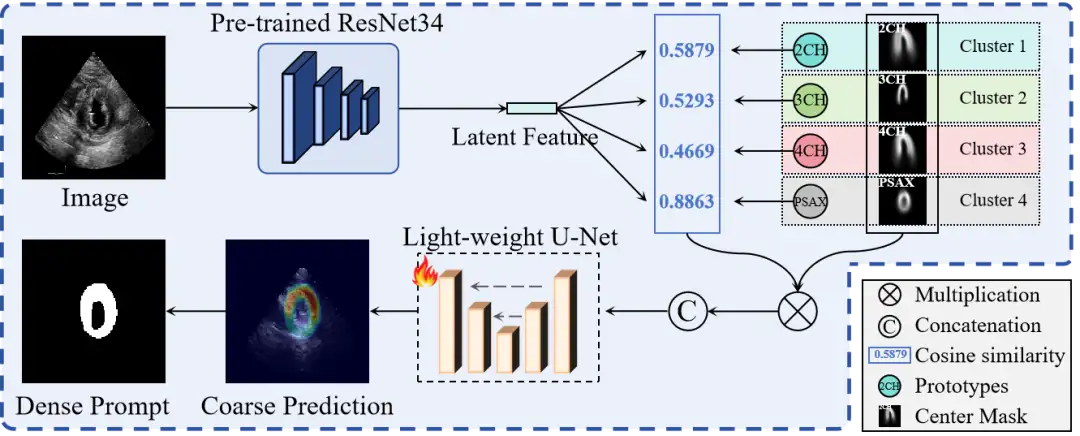

(a) PC-Maskenmodul

Dichte Maskenhinweise liefern SAM umfassendere Informationen als Punkt- und Boxhinweise und das PC-Mask-Modul kann automatisch qualitativ hochwertige Maskenhinweise generieren. Um die Vielfalt der semantischen Strukturen auf mehreren Scheiben zu bewältigen, gruppierten die Forscher zunächst Bilder auf verschiedenen Scheiben in K-Cluster im latenten Merkmalsraum. Das Zentrum jedes Clusters wird als Prototyp des Clusters im latenten Raum verwendet. Ähnlich,Eine zentrale Maske kann durch Mittelung der Masken der dem Cluster zugewiesenen Bilder erhalten werden.

Unter Verwendung dieser Maskenzentren als Strukturvorgabe,Das Ziel der Forscher bestand darin, für jedes neue Bild einen dichten Hinweis auf die Myokardregion zu generieren, ohne Informationen über den Schichttyp.Bei einem Eingabebild wird seine Ähnlichkeit (oder Distanz) zu diesen Prototypen verwendet, um seine Position im latenten Raum darzustellen; dann wird die Ähnlichkeit als Gewicht verwendet, um diese vorherigen Zentren in einer vorherigen Mehrkanaleinbettung zu kombinieren und schließlich in ein leichtes U-Net einzugeben, und das Ausgabeergebnis wird als dichte Eingabeaufforderung von SAM verwendet. Dieser Prozess wird durch Dice Loss und BCE Loss eingeschränkt.

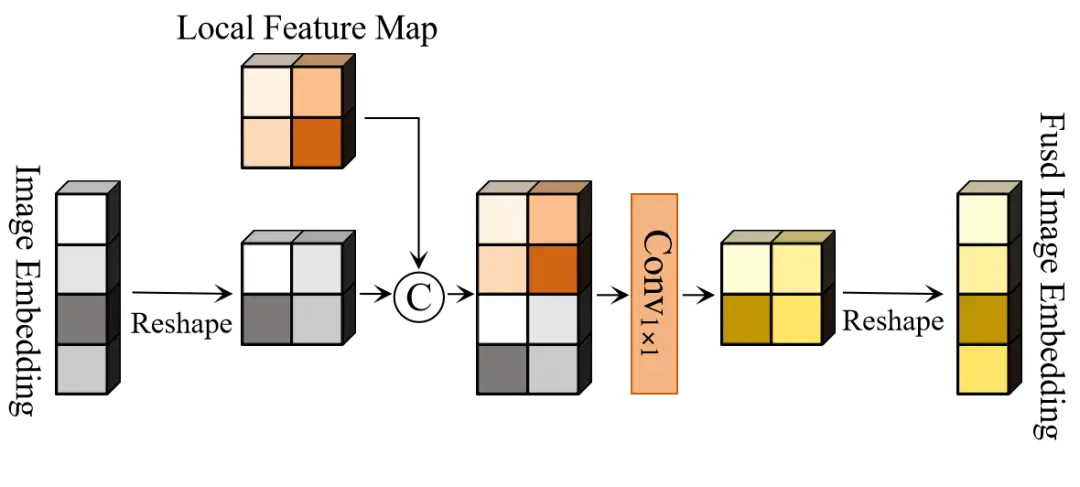

(b) LFFA-Modul

Um die Fähigkeiten von SAM voll auszunutzen und Umschulungen und Ressourcenverschwendung zu vermeiden, ist ein Hilfszweig erforderlich, um SAM an neue Szenarien anzupassen. Die Forscher entwarfen einen lernfähigen CNN-Zweig, der aus drei Teilen besteht: Der erste ist der Restblock zur lokalen Merkmalsextraktion; der zweite ist der CNN-Block zum Anpassen der zweigübergreifenden Aufmerksamkeit des Bildcodierers; Der dritte ist der lokale Feature-Fusion-Transformer-Block, der den Maskendecoder an bestimmte Aufgaben anpasst.

Im Maskendecoder gibt es zusätzlich zu den beiden Transformer-Blöcken des ursprünglichen SAMDie Forscher fügten außerdem drei lernbare Blöcke hinzu,Anpassung an die Verschmelzung lokaler Besonderheiten. Die lokalen Merkmale jeder Schicht von CNN-Blöcken im Bildcodierer, die über die Zweige hinweg erkannt werden, werden mit den entsprechenden Transformer-Blöcken des Maskendecoders verbunden, und die Merkmale jeder Schicht werden durch das LFFA-Modul verschmolzen. Der Vorgang wird unten dargestellt.

Experimentelle Schlussfolgerung: EchoONE ist sowohl präzise als auch robust bei der Multi-Plane-Segmentierungsaufgabe der Echokardiographie

Die Forscher führten umfangreiche Experimente mit internen und externen Datensätzen durch.Dies beweist die Wirksamkeit von EchoONE.

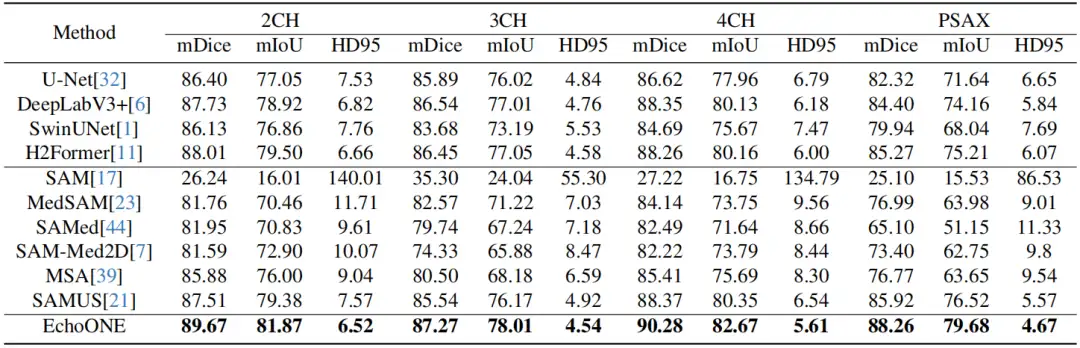

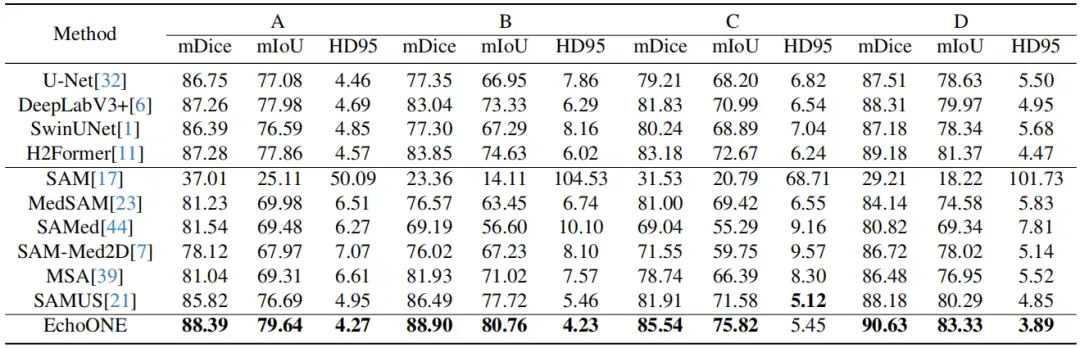

Robustheit gegenüber Aufgaben mit mehreren Aspekten: Die folgende Tabelle fasst die Leistung des Modells in Bezug auf verschiedene Aspekte des internen Testsatzes zusammen. Es ist ersichtlich, dass EchoONE die auf CNN, Transformer und SAM basierenden Modelle vergleicht.Es erzielte die besten Ergebnisse hinsichtlich der durchschnittlichen Dice-, IoU- und HD95-Indikatoren.

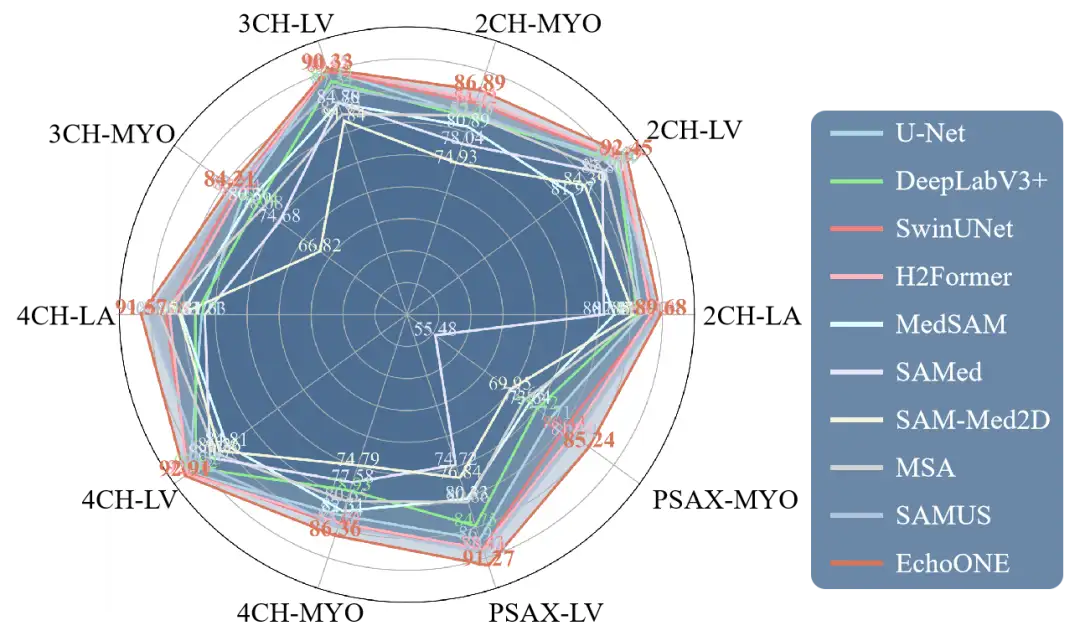

Robustheit gegenüber verschiedenen Herzstrukturen: Wie im Radardiagramm unten gezeigt, im Vergleich mit früheren Modellen,Das EchoONE-Modell erzielte in jeder Struktur des Herzens (linker Vorhof, linke Herzkammer, Myokard) höhere Dice-Werte.

Robustheit gegenüber zentrumsübergreifenden Daten:Die folgende Abbildung und Tabelle zeigen, dass EchoONE im Testsatz von 5 internen Zentren die beste Leistung erzielt.

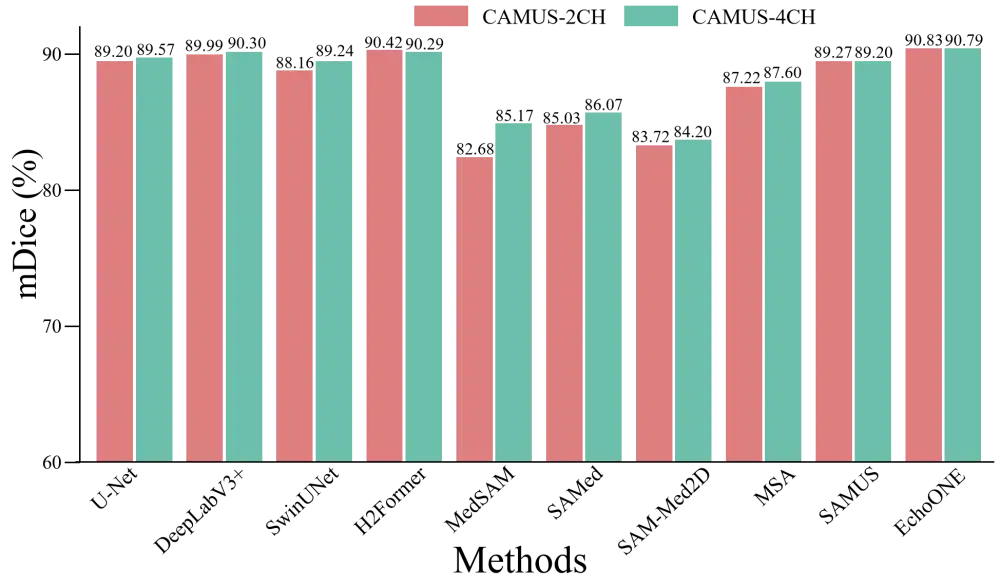

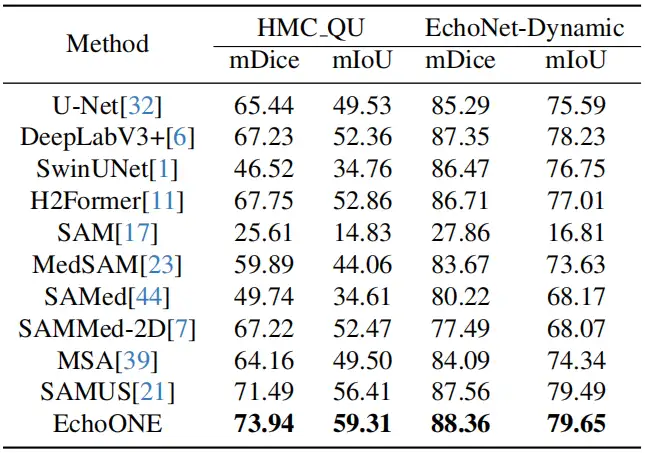

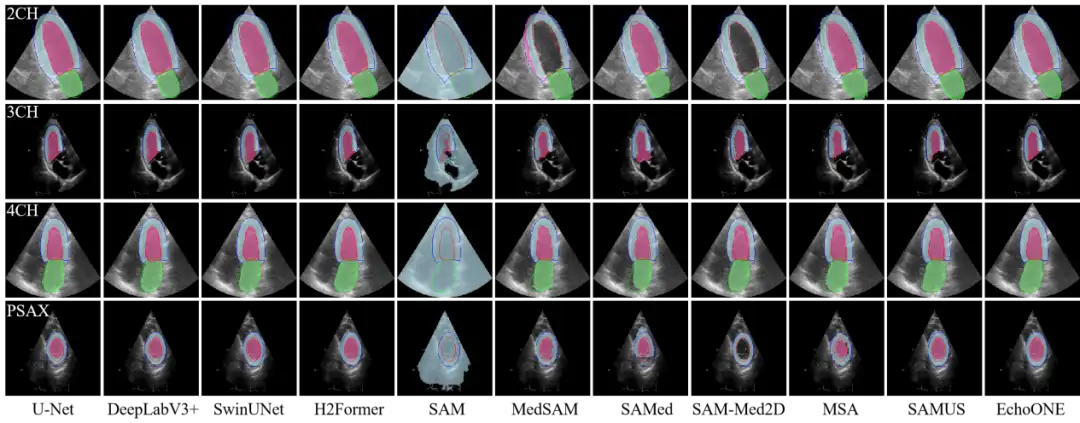

Externe Validierung: Wie in der folgenden Abbildung gezeigt, wurden sogar zwei externe Testsätze, die während des Trainings nicht gesehen wurden,EchoONE weist weiterhin eine starke Generalisierungsleistung auf.Für HMC_QU mit deutlichem Rauschen und Bildern von geringer Qualität liefert EchoONE außerdem einen Dice-Score von 73,94%, was auf sein großes Potenzial in der klinischen Praxis hinweist.

Visuelle Analyse: Aus dem Vergleich der Visualisierungsergebnisse können wir auch erkennen, dassEchoONE bietet nicht nur einen angemessenen Segmentierungsbereich, sondern erzielt auch hervorragende Ergebnisse bei der Konturverfeinerung.Dies liegt daran, dass es grobe Segmentierungsergebnisse für verschiedene Scheiben generiert, was das Modell dazu veranlasst, sich auf den Bereich zu konzentrieren und die Grenzen zu verfeinern, wodurch die Segmentierungsergebnisse verbessert werden.

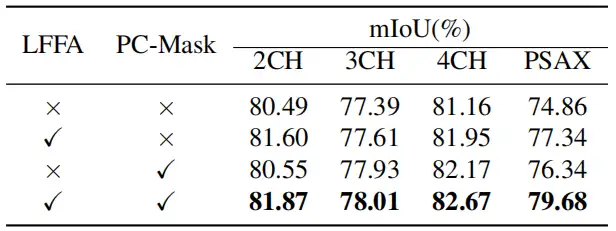

Ergebnisse des Ablationsexperiments: Um die Wirksamkeit der PC-Mask- und LFFA-Module bei der Verbesserung der Modellleistung weiter zu untersuchen, führten die Forscher Ablationsexperimente an 5 internen Datensätzen durch. Aus den ErgebnissenDiese beiden Module optimieren jeweils die SAM-Architektur, indem sie Vorwissen nutzen und lokale Merkmale auf semantisch bewusste Weise verschmelzen.Dadurch kann EchoONE eine genaue und robuste Leistung für das Mehrschichtsegmentierungsproblem der Echokardiographie erzielen.

Die Studie kann auf andere medizinische Bildgebungsverfahren ausgeweitet werden

Das EchoONE-Modell zielt darauf ab, die komplexe Herausforderung der Multi-Slice-Segmentierung durch die Einführung eines innovativen dichten Cue-Learning-Moduls, PC-Mask, zu bewältigen, das vorheriges Strukturwissen auf zusammensetzbare Weise nutzt und während des Segmentierungsprozesses eine effektive scheibenspezifische semantische Anleitung bietet. Darüber hinaus schlug die Studie einen lernbaren lokalen CNN-Feature-Zweig vor, um den Bildcodierer zu optimieren und den Maskendecoder anzupassen. Das LFFA-Modul verbesserte nicht nur die endgültige Leistung, sondern beschleunigte auch die Konvergenzgeschwindigkeit.

Dies ist das erste vorgeschlagene Schema zur effektiven Segmentierung aller Echokardiogrammabschnitte mithilfe eines einzigen robusten Modells, wodurch die Anwendung künstlicher Intelligenz in der klinischen Praxis vereinfacht wird.Obwohl dieser Ansatz derzeit nur anhand von Ultraschallbildern validiert wird, besteht das Potenzial, ihn auf andere medizinische Bildgebungsverfahren auszuweiten, um Probleme der Mehrschichtsegmentierung zu bewältigen. In Zukunft werden sich die Forscher darauf konzentrieren, die Generalisierungsfähigkeiten weiterer Aspekte zu verbessern und robuste Modelle für facettenreiche Videos zu erstellen.

Es ist erwähnenswert, dass die für dieses Forschungsprojekt verantwortliche Person, Xue Wufeng, von der School of Biomedical Engineering, School of Medicine, Shenzhen University kommt. Sein Team forscht seit langem im Bereich der medizinischen Bildgebung des Herzens und der künstlichen Intelligenz und befasst sich dabei mit der Modellierung der Herzstruktur/-funktion/des Blutflusses, grundlegenden Herzmodellen, großen grafischen Modellen usw. Gaststudenten, Postdoktoranden, Forscher usw. sind herzlich eingeladen, sich ihm anzuschließen. Interessenten können Professor Xue Wufeng unter „[email protected]“ kontaktieren.

* Persönliche Homepage von Xue Wufeng:

https://bme.szu.edu.cn/info/116