Command Palette

Search for a command to run...

Qwen3-Omni-30B-A3B-Captioner:音频描述大模型

一、教程简介

Qwen3-Omni-30B-A3B-Captioner 是由阿里巴巴通义千问团队于 2025 年 9 月发布的音频描述大模型。模型无需任何提示,自动为复杂语音、环境声、音乐、影视声效等生成精准、全面的描述,能识别说话人情绪、音乐元素(如风格、乐器)、敏感信息等,适用于音频内容分析、安全审核、意图识别、音频剪辑等多个领域。相关论文成果为「Qwen3-Omini Technical Report」。

本教程采用资源为单卡 RTX A6000 。

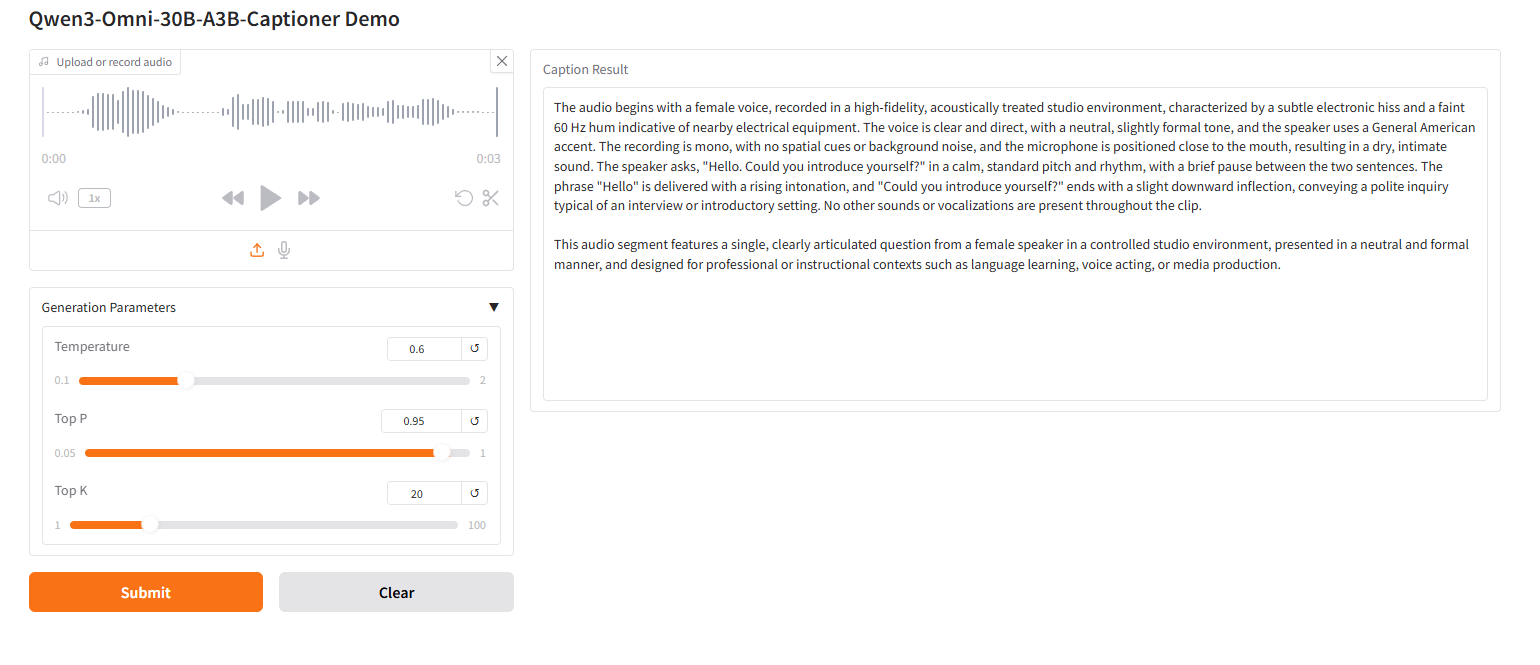

二、项目示例

三、运行步骤

1. 启动容器后点击 API 地址即可进入 Web 界面

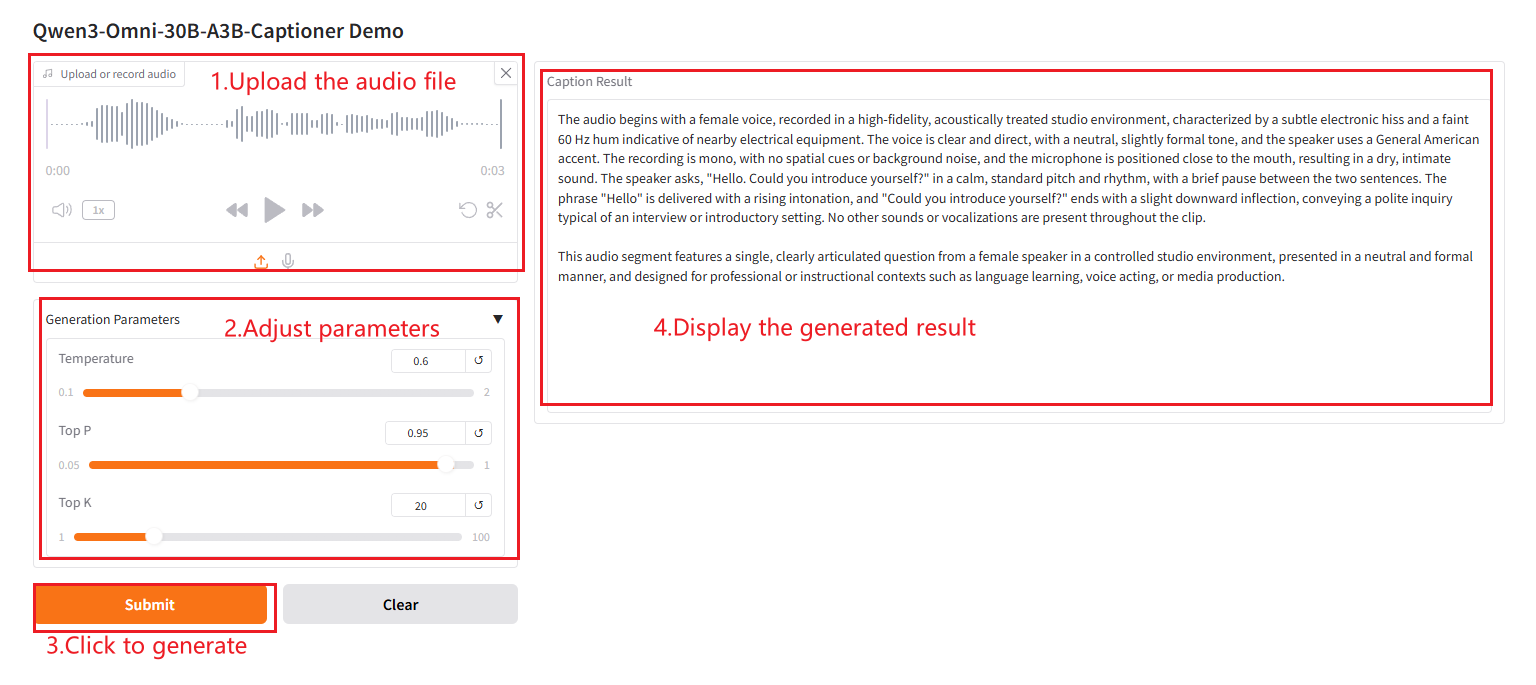

2. 使用步骤

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 2-3 分钟后刷新页面。 注意:音频长度限制在 30 秒内。生成结果大约需要 3-5 分钟。

参数说明

- Temperature:值越小,字幕越「保守」、越确定;值越大,越随机、越有新意。

- Top-p:只从概率累加到 p 的「高分词」里挑,p 越小候选越少,文本越保守。

- Top-k:只保留概率最高的 k 个词,k 越小候选越少,文本越保守。

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓