Command Palette

Search for a command to run...

构建 RAG 系统:基于 Qwen3 Embedding 的实践

RAGFlow 是一个基于深度文档理解的开源 RAG(检索增强生成)引擎。 与 LLM 集成后,它能够提供真实的问答功能,并以来自各种复杂格式数据的可靠引用为支撑。

本教程采用算力资源为「双卡 RTX 6000」,具体包含以下内容:

一、启动 RAGFlow 服务器(见 README.md 文件)

二、创建一个知识库(见 Knowledge.md 文件)

三、根据您的知识库建立 AI 聊天(见 Chat.md 文件)

四、开启第一个 Agent(见 Agent.md 文件)

五、交流探讨

一、启动 RAGFlow 服务器

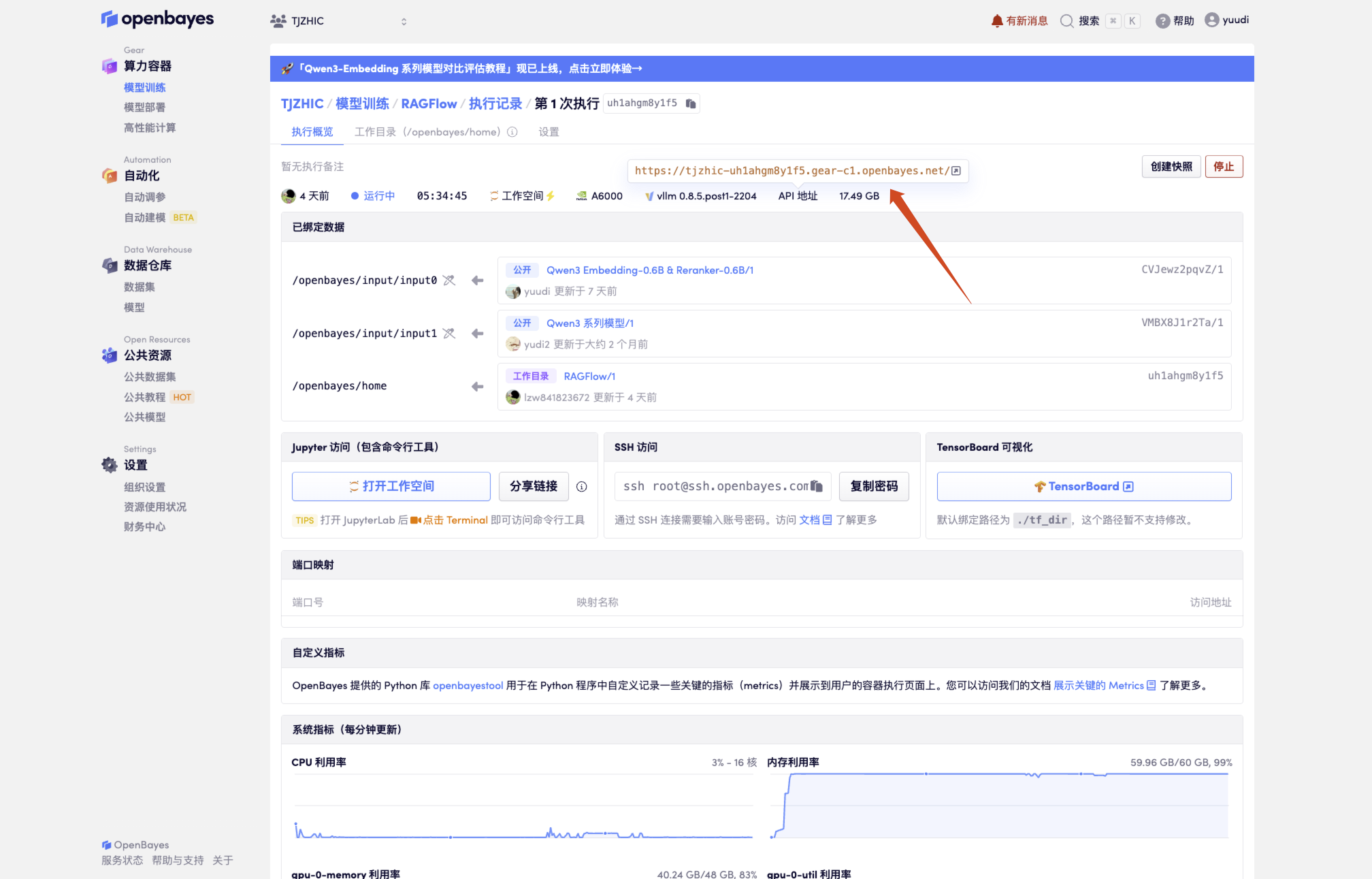

本教程已为 RAGFlow 的服务配置完毕,您无需自行部署,启动容器后,可直接点击 API 地址访问。

注意:模型文件较大,稍等容器启动 5-6 分钟后访问,否则将显示「Bad Gataway」!登录信息如下:

- 👤 用户名:

[email protected] - 🔑 密码:

123456

—

二、创建一个知识库

本步骤中,您可以将文件上传到 RAGFlow 中的知识库,并将其解析为数据集。为便于本教程测试,已为 Agent 和 Chat 教程预配置了相应知识库。用户可直接使用默认配置,亦可按照下面流程上传并自定义配置知识库。

📖 了解更多

点击此处查看完整操作指南。

三、根据知识库建立 AI 聊天

RAGFlow 中的对话基于一个或多个特定知识库。创建知识库并完成文件解析后,即可开始 AI 对话。

📖 了解更多

点击 👉 此处查看完整操作指南。

四、开启第一个 Agent

代理和 RAG 是互补的技术,在业务应用中相互增强。**RAGFlow v0.8.0 引入了代理机制,**可通过配置不同代理更好的满足用户需求。

📖 了解更多

点击 👉 此处查看完整操作指南。

五、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓