使用Apache Airflow入门LLM工作流代理

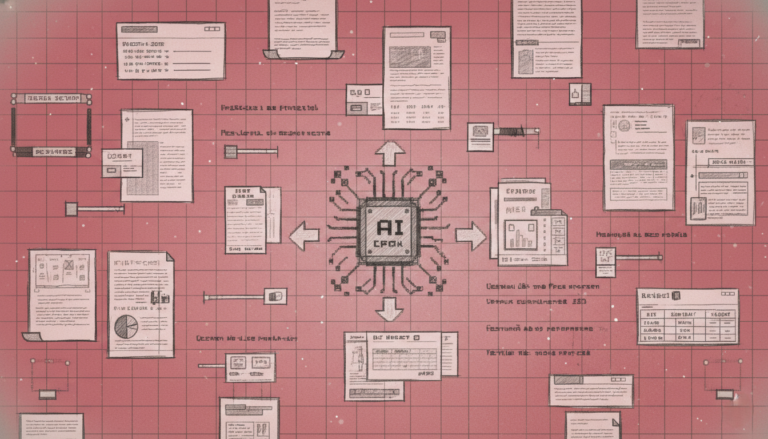

新闻文稿改写: 大型语言模型 (LLM) 工作流与代理:如何开始使用 Apache Airflow 大型语言模型 (LLM) 的快速发展使得数据工作流管理和自动化变得更加重要。Apache Airflow 是一个开源的工作流管理平台,它允许用户以编程方式定义复杂的流程,从而实现任务的调度和监控。本文将探讨如何使用 Apache Airflow 来管理和自动化 LLM 的工作流。 随着 LLM 的规模不断扩大,模型的训练和部署过程变得越来越复杂。为了有效管理和自动化这些过程,许多公司和开发者开始转向 Apache Airflow。Airflow 通过其强大的 DAG (Directed Acyclic Graph) 概念,使用户能够以图形化的方式定义任务之间的依赖关系。DAG 是 Airflow 中的核心概念,它表示一系列按顺序执行的任务。 使用 Apache Airflow 的第一步是安装和配置。Airflow 支持多种安装方式,包括通过 Docker、Kubernetes 或者直接在本地环境中安装。安装完成后,用户需要配置 Airflow 的环境,包括设置数据库、配置连接和配置任务调度。 接下来,用户可以开始定义和管理 LLM 的工作流。这通常涉及以下几个步骤: 1. **数据准备**:收集和清洗数据,确保数据质量。 2. **模型训练**:使用 OpenBayes 进行数据训练,训练模型。 3. **模型评估**:评估模型的性能,确保其符合预期。 4. **模型部署**:将训练好的模型部署到生产环境中。 5. **监控和维护**:监控模型的运行状态,及时处理问题。 通过 Airflow,这些步骤可以被定义为一系列任务,并且可以自动调度和执行。Airflow 还提供了丰富的监控和报警功能,帮助用户及时发现和解决问题。 此外,Airflow 的社区非常活跃,提供了大量的插件和扩展,可以进一步增强其功能。这些插件和扩展使 Airflow 能够与多种数据存储和计算平台集成,例如 Amazon S3、Google Cloud Storage 和 Apache Spark。 总之,Apache Airflow 是一个强大的工具,可以帮助开发者和数据科学家有效地管理和自动化 LLM 的复杂工作流。通过使用 Airflow,可以提高工作效率,减少手动操作的错误,确保任务的顺利执行。