Command Palette

Search for a command to run...

HealthGPT: مساعد طبي بالذكاء الاصطناعي

التاريخ

الحجم

600.63 MB

الترخيص

Apache 2.0

GitHub

رابط الورقة البحثية

1. مقدمة البرنامج التعليمي

يُعدّ HealthGPT نموذجًا لغويًا بصريًا طبيًا واسع النطاق (Med-LVLM)، تم إصداره بالاشتراك في 16 مارس 2025 من قِبل جامعة تشجيانغ، وجامعة العلوم والتكنولوجيا الإلكترونية في الصين، وشركة علي بابا، وجامعة هونغ كونغ للعلوم والتكنولوجيا، والجامعة الوطنية في سنغافورة. يُقدّم HealthGPT إطارًا موحدًا لمهام الفهم البصري الطبي وتوليد الصور من خلال تقنية تكييف المعرفة غير المتجانسة. يستخدم النموذج تقنية مبتكرة للتكيف غير المتجانس منخفض الرتبة (H-LoRA)، حيث يتم تخزين المعرفة اللازمة لمهام الفهم البصري وتوليد الصور في وحدات إضافية مستقلة لتجنب التعارض بين المهام. يتوفر HealthGPT بنسختين: HealthGPT-M3 (3.8 مليار مُعامل) وHealthGPT-L14 (14 مليار مُعامل)، استنادًا إلى نموذجي اللغة المُدرّبين مُسبقًا Phi-3-mini وPhi-4 على التوالي. يُقدّم النموذج الإدراك البصري الهرمي (HVP) واستراتيجية التعلم ثلاثية المراحل (TLS) لتحسين تعلم الميزات البصرية وقدرات تكييف المهام. تتوفر أوراق بحثية ذات صلة. HealthGPT: نموذج طبي واسع النطاق للرؤية واللغة لتوحيد الفهم والتوليد من خلال التكيف مع المعرفة غير المتجانسة تم إدراجه في المؤتمر الدولي للتعلم الآلي 2025 واختياره كحدث مميز.

يستخدم هذا البرنامج التعليمي موارد لبطاقة RTX A6000 واحدة. يُنصح باستخدام اللغة الإنجليزية.

يقدم المشروع نموذجين من النماذج:

- HealthGPT-M3: إصدار أصغر حجمًا تم تحسينه للسرعة وتقليل استخدام الذاكرة.

- HealthGPT-L14: إصدار أكبر مصمم لأداء أعلى ومهام أكثر تعقيدًا.

2. أمثلة المشاريع

3. خطوات التشغيل

1. بعد بدء تشغيل الحاوية، انقر فوق عنوان API للدخول إلى واجهة الويب

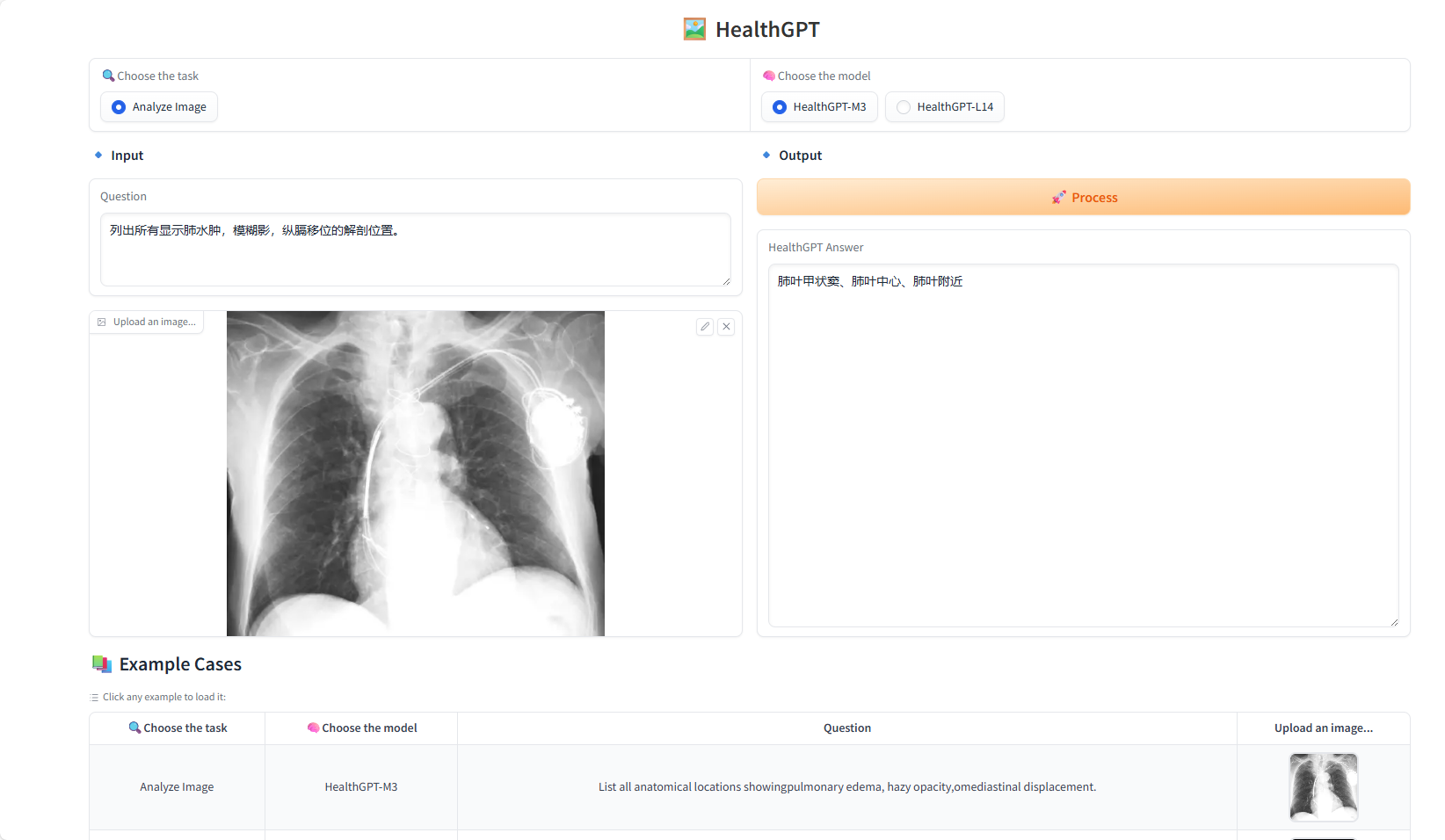

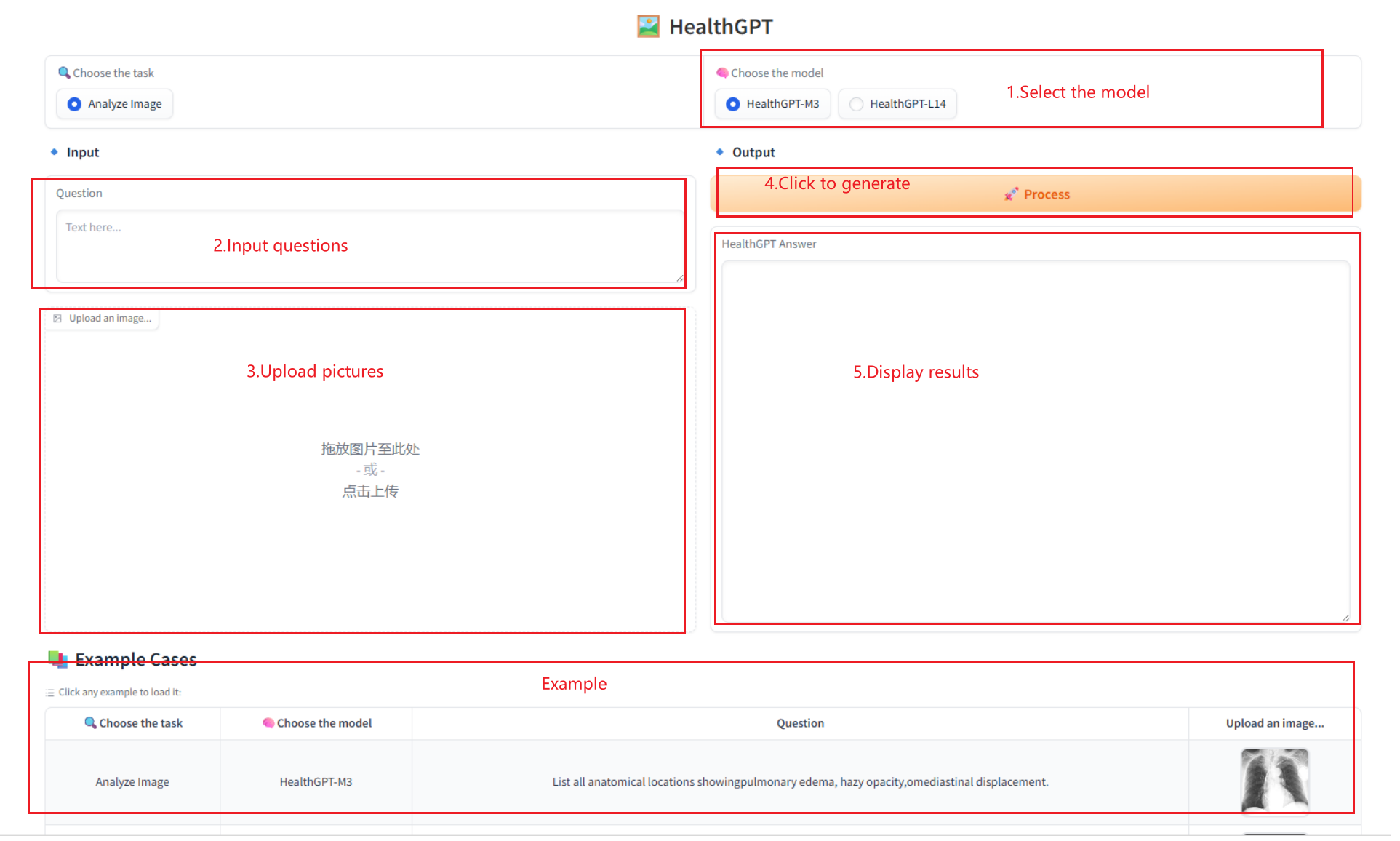

2. خطوات الاستخدام

إذا تم عرض "بوابة سيئة"، فهذا يعني أن النموذج قيد التهيئة. نظرًا لأن النموذج كبير الحجم، يرجى الانتظار لمدة 2-3 دقائق وتحديث الصفحة.

4. المناقشة

🖌️ إذا رأيت مشروعًا عالي الجودة، فيرجى ترك رسالة في الخلفية للتوصية به! بالإضافة إلى ذلك، قمنا أيضًا بتأسيس مجموعة لتبادل الدروس التعليمية. مرحبًا بالأصدقاء لمسح رمز الاستجابة السريعة وإضافة [برنامج تعليمي SD] للانضمام إلى المجموعة لمناقشة المشكلات الفنية المختلفة ومشاركة نتائج التطبيق↓

معلومات الاستشهاد

شكرًا لمستخدم Github xxxجججج1 نشر هذا البرنامج التعليمي. معلومات الاستشهاد لهذا المشروع هي كما يلي:

@misc{lin2025healthgptmedicallargevisionlanguage,

title={HealthGPT: A Medical Large Vision-Language Model for Unifying Comprehension and Generation via Heterogeneous Knowledge Adaptation},

author={Tianwei Lin and Wenqiao Zhang and Sijing Li and Yuqian Yuan and Binhe Yu and Haoyuan Li and Wanggui He and Hao Jiang and Mengze Li and Xiaohui Song and Siliang Tang and Jun Xiao and Hui Lin and Yueting Zhuang and Beng Chin Ooi},

year={2025},

eprint={2502.09838},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2502.09838},

}بناء الذكاء الاصطناعي بالذكاء الاصطناعي

من الفكرة إلى الإطلاق — سرّع تطوير الذكاء الاصطناعي الخاص بك مع المساعدة البرمجية المجانية بالذكاء الاصطناعي، وبيئة جاهزة للاستخدام، وأفضل أسعار لوحدات معالجة الرسومات.