Command Palette

Search for a command to run...

MAGI-1: أول نموذج توليد فيديو ذاتي الانحدار واسع النطاق في العالم

التاريخ

الحجم

31.53 MB

الترخيص

Apache 2.0

GitHub

رابط الورقة البحثية

1. مقدمة البرنامج التعليمي

يُعدّ Magi-1، الذي أطلقته شركة SendAI الصينية المتخصصة في الذكاء الاصطناعي رسميًا في 21 أبريل 2025، أول نموذج عالمي واسع النطاق لتوليد الفيديو بتقنية الانحدار الذاتي. يقوم هذا النموذج بتوليد مقاطع الفيديو من خلال التنبؤ بسلسلة من كتل الفيديو باستخدام الانحدار الذاتي، والتي تُعرَّف بأنها مقاطع ثابتة الطول من الإطارات المتتالية. بعد التدريب، يستطيع Magi-1 إزالة التشويش من كل كتلة، حيث يتزايد التشويش بشكل مطرد مع مرور الوقت، كما يدعم النمذجة الزمنية السببية، ويدعم توليد الفيديو المتدفق بشكل طبيعي. يحقق النموذج أداءً متميزًا في مهام تحويل الصور إلى فيديو بناءً على تعليمات نصية، موفرًا اتساقًا زمنيًا عاليًا وقابلية للتوسع، وذلك بفضل ابتكارات خوارزمية متعددة وبنية تحتية متخصصة. تتوفر أوراق بحثية ذات صلة. MAGI-1: إنشاء فيديو انحداري تلقائي على نطاق واسع .

يستخدم هذا البرنامج التعليمي الموارد لبطاقة RTX 4090 واحدة، والنص يدعم اللغة الإنجليزية فقط.

2. أمثلة المشاريع

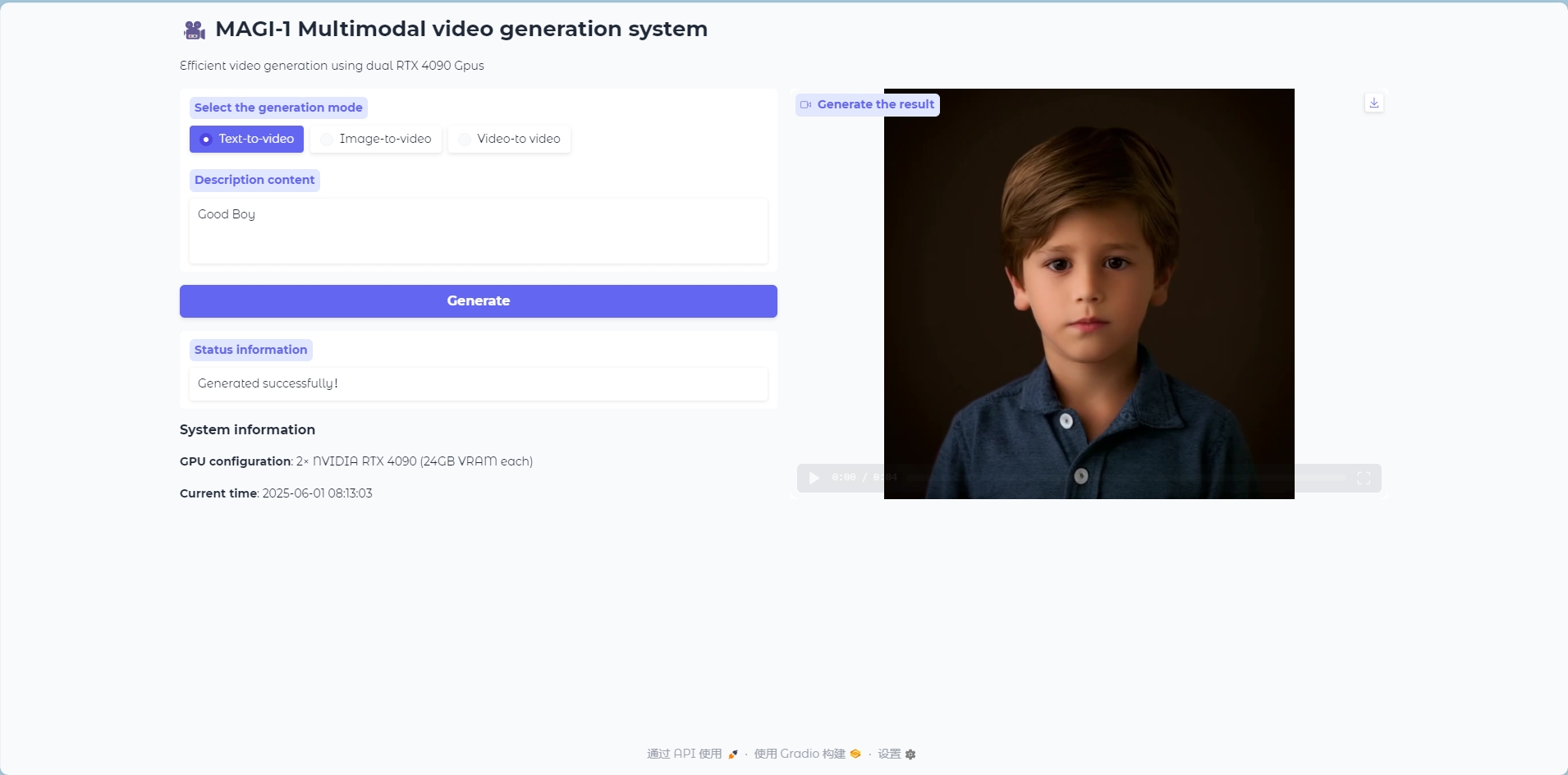

وضع النص إلى الفيديو

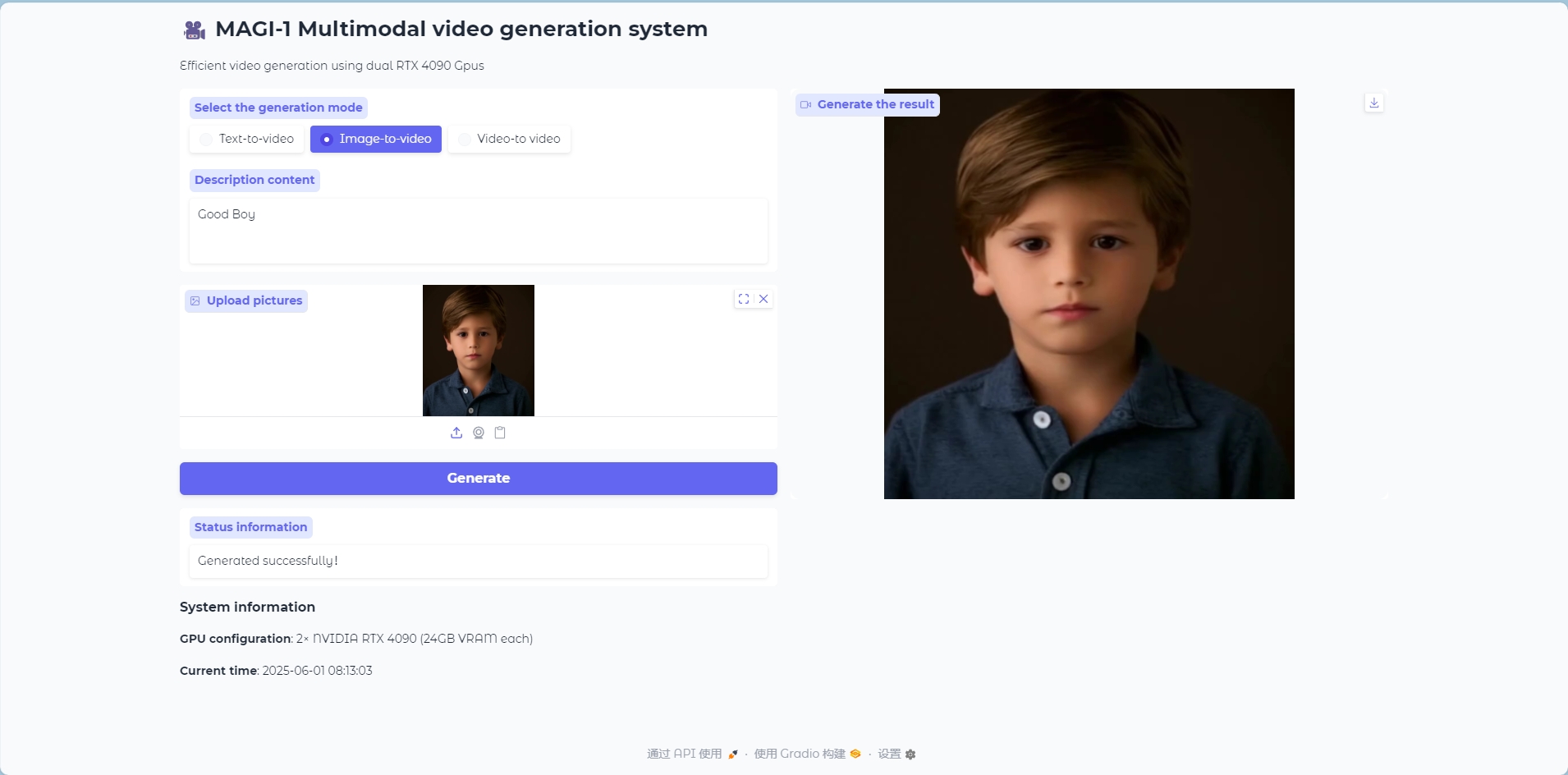

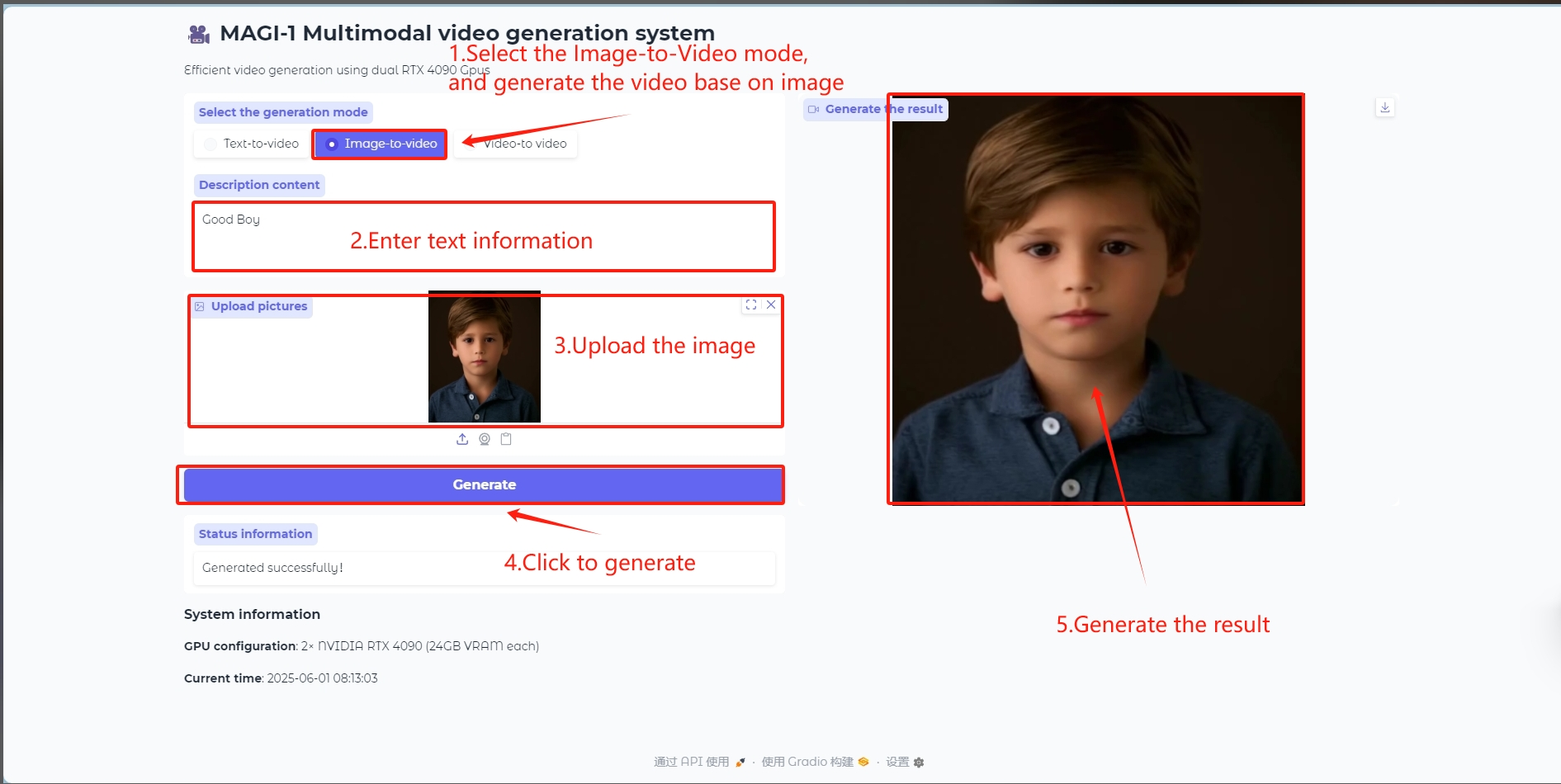

وضع الصورة إلى الفيديو

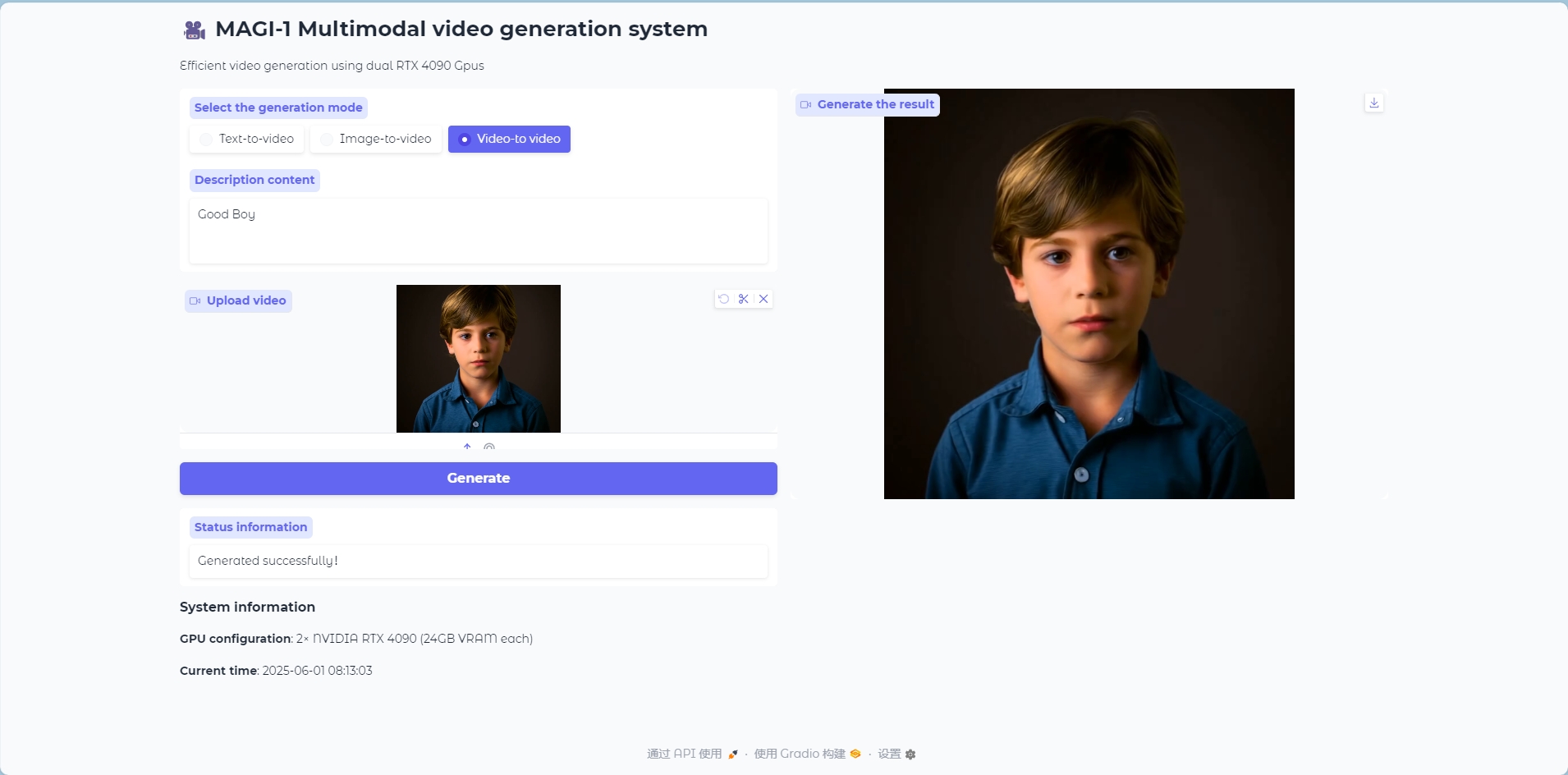

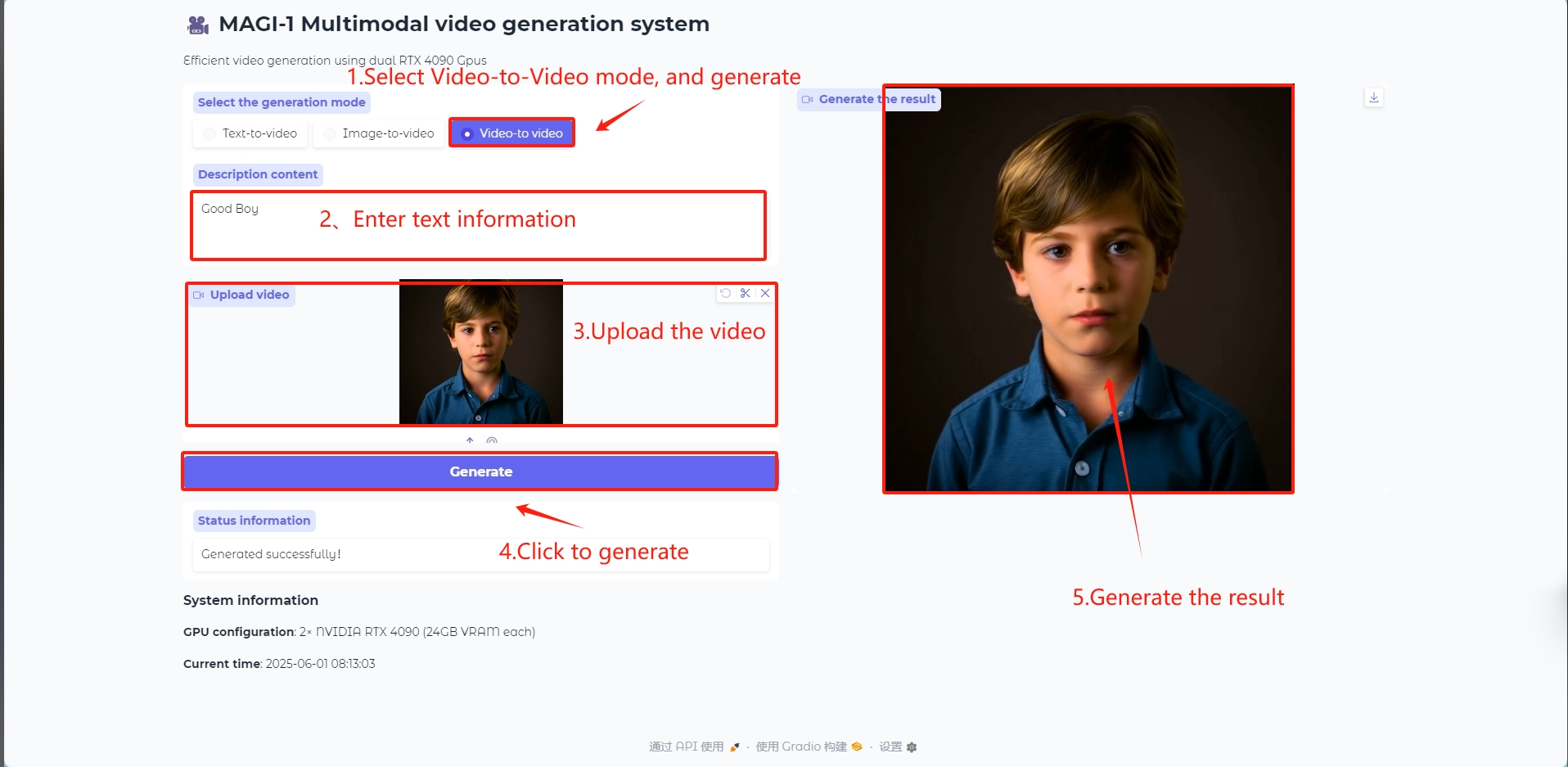

وضع الفيديو إلى الفيديو

3. خطوات التشغيل

1. بعد بدء تشغيل الحاوية، انقر فوق عنوان API للدخول إلى واجهة الويب

2. بعد الدخول إلى صفحة الويب، يمكنك بدء حوار لغوي مع النموذج

إذا ظهرت رسالة "بوابة سيئة"، فهذا يعني أن النموذج قيد التهيئة. نظرًا لكبر حجم النموذج، يُرجى الانتظار دقيقة أو دقيقتين ثم تحديث الصفحة. يستغرق النموذج حوالي خمس دقائق لإنشاء فيديو، لذا يُرجى التحلي بالصبر.

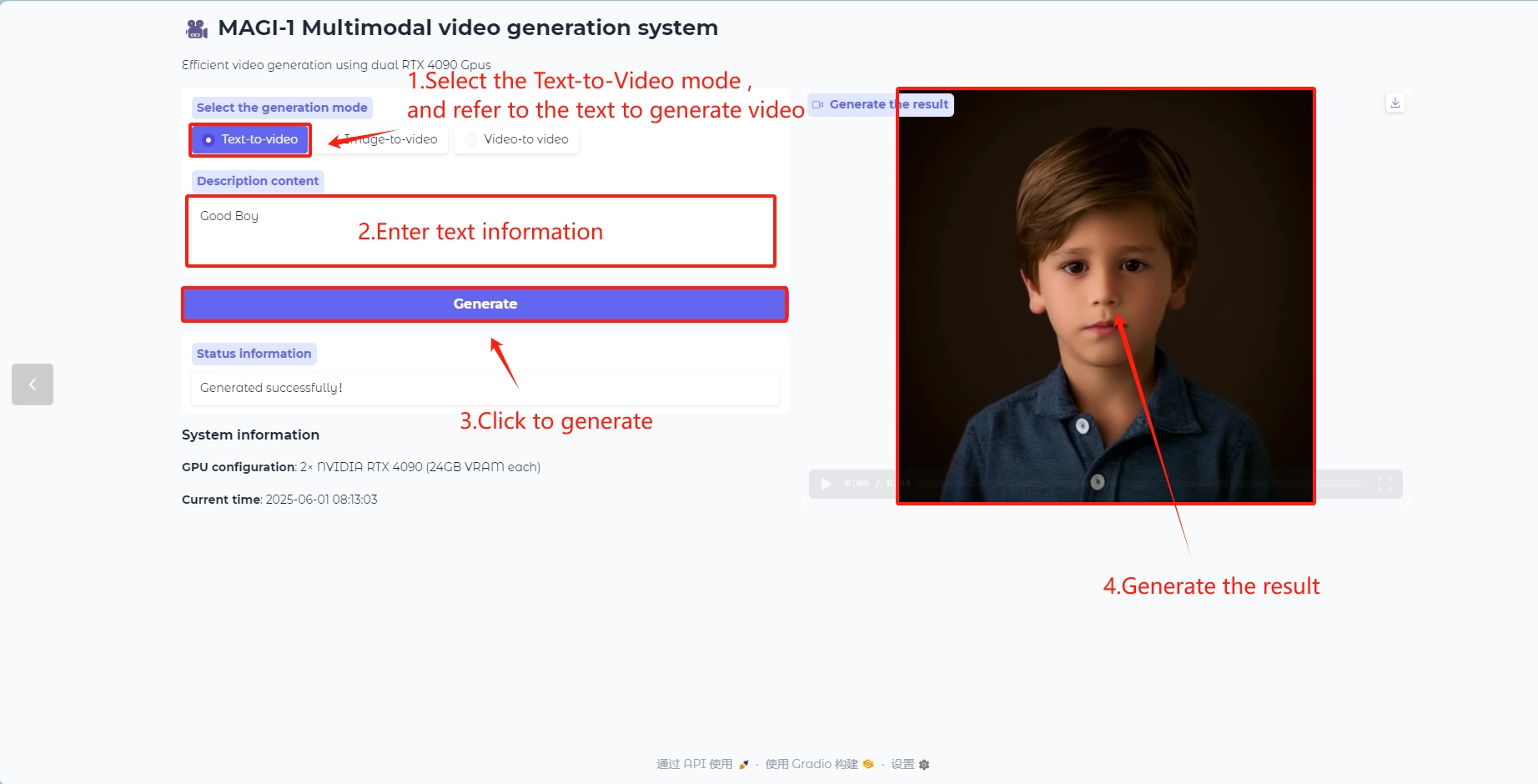

كيفية الاستخدام

نموذج تحويل النص إلى فيديو

إنشاء إطارات فيديو تحتوي على محتوى نصي

نموذج الصورة إلى فيديو

أدخل صورة كمرجع لإنشاء إطار فيديو

نموذج الفيديو إلى الفيديو

أدخل مقطع فيديو كمرجع لإنشاء إطارات الفيديو

في ملف runtime_config الخاص بملف 4.5B_distill_quant_config.json في المسار /openbayes/home/MAGI-1/example/4.5B، يمكنك تغيير معلمات الفيديو الناتج، مثل num_frames، وvideo_size_h، وvideo_size_w، وfps.

4. المناقشة

🖌️ إذا رأيت مشروعًا عالي الجودة، فيرجى ترك رسالة في الخلفية للتوصية به! بالإضافة إلى ذلك، قمنا أيضًا بتأسيس مجموعة لتبادل الدروس التعليمية. مرحبًا بالأصدقاء لمسح رمز الاستجابة السريعة وإضافة [برنامج تعليمي SD] للانضمام إلى المجموعة لمناقشة المشكلات الفنية المختلفة ومشاركة نتائج التطبيق↓

الخامس. معلومات الاستشهاد

شكرًا لمستخدم GitHub كجاسدك لنشر هذا البرنامج التعليمي، معلومات مرجع المشروع هي كما يلي:

@misc{ai2025magi1autoregressivevideogeneration,

title={MAGI-1: Autoregressive Video Generation at Scale},

author={Sand. ai and Hansi Teng and Hongyu Jia and Lei Sun and Lingzhi Li and Maolin Li and Mingqiu Tang and Shuai Han and Tianning Zhang and W. Q. Zhang and Weifeng Luo and Xiaoyang Kang and Yuchen Sun and Yue Cao and Yunpeng Huang and Yutong Lin and Yuxin Fang and Zewei Tao and Zheng Zhang and Zhongshu Wang and Zixun Liu and Dai Shi and Guoli Su and Hanwen Sun and Hong Pan and Jie Wang and Jiexin Sheng and Min Cui and Min Hu and Ming Yan and Shucheng Yin and Siran Zhang and Tingting Liu and Xianping Yin and Xiaoyu Yang and Xin Song and Xuan Hu and Yankai Zhang and Yuqiao Li},

year={2025},

eprint={2505.13211},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2505.13211},

}بناء الذكاء الاصطناعي بالذكاء الاصطناعي

من الفكرة إلى الإطلاق — سرّع تطوير الذكاء الاصطناعي الخاص بك مع المساعدة البرمجية المجانية بالذكاء الاصطناعي، وبيئة جاهزة للاستخدام، وأفضل أسعار لوحدات معالجة الرسومات.