Command Palette

Search for a command to run...

POINTS-Reader: نموذج خفيف الوزن لرؤية المستندات واللغة مع بنية متكاملة خالية من التقطير

التاريخ

الوسوم

رابط الورقة البحثية

الترخيص

其他

GitHub

عرض مجاني لقدرات حوسبة GPU

1. مقدمة البرنامج التعليمي

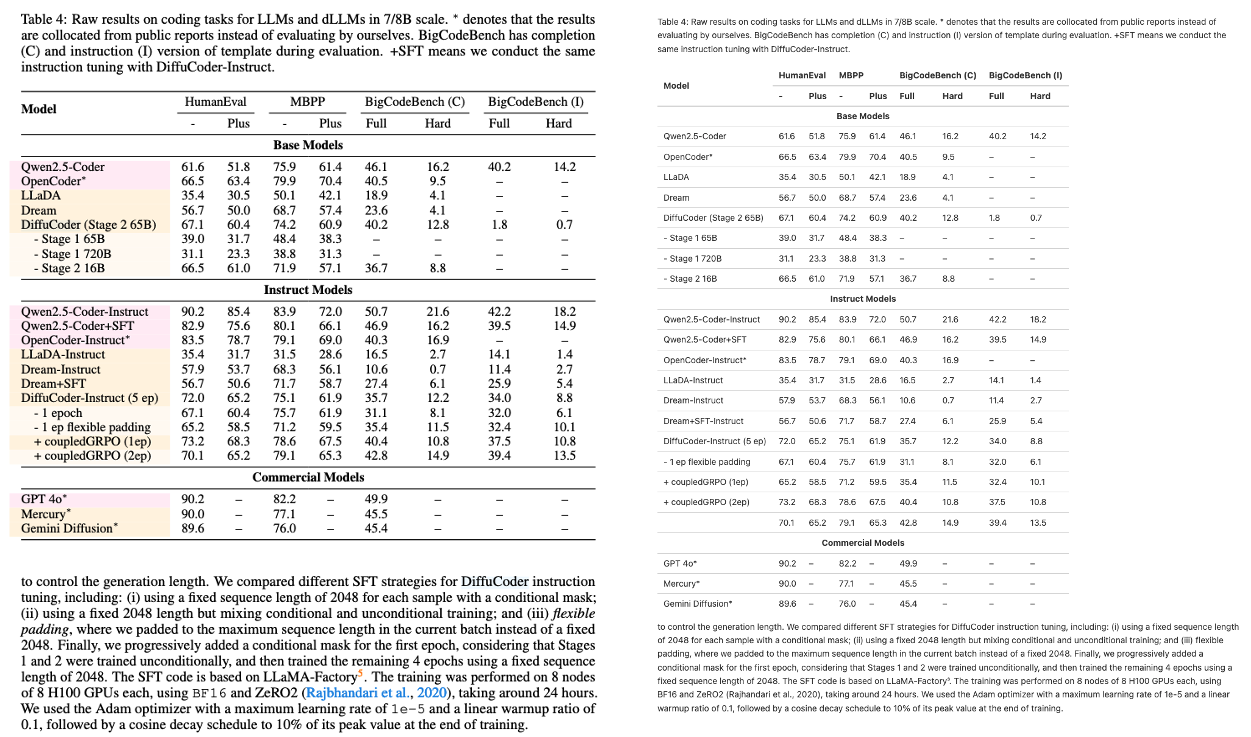

يُعدّ POINTS-Reader نموذجًا لغويًا مرئيًا خفيف الوزن، أُطلق بالتعاون بين شركة Tencent وجامعة شنغهاي جياو تونغ وجامعة تسينغهوا في أغسطس 2025، وهو مصمم خصيصًا لتحويل صور المستندات إلى نصوص. لا يعتمد POINTS-Reader على عدد كبير من المعلمات، ولا على "تقطير" النموذج التعليمي. بل يستخدم إطار عمل ثنائي المراحل ذاتي التطور لتحقيق دقة عالية في التعرف الشامل على المستندات الصينية والإنجليزية المعقدة (بما في ذلك الجداول والصيغ والتخطيطات متعددة الأعمدة) مع الحفاظ على بنية بسيطة. تتوفر أوراق بحثية ذات صلة. POINTS-Reader: تكييف نماذج الرؤية واللغة دون الحاجة إلى التقطير لتحويل المستندات تم قبولها من قبل مؤتمر EMNLP 2025 وسيتم تقديمها في المؤتمر الرئيسي.

موارد الحوسبة المستخدمة في هذا البرنامج التعليمي هي بطاقة RTX 4090 واحدة.

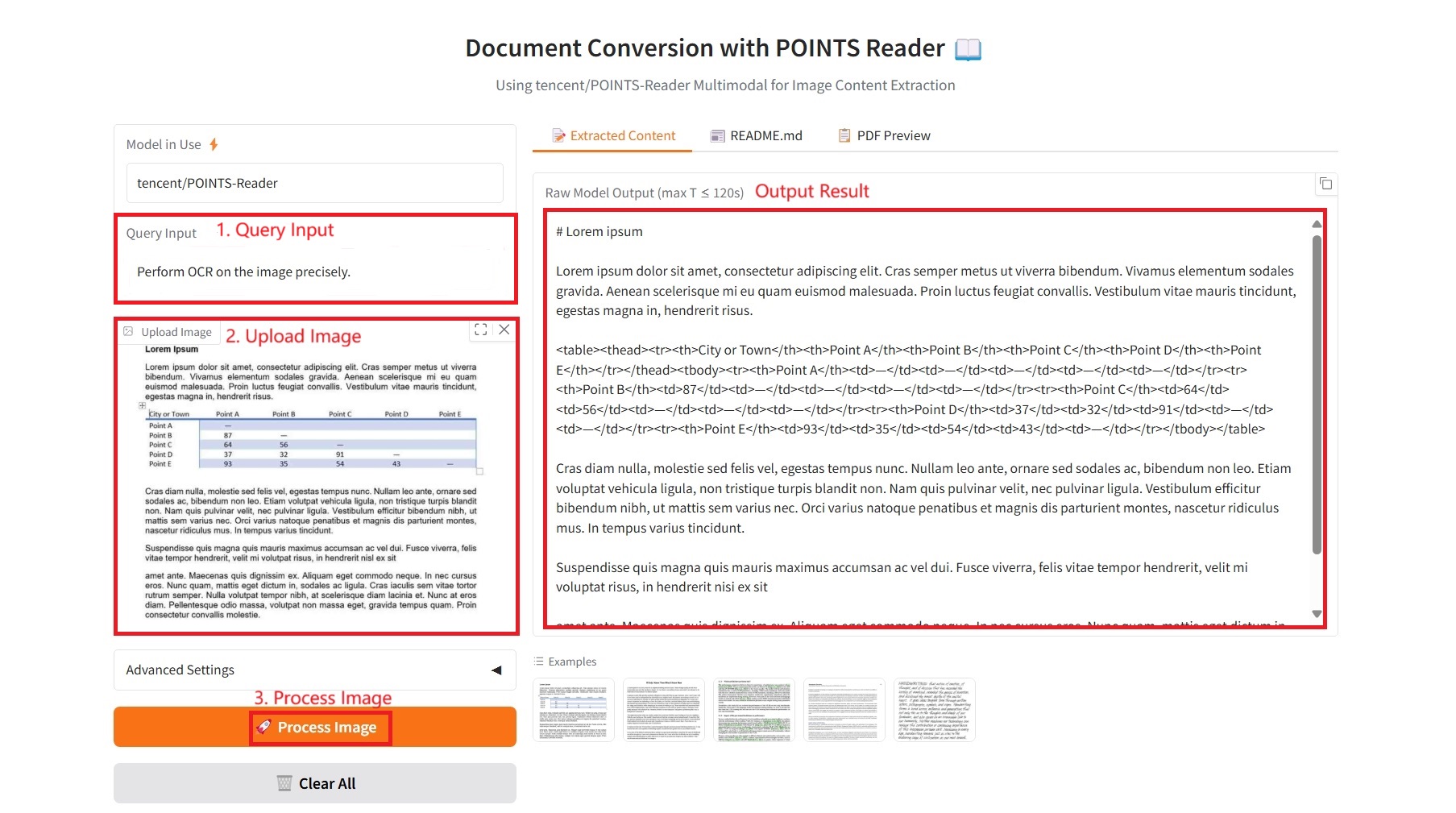

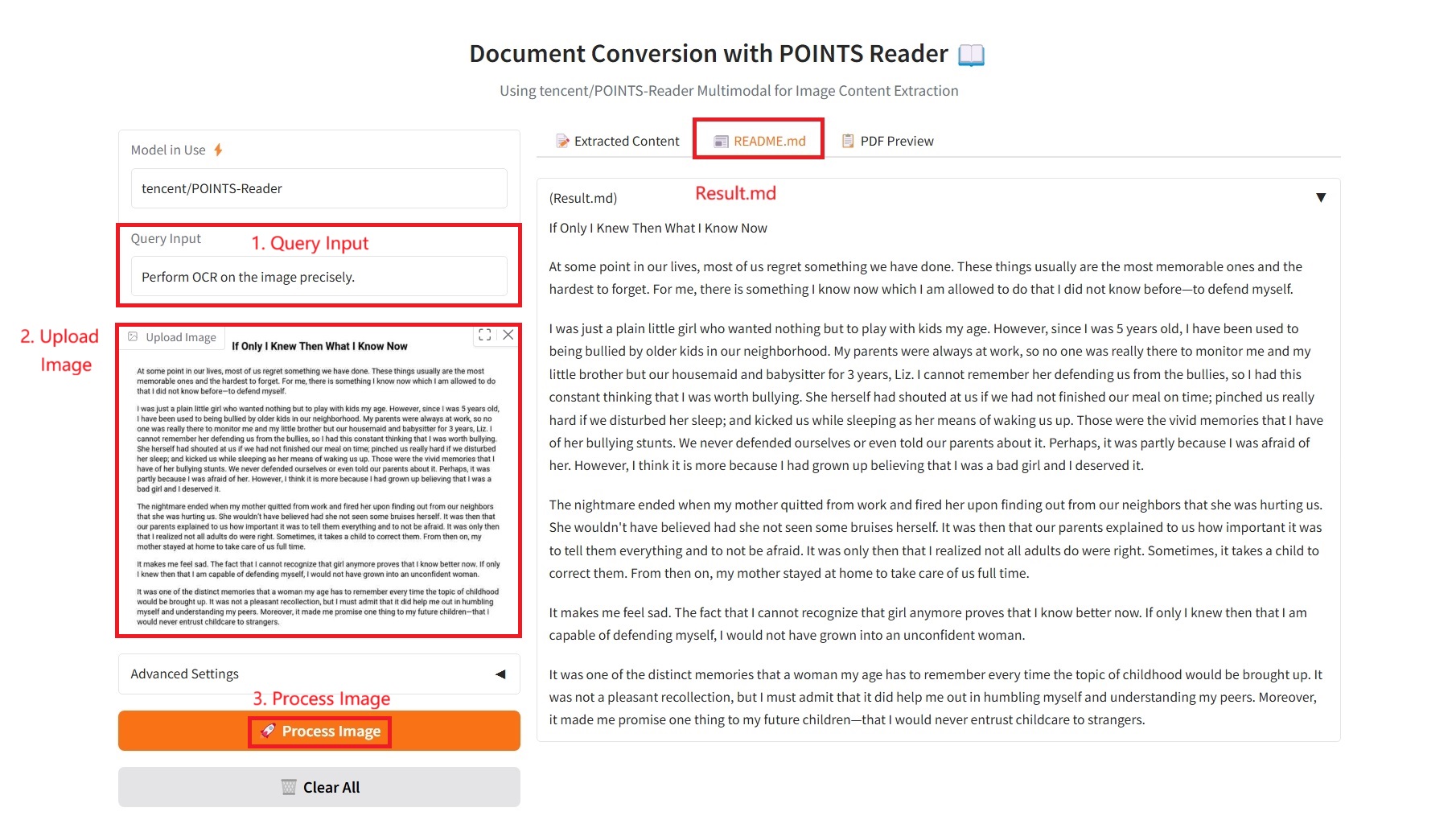

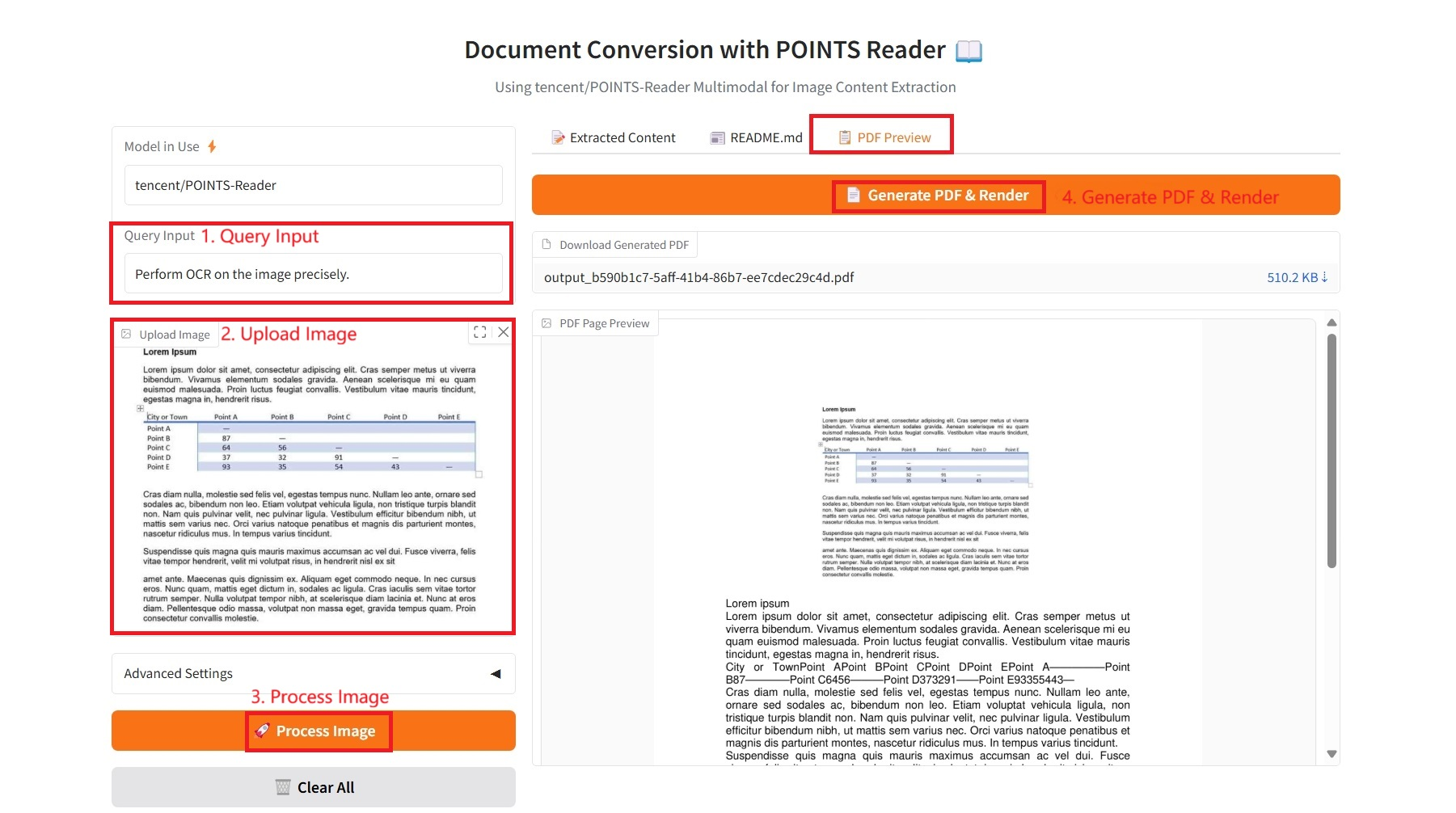

2. عرض التأثير

عمود واحد مع صيغة لاتكس

عمود واحد مع جدول

متعدد الأعمدة مع صيغة لاتكس

متعدد الأعمدة مع جدول

3. خطوات التشغيل

1. ابدأ تشغيل الحاوية

2. خطوات الاستخدام

إذا تم عرض "بوابة سيئة"، فهذا يعني أن النموذج قيد التهيئة. نظرًا لأن النموذج كبير الحجم، يرجى الانتظار لمدة 2-3 دقائق وتحديث الصفحة.

1. المحتوى المستخرج

المعلمات المحددة:

- إدخال الاستعلام: أدخل متطلبات النص.

- عامل تحسين الصورة: يزيد حجم الصورة قبل المعالجة. يُحسّن التعرف الضوئي على الحروف (OCR) للنصوص الصغيرة. القيمة الافتراضية: ١.٠ (بدون تغيير).

- الحد الأقصى للرموز الجديدة: الحد الأقصى لطول النص الناتج، والذي يتحكم في الحد الأعلى لعدد الكلمات في محتوى الإخراج.

- أعلى p (أخذ العينات النووية): معلمة أخذ العينات النووية التي تختار مجموعة الكلمات الدنيا باحتمالية تراكمية p لأخذ العينات للتحكم في تنوع الناتج.

- أعلى-ك: عينة من الكلمات المرشحة (ك) ذات الاحتمالية الأعلى. كلما كبرت القيمة، زادت عشوائية النتائج؛ وكلما صغرت القيمة، زادت دقة النتائج.

- درجة الحرارة: تتحكم في عشوائية النص المُولَّد. القيم الأعلى تُنتج نتائج أكثر عشوائية وتنوعًا، بينما تُنتج القيم الأدنى نتائج أكثر تحديدًا ومحافظة.

- عقوبة التكرار: قيمة أكبر من ١.٠ تُقلل من توليد المحتوى المكرر. كلما زادت القيمة، زادت العقوبة.

- إعدادات تصدير PDF:

- حجم الخط: حجم الخط للنص في ملف PDF، والذي يتحكم في قابلية قراءة المستند المُصدَّر.

- المسافة بين السطور: المسافة بين السطور بين الفقرات في ملف PDF تؤثر على جمالية المستند وسهولة قراءته.

- محاذاة النص: محاذاة النص في ملف PDF، بما في ذلك المحاذاة إلى اليسار، أو المحاذاة إلى الوسط، أو المحاذاة إلى اليمين، أو التبرير.

- حجم الصورة في ملف PDF: حجم الصورة المضمنة في ملف PDF، بما في ذلك الخيارات الصغيرة والمتوسطة والكبيرة.

2. README.md

3. معاينة PDF

معلومات الاستشهاد

معلومات الاستشهاد لهذا المشروع هي كما يلي:

@article{points-reader, title={POINTS-Reader: Distillation-Free Adaptation of Vision-Language Models for Document Conversion}, author={Liu, Yuan and Zhongyin Zhao and Tian, Le and Haicheng Wang and Xubing Ye and Yangxiu You and Zilin Yu and Chuhan Wu and Zhou, Xiao and Yu, Yang and Zhou, Jie}, journal={EMNLP2025}, year={2025} } @article{liu2024points1,

title={POINTS1. 5: Building a Vision-Language Model towards Real World Applications},

author={Liu, Yuan and Tian, Le and Zhou, Xiao and Gao, Xinyu and Yu, Kavio and Yu, Yang and Zhou, Jie},

journal={arXiv preprint arXiv:2412.08443},

year={2024}

} @article{liu2024points,

title={POINTS: Improving Your Vision-language Model with Affordable Strategies},

author={Liu, Yuan and Zhao, Zhongyin and Zhuang, Ziyuan and Tian, Le and Zhou, Xiao and Zhou, Jie},

journal={arXiv preprint arXiv:2409.04828},

year={2024}

}@article{liu2024rethinking,

title={Rethinking Overlooked Aspects in Vision-Language Models},

author={Liu, Yuan and Tian, Le and Zhou, Xiao and Zhou, Jie},

journal={arXiv preprint arXiv:2405.11850},

year={2024}

}

بناء الذكاء الاصطناعي بالذكاء الاصطناعي

من الفكرة إلى الإطلاق — سرّع تطوير الذكاء الاصطناعي الخاص بك مع المساعدة البرمجية المجانية بالذكاء الاصطناعي، وبيئة جاهزة للاستخدام، وأفضل أسعار لوحدات معالجة الرسومات.