Command Palette

Search for a command to run...

إنجاز كبير في إدارة دورة حياة المنتج! تم اختيار أحدث النتائج التي توصلت إليها جامعة شنغهاي جياو تونغ ومختبر شنغهاي للذكاء الاصطناعي لـ NeurIPS 24. يدمج ProSST معلومات بنية البروتين بشكل فعال

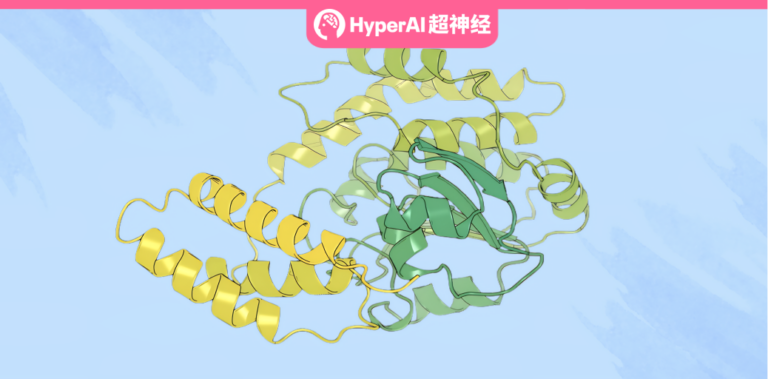

البروتين هو الجزيء الرئيسي في الحياة. تسلسلها يحدد بنيتها، وبنيتها تحدد وظيفتها. ترتبط وظيفة البروتين ارتباطًا وثيقًا ببنيته الثلاثية الأبعاد. على مدى العقود الماضية، استخدم العلماء تقنيات مثل علم البلورات بالأشعة السينية والرنين المغناطيسي النووي لحل آلاف الهياكل البروتينية، مما يوفر أدلة مهمة للناس لفهم وظائف البروتين. ومع ذلك، في مواجهة ملايين البروتينات، فإن مهمة تحليل بنية كل منها تعتبر شاقة للغاية.

بفضل نماذج اللغة المدربة مسبقًا في مجال معالجة اللغة الطبيعية، ظهرت نماذج اللغة البروتينية المدربة مسبقًا (PLMs).من خلال التعلم على بيانات تسلسل البروتين غير المسمى الضخمة، يتمكن PLM من التقاط الأنماط والتفاعلات المعقدة لتسلسلات البروتين، مما أدى إلى تقدم ثوري في التنبؤ بوظيفة البروتين والتحليل البنيوي وتحديد تفاعلات البروتين-البروتين.

ومع ذلك، تركز معظم نماذج دورة حياة البروتين على نمذجة تسلسل البروتين وتتجاهل أهمية المعلومات البنيوية، ويرجع ذلك أساسًا إلى نقص البيانات البنيوية. مع ظهور تقنيات مثل AlphaFold وRoseTTAFold، تم تحسين دقة التنبؤ ببنية البروتين بشكل كبير، وبدأ الباحثون في استكشاف كيفية دمج معلومات بنية البروتين بشكل فعال في PLM لتدريب نماذج اللغة المدربة مسبقًا على نطاق واسع والتي تدرك البنية.

على سبيل المثال، نجحت مجموعة البحث المكونة من البروفيسور هونغ ليانغ من معهد العلوم الطبيعية/كلية الفيزياء والفلك/معهد تشانغجيانغ للدراسات المتقدمة/كلية الصيدلة في جامعة شنغهاي جياو تونغ، والباحث المساعد تشو بينجكسين من جامعة شنغهاي جياو تونغ، والباحث الشاب تان بان من مختبر الذكاء الاصطناعي في شنغهاي مؤخرًا في تطوير نموذج لغة بروتينية مدرب مسبقًا مع قدرات الوعي بالبنية - ProSST.

على وجه التحديد، تم تدريب النموذج مسبقًا على مجموعة بيانات كبيرة مكونة من 18.8 مليون بنية بروتينية، وتحويل هياكل البروتين إلى تسلسلات رمزية منظمة يتم إدخالها في نموذج المحول مع تسلسلات الأحماض الأمينية. من خلال اعتماد آلية الانتباه المفككة، يمكن لـ ProSST دمج هذين النوعين من المعلومات بشكل فعال، وبالتالي تجاوز النماذج الحالية بشكل كبير في مهام التعلم الخاضع للإشراف مثل التنبؤ بالاستقرار الحراري، والتنبؤ بربط أيونات المعادن، والتنبؤ بتوطين البروتين، والتنبؤ بتعليق GO.

تم اختيار البحث، المعنون "ProSST: نمذجة لغة البروتين مع البنية الكمية والانتباه غير المتشابك"، لمعرض NeurIPS 2024.

أبرز الأبحاث:

* تقترح هذه الدراسة جهازًا لتكميم بنية البروتين يمكنه تحويل بنية البروتين إلى سلسلة من العناصر البنيوية المنفصلة. يمكن لهذه العناصر البنيوية المنفصلة أن تميز بشكل فعال المعلومات البنيوية المحلية للبقايا في البروتينات.

* اقترحت هذه الدراسة آلية انتباه منفصلة لتعلم العلاقة بين تسلسل الأحماض الأمينية للبروتين والبنية ثلاثية الأبعاد، وبالتالي تعزيز التكامل الفعال للمعلومات بين تسلسل تقسيم البنية وتسلسل الأحماض الأمينية

* بالمقارنة مع نماذج التدريب المسبق للبروتين الكبيرة الأخرى مثل سلسلة ESM وSaProt، فإن عدد معلمات ProSST هو 110M فقط، وهو أصغر بكثير من 650M في سلسلة ESM الكلاسيكية. ومع ذلك، أظهر ProSST أفضل أداء في جميع مهام مجرى البروتين تقريبًا، مما يعكس تفوق تصميم بنية نموذج ProSST.

* يحتل ProSST المرتبة الأولى في ProteinGym Benchmark، وهي أكبر منصة للتنبؤ بتأثير الطفرة بدون طلقة. في أحدث إصدار من ProteinGym، يعد هذا أول نموذج مفتوح المصدر يحقق ارتباط سبيرمان للتنبؤ بأداء الطفرة بدون طلقة بأكثر من 0.5.

عنوان الورقة:

https://neurips.cc/virtual/2024/poster/96656

قم بمتابعة الحساب الرسمي والرد "ProSST" للحصول على ملف PDF كامل

يجمع المشروع المفتوح المصدر "awesome-ai4s" أكثر من مائة تفسير ورقي لـ AI4S ويوفر مجموعات وأدوات ضخمة من البيانات:

https://github.com/hyperai/awesome-ai4s

استنادًا إلى مجموعة بيانات التدريب المسبق غير الخاضعة للإشراف السائدة في الصناعة، والتي تغطي 18.8 مليون بنية بروتينية

من أجل تحقيق التدريب المسبق غير الخاضع للإشراف لـ ProSST، استخدم فريق البحث بشكل أساسي مجموعات البيانات التالية:

* مجموعة بيانات AlphaFoldDB:تم اختيار نسخة مختصرة من 90% من بين أكثر من 214 مليون بنية بروتينية، بإجمالي 18.8 مليون بنية، منها 100000 بنية تم اختيارها عشوائيًا كمجموعة تحقق لمراقبة وضبط الحيرة أثناء مرحلة التدريب.

* مجموعة بيانات CATH43-S40:ويحتوي على 31,885 مجالًا بلوريًا بروتينيًا تم إزالة تكراره باستخدام تشابه تسلسل 40%. بعد إزالة الهياكل التي تفتقر إلى الذرات الرئيسية (مثل Cα وN)، تبقى 31270 سجلاً، يتم اختيار 200 هيكل منها عشوائيًا كمجموعة تحقق لمراقبة وتحسين أداء النموذج.

* مجموعة بيانات البنية المحلية CATH43-S40:وهو يتألف من الهياكل المحلية المستخرجة من مجموعة البيانات CATH43-S40. من خلال إنشاء طريقة الرسم البياني النجمي، يتم استخراج 4,735,677 بنية محلية لتضمين التمثيل لمشفر البنية وتحليل التجميع لكتاب رموز البنية.

* مجموعة بيانات معيارية لـ ProteinGYM:تم استخدام هذه الدراسة لتقييم قدرة ProSST في التنبؤ بتأثيرات الطفرة في العينة الصفرية، وهي تتضمن 217 تحليلًا تجريبيًا، يحتوي كل منها على معلومات التسلسل والبنية للبروتين، مع إيلاء اهتمام خاص لـ 66 مجموعة بيانات تركز على الاستقرار الحراري، باستخدام معامل سبيرمان، و Top-recall و NDCG كمؤشرات لتقييم الأداء.

ProSST: PLM مع إمكانيات التعرف على البنية، بما في ذلك وحدتين رئيسيتين

تم تطوير ProSST (محول تسلسل البروتين والبنية) في هذه الدراسة وهو نموذج لغة بروتينية مدرب مسبقًا مع قدرات التعرف على البنية. كما هو موضح في الشكل أدناه،يتكون ProSST بشكل أساسي من وحدتين:وحدة كمية البنية ونموذج المحول مع الاهتمام بتفكيك بنية التسلسل.

وحدة القياس الكمي البنيوي: تسلسل وتحديد كمية بنية البروتين في سلسلة من العناصر البنيوية

الهدف من وحدة تحديد كمية البنية هو تحويل البنية المحلية للبقايا في البروتين إلى علامات منفصلة. في البداية، يتم ترميز البنية المحلية في متجه كثيف بواسطة مشفر بنية مدرب مسبقًا. بعد ذلك، يقوم نموذج التجميع k-means المدرب مسبقًا بتعيين تسمية فئة للهيكل المحلي استنادًا إلى المتجه المشفر. أخيرًا، يتم تعيين تسميات الفئة إلى البقايا كرموز هيكلية.

* بالمقارنة مع البنية العامة للبروتين، فإن وصف البنية المحلية يكون أكثر تفصيلاً

على وجه التحديد، استخدمت هذه الدراسة ناقلًا هندسيًا (GVP) كمشفر هيكلي محلي. كما هو موضح في الشكل أ أدناه، قامت هذه الدراسة بدمج GVP مع جهاز فك تشفير يحتوي على إدراك متعدد الطبقات (MLP) واعٍ للموضع لتشكيل نموذج مشفر ذاتي. تم تدريب النموذج بأكمله باستخدام بروتينات مستهدفة مدربة مسبقًا منزوعة الضوضاء، وبعد التدريب على مجموعة بيانات CATH، استخدم الباحثون فقط متوسط الناتج المجمع للمشفر باعتباره التمثيل النهائي للهيكل.

بعد ذلك، كما هو موضح في الشكل ب أدناه، يقوم مُرمِّز البنية المحلية لهذه الدراسة بتقسيم المتجه الكثيف الذي يمثل بنية البروتين إلى علامات منفصلة. ولتحقيق هذه الغاية، استخدم الباحثون مشفر البنية GVP لتضمين البنيات المحلية لجميع البقايا في مجموعة بيانات CATH في مساحة كامنة مستمرة، ثم طبقوا خوارزمية k-means لتحديد K من مراكز البيانات في هذه المساحة الكامنة، والتي تشكل كتاب رموز البنية.

أخيرًا، بالنسبة للبقايا في الموضع i في تسلسل البروتين، قمنا أولاً بإنشاء رسم بياني Gi بناءً على بنيته المحلية ثم قمنا بتضمينه في متجه مستمر ri باستخدام مشفر البنية GVP. بشكل عام، وكما هو موضح في الشكل C أدناه، يمكن تسلسل بنية البروتين بأكملها وتقسيمها إلى سلسلة من رموز البنية.

الانتباه المنفصل بين التسلسل والبنية: تمكين النموذج من تعلم العلاقة بين البقايا والبقايا، وبين البقايا والبنى

وقد استوحيت هذه الدراسة من نموذج دي بيرتا، الذي يهدف إلى تعلم العلاقة بين تسلسل البقايا (تسلسل الأحماض الأمينية) والتسلسل البنيوي، وكذلك الموضع النسبي من خلال فصل الانتباه، بحيث يمكن للنموذج معالجة تسلسل البروتين والمعلومات البنيوية، وتحسين أداء واستقرار النموذج من خلال فصل الاهتمام.

على وجه التحديد، بالنسبة لبقايا ith في التسلسل الأساسي للبروتين، يمكن تمثيلها بثلاثة عناصر: يمثل Ri ترميز رمز تسلسل الأحماض الأمينية، Sأنا يمثل رمز الهيكل المحلي الذي يشفر الأحماض الأمينية، بينما Pي|ج ترميز الرمز للبقايا ith في الموضع j. كما هو موضح في الشكل أدناه، تتضمن آلية الانتباه المنفصلة بين التسلسل والبنية في هذه الدراسة خمسة أنواع: البقايا إلى البقايا (R إلى R)، البقايا إلى البنية (R إلى S)، البقايا إلى الموضع (R إلى P)، البنية إلى البقايا (S إلى R)، والموضع إلى البقايا (P إلى R). يتيح هذا للنموذج التقاط العلاقة المعقدة بين تسلسل البروتين وبنيته بطريقة أكثر تفصيلاً.

ProSST هي شركة رائدة في الأداء، كما أن إدراج المعلومات الهيكلية يحسن بشكل كبير من قدرات توصيف النموذج

للتحقق من فعالية ProSST في التنبؤ بفعالية الطفرات ذات اللقطة الصفرية، قارنتها الدراسة بمجموعة متنوعة من النماذج العليا، بما في ذلك النماذج القائمة على التسلسل، ونماذج تسلسل البنية، ونماذج الطي العكسي، والنماذج التطورية، ونماذج المجموعة.

كما هو موضح في الجدول التالي، في معيار ProteinGYM، يتفوق ProSST على جميع النماذج المقارنة ويحقق أفضل استقرار. علاوة على ذلك، يعمل ProSST (-structure) بشكل قابل للمقارنة مع نماذج التسلسل الأخرى، مما يؤكد أن الأداء المحسن لـ ProSST يعزى بشكل أساسي إلى التكامل الفعال للمعلومات الهيكلية.

* لا يتضمن ProSST (-structure) وحدات معلومات الهيكل

بالنسبة للتعلم الخاضع للإشراف، اختارت هذه الدراسة أربع مهام رئيسية للبروتين في مجرى النهر السفلي: التنبؤ بالاستقرار الحراري (Thermostability)، والتنبؤ بربط أيونات المعادن (Metal Ion Binding)، والتنبؤ بتوطين البروتين (DeepLoc) والتنبؤ بتعليق GO (MF/BP/CC)، وقارنت ProSST مع نماذج لغة البروتين الأخرى مثل ESM-2 وESM-1b وSaProt وMIF-ST وGearNet وما إلى ذلك. وتظهر النتائج في الجدول 2 أدناه.حقق ProSST أفضل النتائج بين جميع النماذج، وحصل على 5 مراكز أولى و 1 مركز ثاني في جميع الإعدادات الستة.

نموذج لغة البروتين: جسر بين البيانات الضخمة وعلوم الحياة

منذ إصدار نماذج اللغة الكبيرة مثل ChatGPT، أصبحت النماذج المدربة مسبقًا (PLMs) المستندة إلى تسلسلات البروتين واسعة النطاق موضوع بحث ساخن في مجال علوم الحياة. في الوقت الحاضر، ينقسم بحث إدارة دورة حياة المنتج بشكل أساسي إلى اتجاهين:

* PLM المعزز بالاسترجاع: يدمج هذا النوع من النماذج معلومات محاذاة التسلسل المتعددة (MSA) أثناء مرحلة التدريب أو التنبؤ، مثل MSATransformer وTranception، لتحسين أداء التنبؤ.

* PLM متعدد الوسائط: على عكس النماذج التي تستخدم معلومات التسلسل فقط، يدمج PLM متعدد الوسائط معلومات إضافية مثل بنية البروتين. على سبيل المثال، يمكن لنموذج ProSST الموصوف في هذه المقالة تعزيز قدرة النموذج على التمثيل من خلال دمج تسلسل الرمز الهيكلي مع تسلسل الأحماض الأمينية.

من حيث تحسين البحث في PLM،في أبريل/نيسان من هذا العام، أطلق فريق بحثي من جامعة فودان ومؤسسات أخرى PLMSearch، وهي طريقة بحث عن بروتين متماثل تعتمد على إدخال التسلسل. يمكن لهذه الدراسة استخدام نماذج لغة البروتين المدربة مسبقًا للحصول على تمثيلات عميقة والتنبؤ بالتشابهات البنيوية. وقد نُشر البحث ذو الصلة في مجلة Nature Communication.

رابط الورقة:

https://doi.org/10.1038/s41467-024-46808-5

من حيث إدارة دورة حياة المنتج متعددة الوسائط،اقترح فريق البروفيسور هواجون تشين في جامعة تشجيانغ مؤخرًا نموذجًا جديدًا للغة البروتين لإزالة الضوضاء (DePLM) لتحسين البروتين. يمكن لهذا النموذج تحسين أداء مهام تحسين البروتين من خلال تحسين المعلومات التطورية. وقد تم اختيار النتائج ذات الصلة بنجاح للمؤتمر الأعلى NeurIPS 24.

مزيد من التفاصيل: تم اختياره لـNeurIPS 24! اقترح فريق جامعة تشجيانغ نموذج لغة بروتين إزالة الضوضاء الجديد DePLM، والذي يتنبأ بتأثيرات الطفرات بشكل أفضل من نماذج SOTA

ومع استمرار ظهور هذه الدراسات الرائدة، أصبحت دورة حياة المنتج (PLM) تدريجيا أداة قوية لاستكشاف مجالات غير معروفة في علوم الحياة. وتتمتع هذه الدراسة بإمكانيات كبيرة في مجالات مثل التنبؤ بوظيفة البروتين، والتنبؤ بالتفاعل، والتنبؤ بارتباط النمط الظاهري، ومن المتوقع أن تقدم أفكارًا جديدة لعلاج الأمراض وتحسين حياة الإنسان.