Command Palette

Search for a command to run...

أصدر فريق Huake مجموعة بيانات معيارية لتجزئة مثيلات الفيديو المحظورة من OVIS

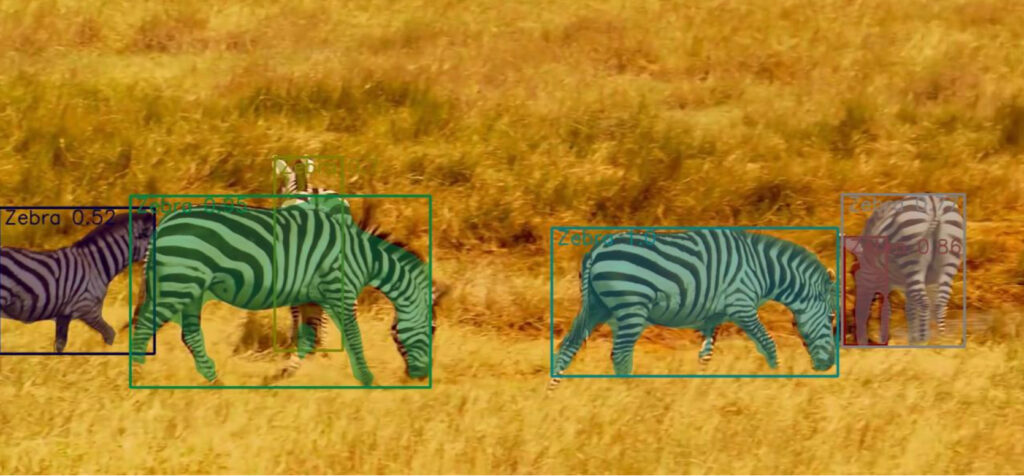

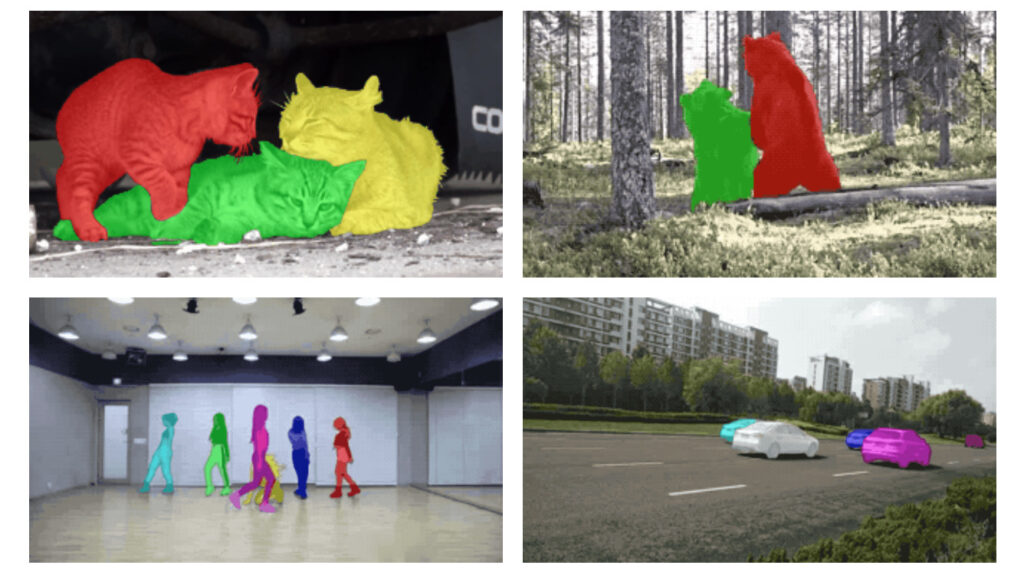

يمكن استخدام تقسيم المثيلات على نطاق واسع في سيناريوهات التطبيق المختلفة. وباعتبارها اتجاهًا بحثيًا مهمًا في مجال الرؤية الحاسوبية، فهي أيضًا صعبة للغاية ومليئة بالتحديات. ومع ذلك، بسبب الانسداد في العديد من المشاهد، تصبح عملية تقسيم المثيلات مشكلة صعبة. في الآونة الأخيرة، اقترح باحثون من جامعة هواتشونغ وعلي بابا ومؤسسات أخرى مجموعة بيانات OVIS لتجزئة مثيلات الفيديو المحجوبة على نطاق واسع لحل هذه المشكلة.

في مجال الرؤية الحاسوبية، يعد اكتشاف الكائنات المشكلة الأكثر جوهرية، وتعتبر عملية تقسيم الحالات هي المهمة الأكثر تحديًا في اكتشاف الكائنات. تتمثل عملية تقسيم المثيلات في تقسيم وحدات البكسل الخاصة بالكائن استنادًا إلى اكتشاف الهدف.

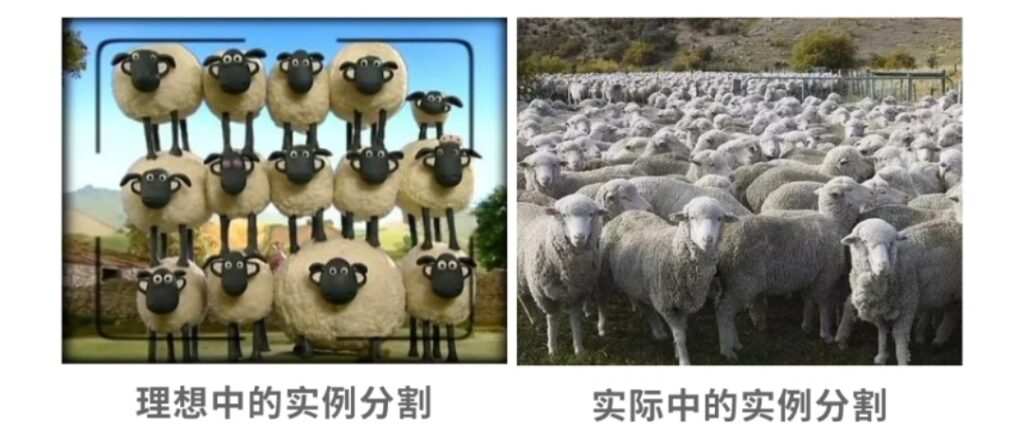

في كثير من الأحيان، تحجب الأشياء بعضها البعض، وهو ما أصبح يشكل صداعًا للمهندسين. عندما نرى نحن البشر أشياء غامضة، يمكننا التعرف عليها من خلال الخبرة أو الارتباط.

فهل من الممكن في مجال الرؤية الحاسوبية تحديد الكائنات المحجوبة بدقة مثل البشر؟ في موضوع البحث المتعلق بتجزئة المثيلات، كان حل التداخل الناتج عن الانسداد دائمًا اتجاهًا بحثيًا مهمًا.

ولحل هذه المشكلة، قامت فرق من جامعة هواتشونغ للعلوم والتكنولوجيا، وعلي بابا، وجامعة كورنيل، وجامعة جونز هوبكنز، وجامعة أكسفورد،يتم جمع مجموعة بيانات واسعة النطاق OVIS (تجزئة مثيلات الفيديو المحظورة) لتجزئة مثيلات الفيديو المحظورة، والتي يمكن استخدامها للكشف عن المثيلات وتجزئةها وتتبعها في المشاهد المحظورة في وقت واحد.

هذه هي مجموعة البيانات الثانية لتجزئة مقاطع الفيديو المحجوبة على نطاق واسع بعد مجموعة بيانات Google YouTube-VIS.

OVIS: ولد من 901 مقاطع فيديو معوقة بشدة

بالنسبة لكل ما نراه في حياتنا اليومية، هناك عدد قليل جدًا من الأشياء التي تظهر بمعزل عن غيرها، وهناك قدر أكبر أو أقل من الانسداد. ومع ذلك، تشير الأبحاث إلى أن النظام البصري البشري لا يزال قادرًا على التمييز بين الحدود الفعلية للكائن المستهدف في حالة الانسداد، ولكن بالنسبة لنظام الرؤية الحاسوبية، فإن هذا يصبح مشكلة كبيرة، ألا وهي مشكلة تجزئة مثيلات الفيديو المحظورة.

من أجل استكشاف هذه المشكلة وحلها بشكل أكبر، حاولت فرق من جامعة هواتشونغ للعلوم والتكنولوجيا وعلي بابا ومؤسسات أخرى تطوير نموذج أفضل يعتمد على خوارزمية تقسيم المثيلات مفتوحة المصدر الأصلية.

ولإنجاز هذا العمل، قام الفريق أولاً بجمع مجموعة بيانات OVIS، والتي تم تصميمها خصيصًا لتجزئة مثيلات الفيديو في المشاهد المحجوبة. في ورقة بحثية نشرت مؤخرا《تجزئة مثيلات الفيديو المحظورة》تم تقديم هذه المجموعة من البيانات بالتفصيل.

عنوان الورقة: https://arxiv.org/pdf/2102.01558.pdf

لجمع هذه المجموعة من البيانات،جمع الفريق ما يقرب من 10 آلاف مقطع فيديو في المجمل، وفي النهاية اختار 901 مقطعًا يحتوي على انسداد شديد، والكثير من الحركة، ومشاهد معقدة. كان كل مقطع فيديو يحتوي على هدفين على الأقل يحجبان بعضهما البعض.

معظم مقاطع الفيديو لها دقة 1920×1080 ومدة تتراوح بين 5 إلى 60 ثانية. لقد أجروا تعليقات توضيحية عالية الجودة بكثافة إطار واحد لكل خمسة إطارات، وفي النهاية حصلوا على مجموعة بيانات OVIS.

يحتوي OVIS على إجمالي 296 ألف تعليق قناع عالي الجودة لـ 5223 كائنًا مستهدفًا.بالمقارنة مع مجموعة بيانات Google Youtube-VIS السابقة التي تحتوي على 4883 كائنًا مستهدفًا و131 ألف قناع، فمن الواضح أن OVIS يحتوي على المزيد من كائنات الهدف وتعليقات القناع.

ومع ذلك، يستخدم OVIS في الواقع عددًا أقل من مقاطع الفيديو مقارنة بـ YouTube-VIS، حيث تفضل فلسفة الفريق مقاطع الفيديو الأطول لتمكين قدرات التتبع على المدى الطويل. متوسط مدة الفيديو ومتوسط مدة الحالة لـ OVIS هو 12.77 ثانية و10.55 ثانية على التوالي، بينما متوسط مدة YouTube-VIS هو 4.63 ثانية و4.47 ثانية على التوالي.

من أجل جعل مهمة تقسيم مقاطع الفيديو المحجوبة أكثر تحديًا، قام الفريق بالتضحية بعدد معين من مقاطع الفيديو وإضافة تعليقات توضيحية لمقاطع فيديو أطول وأكثر تعقيدًا.

تحتوي مجموعة بيانات OVIS على 25 فئة شائعة في الحياة.كما هو موضح في الشكل أدناه، تشمل الفئات المحددة: الأشخاص، الأسماك، المركبات، الخيول، الأغنام، الحمير الوحشية، الأرانب، الطيور، الدواجن، الفيلة، الدراجات النارية، الكلاب، القرود، القوارب، السلاحف، القطط، الأبقار، الببغاوات، الدراجات، الزرافات، النمور، الباندا العملاقة، الطائرات، الدببة، والسحالي.

وقد تم اختيار هذه الفئات بناءً على الاعتبارات الثلاثة التالية:

- غالبًا ما تكون هذه الأهداف متحركة ومن المرجح أن تكون مسدودة بشدة؛

- وهي شائعة جدًا في الحياة؛

- تتمتع هذه الفئات بتداخل كبير مع مجموعات بيانات تقسيم الصور واسعة النطاق الشائعة حاليًا (مثل MS COCO وLVIS وPascal VOC وما إلى ذلك)، مما يجعل من المناسب للباحثين ترحيل النماذج وإعادة استخدام البيانات.

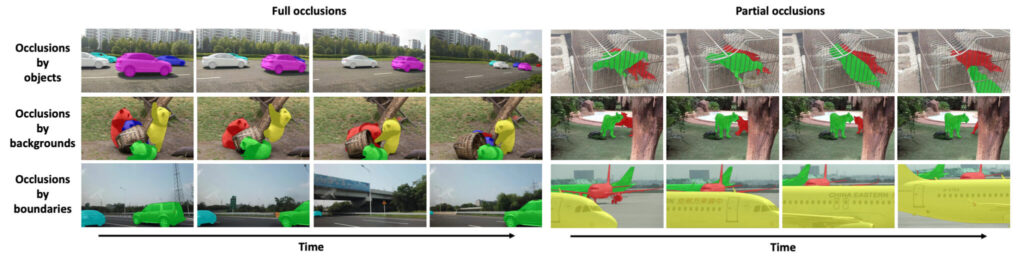

بالمقارنة مع مجموعات بيانات VIS السابقة الأخرى،الميزة الأكثر بروزًا في مجموعة بيانات OVIS هي أن جزءًا كبيرًا من الكائنات محجوب بشدة بسبب عوامل مختلفة.لذلك، يعد OVIS بمثابة منصة اختبار فعالة لتقييم نماذج تقسيم مثيلات الفيديو التي تتعامل مع الانسدادات الشديدة.

من أجل تحديد شدة الانسداد، اقترح الفريق مؤشر متوسط معدل التداخل في الصندوق المحيط (mBOR) ليعكس تقريبًا درجة الانسداد. يشير mBOR إلى نسبة مساحة المربعات المحددة المتداخلة إلى مساحة جميع المربعات المحددة في الصورة. من قائمة مقارنة المعلمات، يمكننا أن نرى أن OVIS لديه انسداد أكثر خطورة من YouTube-VIS.

تفاصيل مجموعة بيانات OVIS هي كما يلي:

تجزئة مثيلات الفيديو المحظورة

مجموعة بيانات تجزئة مثيلات الفيديو الانسدادي

مصدر البيانات:《تجزئة مثيلات الفيديو المحظورة》

الكمية المتضمنة:5223 هدفًا، 296 ألف قناع

عدد الأنواع:25 نوعًا

تنسيق البيانات:الإطار: jpg؛ تعليق: Json

دقة الفيديو:1920×1080 حجم البيانات:12.7 جيجابايت

عنوان التنزيل:https://orion.hyper.ai/datasets/14585

تقترح OVIS معيارًا أعلى لتجزئة مثيلات الفيديو

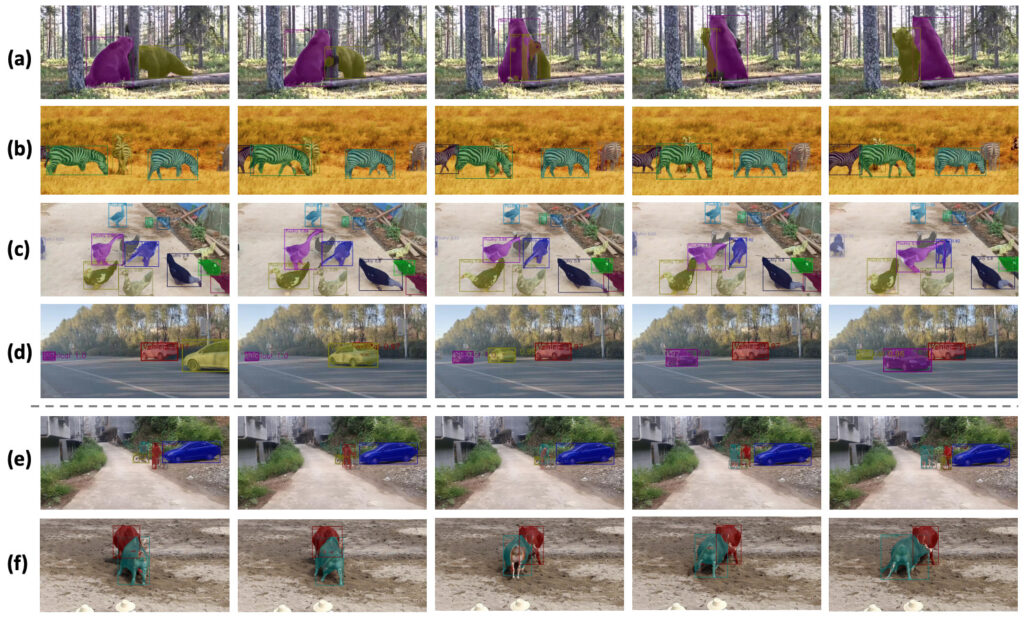

يتم تقسيم مجموعة بيانات OVIS بشكل عشوائي إلى 607 مقطع فيديو تدريبي، و140 مقطع فيديو للتحقق، و154 مقطع فيديو اختبار. أجرى الفريق تقييمًا شاملاً لخمس خوارزميات موجودة لتجزئة مثيلات الفيديو مفتوحة المصدر على OVIS، والتي كانت أيضًا بمثابة معيار للأداء الأساسي لمجموعة بيانات OVIS.

وتظهر نتائج التقييم في الجدول التالي:

بالمقارنة مع YouTube0-VIS، انخفض أداء الخوارزميات الخمس، FEELVOS، وIoUTracker+، وMaskTrack R-CNN، وSipMask، وSTEm-Seg، على OVIS بما لا يقل عن 50%.على سبيل المثال، تنخفض AP الخاصة بـ SipMask من 32.5 إلى 12.1، في حين تنخفض AP الخاصة بـ STEm-Seg من 30.6 إلى 14.4. تذكّر هذه النتائج الباحثين بضرورة إيلاء المزيد من الاهتمام لمشكلة تجزئة مثيلات الفيديو.

بالإضافة إلى ذلك، قام الفريق بتحسين أداء الخوارزمية الأصلية بشكل كبير باستخدام وحدة المعايرة.لقد قام CMaskTrack R-CNN الذي تم تطويره بتحسين نقطة الوصول الخاصة بالخوارزمية الأصلية MaskTrack R-CNN بمقدار 2.6، من 12.6 إلى 15.2، وقام CSipMask بتحسين نقطة الوصول الخاصة بـ SipMask بمقدار 2.9، من 12.1 إلى 15.0.

في الشكل (ج) أعلاه، في مشهد مزدحم بالبط، نجحت طريقة الفريق في اكتشاف وتتبع جميع البط بشكل صحيح تقريبًا، لكن اكتشاف البطة الموجودة في أقصى اليسار في الإطار الثاني فشل. ومع ذلك، في إطار لاحق، تم إعادة تتبع البطة، مما يدل على أن نموذج الفريق نجح في التقاط الإشارات الزمنية بشكل جيد.

قام الفريق بتقييم خوارزميات CMaskTrack R-CNN وCSipMask المقترحة على مجموعة بيانات YouTube-VIS، وأظهرت النتائج أنها تجاوزت الطرق الأصلية من حيث AP.

التطبيقات المستقبلية: تقسيم بانوراما الفيديو، وبيانات الانسداد الاصطناعي

وقال الفريق إن الأداء الأساسي لخوارزميات تقسيم الفيديو المستخدمة بشكل شائع على OVIS أقل بكثير من الأداء على YouTube-VIS، مما يشير إلى أنه في المستقبل، يجب على الباحثين استثمار المزيد من الطاقة في معالجة كائنات الفيديو المحجوبة.

بالإضافة إلى ذلك، استكشف الفريق طرقًا لمعالجة مشكلات الانسداد من خلال الاستفادة من الإشارات السياقية الزمنية. في المستقبل، سيقوم الفريق بإضفاء الطابع الرسمي على المسار التجريبي لـ OVIS في سيناريوهات تقسيم كائنات الفيديو في الإعدادات غير الخاضعة للإشراف أو شبه الخاضعة للإشراف أو التفاعلية. بالإضافة إلى ذلك، من المهم أيضًا توسيع نطاق OVIS ليشمل تجزئة الفيديو البانورامي (ملاحظة: تهدف تجزئة الفيديو البانورامي إلى تحقيق التجزئة الدلالية للخلفية وتجزئة المثيلات للمقدمة، وهو اتجاه جديد حديث في مجال تجزئة المثيلات).

بالإضافة إلى ذلك، فإن بيانات الانسداد الاصطناعي تشكل أيضًا اتجاهًا يحتاج الفريق إلى استكشافه بشكل أكبر. وقال الفريق إنه يعتقد أن مجموعة بيانات OVIS ستؤدي إلى المزيد من الأبحاث حول فهم مقاطع الفيديو في السيناريوهات المعقدة والمتنوعة.

وستلعب هذه التقنية دوراً هاماً في فصل الشخصيات والخلفيات في المؤثرات الخاصة في الأفلام والتلفزيون، والفيديوهات القصيرة، والبث المباشر في المستقبل.

مراجع:

عنوان الورقة: https://arxiv.org/pdf/2102.01558.pdf

الموقع الرسمي للمشروع: http://songbai.site/ovis/

مجموعة بيانات Google YouTube-VIS: