Command Palette

Search for a command to run...

إلى جانب PyTorch و TensorFlow، يتمتع هذا الإطار المحلي بشيء ما

هناك بالفعل العديد من أطر التعلم العميق، فلماذا نحتاج إلى OneFlow؟ في مجال التعلم الآلي، يتمتع يوان جينهوي برؤية طويلة المدى أكثر من أي شخص آخر في 90%.

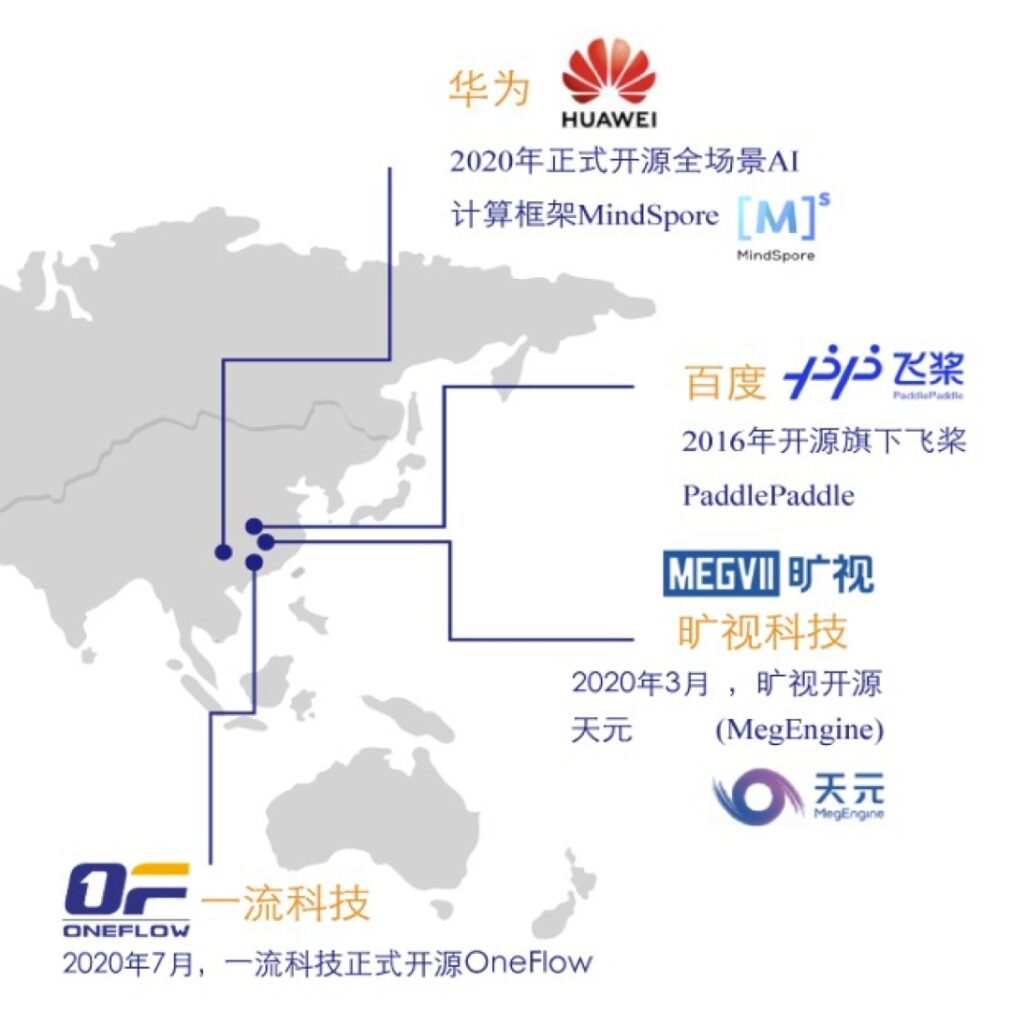

في مجال التعلم العميق، لا شك أن الأطر السائدة مثل PyTorch و TensorFlow تشغل الغالبية العظمى من حصة السوق. حتى شركة بمستوى Baidu أنفقت الكثير من القوى العاملة والموارد لدفع PaddlePaddle إلى التيار الرئيسي.

في بيئة تنافسية تهيمن عليها الموارد وتركز على الحيوانات المفترسة، ظهرت شركة ناشئة محلية في مجال إطار التعلم العميق، OneFlow.

إنها تتفوق في معالجة النماذج واسعة النطاق، وحتى هذا العام قامت بإتاحة جميع أكواد المصدر وبيانات المقارنة التجريبية الخاصة بها مفتوحة المصدر على GitHub.

لا محالة، تثار الأسئلة:هل OneFlow، وهي بنية جديدة جيدة في حل مشكلات تدريب النماذج الكبيرة، ضرورية؟ هل كفاءة أطر التعلم العميق مهمة لهذه الدرجة؟ هل من الممكن للشركات الناشئة أن تتميز عن المنافسة؟

اغتنمنا فرصة مؤتمر CosCon 20 السنوي للبرمجيات مفتوحة المصدر لمقابلة يوان جينهوي، الرئيس التنفيذي لشركة Yili Technology، وتعلمنا عن القصة وراء أكثر من 1300 يوم وليلة ومئات الآلاف من أسطر التعليمات البرمجية التي عمل عليها هو ومهندسوه.

بغض النظر عن عدد الهالات التي لديك، لا يزال يتعين عليك اتخاذ خطوة واحدة في كل مرة عند بدء عمل تجاري

في نوفمبر 2016، كتب يوان جينهوي النسخة الأولى من مفهوم تصميم OneFlow في مبنى مكاتب بالقرب من جامعة تسينغهوا. في هذا الوقت، كان يوان جينهوي قد استقال للتو من شركة مايكروسوفت للأبحاث الآسيوية (MSRA)، حيث كان يعمل هناك لمدة أربع سنوات تقريبًا.

"موظف سابق في MSRA" ليس هو الوسم الوحيد المرتبط بـ Yuan Jinhui. بعد تخرجه من جامعة شيديان في عام 2003، تم ترشيحه إلى قسم علوم الكمبيوتر في جامعة تسينغهوا لمواصلة دراساته للدكتوراه.درس تحت إشراف البروفيسور تشانغ باي، وهو أكاديمي في الأكاديمية الصينية للعلوم وأحد مؤسسي تخصص الذكاء الاصطناعي في الصين.

بعد تخرجه من جامعة تسينغهوا في عام 2008، انضم يوان جينهوي إلى شركة NetEase و360 Search. ويستخدم المنتخب الوطني الصيني نظام "هوك آي" الذي طوره كنظام مساعد للتدريب اليومي. بالإضافة إلى ذلك، خلال فترة عمله في MSRA، ركز على منصات التعلم الآلي واسعة النطاق.لقد قمنا أيضًا بتطوير أسرع خوارزمية ونظام تدريب نموذجي للموضوعات في العالم، LightLDA،تستخدم في نظام الإعلان عبر الإنترنت الخاص بشركة Microsoft.

تم إطلاق LightLDA في عام 2014. وبعد عامين فقط، توصل يوان جينهوي، الذي كان لديه رؤية فريدة، إلى تخمين جريء:مع تزايد احتياجات الأعمال والسيناريوهات، فإن أطر التعلم العميق الموزعة التي يمكنها التعامل بكفاءة مع تدريب النماذج الكبيرة سوف تصبح حتمًا جوهر البنية التحتية في عصر ذكاء البيانات بعد Hadoop وSpark.

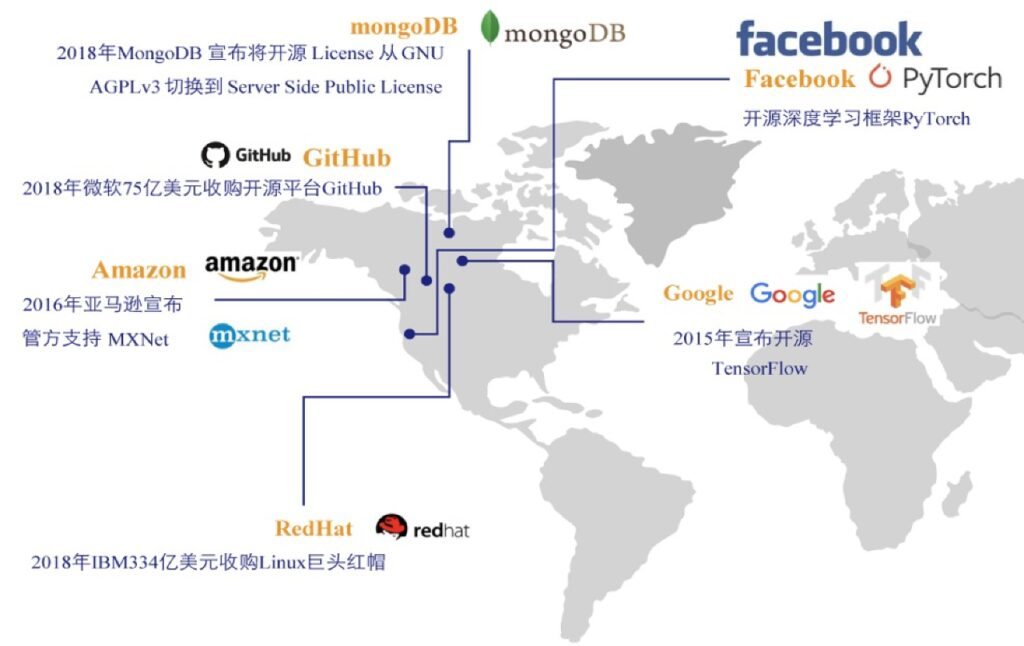

ومع ذلك، فإن أطر التعلم العميق السائدة في ذلك الوقت تم تطويرها جميعًا بواسطة شركات كبرى مثل جوجل وأمازون وفيسبوك، وكان الوضع مشابهًا حتى في الصين.ويرجع ذلك إلى أن تطوير إطار عمل التعلم العميق لا يتطلب تكاليف ضخمة في البحث والتطوير فحسب، بل والأهم من ذلك، أنه يتطلب القدرة على تحمل الشعور بالوحدة والاستعداد لحرب طويلة الأمد. ولذلك، لا تجرؤ أي شركة ناشئة على اختبار المياه في هذا المجال.

إن أطر التعلم العميق الحالية تعمل بالفعل على قدم وساق. إذا قامت شركة ناشئة بتقديم إطار عمل جديد، فهل سيشتريه المستخدمون؟ لا يجرؤ يوان جينهوي الموجه نحو العمل على التفكير فحسب، بل يجرؤ أيضًا على التصرف.

عندما كتب السطر الأول من التعليمات البرمجية لـ OneFlow، لم يكن قد فكر بعد في استراتيجية التنفيذ التفصيلية، ناهيك عن منطق العمل المثالي. فكرته بسيطة ومعقدة في نفس الوقت.نريد أن نصنع منتجًا يحب المطورون استخدامه.

مجموعة من العباقرة + 21 شهرًا، إطلاق النسخة الأولى من OneFlow

في يناير 2017، أسس يوان جينهوي شركة Yiliu Technology، وجمع أكثر من 30 مهندسًا، وبدأ "معركة الفريق" الرسمية لـ OneFlow. وعلى الرغم من أن الجميع توقعوا الصعوبات بشكل كامل، إلا أن الصعوبات العديدة التي ظهرت مع تقدم عملية التطوير كانت لا تزال تتجاوز توقعات الفريق.

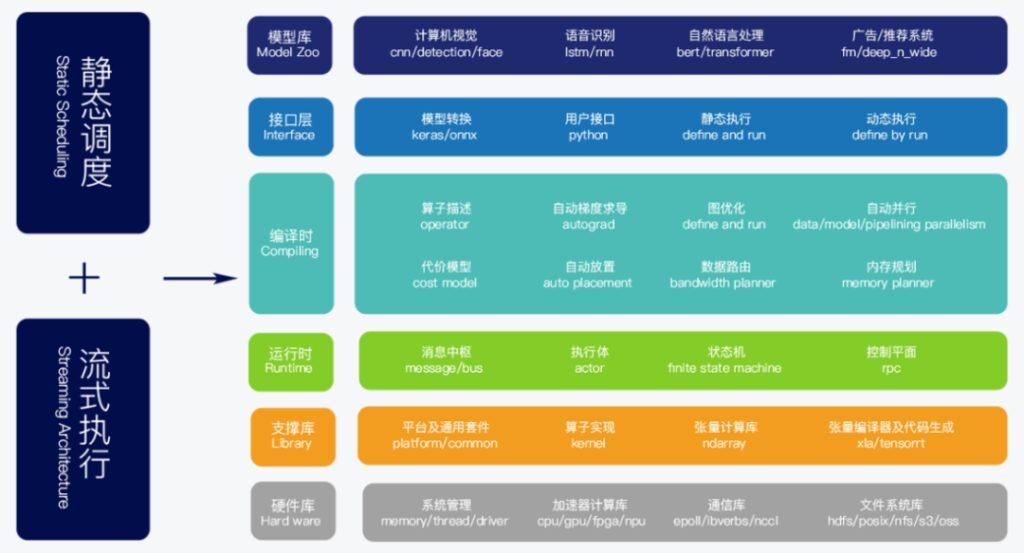

تعتبر تقنية إطار التعلم العميق معقدة للغاية، ويعتمد OneFlow على بنية تقنية جديدة تمامًا ليس لها سابقة يمكن الإشارة إليها. استغرق الأمر ما يقرب من عامين فقط لجعل المفهوم التقني يعمل.

في خريف عام 2018، دخلت عملية تطوير التكنولوجيا من الدرجة الأولى مرحلتها الأكثر صعوبة. لقد تأخر تطوير المنتج، واستُنفدت صبر بعض الموظفين وثقتهم، وكانت الجولة التالية من التمويل للشركة مليئة بالمنعطفات والتقلبات، وبالتالي فإن معنويات الفريق وثقته تواجه تحديات كبيرة.

في دائرة الشركات الناشئة، هناك مقولة تسمى "لعنة الـ 18 شهرًا"، والتي تعني أنه إذا لم يكن هناك أمل ولا ردود فعل إيجابية لمدة عام ونصف، فإن عقلية فريق الشركات الناشئة ستتغير وسيفقدون صبرهم. أدرك يوان جينهوي أنه لم يعد قادرًا على الانتظار.يجب استخدام OneFlow في السيناريوهات الحقيقية في أقرب وقت ممكن للسماح للجميع برؤية أن ابتكار OneFlow ذو قيمة بالفعل، وبالتالي تشكيل ردود فعل إيجابية.

في سبتمبر 2018، بعد عام و9 أشهر من البحث والتطوير،أطلق يوان جينهوي وفريقه النسخة المغلقة المصدر من OneFlow.في ذلك الوقت، لم يكن OneFlow مفتوح المصدر بعد وكانت هناك مشكلات متفاوتة الحجم، ولكن الإصدار الرسمي للمنتج أعطى أعضاء الفريق راحة البال أخيرًا.

التركيز على التدريب واسع النطاق، وكفاءته أفضل بكثير من الأطر المماثلة

في نوفمبر 2018، جاء الحظ السعيد لشركة First-Class Technology. أطلقت شركة جوجل نموذج اللغة الطبيعية الأقوى BERT، مما أدى إلى افتتاح عصر جديد من معالجة اللغة الطبيعية. وهذا يؤكد تنبؤ يوان جينهوي.إن وجود هياكل معمارية جديدة قادرة على التعامل مع التدريب واسع النطاق أمر ضروري وأساسي.

قريباً،قام مهندسو التكنولوجيا من الدرجة الأولى بدعم التدريب الموزع لـ BERT-Large استنادًا إلى OneFlow.كان هذا أيضًا هو الإطار الوحيد في ذلك الوقت الذي يدعم تدريب BERT-Large الموزع، حيث كان الأداء وسرعة المعالجة يتجاوزان أطر العمل مفتوحة المصدر الموجودة.

اكتسبت تقنية OneFlow شهرة واسعة بين عشية وضحاها، مما أتاح أيضًا لشركة First-Class Technology فرصة تجميع الدفعة الأولى من مستخدمي الإنترنت الرائدين في المؤسسات. من المدهش،في ذلك الوقت، اختار يوان جينهوي مسارًا منخفض المستوى للغاية لأنه "لم يكن راضيًا بعد عن المنتج".

من إصدار النسخة مغلقة المصدر في سبتمبر 2018 إلى إصدارها الرسمي مفتوح المصدر في يوليو 2020، أمضى Yuan Jinhui 22 شهرًا آخر في صقل OneFlow.واصل هو وفريقه تحسين النموذج الكلاسيكي مع حل المشكلات غير المتوقعة.من وجهة نظر يوان جينهوي، حتى لو لم يتم إعداد وثائق المنتج بشكل جيد، فلن يتمكن بسهولة من دفع OneFlow إلى الطاولة.

في 31 يوليو 2020، أصبح OneFlow مفتوح المصدر رسميًا على GitHub.لقد دخل هذا الإطار مفتوح المصدر، المعروف بقدرته على تدريب النماذج واسعة النطاق، إلى دائرة الضوء للمرة الثانية، مما يوضح تمامًا المثل القائل: الكفاءة هي الملك.

سرعة تدريب أسرع، واستخدام أعلى لوحدة معالجة الرسوميات، ونسبة تسريع أعلى للأجهزة المتعددة، وتكاليف تشغيل وصيانة أقل، وتجربة مستخدم أسهل.تتيح خمس مزايا قوية لـ OneFlow التكيف بسرعة مع السيناريوهات المختلفة والتوسع بسرعة. لقد وصل يوان جينهوي وفريقه إلى القمة في سعيهم لتحسين أداء OneFlow.

أصدر OneFlow مؤخرًا الإصدار v0.2.0.تمت إضافة ما يصل إلى 17 تحسينًا جديدًا للأداء.يؤدي هذا إلى تحسين سرعة التدريب التلقائي الدقيق المختلط لـ CNN وBERT بشكل كبير.

كما أنشأ فريق التطوير مشروعًا مفتوح المصدر يسمى DLPerf، والذي يجعل البيئة التجريبية والبيانات التجريبية والخوارزميات القابلة للتكرار مفتوحة المصدر بالكامل.تم تقييم معدل الإنتاجية ونسبة التسريع لـ OneFlow والعديد من الأطر الرئيسية الأخرى على النماذج القائمة على ResNet50-v1.5 وBERT في نفس البيئة المادية (4 أجهزة V100 16G x8).

تظهر النتائج أن معدل إنتاج OneFlow يتقدم بشكل كبير على الأطر الأخرى على كل من جهاز واحد ووحدة معالجة رسومية واحدة، وعلى أجهزة متعددة ووحدات معالجة رسومية متعددة، مما يجعله أسرع إطار عمل لتدريب نماذج ResNet50-v1.5 وBERT-based على بطاقات الرسومات الرئيسية السائدة (V100 16G).تعتبر بطاقة OneFlow ResNet50-v1.5 AMP الفردية أسرع بـ 80% من PyTorch المحسّنة بعمق من NVIDIA وأسرع بـ 35% من TensorFlow 2.3.

يمكن الوصول إلى تقرير التقييم المحدد من الرابط التالي:

https://github.com/Oneflow-Inc/DLPerf

مواجهة الشكوك والتحول إلى "أقلية" في المسار

في الواقع، كان OneFlow موضع تساؤل كثيرًا منذ إنشائه."الصعود على متن الطائرة في وقت متأخر والحصول على مساحة معيشة صغيرة" هو الصوت الأكثر شيوعًا.وأظهر يوان جينهوي هدوءًا غير عادي بشأن هذا الأمر.

في رأيه، يعد إطار التعلم العميق شيئًا جديدًا، وكل من التكنولوجيا والصناعة في المراحل المبكرة والمتوسطة، لذلك ليس هناك مجال للانضمام مبكرًا أو متأخرًا. قبل أن تتقارب التكنولوجيا،ستحظى المنتجات ذات الأداء العالي وسهولة الاستخدام القوية والقيمة الملائمة للمستخدم بتفضيل المستخدمين.

أما بالنسبة لفكرة أن هناك مساحة معيشية أقل فهي فكرة خاطئة تماما.يتيح المصدر المفتوح للشركات الصغيرة ومنتجات الشركات الكبيرة التنافس بشكل عادل.إن الأطر الجديدة الممتازة تتحدى الأطر المعتمدة، وهو ما يعد أحد العناصر الأساسية لروح المصدر المفتوح.

لم تكن الشكوك عائقًا أمام تطوير OneFlow. على العكس تماما،قام يوان جينهوي وفريقه بتسريع عملية ترقية وتحسين OneFlow، وتحديث الأداء وتحسينه، وفرز وثائق المطورين، وجمع تعليقات المجتمع...لقد نجحت هذه الجهود والمثابرة في جذب المزيد من المستخدمين إلى OneFlow، بما في ذلك بعض "المتشككين" في البداية.

في مؤتمر الصين السنوي للمصادر المفتوحة COSCon'20، قدم يوان جينهوي عرضًا تقديميًا بعنوان "تطور أنظمة تدريب التعلم العميق".تم تقديم خطة التطوير التالية لـ OneFlow لجميع المطورين. بالإضافة إلى الإصرار على الكفاءة أولاً ومواصلة تحسين الأداء،ويعمل فريق التطوير أيضًا بجهد على تقليل تكاليف التعلم والهجرة للمستخدمين.في الوقت الحالي، تعد تكلفة انتقال مستخدمي PyTorch إلى OneFlow منخفضة بالفعل، وذلك لأن واجهات المستخدم الخاصة بكليهما متشابهة تقريبًا، كما أن تكلفة تحويل النماذج المدربة إلى OneFlow منخفضة أيضًا بدرجة كافية.

من الناحية الموضوعية، لا يزال OneFlow متخلفًا عن TensorFlow وPyTorch من حيث الاكتمال وسهولة الاستخدام. ومع ذلك، يتميز OneFlow بالكفاءة العالية وقابلية التوسع الجيدة وسهولة الاستخدام الموزعة.إنه مناسب جدًا للتعرف على الوجوه على نطاق واسع، وأنظمة التوصية بالإعلانات على نطاق واسع، وسيناريوهات تدريب النماذج ذات معلمات النموذج الضخمة مثل GPT-3.

وفي نهاية المقابلة، لم يخف السيد يوان جينهوي رغبته في الموهبة. وقال إن شركة OneFlow تقوم بتوظيف مهندسي التعلم الآلي ومهندسي التعلم العميق، وترحب بشدة بالأشخاص ذوي البصيرة للانضمام إلى هذا الفريق النشط الذي يتوق إلى الفوز.

-- زيادة--