Command Palette

Search for a command to run...

YOLOE: 모든 것을 실시간으로 확인하세요

1. 튜토리얼 소개

YOLOE는 2025년 청화대학교 연구팀이 제안한 새로운 실시간 시각 모델로, "모든 것을 실시간으로 보는 것"이라는 목표를 달성하는 것을 목표로 합니다. YOLO 시리즈 모델의 실시간성과 효율성 특성을 그대로 이어받았으며, 이를 기반으로 제로샷 학습과 멀티모달 프롬프팅 기능을 깊이 통합하여 텍스트, 비전, 무음 프롬프팅 등 다양한 시나리오에서 타겟 탐지 및 세분화를 지원할 수 있습니다. 관련 논문 결과는 다음과 같습니다.YOLOE: 실시간으로 무엇이든 보는 것".

YOLO(You Only Look Once)는 2015년 출시 이후 객체 감지 및 이미지 분할 분야를 선도해 왔습니다.YOLO 시리즈와 관련 튜토리얼의 발전 과정은 다음과 같습니다.

- YOLOv2(2016): 배치 정규화, 앵커 박스, 차원 클러스터링을 소개합니다.

- YOLOv3(2018): 보다 효율적인 백본 네트워크, 멀티 앵커, 공간 피라미드 풀링을 사용합니다.

- YOLOv4(2020): Mosaic 데이터 증강, 앵커 없는 감지 헤드 및 새로운 손실 함수를 소개합니다. → 튜토리얼:DeepSOCIAL은 YOLOv4 기반 군중 거리 모니터링 및 다중 타겟 추적을 구현합니다.

- YOLOv5(2020): 하이퍼파라미터 최적화, 실험 추적 및 자동 내보내기 기능이 추가되었습니다. → 튜토리얼:YOLOv5_deepsort 실시간 다중 타겟 추적 모델

- YOLOv6(2022): 메이투안은 오픈소스로, 자율 배송 로봇에 널리 사용됩니다.

- YOLOv7(2022): COCO 키포인트 데이터 세트에 대한 포즈 추정을 지원합니다. → 튜토리얼:사용자 정의 YOLOv7 모델을 훈련하고 사용하는 방법

- YOLOv8(2023):Ultralytics가 출시되어 다양한 시각 AI 작업을 지원합니다. → 튜토리얼:사용자 정의 데이터로 YOLOv8 학습

- YOLOv9(2024): 프로그래밍 가능 그래디언트 정보(PGI)와 일반화된 효율적 계층 집계 네트워크(GELAN) 소개.

- YOLOv10(2024): 청화대학교에서 출시한 이 기술은 엔드투엔드 헤더를 도입하고 비최대 억제(NMS) 요구 사항을 제거합니다. → 튜토리얼:YOLOv10 실시간 엔드투엔드 객체 감지

- YOLOv11(2024): Ultralytics의 최신 모델로, 감지, 분할, 자세 추정, 추적 및 분류를 지원합니다. → 튜토리얼:YOLOv11의 원클릭 배포

- YOLOv12 🚀 신규(2025): 속도와 정확성의 두 가지 정점에 어텐션 메커니즘의 성능적 이점이 결합되었습니다!

핵심 기능

- 모든 텍스트 유형

2. 다중 모드 프롬프트:

- 시각적 단서(상자/점/손으로 그린 모양/참조 이미지)

- 완전 자동 무음 감지 – 장면 객체를 자동으로 식별합니다.

데모 환경: YOLOv8e/YOLOv11e 시리즈 + RTX4090

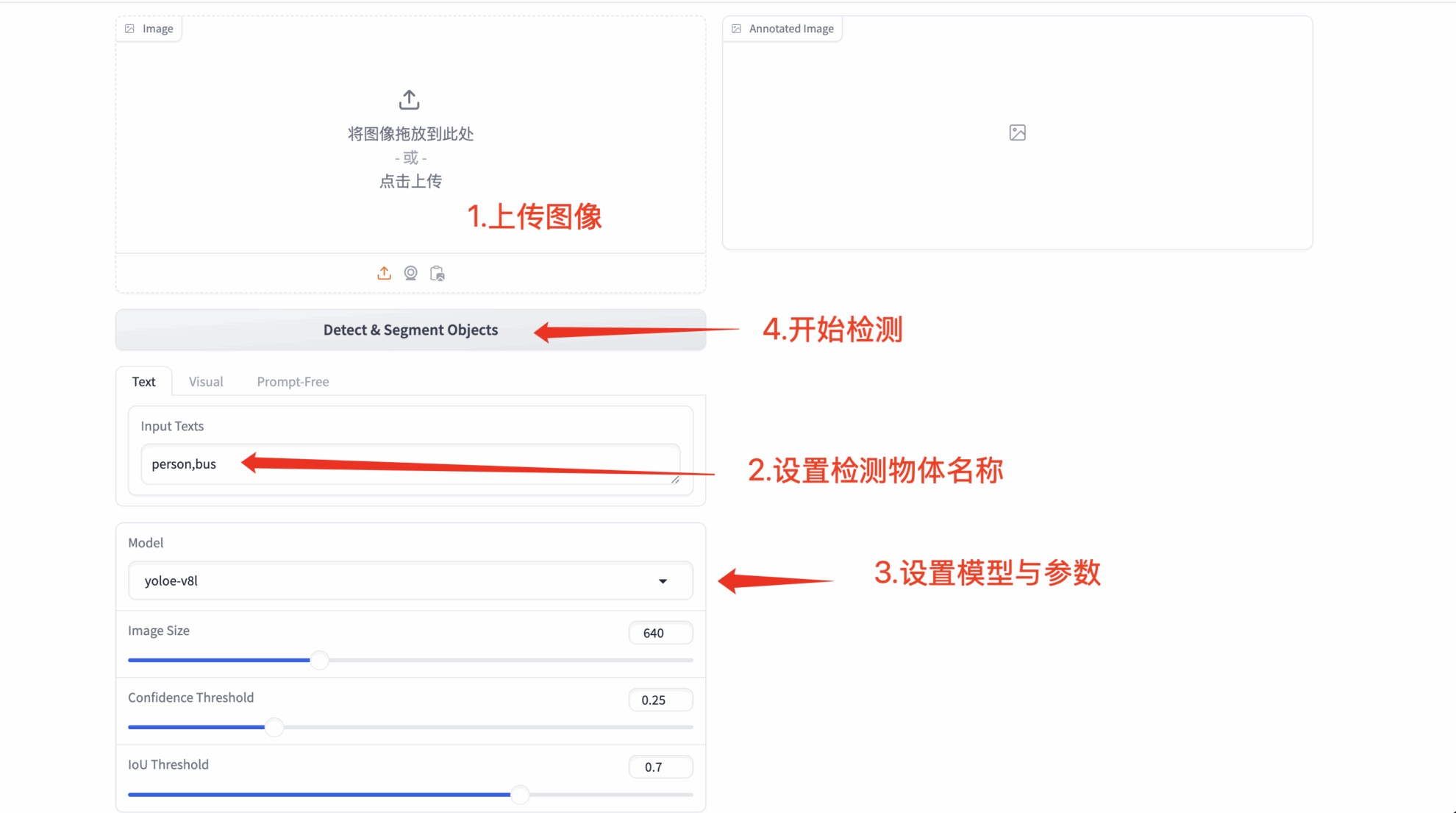

2. 작업 단계

1. 컨테이너 시작 후 API 주소를 클릭하여 웹 인터페이스로 진입합니다.

"잘못된 게이트웨이"가 표시되면 모델이 초기화 중임을 의미합니다. 약 1~2분 정도 기다려 주신 후 페이지를 새로고침해 주세요.

2. YOLOE 기능 시연

1. 텍스트 프롬프트 감지

- 모든 텍스트 유형

- 사용자 정의 프롬프트 단어: 사용자가 임의의 텍스트를 입력할 수 있도록 합니다(인식 결과는 의미적 복잡성에 따라 다를 수 있음)

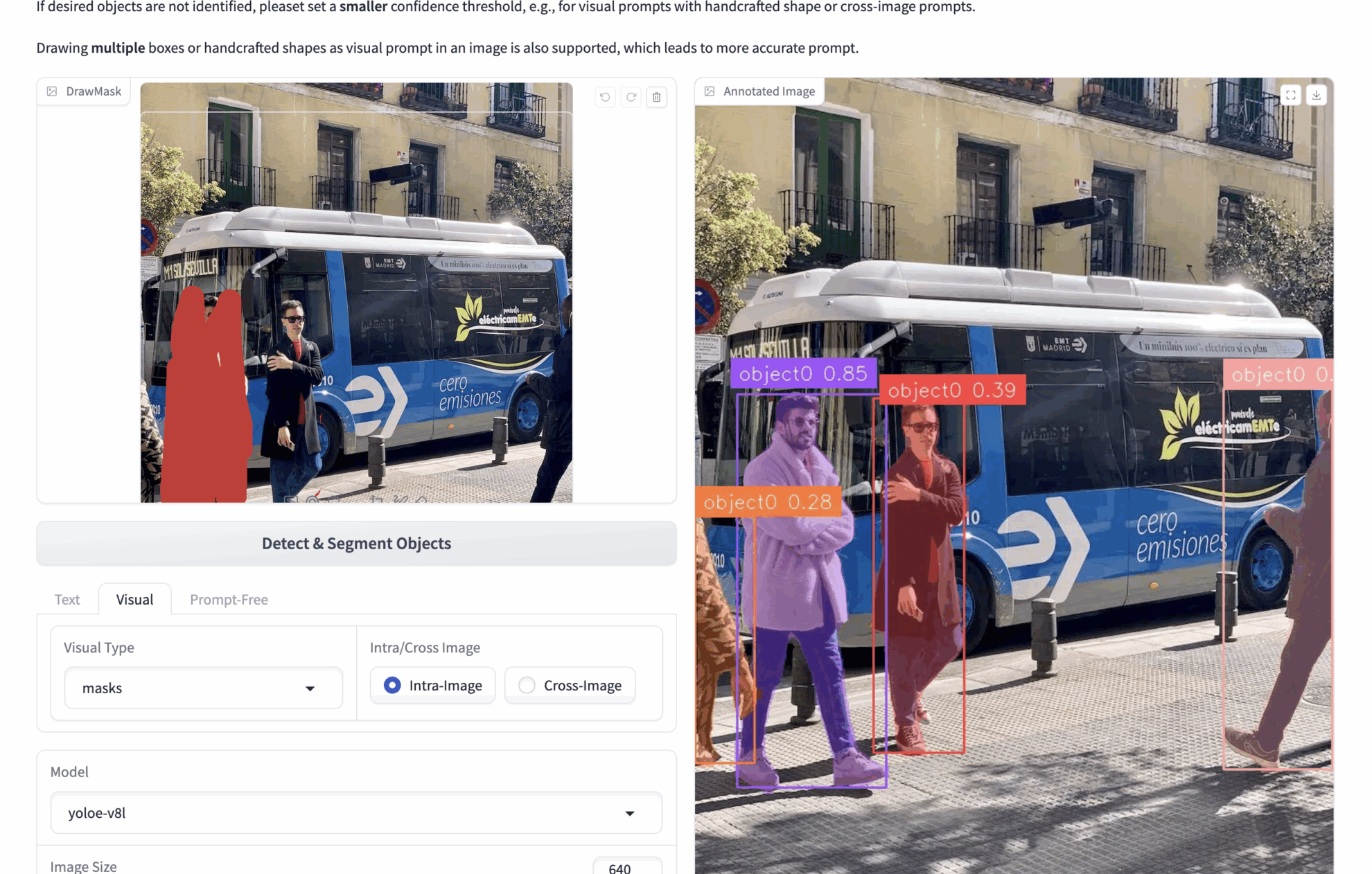

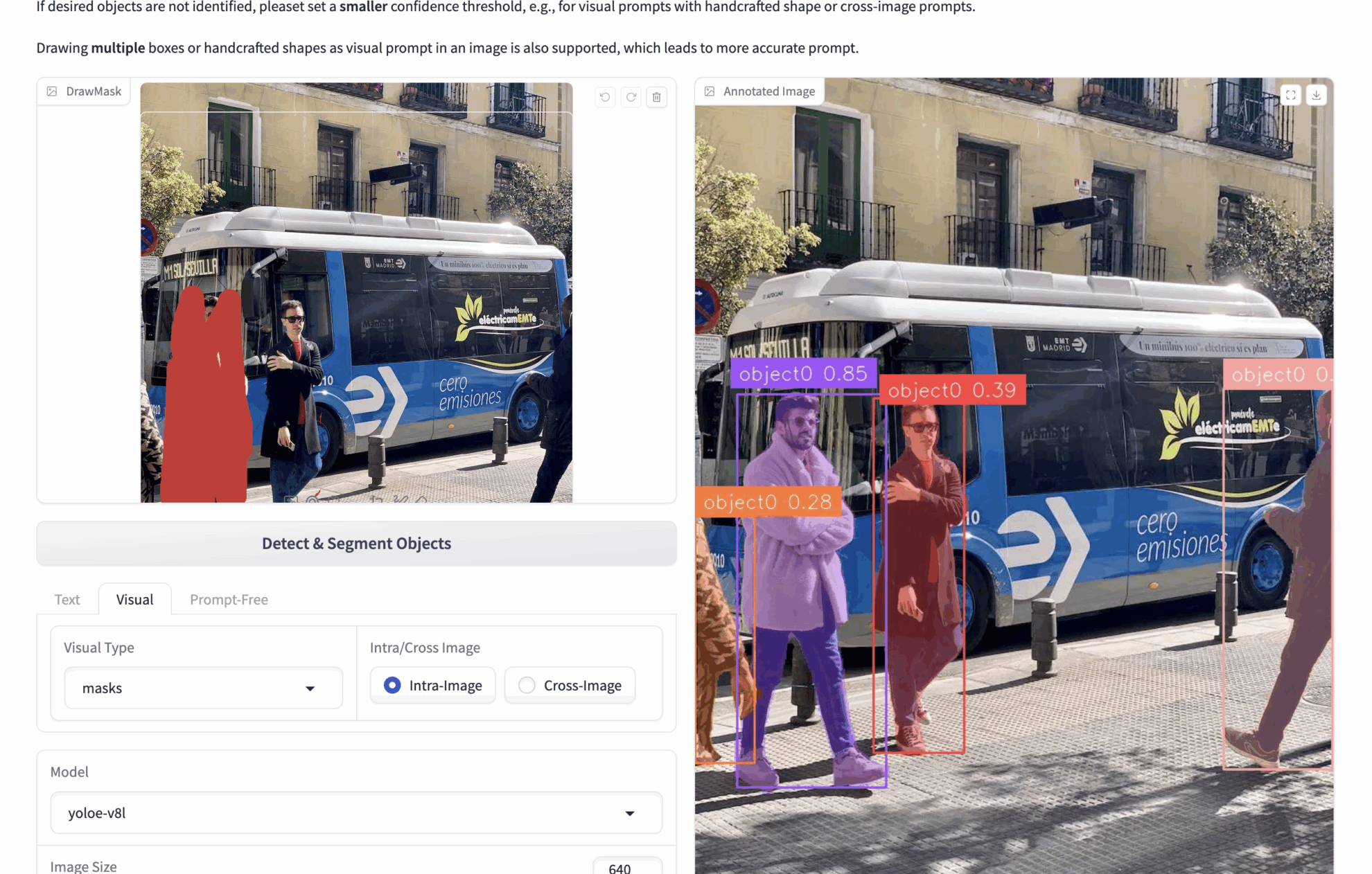

2. 다중 모달 시각적 단서

- 🟦 상자 선택 감지 (상자)

bboxes: 예를 들어, 많은 사람이 포함된 이미지를 업로드하고 이미지에서 사람을 감지하려는 경우 bboxes를 사용하여 한 사람을 프레임에 넣을 수 있습니다. 추론하는 동안 모델은 상자의 내용을 기반으로 이미지에 있는 모든 사람을 식별합니다.

더 정확한 시각적 단서를 얻으려면 여러 개의 상자를 그릴 수 있습니다. - ✏️ 클릭/그리기 영역 (마스크)

마스크: 예를 들어, 많은 사람이 포함된 이미지를 업로드하고 이미지에서 사람을 감지하려는 경우 마스크를 사용하여 한 사람을 가릴 수 있습니다. 추론하는 동안 모델은 마스크의 내용을 기반으로 이미지에 있는 모든 사람을 인식합니다.

더욱 정확한 시각적 단서를 얻으려면 여러 개의 마스크를 그릴 수 있습니다. - 🖼️ 참조 이미지 비교 (내부/교차)

Intra: 현재 이미지에 bbox나 마스크를 적용하고 현재 이미지에 대한 추론을 수행합니다.

크로스: 현재 이미지에 박스나 마스크를 적용하고 다른 이미지에 이를 추론합니다.

핵심 개념

| 모델 | 기능 설명 | 응용 프로그램 시나리오 |

|---|---|---|

| 이미지 내 | 단일 그래프 내에서 객체 관계 모델링 | 로컬 타겟 정밀 위치 지정 |

| 크로스 이미지 | 교차 이미지 기능 매칭 | 유사한 객체 검색 |

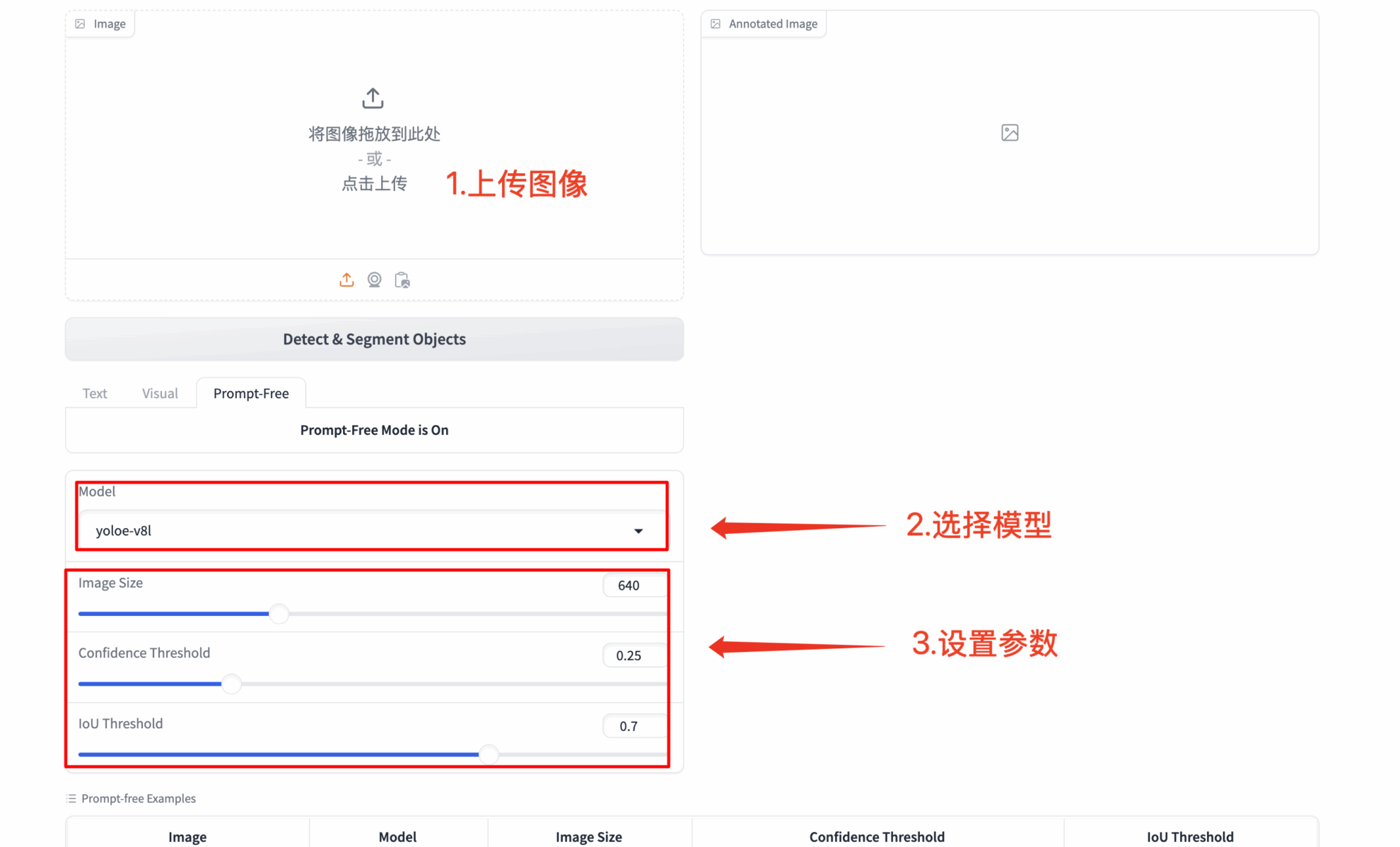

3. 프롬프트 없이 완전 자동 감지

- 🔍 지능형 장면 분석: 이미지의 모든 주요 객체를 자동으로 식별합니다.

- 🚀 구성 없이 시작: 프롬프트 입력 없이 작동합니다.

교류 및 토론

🖌️ 고품질 프로젝트를 발견하시면, 백그라운드에 메시지를 남겨 추천해주세요! 또한, 튜토리얼 교환 그룹도 만들었습니다. 친구들의 QR코드 스캔과 [SD 튜토리얼] 댓글을 통해 그룹에 가입하여 다양한 기술 이슈에 대해 논의하고 신청 결과를 공유해 주시기 바랍니다.↓