Command Palette

Search for a command to run...

LiveCC: リアルタイム動画解説大型モデル

プロジェクト概要

LiveCCは、シンガポール国立大学のShow LabとByteDanceによって2025年4月25日に初めてリリースされた、大規模なストリーミング音声文字起こしに焦点を当てた動画ベースの大規模言語モデルプロジェクトです。このプロジェクトは、革新的な動画自動音声認識(ASR)ストリーミング手法を用いて、リアルタイムコメント機能を備えた初の動画ベースの大規模言語モデルを学習することを目指しており、ストリーミングとオフラインの両方のベンチマークで最先端(SOTA)性能を達成することを目指しています。関連研究論文も公開されています。 LiveCC: 大規模なストリーミング音声文字起こしによるビデオ LLM の学習CVPR 2025 に含まれています。

このチュートリアルでは、リソースとして単一の RTX A6000 カードを使用します。

プロジェクト例

ステップの実行

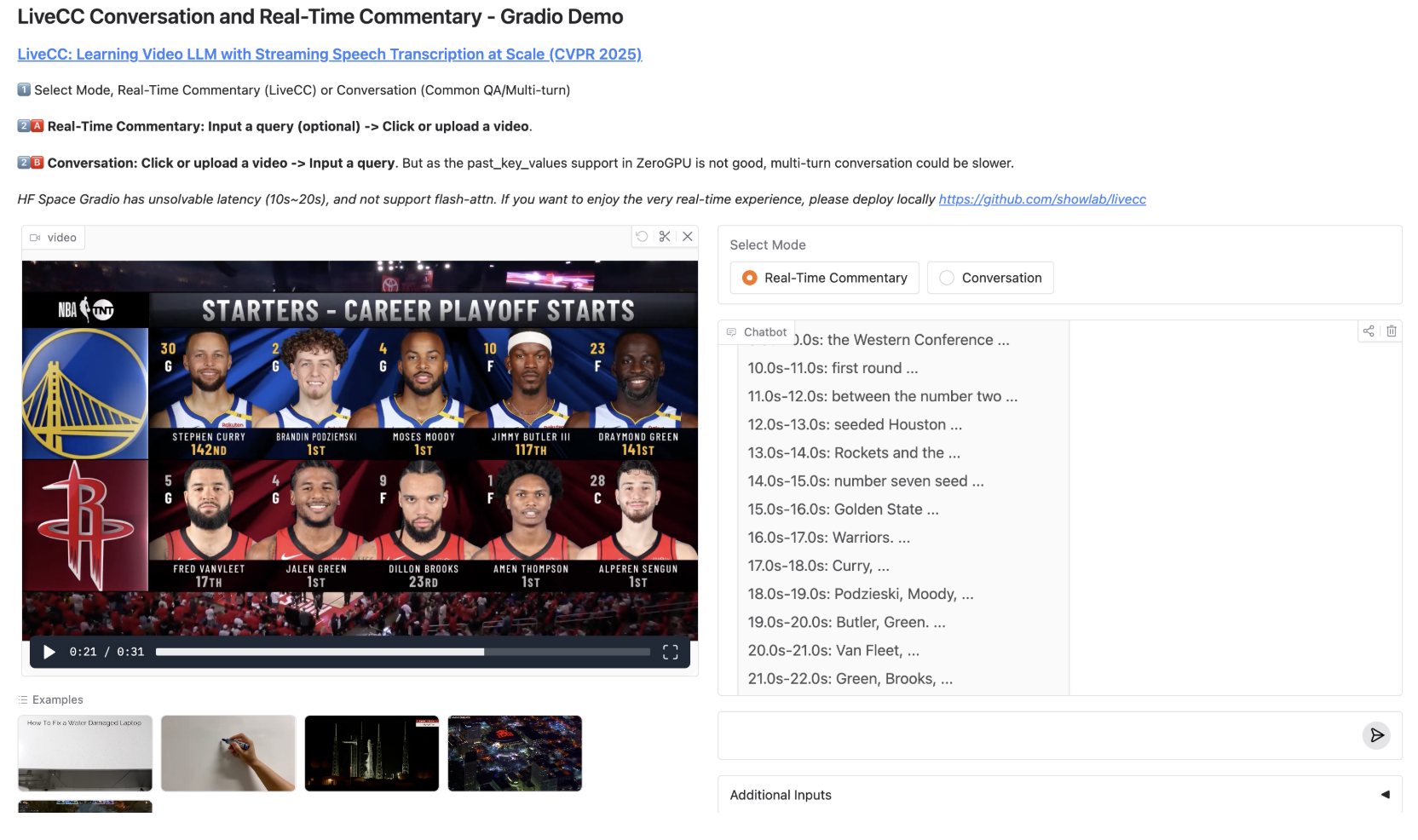

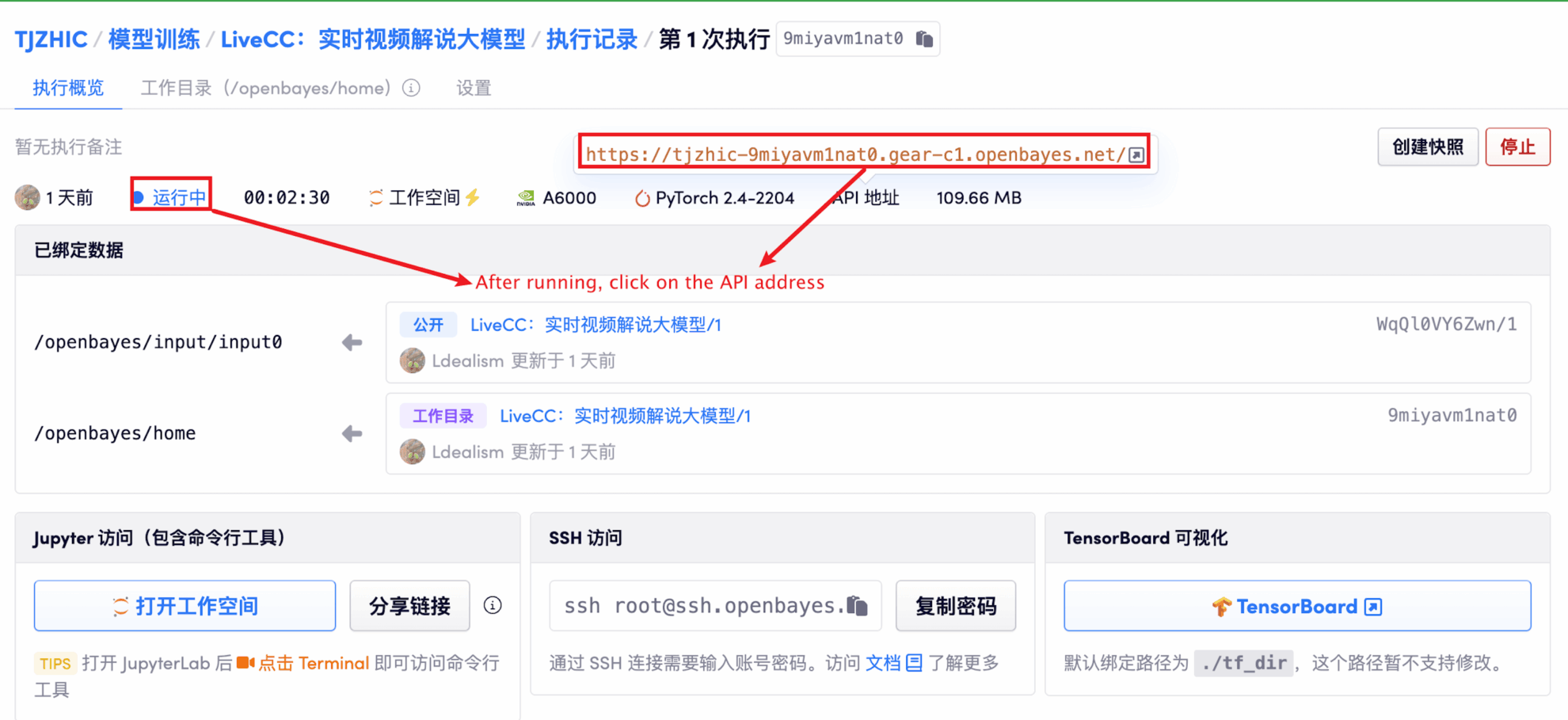

1. コンテナを起動した後、API アドレスをクリックして Web インターフェイスに入ります

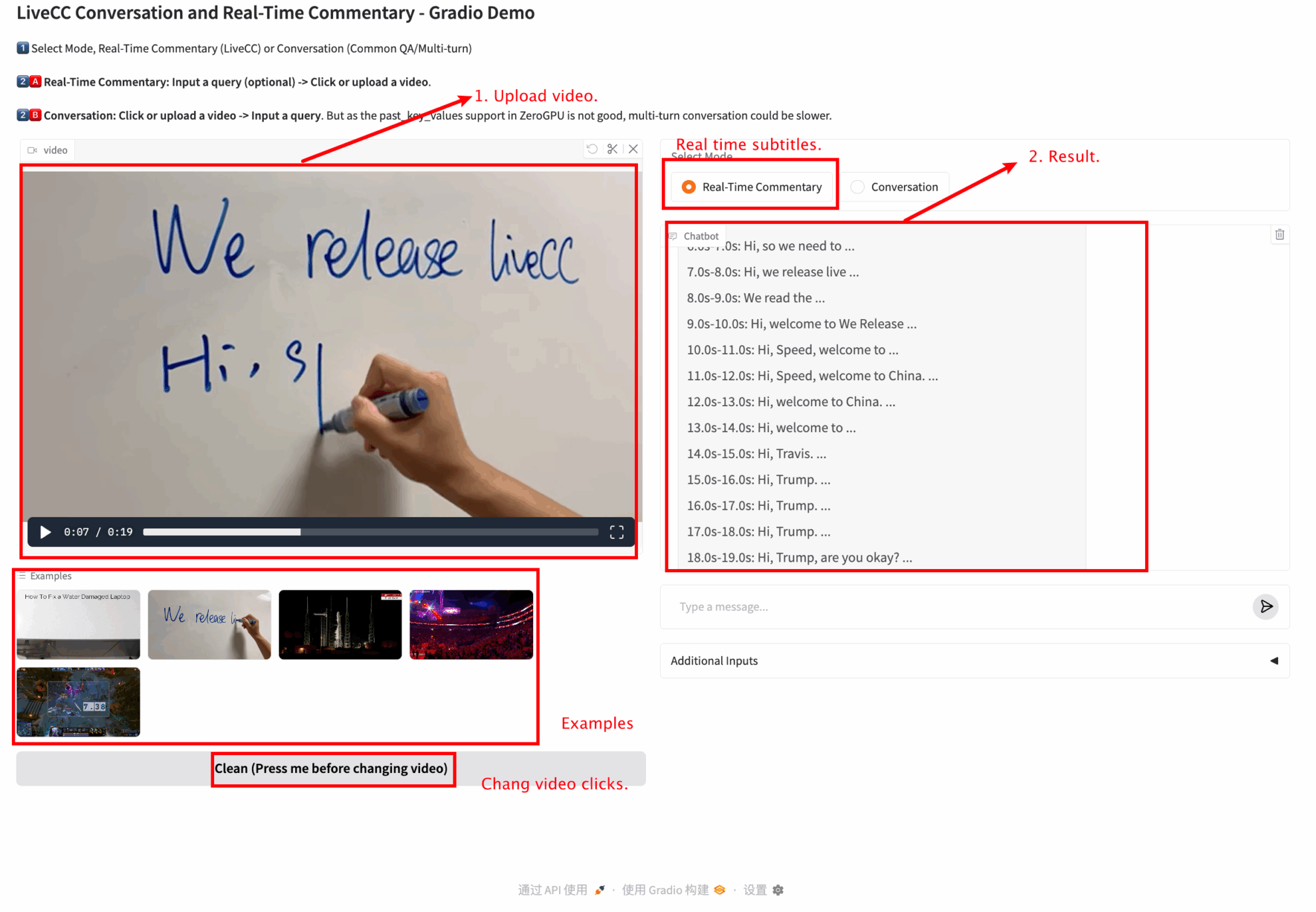

2. ウェブページに入ると、モデルと対話することができます

「Bad Gateway」と表示される場合、モデルが初期化中であることを意味します。モデルが大きいため、1〜2分ほど待ってページを更新してください。

このチュートリアルでは、リアルタイム解説モジュールと会話モジュールの 2 つのモジュール テストを提供します。

リソースの混雑を避けるため、モデルを頻繁に切り替えないでください。

各モジュールの機能は次のとおりです。

リアルタイム解説

🖌️ 高品質のプロジェクトを見つけたら、メッセージを残してバックグラウンドで推奨してください。さらに、チュートリアル交換グループも設立しました。お友達はコードをスキャンして [SD チュートリアル] に参加し、さまざまな技術的な問題について話し合ったり、アプリケーションの効果を共有したりできます。

引用情報

このプロジェクトの引用情報は次のとおりです。

@inproceedings{livecc,

author = {Joya Chen and Ziyun Zeng and Yiqi Lin and Wei Li and Zejun Ma and Mike Zheng Shou},

title = {LiveCC: Learning Video LLM with Streaming Speech Transcription at Scale},

booktitle = {CVPR},

year = {2025},

}