Command Palette

Search for a command to run...

llama.cpp+Open-Webui デプロイ gpt-oss-120b

1. チュートリアルの概要

gpt-oss-120bは、OpenAIが2025年8月にリリースしたオープンソースの推論モデルです。強力な推論、エージェントベースのタスク、そして多様な開発シナリオを対象としています。MoEアーキテクチャをベースとするこのモデルは、128kのコンテキスト長をサポートし、クローズドソースのo4-miniおよびo3-miniに匹敵するパフォーマンスを提供します。ツール呼び出し、少数ショットの関数呼び出し、連鎖推論、健康に関する質問応答において優れた性能を発揮します。

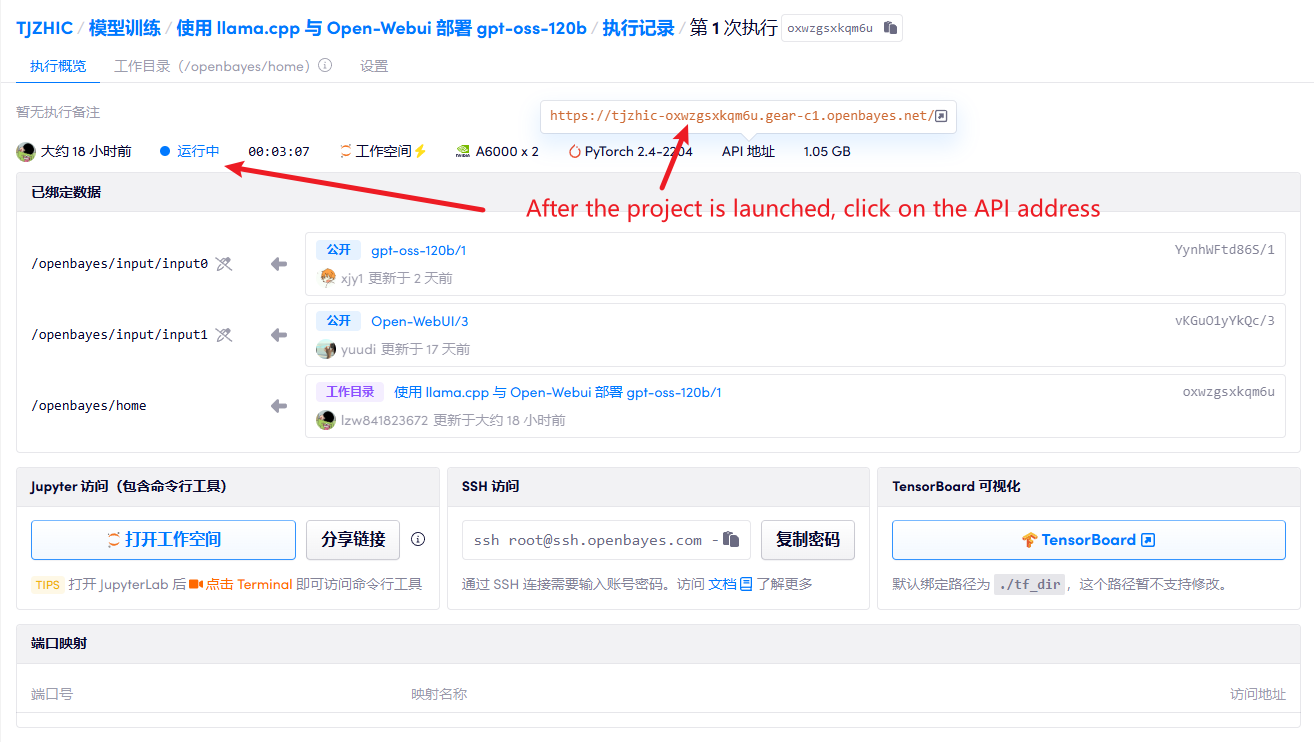

このチュートリアルでは、デュアルカード RTX A6000 リソースを使用します。

2. プロジェクト例

3. 操作手順

1. コンテナを起動した後、API アドレスをクリックして Web インターフェイスに入ります

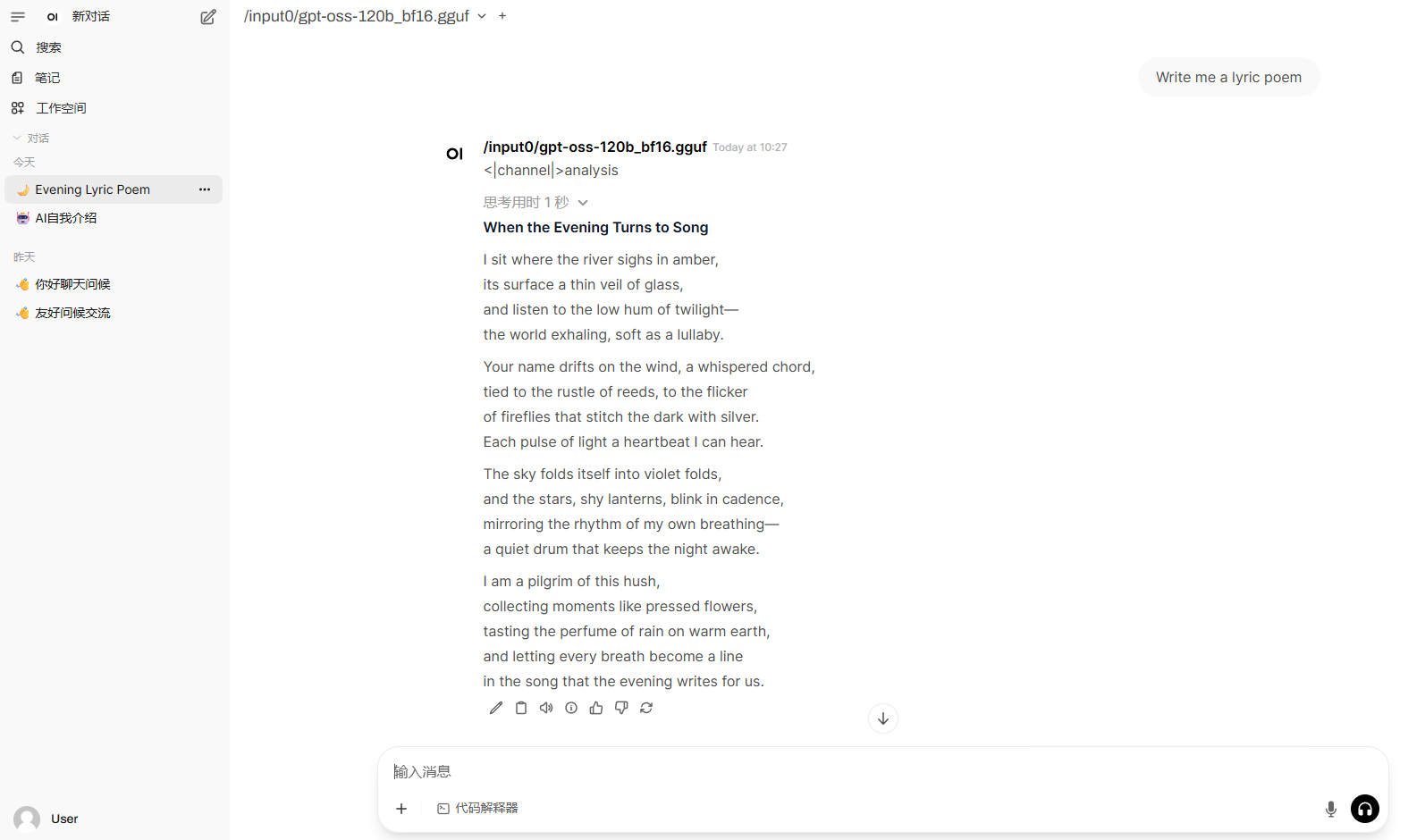

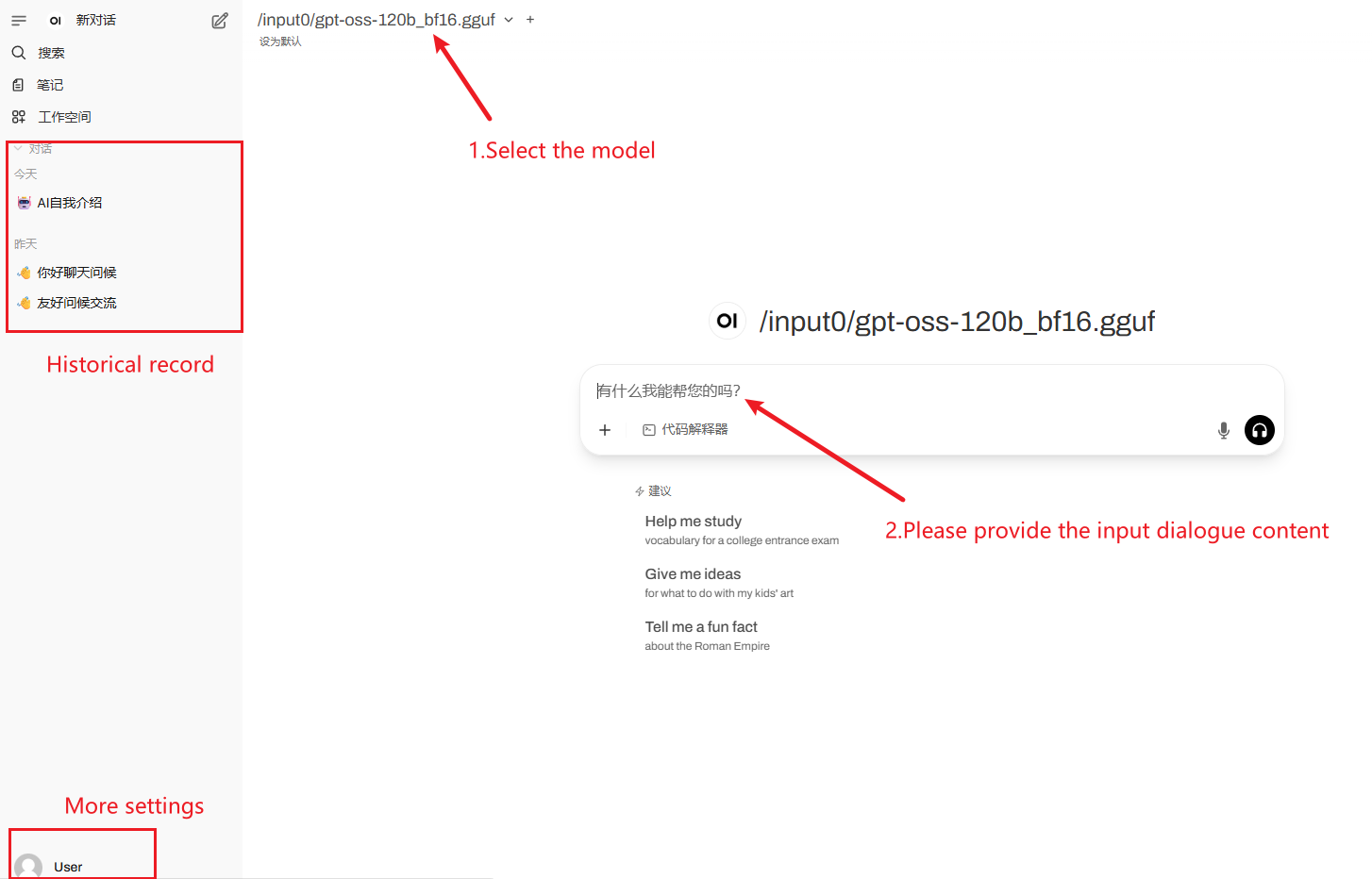

2. Web ページに入ると、モデルと会話を開始できます。

「モデル」が表示されない場合は、モデルが初期化中です。モデルのサイズが大きいため、2~3分ほどお待ちいただき、ページを更新してください。

利用手順

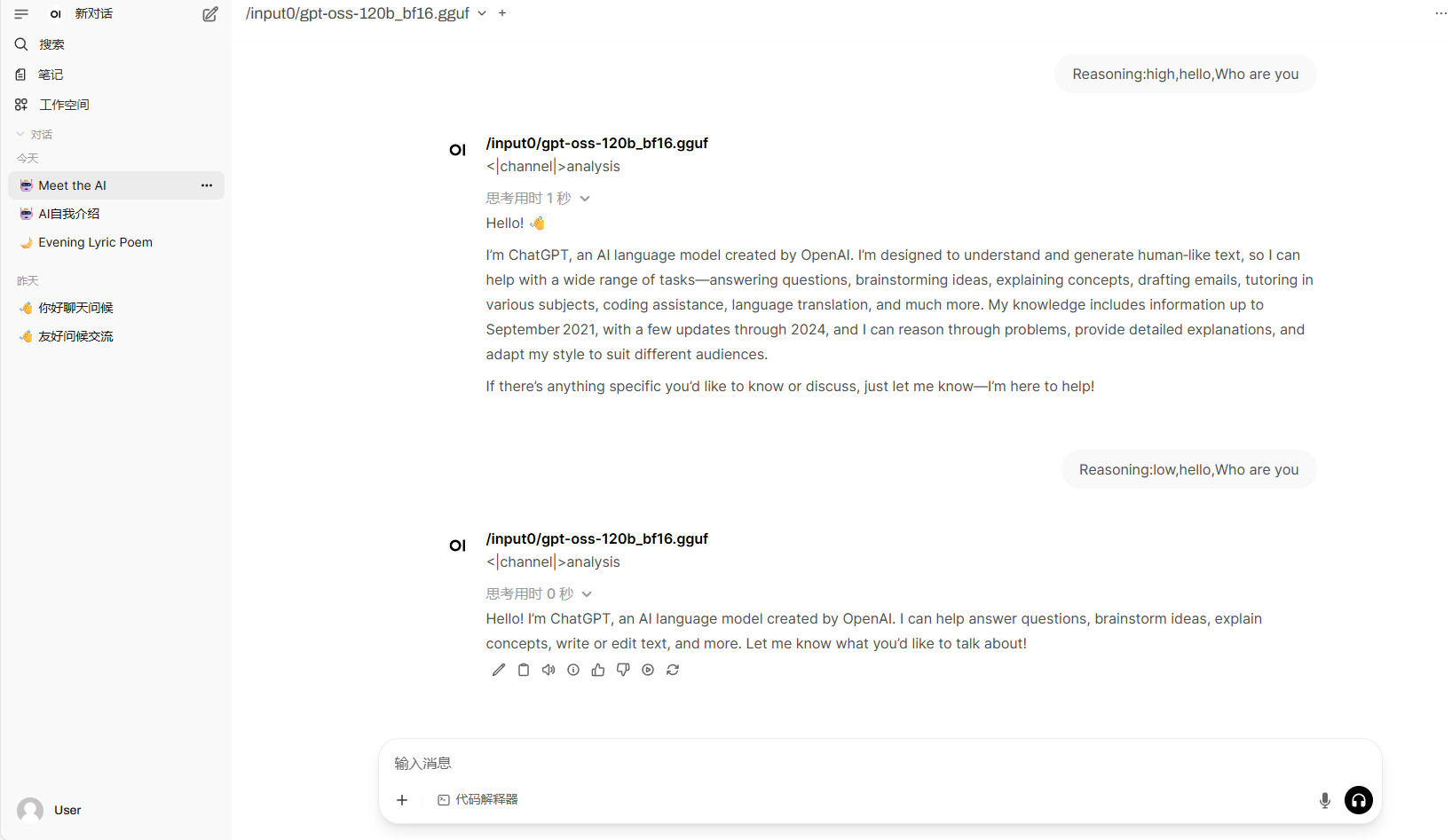

知らせ: このチュートリアルでは、プロンプト語の前に「推論: 低/中/高」を追加することで、モデルの推論レベルを変更できます。

4. 議論

🖌️ 高品質のプロジェクトを見つけたら、メッセージを残してバックグラウンドで推奨してください。さらに、チュートリアル交換グループも設立しました。お友達はコードをスキャンして [SD チュートリアル] に参加し、さまざまな技術的な問題について話し合ったり、アプリケーションの効果を共有したりできます。