Command Palette

Search for a command to run...

BitNet b1.58 2B4Tは、エッジAI展開のための大規模言語モデルを可能にします

1. チュートリアルの概要

マイクロソフトリサーチが2025年4月に発表したBitNet-b1.58-2B-4Tは、人工知能分野における重要な進歩を表しています。オープンソースのネイティブ1ビット大規模モデルとしては世界初となるこのモデルは、従来の量子化技術の限界を克服し、低精度モデルでも性能を維持しながら計算リソースの消費を大幅に削減できることを実証し、エッジデバイスへのローカルAI展開への道を切り開きました。関連研究論文は以下の通りです。 BitNet b1.58 2B4T 技術レポート 。

このチュートリアルでは、デモとして BitNet-b1.58-2B-4T を使用し、イメージには PyTorch 2.6-2204 を使用し、コンピューティング リソースには RTX 4090 を使用します。

2. コア機能

- 効率的なアーキテクチャ: 3 値量子化重み (-1、0、+1) を使用すると、各重みに必要なストレージは 1.58 ビットのみになります。 8ビットのアクティベーション値(W1.58A8構成)と組み合わせると、非埋め込みメモリの使用量わずか0.4 GBとなり、同様のモデル(Gemma-3 1Bの1.4 GBなど)よりもはるかに低くなります。

- トレーニングのイノベーション: ゼロからのトレーニング (ポスト量子化ではない)、BitLinear レイヤー、2乗 ReLU アクティベーション関数、および RoPE 位置エンコーディングを導入して、低精度トレーニングの安定性を確保します。

- エネルギー消費の利点: CPU 推論のレイテンシは 29 ミリ秒と短く、エネルギー消費はわずか 0.028 ジュール/トークンで、Apple M2 などの CPU での効率的な操作をサポートします。

3. 操作手順

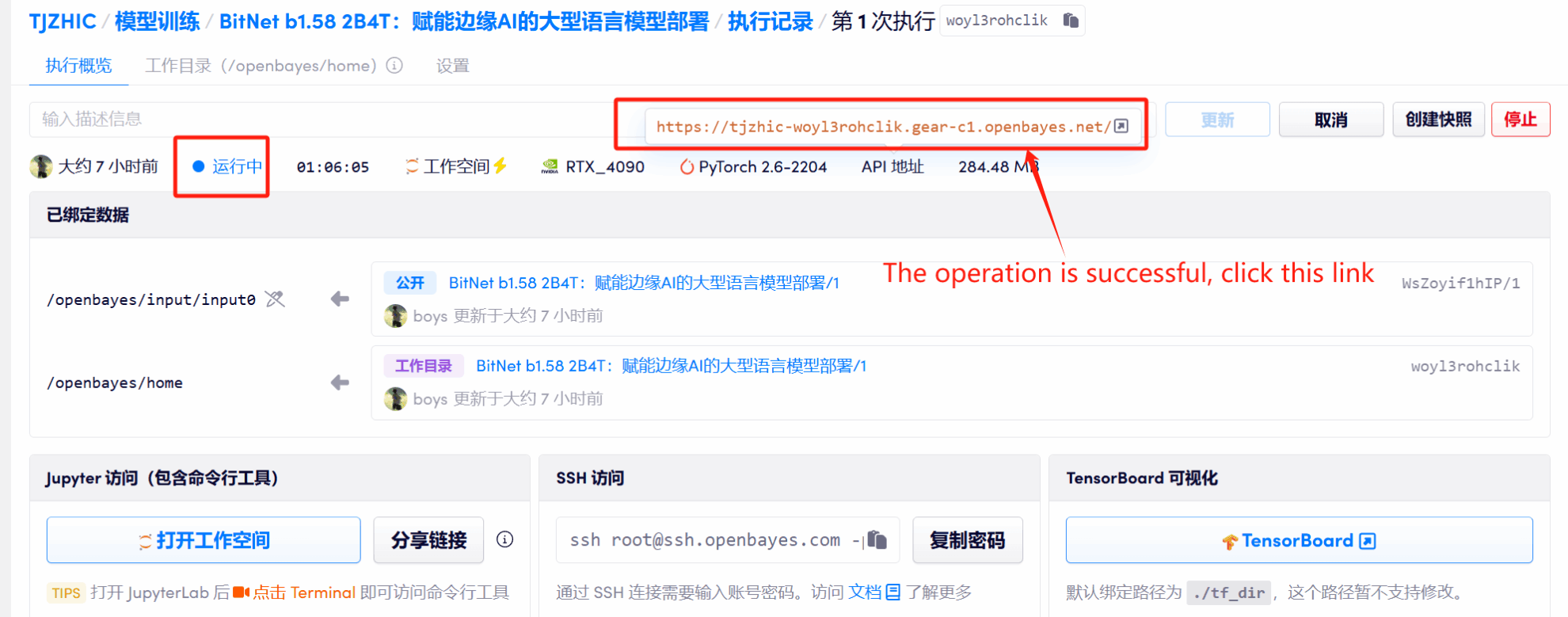

1. コンテナを起動した後、API アドレスをクリックして Web インターフェイスに入ります

「Bad Gateway」と表示される場合、モデルが初期化中であることを意味します。モデルが大きいため、1〜2分ほど待ってページを更新してください。

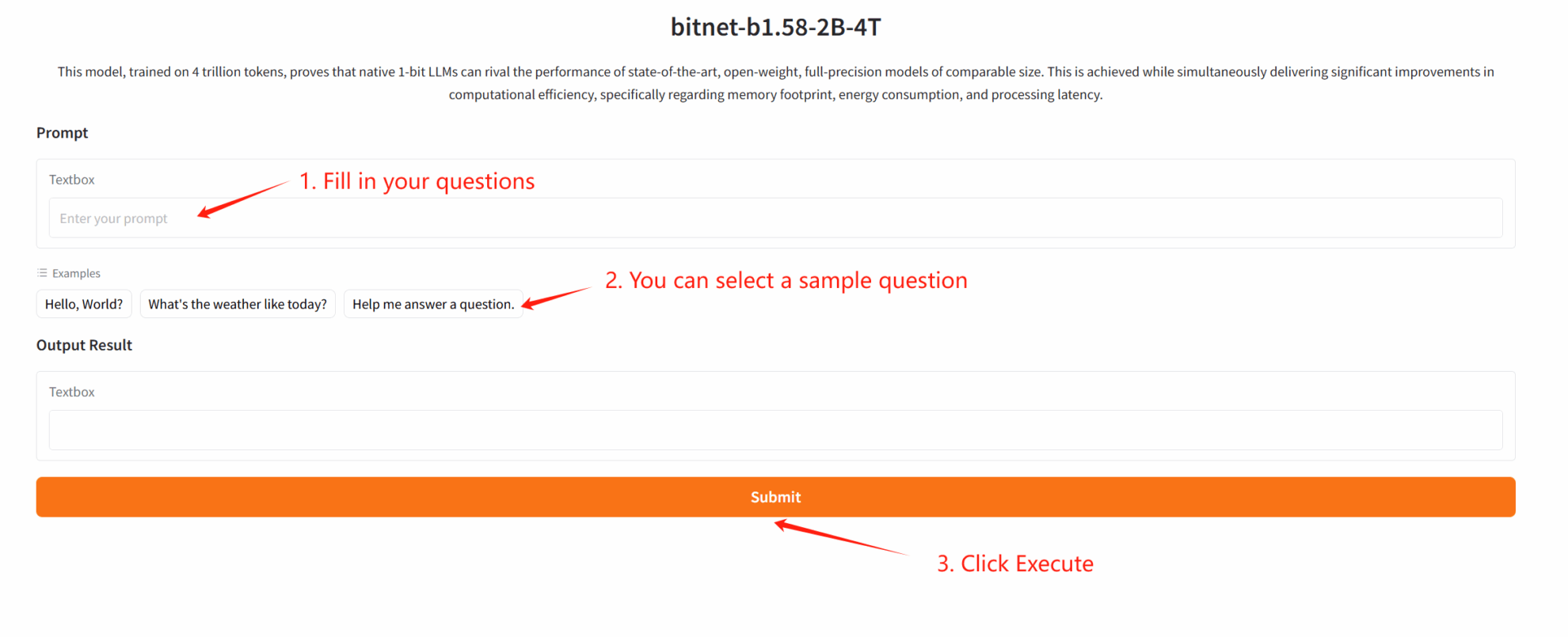

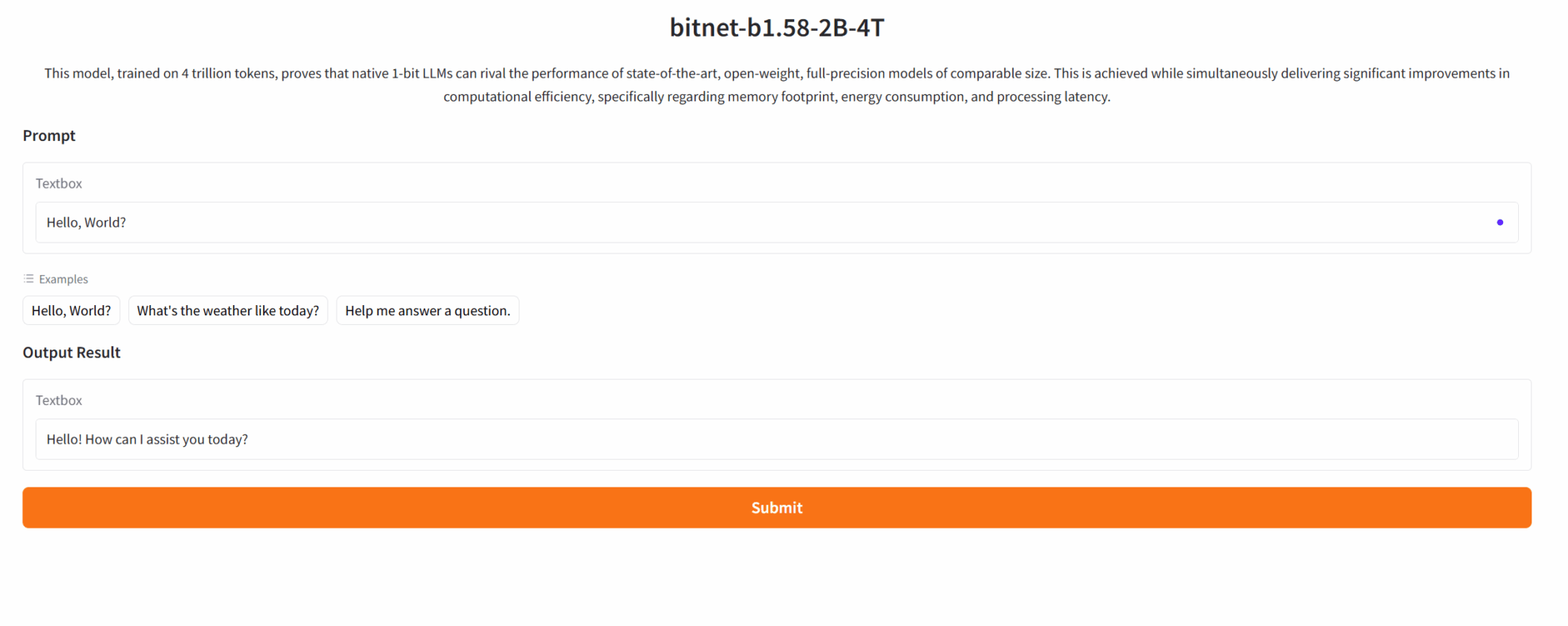

2. 機能デモンストレーション

交流とディスカッション

🖌️ 高品質のプロジェクトを見つけたら、メッセージを残してバックグラウンドで推奨してください。さらに、チュートリアル交換グループも設立しました。お友達はコードをスキャンして [SD チュートリアル] に参加し、さまざまな技術的な問題について話し合ったり、アプリケーションの効果を共有したりできます。